stable diffusion 入门教程

sd基础

工作原理&入门

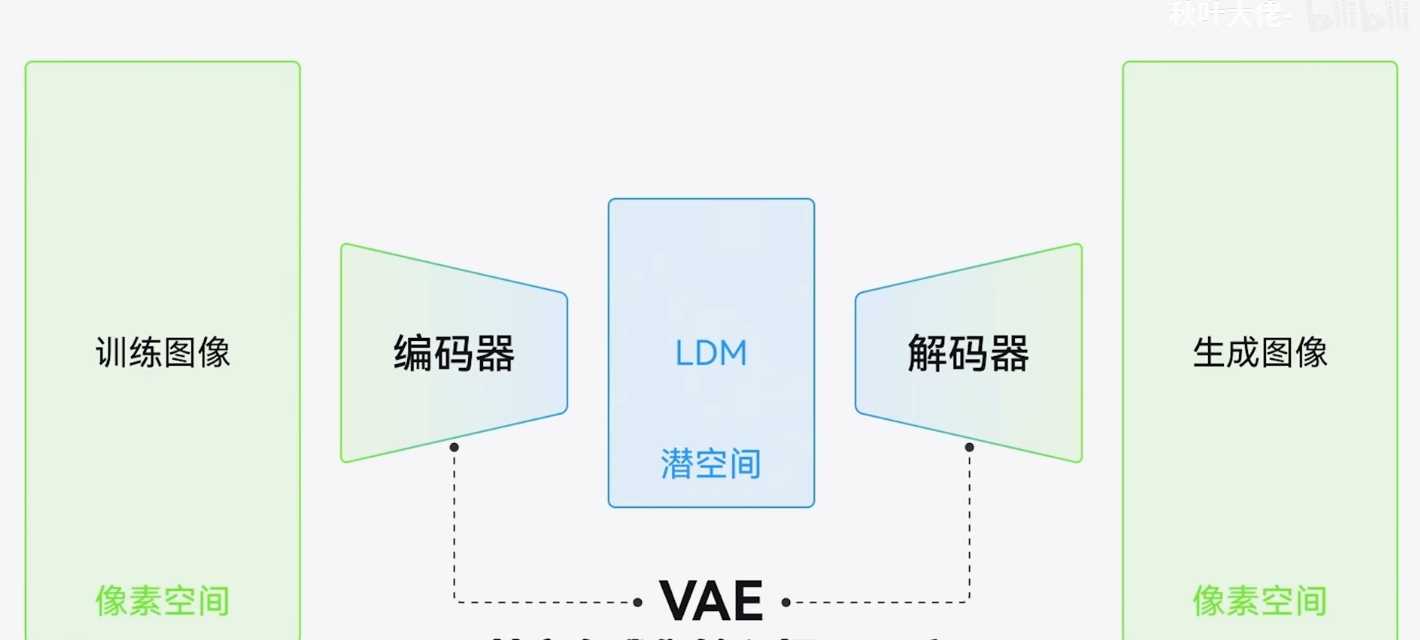

输入提示词后 有文本编码器将提示词编译成特征向量,vae编码器将特征向量传入潜空间内,特征向量在潜空间内不断降噪,最后通过vae解码器将降噪之后的特征向量 解码成一个个像素组成的图片

一般选中默认vae模型

解码编码的模型

CLIP值越大,提前停止的越快,我们提示词被数字化的层数越少,提示词的相关性越小。反之越小越能丰富提示词

CLIP终止层数一般为2

其他功能

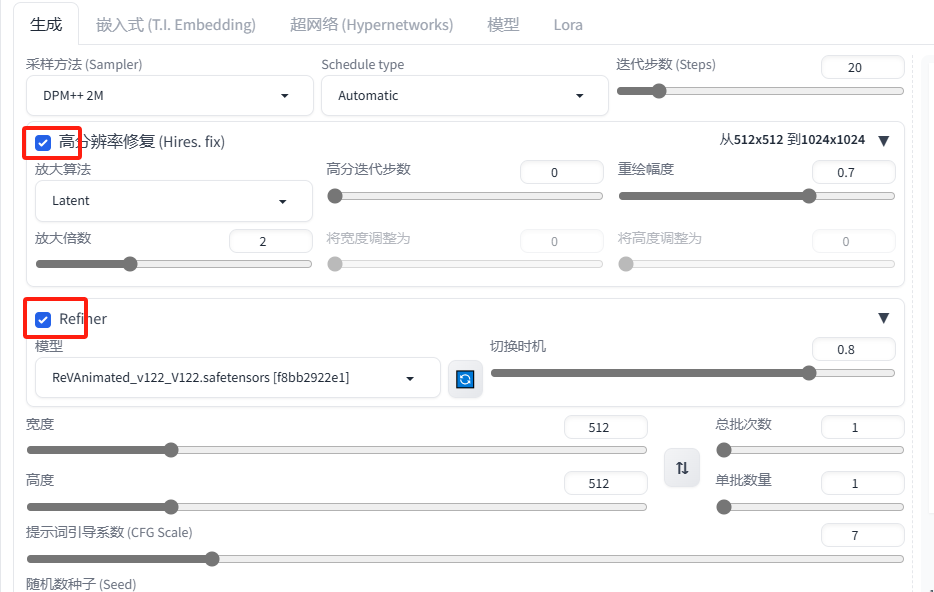

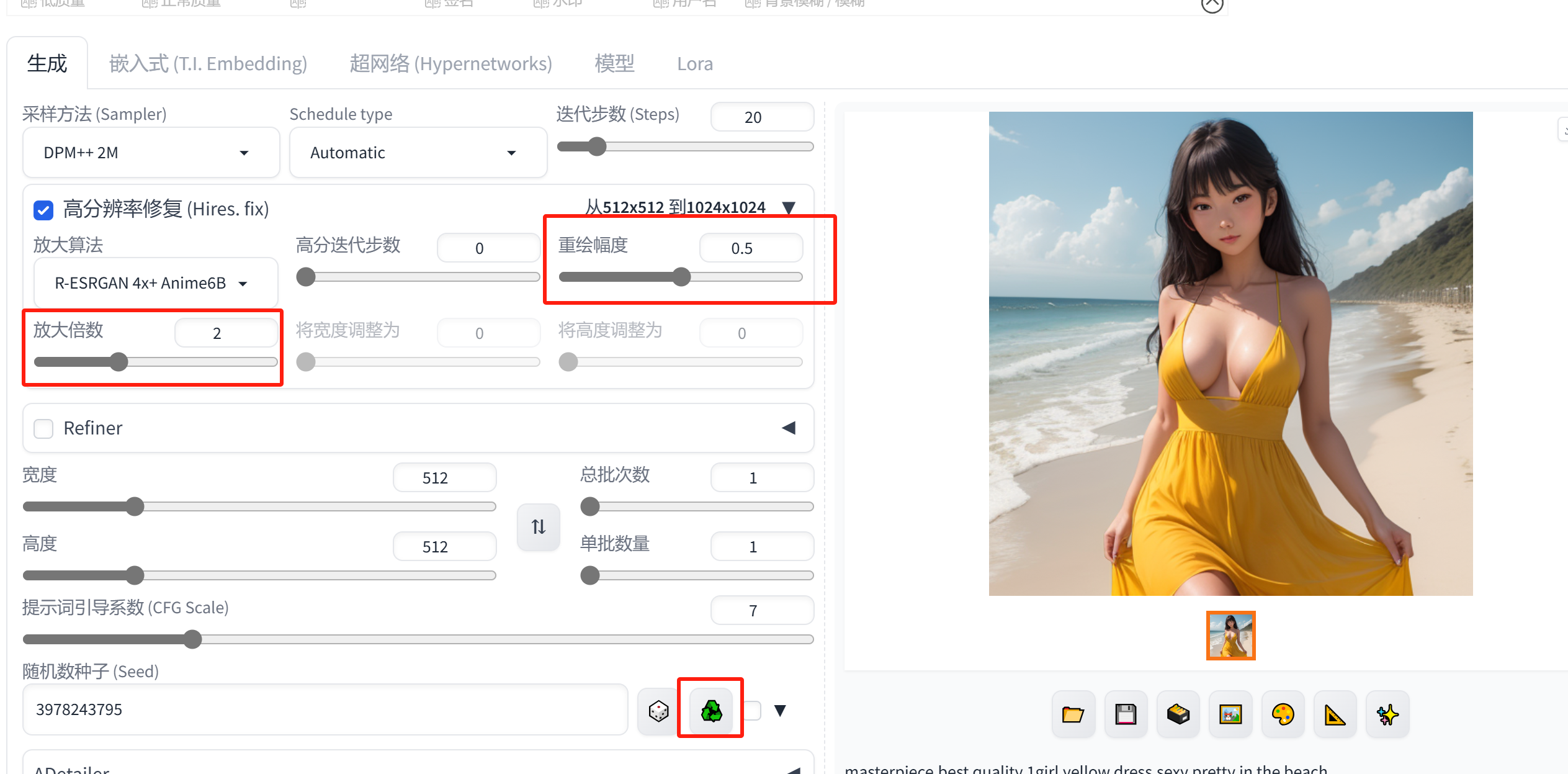

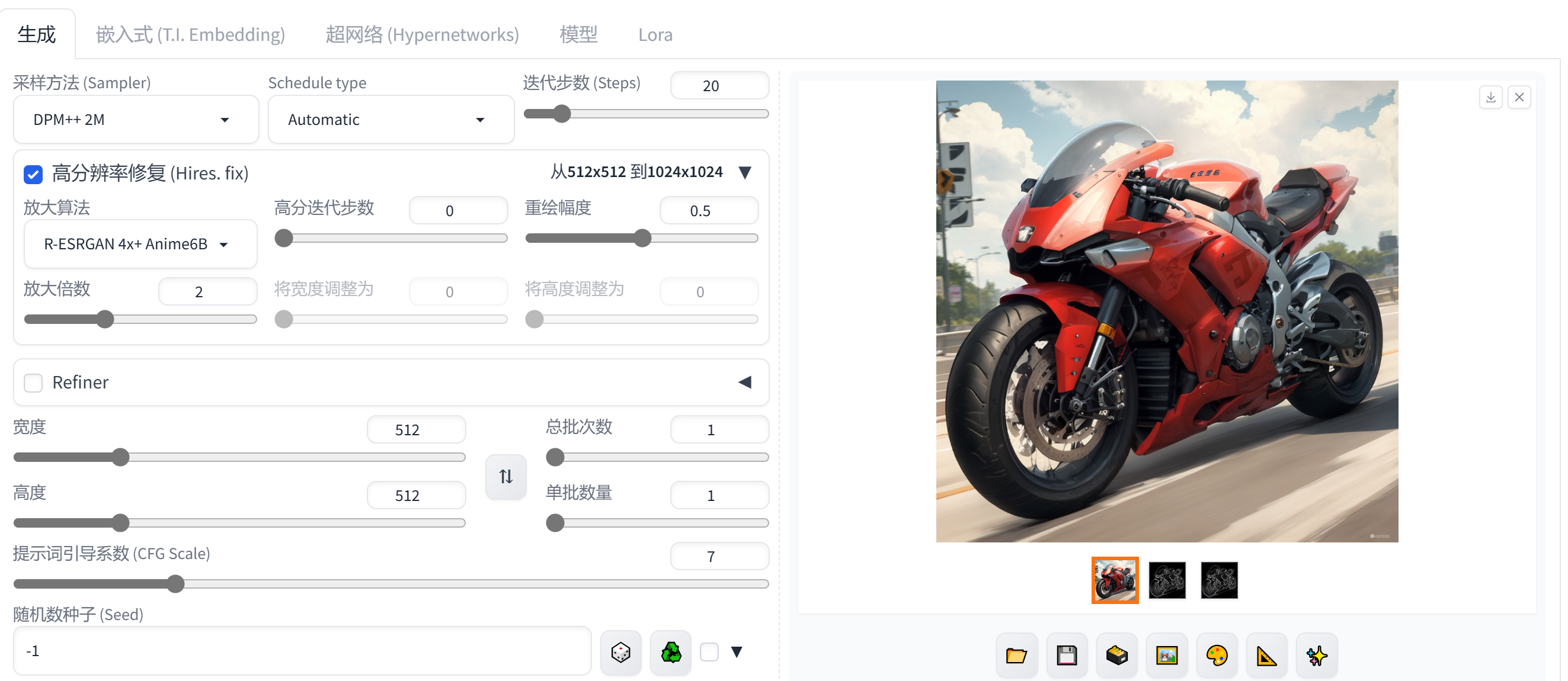

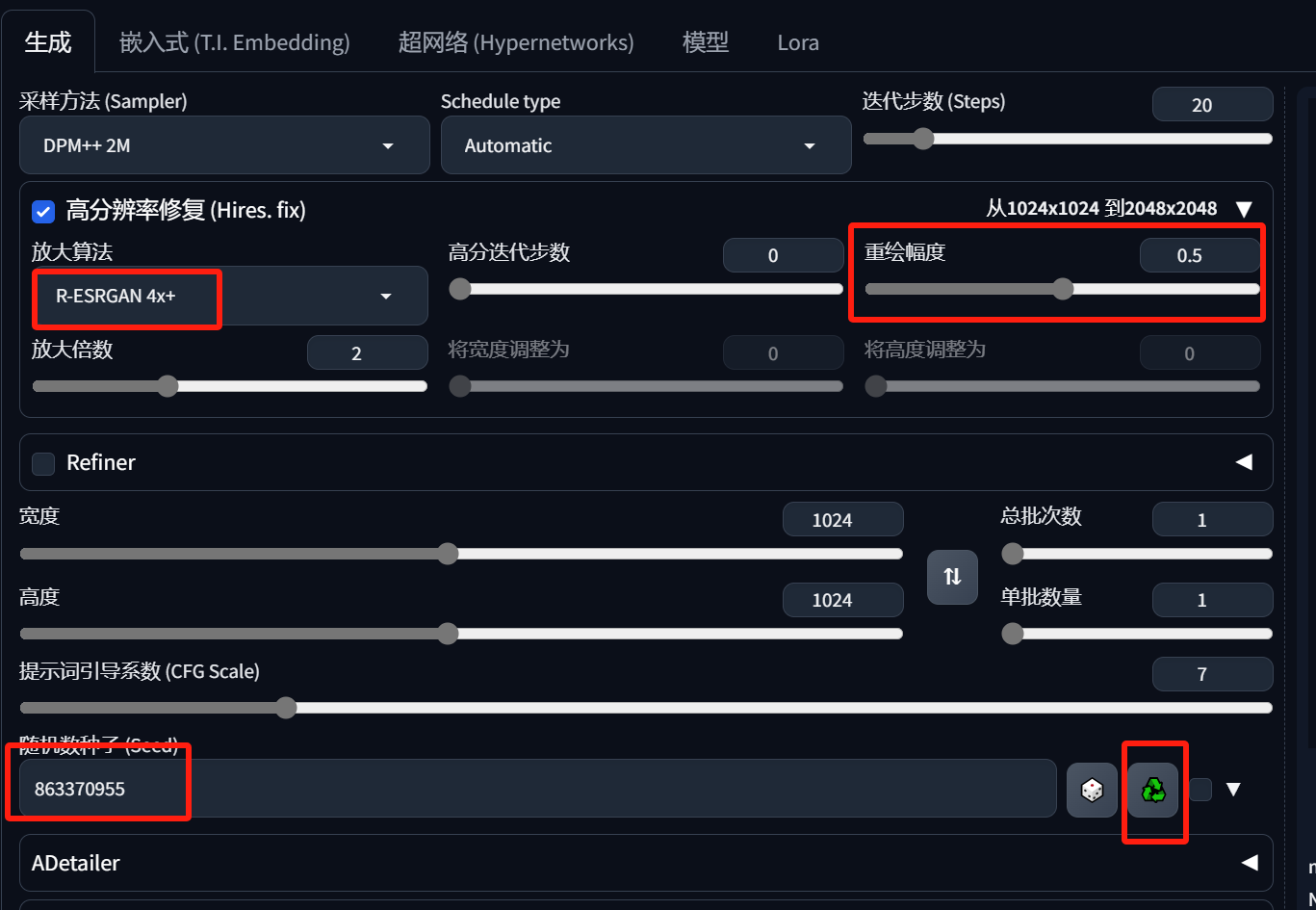

1.Hires.fix 高清修复

2.Refiner 当渲染到80% 切换另一个模型渲染

3.CFG 一般为5-10 越小ai越自由,越高越靠近提示词

4.随机种子 提示词一样,随机种子一样则可以在不同电脑生成相同图片

5.迭代步数越高 20-30 图片质量越高,步数过高则失真,且消耗更多时间,有时候还没有效果

ADetailer 修复人物的脸

采样方法 DPM++2M

网站,模型推荐

liblib NovelAI hugingface promlib civitai github

majicmix dreamshaper primemix architectrealmix

提示词 语法

英文和英文的标题符号

权重

数字越高权重越高,画面着重描述什么

[cat]=(cat:0.9)

(cat)=(cat:1.1)

{cat}=(cat:1.05)

[[cat]]=(cat:0.9x0.9)=(cat:0.81)

((cat))=(cat:1.1x1.1)=(cat:1.21)

ctrl + 上箭头 可以快捷调节 权重多低都行,过高则不行,会失真

短句与长句

一个一个词的拼写,而不是一句话呢

一个个词组会更准确,而且好调整权重

提示词控制在75个以内,正反向一样,不超过75

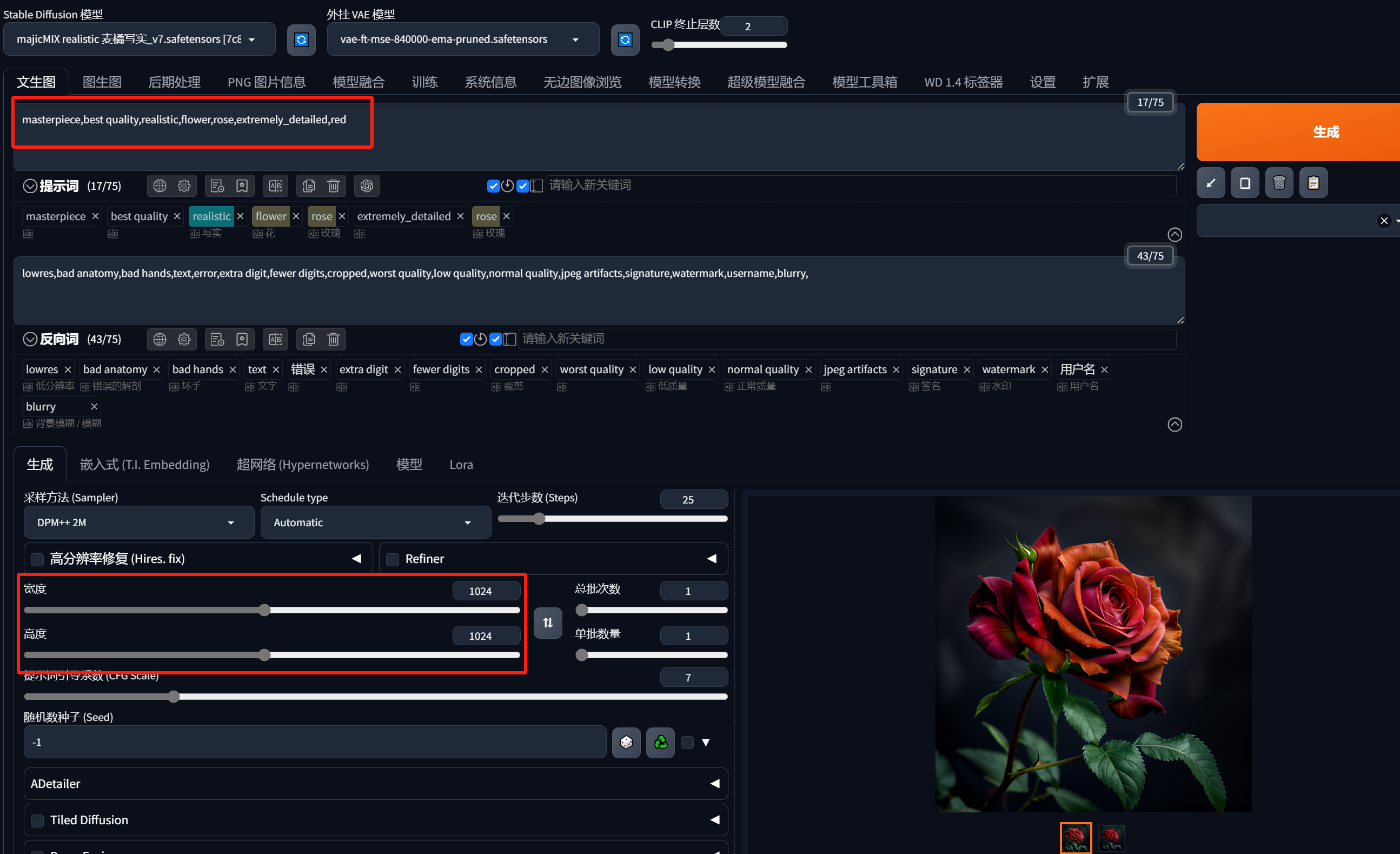

起手式

正向 4k masterpiece 会让图片更加精美

反向则用 text blur之类

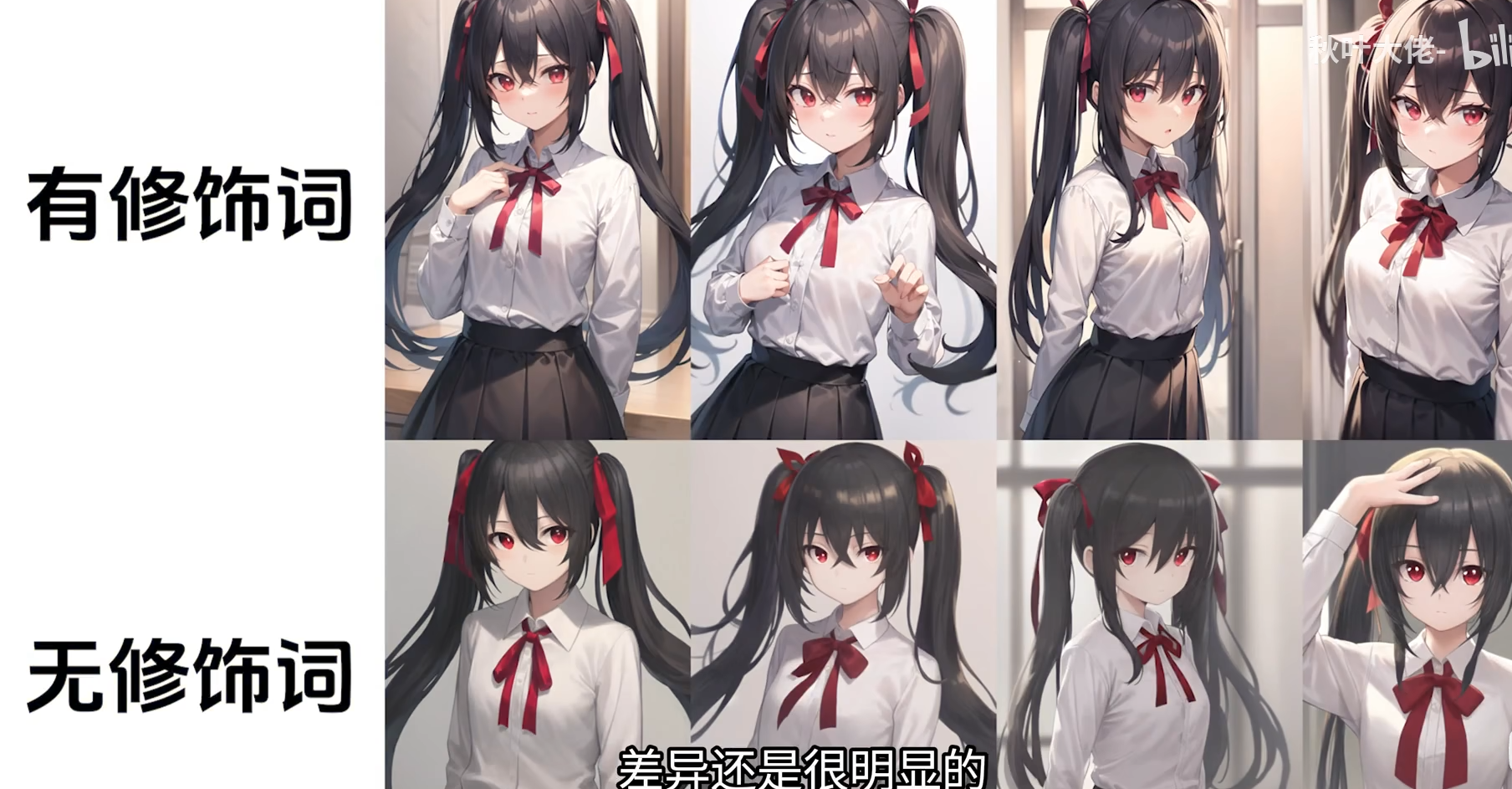

有修饰词

提示词顺序,越靠前权重越高

no.1 画质词/画风词

no.2 主题 one girl

no.3 环境/场景/构图

no.4 lora

提示词污染

1girl,blue dress,pink hair,green umbrella,

1girl,blue dress,red hair,puple umbrella,

防止提示词尤其是颜色相互渗透 使用break隔开

提示词融合

1girl,cat 猫在女孩身上

1girl And cat 猫娘 (1girl_cat 有同样效果)

[cat|dog] 也有融合效果

{forest:1girl:0.3} 在30%的时候结束画forest

{forest:1girl:0.7} 在70%的时候结束画forest

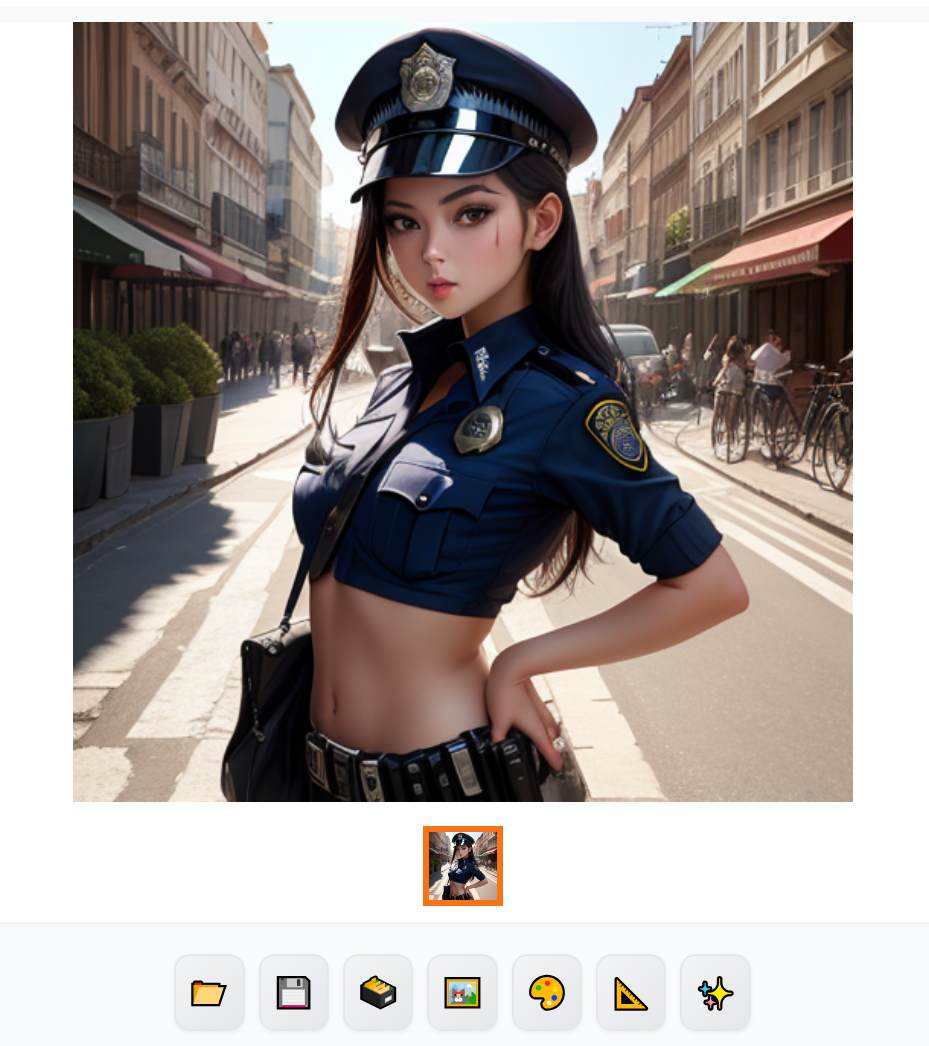

图生图&高清修复

通过图片加提示词生成结果

使用预设起手式,并添加进提示词

通过插件来快速选择自己想要的提示词

masterpiece,best quality,1girl,police,glamor,in summer,street,

将参考图拖入图生图并增加提示词

masterpiece,best quality,1girl,police,glamor,in summer,street,coat,

增加提示词coat,通过原图再次生图

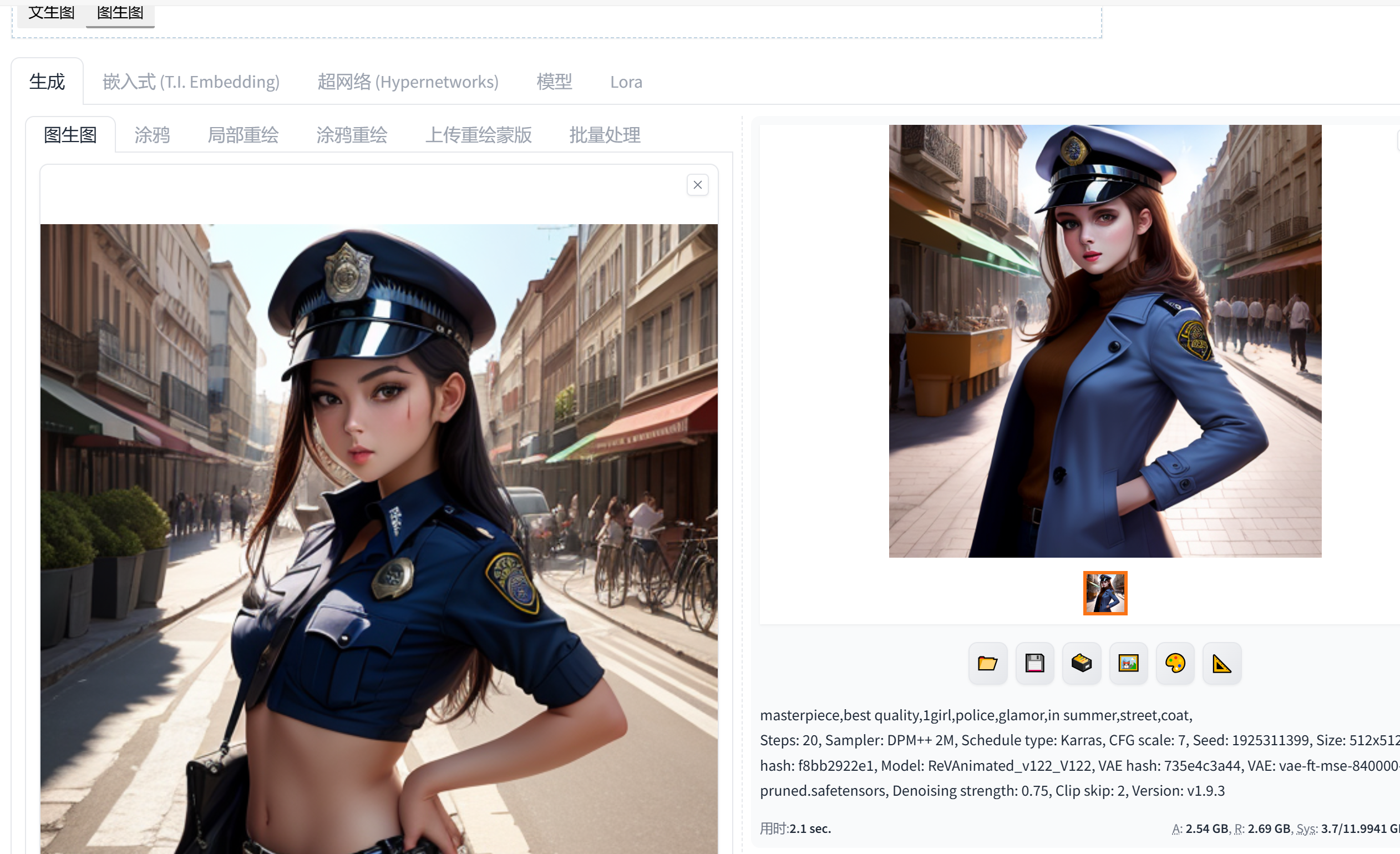

图生图重绘幅度,不过高也不过低 0.3-0.5结果图与参考图之间差距不会太大

0.5-0.7赋予ai更多想象空间

低于0.3 或大于 0.7则扭曲变形

局部重绘,增加sunglasses提示词

upscale 二次元

GAN 4X Anime6B 适合动漫放大 (Gan生成式对抗网络简称)

重绘幅度 0.3-0.5安全区间 0.5-0.7ai自由领域

放大倍数x2 512 变为1024

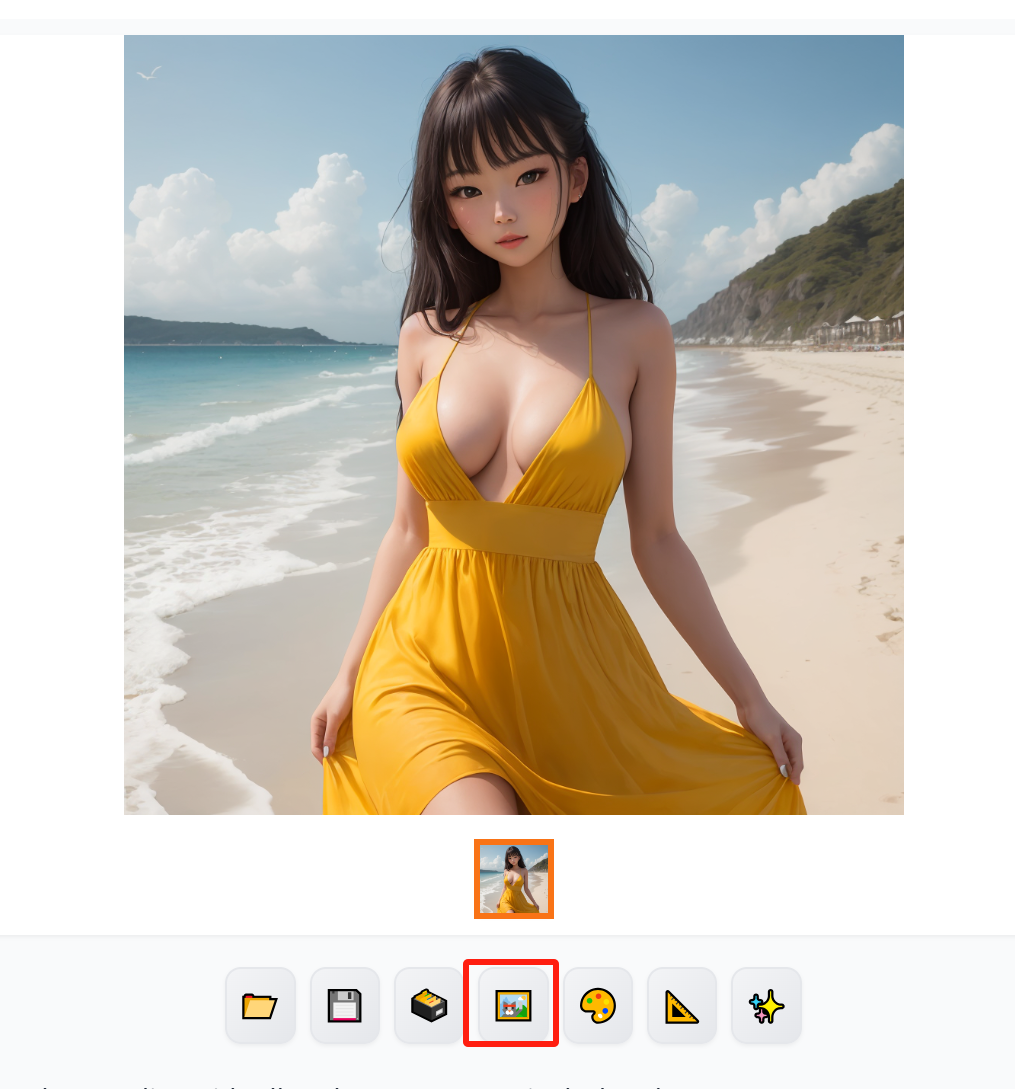

文生图界面

文生图界面的放大需要锁定种子

再次点击小图标来到图生图,再次放大

无需锁定种子

再次放大 模型放大

从512缩放到1024

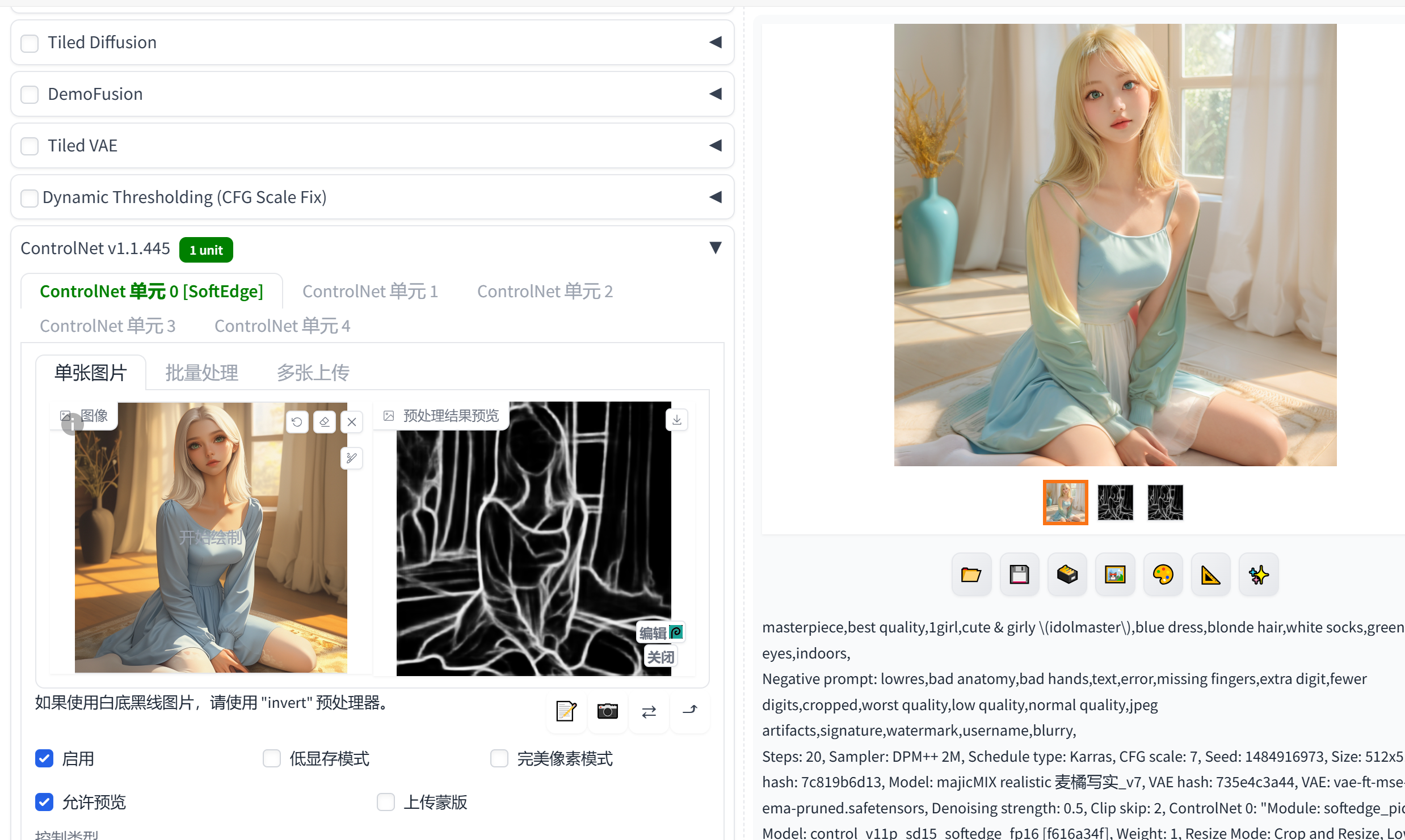

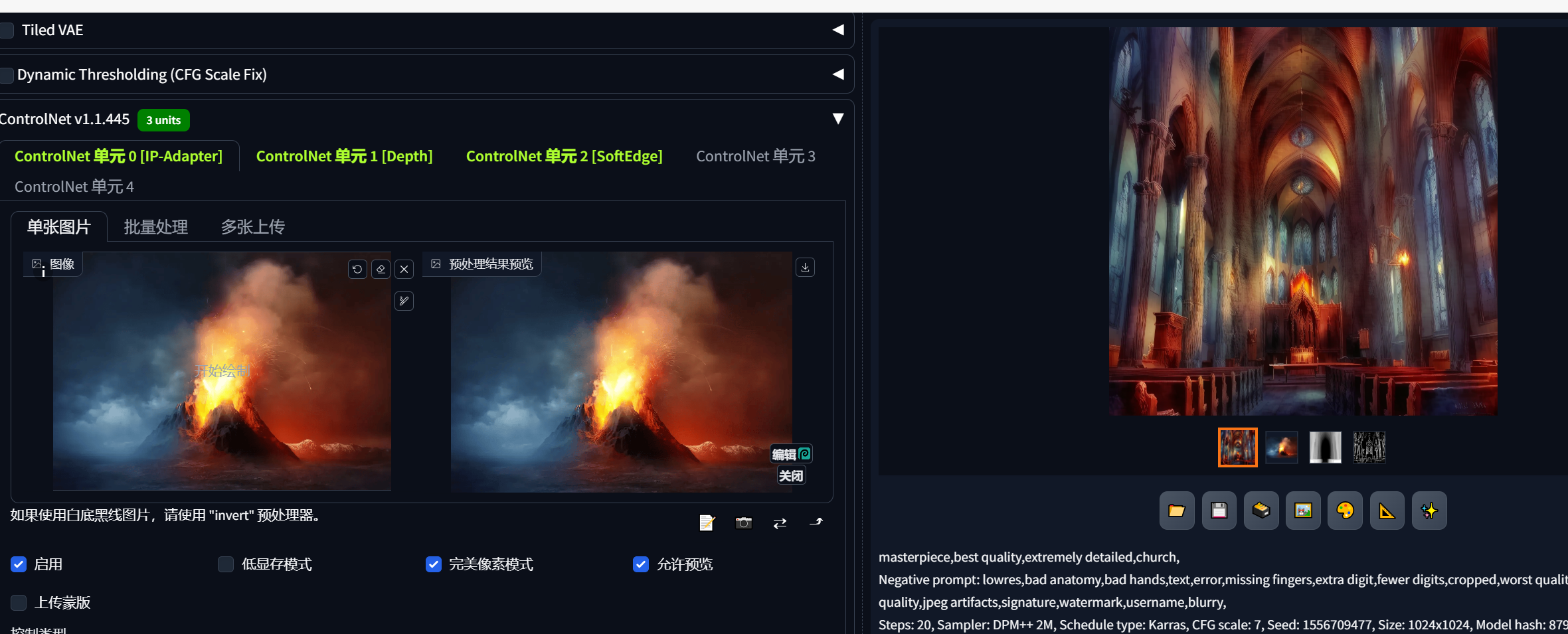

controlnet

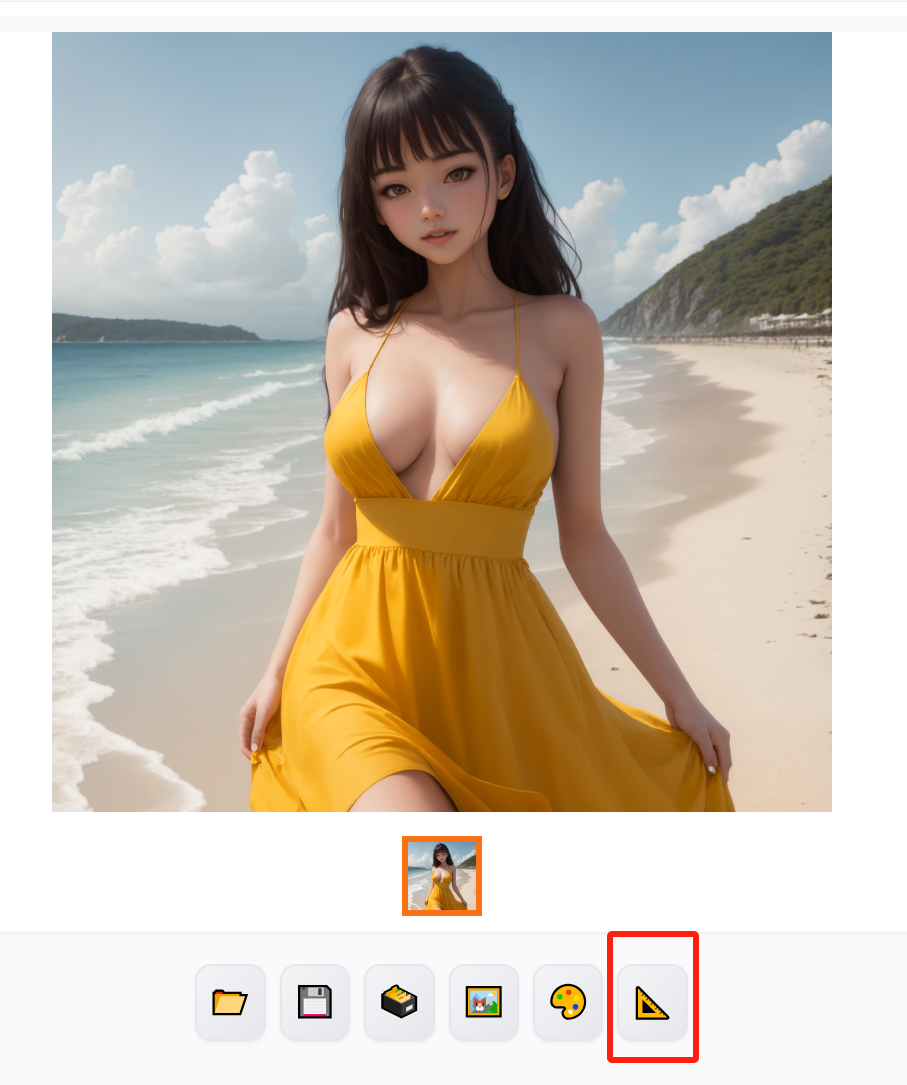

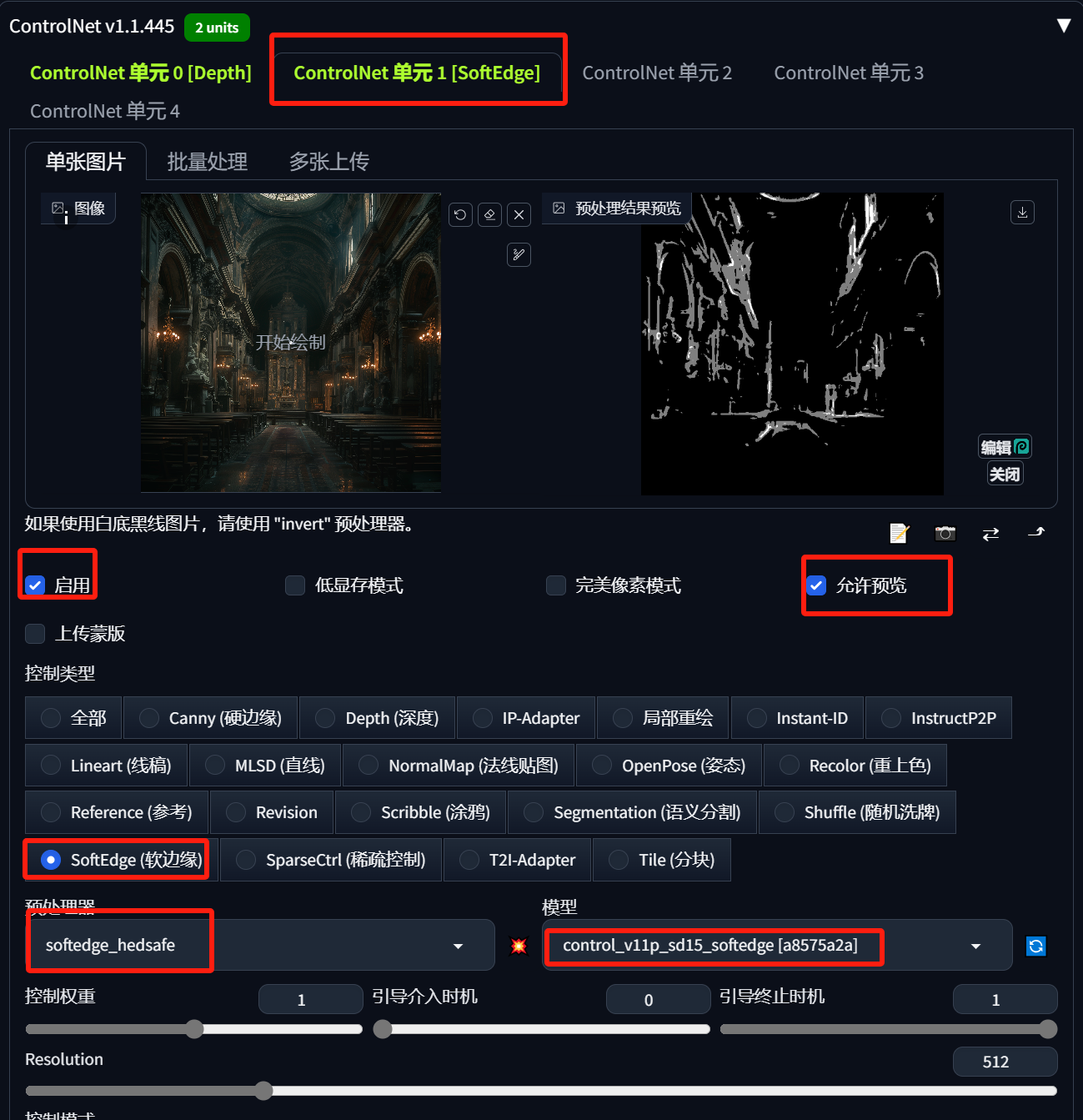

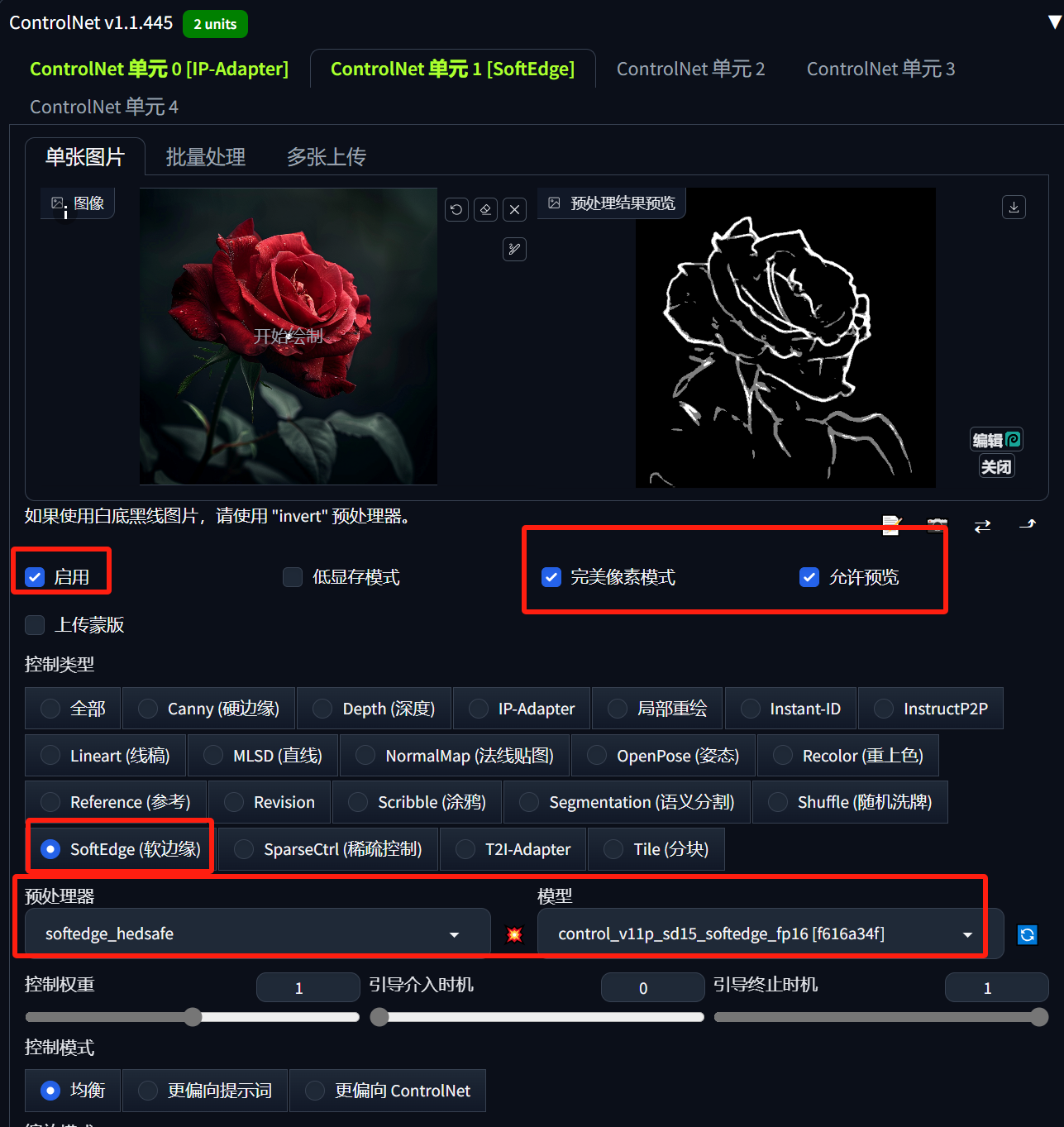

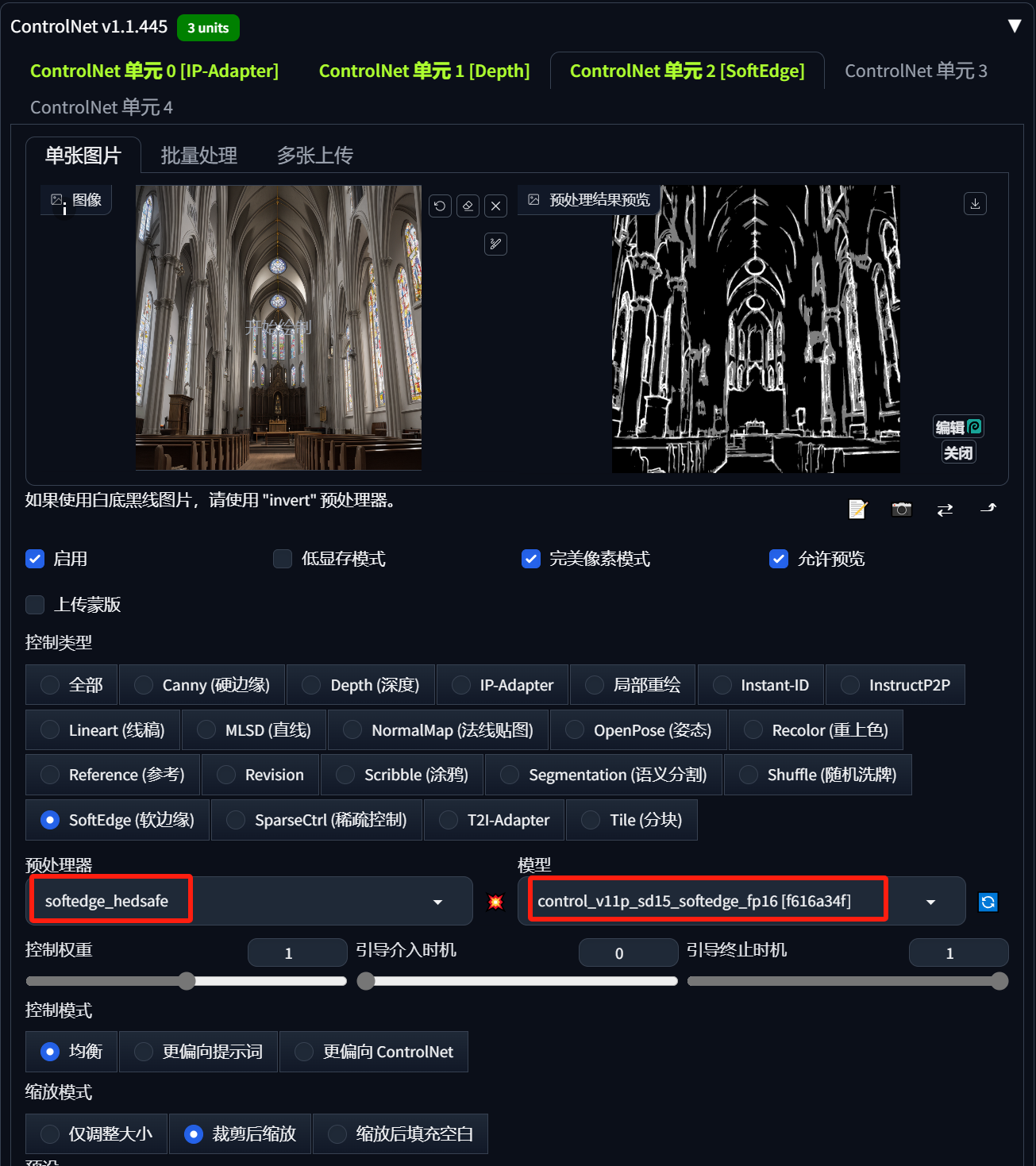

风格转换 softedge

最开始能通过线条处理还原参考图的只有canny

canny 硬边缘 canny将参考图通过细线勾勒出来 架构基于相邻像素计算差值,死板,图片会出现莫名奇妙的元素

softedge 全能模型 将主体勾勒

开启插件controlnet

pidinet 与 hed

hed 保留图片更多细节,完整性好 建筑,场景

pidinet 能够更好保留主体,忽视细节 人物

使用真实系的模型,将二次元图片好好描述

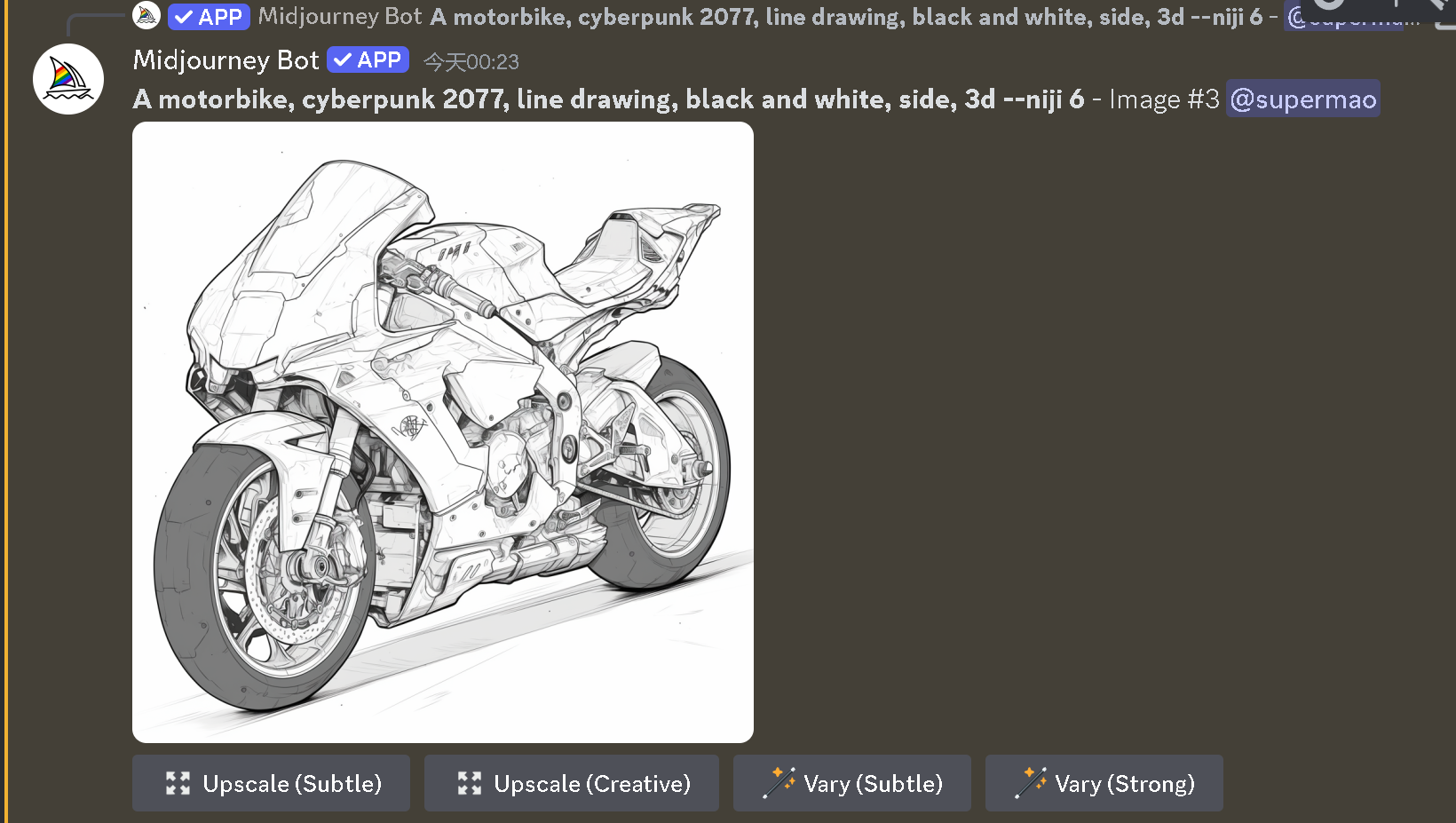

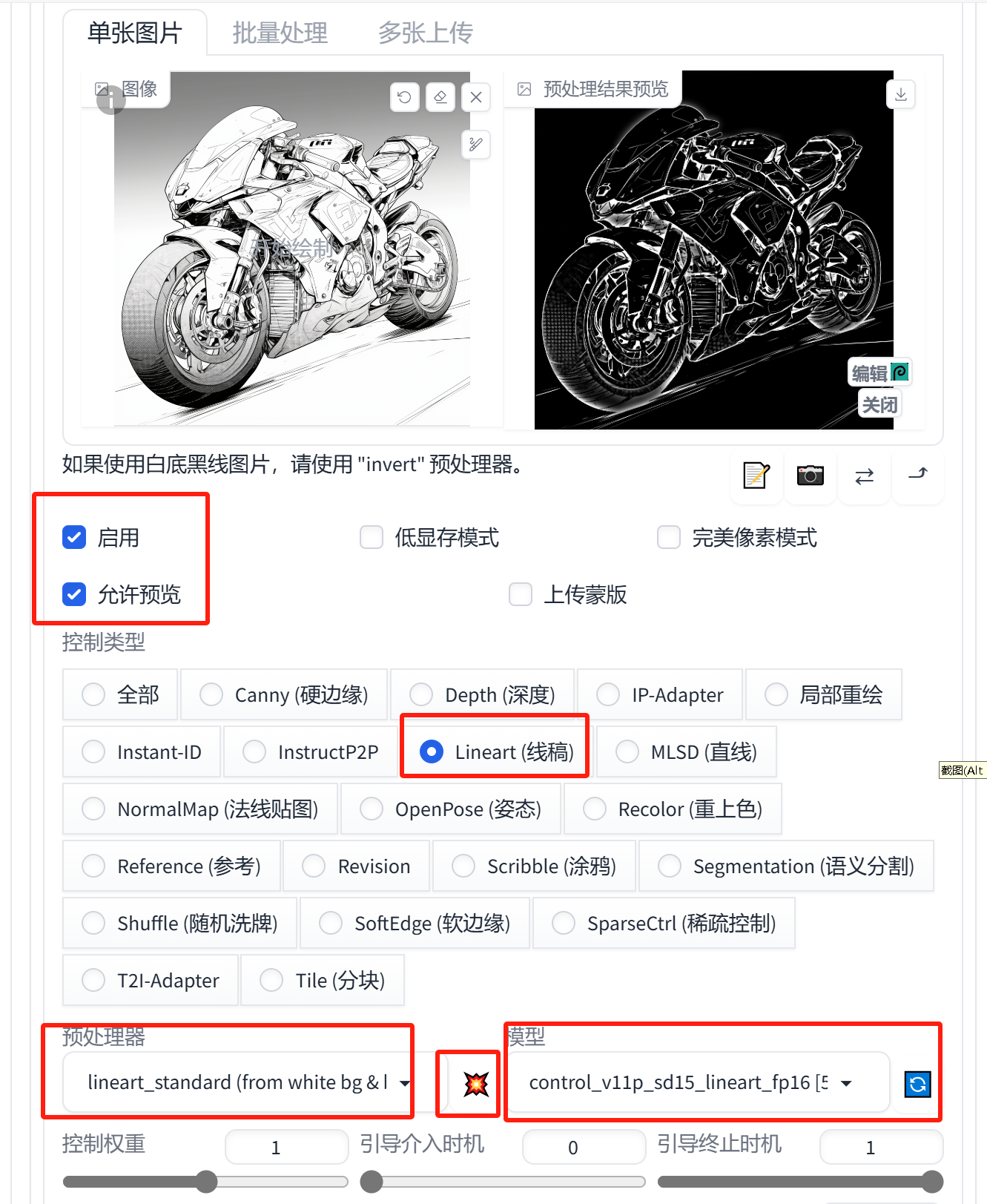

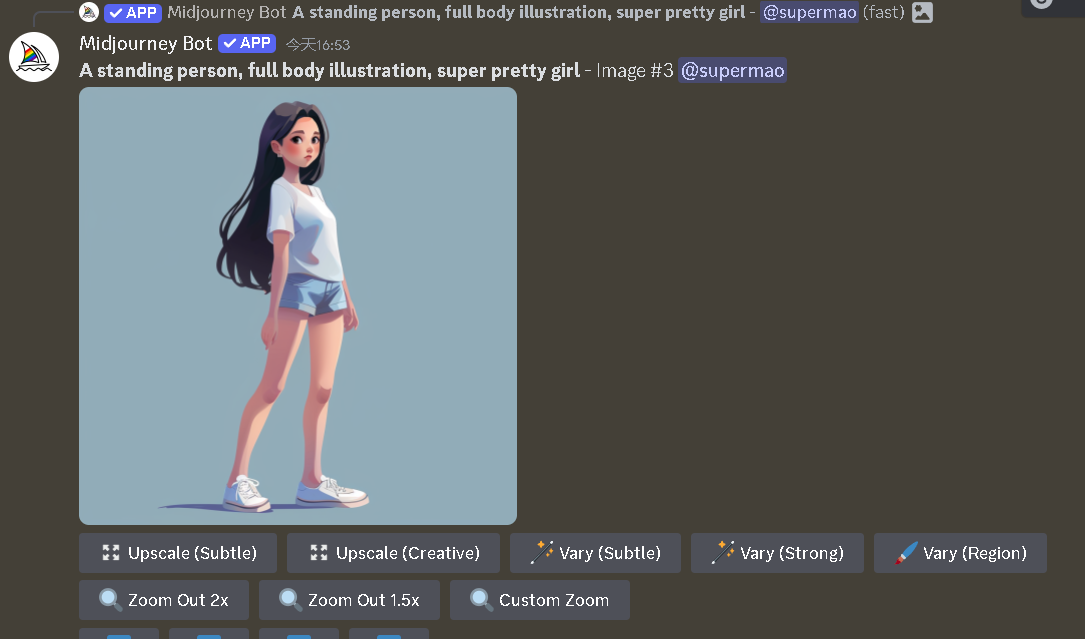

线稿上色 Lineart

lineart多用于线稿上色动漫类图像处理

mj 生成线稿

点击爆炸按钮后,会有去下载插件,如控制台显示git网络失败,手动去下载到相应目录解压

最好宽高比 和原来图片一样 也就是宽度和高度

controlnet-2

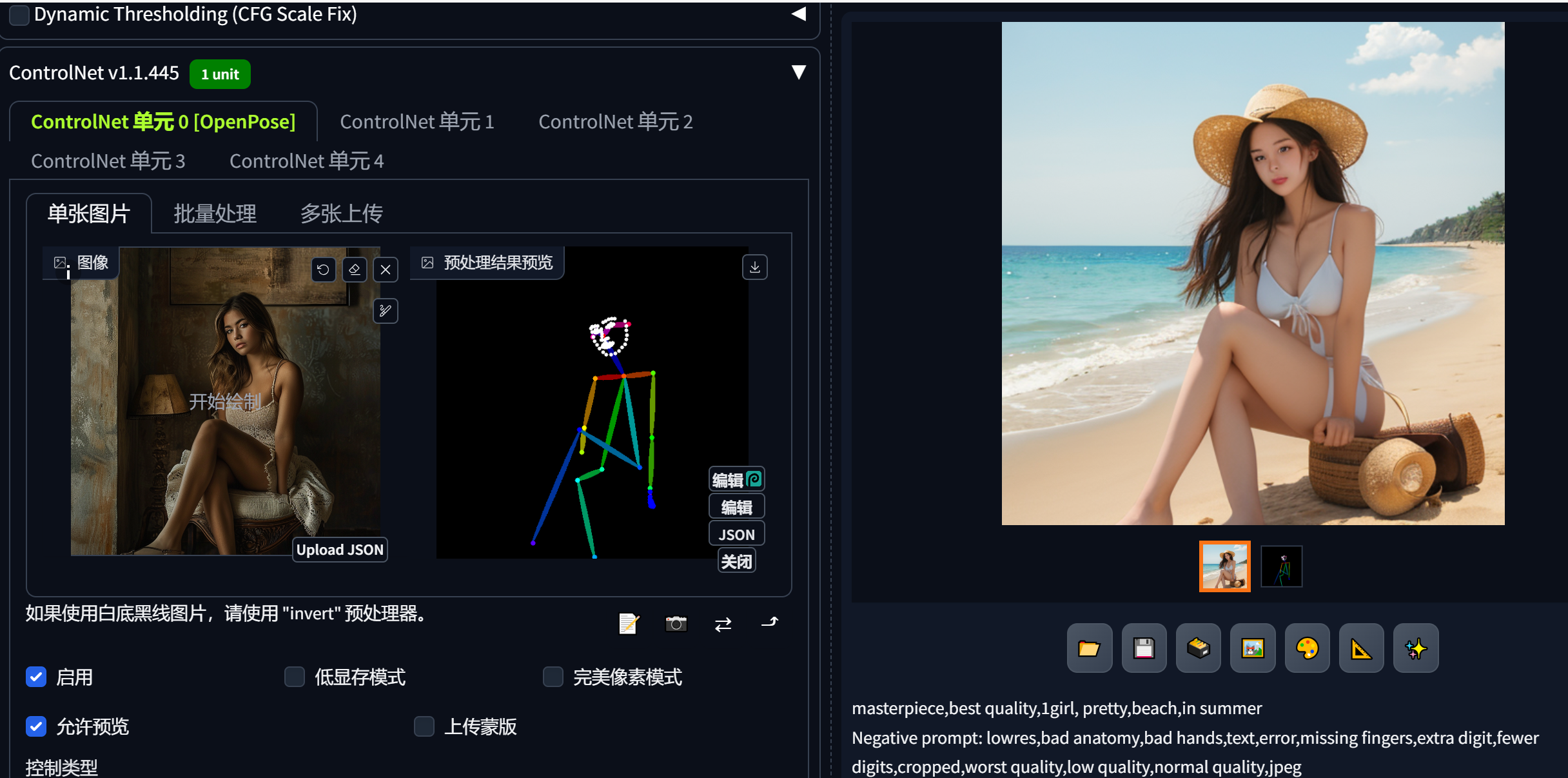

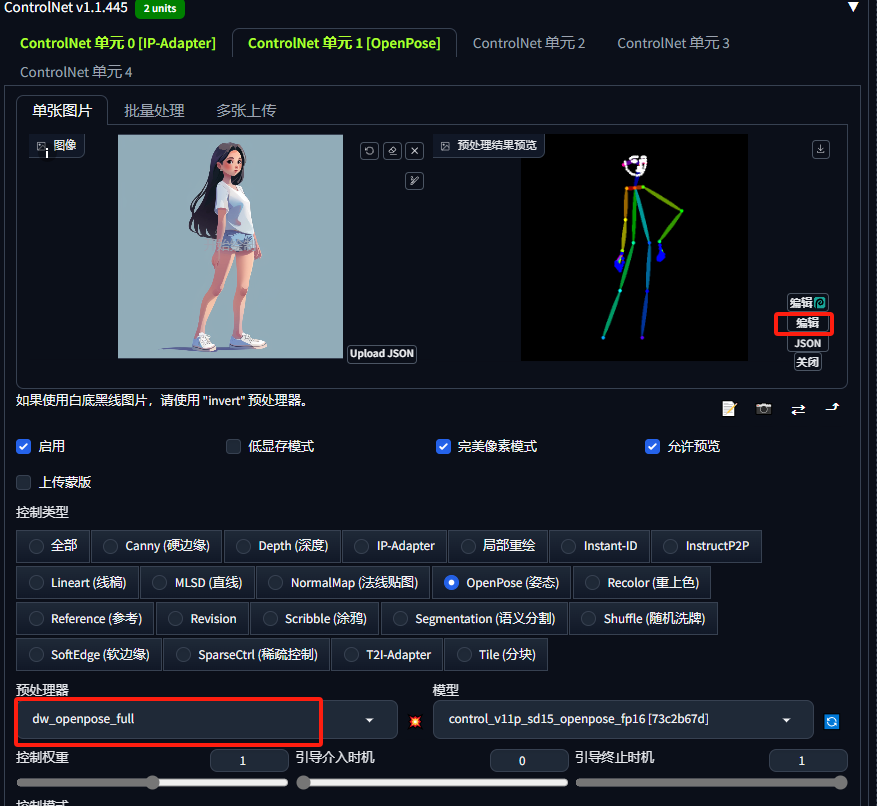

openpose 姿态管理

姿态成功控制

dw_openpose_full效果最好

根据参考图图片高宽一致

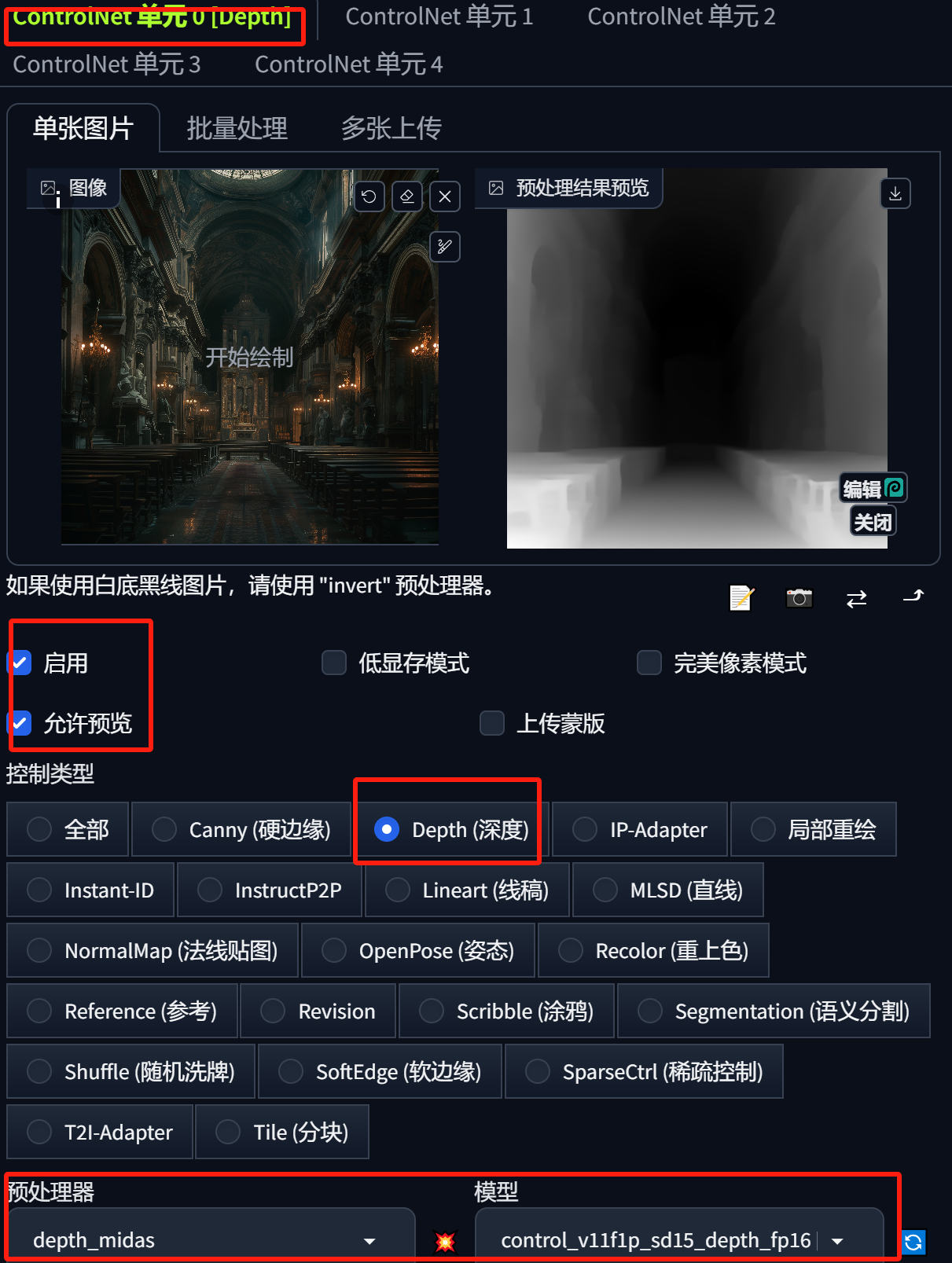

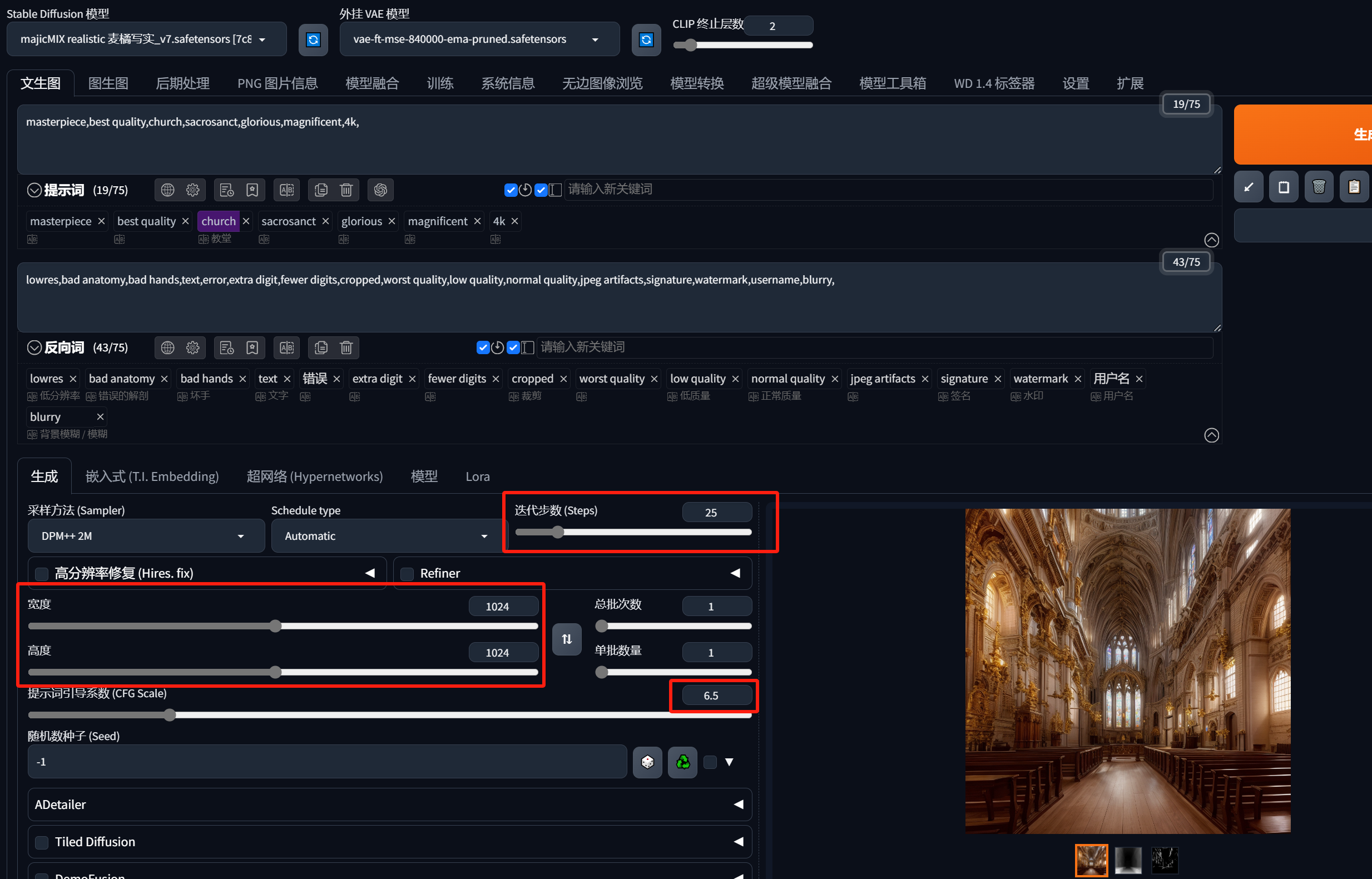

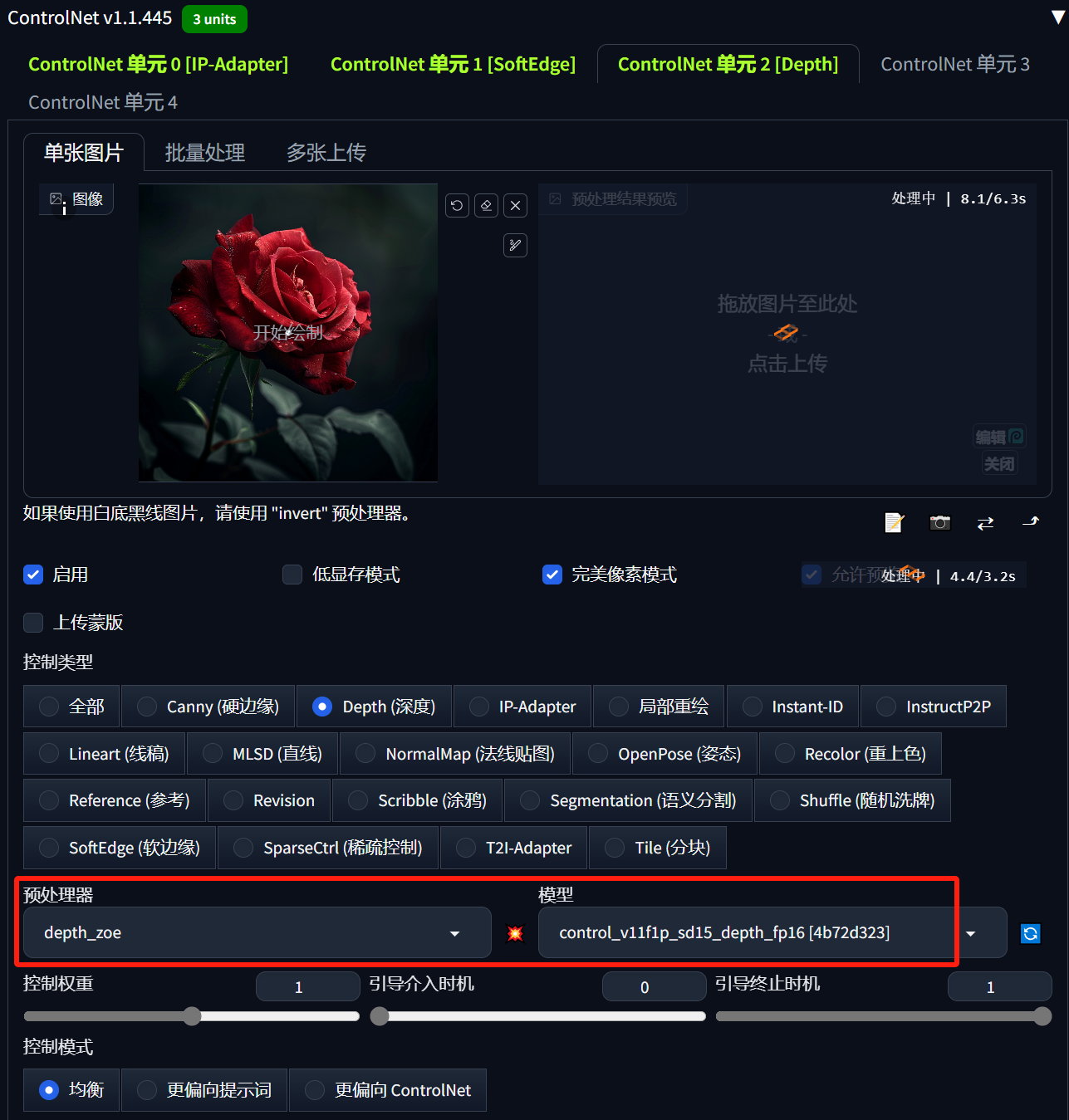

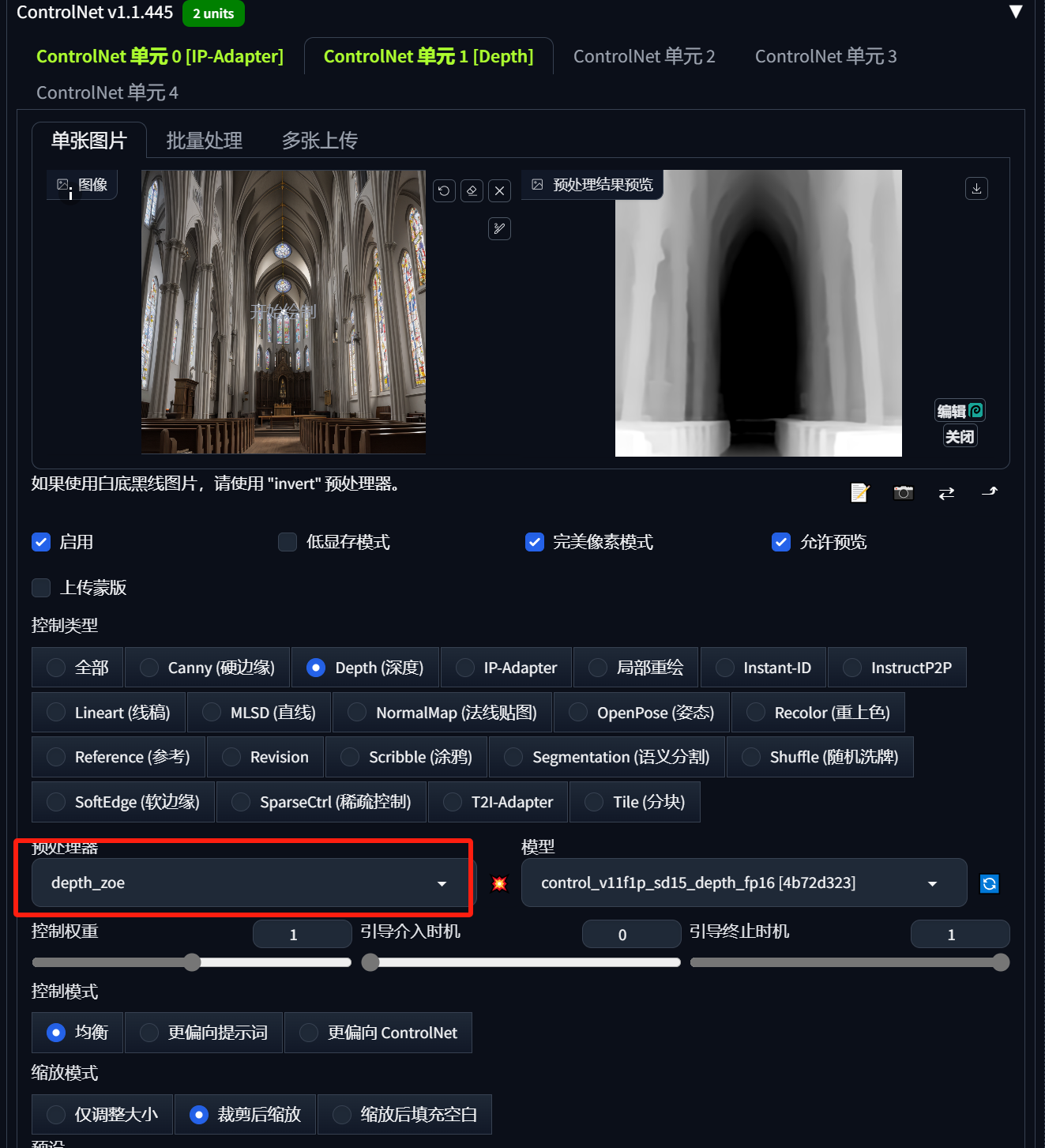

depth [空间关系]

场景 比如教堂

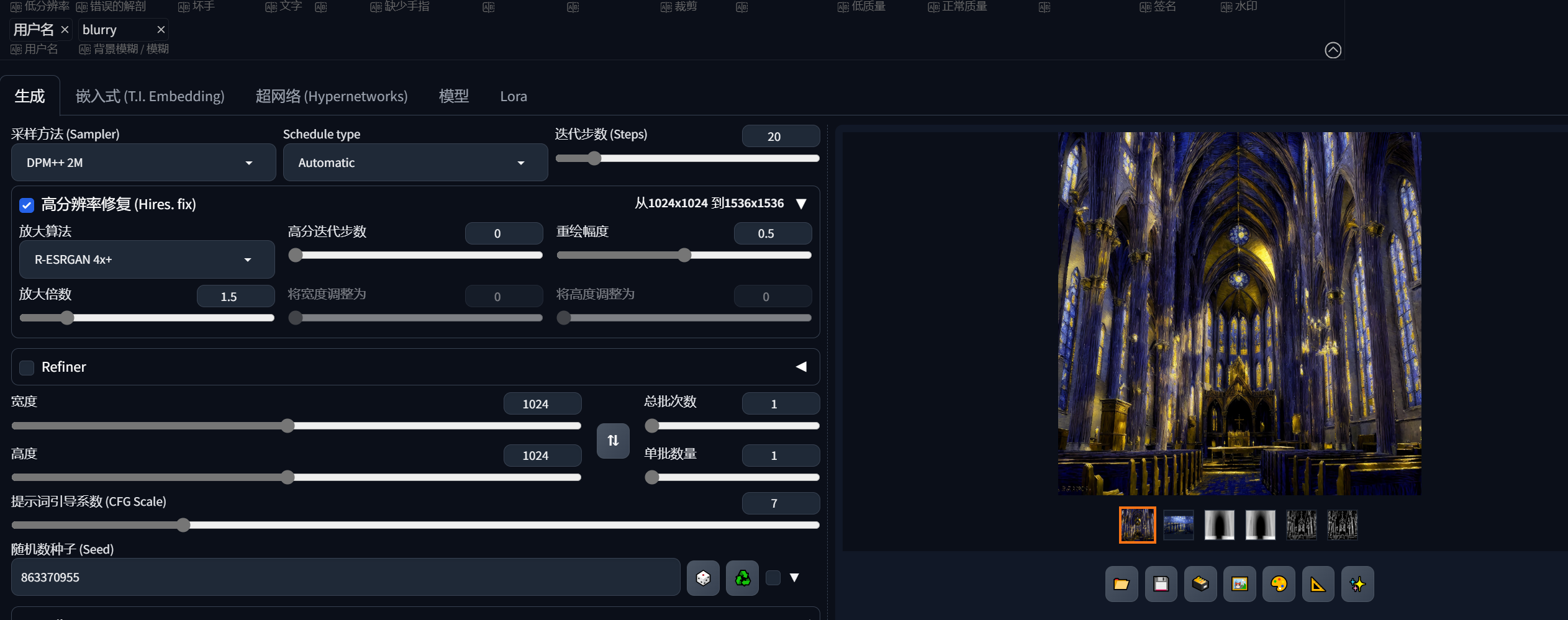

softedge + depth

控制线条分布 + 深度

depth

预处理用了hedsafe

softedge

负面提示词这里因为是建筑,所以去除finger有关

可以通过提示词来改变教堂颜色

人物

softedge openpose depth ipadapter

线条分布 绑定骨骼 空间关系 面部特征迁移/风格一致性

tile

参考图模糊,再分区块重采样 结果图细节更丰富

可以将图片拖入controlnet的单张图片,再次tile。可以看到叶子的纹路

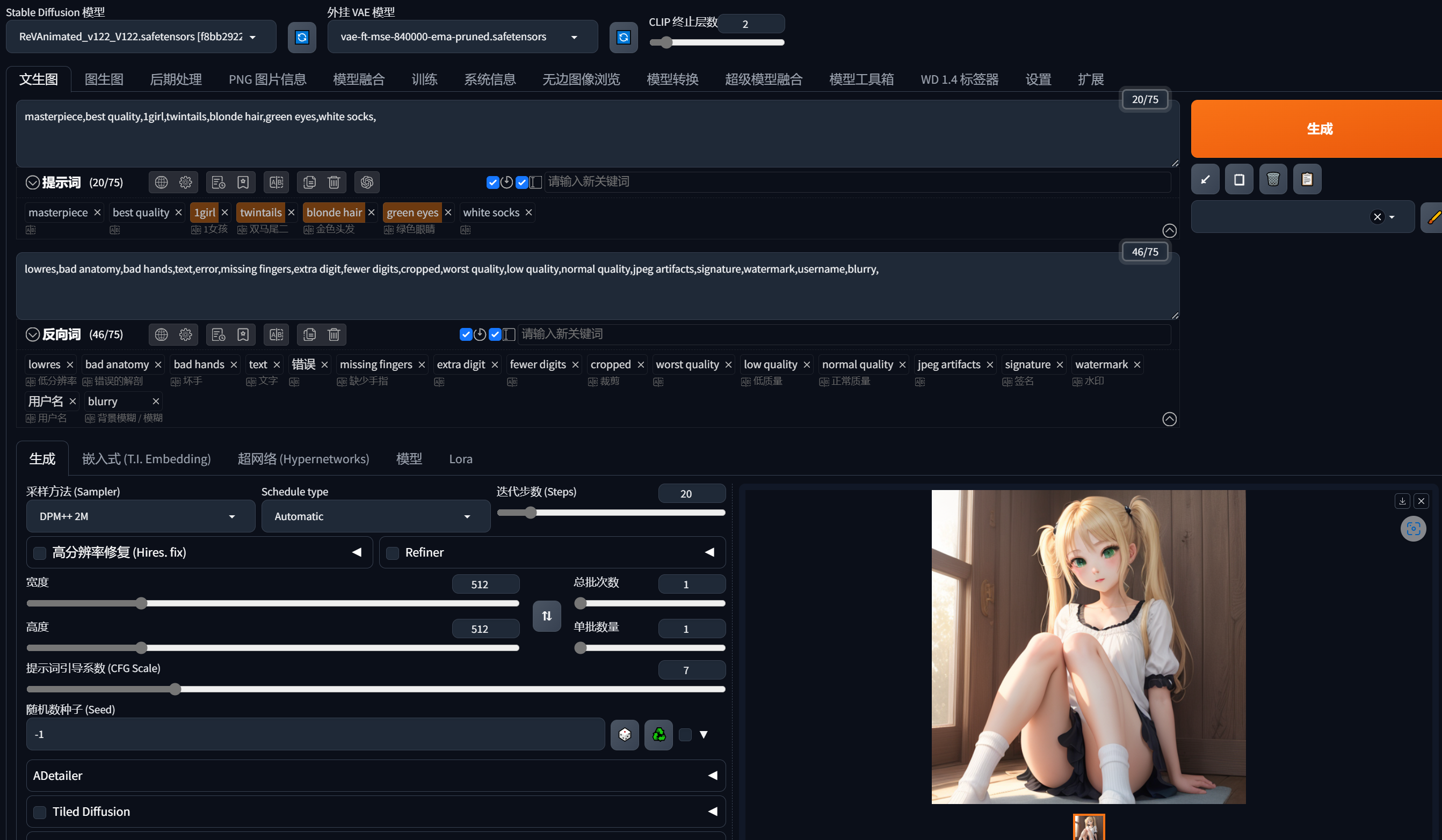

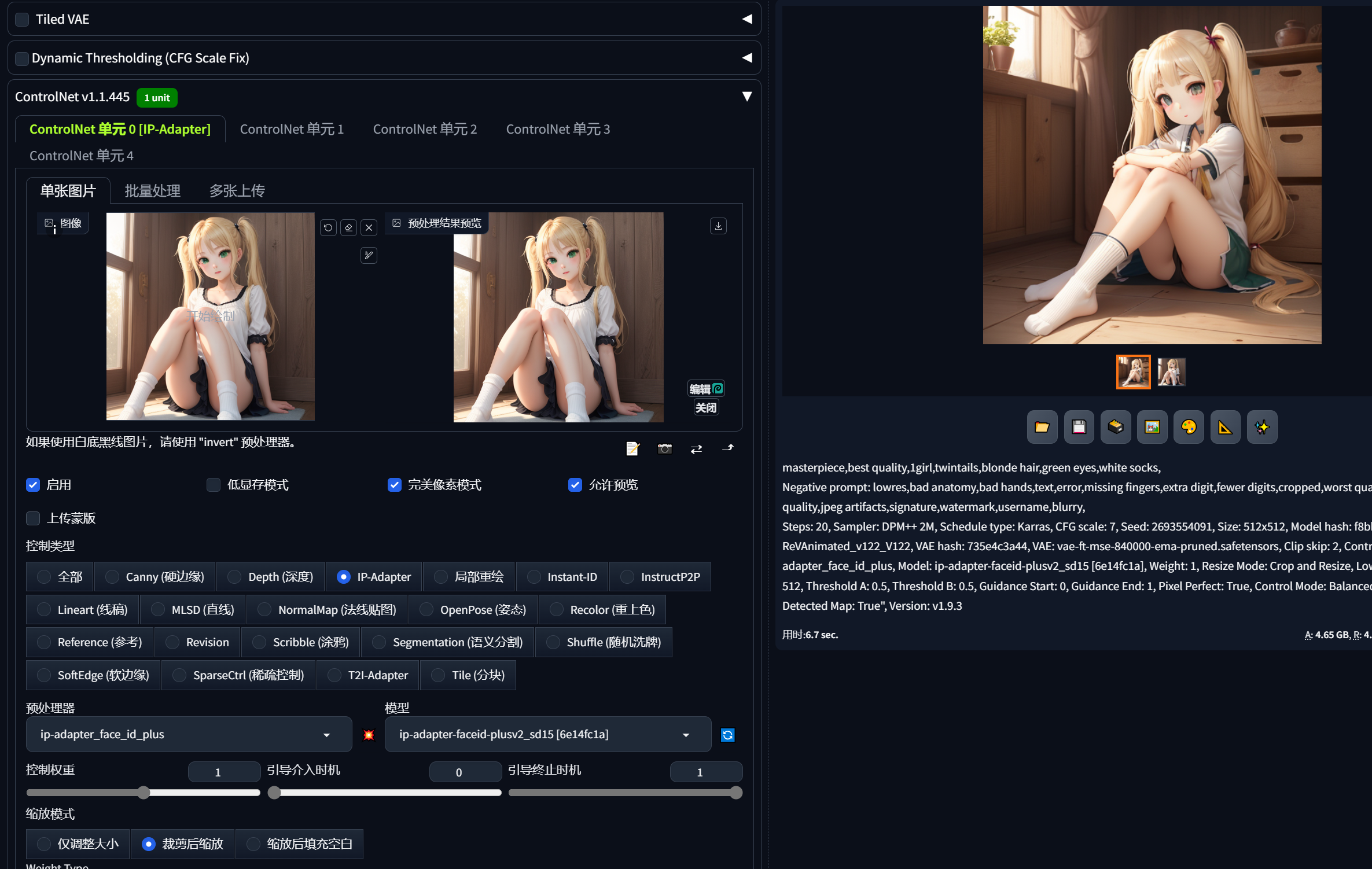

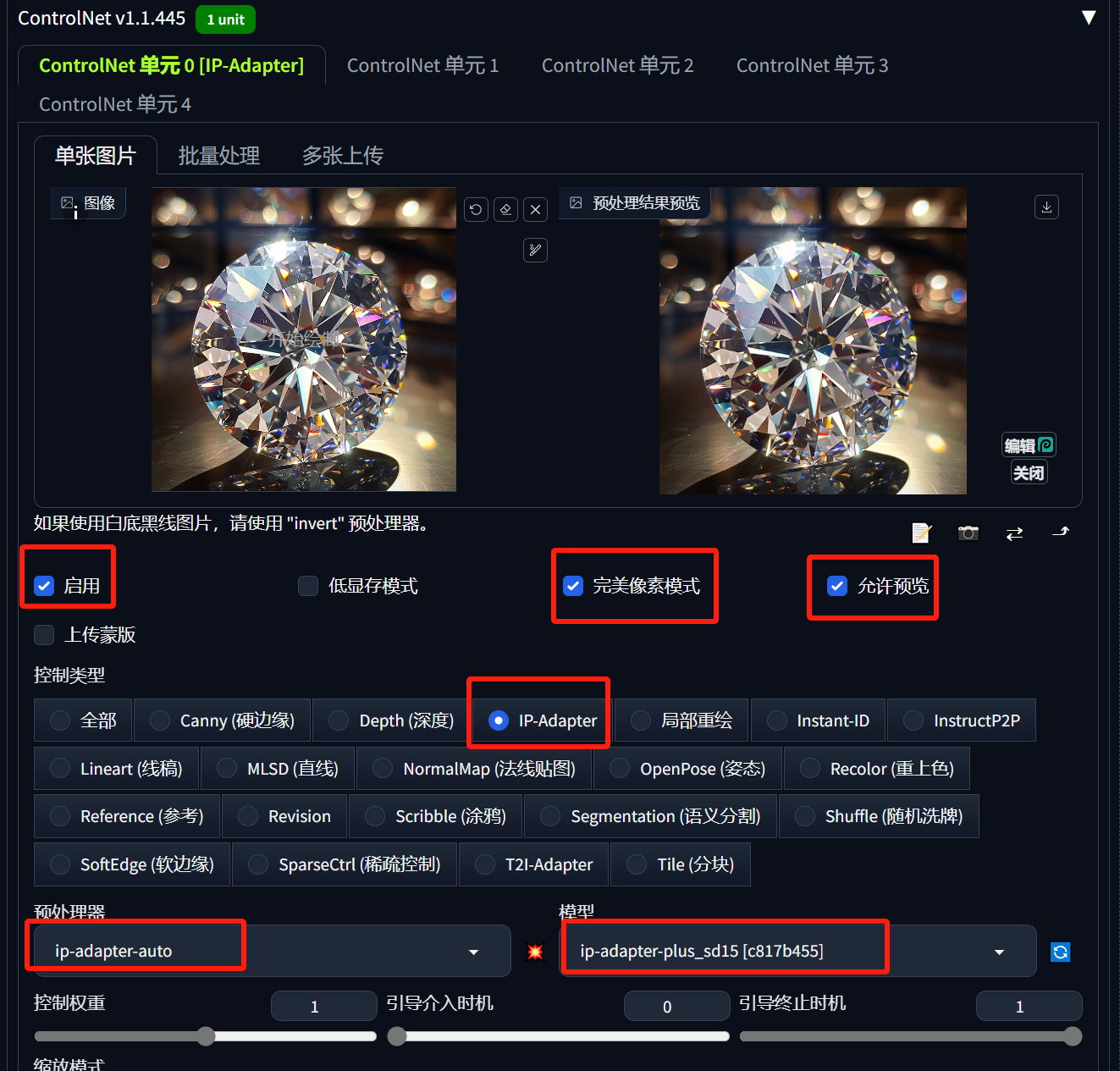

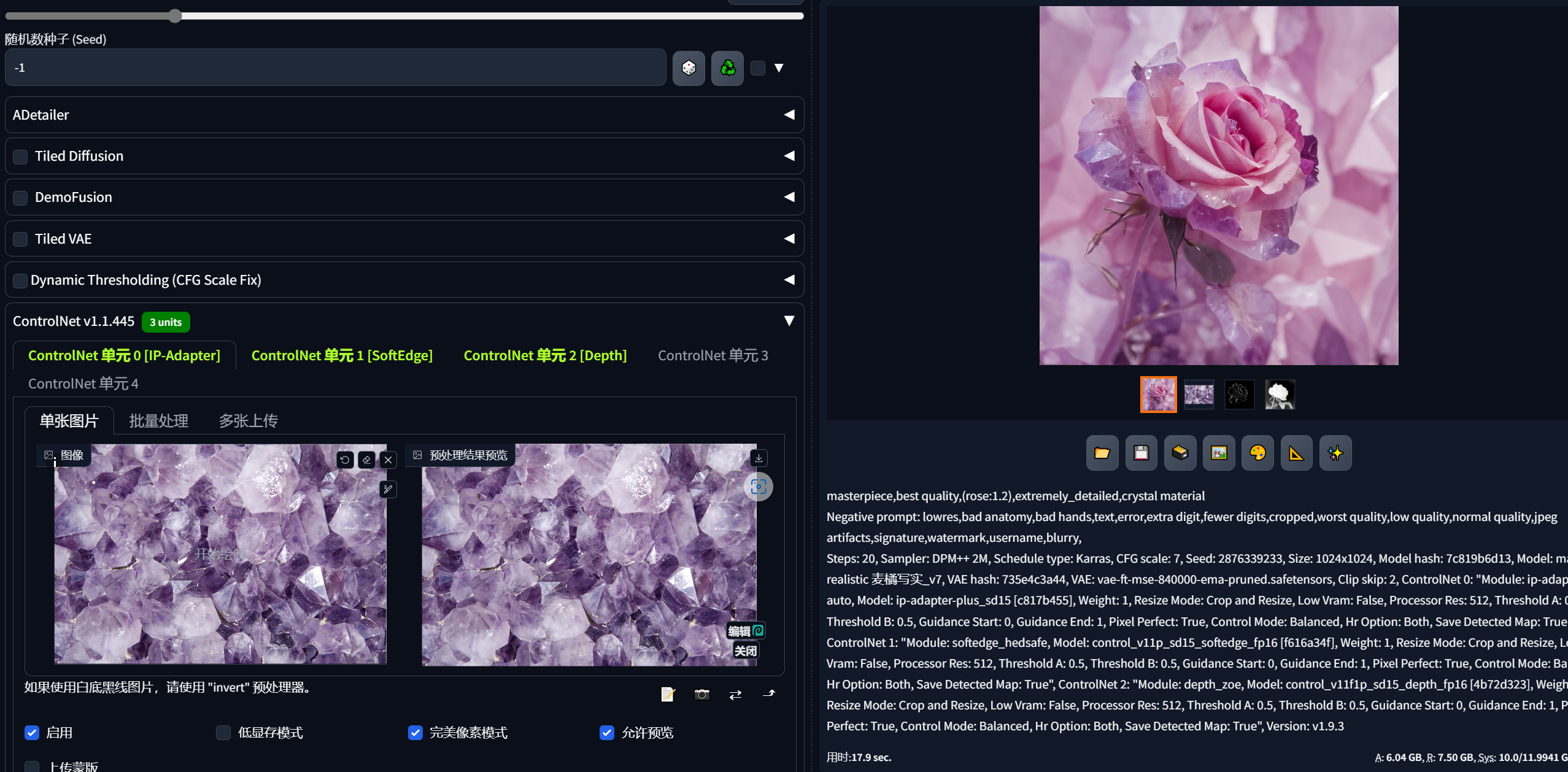

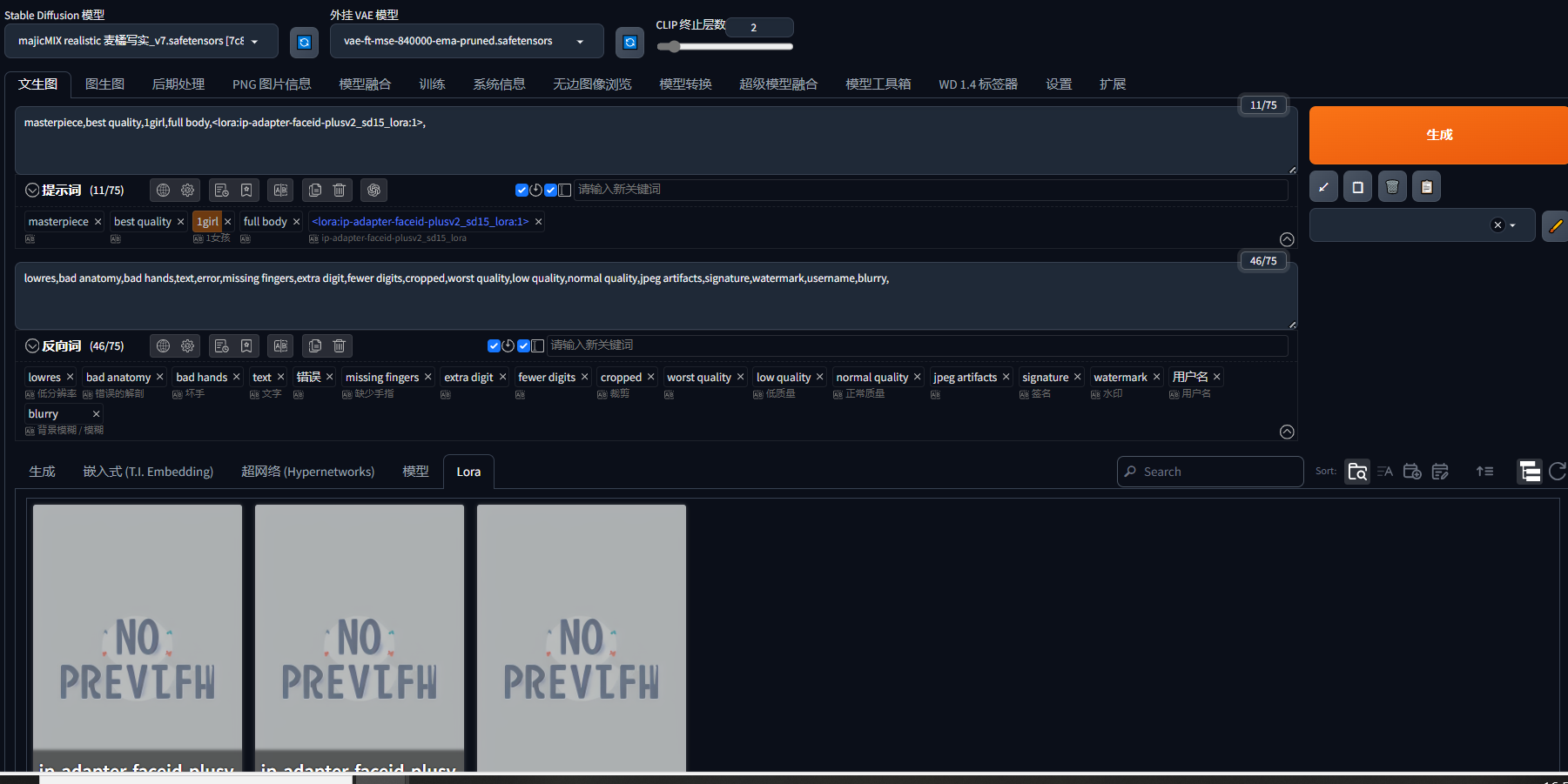

controlnet Ipadapter

ipadapter 可以去hugingface里下载,根据后缀放在指定目录

换脸

材质迁移

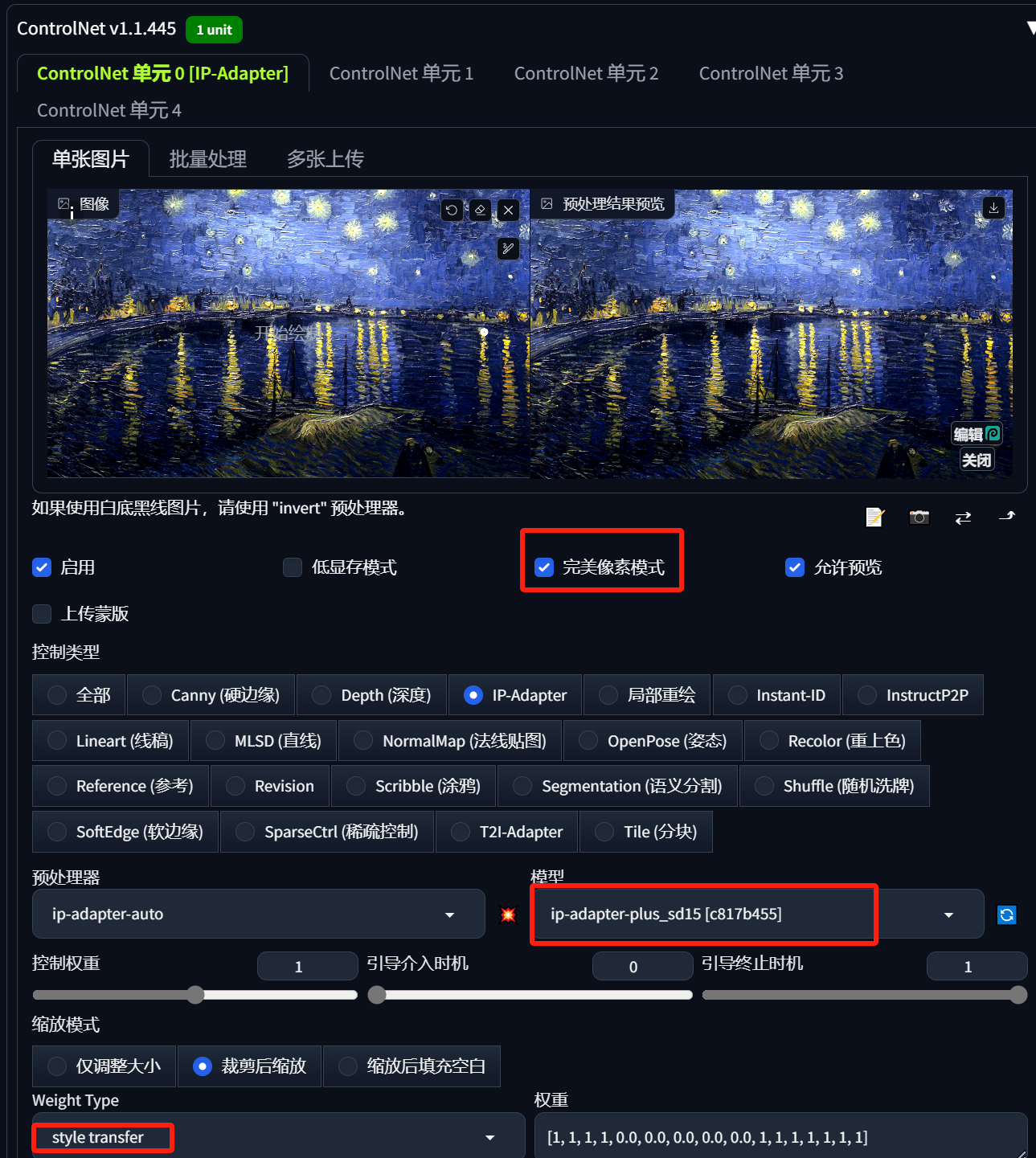

风格迁移

换脸

生成一张图片,为参考图

将参考图拖进ipadapter

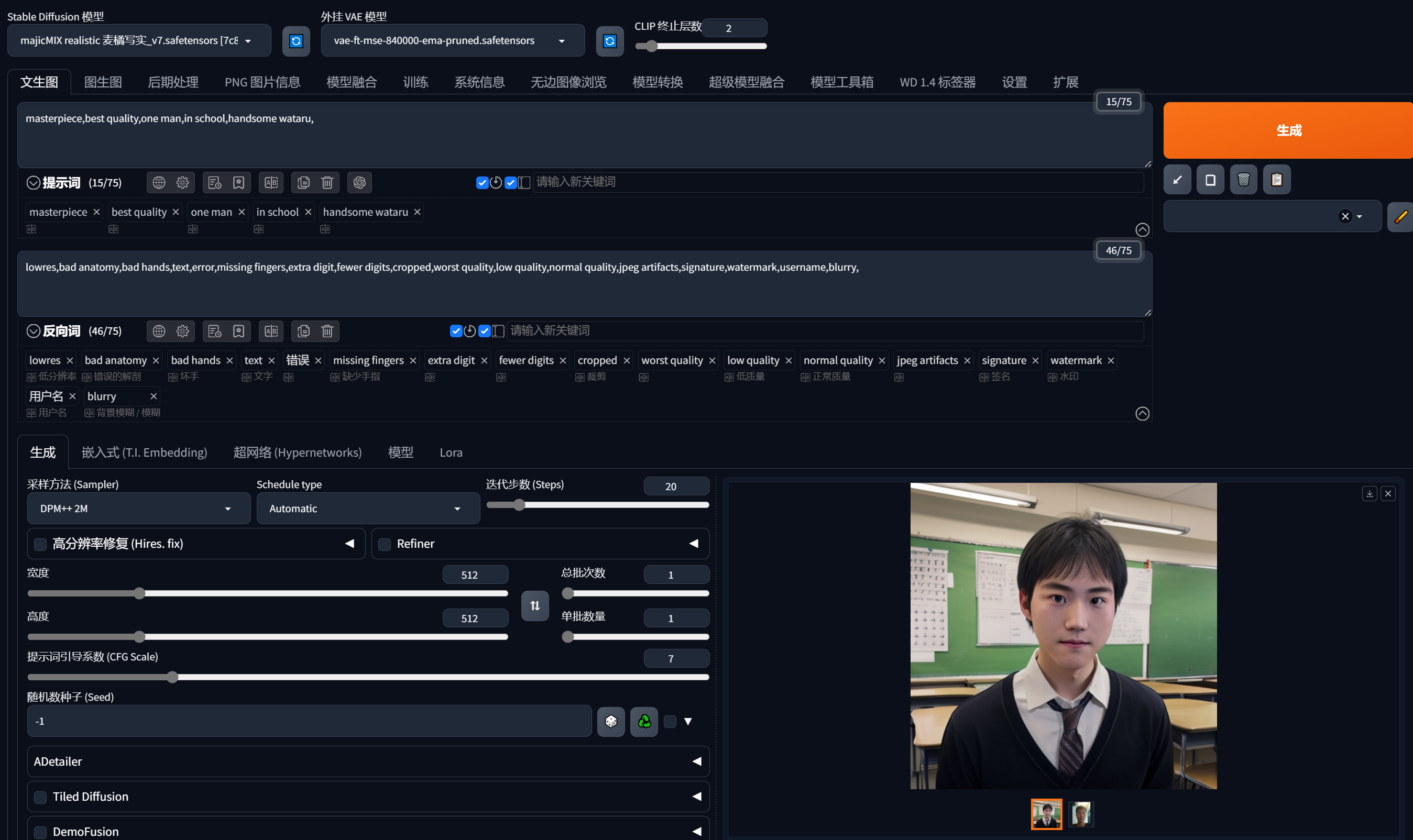

写实换脸,上传了自己的图片

材质迁移

ipdapter

softedge

depth

midas也不错

材质很重要,如果用下图材质则使用crystal materials

Ipadapter-1

风格迁移

选择综合性强的大模型 dreamshaper

生成参考图

风格转换 style transfer

点击生成,

生成成功后,高清放大

直接更换风格

甚至可以根据动漫角色的画风,直接变换

ipadapter与openpose综合运用

controlnet unit1 ipadapter

生成骨骼图

controlnet unit2 openpose

写提示词增加lora

要和骨骼图一样比例

有lora则更靠近赫敏的图片

综合案例使用

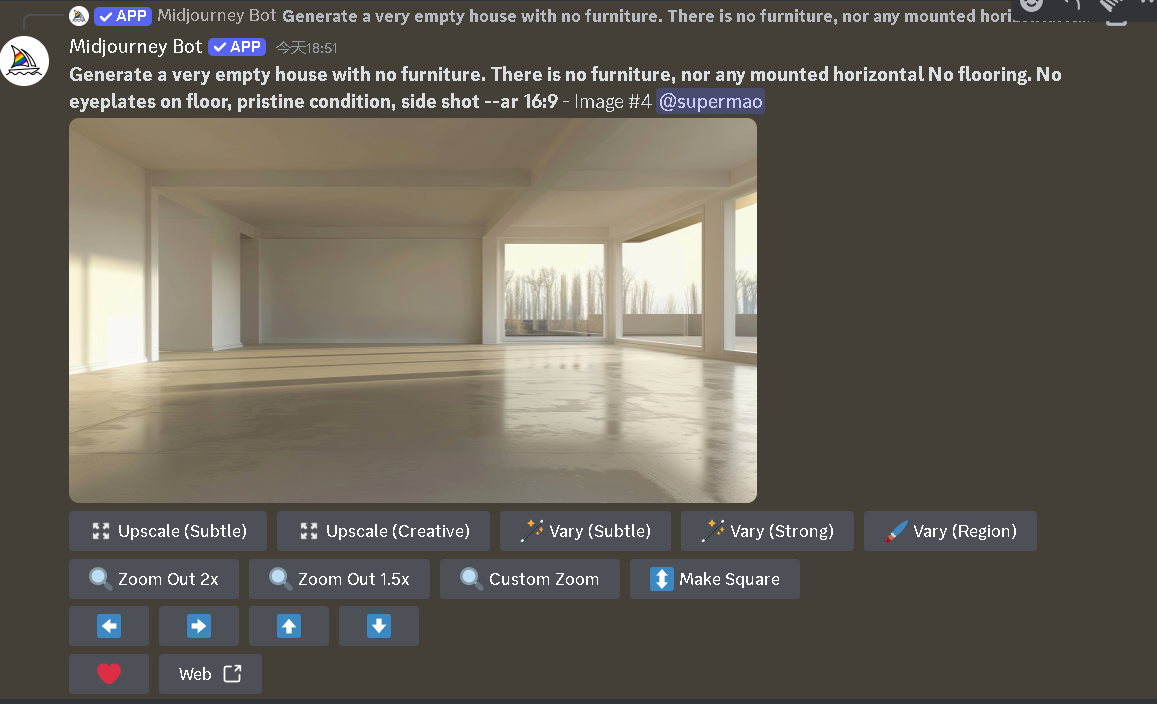

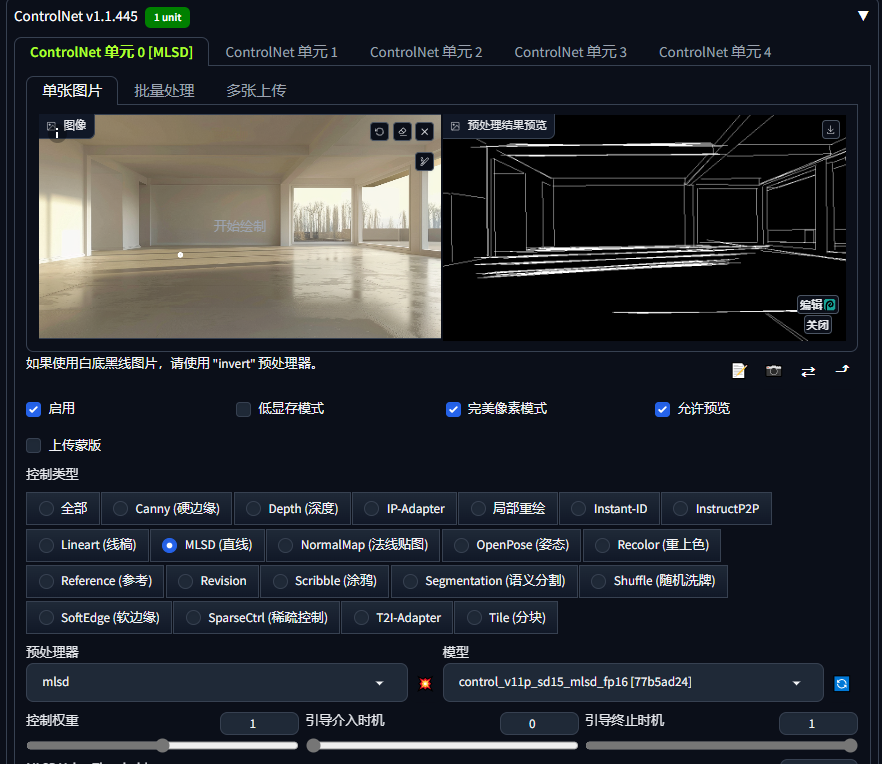

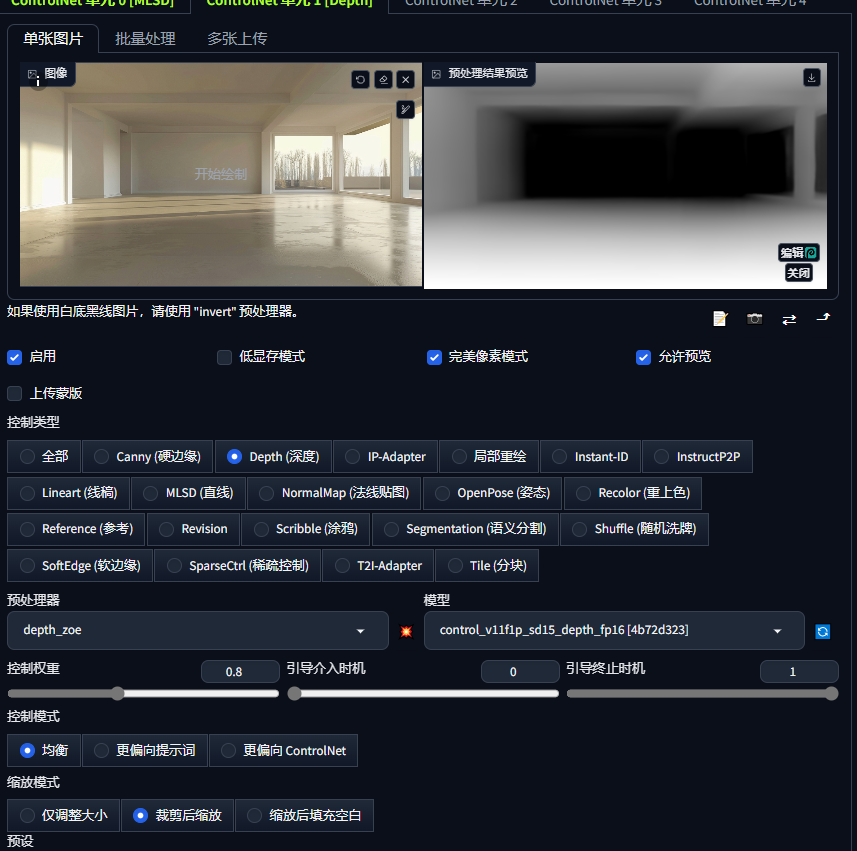

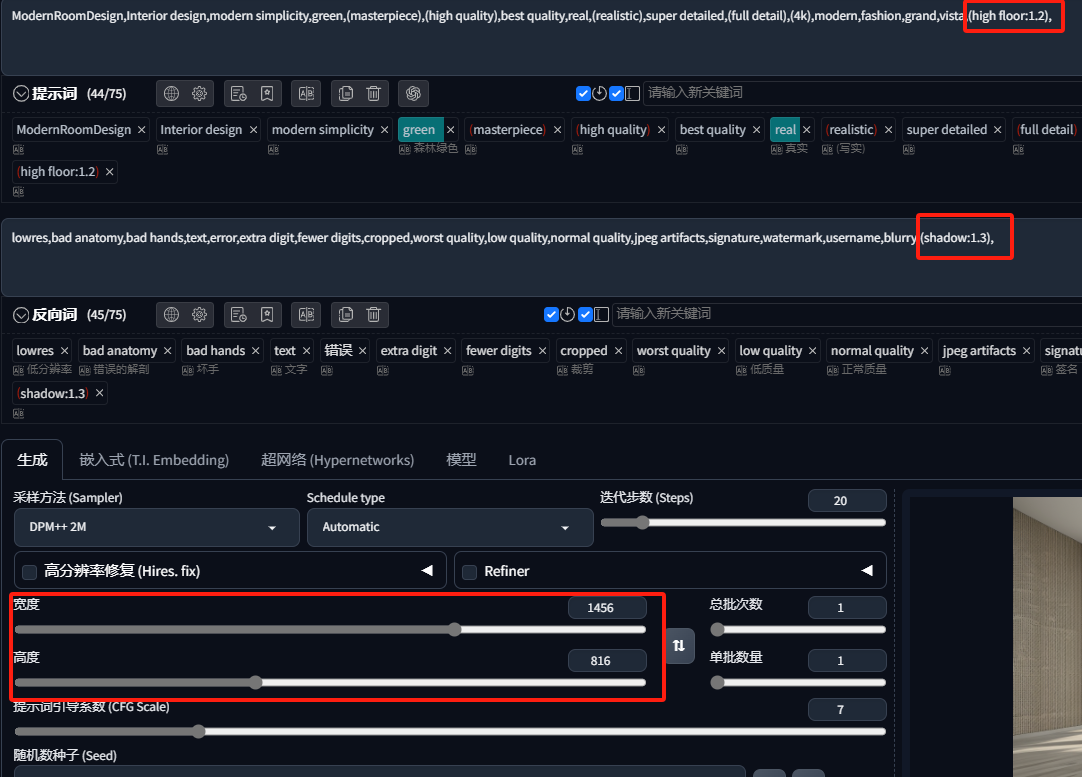

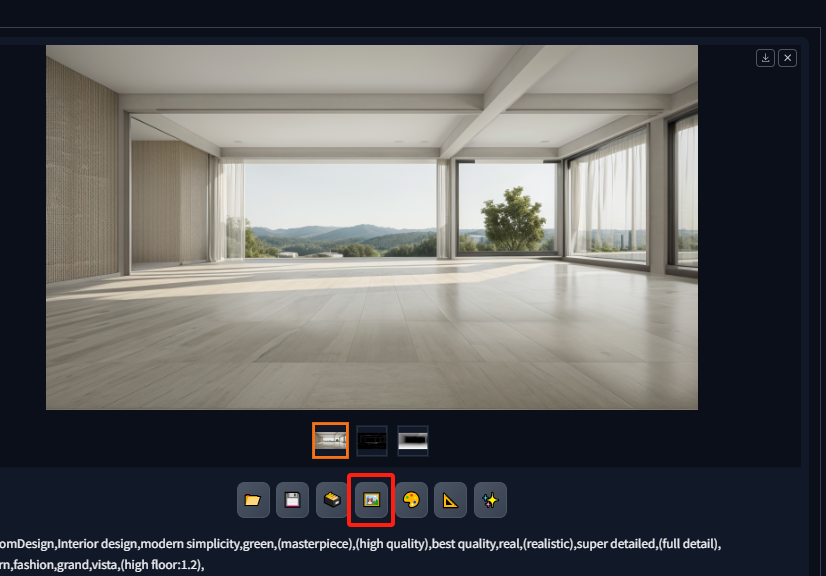

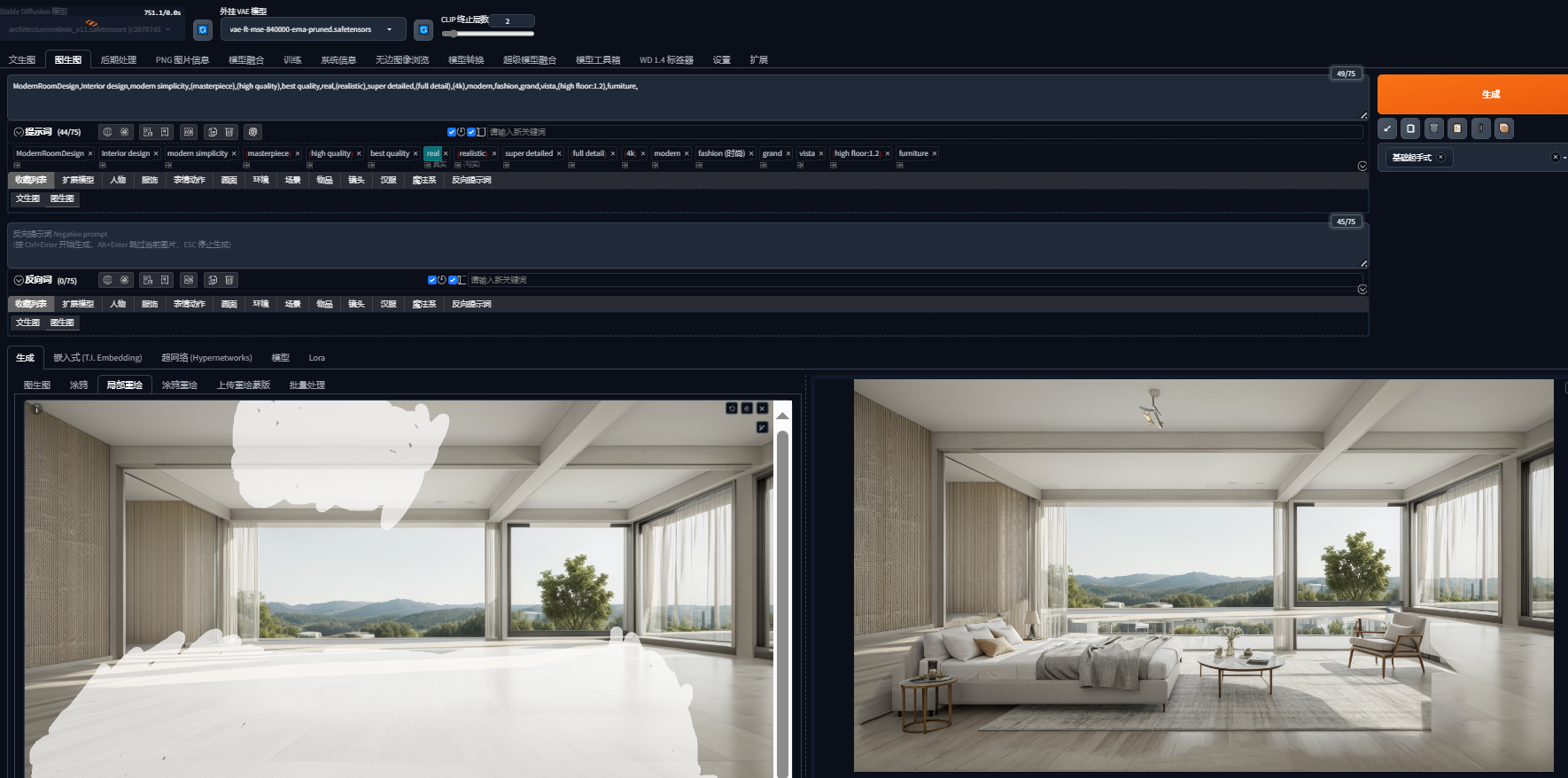

室内设计

大模型选择 Architecturerealmix

unit 1 mlsd处理完只包含直线

unit 2

生成毛坯房

Unfinished, nothing, no furniture, rough, house interior

精装修

ModernRoomDesign,Interior design,modern simplicity,green,(masterpiece),(high quality),best quality,real,(realistic),super detailed,(full detail),(4k),modern,fashion,grand,vista,(high floor:1.2),

去到图生图

改变关键词然后图生图

如果成品出来还想改变,继续图生图

如果想要壁纸变成自己图片的风格,通过勾选上传独立的控制图像

使用ipadapter,进行渲染

如果没有空间深度则继续使用depth

stable diffusion基础[liblib]

正向提示词

人物特征

1girl,solo,

suspender dress,headdress,delicate eyes,beautiful face,shallow smile,snow-white skin,elegant standing,

场景特点

outdoor,blue sky,white clouds,flowers,grass,

场景设定 [天气与光线与白天和黑夜]

day,night sunset,rain shrong rim light

movie light,light tracking,

场景形容词

beautifful ,happy

生图标准 [画质与风格]

8k,highest quality,high resolution

Comic Watercolor Realistic Abstract

1girl,solo,

suspender dress,headdress,delicate eyes,beautiful face,shallow smile,snow-white skin,elegant standing,

outdoor,blue sky,white clouds,flowers,grass,

movie light,light tracking,

beautiful,happy,

8k,highest quality,high resolution,

realistic,extreme detail

负向

low quality,blurry,bad proportions,cropped,watermark

ugly,bad body,missing fingers,extra feet

NSFW text logo

参数

eular a画笔选择,根据推荐来,其实都差不多

步数15-25,过高也不会有用

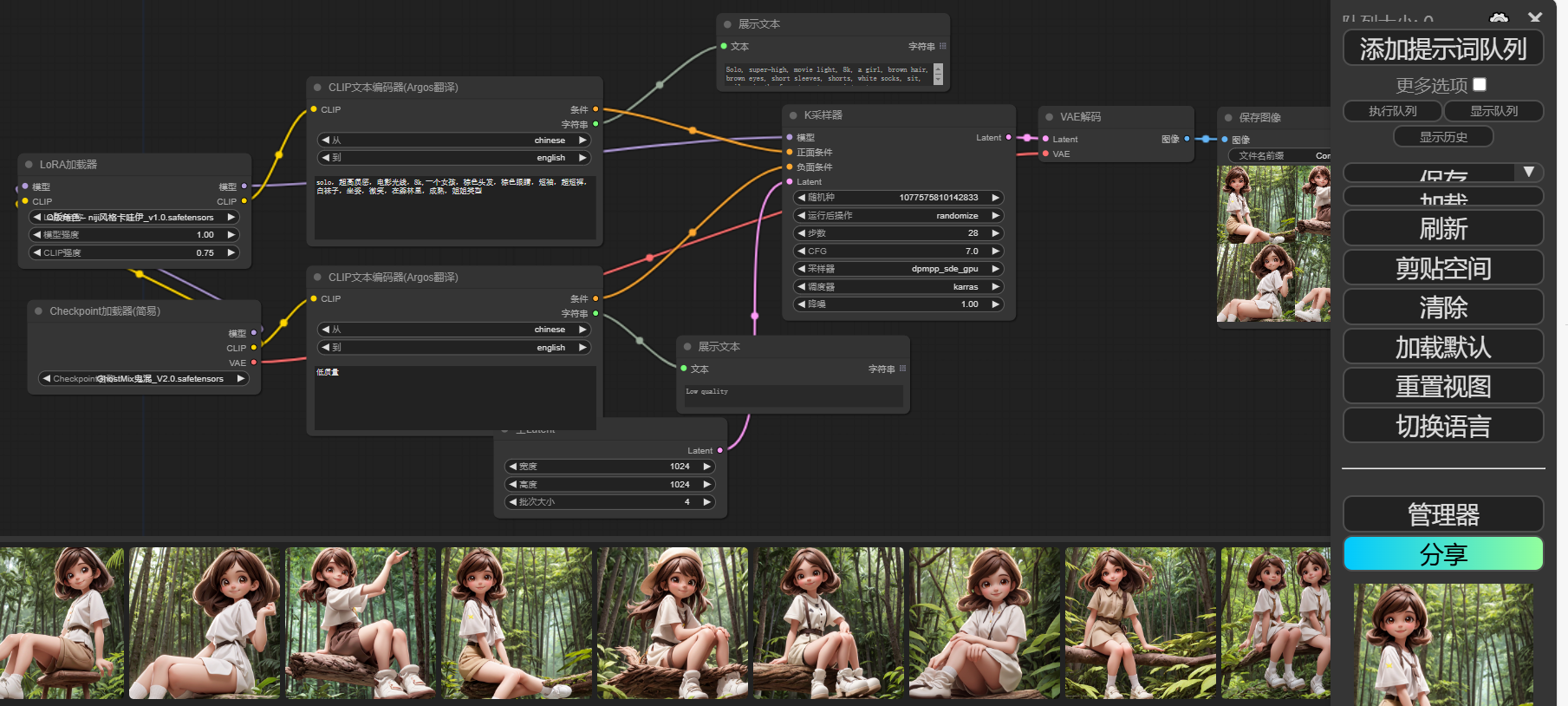

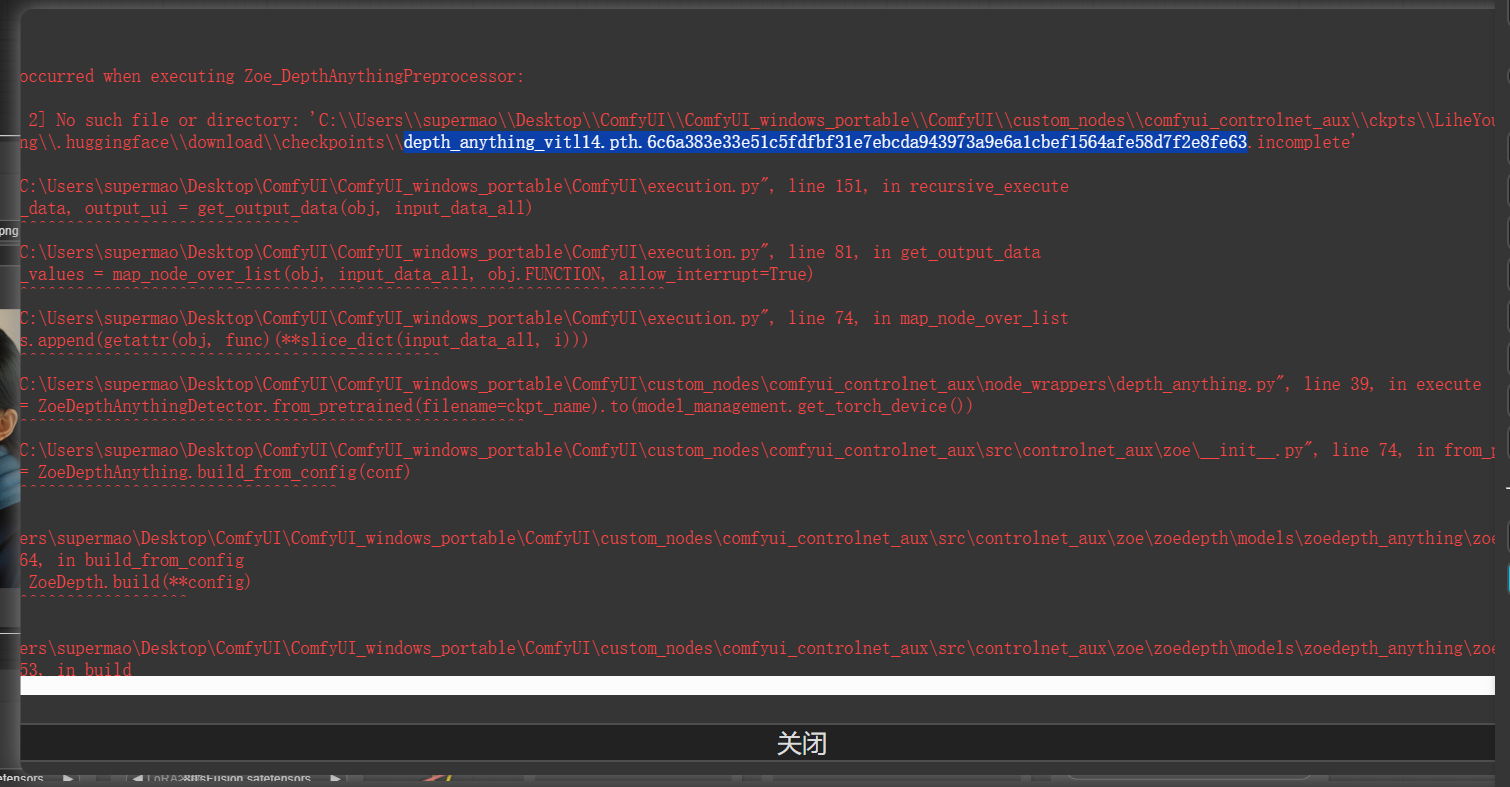

comfyui尝试

sd 挂lora+汉化工作流

图片有元数据

可以通过拉取图片来获得工作流

comfyui 大部分问题可以通过离线安装的方式解决 google可以解决。每当报错

通过日志去查看,工作流报红,缺模型就安装模型,缺插件安装插件,缺什么装什么

浙公网安备 33010602011771号

浙公网安备 33010602011771号