神经网络中的 batch_size、epochs、iteration

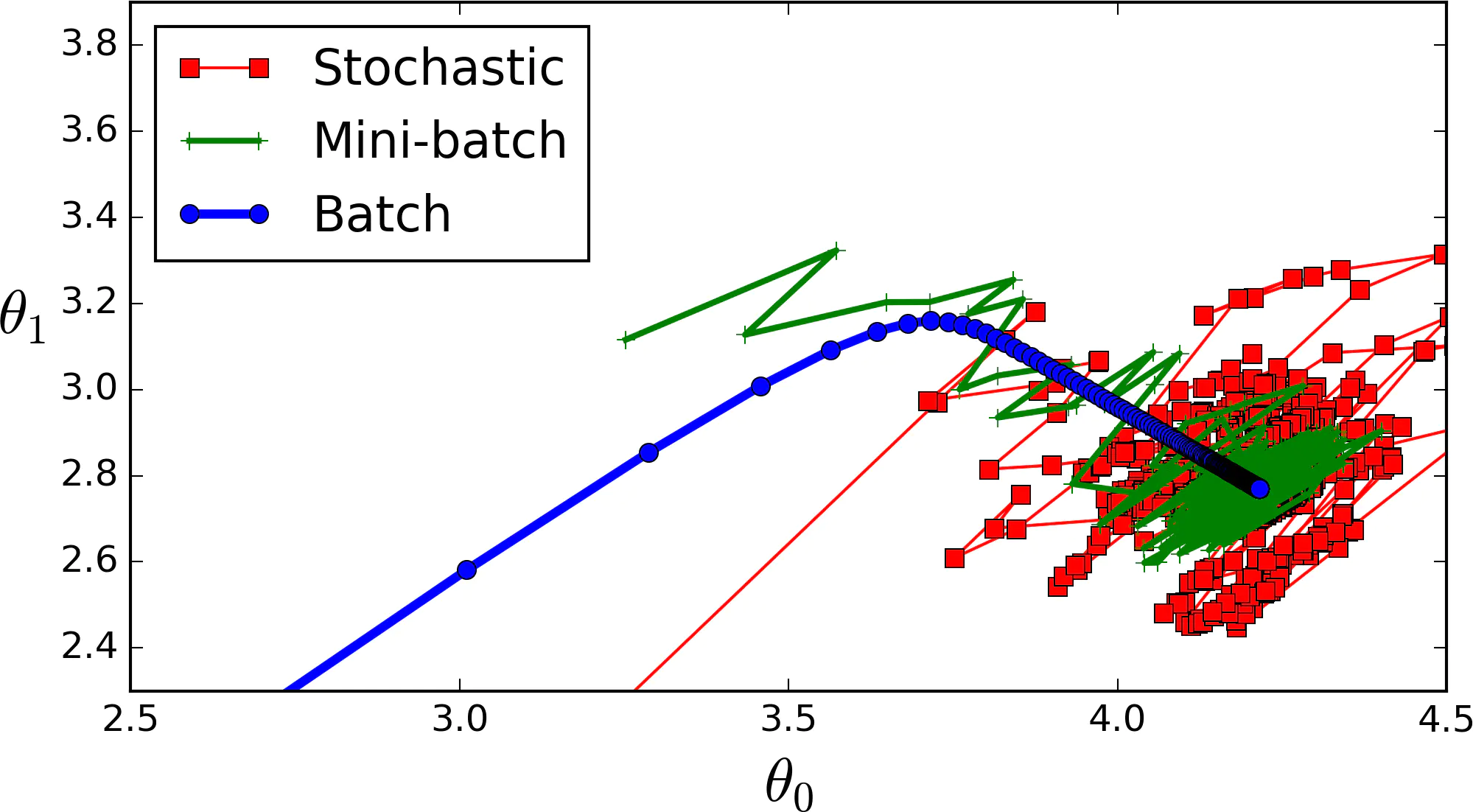

这三个概念是基于梯度下降法而言的。

1 batch_size

batch_size 就是批量大小,即一次训练中所使用的样本个数。

batch_size 的选择是为了在内存效率和内存容量之间寻找最佳平衡,将影响到模型的优化程度和速度。

适当的增加Batch_Size,梯度下降方向准确度增加,训练震动的幅度减小。还可以通过并行化提高内存利用率。

2 epochs

一个 epoch 指用训练集中的全部样本训练一次,当一个epoch对于计算机而言太庞大的时候,就需要把它分成多个小块,epoch 由一个或多个 batch 组成。

随着epoch数量增加,神经网络中的权重的更新次数也在增加,曲线从欠拟合变得过拟合。

3 iteration

一个 iteration 即迭代一次,也就是用 batch_size 个样本训练一次。

浙公网安备 33010602011771号

浙公网安备 33010602011771号