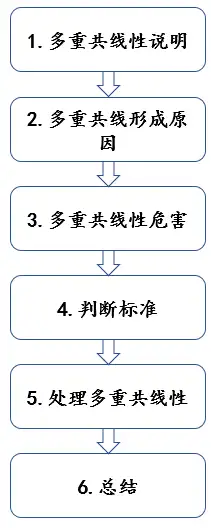

速进!!关于多重共线性你知道多少?

一、多重共线性说明

多重共线性有时也称多重相关性,一般是指自变量间存在线性关系或者高度相关(比如相关系数大于0.8)的现象。自变量之间具体的线性相关关系一般分为完全相关性,存在一定程度的相关性以及完全不相关,相关关系如何界定如下:

- 完全相关:分析项之间的相关系数为1。

- 一定程度相关:分析项之间的相关系数在0-1之间变化。

- 完全不相关:分析项之间的相关系数为0。

二、多重共线性形成原因

多重共线性形成的原因有很多,可能由于样本量过少所导致,样本量少有可能是数据搜集具有限制性,比如已经完成实验或者经费有限等一些其他原因。还有可能是本身分析项之间就存在某种关系,比如某品牌电脑营业额和销量等。而且我们在建模分析时,为了更好描述分析结果,以及分析项之间的关系,常常倾向于选择有关指标,这可能也会对模型带来多重共线性。那么多重共线性有哪些危害呢?

三、多重共线性危害

在回归分析中,当自变量之间出现多重共线性现象时,一般会出现使模型或者检验存在一些问题。具体如下:

- 一般会降低估计的精准度,并且稳定性也会降低。

- 无法判断单独变量的影响。

- 回归方程的标准误差增大。

- 变量显著性可能会失去意义。

四、判断标准

常见的直观判断方法共有四个,如下:

(1)某些自变量的相关系数值较大(比如大于0.8)等,可以利用pearson相关系数检验法一般是利用解释变量之间的线性相关程度判断,一般标准是系数大于0.8则认为可能存在多重共线性。

(2)如果增加一个变量或者删除一个变量,回归系数的观测值变化很大。

(3)如果说F检验通过,并且决定系数值也较大,但是t检验并不显著,也可能存在多重共线性。

(4)回归系数的正负符号与专业知识相反或与实际分析结果不符,也会存在多重共线性的可能。

以上方法可能会存在误差,更多偏向于主观,还有一种正规检验方法,观察回归分析中的VIF值(方差膨胀因子),这个检验方法更为严谨、准确。通常的判断标准是VIF值大于10即具有多重共线性,有的文献也说大于5即有共线性。

其中VIF值如下:

VIF=(1−R2)−1

从公式中我们发现VIF和R方是有直接关系的。

当VIF>5, 1- R2 <0.2, R2 >0.8;

当VIF>10, 1- R2 <0.1, R2 >0.9;

从上式可以看出,VIF若大于10其R方相对应也大于0.9,若VIF大于5其R方相对于大于0.8,如果存在这种现象,可以认为该自变量是其他自变量的近似线性组合,也就是说,在自变量之间存在高度相关的现象。

五、处理多重共线性

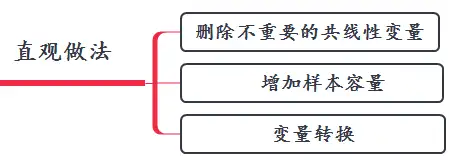

处理多重共线性经验式做法:

(1)删除不重要的共线性变量

但是删除变量后可能会导致模型和原本分析的模型不一样,可能会出现决策错误等现象。

(2)增加样本容量

多重共线性有可能与样本量过少有关,所以如果存在也可以加大样本量。但是加大样本量具有局限性比如实验已经结束或者其它原因。

(3)变量转换

构造一个新的变量,这一新变量是多重共线性变量的函数,然后用这个新的变量代替多重共线性的变量,但是要注意组合后的数据需要有实际意义否则模型不好解释。

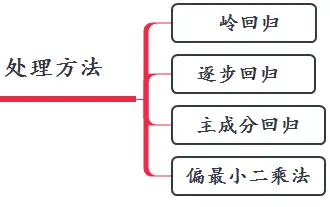

其它处理方法:

- 岭回归

岭回归分析是一种修正的最小二乘估计法,当自变量系统中存在多重共线性时,它可以提供一个有偏估计量,这个估计量虽有微小偏差,但它的精度却能大大高于无偏估计。

如果使用SPSSAU进行分析岭回归一般有两个步骤:岭回归通过引入k个单位阵,使得回归系数可估计;单位阵引入会导致信息丢失,但同时可换来回归模型的合理估计。针对岭回归:其研究步骤共为2步,分别是结合岭迹图寻找最佳K值;输入K值进行回归建模。 - 逐步回归

逐步回归分析方法视自变量对因变量的影响显著性大小从大到小逐个引入回归方程,从处理角度来看逐步回归比岭回归和主成分回归要好一些。逐步回归面临着检验的显著性水平的选择困难它通常得不到最优变量子集,可以利用SPSSAU进阶方法中逐步回归进行分析。

3.主成分回归

主成分回归根据主成分分析的思想提出的。主成分估计和岭回归类似都是一种有偏估计。主成分分析利用降维的思想对数据信息进行浓缩,将多个分析项浓缩成几个关键概括性指标;剔除对系统影响微弱的部分。通过对各个主成分的重点分析,来达到对原始变量进行分析的目的。主成分回归就是用对原变量进行主成分分析后得到的新的指标来代替原变量,再使用最小二乘法进行回归分析。由于对原变量的综合,就可以起到克服多重共线性所造成的信息重叠的作用,从而消除多重共线性对回归建模的影响。

4.偏最小二乘法

偏最小二乘法不仅可以用单变量回归分析方法,也可以用于多变量回归分析方法,一般情况下处理样本量相对较小,自变量多的数据。

六、总结

本篇文章主要讲述多重共线性形成原因,以及危害,如何判断多重共线性,以及如果出现多重共线性需要解决如何去解决。解决的办法有很多,具体使用那种方法,还需要研究者根据自己的数据情况进行衡量。

浙公网安备 33010602011771号

浙公网安备 33010602011771号