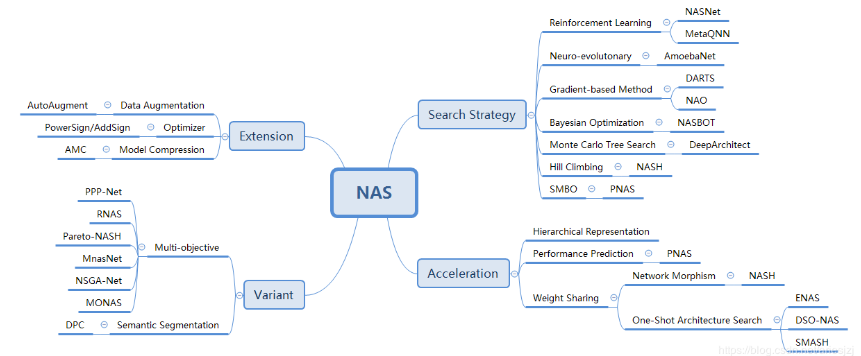

神经架构搜索(NAS)综述

一、定义

神经架构搜索(Neural Architecture Search,简称 NAS)的核心思想是使用搜索算法来发现用于解决我们的问题所需要的神经网络结构。

有些论文的结果很难重现原因之一就是获得最优超参值往往需要花很大的力气。超参数的自动搜索优化是一个古老的话题了。

对于深度学习来说,超参数(Hyperparameter)主要有三类:

- 优化参数(如learning rate,batch size,weight decay等)

- 定义网络结构的参数(比如有几层,每层是啥算子,卷积中的filter size等)

- 正则化系数

对于训练参数的自动调优属于超参数优化(Hyperparameter optimization,简称HO);而定义网络结构的参数进行自动调优一般称为网络架构搜索(Neural Architecture Search,简称NAS)。

二、NAS 架构

三、NAS结构组成

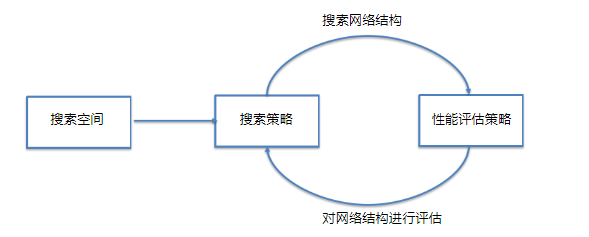

NAS主要由搜索空间、搜索策略、性能评估策略三部分组成。

NAS的原理是给定一个称为搜索空间的候选神经网络结构集合,用某种策略从中搜索出最优网络结构。神经网络结构的优劣即性能用某些指标如精度、速度来度量,称为性能评估。

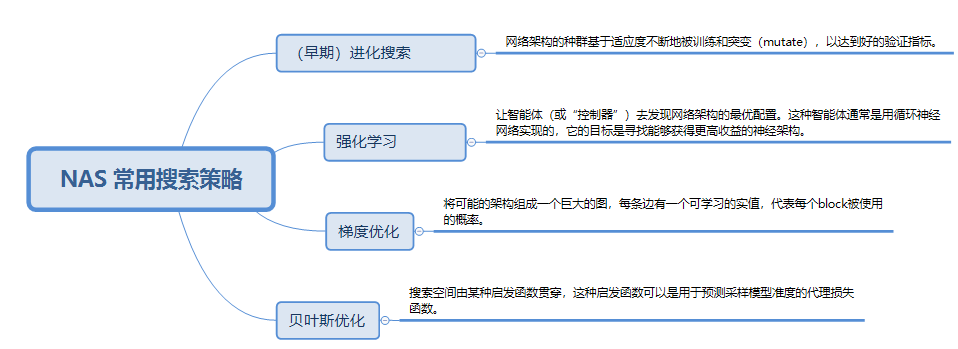

四、搜索策略

参考博客:https://blog.csdn.net/jinzhuojun/article/details/84698471