吴恩达机器学习笔记11-梯度下降法实践2-学习率

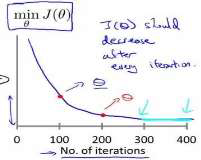

梯度下降算法收敛所需要的迭代次数根据模型的不同而不同,我们不能提前预知,我们

可以绘制迭代次数和代价函数的图表来观测算法在何时趋于收敛。

也有一些自动测试是否收敛的方法,例如将代价函数的变化值与某个阀值(例如0.001)

进行比较,但通常看上面这样的图表更好。

梯度下降算法的每次迭代受到学习率的影响,如果学习率𝑎过小,则达到收敛所需的迭

代次数会非常高;如果学习率𝑎过大,每次迭代可能不会减小代价函数,可能会越过局部最

小值导致无法收敛。

通常可以考虑尝试些学习率:

𝛼 = 0.01,0.03,0.1,0.3,1,3,10

浙公网安备 33010602011771号

浙公网安备 33010602011771号