吴恩达机器学习笔记6-梯度下降II(Gradient descent intuition)--梯度下降的直观理解

在之前的学习中,我们给出了一个数学上关于梯度下降的定义,本次视频我们更深入研

究一下,更直观地感受一下这个算法是做什么的,以及梯度下降算法的更新过程有什么意义。

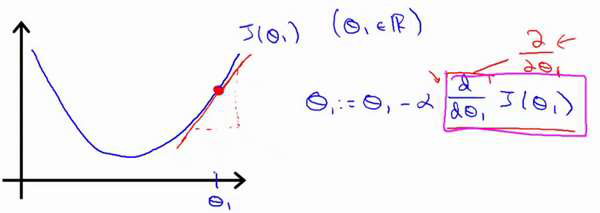

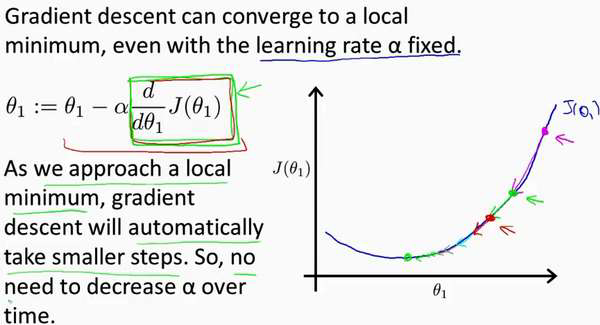

梯度下降算法如下:

描述:对𝜃赋值,使得𝐽(𝜃)按梯度下降最快方向进行,一直迭代下去,最终得到局部最

小值。其中𝑎是学习率(learning rate),它决定了我们沿着能让代价函数下降程度最大的方

向向下迈出的步子有多大。

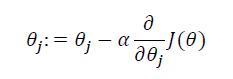

对于这个问题,求导的目的,基本上可以说取这个红点的切线,就是这样一条红色的直

线,刚好与函数相切于这一点,让我们看看这条红色直线的斜率,就是这条刚好与函数曲线

相切的这条直线,这条直线的斜率正好是这个三角形的高度除以这个水平长度,现在,这条

线有一个正斜率,也就是说它有正导数,因此,我得到的新的𝜃1,𝜃1更新后等于𝜃1减去一个

正数乘以𝑎。

这就是我梯度下降法的更新规则:

让我们来看看如果𝑎太小或𝑎太大会出现什么情况:

如果𝑎太小了,即我的学习速率太小,结果就是只能这样像小宝宝一样一点点地挪动,

去努力接近最低点,这样就需要很多步才能到达最低点,所以如果𝑎太小的话,可能会很慢,

因为它会一点点挪动,它会需要很多步才能到达全局最低点。

如果𝑎太大,那么梯度下降法可能会越过最低点,甚至可能无法收敛,下一次迭代又移

动了一大步,越过一次,又越过一次,一次次越过最低点,直到你发现实际上离最低点越来

越远,所以,如果𝑎太大,它会导致无法收敛,甚至发散。

现在,我还有一个问题,当我第一次学习这个地方时,我花了很长一段时间才理解这个

问题,如果我们预先把𝜃1放在一个局部的最低点,你认为下一步梯度下降法会怎样工作?

假设你将𝜃1初始化在局部最低点,在这儿,它已经在一个局部的最优处或局部最低点。

结果是局部最优点的导数将等于零,因为它是那条切线的斜率。这意味着你已经在局部最优

点,它使得𝜃1不再改变,也就是新的𝜃1等于原来的𝜃1,因此,如果你的参数已经处于局部最

低点,那么梯度下降法更新其实什么都没做,它不会改变参数的值。这也解释了为什么即使

学习速率𝑎保持不变时,梯度下降也可以收敛到局部最低点。

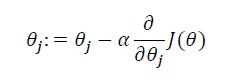

我们来看一个例子,这是代价函数𝐽(𝜃)。

我想找到它的最小值,首先初始化我的梯度下降算法,在那个品红色的点初始化,如果

我更新一步梯度下降,也许它会带我到这个点,因为这个点的导数是相当陡的。现在,在这

个绿色的点,如果我再更新一步,你会发现我的导数,也即斜率,是没那么陡的。随着我接

近最低点,我的导数越来越接近零,所以,梯度下降一步后,新的导数会变小一点点。然后

我想再梯度下降一步,在这个绿点,我自然会用一个稍微跟刚才在那个品红点时比,再小一

点的一步,到了新的红色点,更接近全局最低点了,因此这点的导数会比在绿点时更小。所

以,我再进行一步梯度下降时,我的导数项是更小的,𝜃1更新的幅度就会更小。所以随着梯

度下降法的运行,你移动的幅度会自动变得越来越小,直到最终移动幅度非常小,你会发现,

已经收敛到局部极小值。

回顾一下,在梯度下降法中,当我们接近局部最低点时,梯度下降法会自动采取更小的

幅度,这是因为当我们接近局部最低点时,很显然在局部最低时导数等于零,所以当我们接

近局部最低时,导数值会自动变得越来越小,所以梯度下降将自动采取较小的幅度,这就是

梯度下降的做法。所以实际上没有必要再另外减小𝑎。

这就是梯度下降算法,你可以用它来最小化任何代价函数𝐽,不只是线性回归中的代价

函数𝐽。

浙公网安备 33010602011771号

浙公网安备 33010602011771号