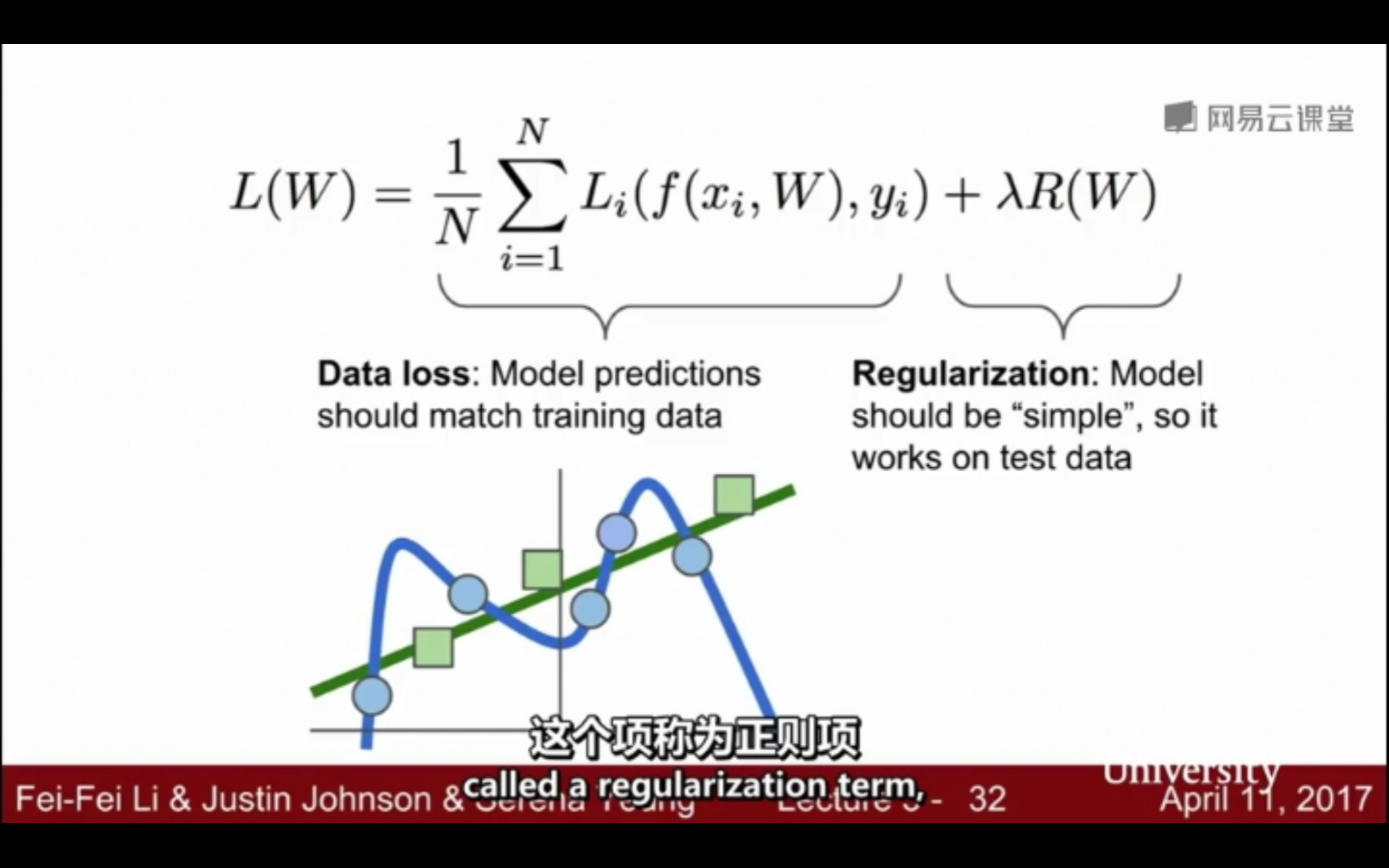

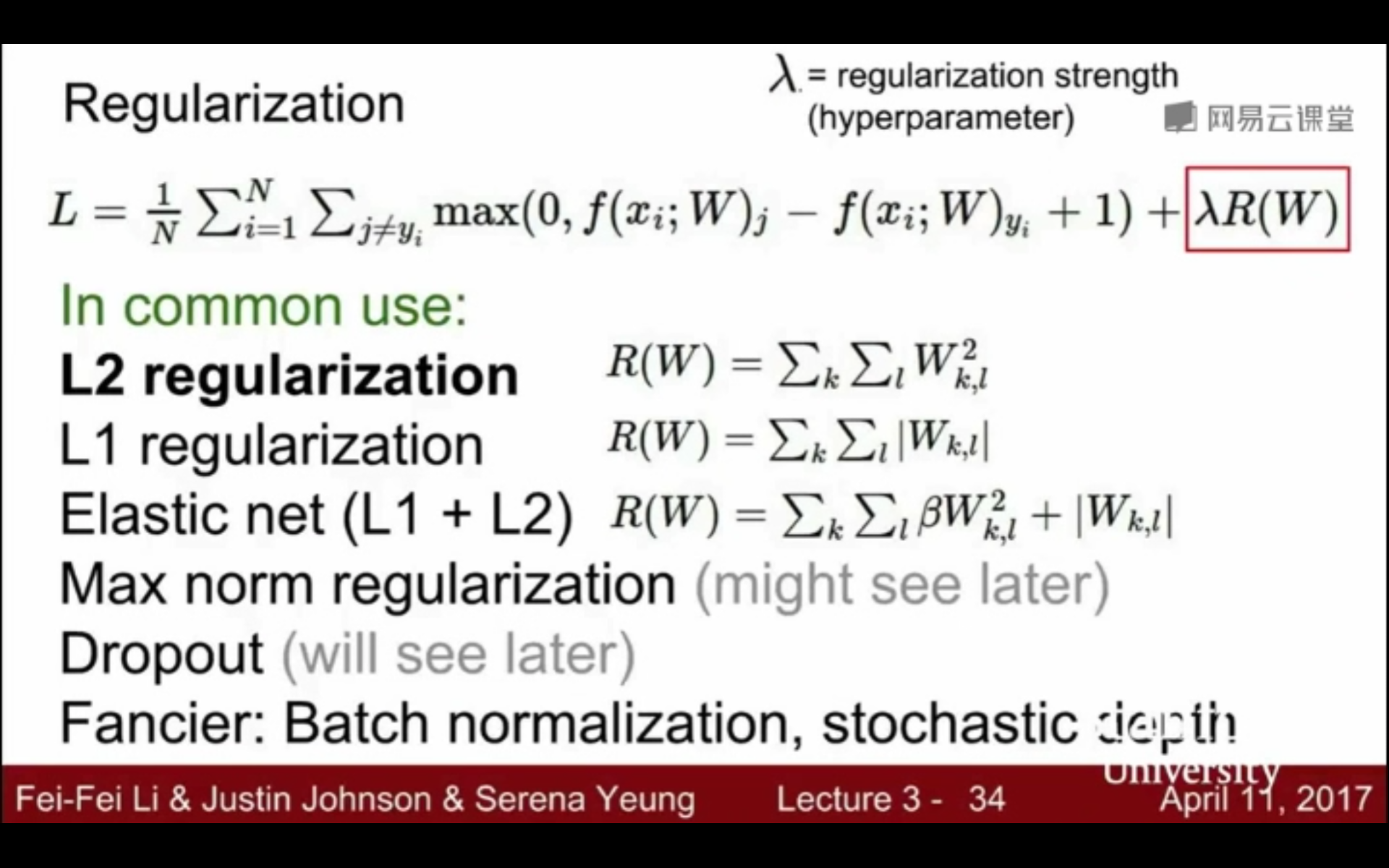

Regularization:正则化 - L1、L2

1. 正则化:通常在损失函数后加上一项正则化项,对模型进行干扰,以达到防止过拟合,增加模型的泛化性的目的

正则化:L1正则化 、L2正则化(权重衰减)

①L1正则化 ||w||1:权重矩阵W中各元素的绝对值之和,主要是为了构建稀疏矩阵,保留必要的特征向量,筛选掉不必要的特征向量

稀疏矩阵是指的是大多数元素为0,只有少数元素为非0的矩阵。通常机器学习中特征数量很多,在预测或分类时,那么多特征显然难以选择,如果代入这些特征得到的模型是一

个稀疏模型,表示只有少数特征对这个模型有贡献,绝大部分特征是没有贡献或者贡献微小,此时只需关注系数是非零值的特征

L1正则化:W中各元素的绝对值之和

![]()

②L2正则化 ||w||2:权重矩阵W中各元素的平方和再开方,主要是使得权重矩阵的参数尽可能的小,特别是高次方的系数,以减少波动性,增加抗干扰能力。

一般参数值小的模型比较简单,能适应不同的数据集,也在一定程度上避免了过拟合现象。因此,拟合过程中通常都倾向于让权值尽可能小,最后构造一个所有参数都比较小的

模型。可以设想一下对于一个线性回归方程,若参数很大,那么只要数据偏移一点点,就会对结果造成很大的影响;但如果参数足够小,数据偏移得多一点也不会对结果造成什

么影响,就是抗扰动能力强

L2正则化:W中各元素的平方和再开方

![]()

③正则化与损失函数:

附:其他避免过拟合的方法

参考:https://blog.csdn.net/jinping_shi/article/details/52433975