摘要:

小结: 1、配置了学长的环境,并编写点处理(旋转、镜像)和保存(由内存numpy数组到shp文件)脚本。 2、初步阅读mesh-gpt论文,思考Transformer网络架构(翻译模型和补全模型的训练区别) 环境配置 pip install torch==2.1.2 torchvision==0.1 阅读全文

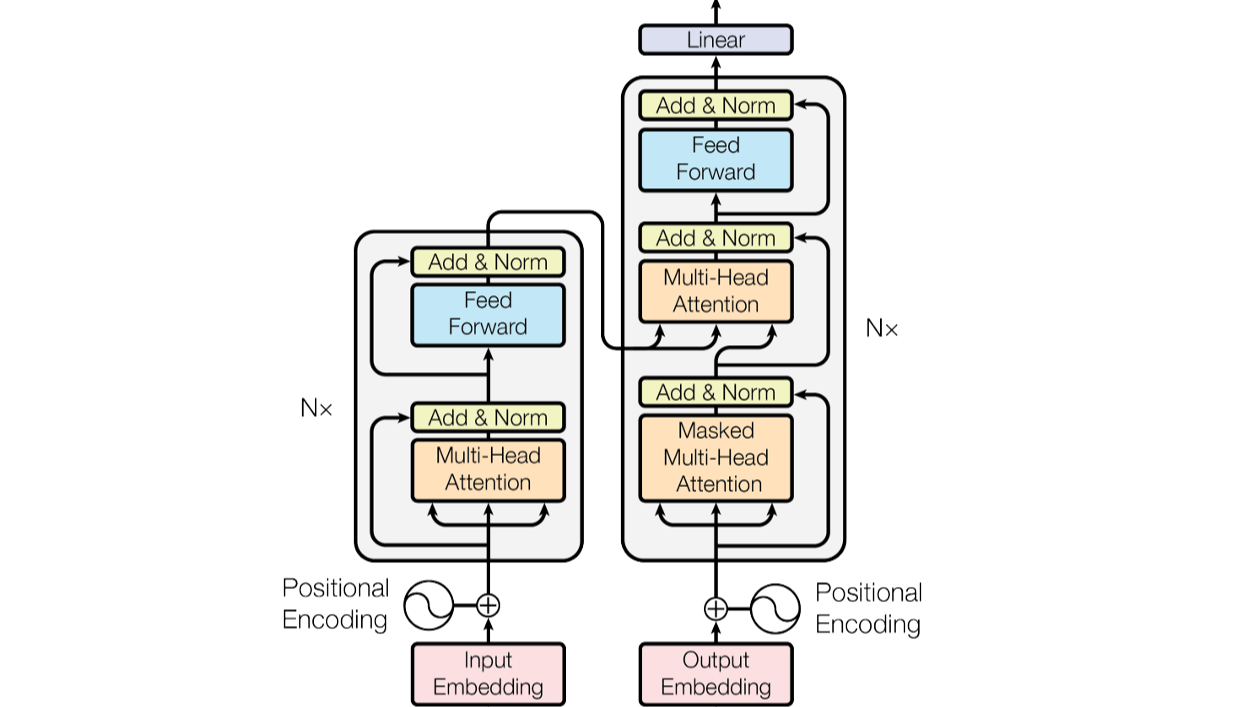

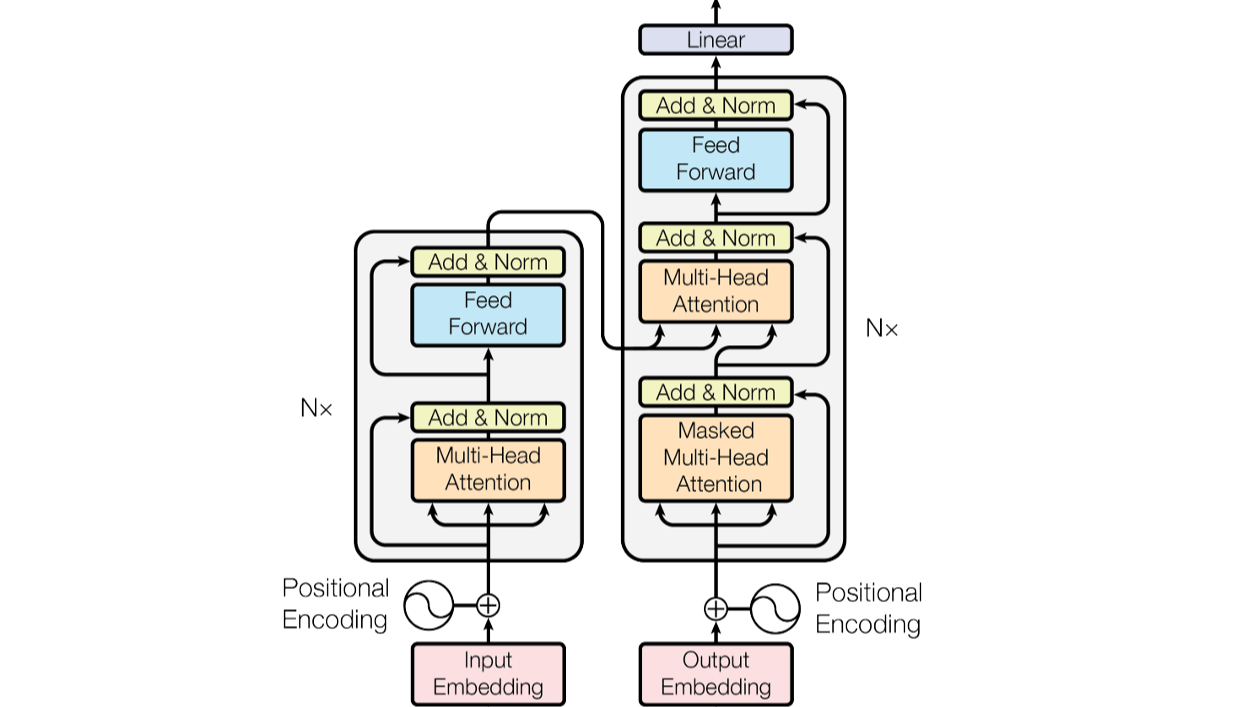

摘要:  只有理解了,才能在超越经验的情况下,生成出合理的内容 编解码 encoder-decoder结构 什么是“码”? 剥离形式的表示(各种语言的不同),剩下的语义关系(上下文语义) “码”的要求:1、数字化 2、语义关系的距离 分词器和one-hot编码在2不足 需要找到一个纬度高,但是又没那么高的空间 阅读全文

只有理解了,才能在超越经验的情况下,生成出合理的内容 编解码 encoder-decoder结构 什么是“码”? 剥离形式的表示(各种语言的不同),剩下的语义关系(上下文语义) “码”的要求:1、数字化 2、语义关系的距离 分词器和one-hot编码在2不足 需要找到一个纬度高,但是又没那么高的空间 阅读全文

只有理解了,才能在超越经验的情况下,生成出合理的内容 编解码 encoder-decoder结构 什么是“码”? 剥离形式的表示(各种语言的不同),剩下的语义关系(上下文语义) “码”的要求:1、数字化 2、语义关系的距离 分词器和one-hot编码在2不足 需要找到一个纬度高,但是又没那么高的空间 阅读全文

只有理解了,才能在超越经验的情况下,生成出合理的内容 编解码 encoder-decoder结构 什么是“码”? 剥离形式的表示(各种语言的不同),剩下的语义关系(上下文语义) “码”的要求:1、数字化 2、语义关系的距离 分词器和one-hot编码在2不足 需要找到一个纬度高,但是又没那么高的空间 阅读全文