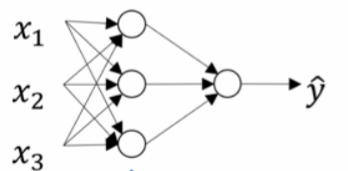

浅层神经网络工作流程

上次写的那个神经网络是只有一个W,b的神经网络

说实话,其实那个根本不能叫做神经网络

那个只是一个高级一点的线性拟合而已

浅层神经网络有2层

第0层是输入层,输入一个向量

第二场是隐藏层,第三层是输出层

每一个节点都会把传进来的变量用Z=X*W.T+b,a=f(Z),然后输出a

最后一个节点的输出就是答案

f是激活函数,比如说逻辑回归中,f=sigmoid

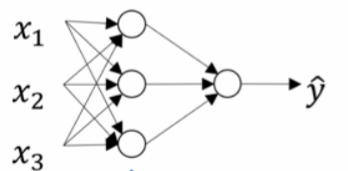

上次写的那个神经网络是只有一个W,b的神经网络

说实话,其实那个根本不能叫做神经网络

那个只是一个高级一点的线性拟合而已

浅层神经网络有2层

第0层是输入层,输入一个向量

第二场是隐藏层,第三层是输出层

每一个节点都会把传进来的变量用Z=X*W.T+b,a=f(Z),然后输出a

最后一个节点的输出就是答案

f是激活函数,比如说逻辑回归中,f=sigmoid