EmbodiedCity:首个基于真实城市环境的具身智能基准测试平台。

2024-10-13,由清华大学创建的EmbodiedCity数据集,标志着Embodied AI研究从室内走向户外,为人工智能提供了一个更接近现实世界的测试环境。

一、研究背景:

随着Embodied AI(具身智能)的发展,研究者们越来越重视构建能够感知、规划和行动的机器学习模型,以实现与现实世界的实时互动。然而,大多数研究工作都集中在有限的室内环境中,如室内导航或设备操作,而对于在开放世界和户外环境中的具身智能探索较少。

目前遇到困难和挑战:

1、缺乏高质量的模拟器、基准和数据集,尤其是在开放和户外环境中。

2、现有的研究主要关注室内场景,限制了对具身智能能力的全面验证。

二、让我们一起看一下EmbodiedCity数据集

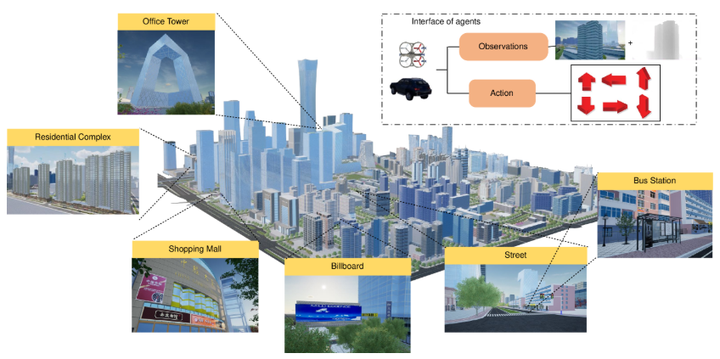

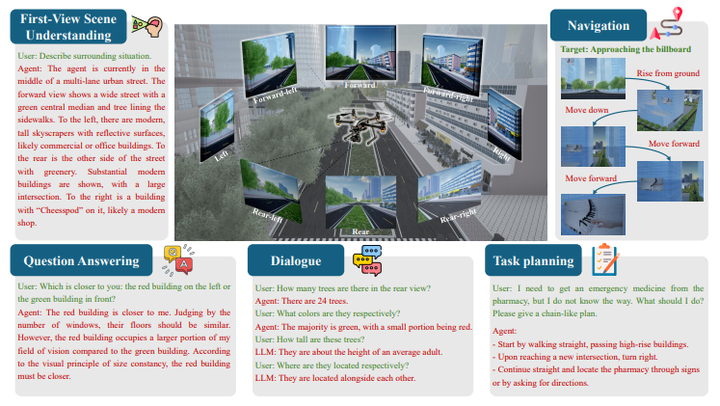

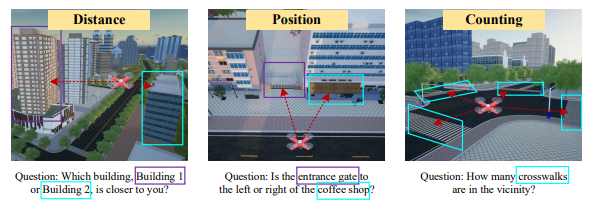

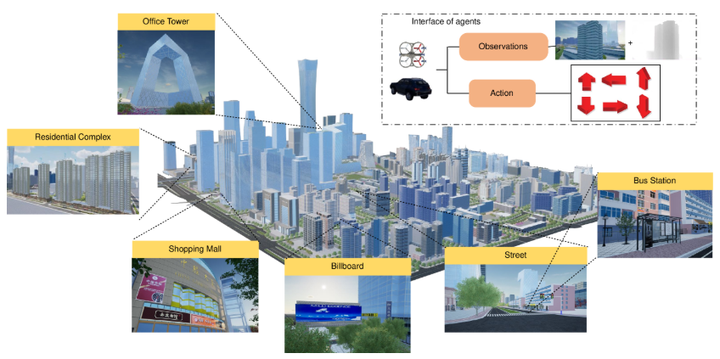

EmbodiedCity是一个基于真实城市环境构建的Embodied AI基准测试平台,提供了一个高度真实的3D模拟环境和一系列评估任务。

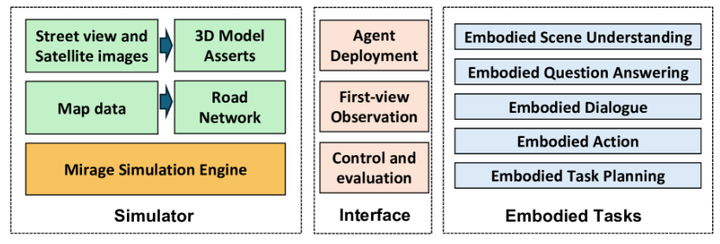

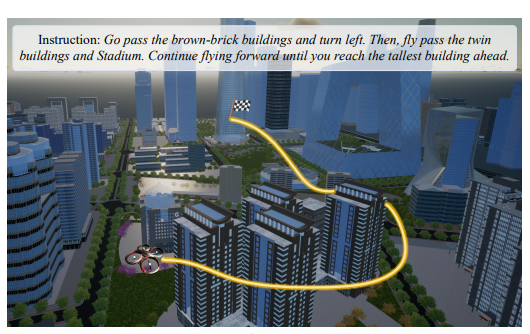

EmbodiedCity数据集基于中国北京市的一个商业区的真实街道、建筑和城市元素,通过结合历史收集的交通数据和模拟算法,进行高保真的行人和车辆流动模拟。该平台设计了一系列评估任务,覆盖了不同的EmbodiedAI能力,并提供了完整的输入输出接口,使具身智能体能够轻松获取任务要求和当前环境观察结果,然后做出决策和获得性能评估。

数据集构建:

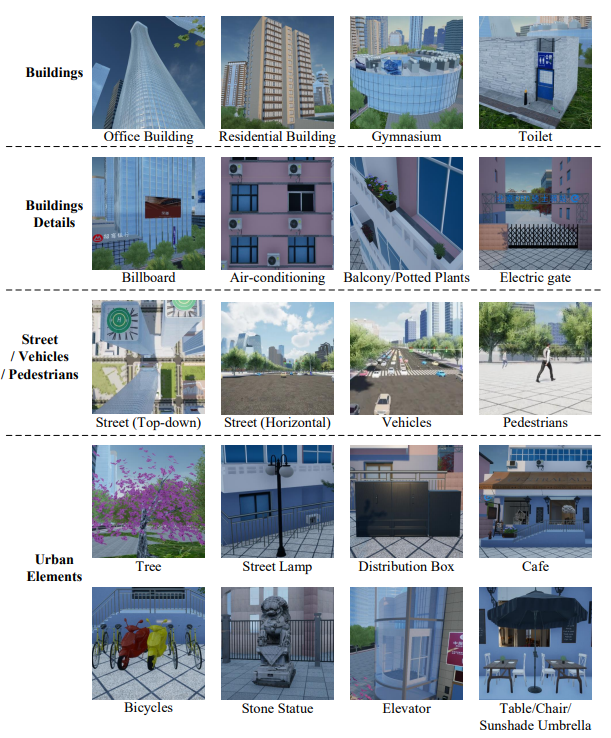

EmbodiedCity数据集构建了一个2.8km x 2.4km的北京区域的3D模型,包括约200栋建筑和100条街道,总长度约50公里。此外,还包括了6000多个城市元素,如街道家具、植被和城市设施,以增强城市模拟的真实性。

数据集特点:

1、基于真实城市环境,提供高保真的3D模拟。

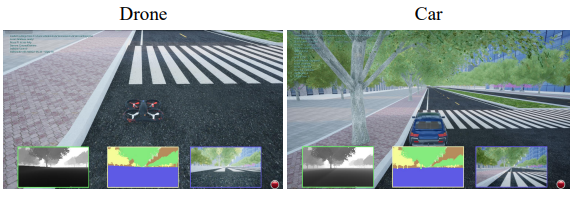

2、支持多种类型的智能体,包括地面和空中智能体。

3、提供连续的决策制定和系统化的基准测试任务。

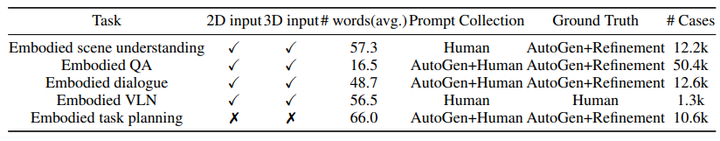

4、包含87.1k案例的数据集,涵盖五个基本的具身任务。

EmbodiedCity提供了一个Python客户端软件开发包(SDK)和一个基于HTTP协议的Python代理服务器,使得用户可以远程访问和控制模拟器。用户可以通过键盘、Web GUI或在线Python代码编辑器控制智能体的移动,并可以通过实时视频流观看所有智能体的第一人称视角。

基准测试:

EmbodiedCity基准测试包括五个任务:场景描述、问题回答、对话、视觉语言导航和任务规划。这些任务覆盖了具身智能体在开放户外城市环境中的多级和多维能力。

三、让我们一起展望EmbodiedCity数据集应用

比如,某市的一个繁华商业区突然发生了一场地震。由于地震的破坏,一些建筑物受损严重,人们可能被困在废墟之中。在这种情况下,时间就是生命,快速有效的救援行动至关重要。

首先,我们的高空侦察机会迅速出动,它能够快速机动,视野广阔,不受地形限制。它在受灾区域上空飞行,利用搭载的高清摄像头和红外热成像设备,迅速侦察整个区域,获取受损建筑物的位置信息。这些信息就像是给救援队伍提供了一张“地图”,指引他们应该去哪里寻找可能的幸存者。

接下来,无人机群体会根据高空侦察机提供的信息,飞往各个受损建筑物地点。这些无人机小巧、便宜,便于大规模部署。它们搭载着红外、声呐、雷达等生命探测装置,对受损建筑物进行详细的探测,寻找可能的幸存者。无人机能够形成一张受灾人员密度分布图,告诉我们哪里的幸存者最多,哪里需要优先救援。

最后,无人车群体会根据无人机提供的密度分布图,实施救援。无人车体型较大,运载能力强,它们可以携带救援设备和物资,快速到达现场,为幸存者提供急需的帮助。

在这个案例中,EmbodiedCity数据集扮演了至关重要的角色。它提供了一个高度真实的城市环境模拟,让这些救援机器人和无人机能够在虚拟环境中进行训练和测试。通过模拟地震发生后的城市场景,EmbodiedCity帮助我们训练这些救援智能体,提高它们在真实情况下的救援效率和成功率。同时还能够减少救援人员的风险,确保救援行动的安全性和有效性。通过这种方式,EmbodiedCity数据集为拯救生命提供了强有力的支持。

更多开源数据集,请打开:遇见数据集

2024-10-13,由清华大学创建的EmbodiedCity数据集,标志着Embodied AI研究从室内走向户外,为人工智能提供了一个更接近现实世界的测试环境。

2024-10-13,由清华大学创建的EmbodiedCity数据集,标志着Embodied AI研究从室内走向户外,为人工智能提供了一个更接近现实世界的测试环境。

浙公网安备 33010602011771号

浙公网安备 33010602011771号