【特征检测】SIFT 尺度不变特征变换匹配 算法详解

1. 尺度不变特征变换匹配算法详解 Scale Invariant Feature Transform(SIFT)

2. 尺度不变特征变换(SIFT)特征提取分析

3. opencv源码解析之(3):特征点检查前言1 , SIFT+SURF OpenCV 调用demo

-------------------------------------------------

1.尺度不变特征变换匹配算法详解

zddmail@gmail.com or (zddhub@gmail.com)

对于初学者,从David G.Lowe的论文到实现,有许多鸿沟,本文帮你跨越。

如果你学习SIFI得目的是为了做检索,也许 OpenSSE 更适合你,欢迎使用。

1、SIFT综述

尺度不变特征转换(Scale-invariant feature transform或SIFT)是一种电脑视觉的算法用来侦测与描述影像中的局部性特征,它在空间尺度中寻找极值点,并提取出其位置、尺度、旋转不变量,此算法由 David Lowe在1999年所发表,2004年完善总结。

其应用范围包含物体辨识、机器人地图感知与导航、影像缝合、3D模型建立、手势辨识、影像追踪和动作比对。

此算法有其专利,专利拥有者为英属哥伦比亚大学。

局部影像特征的描述与侦测可以帮助辨识物体,SIFT 特征是基于物体上的一些局部外观的兴趣点而与影像的大小和旋转无关。对于光线、噪声、些微视角改变的容忍度也相当高。基于这些特性,它们是高度显著而且相对容易撷取,在母数庞大的特征数据库中,很容易辨识物体而且鲜有误认。使用 SIFT特征描述对于部分物体遮蔽的侦测率也相当高,甚至只需要3个以上的SIFT物体特征就足以计算出位置与方位。在现今的电脑硬件速度下和小型的特征数据库条件下,辨识速度可接近即时运算。SIFT特征的信息量大,适合在海量数据库中快速准确匹配。

SIFT算法的特点有:

1. SIFT特征是图像的局部特征,其对旋转、尺度缩放、亮度变化保持不变性,对视角变化、仿射变换、噪声也保持一定程度的稳定性;

2. 独特性(Distinctiveness)好,信息量丰富,适用于在海量特征数据库中进行快速、准确的匹配;

3. 多量性,即使少数的几个物体也可以产生大量的SIFT特征向量;

4. 高速性,经优化的SIFT匹配算法甚至可以达到实时的要求;

5. 可扩展性,可以很方便的与其他形式的特征向量进行联合。

SIFT算法可以解决的问题:

目标的自身状态、场景所处的环境和成像器材的成像特性等因素影响图像配准/目标识别跟踪的性能。而SIFT算法在一定程度上可解决:

1. 目标的旋转、缩放、平移(RST)

2. 图像仿射/投影变换(视点viewpoint)

3. 光照影响(illumination)

4. 目标遮挡(occlusion)

5. 杂物场景(clutter)

6. 噪声

SIFT算法的实质是在不同的尺度空间上查找关键点(特征点),并计算出关键点的方向。SIFT所查找到的关键点是一些十分突出,不会因光照,仿射变换和噪音等因素而变化的点,如角点、边缘点、暗区的亮点及亮区的暗点等。

Lowe将SIFT算法分解为如下四步:

1. 尺度空间极值检测:搜索所有尺度上的图像位置。通过高斯微分函数来识别潜在的对于尺度和旋转不变的兴趣点。

2. 关键点定位:在每个候选的位置上,通过一个拟合精细的模型来确定位置和尺度。关键点的选择依据于它们的稳定程度。

3. 方向确定:基于图像局部的梯度方向,分配给每个关键点位置一个或多个方向。所有后面的对图像数据的操作都相对于关键点的方向、尺度和位置进行变换,从而提供对于这些变换的不变性。

4. 关键点描述:在每个关键点周围的邻域内,在选定的尺度上测量图像局部的梯度。这些梯度被变换成一种表示,这种表示允许比较大的局部形状的变形和光照变化。

本文沿着Lowe的步骤,参考Rob Hess及Andrea Vedaldi源码,详解SIFT算法的实现过程。

2、高斯模糊

SIFT算法是在不同的尺度空间上查找关键点,而尺度空间的获取需要使用高斯模糊来实现,Lindeberg等人已证明高斯卷积核是实现尺度变换的唯一变换核,并且是唯一的线性核。本节先介绍高斯模糊算法。

2.1二维高斯函数

高斯模糊是一种图像滤波器,它使用正态分布(高斯函数)计算模糊模板,并使用该模板与原图像做卷积运算,达到模糊图像的目的。

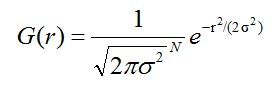

N维空间正态分布方程为:

(1-1)

(1-1)

其中, 是正态分布的标准差,

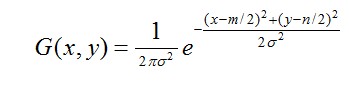

是正态分布的标准差, 值越大,图像越模糊(平滑)。r为模糊半径,模糊半径是指模板元素到模板中心的距离。如二维模板大小为m*n,则模板上的元素(x,y)对应的高斯计算公式为:

值越大,图像越模糊(平滑)。r为模糊半径,模糊半径是指模板元素到模板中心的距离。如二维模板大小为m*n,则模板上的元素(x,y)对应的高斯计算公式为:

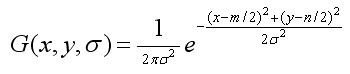

(1-2)

(1-2)

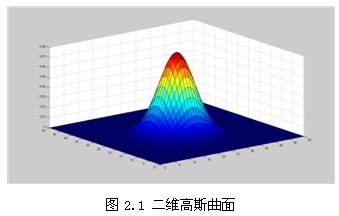

在二维空间中,这个公式生成的曲面的等高线是从中心开始呈正态分布的同心圆,如图2.1所示。分布不为零的像素组成的卷积矩阵与原始图像做变换。每个像素的值都是周围相邻像素值的加权平均。原始像素的值有最大的高斯分布值,所以有最大的权重,相邻像素随着距离原始像素越来越远,其权重也越来越小。这样进行模糊处理比其它的均衡模糊滤波器更高地保留了边缘效果。

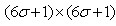

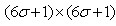

理论上来讲,图像中每点的分布都不为零,这也就是说每个像素的计算都需要包含整幅图像。在实际应用中,在计算高斯函数的离散近似时,在大概3σ距离之外的像素都可以看作不起作用,这些像素的计算也就可以忽略。通常,图像处理程序只需要计算 的矩阵就可以保证相关像素影响。

的矩阵就可以保证相关像素影响。

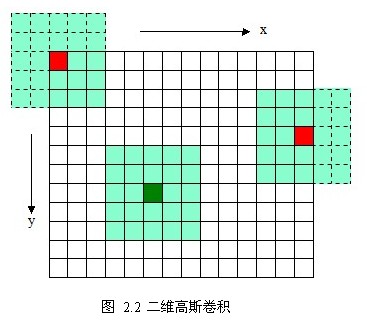

2.2 图像的二维高斯模糊

根据σ的值,计算出高斯模板矩阵的大小( ),使用公式(1-2)计算高斯模板矩阵的值,与原图像做卷积,即可获得原图像的平滑(高斯模糊)图像。为了确保模板矩阵中的元素在[0,1]之间,需将模板矩阵归一化。5*5的高斯模板如表2.1所示。

),使用公式(1-2)计算高斯模板矩阵的值,与原图像做卷积,即可获得原图像的平滑(高斯模糊)图像。为了确保模板矩阵中的元素在[0,1]之间,需将模板矩阵归一化。5*5的高斯模板如表2.1所示。

下图是5*5的高斯模板卷积计算示意图。高斯模板是中心对称的。

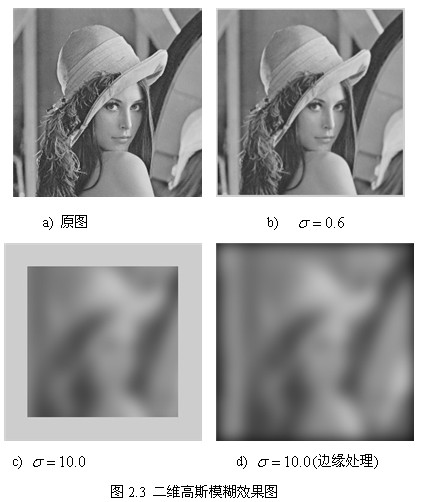

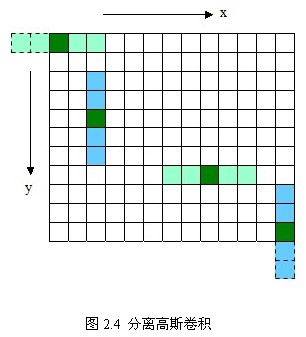

2.3分离高斯模糊

如图2.3所示,使用二维的高斯模板达到了模糊图像的目的,但是会因模板矩阵的关系而造成边缘图像缺失(2.3 b,c), 越大,缺失像素越多,丢弃模板会造成黑边(2.3 d)。更重要的是当变大时,高斯模板(高斯核)和卷积运算量将大幅度提高。根据高斯函数的可分离性,可对二维高斯模糊函数进行改进。

越大,缺失像素越多,丢弃模板会造成黑边(2.3 d)。更重要的是当变大时,高斯模板(高斯核)和卷积运算量将大幅度提高。根据高斯函数的可分离性,可对二维高斯模糊函数进行改进。

高斯函数的可分离性是指使用二维矩阵变换得到的效果也可以通过在水平方向进行一维高斯矩阵变换加上竖直方向的一维高斯矩阵变换得到。从计算的角度来看,这是一项有用的特性,因为这样只需要 次计算,而二维不可分的矩阵则需要

次计算,而二维不可分的矩阵则需要 次计算,其中,m,n为高斯矩阵的维数,M,N为二维图像的维数。

次计算,其中,m,n为高斯矩阵的维数,M,N为二维图像的维数。

另外,两次一维的高斯卷积将消除二维高斯矩阵所产生的边缘。(关于消除边缘的论述如下图2.4所示, 对用模板矩阵超出边界的部分——虚线框,将不做卷积计算。如图2.4中x方向的第一个模板1*5,将退化成1*3的模板,只在图像之内的部分做卷积。)

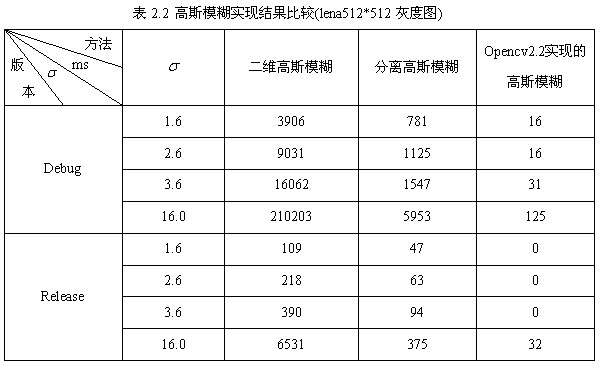

附录1是用opencv2.2实现的二维高斯模糊和分离高斯模糊。表2.2为上述两种方法和opencv2.3开源库实现的高斯模糊程序的比较。

3、尺度空间极值检测

尺度空间使用高斯金字塔表示。Tony Lindeberg指出尺度规范化的LoG(Laplacion of Gaussian)算子具有真正的尺度不变性,Lowe使用高斯差分金字塔近似LoG算子,在尺度空间检测稳定的关键点。

3.1 尺度空间理论

尺度空间(scale space)思想最早是由Iijima于1962年提出的,后经witkin和Koenderink等人的推广逐渐得到关注,在计算机视觉邻域使用广泛。

尺度空间理论的基本思想是:在图像信息处理模型中引入一个被视为尺度的参数,通过连续变化尺度参数获得多尺度下的尺度空间表示序列,对这些序列进行尺度空间主轮廓的提取,并以该主轮廓作为一种特征向量,实现边缘、角点检测和不同分辨率上的特征提取等。

尺度空间方法将传统的单尺度图像信息处理技术纳入尺度不断变化的动态分析框架中,更容易获取图像的本质特征。尺度空间中各尺度图像的模糊程度逐渐变大,能够模拟人在距离目标由近到远时目标在视网膜上的形成过程。

尺度空间满足视觉不变性。该不变性的视觉解释如下:当我们用眼睛观察物体时,一方面当物体所处背景的光照条件变化时,视网膜感知图像的亮度水平和对比度是不同的,因此要求尺度空间算子对图像的分析不受图像的灰度水平和对比度变化的影响,即满足灰度不变性和对比度不变性。另一方面,相对于某一固定坐标系,当观察者和物体之间的相对位置变化时,视网膜所感知的图像的位置、大小、角度和形状是不同的,因此要求尺度空间算子对图像的分析和图像的位置、大小、角度以及仿射变换无关,即满足平移不变性、尺度不变性、欧几里德不变性以及仿射不变性。

3.2 尺度空间的表示

一个图像的尺度空间, 定义为一个变化尺度的高斯函数

定义为一个变化尺度的高斯函数 与原图像

与原图像 的卷积。

的卷积。

(3-1)

(3-1)

其中,*表示卷积运算,

(3-2)

(3-2)

与公式(1-2)相同,m,n表示高斯模板的维度(由 确定)。(x, y)代表图像的像素位置。

确定)。(x, y)代表图像的像素位置。 是尺度空间因子,值越小表示图像被平滑的越少,相应的尺度也就越小。大尺度对应于图像的概貌特征,小尺度对应于图像的细节特征。

是尺度空间因子,值越小表示图像被平滑的越少,相应的尺度也就越小。大尺度对应于图像的概貌特征,小尺度对应于图像的细节特征。

3.3 高斯金字塔的构建

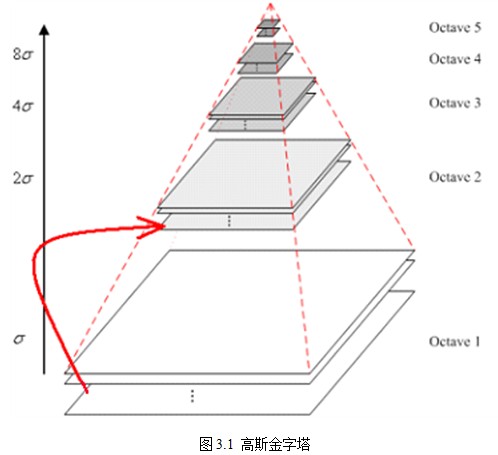

尺度空间在实现时使用高斯金字塔表示,高斯金字塔的构建分为两部分:

1. 对图像做不同尺度的高斯模糊;

2. 对图像做降采样(隔点采样)。

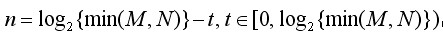

图像的金字塔模型是指,将原始图像不断降阶采样,得到一系列大小不一的图像,由大到小,从下到上构成的塔状模型。原图像为金子塔的第一层,每次降采样所得到的新图像为金字塔的一层(每层一张图像),每个金字塔共n层。金字塔的层数根据图像的原始大小和塔顶图像的大小共同决定,其计算公式如下:

(3-3)

(3-3)

其中M,N为原图像的大小,t为塔顶图像的最小维数的对数值。如,对于大小为512*512的图像,金字塔上各层图像的大小如表3.1所示,当塔顶图像为4*4时,n=7,当塔顶图像为2*2时,n=8。

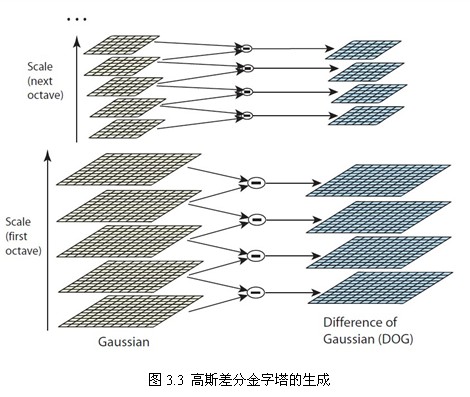

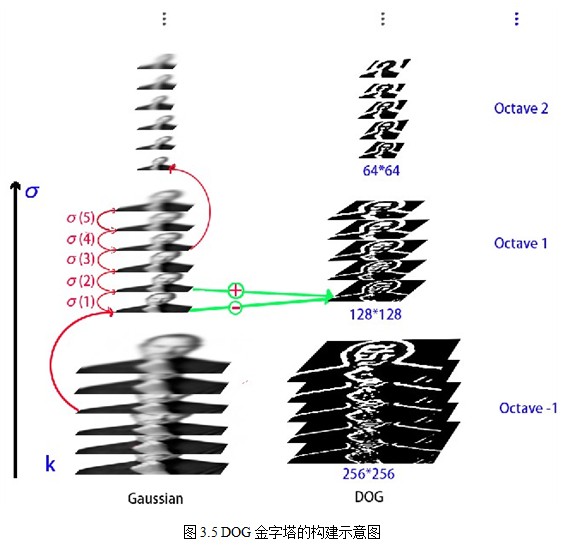

为了让尺度体现其连续性,高斯金字塔在简单降采样的基础上加上了高斯滤波。如图3.1所示,将图像金字塔每层的一张图像使用不同参数做高斯模糊,使得金字塔的每层含有多张高斯模糊图像,将金字塔每层多张图像合称为一组(Octave),金字塔每层只有一组图像,组数和金字塔层数相等,使用公式(3-3)计算,每组含有多张(也叫层Interval)图像。另外,降采样时,高斯金字塔上一组图像的初始图像(底层图像)是由前一组图像的倒数第三张图像隔点采样得到的。

注:由于组内的多张图像按层次叠放,因此组内的多张图像也称做多层,为避免与金字塔层的概念混淆,本文以下内容中,若不特别说明是金字塔层数,层一般指组内各层图像。

注:如3.4节所示,为了在每组中检测S个尺度的极值点,则DOG金字塔每组需S+2层图像,而DOG金字塔由高斯金字塔相邻两层相减得到,则高斯金字塔每组需S+3层图像,实际计算时S在3到5之间。取S=3时,假定高斯金字塔存储索引如下:

第0组(即第-1组): 0 1 2 3 4 5

第1组: 6 7 8 9 10 11

第2组: ?

则第2组第一张图片根据第一组中索引为9的图片降采样得到,其它类似。

3.4 高斯差分金字塔

2002年Mikolajczyk在详细的实验比较中发现尺度归一化的高斯拉普拉斯函数 的极大值和极小值同其它的特征提取函数,例如:梯度,Hessian或Harris角特征比较,能够产生最稳定的图像特征。

的极大值和极小值同其它的特征提取函数,例如:梯度,Hessian或Harris角特征比较,能够产生最稳定的图像特征。

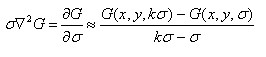

而Lindeberg早在1994年就发现高斯差分函数(Difference of Gaussian ,简称DOG算子)与尺度归一化的高斯拉普拉斯函数 非常近似。其中

非常近似。其中 和

和 的关系可以从如下公式推导得到:

的关系可以从如下公式推导得到:

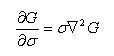

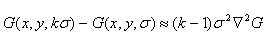

利用差分近似代替微分,则有:

因此有

其中k-1是个常数,并不影响极值点位置的求取。

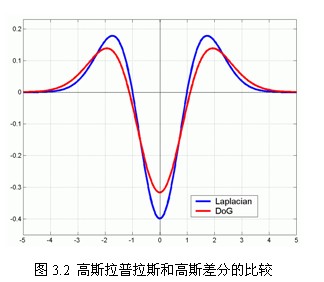

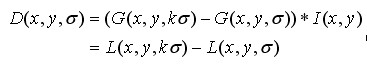

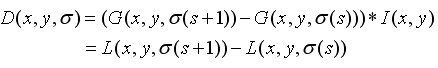

如图3.2所示,红色曲线表示的是高斯差分算子,而蓝色曲线表示的是高斯拉普拉斯算子。Lowe使用更高效的高斯差分算子代替拉普拉斯算子进行极值检测,如下:

(3-4)

(3-4)

在实际计算时,使用高斯金字塔每组中相邻上下两层图像相减,得到高斯差分图像,如图3.3所示,进行极值检测。

3.5 空间极值点检测(关键点的初步探查)

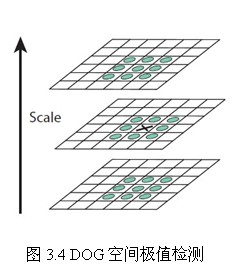

关键点是由DOG空间的局部极值点组成的,关键点的初步探查是通过同一组内各DoG相邻两层图像之间比较完成的。为了寻找DoG函数的极值点,每一个像素点要和它所有的相邻点比较,看其是否比它的图像域和尺度域的相邻点大或者小。如图3.4所示,中间的检测点和它同尺度的8个相邻点和上下相邻尺度对应的9×2个点共26个点比较,以确保在尺度空间和二维图像空间都检测到极值点。

由于要在相邻尺度进行比较,如图3.3右侧每组含4层的高斯差分金子塔,只能在中间两层中进行两个尺度的极值点检测,其它尺度则只能在不同组中进行。为了在每组中检测S个尺度的极值点,则DOG金字塔每组需S+2层图像,而DOG金字塔由高斯金字塔相邻两层相减得到,则高斯金字塔每组需S+3层图像,实际计算时S在3到5之间。

当然这样产生的极值点并不全都是稳定的特征点,因为某些极值点响应较弱,而且DOG算子会产生较强的边缘响应。

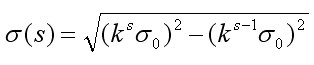

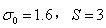

3.6 构建尺度空间需确定的参数

—尺度空间坐标

—尺度空间坐标

O—组(octave)数

S— 组内层数

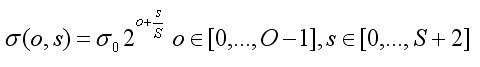

在上述尺度空间中,O和S, 的关系如下:

的关系如下:

(3-5)

(3-5)

其中 是基准层尺度,o为组octave的索引,s为组内层的索引。关键点的尺度坐标

是基准层尺度,o为组octave的索引,s为组内层的索引。关键点的尺度坐标 就是按关键点所在的组和组内的层,利用公式(3-5)计算而来。

就是按关键点所在的组和组内的层,利用公式(3-5)计算而来。

在最开始建立高斯金字塔时,要预先模糊输入图像来作为第0个组的第0层的图像,这时相当于丢弃了最高的空域的采样率。因此通常的做法是先将图像的尺度扩大一倍来生成第-1组。我们假定初始的输入图像为了抗击混淆现象,已经对其进行 的高斯模糊,如果输入图像的尺寸用双线性插值扩大一倍,那么相当于

的高斯模糊,如果输入图像的尺寸用双线性插值扩大一倍,那么相当于 。

。

取式(3-4)中的k为组内总层数的倒数,即

(3-6)

(3-6)

在构建高斯金字塔时,组内每层的尺度坐标按如下公式计算:

(3-7)

(3-7)

其中 初始尺度,lowe取

初始尺度,lowe取 ,s为组内的层索引,不同组相同层的组内尺度坐标

,s为组内的层索引,不同组相同层的组内尺度坐标 相同。组内下一层图像是由前一层图像按

相同。组内下一层图像是由前一层图像按 进行高斯模糊所得。式(3-7)用于一次生成组内不同尺度的高斯图像,而在计算组内某一层图像的尺度时,直接使用如下公式进行计算:

进行高斯模糊所得。式(3-7)用于一次生成组内不同尺度的高斯图像,而在计算组内某一层图像的尺度时,直接使用如下公式进行计算:

(3-8)

(3-8)

该组内尺度在方向分配和特征描述时确定采样窗口的大小。

由上,式(3-4)可记为

(3-9)

(3-9)

图3.5为构建DOG金字塔的示意图,原图采用128*128的jobs图像,扩大一倍后构建金字塔。

4、关键点定位

以上方法检测到的极值点是离散空间的极值点,以下通过拟合三维二次函数来精确确定关键点的位置和尺度,同时去除低对比度的关键点和不稳定的边缘响应点(因为DoG算子会产生较强的边缘响应),以增强匹配稳定性、提高抗噪声能力。

4.1关键点的精确定位

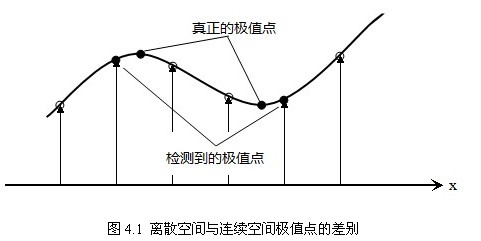

离散空间的极值点并不是真正的极值点,图4.1显示了二维函数离散空间得到的极值点与连续空间极值点的差别。利用已知的离散空间点插值得到的连续空间极值点的方法叫做子像素插值(Sub-pixel Interpolation)。

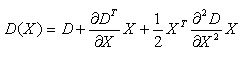

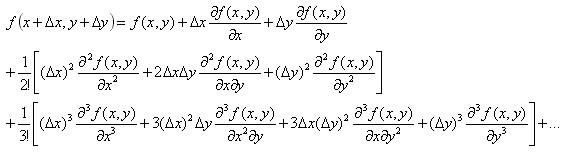

为了提高关键点的稳定性,需要对尺度空间DoG函数进行曲线拟合。利用DoG函数在尺度空间的Taylor展开式(拟合函数)为:

(4-1)

(4-1)

其中, 。求导并让方程等于零,可以得到极值点的偏移量为:

。求导并让方程等于零,可以得到极值点的偏移量为:

(4-2)

(4-2)

对应极值点,方程的值为:

(4-3)

(4-3)

其中, 代表相对插值中心的偏移量,当它在任一维度上的偏移量大于0.5时(即x或y或

代表相对插值中心的偏移量,当它在任一维度上的偏移量大于0.5时(即x或y或 ),意味着插值中心已经偏移到它的邻近点上,所以必须改变当前关键点的位置。同时在新的位置上反复插值直到收敛;也有可能超出所设定的迭代次数或者超出图像边界的范围,此时这样的点应该删除,在Lowe中进行了5次迭代。另外,

),意味着插值中心已经偏移到它的邻近点上,所以必须改变当前关键点的位置。同时在新的位置上反复插值直到收敛;也有可能超出所设定的迭代次数或者超出图像边界的范围,此时这样的点应该删除,在Lowe中进行了5次迭代。另外, 过小的点易受噪声的干扰而变得不稳定,所以将

过小的点易受噪声的干扰而变得不稳定,所以将 小于某个经验值(Lowe论文中使用0.03,Rob Hess等人实现时使用0.04/S)的极值点删除。同时,在此过程中获取特征点的精确位置(原位置加上拟合的偏移量)以及尺度(

小于某个经验值(Lowe论文中使用0.03,Rob Hess等人实现时使用0.04/S)的极值点删除。同时,在此过程中获取特征点的精确位置(原位置加上拟合的偏移量)以及尺度( )。

)。

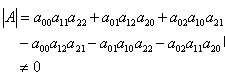

4.2消除边缘响应

一个定义不好的高斯差分算子的极值在横跨边缘的地方有较大的主曲率,而在垂直边缘的方向有较小的主曲率。

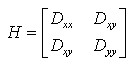

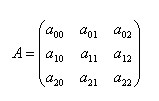

DOG算子会产生较强的边缘响应,需要剔除不稳定的边缘响应点。获取特征点处的Hessian矩阵,主曲率通过一个2x2 的Hessian矩阵H求出:

(4-4)

(4-4)

H的特征值α和β代表x和y方向的梯度,

(4-5)

(4-5)

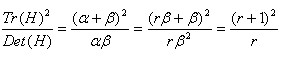

表示矩阵H对角线元素之和,表示矩阵H的行列式。假设是α较大的特征值,而是β较小的特征值,令 ,则

,则

(4-6)

(4-6)

导数由采样点相邻差估计得到,在下一节中说明。

D的主曲率和H的特征值成正比,令为α最大特征值,β为最小的特征值,则公式 的值在两个特征值相等时最小,随着的增大而增大。值越大,说明两个特征值的比值越大,即在某一个方向的梯度值越大,而在另一个方向的梯度值越小,而边缘恰恰就是这种情况。所以为了剔除边缘响应点,需要让该比值小于一定的阈值,因此,为了检测主曲率是否在某域值r下,只需检测

的值在两个特征值相等时最小,随着的增大而增大。值越大,说明两个特征值的比值越大,即在某一个方向的梯度值越大,而在另一个方向的梯度值越小,而边缘恰恰就是这种情况。所以为了剔除边缘响应点,需要让该比值小于一定的阈值,因此,为了检测主曲率是否在某域值r下,只需检测

(4-7)

(4-7)

式(4-7)成立时将关键点保留,反之剔除。

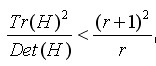

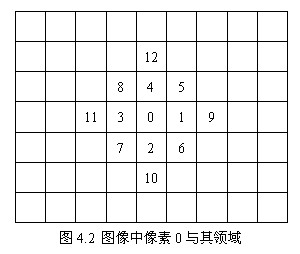

在Lowe的文章中,取r=10。图4.2右侧为消除边缘响应后的关键点分布图。

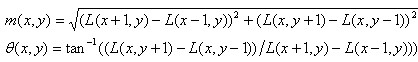

4.3有限差分法求导

有限差分法以变量离散取值后对应的函数值来近似微分方程中独立变量的连续取值。在有限差分方法中,我们放弃了微分方程中独立变量可以取连续值的特征,而关注独立变量离散取值后对应的函数值。但是从原则上说,这种方法仍然可以达到任意满意的计算精度。因为方程的连续数值解可以通过减小独立变量离散取值的间格,或者通过离散点上的函数值插值计算来近似得到。这种方法是随着计算机的诞生和应用而发展起来的。其计算格式和程序的设计都比较直观和简单,因而,它在计算数学中使用广泛。

有限差分法的具体操作分为两个部分:

1. 用差分代替微分方程中的微分,将连续变化的变量离散化,从而得到差分方程组的数学形式;

2. 求解差分方程组。

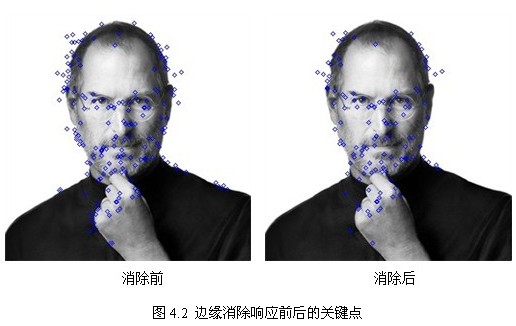

一个函数在x点上的一阶和二阶微商,可以近似地用它所临近的两点上的函数值的差分来表示。如对一个单变量函数f(x),x为定义在区间[a,b]上的连续变量,以步长 将区间[a,b]离散化,我们会得到一系列节点,

将区间[a,b]离散化,我们会得到一系列节点,

然后求出f(x)在这些点上的近似值。显然步长h越小,近似解的精度就越好。与节点 相邻的节点有

相邻的节点有 和

和 ,所以在节点

,所以在节点 处可构造如下形式的差值:

处可构造如下形式的差值:

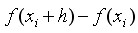

节点的一阶向前差分

节点的一阶向前差分

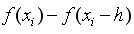

节点的一阶向后差分

节点的一阶向后差分

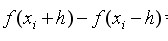

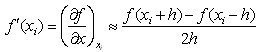

节点的一阶中心差分

节点的一阶中心差分

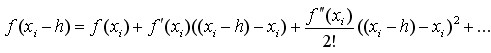

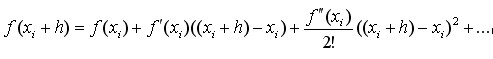

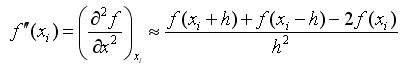

本文使用中心差分法利用泰勒展开式求解第四节所使用的导数,现做如下推导。

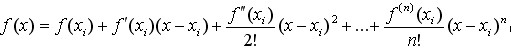

函数f(x)在 处的泰勒展开式为:

处的泰勒展开式为:

(4-8)

(4-8)

则,

(4-9)

(4-9)

(4-10)

(4-10)

忽略h平方之后的项,联立式(4-9),(4-10)解方程组得:

(4-11)

(4-11)

(4-12)

(4-12)

二元函数的泰勒展开式如下:

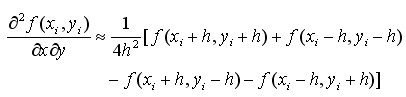

将 展开后忽略次要项联立解方程得二维混合偏导如下:

展开后忽略次要项联立解方程得二维混合偏导如下:

(4-13)

(4-13)

综上,推导了4.1,4.2遇到的所有导数计算。同理,利用多元泰勒展开式,可得任意偏导的近似差分表示。

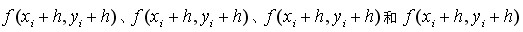

在图像处理中,取h=1,在图4.2所示的图像中,将像素0的基本中点导数公式整理如下:

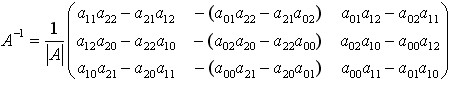

4.4 三阶矩阵求逆公式

高阶矩阵的求逆算法主要有归一法和消元法两种,现将三阶矩阵求逆公式总结如下:

若矩阵

可逆,即 时,

时,

(4-14)

(4-14)

5、关键点方向分配

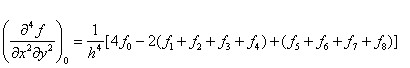

为了使描述符具有旋转不变性,需要利用图像的局部特征为给每一个关键点分配一个基准方向。使用图像梯度的方法求取局部结构的稳定方向。对于在DOG金字塔中检测出的关键点点,采集其所在高斯金字塔图像3σ邻域窗口内像素的梯度和方向分布特征。梯度的模值和方向如下:

(5-1)

(5-1)

L为关键点所在的尺度空间值,按Lowe的建议,梯度的模值m(x,y)按 的高斯分布加成,按尺度采样的3σ原则,邻域窗口半径为

的高斯分布加成,按尺度采样的3σ原则,邻域窗口半径为 。

。

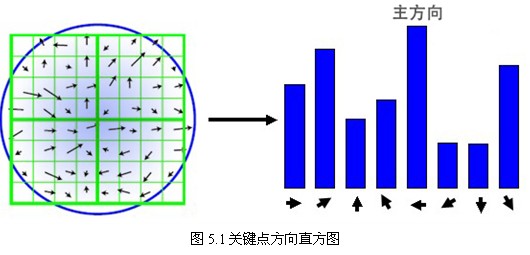

在完成关键点的梯度计算后,使用直方图统计邻域内像素的梯度和方向。梯度直方图将0~360度的方向范围分为36个柱(bins),其中每柱10度。如图5.1所示,直方图的峰值方向代表了关键点的主方向,(为简化,图中只画了八个方向的直方图)。

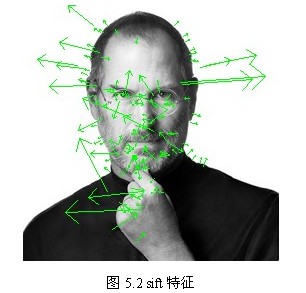

方向直方图的峰值则代表了该特征点处邻域梯度的方向,以直方图中最大值作为该关键点的主方向。为了增强匹配的鲁棒性,只保留峰值大于主方向峰值80%的方向作为该关键点的辅方向。因此,对于同一梯度值的多个峰值的关键点位置,在相同位置和尺度将会有多个关键点被创建但方向不同。仅有15%的关键点被赋予多个方向,但可以明显的提高关键点匹配的稳定性。实际编程实现中,就是把该关键点复制成多份关键点,并将方向值分别赋给这些复制后的关键点,并且,离散的梯度方向直方图要进行插值拟合处理,来求得更精确的方向角度值,检测结果如图5.2所示。

至此,将检测出的含有位置、尺度和方向的关键点即是该图像的SIFT特征点。

6、关键点特征描述

通过以上步骤,对于每一个关键点,拥有三个信息:位置、尺度以及方向。接下来就是为每个关键点建立一个描述符,用一组向量将这个关键点描述出来,使其不随各种变化而改变,比如光照变化、视角变化等等。这个描述子不但包括关键点,也包含关键点周围对其有贡献的像素点,并且描述符应该有较高的独特性,以便于提高特征点正确匹配的概率。

SIFT描述子是关键点邻域高斯图像梯度统计结果的一种表示。通过对关键点周围图像区域分块,计算块内梯度直方图,生成具有独特性的向量,这个向量是该区域图像信息的一种抽象,具有唯一性。

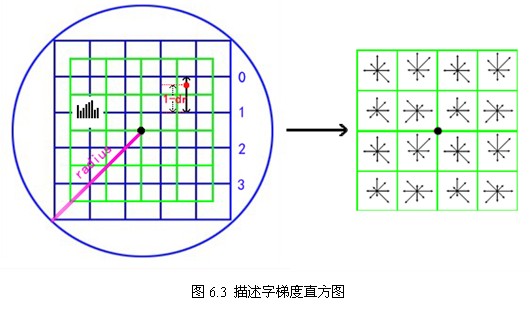

Lowe建议描述子使用在关键点尺度空间内4*4的窗口中计算的8个方向的梯度信息,共4*4*8=128维向量表征。表示步骤如下:

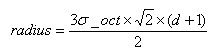

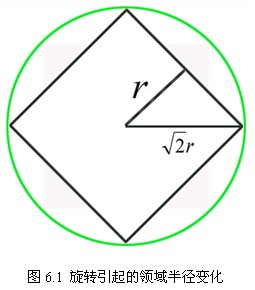

1. 确定计算描述子所需的图像区域

特征描述子与特征点所在的尺度有关,因此,对梯度的求取应在特征点对应的高斯图像上进行。将关键点附近的邻域划分为d*d(Lowe建议d=4)个子区域,每个子区域做为一个种子点,每个种子点有8个方向。每个子区域的大小与关键点方向分配时相同,即每个区域有个 子像素,为每个子区域分配边长为

子像素,为每个子区域分配边长为 的矩形区域进行采样(个子像素实际用边长为

的矩形区域进行采样(个子像素实际用边长为 的矩形区域即可包含,但由式(3-8),

的矩形区域即可包含,但由式(3-8), 不大,为了简化计算取其边长为

不大,为了简化计算取其边长为 ,并且采样点宜多不宜少)。考虑到实际计算时,需要采用双线性插值,所需图像窗口边长为

,并且采样点宜多不宜少)。考虑到实际计算时,需要采用双线性插值,所需图像窗口边长为 。在考虑到旋转因素(方便下一步将坐标轴旋转到关键点的方向),如下图6.1所示,实际计算所需的图像区域半径为:

。在考虑到旋转因素(方便下一步将坐标轴旋转到关键点的方向),如下图6.1所示,实际计算所需的图像区域半径为:

(6-1)

(6-1)

计算结果四舍五入取整。

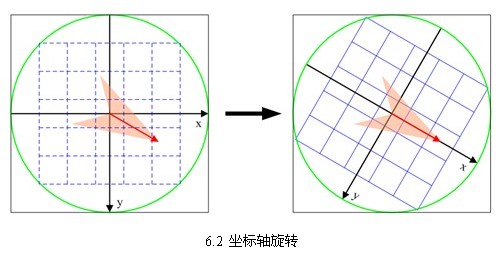

2. 将坐标轴旋转为关键点的方向,以确保旋转不变性,如6.2所示。

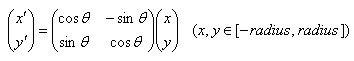

旋转后邻域内采样点的新坐标为:

(6-2)

(6-2)

3. 将邻域内的采样点分配到对应的子区域内,将子区域内的梯度值分配到8个方向上,计算其权值。

旋转后的采样点坐标在半径为radius的圆内被分配到 的子区域,计算影响子区域的采样点的梯度和方向,分配到8个方向上。

的子区域,计算影响子区域的采样点的梯度和方向,分配到8个方向上。

旋转后的采样点 落在子区域的下标为

落在子区域的下标为

(6-3)

(6-3)

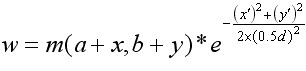

Lowe建议子区域的像素的梯度大小按 的高斯加权计算,即

的高斯加权计算,即

(6-4)

(6-4)

其中a,b为关键点在高斯金字塔图像中的位置坐标。

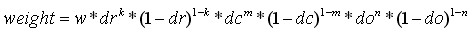

4. 插值计算每个种子点八个方向的梯度。

如图6.3所示,将由式(6-3)所得采样点在子区域中的下标 (图中蓝色窗口内红色点)线性插值,计算其对每个种子点的贡献。如图中的红色点,落在第0行和第1行之间,对这两行都有贡献。对第0行第3列种子点的贡献因子为dr,对第1行第3列的贡献因子为1-dr,同理,对邻近两列的贡献因子为dc和1-dc,对邻近两个方向的贡献因子为do和1-do。则最终累加在每个方向上的梯度大小为:

(图中蓝色窗口内红色点)线性插值,计算其对每个种子点的贡献。如图中的红色点,落在第0行和第1行之间,对这两行都有贡献。对第0行第3列种子点的贡献因子为dr,对第1行第3列的贡献因子为1-dr,同理,对邻近两列的贡献因子为dc和1-dc,对邻近两个方向的贡献因子为do和1-do。则最终累加在每个方向上的梯度大小为:

(6-5)

(6-5)

其中k,m,n为0或为1。

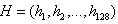

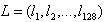

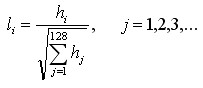

5. 如上统计的4*4*8=128个梯度信息即为该关键点的特征向量。特征向量形成后,为了去除光照变化的影响,需要对它们进行归一化处理,对于图像灰度值整体漂移,图像各点的梯度是邻域像素相减得到,所以也能去除。得到的描述子向量为 ,归一化后的特征向量为

,归一化后的特征向量为 则

则

(6-7)

(6-7)

6. 描述子向量门限。非线性光照,相机饱和度变化对造成某些方向的梯度值过大,而对方向的影响微弱。因此设置门限值(向量归一化后,一般取0.2)截断较大的梯度值。然后,再进行一次归一化处理,提高特征的鉴别性。

7. 按特征点的尺度对特征描述向量进行排序。

至此,SIFT特征描述向量生成。

描述向量这块不好理解,我画了个草图,供参考:

7、SIFT的缺点

SIFT在图像的不变特征提取方面拥有无与伦比的优势,但并不完美,仍然存在:

1. 实时性不高。

2. 有时特征点较少。

3. 对边缘光滑的目标无法准确提取特征点。

等缺点,如下图7.1所示,对模糊的图像和边缘平滑的图像,检测出的特征点过少,对圆更是无能为力。近来不断有人改进,其中最著名的有SURF和CSIFT。

8、总结

本人研究SIFT算法一月有余,鉴于相关知识的缺失,尺度空间技术和差分近似求导曾困我良久。Lowe在论文中对细节提之甚少,甚至只字未提,给实现带来了很大困难。经过多方查阅,实现,总结成此文。自认为是到目前为止,关于SIFT算法最为详尽的资料,现分享给你,望批评指正。

一同分享给你的还有同时实现的高斯模糊源码,sift算法源码,见附录1,2。源码使用vs2010+opencv2.2实现。

zdd

2012年4月28日 于北师大

2012年5月17日15:33:23第一次修正

修正内容:第3.3部分内容,图3.1,图3.5。

修正后代码:http://download.csdn.net/detail/zddmail/4309418

参考资料

1、David G.Lowe Distinctive Image Features from Scale-Invariant Keypoints. January 5, 2004.

2、David G.Lowe Object Recognition from Local Scale-Invariant Features. 1999

3、Matthew Brown and David Lowe Invariant Features from Interest Point Groups. In British Machine Vision Conference, Cardiff, Wales, pp. 656-665.

4、PETER J. BURT, MEMBER, IEEE, AND EDWARD H. ADELSON, The Laplacian Pyramid as a Compact Image Code. IEEE TRANSACTIONS ON COMMUNICATIONS, VOL. COM-3l, NO. 4, APRIL 1983

5、宋丹 10905056 尺度不变特征变换匹配算法Scale Invariant Feature Transform (SIFT)(PPT)

6、RaySaint 的博客SIFT算法研究http://underthehood.blog.51cto.com/2531780/658350

7、Jason Clemons SIFT: SCALE INVARIANT FEATURE TRANSFORM BY DAVID LOWE(ppt)

8、Tony Lindeberg Scale-space theory: A basic tool for analysing structures at different scales.1994

9、SIFT官网的Rob Hess <hess@eecs.oregonstate.edu> SIFT源码

10、Opencv2.2 Andrea Vedaldi(UCLA VisionLab)实现的SIFT源码 http://www.vlfeat.org/~vedaldi/code/siftpp.html, opencv2.3改用Rob Hess的源码

11、科学计算中的偏微分方程有限差分法 杨乐主编

12、维基百科SIFT词条:http://zh.wikipedia.org/zh-cn/Scale-invariant_feature_transform

13、百度百科SIFT词条:http://baike.baidu.com/view/2832304.htm

14、其它互联网资料

附录1 高斯模糊源码

http://blog.csdn.net/zddmail/article/details/7450033

http://download.csdn.net/detail/zddmail/4217704

附录2 SIFT算法源码

http://download.csdn.net/detail/zddmail/4309418

===========

2.尺度不变特征变换(SIFT)特征提取分析

背景引言

尺度不变换特征变换(Scale invariant feature Transform,SIFT)(Lowe,1999,2004)[1],[2]的目标是解决低层次特征提取及其图像匹配应用中的许多实际问题。在博文【特征提取】Harris角点检测中介绍的Harris算子对图像尺度变化非常敏感,因此不适合用于不同尺度的图像匹配。所以,本节主要根据论文[1]和[2]理解,介绍SIFT相关知识。

基本介绍

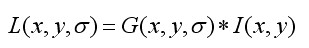

关于SIFT算法,2004年David Lowe发表在Int. Journal of Computer Vision的经典论文[2]中,对尺度空间(scale space)是这样定义 :It has been shown by Koenderink (1984) and Lindeberg (1994) that under a variety of reasonable assumptions the only possible scale-space kernel is the Gaussian function.Therefore,the scale space of an image is defined as a function L(x, y,delta) that is produced from the convolution of a variable-scale Gaussian G(x,y,delta), with an input image I(x, y).因此,一个图像的尺度空间L(x,y,delta)定义为原始图像I (x,y)与一个可变尺度的2-D高斯函数G(x,y,delta) 卷积运算。关于图象处理中的空间域卷积运算,可以参考经典的图像处理教材(如:[5]书中,叙述了如何在离散空间进行运算的例子和说明)。而论文中 delta为希腊字母,具体地含义,请参考论文[2]所述。在此不作介绍。

SIFT算法中,提到了尺度空间,请问什么是尺度和尺度空间呢? 在上述理解的基础上,尺度就是受delta这个参数控制的表示 。而不同的L(x,y,delta)就构成了尺度空间(Space ,我理解,由于描述图像的时候,一般用连续函数比较好描述公式,所以,采用空间集合 ,空间的概念正规一些),实际上,具体计算的时候,即使连续的高斯函数,都要被离散为(一般为奇数大小)(2*k+1) *(2*k+1)矩阵,来和数字图像进行卷积运算。

算法描述

SIFT算法主要包括两个阶段,一个是SIFT特征的生成,即从多幅图像中提取对尺度缩放、旋转、亮度变化无关的特征向量;第二阶段是SIFT特征向量的匹配。SIFT方法中的低层次特征提取是选取那些显特征,这些特征具有图像尺度(特征大小)和旋转不变性,而且对光照变化也具有一定程度的不变性。此外,SIFT方法还可以减少由遮挡、杂乱和噪声所引起的低提取概率。整个算法由以下几个部分组成。

1.尺度空间极值检测(Scale-space extrema detection)

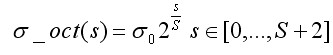

这是一个搜索所有尺度上的图像位置。通过高斯微分函数来识别潜在的对于尺度和旋转不变的兴趣点。尺度空间是由一原始图像经过不同尺度的高斯模糊所得的一组图像空间定义为:

其中G(x,y,σ) 是尺度可变高斯函数

(x,y)是空间坐标,σ是尺度坐标。σ大小决定图像的平滑程度,大尺度对应图像的概貌特征,小尺度对应图像的细节特征。大的σ值对应粗糙尺度(低分辨率),反之,对应精细尺度(高分辨率)。为了有效的在尺度空间检测到稳定的关键点,提出了高斯差分尺度空间(DOG scale-space)。利用不同尺度的高斯差分核与图像卷积生成。

高斯差分尺度空间是极值点由高斯差分尺度空间确定。而选择高斯差分尺度空间计算极值点是原因有两点;第一、为了容易计算,不同尺度空间相减即可;第二、差分尺度空间和高斯拉普拉斯函数近似相等。高斯金塔及高斯差分金字塔:对于一幅图像I,建立其在不同尺度(scale)的图像,也成为子八度(octave),这是为了scale-invariant,也就是在任何尺度都能够有对应的特征点,第一个子八度的scale为原图大小,后面每个octave为上一个octave降采样的结果,即原图的1/4(长宽分别减半),构成下一个子八度(高一层金字塔)。建立如下图所示:

由图片size决定建几个塔,每塔几层图像(S每塔层数,一般为3-5层)。0塔的第0层是原始图像(或你double后的图像),往上每一层是对其下一层进行Laplacian变换(高斯卷积,其中σ值渐大,例如可以是σ, k*σ, k*k*σ…),直观上看来越往上图片越模糊。塔间的图片是降采样关系,例如1塔的第0层可以由0塔的第3层down sample得到,然后进行与0塔类似的高斯卷积操作。

为了寻找尺度空间的极值点,每一个采样点要和它所有的相邻点比较,看其是否比它的图像域和尺度域的相邻点大或者小。如图所示,中间的检测点和它同尺度的8个相邻点和上下相邻尺度对应的9×2个点共26个点比较,以确保在尺度空间和二维图像空间都检测到极值点。一个点如果在DOG尺度空间本层以及上下两层的26个领域中是最大或最小值时,就认为该点是图像在该尺度下的一个特征点。

在极值比较的过程中,每一组图像的首末两层是无法进行极值比较的,为了满足尺度变化的连续性,我们在每一组图像的顶层继续用高斯模糊生成了 3 幅图像,高斯金字塔有每组S+3层图像。DOG金字塔每组有S+2层图像.

假设s=3,即每个塔里有3层,则k=21/s=21/3,那么可得Gaussian Space和DoG Space 分别有3个(s个)和2个(s-1个)分量,在DoG Space中,1st-octave两项分别是σ,kσ; 2nd-octave两项分别是2σ,2kσ.由于无法比较极值,我们必须在高斯空间继续添加高斯模糊项,使得形成σ,kσ,k2σ,k3σ,k4σ。这样就可以选择DoG space中的中间三项kσ,k2σ,k3σ(只有左右都有才能有极值),那么下一octave中(由上一层降采样获得)所得三项即为2kσ,2k2σ,2k3σ,其首项2kσ=24/3。刚好与上一octave末项k3σ=23/3尺度变化连续起来,所以每次要在Gaussian Space添加3项,每组(塔)共S+3层图像,相应的DoG金字塔有S+2层图像。

使用LOG能够很好地找到找到图像中的兴趣点,但是计算量很大,所以使用DOG图像的极大极极小值近似寻找特征点DOG算子计算简单是尺度归一化的LOG算子的近似。有关DOG寻找特征点的介绍及方法详见博文【特征提取】DOG算子。

2.关键点定位(Keypoint localization)

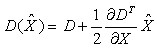

在每个候选的位置上,通过一个拟合精细的模型来确定位置和尺度。关键点的选择依据于它们的稳定程度。通过拟和3-D二次函数以精确确定点的位置和尺度,同时去除低对比度的关键点和不稳定的边缘响应点,以增强匹配稳定性,提高噪声能力。我们对尺度空间DoG函数进行曲线拟合。利用DoG函数在尺度空间定义为:

..............(1)

其中:. 求导,并令其为0,可以得到极值点的偏移量为:

...........................(2)

在已经检测到的特征中,要去掉低对比度的特征点和不稳定的边缘响应点。去掉低对比度的点。把公式(2)代入公式(1),只取前两项可得为:

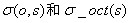

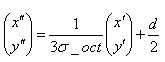

其中:代表相对插值中心的偏移量,当它在任一维度上的偏移量大于0.5时(即x或y或σ),意味着插值中心已经偏移到它的邻近点上,所以必须改变当前关键点的位置。同时在新的位置上反复插值直到收敛;也有可能超出所设定的迭代次数或者超出图像边界的范围,此时这样的点应该删除,在Lowe中进行了5次迭代。另外,|D(x)|过小的点易受噪声的干扰而变得不稳定,所以将|D(x)|小于某个经验值(Lowe论文中使用0.03,Rob Hess等人实现时使用0.04/S)的极值点删除。同时,在此过程中获取特征点的精确位置(原位置加上拟合的偏移量)以及尺度(σ(o,s)和σ_oct(s))。

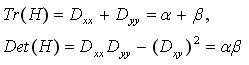

而对比度小的点,通过DOG所得的极值点中存在对比度小的点,若,该特征点就保留下来,否则丢弃。由于DoG算子会产生较强的边缘响应,所以极值点中存在边缘点。因为一个定义不好的高斯差分算子的极值在横跨边缘的地方有较大的主曲率,而在垂直边缘的方向有较小的主曲率,主曲率可以通过一个2x2的Hessian矩阵H求出:

导数由采样点相邻差估计得到。D的主曲率和H的特征值成正比,令α为较大特征值,β为较小的特征值,我们不直接求特征值,求Tr 和 行列式Det则

令α=γβ,则

(r + 1)2/r的值在两个特征值相等的时候最小,随着r的增大而增大,因此,为了检测主曲率是否在某域值r下,只需检测

当比值为负值时直接丢弃,当 (α+β)/ αβ> (r+1)2/r, throw it out. 在Lowe的文章中,取r=10。

3.方向确定(Orientation assignment)

基于图像局部的梯度方向,分配给每个关键点位置一个或多个方向。所有后面的对图像数据的操作都相对于关键点的方向、尺度和位置进行变换,从而提供对于这些变换的不变性。关键点的位置确定了,接下来我们确定关键点的尺度和方向,算出每个关键点的幅度和方向。通过尺度不变性求极值点,可以使其具有缩放不变的性质,利用关键点邻域像素的梯度方向分布特性,我们可以为每个关键点指定方向参数方向,从而使描述子对图像旋转具有不变性,我们通过求每个极值点的梯度来为极值点赋予方向。

为(x,y)处梯度的模值和方向公式。其中L 所用的尺度为每个关键点各自所在的尺度。至此,图像的关键点已经检测完毕,每个关键点有三个信息:位置,所处尺度、方向,由此可以确定一个SIFT特征区域。

梯度直方图的范围是0~360度,其中每10度一个柱,总共36个柱。随着距中心点越远的领域其对直方图的贡献也响应减小.Lowe论文中还提到要使用高斯函数对直方图进行平滑,减少突变的影响。在实际计算时,我们在以关键点为中心的邻域窗口内采样,并用直方图统计邻域像素的梯度方向。梯度直方图的范围是0~360度,其中每45度一个柱,总共8个柱, 或者每10度一个柱,总共36个柱。Lowe论文中还提到要使用高斯函数对直方图进行平滑,减少突变的影响。直方图的峰值则代表了该关键点处邻域梯度的主方向,即作为该关键点的方向。以特征点为中心取16*16的邻域作为采样窗口,将采样点与特征点的相对方向通过高斯加权后归入包含8个bin的方向直方图,最后获得4*4*8的128维特征描述子。16x16的图中其中1/4的特征点梯度方向及scale,右图为其加权到8个主方向后的效果。示意图如下:

图左部分的中央为当前关键点的位置,每个小格代表关键点邻域所在尺度空间的一个像素,利用公式求得每个像素的梯度幅值与梯度方向,箭头方向代表该像素的梯度方向,箭头长度代表梯度模值,然后用高斯窗口对其进行加权运算。图中蓝色的圈代表高斯加权的范围(越靠近关键点的像素梯度方向信息贡献越大)。然后在每4×4的小块上计算8个方向的梯度方向直方图,绘制每个梯度方向的累加值,即可形成一个种子点,如图右部分示。此图中一个关键点由2×2共4个种子点组成,每个种子点有8个方向向量信息。这种邻域方向性信息联合的思想增强了算法抗噪声的能力,同时对于含有定位误差的特征匹配也提供了较好的容错性。

当两幅图像的Sift特征向量生成以后,下一步就可以采用关键点特征向量的欧式距离来作为两幅图像中关键点的相似性判定度量。取图1的某个关键点,通过遍历找到图像2中的距离最近的两个关键点。在这两个关键点中,如果次近距离除以最近距离小于某个阙值,则判定为一对匹配点。Lowe实验结果表明:描述子采用4×4×8=128维向量表征,综合效果最优(不变性与独特性)。计算keypoint周围的16x16的window中每一个像素的梯度,而且使用高斯下降函数降低远离中心的权重。

4.关键点描述(Keypoint descriptor)

在每个关键点周围的邻域内,在选定的尺度上测量图像局部的梯度。这些梯度被变换成一种表示,这种表示允许比较大的局部形状的变形和光照变化。

首先,确定计算描述子所需的图像区域,描述子梯度方向直方图由关键点所在尺度的模糊图像计算产生。图像区域的半径通过下式计算:

然后,将坐标移至关键点主方向:

旋转后领域内采样点的新坐标为:

其次,在图像半径区域内对每个像素点求其梯度幅值和方向,然后对每个梯度幅值乘以高斯权重参数,生成方向直方图。

在窗口宽度为2X2的区域内计算8个方向的梯度方向直方图,绘制每个梯度方向的累加值,即可形成一个种子点。然后再在下一个2X2的区域内进行直方图统计,形成下一个种子点,共生成16个种子点。

最后,描述子向量元素门限化及门限化后的描述子向量规范化。根据特征点的尺度对特征描述向量进行排序,SIFT特征向量生成。

实验结果

OpenCV-Python版SIFT角点检测输出图像效果

OpenCV-Python版SIFT带FLAGS角点检测输出图像效果

Flags设置为DRAW_MATCHES_FLAGS_DRAW_RICH_KEYPOINTS.

C版SIFT算子检测特征输出图像效果

1.尺度空间理论尺度空间理论目的是模拟图像数据的多尺度特征。其基本思想是在视觉信息图像信息处理模型中引入一个被视为尺度的参数, 通过连续变化尺度参数获得不同尺度下的视觉处理信息, 然后综合这些信息以深入地挖掘图像的本质特征。

2. 局部特征提取算法sift SIFT算法由D.G.Lowe 1999年提出,2004年完善总结。后来Y.Ke将其描述子部分用PCA代替直方图的方式,对其进行改进。SIFT算法是一种提取局部特征的算法,在尺度空间寻找极值点,提取位置,尺度,旋转不变量。SIFT特征是图像的局部特征,其对旋转、尺度缩放、亮度变化保持不变性,对视角变化、仿射变换、噪声也保持一定程度的稳定性。独特性好,信息量丰富,适用于在海量特征数据库中进行快速、准确的匹配。多量性,即使少数的几个物体也可以产生大量SIFT特征向量。可扩展性,可以很方便的与其他形式的特征向量进行联合。

3. 什么是局部特征?局部特征从总体上说是图像或在视觉领域中一些有别于其周围的地方。局部特征通常是描述一块区域,使其能具有高可区分度。局部特征的好坏直接会决定着后面分类、识别是否会得到一个好的结果。局部特征需具备的特性:重复性、可区分性、准确性、数量以及效率、不变性。

4. 描述子生成的细节 以极值点为中心点,并且以此点所处于的高斯尺度sigma值作为半径因子。对于远离中心点的梯度值降低对其所处区域的直方图的贡献,防止一些突变的影响。每个极值点对其进行三线性插值,这样可以把此极值点的贡献均衡的分到直方图中相邻的柱子上

5. PCA-SIFT算法 PCA-SIFT与标准SIFT有相同的亚像素位置,尺度和主方向。但在第4步计算描述子的设计,采用的主成分分析的技术。其特征描述子计算的部分:用特征点周围的41×41的像斑计算它的主元,并用PCA-SIFT将原来的2×39×39维的向量降成20维,以达到更精确的表示方式。它的主要步骤为,对每一个关键点:在关键点周围提取一个41×41的像斑于给定的尺度,旋转到它的主方向 ;计算39×39水平和垂直的梯度,形成一个大小为3042的矢量;用预先计算好的投影矩阵n×3042与此矢量相乘;这样生成一个大小为n的PCA-SIFT描述子。

6.归一化处理 在求出4*4*8的128维特征向量后,此时SIFT特征向量已经去除了尺度变化、旋转等几何变形因素的影响。而图像的对比度变化相当于每个像素点乘上一个因子,光照变化是每个像素点加上一个值,但这些对图像归一化的梯度没有影响。因此将特征向量的长度归一化,则可以进一步去除光照变化的影响。对于一些非线性的光照变化,SIFT并不具备不变性,但由于这类变化影响的主要是梯度的幅值变化,对梯度的方向影响较小,因此作者通过限制梯度幅值的值来减少这类变化造成的影响。

参考资料

[1] David G. Lowe,"Object recognition from local scale-invariant features," International Conference on Computer Vision,Corfu, Greece (September 1999), pp. 1150-115.

[2] David G. Lowe,"Distinctive image features from scale-invariant keypoints,"International Journal of Computer Vision, 60, 2 (2004), pp. 91-110.

[3] Scale invariant feature Transform From Wikipedia, the free encyclopedia.

[4] Demo Software:SIFT Keypoint Detctor.

[5] Rafael C.Gonzalez, Rechard E.Woods at. el , "Digital Image Processing Using MatLab (Second Edition)",Gatesamark Publishing.

扩展链接

[1] SIFT: Scale Invariant Feature Transform .

[2] Scale Invariant Feature Transform Form www. scholarpedia.org.

[3] C语言版源代码 Scale Invariant Feature Transform(SIFT).

关于Image Engineering & Computer Vision的更多讨论与交流,敬请关注本博和新浪微博songzi_tea.

-----------------

3.opencv源码解析之(3):特征点检查前言1

因为最近准备看特征点检查方面的源码,而其中最著名的算法就是sift和surf。因此这次主要是学会怎样使用opencv中的sift和surf函数来检测特征点和描述特征点,以及怎样使用其算法来进行特征点匹配。庆幸的是,sift算法虽然是专利,但是在opencv的努力下也获得了作者的允许,将其加入了新版本的opencv中了。

使用环境:opencv2.3.1+vs2010

功能:找出2幅图中特征点,并将其描述出来,且在2幅中进行匹配。2幅图内容相同,但是经过了曝光,旋转,缩放处理过。

首先来看sift算法函数的使用。

工程代码:

// sift_test.cpp : 定义控制台应用程序的入口点。

#include "stdafx.h"

#include <stdio.h>

#include <iostream>

#include "opencv2/core/core.hpp"//因为在属性中已经配置了opencv等目录,所以把其当成了本地目录一样

#include "opencv2/features2d/features2d.hpp"

#include "opencv2/highgui/highgui.hpp"

using namespace cv;

using namespace std;

void readme();

int main(int argc,char* argv[])

{

Mat img_1=imread("./image/query.png",CV_LOAD_IMAGE_GRAYSCALE);//宏定义时CV_LOAD_IMAGE_GRAYSCALE=0,也就是读取灰度图像

Mat img_2=imread("./image/rs_query.png",CV_LOAD_IMAGE_GRAYSCALE);//一定要记得这里路径的斜线方向,这与Matlab里面是相反的

if(!img_1.data || !img_2.data)//如果数据为空

{

cout<<"opencv error"<<endl;

return -1;

}

cout<<"open right"<<endl;

//第一步,用SIFT算子检测关键点

SiftFeatureDetector detector;//构造函数采用内部默认的

std::vector<KeyPoint> keypoints_1,keypoints_2;//构造2个专门由点组成的点向量用来存储特征点

detector.detect(img_1,keypoints_1);//将img_1图像中检测到的特征点存储起来放在keypoints_1中

detector.detect(img_2,keypoints_2);//同理

//在图像中画出特征点

Mat img_keypoints_1,img_keypoints_2;

drawKeypoints(img_1,keypoints_1,img_keypoints_1,Scalar::all(-1),DrawMatchesFlags::DEFAULT);//在内存中画出特征点

drawKeypoints(img_2,keypoints_2,img_keypoints_2,Scalar::all(-1),DrawMatchesFlags::DEFAULT);

imshow("sift_keypoints_1",img_keypoints_1);//显示特征点

imshow("sift_keypoints_2",img_keypoints_2);

//计算特征向量

SiftDescriptorExtractor extractor;//定义描述子对象

Mat descriptors_1,descriptors_2;//存放特征向量的矩阵

extractor.compute(img_1,keypoints_1,descriptors_1);//计算特征向量

extractor.compute(img_2,keypoints_2,descriptors_2);

//用burte force进行匹配特征向量

BruteForceMatcher<L2<float>>matcher;//定义一个burte force matcher对象

vector<DMatch>matches;

matcher.match(descriptors_1,descriptors_2,matches);

//绘制匹配线段

Mat img_matches;

drawMatches(img_1,keypoints_1,img_2,keypoints_2,matches,img_matches);//将匹配出来的结果放入内存img_matches中

//显示匹配线段

imshow("sift_Matches",img_matches);//显示的标题为Matches

waitKey(0);

return 0;

}

运行结果如下:

下面看surf算法函数的使用(和sift基本一样,就是函数名改了下而已):

工程代码:

// surf_test.cpp : 定义控制台应用程序的入口点。

//

#include "stdafx.h"

#include <stdio.h>

#include <iostream>

#include "opencv2/core/core.hpp"//因为在属性中已经配置了opencv等目录,所以把其当成了本地目录一样

#include "opencv2/features2d/features2d.hpp"

#include "opencv2/highgui/highgui.hpp"

using namespace cv;

using namespace std;

void readme();

int main(int argc,char* argv[])

{

Mat img_1=imread("./image/query.png",CV_LOAD_IMAGE_GRAYSCALE);//宏定义时CV_LOAD_IMAGE_GRAYSCALE=0,也就是读取灰度图像

Mat img_2=imread("./image/rs_query.png",CV_LOAD_IMAGE_GRAYSCALE);//一定要记得这里路径的斜线方向,这与Matlab里面是相反的

if(!img_1.data || !img_2.data)//如果数据为空

{

cout<<"opencv error"<<endl;

return -1;

}

cout<<"open right"<<endl;

//第一步,用SURF算子检测关键点

int minHessian=400;

SurfFeatureDetector detector(minHessian);

std::vector<KeyPoint> keypoints_1,keypoints_2;//构造2个专门由点组成的点向量用来存储特征点

detector.detect(img_1,keypoints_1);//将img_1图像中检测到的特征点存储起来放在keypoints_1中

detector.detect(img_2,keypoints_2);//同理

//在图像中画出特征点

Mat img_keypoints_1,img_keypoints_2;

drawKeypoints(img_1,keypoints_1,img_keypoints_1,Scalar::all(-1),DrawMatchesFlags::DEFAULT);

drawKeypoints(img_2,keypoints_2,img_keypoints_2,Scalar::all(-1),DrawMatchesFlags::DEFAULT);

imshow("surf_keypoints_1",img_keypoints_1);

imshow("surf_keypoints_2",img_keypoints_2);

//计算特征向量

SurfDescriptorExtractor extractor;//定义描述子对象

Mat descriptors_1,descriptors_2;//存放特征向量的矩阵

extractor.compute(img_1,keypoints_1,descriptors_1);

extractor.compute(img_2,keypoints_2,descriptors_2);

//用burte force进行匹配特征向量

BruteForceMatcher<L2<float>>matcher;//定义一个burte force matcher对象

vector<DMatch>matches;

matcher.match(descriptors_1,descriptors_2,matches);

//绘制匹配线段

Mat img_matches;

drawMatches(img_1,keypoints_1,img_2,keypoints_2,matches,img_matches);//将匹配出来的结果放入内存img_matches中

//显示匹配线段

imshow("surf_Matches",img_matches);//显示的标题为Matches

waitKey(0);

return 0;

}

其运行结果如下:

从这个实验可以知道,在opencv中使用这2个算法是多么的简单!只需要简单的几个参数就可以达到很好的效果。但这只是opencv的低级应用,我们应该在最好能用opencv一些内部函数来帮助实现自己的算法和想法。这就是分析opencv源码的主要目的。

另外,从实验的过程中可以感觉出来surf算法的运行时间比sift快很多,且特征点的数目检测得比较多,其它的暂时还没区别出来。欢迎交流,谢谢!

浙公网安备 33010602011771号

浙公网安备 33010602011771号