【论文阅读】FEDER:Camouflaged Object Detection with Feature Decomposition and Edge Reconstruction

标题

Camouflaged Object Detection with Feature Decomposition and Edge Reconstruction

基于特征分解和边缘重构的伪装目标检测

Abstract

伪装目标检测(COD)旨在解决在视觉上识别融入周围背景的伪装目标的难题。由于伪装目标与背景的内在相似性以及边界的模糊性,目标识别是一项具有挑战性的任务。现有的解决这个问题的方法开发了各种技术来模仿人类的视觉系统。尽管在许多情况下很有效,但当伪装的物体对视觉系统具有欺骗性时,这些方法仍然很困难。本文提出了一种特征分解与边缘重建(FEature Decomposition and Edge Reconstruction, FEDER)模型。FEDER模型利用可学习小波将特征分解到不同的频带,解决了前景和背景的内在相似性问题。然后,它专注于信息量最大的波段,以挖掘区分前景和背景的微妙线索。为了实现这一目标,开发了频率注意力模块和基于指导的特征聚合模块。为解决模糊边界问题,本文建议在COD任务的同时学习一个辅助边缘重建任务。本文设计了一个受常微分方程启发的边缘重建模块,可生成精确的边缘。通过联合学习辅助任务和COD任务,FEDER模型可以生成具有精确对象边界的精确预测图。实验表明,FEDER模型显著优于目前最先进的方法,具有更低的计算和内存开销。代码将在https://github.com/ChunmingHe/FEDER上提供。

1. Introduction

伪装目标检测(COD)旨在检测和分割“无缝”融入周围环境的目标。COD是一项具有挑战性的任务,需要对抗优秀的伪装策略,包括背景匹配[41]、破坏着色[33]等,并区分候选目标与其背景之间的细微差异。对COD的研究可以促进视觉感知的发展,同时促进各种有价值的现实应用,从工业中的隐蔽缺陷检测[17]到农业中的害虫监测[35]。

COD面临两大挑战。第一个是内在相似性(is)挑战,当伪装的物体与背景共享相似的颜色和图案时,就会发生这种挑战。这使得我们甚至很难粗略地定位那些伪装过的物体。第二是边缘破坏(ED)挑战,这是由极其模糊的对象边界引起的。即使实现了粗略的定位,也很难得到精确的分割。

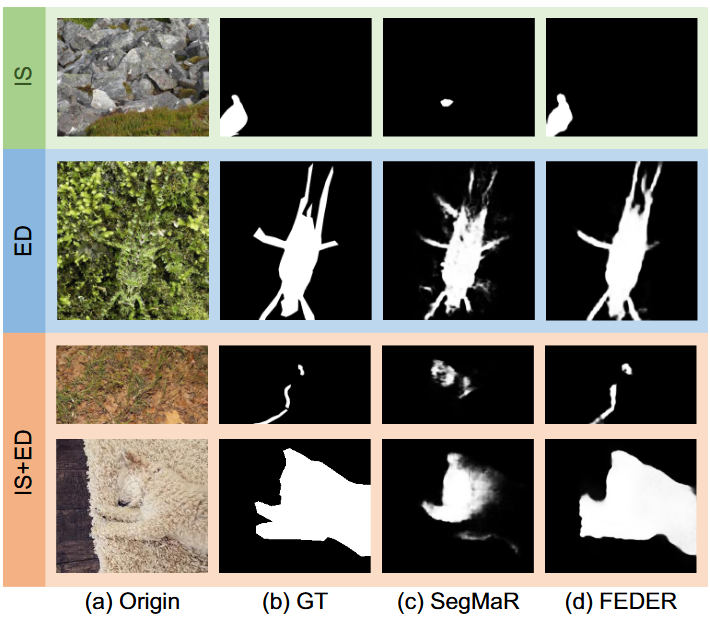

为了应对这些挑战,大多数现有工作旨在开发模仿人类视觉系统的模型[6,28]。然而,由于猎物设计伪装策略是为了迷惑捕食者的视觉系统,且候选目标的内在拓扑属性不具有显著性,这种面向人类感知的尝试可能难以识别细微的可区分特征,无法有效解决上述挑战。例如,如图1所示,最先进的基于人类感知的COD方法只能生成不准确的预测图,如模糊的caddisfly和不完整的dog(第2行和第4行),甚至不能检测到伪装的物体,如鸟和蛇(第1行和第3行)。因此,更好的COD方法应该通过强调细微的判别特征来弥补人类感知的“缺陷”。

基于生物学研究[41],伪装对象通常采用各种伪装策略来掩盖其与周围环境的区分性差异,区分性差异主要存在于纹理细节和全局信息分布上。这样的研究启发我们通过将伪装场景分解为不同的部分来应对COD任务。这允许分解各种复杂的连接,使每个部分都被单独处理,以充分挖掘微妙的判别线索。

在此启发下,本文提出了特征分解与边缘重建(FEature Decomposition and Edge Reconstruction, FEDER)模型,该模型通过强调细微的区分性特征来弥补人类感知的不足,有效地解决了视觉感知中的IS和ED挑战。针对IS挑战带来的难以定位的问题,设计了深度类小波分解(deep wavelet-like decomposition, DWD)策略,利用可学习的类小波模块将提取的特征分解到不同的频带。通过新的频率注意力(FA)模块过滤掉最可能存在判别式线索的值得注意的部分,专注于信息量最大的波段。此外,提出了一种基于引导的特征聚合模块(guide -based feature aggregation module, GFA),对多尺度分解后的特征进行注意力引导聚合,进一步强调判别信息。

为解决ED挑战的模糊边界问题,本文提出学习一个辅助边缘重建任务,以鼓励网络挖掘边缘细节。本文设计了受常微分方程(ODE)启发的边缘重建(OER)模块,用高阶ODE求解器,特别是二阶RungeKutta,重建准确和完整的边缘预测图。将该辅助任务与COD任务相结合,可以促进生成具有精确对象边界的精确分割结果。

我们的贡献总结如下:

- 提出了特征分解和边缘重建(FEDER)模型用于COD任务。据我们所知,我们是第一个从分解的角度来处理COD的。

- 为了突出特征中细微的判别性特征,提出了频率注意力模块来过滤对应特征中值得注意的部分,并设计了基于引导的特征聚合模块来聚合具有注意力引导的多尺度特征。

- 提出在学习COD任务的同时学习辅助边缘重建任务,以帮助生成具有精确对象边界的精确分割图,并设计受ode启发的边缘重建模块,用于完整的边缘预测。

- 所提出的FEDER在四个数据集上显著优于最先进的方法,且计算和内存成本更低。

2. Related Works

Camouflaged object detection. 与现有的目标检测任务不同,伪装目标检测(COD)为挖掘复杂伪装策略下的细微区分性特征提出了新的挑战[6,11]。早期的技术使用手工操作的COD算子[11,30],只适用于具有简单背景的伪装场景。最近的研究利用深度学习的巨大能力以学习的方式检测伪装目标[6,14,28]。SINet[6]受捕食者狩猎过程的启发,设计了一种生物启发网络来逐步搜索和定位伪装物体。PFNet[28]提出位置模块和焦点模块,采用注意力挖掘策略模仿人体识别。通过模拟人类理解复杂场景的行为,对[14]综合片段进行粗到细的分割、放大和重申。然而,这些COD解决方案主要集中在模仿生物视觉系统,容易被复杂的伪装策略所迷惑,难以挖掘细微的鉴别特征,因此无法处理IS和ED挑战(见图1)。首先从分解的角度出发,利用可学习的小波将提取的特征分解到不同的频带上,并过滤掉信息量最大的频带,从而挖掘出那些不明显的鉴别特征,从而弥补人类视觉缺陷,解决IS挑战。为应对ED挑战,本文提出在COD任务的同时学习辅助边缘重建任务,以促进生成具有清晰对象边界的精确分割结果。

Deep wavelet decomposition. 深度小波分解是一种将图像/特征分解为各种频率分量的有效工具,在许多领域得到了广泛的应用,如图像恢复[15]和风格迁移[49]。为了应对IS挑战,将深度小波分解引入到COD任务中。此外,为了更好地适应COD数据,采用可学习小波进行深度自适应特征分解,其系数在AWD[8]之后进行更新。

ODE-inspired network. 研究人员已经建立了ODE和神经网络之间的关系。[46]首先从离散ODE的角度分析ResNet,[1]进一步将ResNet扩展为一种传输更准确的ODE启发的网络架构。自此,受ode启发的网络被广泛应用于许多领域,如图像去雾[37]和机器翻译[19]。为了适应边缘的细粒度特性,本文提出了一种基于ode启发的边缘重建模块,结合二阶Runge-Kutta和加权门机制,旨在生成更精确的边界。此外,我们将Hamiltonian系统应用到OER模块中,以确保边缘重建的稳定性。

3. Methodology

给定伪装图像,我们首先使用伪装特征编码器(CFE)提取级联特征。然后对特征进行类小波分解(DWD),将其分解到不同的频带中。我们选择信息量最大的波段,如高频和低频成分,进行进一步分析。通过频率注意力(FA)模块和基于引导的特征聚合(GFA)模块对这些信息频带进行处理,突出不明显的判别性特征。通过聚合这些特征,分割导向的边缘辅助解码器(SED)同时输出分割图和边缘预测图。图2展示了我们的FEDER模型的框架。

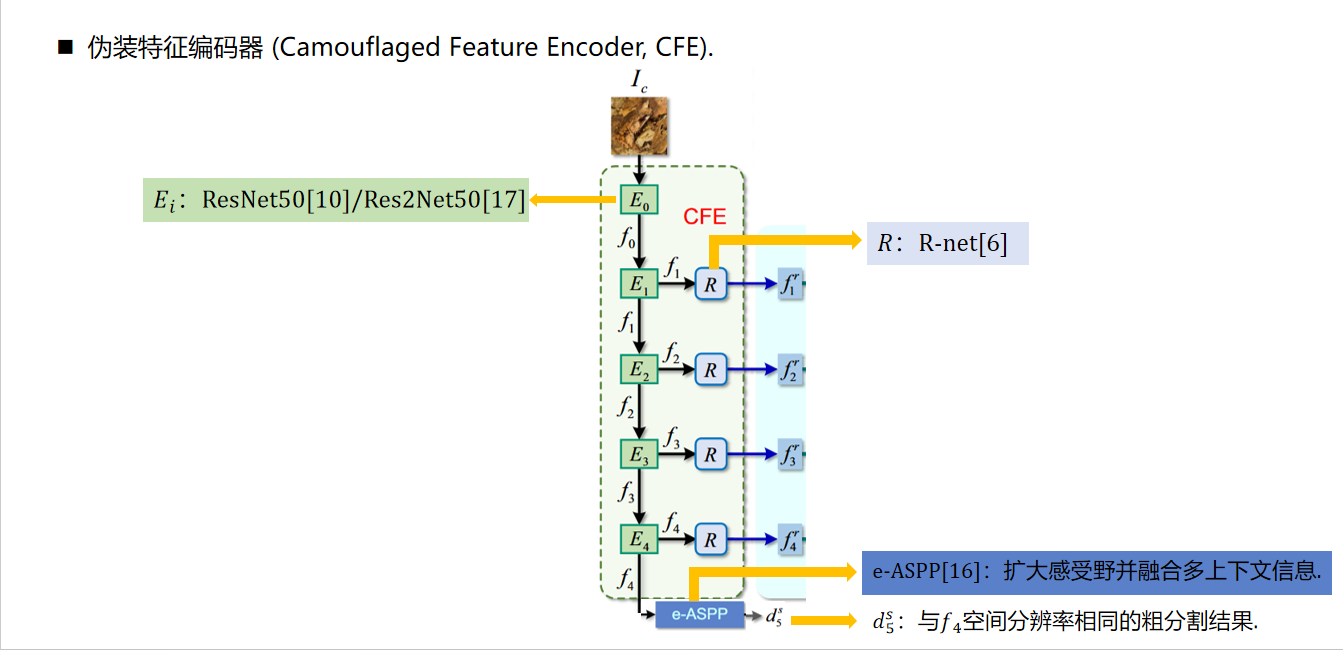

3.1. Camouflaged Feature Encoder (CFE)

遵循SINet V2[4],基础编码器 \(E\) 采用ResNet50[10]/Res2Net50[7]作为骨干网络。给定一个大小为 \(W×H\) 的图像 \(I_c\),基础编码器 \(E\) 生成一组特征图 \(\{f_k\}^4_{k=0}\),分辨率为 \(\frac{H}{2^{k+1}} × \frac{W}{2^{k+1}}\),通过级联 R-net[6] 将 \(\{f_k\}^4_{k=1}\) 转换为信息更丰富、更紧凑的输出,即一系列64通道特征图 \(\{f^r_k\}^4_{k=1}\)。此外,从基本编码器 \(E\) 得到的最后一个特征图 \(f_4\) 进一步输入到高效的空洞空间金字塔池化(e - ASPP)\(A_e\)[16]中,以扩大感受野并融合多上下文信息,得到 \(d^s_5 = A_e(f_4)\),其中 \(d^s_5\) 是与 \(f_4\) 相同空间分辨率的粗分割结果。

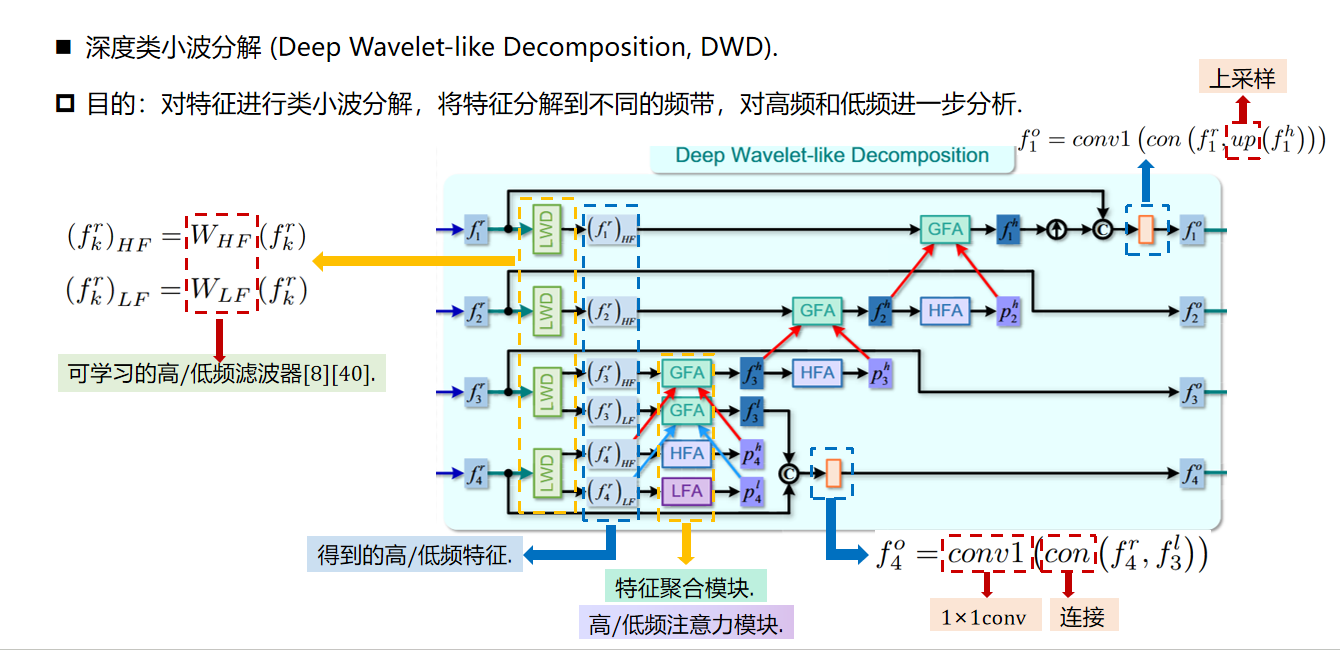

3.2. Deep Wavelet-like Decomposition

3.2.1 Learnable Wavelet-like Decomposition

伪装目标与背景具有较高的内在相似性,这给普通的特征提取器挖掘不显著的区分性特征带来了挑战,最终导致分割性能受到抑制。基于生物学研究[41],COD的判别特征主要存在于纹理、边缘等高频成分和颜色、光照等低频成分中。受这项研究的启发,本文建议对提取的特征 \(\{f^r_k\}^4_{k=1}\) 进行深度类小波分解(DWD),并选择信息量最大的 高频 和 低频 分量进行进一步细化。我们把 \(f^r_k\) 分解成

其中 \((f^r_k)_{HF}\) 和 \((f^r_k)_{LF}\) 表示 \(f^r_k\) 的 高频 和 低频 分量。\(W_{HF}\) 和 \(W_{LF}\) 表示可学习的 高频 和 低频 滤波器,其系数的更新遵循AWD[8],并由Haar小波[40]初始化。与人工设计的小波相比,可学习的类小波变换有望更好地迎合COD数据[36,42],从而进一步促进不显著的判别特征的提取。

3.2.2 Frequency Attention Modules

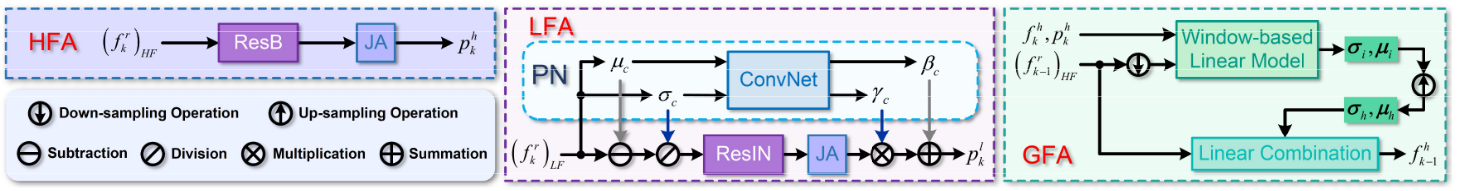

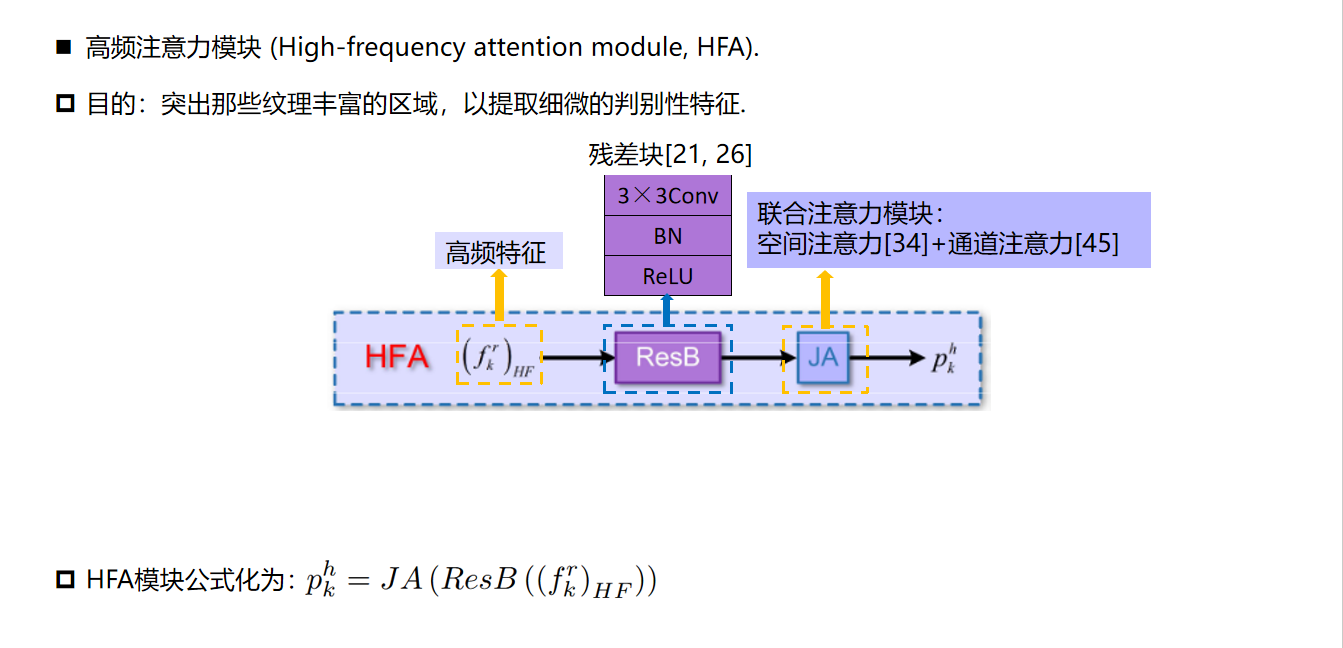

为了从分解后的特征中提取有判别力的信息,提出了高频注意力(HFA)模块和低频注意力(LFA)模块,分别对应HF和LF频段。两个模块的详细结构如图3所示。

High-frequency attention module. 我们设计了 HFA 模块来突出那些纹理丰富的区域,以提取细微的判别性特征。遵循[21,26],首先应用残差块来保持纹理,该残差块由3 × 3卷积层、批归一化(BN)[12]和ReLU组成。然后,采用联合注意力模块 \(JA(·)\),其中包括空间注意力[34]和通道注意力[45],以突出空间和通道域中值得注意的部分。因此,给定HF特征 \((f^r_k)_{HF}\) , HF注意力图 \(p^h_k\) 表示为:

其中 \(ResB(·)\) 表示带有BN层的残差块。

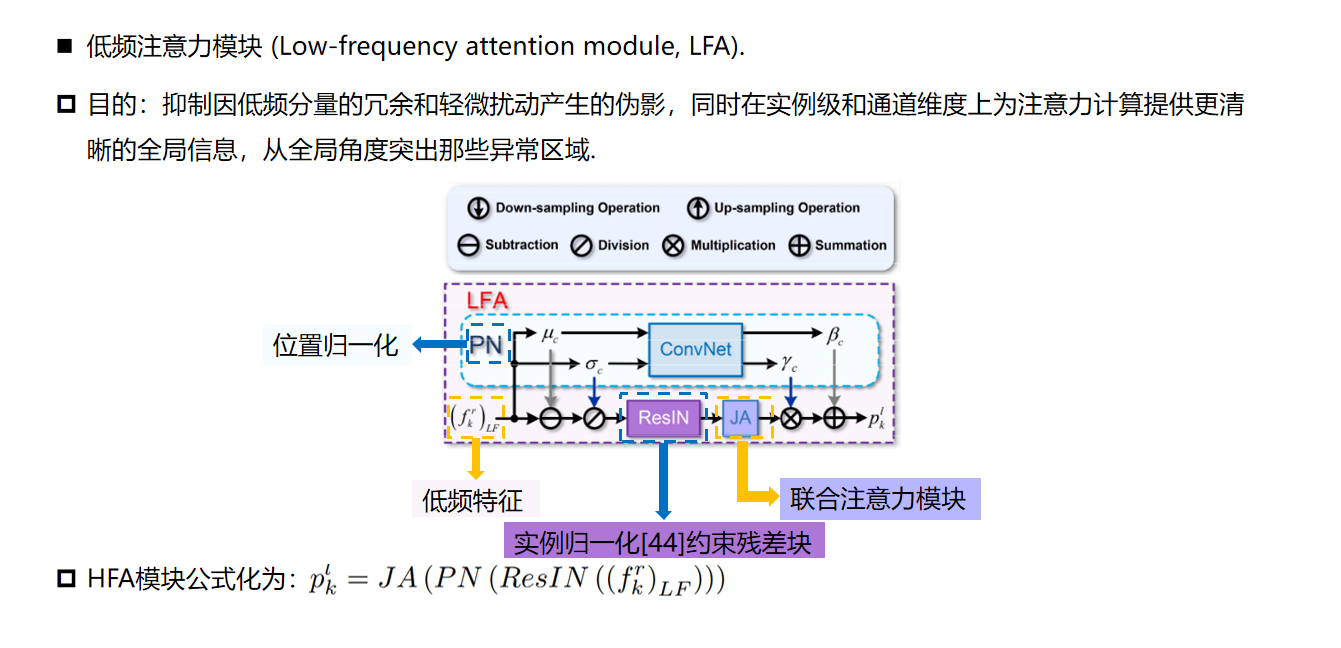

Low-frequency attention module. 低频分量更关注颜色分布、光照等全局信息,不可避免地存在冗余分量和轻微扰动[43]。为了解决这些问题,我们设计了一种全面的归一化策略,以抑制不期望的伪影,并在实例级和通道维度上为注意力计算提供更清晰的全局信息,从全局角度突出那些异常区域。具体来说,该模块将分解后的低频特征 \((f^r_k)_{LF}\) 作为输入和输出:

其中 \(ResIN(·)\)、\(PN(·)\) 和 \(JA(·)\) 分别表示实例归一化[44]约束残差块、位置归一化[20]和联合注意力。

3.2.3 Guidance-based Feature Aggregation Module

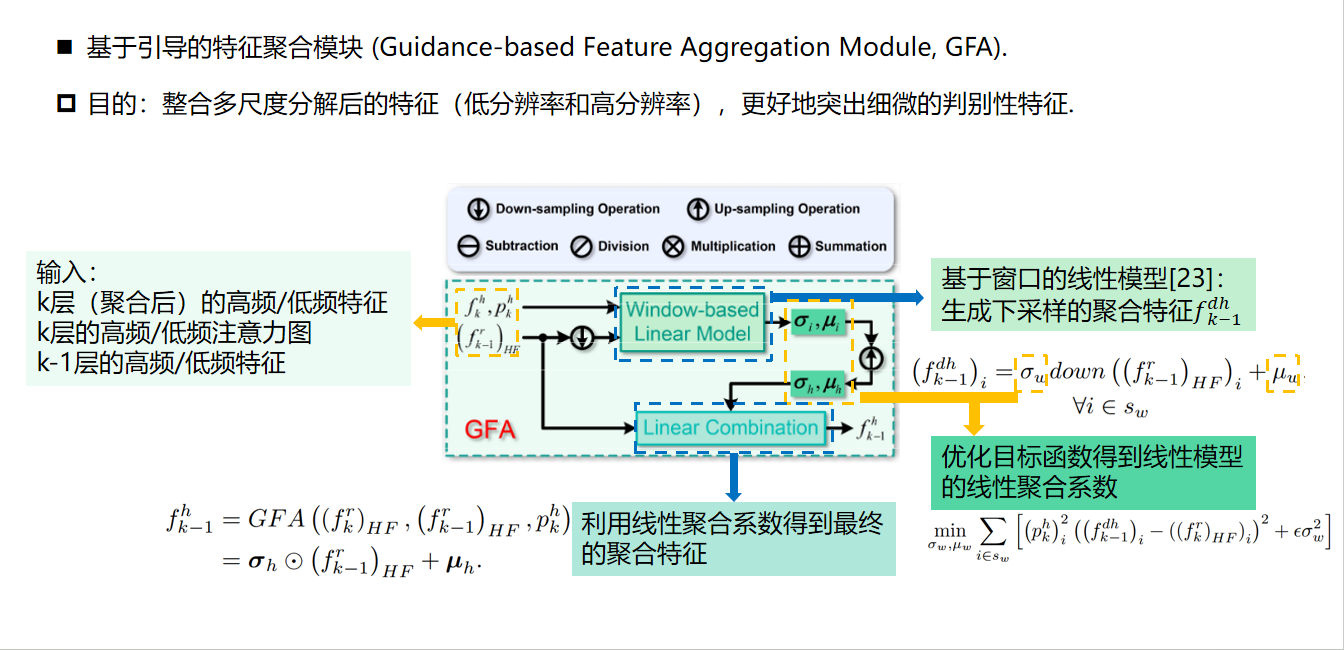

如图3所示,我们提出了一种基于引导的特征聚合(guide -based feature aggregation, GFA)模块来整合多尺度分解后的特征。与现有的基于启发式的特征聚合策略不同[22,24],GFA通过促进特征间的信息交互,来解决COD的关键问题,即强调微妙的区分性特征。

以HF频段为例,GFA生成了融合的特征 \(\{f^h_{k-1}\}^4_{k=2}\),该特征在注意力图 \(p^h_k\) 的引导下合并了低分辨率特征 \((f^r_k)_{HF}\) 的深度语义信息(在较高层次)和高分辨率特征 \((f^r_{k-1})_{HF}\) 的丰富空间细节(在较低层次),因此聚合特征 \(f^h_{k−1}\) 能够更好地突出细微的判别性特征。为了提取注意力引导下的语义信息,我们首先使用基于窗口的线性模型[23]生成下采样的聚合特征 \(f^{dh}_{k−1}\):

其中,\(down(·)\)、\(s_w\)、\(i\) 为下采样操作、局部窗口、像素点。\(\{σ_w, μ_w\}\) 为窗口 \(s_w\) 内像素的线性聚合系数,可通过优化以下目标函数获得:

其中 \(\epsilon\) 是 \(σ_w\) 的约束值。关于 \(\{σ_w, μ_w\}\) 的推导和解,请参阅补充材料(Supp)。

考虑到像素 \(i\) 被多个窗口覆盖,我们对这些窗口系数进行平均,得到像素 \(i\) 的具体聚集系数 \(\{σ_i, μ_i\}\)。将 \(\{σ_i, μ_i\}\) 矩阵化为 \(\{\boldsymbol{σ}_i, \boldsymbol{μ}_i\}\),公式(4)可以重写为:

其中 \(\odot\) 为Hadamard积。然后将 \(\{\boldsymbol{σ}_i, \boldsymbol{μ}_i\}\) 上采样为 \(\{\boldsymbol{σ}_h, \boldsymbol{μ}_h\}\),得到高分辨率的聚合特征 \(f^h_{k−1}\),丰富空间细节:

为了迭代地获得聚合特征 \(\{f^h_{k−1}\}^4_{k=2}\),我们通过用 \(f^h_k\) 替换 \((f^r_k)_{HF}\) 来重新定义GFA模块:

其中 \(p^h_k = JA(ResB(f^h_k))\) 和 \(f_4^h = (f_4^r)_{HF}\)。在频率特定注意力的保证下,通过结合丰富的空间细节和深层语义信息,所提出的聚合特征可以强调比其他特征更具判别性的特征,从而更好地满足COD任务。聚合 LF 特征 \(f^l_{k−1}\) 的计算类似于 \(f^h_{k−1}\),这可以在Supp中看到。

考虑到底层(较高层次)更关注HF细节,而顶层(较低层次)更关注全局信息[38],我们将聚合的HF/LF特征连同跳跃连接的编码特征 \(\{f^r_k\}^4_{k=1}\) 传递到底层/顶层解码器层。为了平衡性能和效率,传递给解码器的综合特征 \(\{f^o_k\}^4_{k=1}\) 定义为:

其中 \(up(·)\) 和 \(con(·)\) 表示上采样操作和级联操作。\(Conv1\) 表示1 × 1卷积,用于通道级集成。

3.3. Segmentation-oriented Edge-assisted Decoder

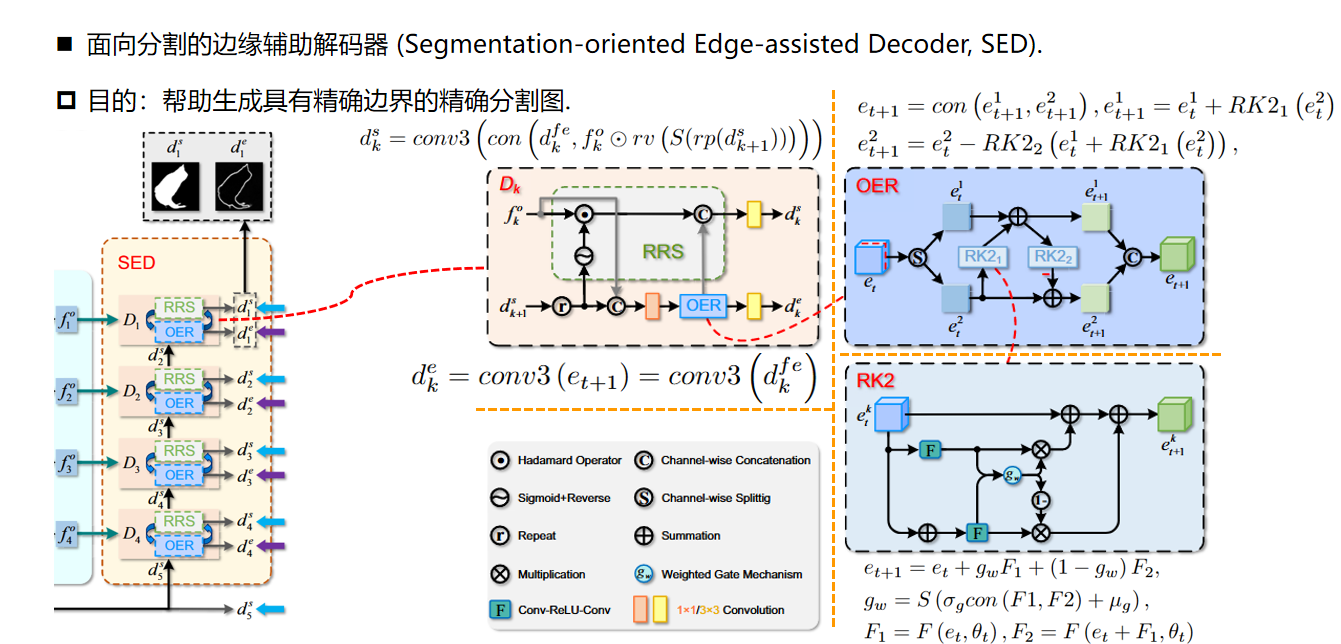

在面向分割的边缘辅助解码器(SED)\(\{Dk\}^4_{k=1}\) 中,我们建议在COD任务的同时学习一个辅助边缘重建任务,以帮助生成具有精确边界的精确分割图。如图4所示,每个解码器层 \(D_k\) 由可逆重标定分割(reversible re-calibration segmentation, RRS)模块和ODE-inspired edge reconstruction (OER)模块组成。

3.3.1 Reversible Re-calibration Segmentation Module

由于复杂的伪装,预测图不可避免地存在一些置信度低的模糊区域,我们采用逆向策略从这些低置信度区域中挖掘线索,通过逆转注意力来删除检测区域并放大低置信度区域的响应,从而重新校准错误分类的区域。具体来说,我们将粗分割图 \(\{d^s_{k+1}\}^3_{k=0}\) 重复为64维张量,用Sigmoid \(S(·)\)将其归一化为[0,1],并通过从1中减去每个元素来反转它。然后将综合特征 \(f^o_k\) 与反向map相乘,并将其与边缘特征 \(d^{fe}_k\) 串联得到分割结果 \(d^s_k\):

其中 \(rp(·)\) 和 \(rv(·)\) 表示重复和反向。

3.3.2 ODE-inspired Edge Reconstruction Module

现有方法倾向于在残差网络结构中融入某些先验来挖掘边缘信息[13,50]。然而,无论是IS难题的定位问题,还是ED难题的模糊边界问题,都难以为COD任务设计合适的边缘先验。在某些情况下,有偏差的先验信息甚至会降低分割性能。

本文专注于提出一种边界友好的网络架构,即ODE启发的边重建(OER)模块,而不是利用先验知识。与传统的残差网络结构(可视为ODE的一阶欧拉离散化近似,具有不可忽略的截断误差[46])相比,所提OER模块采用了高阶ODE求解器,即二阶Runge-Kutta (RK2),以在边缘信息处理中提供更精确的数值解。这更好地适应了边缘的细粒度特性,并促进了完整的边缘重建,从而解决了ED挑战。为确保OER模块的灵活性,我们将RK2求解器中的固定权衡参数替换为具有可学习系数的加权门机制 \(g_w\)。给定一个输入 \(e_t\),其中 \(e_t = conv1(con(f^o_k,\ rp (d^s_{k+1})))\),所提出的OER模块可以表述为:

其中 \(e_{t+1} = d^{fe}_k\),\(\sigma_g\) 和 \(\mu_g\) 是 \(g_w\) 的可学习参数。\(\{F_i\}^2_{i=1}\) 表示具有效率共享参数 \(θ_t\) 的中间层。遵循[1],我们将 \(F_i\) 设置为Conv-ReLU-Conv框架。为了保证OER的稳定性,我们将Hamiltonian system[9]应用到我们的OER模块中。将Eq.(11)表示为 \(RK2(·)\),定义有Hamiltonian理论保证的OER模块为:

其中 \(e_t\) 按通道划分为 \(e_t^1\) 和 \(e_t^2\)。值得注意的是Eq.(12)中的OER模块是一个可逆且稳定的块[9],这进一步提升了边缘重建性能。在这种情况下,可以通过以下方式获得最终的边预测 \(\{d^e_k\}^4_{k=1}\):

3.4. Loss Functions

所提FEDER的损失函数由两种监督组成,即伪装目标的分割掩模 \(GT_s\) 和边缘 \(GT_e\),分别对应多尺度分割图 \(\{d^s_k\}^5_{k=1}\) 和多尺度目标边缘 \(\{d^e_k\}^4_{k=1}\)。遵循[4],我们采用加权二值交叉熵损失 \(L^w_{BCE}\) 和加权交并比损失 \(L^w_{IoU}\) 进行分割监督,更加关注难像素。对于边缘监督,我们使用dice损失 \(L_{dice}\) [29]来克服正负样本之间的极端不平衡。此外,为了处理多尺度输出,我们在训练期间对所有输出进行上采样,以匹配其相应的真实值的大小。因此,我们的FEDER总损失公式如下:

一、伪装特征编码器 (Camouflaged Feature Encoder, CFE).

二、深度类小波分解 (Deep Wavelet-like Decomposition, DWD).

一)高频注意力模块 (High-frequency attention module, HFA).

二)低频注意力模块 (Low-frequency attention module, LFA).

三)基于引导的特征聚合模块 (Guidance-based Feature Aggregation Module, GFA).

三、面向分割的边缘辅助解码器 (Segmentation-oriented Edge-assisted Decoder, SED).

浙公网安备 33010602011771号

浙公网安备 33010602011771号