Java并发编程实战读书笔记

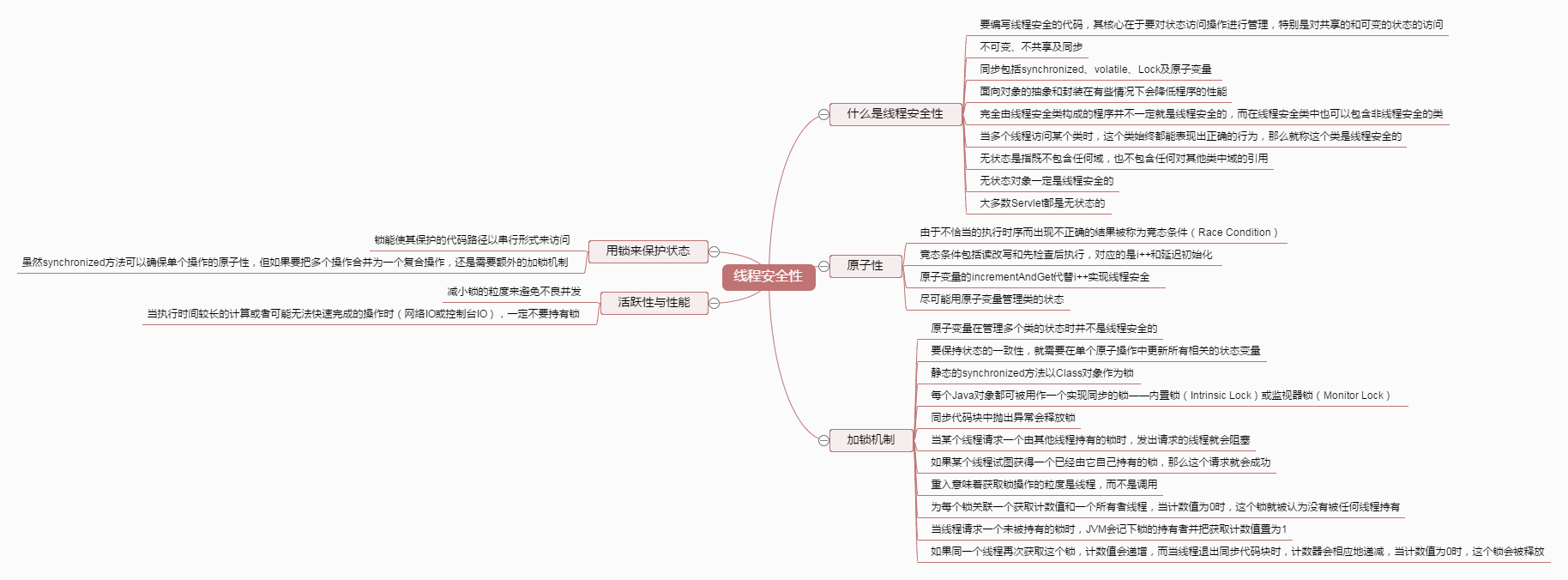

第2章 线程安全性

第3章 对象的共享

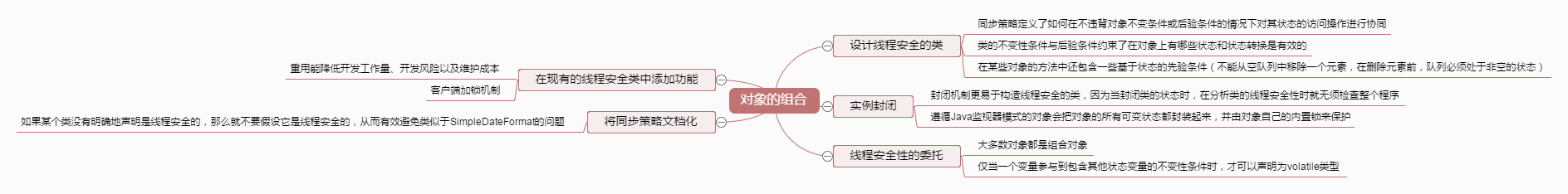

第4章 对象的组合

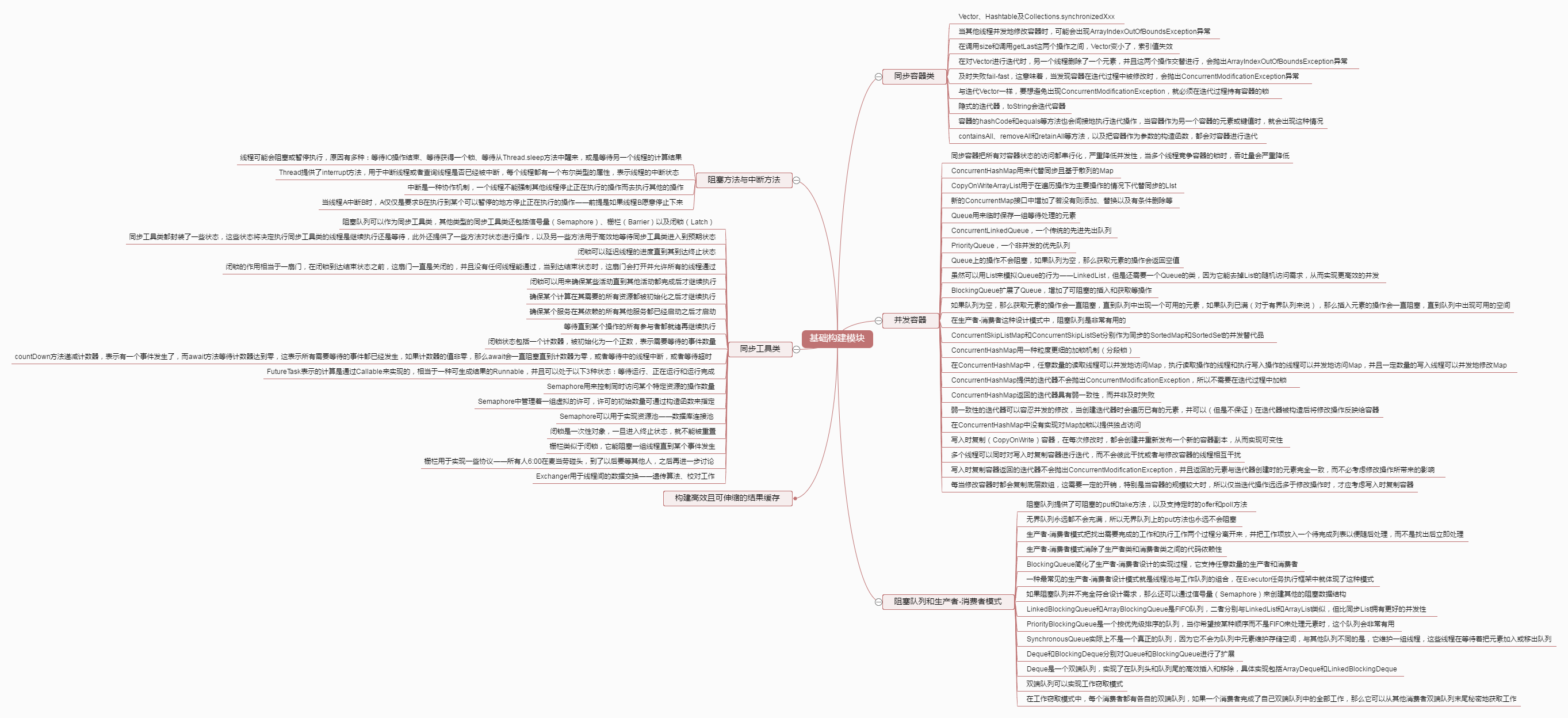

第5章 基础构建模块

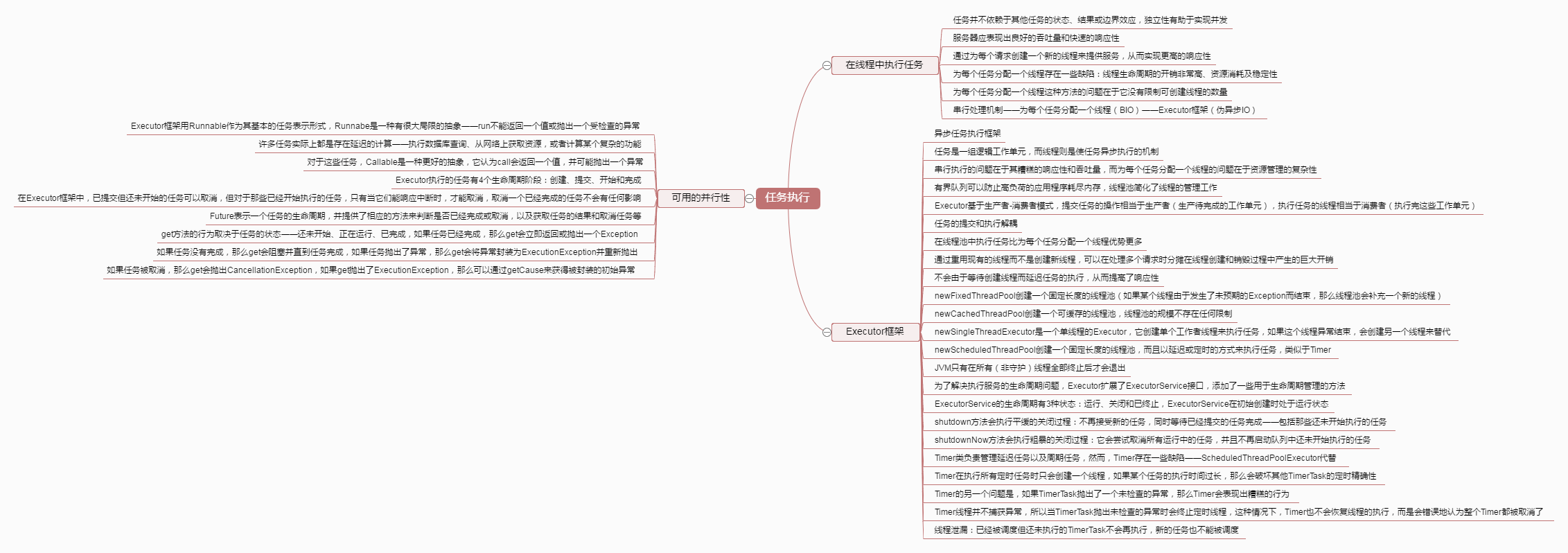

第6章 任务执行

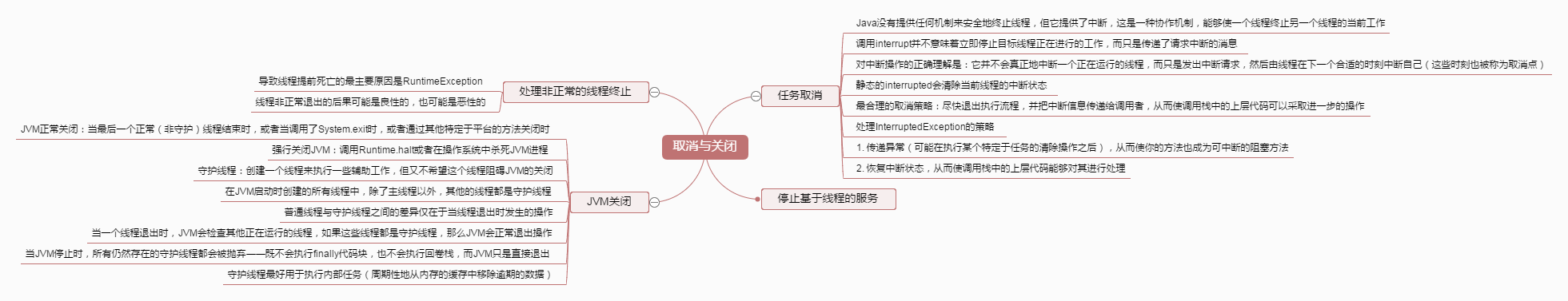

第7章 取消和关闭

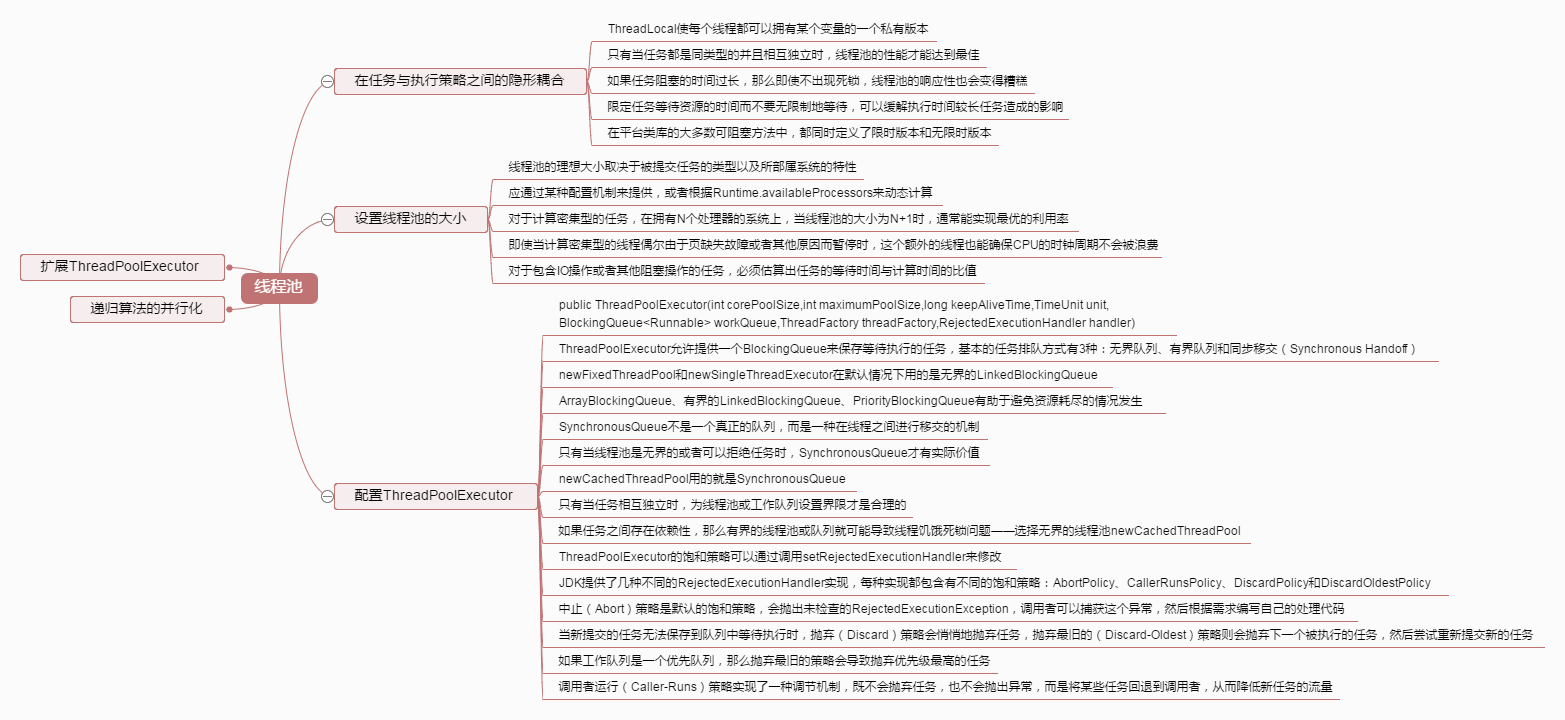

第8章 线程池

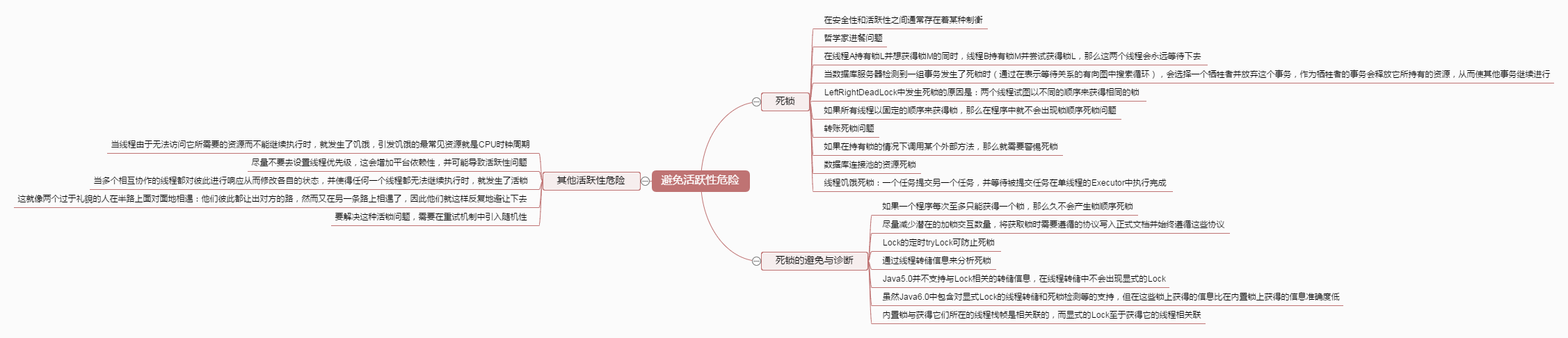

第10章 避免活跃性危险

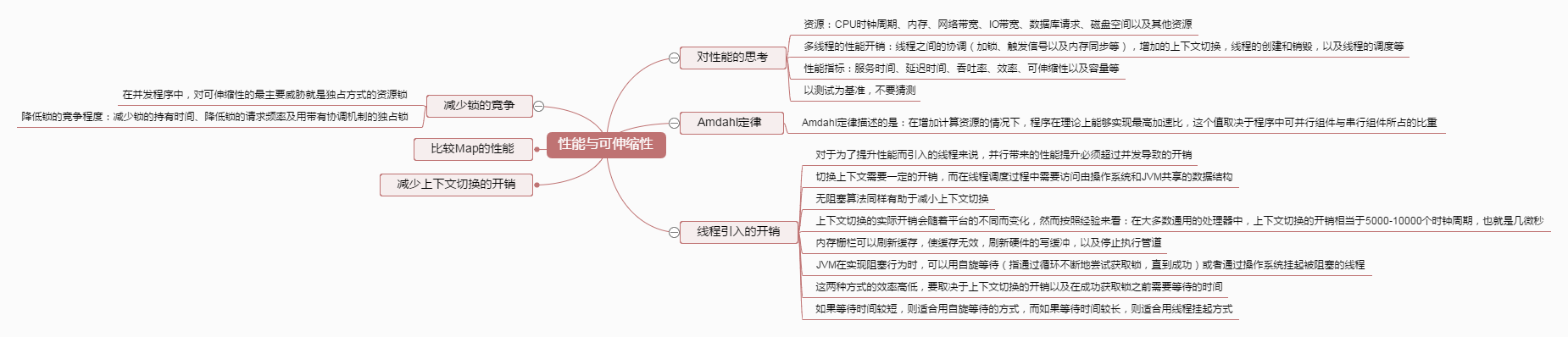

第11章 性能和可伸缩性

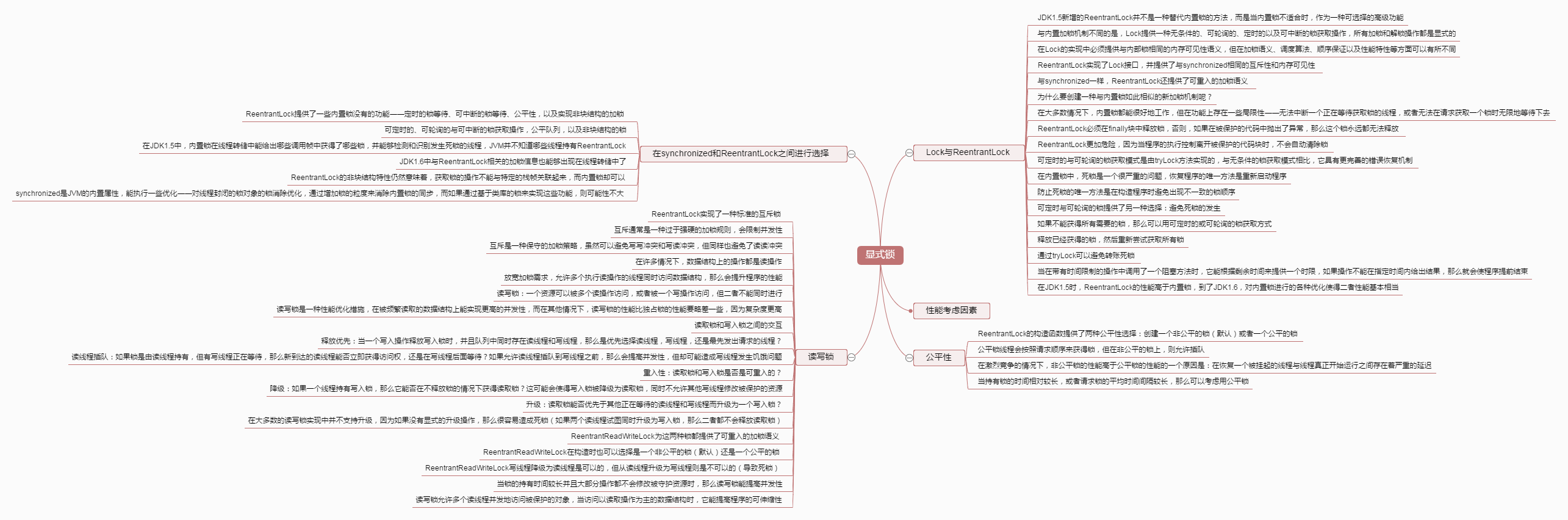

第13章 显式锁

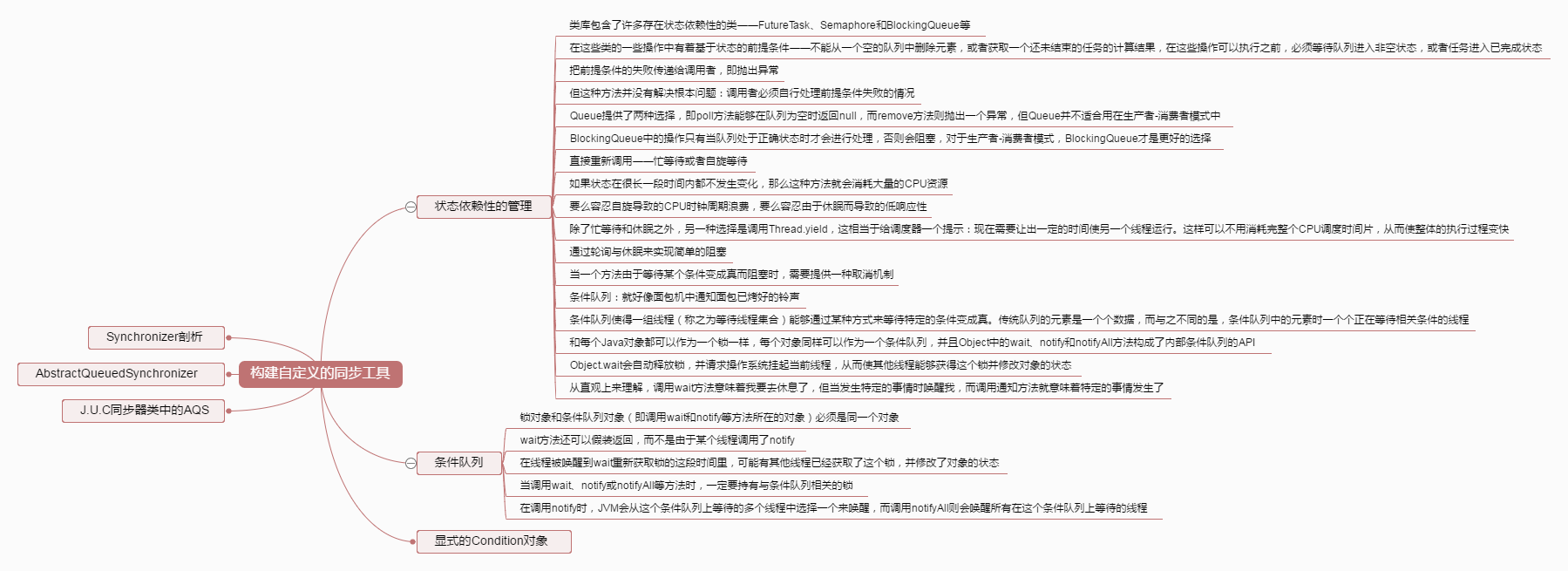

第14章 构建自定义的同步工具

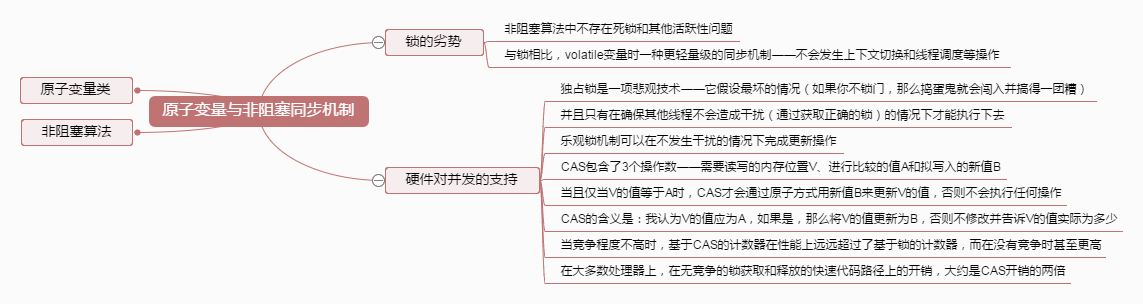

第15章 原子变量与非阻塞同步机制

第16章 Java内存模型

Java并发机制的底层实现原理

volatile:保证了共享变量的可见性,轻量级的synchronized,比synchronized的成本更低,因为它不会引起线程上下文的切换和调度

实现原理:

被volatile修饰的变量在反编译成汇编代码时会多出一条lock指令,而lock指令在多核处理器上会:

1. 把当前处理器缓存行的数据写回到系统内存,缓存行即cache line,是缓存中可以分配的最小存储单位

2. 这个写回内存的操作会使在其他CPU里缓存了此内存地址的数据无效

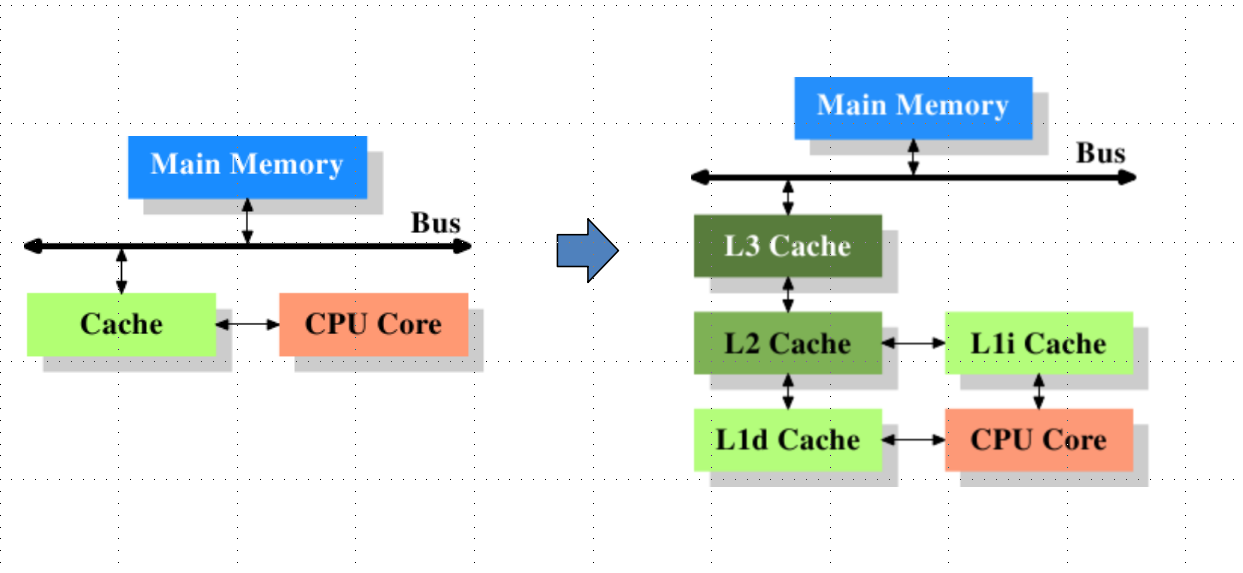

提高处理速度,弥补内存与CPU的剪刀差——引入缓存——在缓存中操作完的数据写回内存的时间是不确定的——对被volatile修饰的变量进行写操作,JVM

就会向处理器发送一条lock前缀的指令,把这个变量所在缓存行的数据立即写回到系统内存,但是就算写回到内存,如果其他处理器缓存的值还是旧的,再执

行计算操作还是会有问题,所以,在多核下,为了保证各个处理器缓存是一致的,就必须实现缓存一致性协议,每个处理器通过嗅探在总线上传播的数据来检

查自己缓存的值是不是过期了,当处理器发现自己缓存行对应的内存地址被修改,就会把当前处理器的缓存行设置成无效状态,当处理器对这个数据进行修改

操作时,会重新从主存中把数据读到处理器缓存里

volatile的优化:Doug lea 集合类LinkedTransferQueue中的volatile变量,用一种追加字节的方式来优化队列出队和入队的性能。追加变量到64个字节(Intel酷睿

的cache line是64个字节宽)——由于并发操作会锁定整个cache line——避免头结点head和尾节点tail加载到同一个cache line中——可以并发地操作头结点和尾节点

synchronized:重量级锁,JDK1.6各种优化性能提高了很多(为了减少获得锁和释放锁带来的性能消耗而引入的偏向锁和轻量级锁,以及锁的存储结构和升级过程)

Java中的每一个对象都可以作为锁:

1. 对于普通同步方法,锁是当前实例对象

2. 对于静态同步方法,锁是当前类的Class对象

3. 对于同步方法块,锁是synchronized括号里的对象

锁到底存在何处?锁里面存储哪些信息?

monitorenter指令是在编译后插入到同步代码块的开始位置,而monitorexit是插入到方法结束处和异常处,JVM要保证每个monitorenter必须有对应的monitorexit与之

配对,任何对象都有一个monitor与之关联,当且一个monitor被持有后,它会处于锁定状态。线程执行到monitorenter指令时,会尝试获取对象所对应的monitor的所有

权,即尝试获得对象的锁

synchronized用的锁是存在于Java对象头里面

Java对象头里的Mark Word里默认存储对象的HashCode、分代年龄和锁标记位

在运行期间,Mark Word里存储的数据会随着锁标志位的变化而变化

锁一共有4种状态,级别从低到高依次是:无锁状态、偏向锁状态、轻量级锁状态和重量级锁状态,这几个状态会随着竞争情况逐渐升级,锁可以升级但不能降级

(这种策略是为了提高获得锁和释放锁的效率)

偏向锁:研究发现,大多数情况下,锁不仅不存在多线程竞争,而且总是由同一线程多次获得,为了让线程获得锁的代价更低而引入了偏向锁。当一个线程访问同步块

并获取锁时,会在对象头和栈帧中的锁记录里存储锁偏向的线程ID,以后此线程再次进入和退出同步块时不需要进行CAS操作来加锁和解锁,只需简单地测试一下对象

头的Mark Word里是否存储着指向当前线程的偏向锁。如果测试成功,表示线程已经获得了锁,如果测试失败,则需要再测试一下Mark Word中偏向锁的标识是否设置

成1(表示当前是偏向锁):如果没有设置,则用CAS竞争锁,如果设置了,则尝试用CAS把对象头的偏向锁指向当前线程

偏向锁的撤销:偏向锁用了一种等到竞争出现才释放锁的机制,所以当其他线程尝试竞争偏向锁时,持有偏向锁的线程才会释放锁,偏向锁的撤销,需要等待全局安全

点(在这个时间点上没有正在执行的字节码)。暂停拥有偏向锁的线程——检查持有偏向锁的线程是否活着,如果线程不处于活动状态,则把对象头设置成无锁状态,如果

线程仍然活着,拥有偏向锁的栈会被执行,遍历偏向对象的锁记录,栈中的锁记录和对象头的Mark Word要么重新偏向于其他线程,要么恢复到无锁或者标记对象不适合

作为偏向锁,最后唤醒暂停的线程

偏向锁的关闭:偏向锁默认是打开的,不过会有延迟,-XX:BiasedLockingStartupDelay=0关闭延迟

如果应用程序里所有的锁通常情况下处于竞争状态,-XX:UseBiasedLocking=false关闭偏向锁,程序会默认进入轻量级锁状态

轻量级锁

轻量级锁加锁:线程在执行同步块之前,JVM会在当前线程的栈帧中创建用于存储锁记录的空间,并把对象头中的Mark Word复制到锁记录中(Displaced Mark Word),

然后线程尝试用CAS把对象头中的Mark Word替换为指向锁记录的指针。如果成功,当前对象获得锁,如果失败,表示其他线程竞争锁,当前线程会尝试用自旋来获取锁

轻量级锁解锁:CAS操作把Displaced Mark Word替换回到对象头,如果成功,则表示没有竞争发生,如果失败,表示当前锁存在竞争,锁就会膨胀成重量级锁

锁的优缺点对比

| 优点 | 缺点 | 应用场景 | |

| 偏向锁 |

加锁和解锁不需要额外的消耗, 和执行非同步方法相比仅存在纳秒级的差距 |

如果线程间存在锁竞争, 会带来额外的锁撤销的消耗 |

只有一个线程访问同步块的场景 |

| 轻量级锁 |

竞争的线程不会阻塞, 提高了程序的响应速度,同步块执行速度非常快 |

始终得不到锁的线程, 会不断自旋消耗CPU |

追求响应时间 |

| 重量级锁 | 线程竞争不会自旋,减少CPU消耗 | 线程阻塞,响应时间缓慢 | 追求吞吐量,同步块执行时间长 |

原子操作的实现原理

处理器会自动保证基本内存操作的原子性,处理器保证从系统内存中读取或者写入一个字节是原子的,意思是当一个处理器读取一个字节时,其他处理器不能访问这个字节

的内存地址对于复杂的内存操作(跨多个缓存行 跨页表),处理器基于对缓存加锁或总线加锁的方式来实现多处理器之间的原子操作

1. 总线锁保证原子性:多个处理器同时对共享变量进行读改写操作(i++)

总线锁即处理器的Lock#信号,当一个处理器在总线上输出此信号时,其他处理器的请求被阻塞,这样保证了此处理器可以独占共享内存

2. 缓存锁保证原子性:总线锁把CPU和内存之间的通信锁住了,开销较大——缓存锁代替总线锁 缓存锁是指内存区域如果被缓存在处理器的缓存行中,并且在lock操作期间

被锁定,那么当它执行锁操作回写到内存时,处理器不在总线上声言lOCK#信号,而是修改内部的内存地址,并允许它的缓存一致性机制保证操作的原子性,因为缓存一致

性机制会阻止同时修改由多个处理器缓存的内存区域数据,当其他处理器回写已被锁定的缓存行的数据时,会使缓存行无效

但是有两种情况不会用缓存锁:

1. 当操作的数据不能被缓存在处理器内部,或操作的数据跨多个cache line

2. 有的处理器不支持缓存锁(Intel 486 Pentium)

Java中通过锁和循环CAS的方式来实现原子操作

CAS底层是处理器提供的CMPXCHG指令,自旋CAS实现的基本思路就是循环进行CAS操作直到成功为止

CAS实现的线程安全计数器

1 private void safeCount() { 2 for (; ; ) { 3 int i = atomicI.get(); 4 boolean suc = atomicI.compareAndSet(i, ++i); 5 if (suc) { 6 break; 7 } 8 } 9 }

CAS实现原子操作的3个问题:

1. ABA问题 如果一个值原来是A,变成了B,又变成了A,那么CAS进行检查时会发现它的值没有发生变化解决思路就是版本号,在变量前面追加版本号,每次变量更新时

把版本号加1,那么A-B-A就会变成1A-2B-3A

2. 循环时间长开销大 自旋CAS如果长时间不成功,会给CPU带来非常大的执行开销

3. 只能保证一个共享变量的原子操作 i=2,j=a合并成ij=2a

除了偏向锁,JVM实现锁的方式都用了循环CAS

Java内存模型

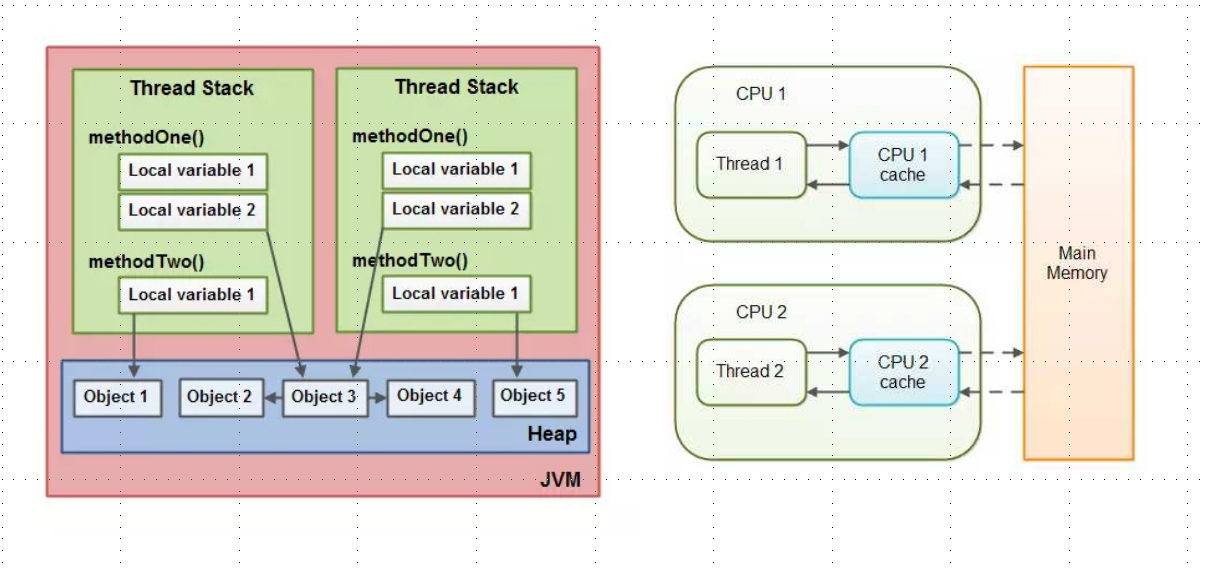

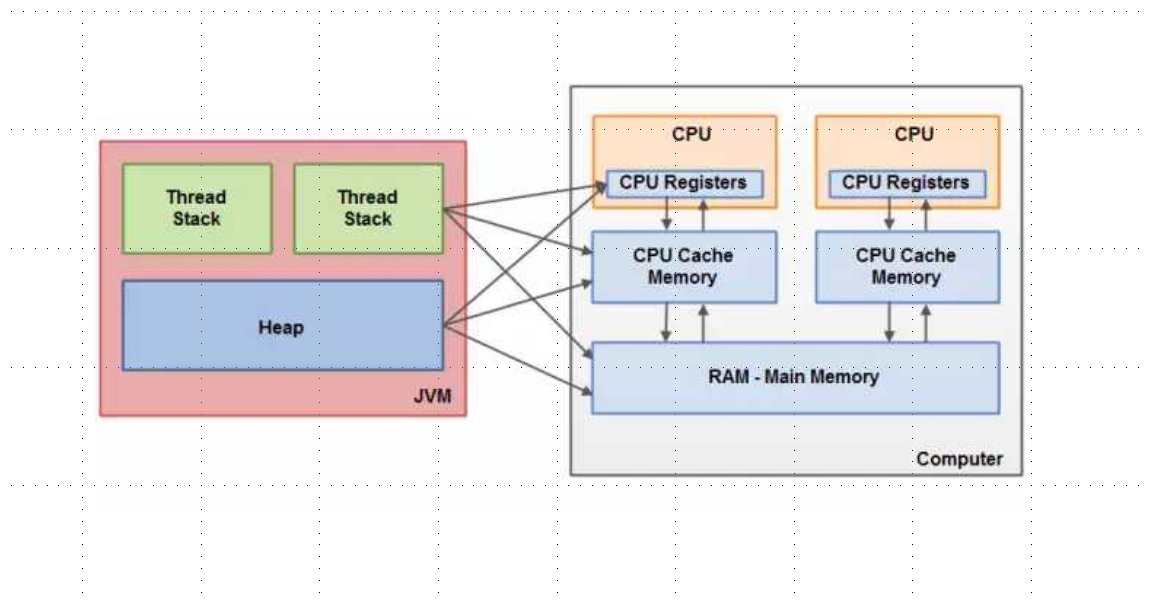

并发编程中的两个关键问题:

1. 线程之间如何通信(命令式编程中有两种:共享内存和消息传递)

2. 线程之间如何同步

JMM决定一个线程对共享变量的写入何时对另一个线程可见

线程A与线程B之间要通信的话,必须要经历2个步骤

1. 线程A把本地内存中更新过的共享变量刷新到主内存中去

2. 线程B到主内存中去读取线程A之前已更新过的共享变量

提高性能——重排序(编译器优化重排序 指令级并行重排序 内存系统重排序)——可能导致内存可见性问题——引入内存屏障

处理器用写缓冲区临时保存向内存写入的数据,写缓冲区可以保证指令流水线持续运行,它可以避免由于处理器停顿下来等待向内存写入数据而产生的延迟。同时,以批处理

的方式刷新写缓冲区,以及合并写缓冲区中对同一内存地址的多次写,可以减少对内存总线的占用——处理器对内存的读写操作的执行顺序,不一定与内存实际发生的读写操

作顺序一致

happens-before

重排序

数据依赖性:写后读 写后写 读后写

编译器和处理器不会改变存在数据依赖关系的两个操作的执行顺序

as-if-serial语义:不管怎么重排序,单线程程序的执行结果不能被改变

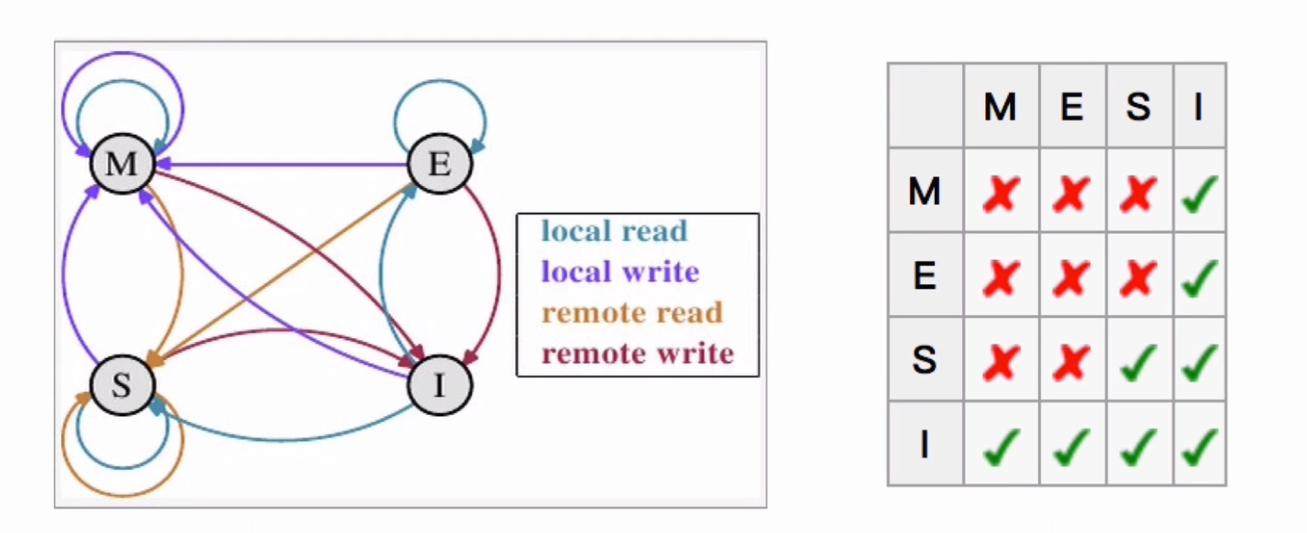

缓存一致性(MESI)

CPU与内存间速度的剪刀差——>引入缓存(时间局部性和空间局部性)——>缓存一致性协议

M:被修改(Modified)

E:独享的(Exclusive)

S:共享的(Shared)

I:无效的(Invalid)

Java内存模型(Java Memory Model,JMM)

浙公网安备 33010602011771号

浙公网安备 33010602011771号