MySQL高可用之PXC

1.PXC简介

参考Percona官方https://www.percona.com/software/mysql-database/percona-xtradb-cluster

PXC(Percona XtraDB Cluster)是一个开源的MySQL高可用解决方案。它将Percona Server和XtraBackup与Galera库集成,以实现同步多主复制。基于Galera的高可用方案主要有MariaDB Galera Cluster和Percona XtraDB Cluster,目前PXC架构在成产线上的用的更多而且更成熟一些。PXC相比那些传统的基于主从复制的集群架构MHA和双主,Galera Cluster最突出的特点就是解决了诟病已久的复制延迟问题,基本上可以达到实时同步。而且节点与节点之间,它们相互的关系是对等的。本身Galera Cluster也是一种多主架构。PXC是存在存储引擎实现的同步复制,而且非异步复制,所以其数据的一致性是相当高的。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-5tPDl9FV-1615780034023)(C:\Users\Administrator\AppData\Roaming\Typora\typora-user-images\image-20210314150453680.png)]](https://img-blog.csdnimg.cn/20210315114927922.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NTMxMDMyMw==,size_16,color_FFFFFF,t_70)

要搭建PXC架构至少需要三个MySQL实例来组成一个集群,三个实例之间不是主从模式,而是各自为主,所以三者关系是对等的,不分从属,这也叫multi-master架构。客户端读写时,连接那个实例都是一样的,读取到的数据是相同的,写入任意一个实例后,集群会将自己的新写入的数据同步到其他实例上,这种架构不共享任何数据,是一种高冗余的集群架构。

1.1PXC优缺点

优点:

- 实现了MySQL集群的高可用性和数据的强一致性。

- 完成了真正的多节点读写的集群方案。

- 改善了主从复制延迟问题,基本上达到了实时同步。

- 新加入的节点可以自动部署,无需提前手动备份,维护方便。

- 由于是多节点写入,所以DB故障切换和容易。

缺点:

- 加入新节点时开销大。添加新节点时,必须从现有的节点之一复制完成数据集。如果数据是100G,则复制100G。

- 任何更新的事物都需要全局验证通过,才会在其他节点上执行,集群性能受限于性能最差的节点,也就说是我们常说的木桶定律。

- 因为需要保证数据的一致性,PXC采用的实时基于存储引擎来实现同步复制,所以在多节点并发写入时,锁冲突问题比较严重。

- 存在扩大问题。所以节点上都会发生写操作,对于写负载的大场景,不推荐实用PXC。

- 只支持innoDB存储引擎。

1.2 PXC原理

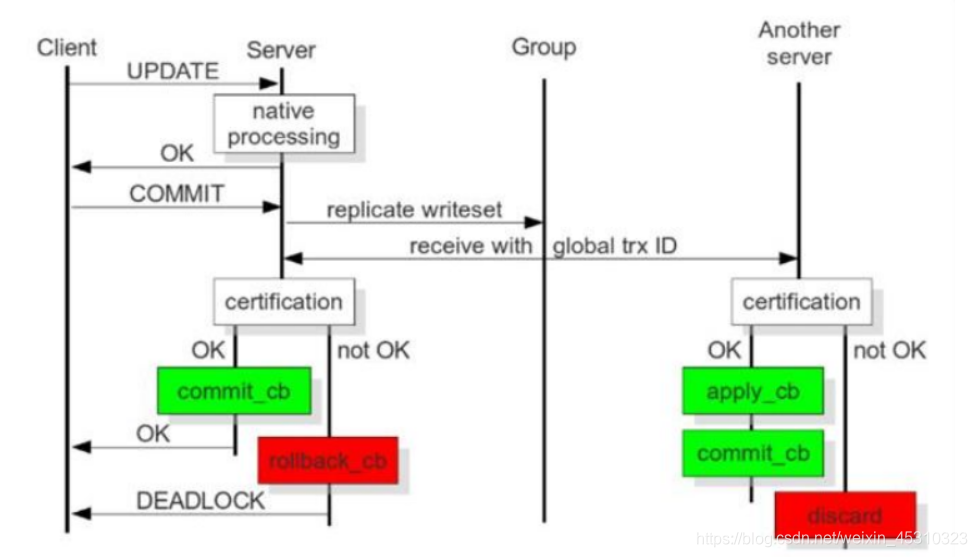

PXC的操作流程大体是这样的,首先客户端向请求连接的写入点提交事务之前,由该节点将需要产生的relication writeset广播出去,然后获取全局事务的id,一并传送到其他的节点上去。其他节点通过certification合并数据之后,发现没有冲突数据,便执行apply_cb和commit_cd操作,否则就discard次事务。

而当前节点(客户端请求的写入节点)通过验证之后,执行commit_cb操作,并返回ok给客户端,如果验证没有通过,则rollback_cb。

在上产线上的PXC集群中,至少要有三台节点。如果其同一台没有通过验证,出现了数据冲突,那么此时采取的方式就是将出现的数据不一致的节点剔出集群,而且它会自动执行shutdown命令自动关机。

1.3 PXC中的重要概念

首先要规模集群中节点的数量,整个集群节点控制在最少三个、至多八个的范围。最少三个是为了防止脑裂现象,因为只有在两个节点的情况下才会出现脑裂。脑裂的表现就是输入任何命令,返回结果都是 unkown command。

当一个新节点要加入PXC集群的时候,需要从集群中各个节点选举出一个doner(提供者)节点作为全量数据的贡献者。PXC有两种节点的数据传输方式,一种叫SST全量传输,另一种叫IST增量传输。SST传输有XtraBackup、mysqldump、rsync三种方式,而增量传输只有XtraBacker。一般数据量不大的时候可以使用SST作为全量全输,但也只是用XtraBackup方式。

节点集群中,会因新节点加入故障,同步失效等而发生状态切换,下面举例这些状态的含义:

- open:节点启动成功,尝试连接到集群。

- primary:节点已经在集群中,在新节点加入集群时,选举donor进行数据同步时会产生的状态。

- joiner:节点处于等待接受同步数据文件的状态

- joinerd:节点已经完成同步,尝试保持和集群中其他节点进度一致。

- synced:节点正常提供服务的状态,表示已经同步完成和集群进度保持一致。

- doner:节点处于为新加入的节点,提供全量数据时的状态。

1.4PXC中的重要配置参数

搭建PXC过程中,需要在my.cnf中设置一下参数

-

wsrep_cluster_name:指定群集的逻辑名称,对于群集中所有的节点,群集名称必须相同。

-

wsrep_cluster_address:指定群集中各个节点的ip地址

-

wsrep_node_name:指定当前节点在及群众的逻辑名称

-

wsrep_node_address:指定当前节点的IP地址

-

wwsrep_provider:指定Galera库路径

-

wsrep_sst_method:模式情况下,PXC使用XtraBackup进行SST传输。强烈建议该参数指为xtrabackup-v2

-

wsrep_sst_auth:指定认证凭证为SST作为<sst_user><sst_pwd>。必须在引导第一个节点后创建此用户并赋予必要的权限

-

pxc_strict_mode:严格模式,官方建议该参数值为ENFORCING。

在PXC中还有一个特别重要的模块就是Gcache。它的核心功能就是每个节点缓存当前最新的写集。如果有新的节点加入集群,就可以把新数据等待增量传递给新节点,而不需要在使用SST方式了。这样可以让节点更快的加入到集群中。GCache模块涉及了如下参数:

-

gcache.size:代表用来缓存写集增量信息的大小。它的默认大小是128MB,通过wsrep_provider_options变量参数来设置。建议调整为2G-4G范围,足够的空间便于缓存更多的增量信息。

-

gcache.page_size:可以理解为如果内存不够用(Gcache不足),就直接将写集写入到磁盘文件中。

-

gcache.mem_size:代表Gcache中内存缓存的大小,适度调大可以提高整个集群的性能。

1.5 PXC集群状态监控

在集群搭建好之后,可以通过如下状态变量'%wsrep%'来查看集群中各个节点的状态,下面列举出几个重要的参数,便于发现问题。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-9D8PgsSp-1615780034030)(C:\Users\Administrator\AppData\Roaming\Typora\typora-user-images\image-20210314180644599.png)]](https://img-blog.csdnimg.cn/20210315115232808.png?x-oss-process=image/watermark,type_ZmFuZ3poZW5naGVpdGk,shadow_10,text_aHR0cHM6Ly9ibG9nLmNzZG4ubmV0L3dlaXhpbl80NTMxMDMyMw==,size_16,color_FFFFFF,t_70)

2.部署PXC

2.1 环境描述

所需文件下载:1111

地址规划:

| 主机名 | IP地址 |

|---|---|

| pxc-node1 | 192.168.1.61 |

| pxc-node2 | 192.168.1.64 |

| pxc-node3 | 192.168.1.65 |

解决依赖包

yum install -y libev lsof perl-Compress-Raw-Bzip2 perl-Compress-Raw-Zlib perl-DBD-MySQL perl-DBI perl-Digest perl-Digest-MD5 perl-IO-Compress perl-Net-Daemon perl-PlRPC qpress socat openssl openssl-devel

//qpress包可能会装不上,我们进行手动安装,上面以提供所需包

tar xf qpress-11-linux-x64.tar -C /usr/local/bin/

安装XtraBackup

yum -y install percona-xtrabackup-24-2.4.18-1.el7.x86_64.rpm

卸载mariadb

rpm -e mariadb-libs --nodeps

创建mysql用户、组

groupadd -r mysql && useradd -M -s /bin/false -r -g mysql mysql

解压软件包到/usr/local/mysql,并创建数据目录,赋予权限

tar zxf Percona-XtraDB-Cluster-5.7.28-rel31-31.41.1.Linux.x86_64.ssl101.tar.gz

mv Percona-XtraDB-Cluster-5.7.28-rel31-31.41.1.Linux.x86_64.ssl101 /usr/local/mysql

mkdir /usr/local/mysql/data

chown -R mysql:mysql /usr/local/mysql/

配置环境变量

tail -1 /etc/profile

export PATH=/usr/local/mysql/bin:$PATH

. /etc/profile

准备配置文件,binlog格式必须为row,pxc-node2和pxc-node3上的配置文件相同,但是注意需要更改 server_id、wsrep_node_name、wsrep_node_address

[client]

port = 3306

socket = /tmp/mysql.sock

[mysql]

prompt="\u@\h \R:\m:\s[\d]> "

no-auto-rehash

[mysqld]

user = mysql

port = 3306

basedir = /usr/local/mysql

datadir = /usr/local/mysql/data

socket = /tmp/mysql.sock

pid-file = db.pid

character-set-server = utf8mb4

skip_name_resolve = 1

open_files_limit = 65535

back_log = 1024

max_connections = 512

max_connect_errors = 1000000

table_open_cache = 1024

table_definition_cache = 1024

table_open_cache_instances = 64

thread_stack = 512K

external-locking = FALSE

max_allowed_packet = 32M

sort_buffer_size = 4M

join_buffer_size = 4M

thread_cache_size = 768

interactive_timeout = 600

wait_timeout = 600

tmp_table_size = 32M

max_heap_table_size = 32M

slow_query_log = 1

slow_query_log_file = /usr/local/mysql/data/slow.log

log-error = /usr/local/mysql/data/error.log

long_query_time = 0.1

server-id = 1813306

log-bin = /usr/local/mysql/data/mysql-bin

sync_binlog = 1

binlog_cache_size = 4M

max_binlog_cache_size = 1G

max_binlog_size = 1G

expire_logs_days = 7

master_info_repository = TABLE

relay_log_info_repository = TABLE

gtid_mode = on

enforce_gtid_consistency = 1

log_slave_updates

binlog_format = row

relay_log_recovery = 1

relay-log-purge = 1

key_buffer_size = 32M

read_buffer_size = 8M

read_rnd_buffer_size = 4M

bulk_insert_buffer_size = 64M

lock_wait_timeout = 3600

explicit_defaults_for_timestamp = 1

innodb_thread_concurrency = 0

innodb_sync_spin_loops = 100

innodb_spin_wait_delay = 30

transaction_isolation = REPEATABLE-READ

innodb_buffer_pool_size = 1024M

innodb_buffer_pool_instances = 8

innodb_buffer_pool_load_at_startup = 1

innodb_buffer_pool_dump_at_shutdown = 1

innodb_data_file_path = ibdata1:1G:autoextend

innodb_flush_log_at_trx_commit = 1

innodb_log_buffer_size = 32M

innodb_log_file_size = 2G

innodb_log_files_in_group = 2

innodb_io_capacity = 2000

innodb_io_capacity_max = 4000

innodb_flush_neighbors = 0

innodb_write_io_threads = 4

innodb_read_io_threads = 4

innodb_purge_threads = 4

innodb_page_cleaners = 4

innodb_open_files = 65535

innodb_max_dirty_pages_pct = 50

innodb_flush_method = O_DIRECT

innodb_lru_scan_depth = 4000

innodb_checksum_algorithm = crc32

innodb_lock_wait_timeout = 10

innodb_rollback_on_timeout = 1

innodb_print_all_deadlocks = 1

innodb_file_per_table = 1

innodb_online_alter_log_max_size = 4G

internal_tmp_disk_storage_engine = InnoDB

innodb_stats_on_metadata = 0

wsrep_provider=/usr/local/mysql/lib/libgalera_smm.so

wsrep_provider_options="gcache.size=1G"

wsrep_cluster_name=pxc-test

wsrep_cluster_address=gcomm://192.168.1.61,192.168.1.64,192.168.1.65

wsrep_node_name=pxc-node1

wsrep_node_address=192.168.1.61

wsrep_sst_method=xtrabackup-v2

wsrep_sst_auth=sst:pwd@123

pxc_strict_mode=ENFORCING

default_storage_engine=InnoDB

innodb_autoinc_lock_mode=2

[mysqldump]

quick

max_allowed_packet = 32M

各节点完成MySQL初始化

mysqld --defaults-file=/etc/my.cnf --user=mysql --basedir=/usr/local/mysql/ --datadir=/usr/local/mysql/data/ --initialize

2.3 引导第一个节点以初始化集群

在pxc-node1上启动MySQL

mysqld --defaults-file=/etc/my.cnf --wsrep_new_cluster &

netstat -anput | grep mysql

tcp 0 0 0.0.0.0:4567 0.0.0.0:* LISTEN 1691/mysqld

tcp6 0 0 :::3306 :::* LISTEN 1691/mysqld

错误日志中获取临时密码,登入到MySQL更改root密码

[root@pxc-node1 ~]# grep 'password' /usr/local/mysql/data/error.log

2021-03-14T11:05:42.083115Z 1 [Note] A temporary password is generated for root@localhost: k-506%(lZJlu

root@localhost 19:09: [(none)]> alter user root@'localhost' identified by '123.com';

创建PXC中的SST传输账号

root@localhost 19:09: [(none)]> grant all privileges on *.* to 'sst'@'localhost' identified by 'pwd@123';

root@localhost 19:13: [(none)]> flush privileges;

2.4 将其他节点添加到集群

在pxc-node2和pxc-node3上启动MySQL,将pxc-node2和pxc-node3加入集群中,过程需要几分钟,耐心等待

mysqld --defaults-file=/etc/my.cnf &

netstat -anput | grep mysql

tcp 0 0 0.0.0.0:4567 0.0.0.0:* LISTEN 2653/mysqld

此刻pxc-node2和pxc-node3正在从pxc-node1往本地同步数据

netstat -anput | grep mysql

tcp 0 0 0.0.0.0:4567 0.0.0.0:* LISTEN 2653/mysqld

tcp 0 0 192.168.1.64:4567 192.168.1.65:48590 ESTABLISHED 2653/mysqld

tcp 0 0 192.168.1.64:41942 192.168.1.61:4567 ESTABLISHED 2653/mysqld

tcp6 0 0 :::3306 :::* LISTEN 2653/mysqld

已同步数据到本地,因此,直接使用pxc-node1上设置的root用户密码,既能直接登录到MySQL终端

mysql -uroot -p123.com

查看集群状态,可以看到,当前集群中有三台节点

root@localhost 11:30: [(none)]> show global status like '%wsrep_cluster_s%';

+--------------------------+--------------------------------------+

| Variable_name | Value |

+--------------------------+--------------------------------------+

| wsrep_cluster_size | 3 |

| wsrep_cluster_state_uuid | abd434e7-853e-11eb-b686-920f5f5a4d49 |

| wsrep_cluster_status | Primary |

+--------------------------+--------------------------------------+

3 rows in set (0.00 sec)

root@localhost 11:33: [(none)]> show global status like '%wsrep_ready%';

+---------------+-------+

| Variable_name | Value |

+---------------+-------+

| wsrep_ready | ON |

+---------------+-------+

1 row in set (0.00 sec)

2.5 验证复制

在其中一台创建库看其他两台是否同步即可。

root@localhost 11:35: [(none)]> create database pxc

root@localhost 11:41: [(none)]> use pxc

root@localhost 11:41: [pxc]> create table test_t1 (

-> id int primary key auto_increment,

-> name varchar(22)

-> );

root@localhost 11:43: [pxc]> insert into test_t1(name) values('zhangsan'),('lisi');

//在其他节点查看是否同步

root@localhost 11:45: [qin]> select * from pxc.test_t1;

+----+----------+

| id | name |

+----+----------+

| 1 | zhangsan |

| 4 | lisi |

+----+----------+

-> id int primary key auto_increment,

-> name varchar(22)

-> );

root@localhost 11:43: [pxc]> insert into test_t1(name) values('zhangsan'),('lisi');

//在其他节点查看是否同步

```bash

root@localhost 11:45: [qin]> select * from pxc.test_t1;

+----+----------+

| id | name |

+----+----------+

| 1 | zhangsan |

| 4 | lisi |

+----+----------+

浙公网安备 33010602011771号

浙公网安备 33010602011771号