GBDT+LR融合

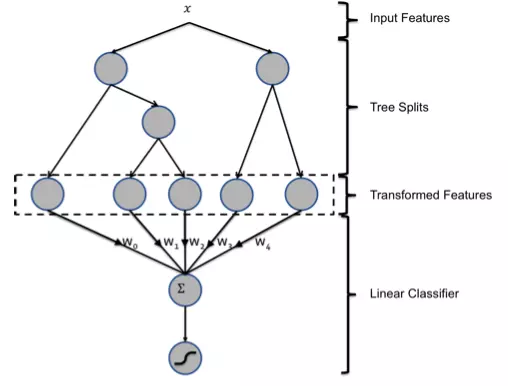

上图有两棵树,左树有三个叶子节点,右树有两个叶子节点,最终的特征即为五维的向量。

对于输入x,假设他落在左树第一个节点,编码[1,0,0],落在右树第二个节点则编码[0,1],所以整体的编码为[1,0,0,0,1],这类编码作为特征,输入到LR中进行分类。

在CTR预估问题的发展初期,使用最多的方法就是逻辑回归(LR),LR使用了Sigmoid变换将函数值映射到0~1区间,映射后的函数值就是CTR的预估值。

LR属于线性模型,学习能力十分有限,需要大量的特征工程来增加模型的学习能力。

LR属于线性模型,学习能力十分有限,需要大量的特征工程来增加模型的学习能力。

[原理] GBDT(Gradient Boost Decision Tree)是一种常用的非线性模型,它基于集成学习中的boosting思想,每次迭代都在减少残差的梯度方向新建立一颗决策树,迭代多少次就会生成多少颗决策树。