HDFS读写过程简析

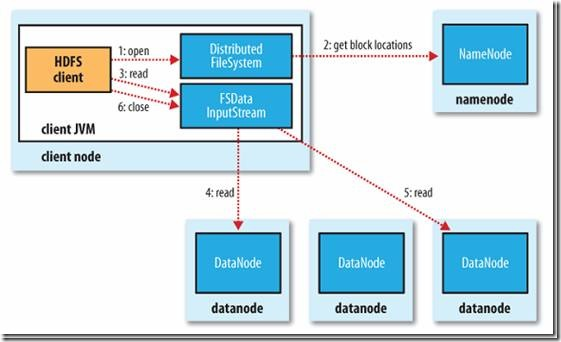

1、HDFS读文件过程

- HDFS客户端(client)用DistributedFileSystem的open()函数打开文件

- 对于文件,DistributedFileSystem用RPC调用元数据节点,得到文件的数据块信息。

- 对于每一个数据块,元数据节点返回保存数据块的数据节点的地址。

- DistributedFileSystem返回FSDataInputStream给客户端,用来从DataNode读取数据。

- HDFS客户端(client)调用FSDataInputStream的read()函数开始读取数据。

- FSDataInputStream中封装DFSInputStream,DFSInputStream连接保存此文件第一个数据块的最近的数据节点,调用DFSInputStreamData的read()函数从数据节点DataNode读数据到客户端(client)

- 当此数据块读取完毕时,DFSInputStream关闭和此数据节点的连接,然后连接距此文件下一个数据块的最近的数据节点。

- 当客户端读取完文件的所有数据块时,调用FSDataInputStream的close函数。

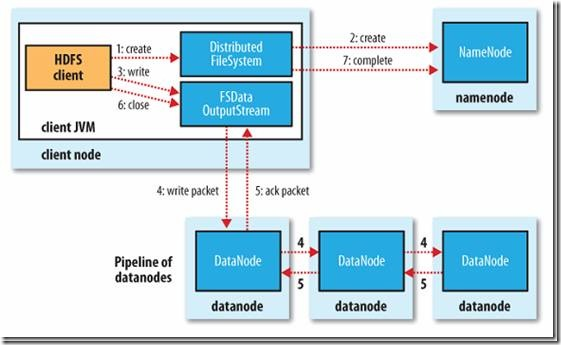

2.2、写文件的过程

- 客户端(client)用DistributedFileSystem的create()函数来创建文件

- DistributedFileSystem用RPC调用元数据节点,在文件系统的命名空间中创建一个新的文件。

- 元数据节点首先确定文件原来不存在,并且客户端有创建文件的权限,然后创建新文件。

- DistributedFileSystem返回DFSOutputStream,客户端用于写数据。

- 客户端开始写入数据,DFSOutputStream将数据分成块,写入data queue。

- Data queue由Data Streamer读取,并通知元数据节点分配数据节点,用来存储数据块(每块默认复制3块)。分配的数据节点放在一个pipeline里。

- Data Streamer将数据块写入pipeline中的第一个数据节点。第一个数据节点将数据块发送给第二个数据节点。第二个数据节点将数据发送给第三个数据节点。

- DFSOutputStream为发出去的数据块保存了ack queue,等待pipeline中的数据节点告知数据已经写入成功。

- 如果数据节点在写入的过程中失败:

- 关闭pipeline,将ack queue中的数据块放入data queue的开始。

- 当前的数据块在已经写入的数据节点中被元数据节点赋予新的标示,则错误节点重启后能够察觉其数据块是过时的,会被删除。

- 失败的数据节点从pipeline中移除,另外的数据块则写入pipeline中的另外两个数据节点。

- 元数据节点则被通知此数据块是复制块数不足,将来会再创建第三份备份。

- 当客户端结束写入数据,则调用stream的close函数。此操作将所有的数据块写入pipeline中的数据节点,并等待ack queue返回成功。最后通知元数据节点写入完毕。

注: dataqueue:将要将要写入的文件的分块数据存放于此

pipeline:将要写入的数据节点(DataNode)列表

ackqueue:将已经写入的数据块存放于此

浙公网安备 33010602011771号

浙公网安备 33010602011771号