Redis

下载与安装Redis

ref:

redis 👉 Download | Redis

xftp/xshell 👉 NetSarang Homepage CN - NetSarang Website (xshell.com)

1、xftp与服务器建立连接

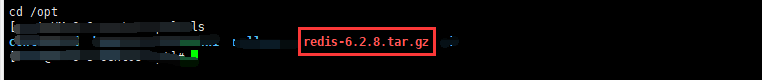

2、将文件放到目录/opt下

3、xshell转到/opt并查看文件列表(cd /opt,ls)

4、安装gcc yum install gcc(C语言环境,如果没有)

5、解压 tar -zxvf redis redis-6.2.8.tar

6、解压完成后 进入目录 cd redis-6.2.8(具体看你解压出来的文件目录名称,ls)

7、执行make,编译成C文件

8、执行安装 make install(默认安装目录 /usr/local/bin)

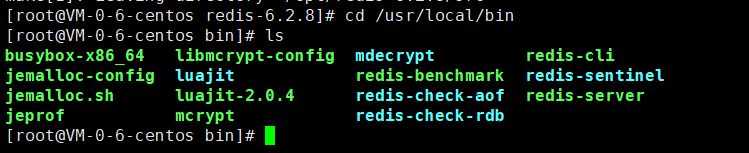

9、查看安装 cd /usr/local/bin,ls

10、目录解析

redis-benchmark: 性能测试工具,可以在自己本子运行,看看自己本机性能如何

redis-check-aof: 修复有问题的AOF文件

redis-check-dump: 修复有问题的dump.rdb文件。

redis-sentinel: Redis集群使用。

redis-server: Redis服务器启动命令。

redis-cli: 客户端,操作入口。

启动与关闭Redis

方式一:

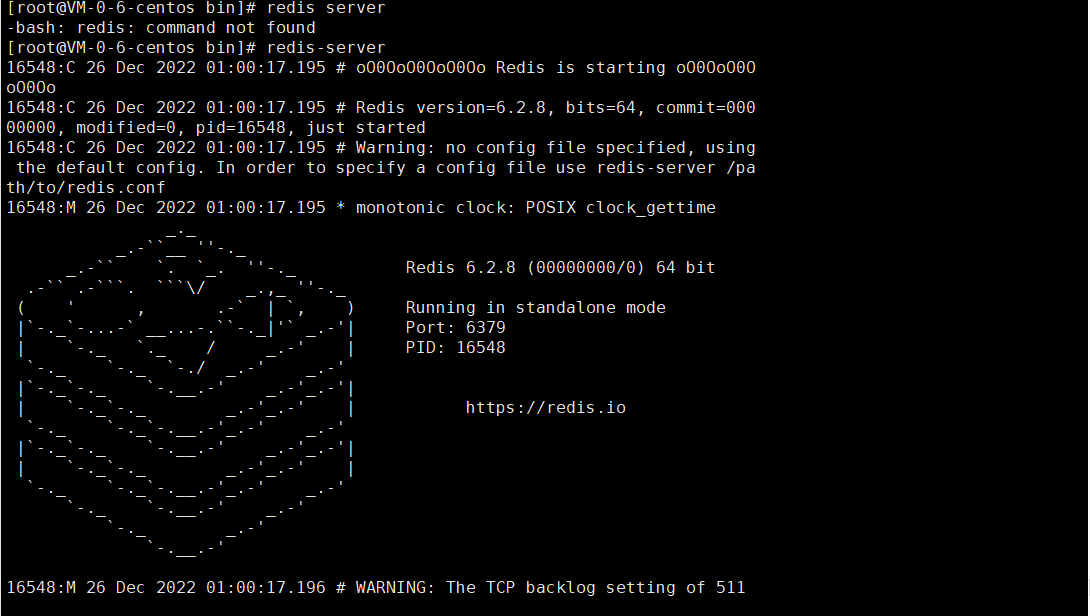

[root@VM-0-6-centos bin]# redis-server

直接启动redis-server(不推荐,窗口关闭服务就会断开)

在redis-server所在目录直接执行命令:redis-server,如图

方式二:

把redis-conf复制到/etc下

cd /opt/redis-6.2.8 cp redis-conf /etc/conf

再通过ls查看复制过来的redis-conf

修改启动设置:daemonize no改成yes(这样就可以在后台运行redis)

vi redis-conf

打开文件时可以使用/daemonize搜索所在位置 按i进行编辑

启动redis-server

cd /usr/local/bin redis-server /etc/redis-conf

这样就启动了redis了

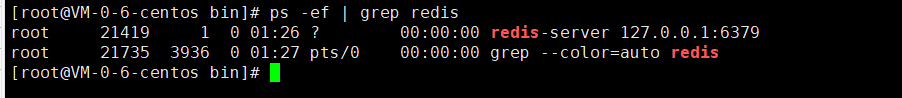

查看进程

ps -ef | grep redis

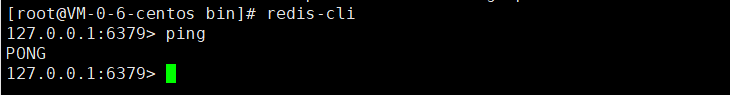

连接redis

redis-cli

单实例关闭

redis-cli shutdown

或者实例中(已经通过redis-cl命令i连接了redis)

shuedown

然后退出

exit

或者通过kill -9指令强制终止退出redis服务进程

kill -9 端口号

多实例关闭,指定端口关闭: redis-cli -p 端口号 shutdown

redis默认端口号:6379

Redis概述

Redis是单线程+多路IO复用技术。

多路复用是指使用一个线程来检查多个文件描述符( Socket )的就绪状态,比如调用select和poll 函数,传入多个文件描述符,如果有一个文件描述符就绪,则返回,否则阻塞直到超时。得到就绪状态后进行真正的操作可以在同一个线程里执行,也可以启动线程执行(比如使用线程池)

(与Memcache三点不同:支持多数据类型, 支持持久化,单线程+多路IO复用)。

串行:按照请求顺序先后执行

memcached:多线程+锁

Redis:单线程+ 多路IO复用

单线程 + 多路IO复用:例如A、B、C三个人等待a、b、c三个vlaue,现在Redis是串行的,如果a拿不到,b也一直在等待,无论是否有b,有了多路IO复用技术,如果没有a,A继续等,B拿到b先走了。

redis默认有16个数据库,类似数组下标从0开始,初始默认使用0号库

key键操作

keys * 查看当前库所有key (匹配 : keys *1)

exists key 判断某个key是否存在

type key 查看你的key是什么类型

del key 删除指定的key数据~

unlink key 根据value选择非阻塞删除(仅将keys从keyspace 元数据中删除,真正的删除会在后续异步操作。)

expire key 1010 秒钟:为给定的key设置过期时间

ttl key查看还有多少秒过期, -1表示永不过期, -2表示已过期

select命令切换数据库.

dbsize查看当前数据库的key的数量

flushdb清空当前库

flushall通杀全部库

[root@VM-0-6-centos bin]# redis-server /etc/redis-conf [root@VM-0-6-centos bin]# redis-cli 127.0.0.1:6379> ping PONG 127.0.0.1:6379> select 1 OK 127.0.0.1:6379[1]> select 15 OK 127.0.0.1:6379[15]> select 16 (error) ERR DB index is out of range 127.0.0.1:6379[15]> select 0 OK 127.0.0.1:6379> keys * (empty array) 127.0.0.1:6379> set k1 hello OK 127.0.0.1:6379> set k2 world OK 127.0.0.1:6379> set k3 hi OK 127.0.0.1:6379> set k4 redis OK 127.0.0.1:6379> keys * 1) "k4" 2) "k3" 3) "k1" 4) "k2" 127.0.0.1:6379> exists k1 (integer) 1 127.0.0.1:6379> exists k6 (integer) 1 127.0.0.1:6379> type k3 string 127.0.0.1:6379> expire k1 10 (integer) 1 127.0.0.1:6379> keys * 1) "k4" 2) "k3" 3) "k1" 4) "k2" 127.0.0.1:6379> ttl k1 (integer) -2 127.0.0.1:6379> ttl k2 (integer) -1 127.0.0.1:6379> dbsize (integer) 3 127.0.0.1:6379>

五种常用类型

String

简介

String是Redis最基本的类型,你可以理解成与Memcached一模一样的类型,一个key对应一个value

String类型是二进制安全的。 意味着Redis的string可以包含任何数据。比如jpg图片或者序列化的对象

string类型是Redis最基本的数据类型,一个Redis中字符串value最多可以是512M

常用命令

set key value

setex key seconds value 设置值与过期时间

get key 查询对应键值

append key value 将给定的 value 追加到原值的末尾。

strlen key 获得值的长度

setnx key value 只有在key不存在时设置 key的值。

incr key 将key中储存的数字值增加1,只能对数字值操作,如果为空,新增值为1

decr key 将key中储存的数字值减14

del key 删除指定key

incrby/decrby key 步长 将key中储存的数字值增减,自定义步长

mset key1 value1 key2 value2 ....同时设置一个或多个 key-value 对

mget skey1 key2 key3.....同时获取一个或多个value

msetnx key1 value1 key2 value2 ....同时设置一个或多个key-value对,当且仅当所有给定key都不存在

(上面的多值操作,一个失败全都失败,具有原子性)

setex key 过期时间 value 单位秒

getset key value 将key对应的值改成value并返回旧值

数据结构

String的数据结构为简单动态字符串(Simple Dynamic String,缩写SDS)。可以修改的字符串,内部结构实现上类似于Java的ArrayList ,采用预分配冗余空间的方式来减少内存的频繁分配.。

内部为当前字符串实际分配的空间capacity一般要高于实际字符串长度len。当字符串长度小于1M时,扩容都是加倍现有的空间,如果超过1M,扩容时一-次只会多扩1M的空间。需要注意的是字符串最大长度为512M。

List

简介

单键多值。

Redis列表是简单的字符串列表,按照插入顺序排序。你可以添加一个元素到列表的头部(左边)或者尾部(右边)。它的底层实际是个双向链表,对两端的操作性能很高,通过索引下标的操作中间的节点性能会较差。

常用命令

lpush/rpush... key value1 value2 value3 ... 从左边/右边插入一个或多个值。

127.0.0.1:6379> lpush k1 v1 v2 v3 (integer) 3 127.0.0.1:6379> lrange k1 0 -1 1) "v3" 2) "v2" 3) "v1" 127.0.0.1:6379>

lpop/rpop key 从左边/右边弹出一个值。 值在键在,值光键亡。。

rpoplpush key1 key2 从key1列表右边弹出一个值,插到 key2 列表左边

127.0.0.1:6379> lpush k1 v1 v2 v3 (integer) 3 127.0.0.1:6379> lrange k1 0 -1 1) "v3" 2) "v2" 3) "v1" 127.0.0.1:6379> lpush k2 va vb vc (integer) 3 127.0.0.1:6379> rpoplpush k1 k2 "v1" 127.0.0.1:6379> lrange k1 0 -1 1) "v3" 2) "v2" 127.0.0.1:6379> lrange k2 0 -1 1) "v1" 2) "vc" 3) "vb" 4) "va"

lrange key start stop 按照索引下标获得元素(从左到右 0左边第一个, -1右边第一个,( 0-1表示获取所有)

lindex key index 按照索引下标获得元素(从左到右)

llen key 获得列表长度。

linsert key before value newvalue在value的后面插入newvalue插入值

Irem key n value从左边删除n个value(从左到右。

lset key index value将列表key下标为index的值替换成value.

数据结构

List的数据结构为快速链表quickList。首先在列表玩素较少的情况下会使用一块连续的内存存储,这个结构是ziplist ,也即是压缩列表。

它将所有的元素紧挨着一起存储,分配的是一块连续的内存。当数据量比较多的时候才会改成quicklist。因为普通的链表需要的附加指针空间太大,会比较浪费空

间。比如这个列表里存的只是int类型的数据,结构上还需要两个额外的指针prev和next。

Set

简介

set对外提供的功能与list 类似是一个列表的功能,特殊之处在于set是可以自动排重的,当你需要存储一个列表数据 ,又不希望出现重腹数据时, set是一个很好的选

择,組set提供了判断某个成员否在一个set集合内的重要接口,这个也是list所不能提供的。Redis的Set是string类型的无序集合。它底层其实是一个value为null的

hash表,所以添加,删除,查找的复杂度都是0(1)。一个算法,随着数据的增加,执行时间的长短,如果是0(1) ,数据增加,查找数据的时间不变。

常用命令

sadd key value1 value2..... 将一个或多个mxmber元加入集合key中,已经存在的member元愫将被忽略''

smembers key取出该集合的所有值

sismember key value判断集合key是否为含有该value值,有1 , 没有0

scard key返回该集合的元素个数

srem key value1 value2 ...删除集合中的某个元素

spop key随机从该集合中吐出一一个值

srandmember key n随机从该集合中取出n个值。不会从集合中删除

127.0.0.1:6379> sadd sk1 s1 s2 s3 s4 s1 s4 (integer) 4 127.0.0.1:6379> smembers sk1 1) "s2" 2) "s3" 3) "s4" 4) "s1" 127.0.0.1:6379> sismember sk1 s4 (integer) 1 127.0.0.1:6379> sismember sk1 s7 (integer) 0 127.0.0.1:6379> scard sk1 (integer) 4 127.0.0.1:6379> srem sk1 s4 s1 (integer) 2 127.0.0.1:6379> smembers sk1 1) "s3" 2) "s2" 127.0.0.1:6379> sadd sk1 s7 s8 s9 (integer) 3 127.0.0.1:6379> spop sk1 2 1) "s9" 2) "s8" 127.0.0.1:6379> smembers sk1 1) "s7" 2) "s3" 3) "s2" 127.0.0.1:6379> srandmember sk1 2 1) "s3" 2) "s7" 127.0.0.1:6379>

smove source destination value把集合中一个值从一个集合移动到另一个集合

sinter key1 key2返回两个集合的交集元素

sunion key1 key2返回两个集合的并集元素

sdiff key1 key2返回两个集合的差集元素(key1中的,不包含key2中的)

数据结构

Set数据结构是dict典,典是用哈希表实现的。

Java中HashSet的内部实现使用的是HashMap ,只不过所有的value都指向同一个对象。Redis的set结构也是一样,它的内部也使用hash结构,所有的value都指向同

一个内部值

Hash

简介

Redis hash是一个键值对集合。

Redis hash 是一个string 类型的field和value的映射表, hash特别适合用于存储对象类似Java里面的Map<String.Object>用户ID为查找的key ,存储的value用户对象

包含姓名,年龄,生日等信息,如果用普通的key/value结构来存储。

常用指令

hset key field value给key集合中的field键赋值 value

hget key1 field 从key1集合field取出value

hmset key1 field1 value1 field2 value2... 批量设置hash的值

hexists key1 field查看哈希表key 中,给定域field 是否存在。

hkeys key列出该hash集合的所有field

hvals key列出该hash集合的所有value

hincrby key field increment为哈希表 key 中的域field 的值加上增量1 -1

hsetnx key field value将哈希表key 中的域field 的值设置为value, 当且仅当域field不存在.。

127.0.0.1:6379> hset hk1 id 1 name zhangsan age 18 (integer) 3 127.0.0.1:6379> hget hk1 age "18" 127.0.0.1:6379> hmset hk1 id 2 name lisi OK 127.0.0.1:6379> hvals hk1 1) "2" 2) "lisi" 3) "18" 127.0.0.1:6379> hincrby hk1 id 1 (integer) 3 127.0.0.1:6379> hvals hk1 1) "3" 2) "lisi" 3) "18" 127.0.0.1:6379> hincrby hk1 id -5 (integer) -2 127.0.0.1:6379> hvals hk1 1) "-2" 2) "lisi" 3) "18" 127.0.0.1:6379> hincrby hk1 id 6 (integer) 4 127.0.0.1:6379> hsetnx hk1 gender 1 (integer) 1 127.0.0.1:6379> hsetnx hk1 id 1 (integer) 0 127.0.0.1:6379> hvals hk1 1) "4" 2) "lisi" 3) "18" 4) "1"

数据结构

Hash类型对应的数据结构是两种: ziplist (压缩列表), hashtable (哈希表)。当field-value长度较短且个数较少时,使用ziplist, 否则使用hashtable.。

Zset

简介

Zset有序结合(stored set)

Redis有序集合zset与普通集合set非常相似,是一个没有重复元素的字符串集合。不同之处是有序集合的每个成员都关联了一个评分( score) ,这个评分( score )被

用来按照从最低分到最高分的方式排序集合中的成员。集合的成员是唯一的,但是评分可以是重复了。因为元素是有序的,所以你也可以很快的根据评分( score )或者

次序( position )来获取一个范围的元素。。访问有序集合的中间元素也是非常快的,因此你能够使用有序集合作为一个没有重复成员的智能列表。

常用指令

zadd key score1 value1 score2 value2...将一个或多个member元愫及其score值加入到有序集key当中

zrange key start stop [WITHSCORES] 。返回有集key中,下标在startstop 之间的元素带WITHSCORES ,可以让分数-起和值返回到结果集

zrangebyscore key minmax [withscores] [imit offset count]~返回有序集key中,所有score值介于min和max之间(包括等于min或max )的成员。有序集成员按score值递增(从小到大)次序排列

zrevrangebyscore key maxmin [withscores] [imit offset count] 同上,改为从大到小排列。

zincrby key ncrement value为元素的score加上增量

zrem key value删除该集合下,指定值的元素

zcount key min max统计该集合,分数区间内的元素个数

zrank key value返回该值在集合中的排名,从0开始

127.0.0.1:6379> zadd zk1 200 java 300 c++ 400 mysql 500 php (integer) 4 127.0.0.1:6379> zrange zk1 0 -1 withscores 1) "java" 2) "200" 3) "c++" 4) "300" 5) "mysql" 6) "400" 7) "php" 8) "500" 127.0.0.1:6379> zrangebyscore zk1 300 500 1) "c++" 2) "mysql" 3) "php" 127.0.0.1:6379> zrevrangebyscore zk1 500 200 withscores 1) "php" 2) "500" 3) "mysql" 4) "400" 5) "c++" 6) "300" 7) "java" 8) "200" 127.0.0.1:6379> zincrby zk1 50 java "250" 127.0.0.1:6379> zcount zk1 200 300 (integer) 2 127.0.0.1:6379> zrank zk1 java (integer) 0 127.0.0.1:6379> zrank zk1 c++ (integer) 1 127.0.0.1:6379> zrank zk1 mysql (integer) 2

数据结构

SortedSet (zset)是Redis提供的一个非常特别的数据结构,一万面它等价于Java的数据结构Map<String, Double> ,可以给每一个元素value赋予一个权重score ,另一

方面它又类似于TreeSet ,内部的元素会按照权重score进行排序,可以得到每个元素的名次,还可以通过score的范围来获取元素的列表

zset底层使用了两个数据结构。

(1)hash , hash的作用就是关联元素value和权重score保障元素value的唯一-性,可以通过元素value找到相应的score值

(2)跳跃表,跳跃表的目的在于给元素value排序,根据score的范围获取元愫列表

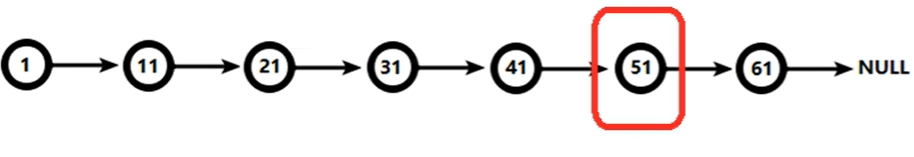

跳跃表

例如从1、11、21、31、41、51、61中寻找51

如图,

如何停止查找进入下一层?当遇到比51大的第一个数,立马到下一层。但是不会从头开始,而是从41(上一层第一个比51大的数的前一个)和61(上一层第一个比51大的数)开始查找。

配置文件

bind: 指定可以访问的ip,如bind 127.0.0.1,仅127.0.0.1可以访问

port: 端口号

backlog :设置tcp的backlog , backlog实是一个连接队列

backlog队列总和=未完成三三次握手队列+已经完成三次握手队列

在高并发环境下你需要一个高 backlog值来避免慢客户端连接问题。注意Linux内核会将这个值减小到/proc/sys/net/core/somaxconn的值(128) ,所以需要确认增大/proc/sys/net/core/somaxconn和/proc/sys/net/ipv4/tcp_ max_ syn _backlog (128)两个值来达到想要的效果。

timeout: 超时时间 连接了redis如果在设定的timeout(单位秒)内没有操作,需要重新连接,0表示永不超时

tcp-keepalive:心跳机制的每一次检测时间

daemonize:后台启动

pidfile:进程id存储位置

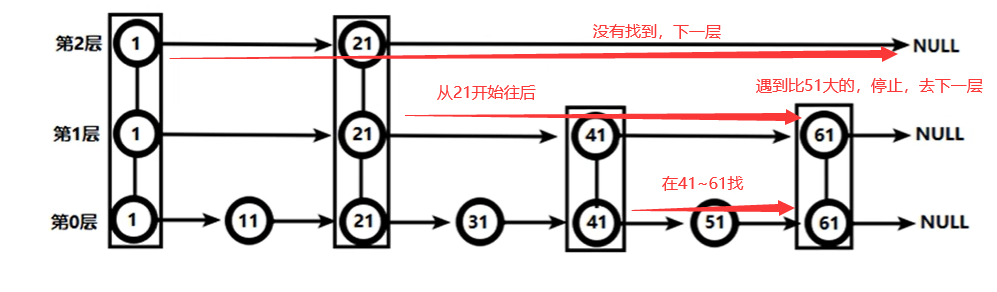

loglevel:日志级别,他有四个值

database:数据库数量,值是int类型的

设置密码:打开并设置密码

maxclients:设置redis同时可以与多少个客户端进行连接。默认情况下为10000个客户端。如果达到了此限制,redis 则会拒绝新的连接请求,组向这些连接请求方发出"max number of clients reached"以作回应

maxmory:建议必须设置,否则将内存占满,造成服务器宕机,设置redis可以使用的内存量。一旦到达内存使用上限, redis 将会试图移除内部数据,移除规则可以通过maxmemory-policy来指定

maxmemory-policy:

volatile-lru :使用LRU算法移除key ,只对设置了过期时间的键; (最近最少使用)

alkeys-lru:在所有集合key中,使用LRU算法移除key

volatile-random:在过期集合中移除随机的key ,只对设置了过期时间的键

allkeys-random:在所有集合key中,移除随机的keyu

volatile-tl:移除那些TTL值最小的key ,即那些最近要过期的keys

noeviction :不进行移除。针对写操作,只是返回错误信息。

maxmemory-samples:设置样本数量ILRU算法和最小ttl算法都并非是精确的算法,而是估算值,所以你可以设置样本的大小, redis 默认会检查这么多个key并选择其中LRU的那个。一般设置3到7的数字,数值越小样本越不准确,但性能消耗越小

rdbchecksum :yes/no 检查rbd文件完整性。在存储快照后,还可以让redis,使用CRC64算法来进行数据校验,但是这样做会增加大约10%的性能消耗,如果希望获取到最大的性能提升,可以关闭此功能,推荐yes.

stop-writes-on-bgsave-error: yes/no 当Redis无法写入磁盘的话,直接关掉Redis的写操作。推荐yes

rdbcompression:yes/no rdb是否压缩

dbfilename dump.rdb 默认输出文件名

dir ./ 输出文件到目录(./表示启动目录中生成rdb文件)

save:sec num 例如:save 20 10 表示如果在20秒内最少有10个key发生变化,则会触发持久化操作。RDB是整个内存的压缩过的Snapshot , RDB的数据结构,可以配置复合的快照触发条件,默认是1分钟内改了1万次,或5分钟内改了10次,或15分钟内改了1次。禁用不设置save指令,或者给save传入空字符串

发布与订阅

Redis发布订阅(pub/sub)是一种消息通信模式:发送者(pub) 发送消息,订阅者,(sub)接收消息。Redis客户端可以订阅任意数量的频道

命令行实现

1、创建两个redis客户端

2、subscribe channel...订阅频道

127.0.0.1:6379> subscribe c1 Reading messages... (press Ctrl-C to quit) 1) "subscribe" 2) "c1" 3) (integer) 1

3、publish channel message...另一个客户端 给对应频道发送消息

127.0.0.1:6379> publish c1 hello (integer) 1

此时另外一边收到消息

1) "message" 2) "c1" 3) "hello"

1是订阅者数量

Redis6新数据类型

Bitmaps

简介

现代计算机用二进制(位)作为信息的基础单位,1个字节等于8位,例如"abc",字符串是由3个字节组成,但实际在计算机存储时将其用二进制表示,"abc" 分别对应的ASCII码分别是97、98、 99 ,对应的二进制分别是01100001、01100010和01100011

合理地使用操作位能够有效地提高内存使用率和开发效率。Redis提供了Bitmaps这个“数据类型”可以实现对位的操作:

(1) Bitmaps本身不是一种数据类型, 实际上它就是字符串(key-value)但是它可以对字符串的位进行操作

(2) Bitmaps单独提供了一套命令,所以在Redis中使用Bitmaps和使用字符串的方法不太相同。可以把 Bitmaps想象成一个以位为单位的数组,数组的每个单元只能存储0和1,数组的下标在Bitmaps中叫做偏移量。

注意

很多应用的用户id以一个指定数字(例如10000 )开头,直接将用户id和Bitmaps的偏移量对应势必会造成一定的浪费,通常的做法是每次做setbit操作时将用户id减去这个指定数字。在第一次初始化Bitmaps时,假如偏移量非常大,那么整个初始化过程执行会比较慢,可能会造成Redis的阻塞

常用指令

setbit key offset value

getbit key offset

bitcount key [start end]

bitop operation destket key [key...]

(值为1的数量),bitop(复合操作,and、or、not、xor异或)

127.0.0.1:6379> setbit user 16 1 (integer) 0 127.0.0.1:6379> setbit user 1 1 (integer) 0 127.0.0.1:6379> setbit user 6 1 (integer) 0 127.0.0.1:6379> getbit user 5 (integer) 0 127.0.0.1:6379> getbit user 6 (integer) 1 127.0.0.1:6379> bitcount user (integer) 3

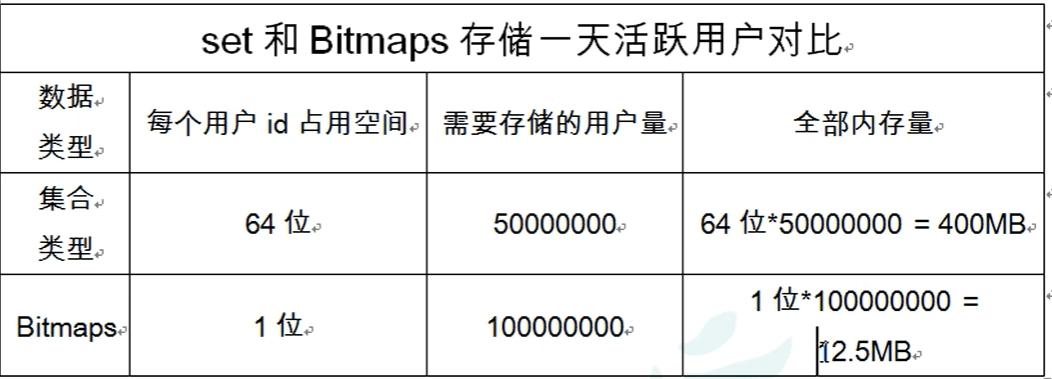

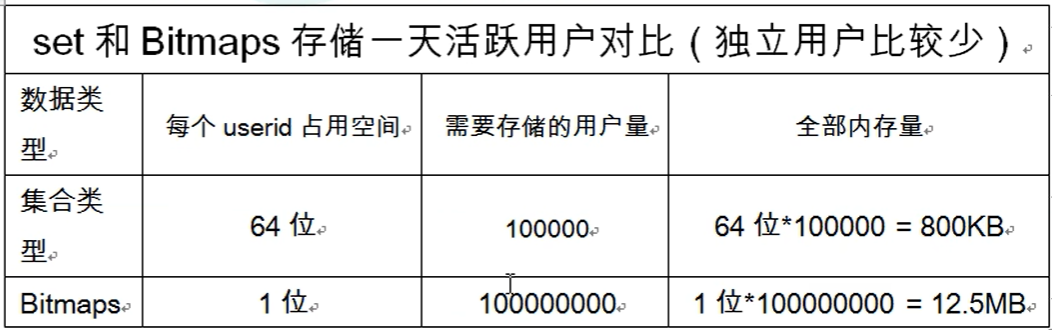

对比set和Bitmaps

HyperLogLog

简介

在工作当中,我们经常会遇到与统计相关的功能需求,比如统计网站PV( PageView页面访问量) ,可以使用Redis的incr. incrby 轻松实现。但像UV ( UniqueVisitor ,独立访客)、独立 IP数、搜索记录数等需要去重和计数的问题如何解决?这种求集合中不重复元素个数的问题称为基数问题。解决基数问题有很多种方案

( 1 )数据存储在MySQL表中,使用distinct count计算不重复个数

( 2 )使用Redis提供的hash、 set、 bitmaps等数据结构来处理

以上的方案结果精确,但随着数据不断增加,导致占用空间越来越大,对于非常大的数据集是不切实际的

能否能够降低-定的精度来平衡存储空间? Redis推出了HyperLogLogs

Redis HyperLogLog 用来做基数统计的算法, HyperLogLog的优点是,在输入元素的数量或者体积非常非常大时,计算基数所需的空间总是固定的、并且是很小

的。在Redis里面,每个HyperLogLog键只需要花费12 KB内存,就可以计算接近2^64个不同元素的基数。这和计算基数时,元素越 多耗费内存就越多的集合形成

鲜明对比。但是,因为HyperLogLog只会根据输入元素来计算基数,而不会储存输入元愫本身,所以HyperLogLog不能像集合那样,返回输入的各个元素

什么是基数?

比如数据集{1, 3,5, 7,5, 7, 8},那么这个数据集的基数集为{1, 3,5 ,7, 8},基数(不重复元素)为5。基数估计就是在误差可接受的范围内 ,快速计算基数

常见命令

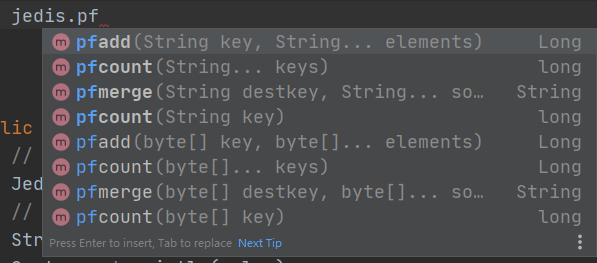

pfadd key element [element...]

pfcount key 获取个数

pfmerge destkey sourcekey [resourcekey...] 合并

127.0.0.1:6379> pfadd p1 "java" (integer) 1 127.0.0.1:6379> pfadd p1 "c++" (integer) 1 127.0.0.1:6379> pfadd p1 "php" (integer) 1 127.0.0.1:6379> pfadd p1 "php" "python" (integer) 1 127.0.0.1:6379> pfadd p1 "php" "python" (integer) 0 127.0.0.1:6379> pfadd p1 "oracle" "go" (integer) 1 127.0.0.1:6379> pfcount p1 (integer) 6 127.0.0.1:6379> pfadd p2 "html" "css" "javascript" "java" "php" (integer) 1 127.0.0.1:6379> pfmerge p1p2 p1 p2 OK 127.0.0.1:6379> pfcount p1p2 (integer) 9

Geospatial

简介

Redis 3.2 中增加了对GEO类型的支持。GEO , Geographic ,地理信息的缩写。该类型,就是元素的2维坐标,在地图上就是经纬度。redis基于该类型,提供了经纬

度设置,查询,范围查询,距离查询,经纬度Hash等常见操作

两极无法直接添加,一般会下载城市数据,直接通过Java程序一次性导入。 有效的经度从-180 度到180 度。有效的纬度从-85.05112878 度到85.05112878度。

当坐标位置超出指定范围时,该命令将会返回一个错误。已经添加的数据是无法再次往里面添加的

常见命令

geoadd key longitude latitude member[longitude latitude member...] 经度、纬度、名称

geopos key member [member...]

geodist key member1 member2 [m|km|ft|mi ]获取两个位置之间的直线距离单位:。m表示单位为米[默认值,,km表示单位为千米,mi表示单位为英里,ft表示单位为英尺,如果用户没有显式地指定单位参数,那么GEODIST默认使用米作为单位。

georadius key longitude latitude radius m|km|ft|mi 以给定的经纬度为中心 ,找出某一半径内的元素

127.0.0.1:6379> geoadd china:city 121.47 31.23 shanghai (integer) 1 127.0.0.1:6379> geoadd china:city 1.2 3.4 test1 12.11 32.22 test2 (integer) 2 127.0.0.1:6379> geopos china:city shanghai 1) 1) "121.47000163793563843" 2) "31.22999903975783553" 127.0.0.1:6379> geopos china:city test1 1) 1) "1.20000153779983521" 2) "3.40000018886306776" 127.0.0.1:6379> geodist china:city shanghai test2 km "9776.9289" 127.0.0.1:6379> georadius china:city 120 30.5 1000 km 1) "shanghai"

Jedis

安装与使用

新建maven工程,引入jedis依赖,新建JedisDemo01.class

public class JedisDemo01 { public static void main(String[] args) { // 测试前提: // 1、redis的配置文件注释掉bind 127.0.0.1 // 2、protect-mode 保护模式设置为no // 3、redis服务启动 // 4、关闭防火墙 // 创建Jedis对象 Jedis jedis = new Jedis("127.0.0.1", 6379); // 测试 String value = jedis.ping(); System.out.println(value);// PONG } }

查看防火墙状态指令

systemctl status firewalld

暂时关闭防火墙

systemctl stop firewalld

其他使用都是差不多的

Jedis jedis = new Jedis("127.0.0.1", 6379); // 设置key和value jedis.set("j01", "hi"); jedis.set("j02", "jedis"); // 设置过期时间 jedis.expire("j02", 20); // 从服务器获取所有键 Set<String> keys = jedis.keys("*"); keys.forEach(System.out::println); System.out.println(jedis.exists("k01", "key01")); System.out.println(jedis.ttl("key01")); System.out.println(jedis.get("j01"));

模拟手机验证码发送与验证

public class PhoneVerifyCodeDemo { public static void main(String[] args) { Scanner scanner = new Scanner(System.in); System.out.println("请输入手机号码"); String phone = scanner.nextLine(); // 如果可以获取到验证码 while (getVerifyCode(phone)){ // 读取用户输入的验证码 System.out.println("请输入验证码:"); String code = scanner.nextLine(); // 验证 如果通过则停止获取验证码 if (verify(phone, code)){ break; } } scanner.close(); } /** * 验证方法 * @param phone 手机号 * @param code 用户输入的验证码 */ public static boolean verify(String phone, String code){ // 连接redis Jedis jedis = new Jedis("127.0.0.1", 6379); // 验证码key String codeKey = "VerifyCode" + phone + ":code"; String redisCode = jedis.get(codeKey); // 判断 if (redisCode.equals(code)){ System.out.println("验证成功"); return true; }else{ System.out.println("验证失败"); return false; } } /** * 用户请求验证码 * @param phone 手机号 */ public static boolean getVerifyCode(String phone){ // 连接redis Jedis jedis = new Jedis("127.0.0.1", 6379); // 手机发送次数key String countKey = "VerifyCode" + phone + ":count"; // 验证码key String codeKey = "VerifyCode" + phone + ":code"; // 每个手机只能三次 String count = jedis.get(countKey); System.out.println("记录手机号次数的key:" + countKey + ",用户手机号之前已经请求了 " + count + " 次验证码"); if (count == null){ // 没有发送次数,第一次发送,设置值并设置过期时间 jedis.setex(countKey, 24*60*60, "1"); }else if (Integer.parseInt(count) <= 2){ // 发送次数加1 jedis.incr(countKey); }else if (Integer.parseInt(count) > 2){ // 已经发送三次,不能再发送了 System.out.println("验证码发送失败,24小时之内只能发送3次验证码,以达到发送上限!"); Long exp = jedis.ttl(countKey); System.out.println("在 " + exp + " 秒后,可在重新获取验证码"); jedis.close(); return false; } // 发送的验证码存到redis String vCode = getCode(); jedis.setex(codeKey, 300, vCode); System.out.println("记录手机号验证码的key:" + codeKey + ",本次请求的验证码是 " + vCode); jedis.close(); // 发送到用户手机... System.out.println("您的验证码为:" + vCode + ",验证码5分钟内有效"); return true; } /** * 生成验证码 * @return 6位验证码 */ public static String getCode(){ Random random = new Random(); StringBuilder buffer = new StringBuilder(); for (int i = 0; i < 6; i++) { buffer.append(random.nextInt(10));// 0-9 } return buffer.toString(); } }

SpringBoot整合Jedis

示例

创建springboot项目并引入依赖

<parent> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-starter-parent</artifactId> <version>2.7.7</version> <relativePath/> <!-- lookup parent from repository --> </parent> <dependency> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-starter-web</artifactId> </dependency> <dependency> <groupId>com.fasterxml.jackson.core</groupId> <artifactId>jackson-databind</artifactId> <version>2.14.1</version> </dependency> <!--redis--> <dependency> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-starter-data-redis</artifactId> </dependency>

配置文件

@EnableCaching // 开启缓存、redis操作 @Configuration public class RedisConfig extends CachingConfigurerSupport { @Bean public RedisTemplate<String, Object> redisTemplate(JedisConnectionFactory factory){ RedisTemplate<String, Object> template = new RedisTemplate<>(); StringRedisSerializer redisSerializer = new StringRedisSerializer(); Jackson2JsonRedisSerializer<Object> jackson2JsonRedisSerializer = new Jackson2JsonRedisSerializer<>(Object.class); ObjectMapper objectMapper = new ObjectMapper(); objectMapper.setVisibility(PropertyAccessor.ALL, JsonAutoDetect.Visibility.ANY); objectMapper.activateDefaultTyping(LaissezFaireSubTypeValidator.instance, ObjectMapper.DefaultTyping.NON_FINAL); jackson2JsonRedisSerializer.setObjectMapper(objectMapper); template.setConnectionFactory(factory); // key序列化方式 template.setKeySerializer(redisSerializer); // value序列化方式 template.setValueSerializer(jackson2JsonRedisSerializer); // value-hashmap序列化方式 template.setHashValueSerializer(jackson2JsonRedisSerializer); return template; } @Bean public CacheManager cacheManager(RedisConnectionFactory factory){ StringRedisSerializer redisSerializer = new StringRedisSerializer(); Jackson2JsonRedisSerializer<Object> jackson2JsonRedisSerializer = new Jackson2JsonRedisSerializer<>(Object.class); // 解决查询缓存转换异常的问题 ObjectMapper objectMapper = new ObjectMapper(); objectMapper.setVisibility(PropertyAccessor.ALL, JsonAutoDetect.Visibility.ANY); // objectMapper.enableDefaultTyping(ObjectMapper.DefaultTyping.NON_FINAL); // 过时的 objectMapper.activateDefaultTyping(LaissezFaireSubTypeValidator.instance, ObjectMapper.DefaultTyping.NON_FINAL); jackson2JsonRedisSerializer.setObjectMapper(objectMapper); // 配置序列化 解决乱码问题,过期时间600秒 RedisCacheConfiguration config = RedisCacheConfiguration.defaultCacheConfig() .entryTtl(Duration.ofSeconds(600)) .serializeKeysWith(RedisSerializationContext.SerializationPair.fromSerializer(redisSerializer)) .serializeValuesWith(RedisSerializationContext.SerializationPair.fromSerializer(jackson2JsonRedisSerializer)) .disableCachingNullValues(); RedisCacheManager cacheManager = RedisCacheManager.builder(factory) .cacheDefaults(config) .build(); return cacheManager; } }

创建RedisTestController

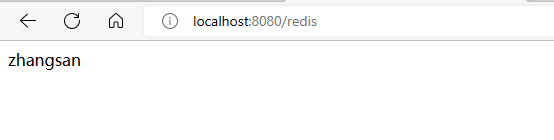

@RestController @RequestMapping("/redis") public class RedisTestController { @Resource private RedisTemplate<String, Object> redisTemplate; @GetMapping public String testRedis(){ // 设置值到redis redisTemplate.opsForValue().set("name", "zhangsan"); // 从redis获取值 String name = (String)redisTemplate.opsForValue().get("name"); return name; } }

访问 http://localhost:8080/redis

注意

上面的示例使用的是redis for windows,安装与使用详见 SpringSecurity 学习记录 的 安装Redis for windows

事务和锁

简介

Redis事务是一个单独的隔离操作:事务中的所有命令都会序列化、按顺序地执行。事务在执行的过程中,不会被其他客户端发送来的命令请求所打断。Redis事务的主要作用就是串联多个命令防止别的命令插队

三个特性

Redis事务三特性

单独的隔离操作 :事务中的所有命令都会序列化、按顺序地执行。事务在执行的过程中,不会被其他客户端发送来的命令请求所打断

没有隔离级别的概念 :队列中的命令没有提交之前都不会实际被执行,因为事务提交前任何指令都

不会被实际执行:不保证原子性 ,事务中如果有一 条命令执行失败 ,其后的命令仍然会被执行,没有回滚。

基本操作

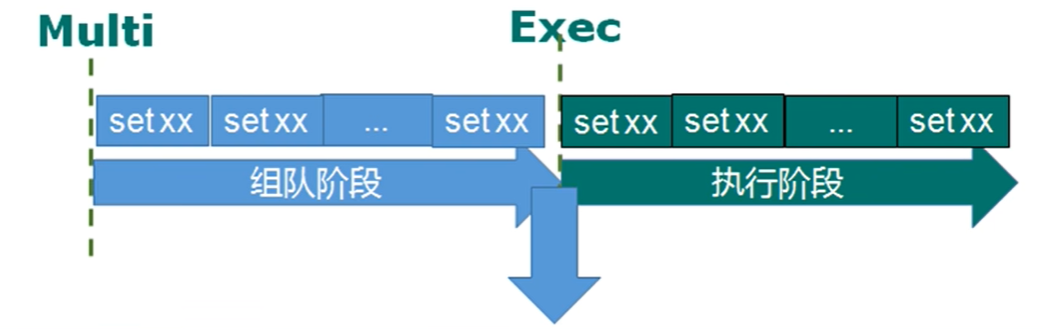

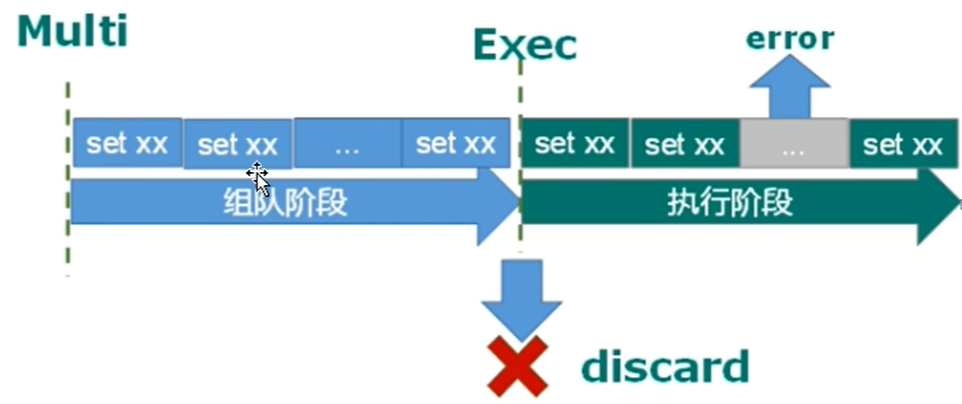

Multi、Exec、discard

可以理解为:进入队伍、执行、退出队伍,退出队伍是在执行之前,如命令有错需要从队伍退出

从输入Multi命令开始,输入的命令都会依次进入命令队列中,但不会执行,直到输入Exec后, Redis会将之前的命令队列中的命令依次执行。组队的过程中可以通过discard来放弃组队

使用

217.0.0.1:6379>multi OK 217.0.0.1:6379>set key1 value1 QUEUED 127.0.0.1:6379>set key2 value2 QUEUED 127.0.0.1:6379>exec 1) OK 2) OK

217.0.0.1:6379>multi OK 217.0.0.1:6379>set key1 value1 QUEUED 127.0.0.1:6379>set key2 value2 QUEUED 127.0.0.1:6379>discard 1) OK

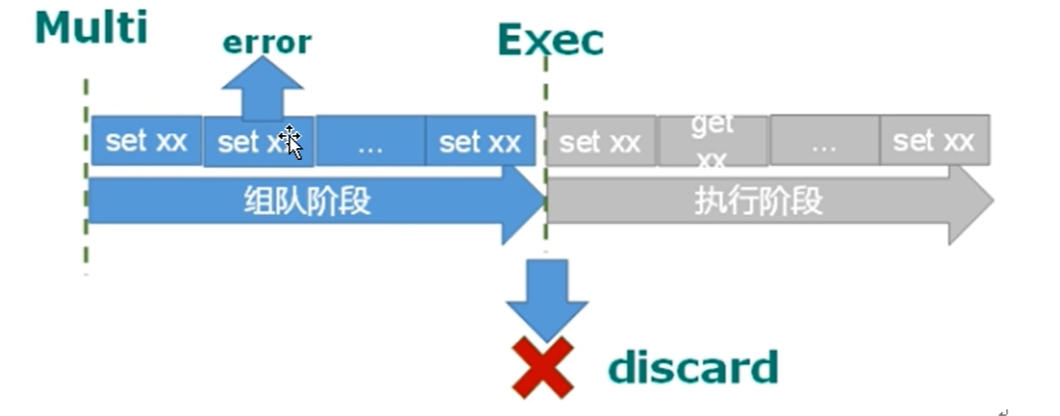

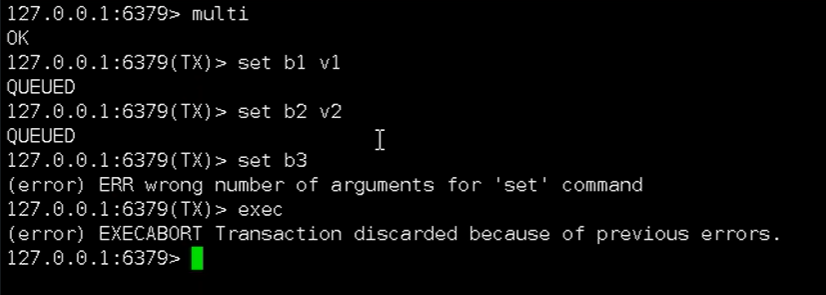

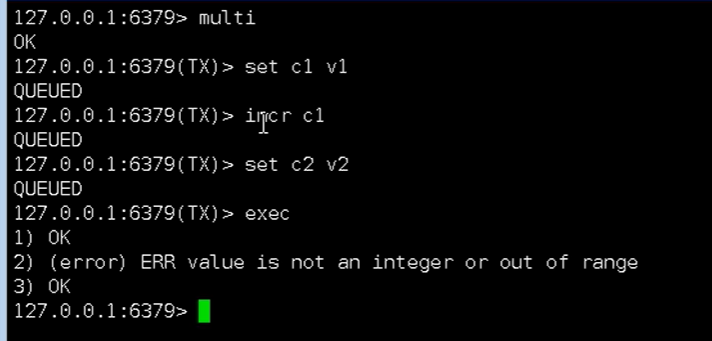

事务错误处理

组队中某个命令出现了报告错误,执行时整个的所有队列都会被取消

两种情况,分别在组队和执行阶段出现错误的处理情况

组队阶段出现异常,整个队列退出组队,无法到达执行阶段

执行阶段出现异常,仅错误命令没有成功,其他命令正常执行

示例1 组队阶段错误

示例2 执行阶段错误

悲观锁和乐观锁

悲观锁:

悲观锁(Pessimistic Lock), 顾名思义,就是很悲观,每次去拿数据的时候都认为别人会修改,所以每次在拿数据的时候都会上锁,这样别人想拿这个数据就会block直到它拿到锁。传统的关系型数据库里边就用到了很多这种锁机制, 比如行锁,表锁等,读锁,写锁等,都是在做操作之前先上锁

乐观锁:

乐观锁(Optimistic Lock), 顾名思义,就是很乐观,每次去拿数据的时候都认为别人不会修改,所以不会上锁,但是在更新的时候会判断一下在此期间别人有没有去更新这个数据,可以使用版本号等机制。乐观锁适用于多读的应用类型,这样可以提高吞吐量。Redis 就是利用这种check-and-set机制实现事务的

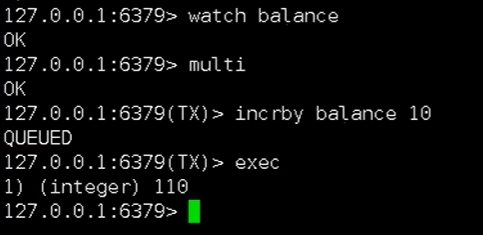

watch 命令

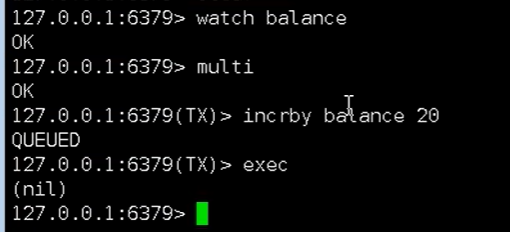

在执行multi之前,先执行watch key1 [key2...]可以监视一个(或多个) key , 如果在事務执行之前这个(或这些) key被某他命令所改动,那么事务将被打断。

unwatch 命令

取消WATCH命令对所有key的监视,如果在执行WATCH命令之后, EXEC命令或DISCARD令先被执行了的话, 那么就不需要再执行UNWATCH了

示例

balance初始值为100

客户端1

客户端2

模拟商品秒杀

@Service public class SeckillService { @Resource private RedisTemplate<String, Object> redisTemplate; public String doSeckill(String uid, String prodId){ // 1.用户id和商品id都不能为空 if (!StringUtils.hasLength(uid) || !StringUtils.hasLength(prodId)){ return "缺少参数"; } // 2.拼接key // 2.1 库存key String stockKey = "sk:" + prodId + ":qt"; // 2.2 秒杀成功 用户key String userKey = "sk:" + uid + ":user"; // 3 库存如果为null,秒杀还没有开始 Object stock = redisTemplate.opsForValue().get(stockKey); if (ObjectUtils.isEmpty(stock)){ return "秒杀还未开始,请等待..."; } // 4 用户是否重复秒杀 Boolean member = redisTemplate.opsForSet().isMember(userKey, uid); if (member != null && member){ return "已经秒杀成功了,不能重复秒杀"; } // 5 商品库存数量小于1,秒杀结束 if (Integer.parseInt(stock.toString()) <= 0){ return "秒杀已经结束"; } // 6 秒杀过程 // 6.1 库存-1 redisTemplate.opsForValue().decrement(stockKey); // 6.2 秒杀成功,将用户加入清单 redisTemplate.opsForSet().add(userKey, uid); return "秒杀成功"; } }

@RestController @RequestMapping("/seckill") public class SeckillController { @Resource private SeckillService seckillService; @GetMapping public String seckill(@RequestParam("uid") String uid, @RequestParam("pid") String prodId){ return seckillService.doSeckill(uid, prodId); } }

测试:

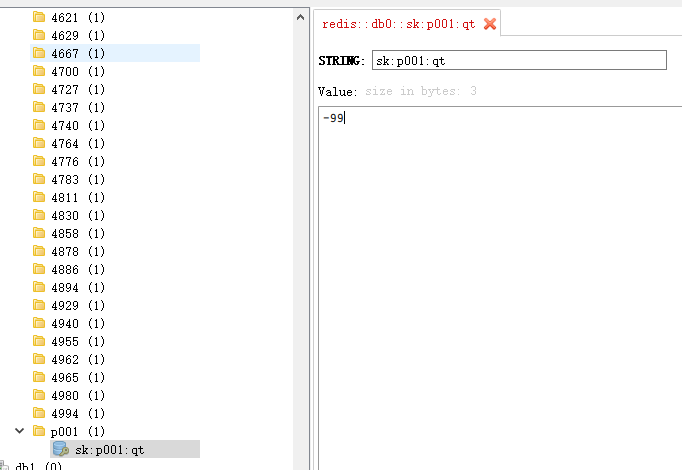

1)redis数据库中没有数据

2)redis中有数据:

key => sk:p001:qt

value => 2

模拟并发

使用Apache ab进行测试

服务器安装ab测试工具

yum install httpd-tools

ab --help

ab: wrong number of arguments Usage: ab [options] [http[s]://]hostname[:port]/path Options are: -n requests Number of requests to perform/要执行的请求数 -c concurrency Number of multiple requests to make at a time/一次发出的多个请求数(并发次数) -t timelimit Seconds to max. to spend on benchmarking/用于基准测试的秒数上限 This implies -n 50000/这意味着-n 50000 -s timeout Seconds to max. wait for each response/等待每个响应的最长秒数 Default is 30 seconds -b windowsize Size of TCP send/receive buffer, in bytes/TCP发送/接收缓冲区的大小(字节) -B address Address to bind to when making outgoing connections/进行传出连接时要绑定到的地址 -p postfile File containing data to POST. Remember also to set -T/包含POST数据的文件。还记得设置-T -u putfile File containing data to PUT. Remember also to set -T/包含要PUT的数据的文件。还记得设置-T -T content-type Content-type header to use for POST/PUT data, eg./用于POST/PUT数据的内容类型头,例如 'application/x-www-form-urlencoded' Default is 'text/plain' -v verbosity How much troubleshooting info to print/要打印多少疑难解答信息 -w Print out results in HTML tables/在HTML表格中打印结果 -i Use HEAD instead of GET/使用HEAD而不是GET -x attributes String to insert as table attributes/要作为表属性插入的字符串 -y attributes String to insert as tr attributes/要作为tr属性插入的字符串 -z attributes String to insert as td or th attributes/作为td或th属性插入的字符串 -C attribute Add cookie, eg. 'Apache=1234'. (repeatable)/添加cookie,例如“Apache=1234”。(可重复) -H attribute Add Arbitrary header line, eg. 'Accept-Encoding: gzip'/添加任意标题行,例如“Accept Encoding:gzip” Inserted after all normal header lines. (repeatable)/在所有正常标题行之后插入。(可重复) -A attribute Add Basic WWW Authentication, the attributes/添加基本WWW身份验证,属性是冒号分隔的用户名和密码。 are a colon separated username and password. -P attribute Add Basic Proxy Authentication, the attributes/添加基本代理身份验证,属性是冒号分隔的用户名和密码。 are a colon separated username and password. -X proxy:port Proxyserver and port number to use/要使用的代理服务器和端口号 -V Print version number and exit/打印版本号并退出 -k Use HTTP KeepAlive feature/使用HTTP KeepAlive功能 -d Do not show percentiles served table./不显示服务百分比表。 -S Do not show confidence estimators and warnings./不要显示置信估计和警告。 -q Do not show progress when doing more than 150 requests/执行超过150个请求时不显示进度 -g filename Output collected data to gnuplot format file./将收集的数据输出到gnuplot格式文件。 -e filename Output CSV file with percentages served/输出CSV文件,提供百分比 -r Don't exit on socket receive errors./不要在socket接收错误时退出。 -h Display usage information (this message)/显示使用信息(此消息) -Z ciphersuite Specify SSL/TLS cipher suite (See openssl ciphers)/指定SSL/TLS密码套件(请参阅openssl密码) -f protocol Specify SSL/TLS protocol/指定SSL/TLS协议 (SSL3, TLS1, TLS1.1, TLS1.2 or ALL)

MyConfig

@Configuration public class MyConfig { @Bean public Random random(){ return new Random(); } }

SeckillController

@Resource private Random random; @PostMapping public String concurrency(@RequestBody Map<String,String> map){ String uid = String.valueOf(random.nextInt(4000) + 1000); String pid = map.get("pid"); return seckillService.doSeckill(uid, pid); }

创建请求文件postfile

vi postfile

键入

pid=p001&

esc + :wq保存

执行命令

ab -n 1000 -c 100 -p ~/postfile -T application/json http://192.168.0.101:8080/seckill

使用Apache JMeter进行测试

安装JMeter 👉 Apache JMeter - Download Apache JMeter

添加JMETER_HOME 为JMeter解压后的目录,例:E:\jemter\apache-jmeter-5.5

CLASSPATH添加;%JMETER_HOME%\lib\ext\ApacheJMeter_core.jar;%JMETER_HOME%\lib\jorphan.jar;%JMETER_HOME%\lib\logkit-2.0.jar

运行bin下的jmeter.bat即可打开UI界面

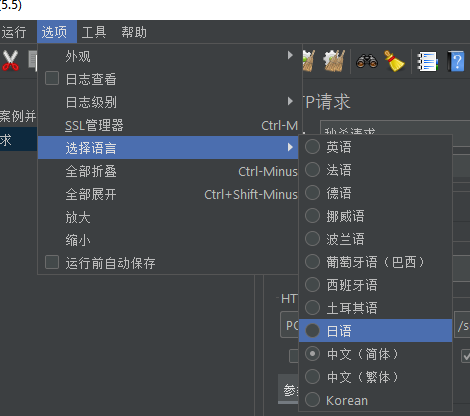

如需设置中文字体,修改properties的language=zh_CN或者

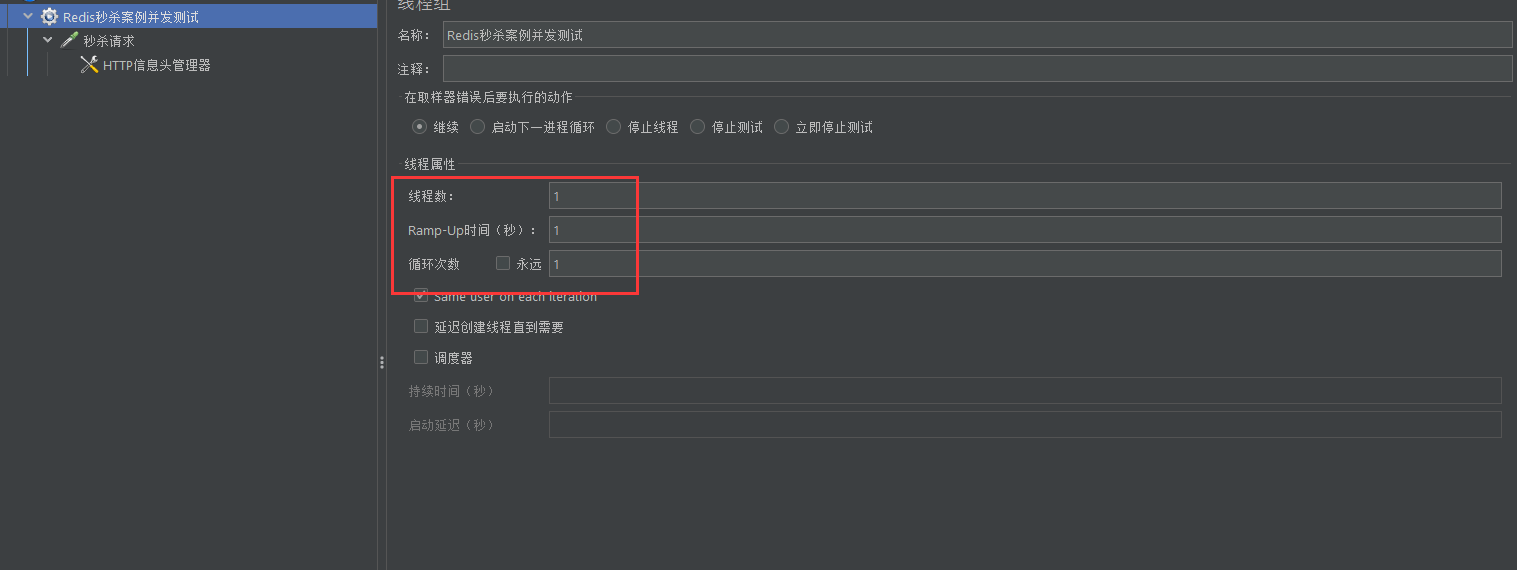

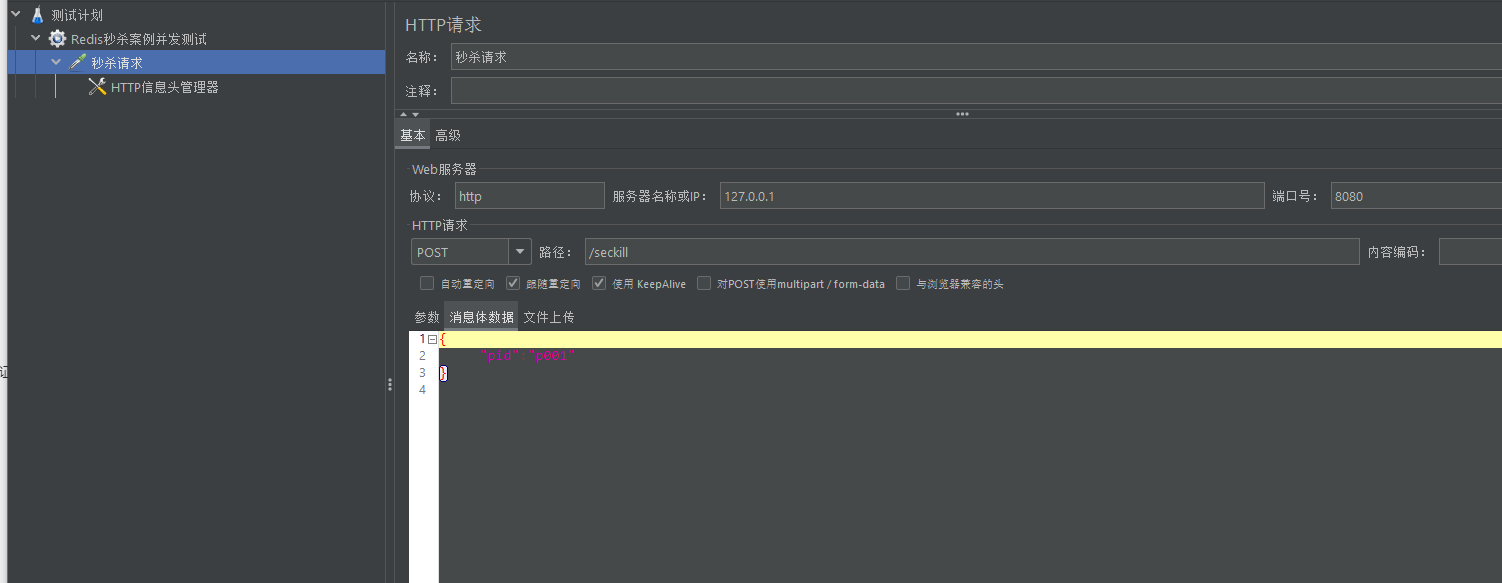

右键测试计划 -> 添加 -> 线程 -> 线程组

邮件线程组 -> 添加 -> 取样器 -> HTTP请求

邮件HTTP请求 -> 添加 -> 配置元件 -> HTTP信息头管理器

先测试一次看看有没有问题,没问题在执行并发测试

没有问题线程数什么的改一改就好了

执行测试后,redis缓存中库存成了-99,也就是说超卖了99件

Redis加锁解决超卖问题

redisson依赖

<dependency> <groupId>org.redisson</groupId> <artifactId>redisson-spring-boot-starter</artifactId> <version>3.12.3</version> </dependency>

无遗留与超卖问题

@Service public class SeckillService { @Resource private RedissonClient redissonClient; @Resource private RedisTemplate<String, Object> redisTemplate; public String doSeckill(String uid, String prodId) { // 1.用户id和商品id都不能为空 if (!StringUtils.hasLength(uid) || !StringUtils.hasLength(prodId)) { return "缺少参数"; } // 2.拼接key // 2.1 库存key String stockKey = "sk:" + prodId + ":qt"; // 2.2 秒杀成功 用户key String userKey = "sk:" + uid + ":user"; RLock rLock = redissonClient.getLock("prod"); try{ // 加锁 rLock.lock(); Object stock = redisTemplate.opsForValue().get(stockKey); // 3 库存如果为null,秒杀还没有开始 if (ObjectUtils.isEmpty(stock)){ System.out.println("秒杀还未开始,请等待..."); return "秒杀还未开始,请等待..."; } // 4 用户是否重复秒杀 Boolean member = redisTemplate.opsForSet().isMember(userKey, uid); if (member != null && member){ System.out.println("已经秒杀成功了,不能重复秒杀"); return "已经秒杀成功了,不能重复秒杀"; } // 5 商品库存数量小于1,秒杀结束 if (Integer.parseInt(stock.toString()) <= 0){ System.out.println("秒杀已经结束"); return "秒杀已经结束"; } // 6 秒杀过程 // 6.1 库存-1 redisTemplate.opsForValue().decrement(stockKey); // 6.2 秒杀成功,将用户加入清单 redisTemplate.opsForSet().add(userKey, uid); }finally { rLock.unlock(); } System.out.println("秒杀成功"); return "秒杀成功"; } }

执行测试,结果如下

ERR EXEC without MULTI

如果使用

操作需要在execute里面执行

List<Object> results = redisTemplate.execute(new SessionCallback<List<Object>>() { @Override public <K, V> List<Object> execute(RedisOperations<K, V> operations) throws DataAccessException { redisTemplate.watch(...); redisTemplate.multi(); redisTemplate.opsForValue().decrement(...); redisTemplate.opsForSet().add(...); return redisTemplate.exec(); } }); if(results == null || results.size()){ // 执行事务失败... }

持久化操作

RDB

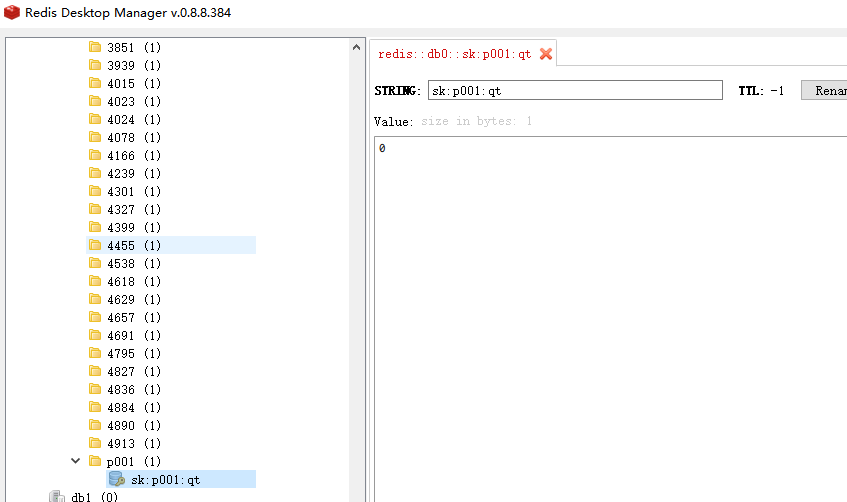

在指定的时间间隔内将内存中的数据集快照写入磁盘,也就是行话讲的Snapshot快照,它恢复时是将快照文件直接读到内存里

Redis会单独创建( fork)-个子进程来进行持久化,会先将数据写入到一个临时文件中,待持久化过程都结束了,再用这个临时文件替换上次持久化好的文件。整个过程

中,主进程是不进行任何IO操作的,这就确保了极高的性能如果需要进行大规模数据的恢复,且对于数据恢复的完整性不是非常敏感,那RDB方式要比AOF方式更加的高效。RDB的缺点是最后一-次持久化后的数据可能丢失。

优势

适合大规模的数据恢复

对数据完整性和一致性要求不高更适合使用

节省磁盘空间

恢复速度快

劣势

Fork的时候,内存中的数据被克隆了- -份,大致2倍的膨胀性需要考虑

虽然Redis在fork时使用了写时拷贝技术,但是如果数据庞大时还是比较消耗性能。

在备份周期在一定间隔时间做一-次备 份,所以如果Redis意外down掉的话,就会丢失最后一次快照后的所有修改。

Fork

Fork的作用是复制一个与当前进程一样的进程。 新进程的所有数据(变量、环境变量、程序计数器等)数值都和原进程一致,但是是一个全新的进程,并作为原进程的子进程

在Linux程序中, fork0会产生一个 和父进程完全相同的子进程,但子进程在此后多会exee系统调用,出于效率考虑, Linux中引入了”写时复制技术“

一般情况父进程和子进程会共用同一段物理内存,只有进程空间的各段的内容要发生变化时,才会将父进程的内容复制份给子进程。

dump.rdb

在redis.conf中配置文件名称,默认为dump.rdb

更多关于持久化配置信息请前往”配置文件“部分

命令

save : save时只管保存,其它不管,全部阻塞。手动保存。不建议。

bgsave : Redlis 会在后台异步进行快照操作,快照同时还可以响应客户端请求。

可以通过lastsave命令获取最后一次成功执行快照的时间

动态停止RDB

redis-cli config set save ""

save后给空值,表示禁用保存策略

RDB备份与恢复

先通过config get dir查询rdb文件的目录

将* .rdb的文件拷贝到别的地方

rdb的恢复,再服务器重新启动时,redis会去加载dump.rdb文件

AOF

简介

Append Only File

以日志的形式来记录每个写操作(增量保存) , 将Redis执行过的所有写指令记录下来(读操作不记录),只许追加文件但不可以改写文件, redis启动之初会读取该文件重新构建数据,换言訖, redis重動的话就根据日志文件的内容将写指令从前到后执行一次以完成数据的恢复工作

可以在redis.conf中配置文件名称,默认为appendonly.aofs,AOF文件的保存路径,同RDB的路径一致。

AOF默认不开启

AOF和RDB同时开启,統默认取AOF的数据(数据不会存在失)

流程

(1) 客户端的请求写命令会被append追加到AOF缓冲区内

(2) AOF缓冲区根据AOF持款化策略[always,everysec,no]将操作sync步到磁盘的AOF文件中

(3 ) AOF文件大小超过重写策略或手动重写时,会对AOF文件rewrite重写,压缩AOF文件容量

(4) Redis服务重启时,会重新load加载AOF文件中的写操作达到数据恢复的目的

AOF启动、修复、恢复

AOF的备份机制和性能虽然和RDB不同,但是备份和恢复的操作同RDB一样,都是拷贝备份文件,需要恢复时再拷贝到Redis工作目录下,启动系统即加载

正常恢复.

修改默认的appendonly no ,改为yes.

将有数据的aof文件复制一份保存到对应目录(查看目录: config get dir)

恢复:重启redis然后重新加载

异常恢复

修改默认的appendonly no,改为yesy

如遇到AOF文件损坏,通过/usr/local/bin/redis-check-aof--fix appendonly.aof进行恢复

备份被写坏的AOF文件

恢复:重启redis ,然后重新加载

同步频率

appendfsync always:始终同步,每次Redis的写入都会立刻记入日志;性能较差但数据完整性比较好

appendfsync everysec:每秒同步,每秒记入日志一次,如果宕机,本秒的数据可能丢失

appendfsync no:redis不主动进行同步, 把同步时机交给操作系统。

rewrite压缩

简介

AOF采用文件追加方式,文件会越来越大为避免出现此种情况,新增了重写机制,当AOF文件的大小超过所设定的阈值时, Redis 就会启动AOF文件的内容压缩,只保留可以恢复数据的最小指令集.可以使用命令bgrewriteaof

原理

AOF文件持续增长而过大时,会fork出一条新进程来将文件重写(也是先写临时文件最后再rename) , redis4.0版本后的重写,是指上就是把rdb的快照,以二级制的形式附在新的aof头部,作为已有的历史数据,替换掉原来的流水账操作

no-appendfsync-on-rewrite

如果no-appendfsync-on-rewrite=yes写入aof文件只写入缓存,用户请求不会阻塞,但是在这段时间如果宕机会丢失这段时间的缓存数据。( 降低数据安全性,提高性能)。

触发机制,何时重写。

Redis会记录上次重写时的AOF小,默认配置是当AOF文件大小是上次rewrite后大小的一倍且文件大于64M时触发

重写虽然可以节约大量磁盘空间,减少恢复时间。但是每次重写还是有-定的负担的因此设定Redis要满足一定条件才会进行重写

auto-aof-rewrite-percentage :设置重写的基准值,文件达到100%时开始重写(文件是原来重写后文件的2倍时触发)

auto-aof-rewrite-min-size :设置重写的基准值,最小文件64MB.达到这个值开始重写

例如:文件达到70MB开始重写,降到50MB,下次什么时候开始重写? 100MB.系统载入时或者上次重写完毕时, Redis会记录此时AOF大小,设为base_ size,如果Redis的AOF当前大小>= base_ size +base _size* 100% (默认)且当前大小>=64mb(默认)的情况下, Redis会对AOF进行重写。

流程

(1) bgrewriteaof触发重写,判断是否当前有bgsave或bgrewriteaof在运行,如果有,则等待该命令结束后再继续执行

(2 )主进程fork出籽进程执行重写操作,保证主进程不会阻塞

(3 )子进程遍历redis内存中数据到临时文件,客户端的写请求同时写入aof_ buf缓冲区和aof_ rewrite_ buf 重写缓冲区保证原AOF文件完整以及新AOF文件生成期间的新的数据修改动作不会丢失

(4) 1).子进程写完新的AOF文件后,向主进程发信号,父进程更新统计信息。2).主进程把aof_ rewrite_ _buf 中的数据写入到新的AOF文件

(5)使用新的AOF文件覆盖旧的AOF文件,完成AOF重写。。

优势

备份机制更稳健,丢失数据概率更低

可读的日志文本,通过操作AOF稳健,可以处理误操作。

劣势

比起RDB更多的磁盘空间

恢复备份速度要慢

每次读写都同步的话,有-定的性能压力

存在个别Bug ,造成恢复不能

总结

官方推荐两个都启用

如果对数据不敏感,可以选单独用RDB

不建议单独用AOF ,因可能会出现Bug

如果只是做纯内存缓存,可以都不用

RDB持执化方式能够在指定的时间间隔能对你的数据进行快照存储

AOF持久化方式记录每次对服务器写的操作,当服务器重启的时候会重新执行这些

命令来恢复原始的数据,A0F命令以redis协议追加保存每次写的操作到文件末尾.

Redis还能对AOF文件进行后台重写,使得AOF文件的体积不至于过大

只做缓存:如果你只希望你的数据在服务器运行的时候存在,你也可以不使用任何揿化方式

同时开启两种持久化方式

在这种情况下,当redis重启的时候会优先载入AOF文件来恢复原始的数据,因为在通常情况下AOF文件保存的数据集要比RDB文件保存的数据集要完整.

RDB的数据不实时,同时使用两者时服务器重启也只会找AOF文件。那要不要只使用AOF呢?

建议不要,因为RDB更适给盱备份数据库(AOF在不断变化不备份),快速重启,且不会有AOF可能潜在的bug ,留着作伪一个万- -的手段

性能建议

因为RDB文件只用作后备用途,建议只在Slave.上持久化RDB文件,而且只要15分钟备份一次就够了,只保留save 900 1这条规则

如果使用AOF ,好处是在最恶劣情况下也只会丢失不超过两秒数据,启动脚本较简单只load自己的AOF文件就可以了

代价,一是带来了持续的I0 ,二是AOF rewrite的最后将rewrite过程中产生的新数据,写到新文件造成的阻塞几乎是不可避免的。

只要硬盘许可,应该尽量减少AOF rewrite的频率, AOF重写的基础大小默认值64M太小了;可以设到5G以上

默认超过原大小100%大小时重写可以改到适当的数值

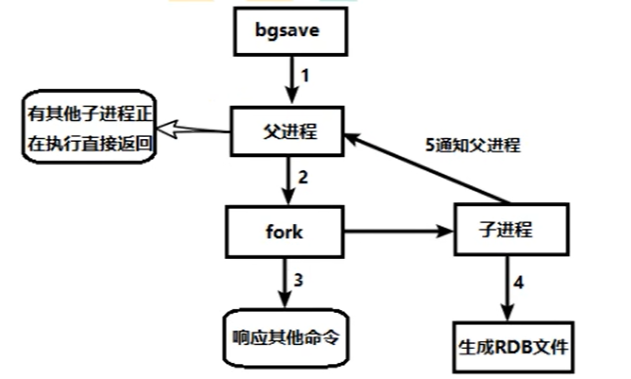

主从复制

简介

主机数据更新后根据配置和策略,自动同步 到备机的masten/slaver机制, Master以写为主, Slaver以读为主。

读写分离,性能扩展

容灾快速恢复

一主多从

步骤

1、创建/myredis文件夹

2、复制redis.conf配置 文件到文件夹中

3、配置-主两从,创建三个配置文件

redis6379.conf

redis6380.conf

redis6381.conf

4、在三个配置文件写入内容

include /myredisfredis.conf

pidfile {var/run/redis_ 63xx.pid

port 63xx

dbfilename dump63xx.rdb

slave-priority 10 设置从机的优先级,值越小,优先级越高,用于选举主机时使用。默认100

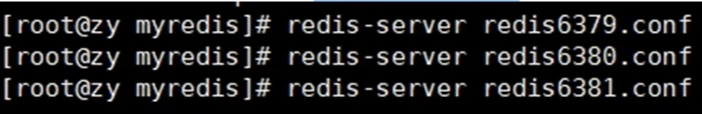

5、启动三台redis服务器

redis-cli -p 6379

info replication

打印主从复制的相关信息

6、slaveof ip port 成为某个实例的从服务器。在6380和6381. 上执行: slaveof 127.0.0.1 6379.

从服务器只能读数据,

说明

从机重新启动不会成为从机,需要手动slaveof ,slaveof 之后数据就会同步

主机down了,其他从机的主机还是down掉的,主机重新上线后,主机的从机还是从机

如果B从于A,C从于B,当主机A更新数据时,向从机发同步消息,B也向从机发送同步消息...如果Bdown了,C、D不能同步

如果A主机down掉,B执行slaveof no one命令,成为主机。

原理

1、当从连接上主服务器之后,从服务器向主服务发送进行数据同步消息

2、主服务器接到从服务器发送过来同步消息,把主服务器数据进行款化,rdb文件,把rdb文件发送从服务器,从服务器拿到rdb进行读取

3、每次主服务器进行写操作之后,和从服务器进行数据同步

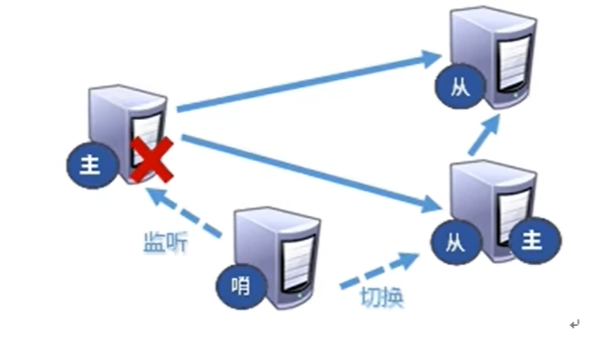

哨兵模式

哨兵模式:不需要手动slaveof no one,能够后台监控主机是否故障,如果故障了根据投票数自动将从库转换为主库、

自定义的/myredis目录下新建sentinel.conf文件

配置哨兵:sentinel monitor mymaster 127.0.0.1 6379 1,其中mymaster为监控对象起的服务器名称,1 为至少有多少个哨兵同意迁移的数量

启动哨兵: /usr/local/bin. redis做压测可以用自带的redis-benchmark工具

执行redis-sentinel /myredis/sentinel.conf

当主机挂掉,从机选举中产生新的主机

大概10秒左右可以看到哨兵窗口日志,切换了新的主机,哪个从机会被选举为主机呢?根据优先级别: slave-priority原主机重启后会变为从机

选取新主机规则:

从下线的主服务的所有从服务里面挑选一个从服务,将其转成主服务选择条件依次为:

1、选择优先级靠前的

2、选择偏移量最大的

3。选择runid最小的从服务

挑选出新的主服务之后sentinel向原主服务的从服务发送slaveof新主服务的命令,复制新master

当已下线的服务重新上线时sentinel会向其发送slaveof命令,让其成为新主机的从机

优先级在redis.conf中默认: slave-priority 100 ,值越小优先级越高

偏移量是指获得原主机数据最全的。每个redis实例启动后都会随机生成一个40位的runid

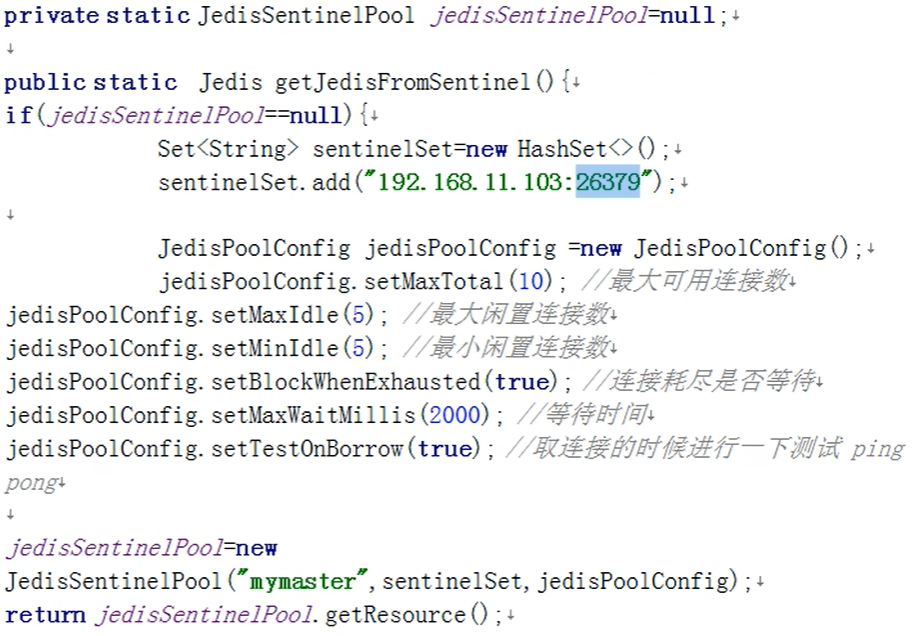

jedis哨兵代码参考

集群

容量不够, redis如何进行扩容?并发写操作,redis 如何分摊?

另外,主从模式,薪火相传模式,主机宕机,导致ip地址发生变化,应用程序中配置需要修改对应的主机地址、端口等信息之前通过代理主机来解决,但是redis3.0 中提供了解决方案。就是无中心化集群配置

什么是集群

Redis集群实现了对Redis的水平扩容,即启动N个redis节点,将整个数据库分布存储在这N个节点中,每个节点存储总数据的1/N。

Redis集群通过分区( partition )来提供-定程度的可用性( availbllity ) :即使集群有一部分节点失效或者无法进行通讯,集群也可以继续处理命令请求

删除持久化数据:将rdb,aof文件都删除掉

步骤

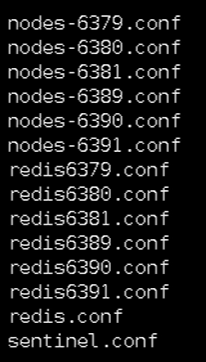

1、创建6个实例:6379、6380、6381、6389、6390、6391

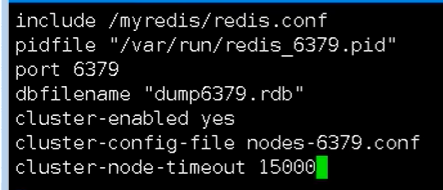

2、配置文件

开启 daemonize yes

Pid 文件名字

指定端口

Log文件名字

Dump.rdb名字

Appendonly关掉或者换名字

3、redis cluster 配置修改

cluster-enabled yes 打开集群模式

cluster-config-file nodes-6379.conf 设定节点配置文件名

cluster-node-timeout 15000 设淀节点失联时间,超过该时间(毫秒),集群自动进行主从切换

其他几个可以使用:%s/6379/6380命令替换内容

4、启动所有实例,查看nodes-端口号.conf是否都正常生成,使用ll命令查看

5、合体

cd /opt/redis-6.2.1/src(去到安装的redis的src目录下)

执行命令

redis-cli --cluster create --cluster-replicas 1 IP:6379 IP:6380 IP:6381 IP:6389 IP:6390 IP:6391 # ip是你的实际ip地址,不用127.0.0.1

--replicas

分配原则尽量保证每个主数据库运行在不同的IP地址,每个从库和主库不在一个IP地址上(挂了说明主机服务器出毛病了,如果同一个IP可能从机up不了)

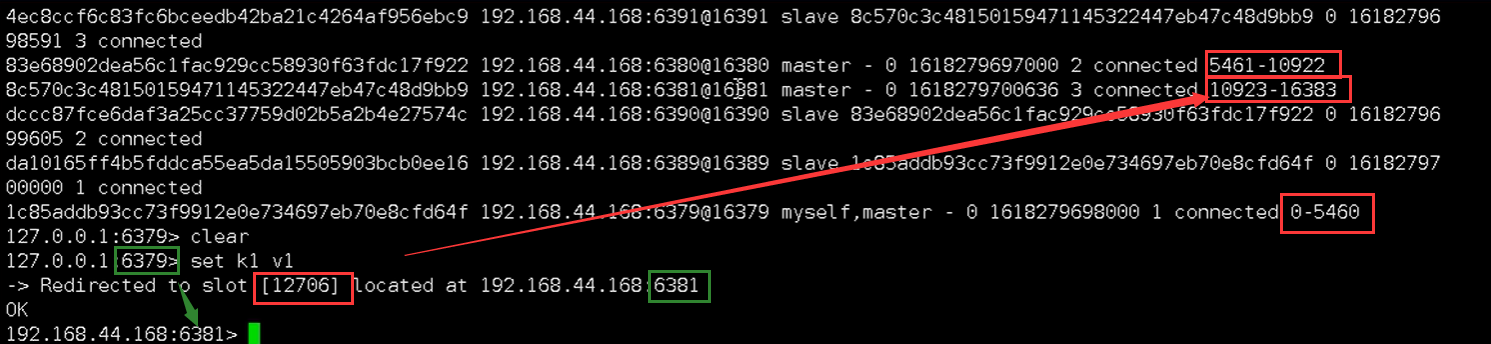

6、以集群方式连接实例

redis-cli -c -p 6379 # -c 集群方式 -p端口

7、查看集群信息

cluster nodes

slot

[OK] AIll 16384 slots covered

一个Redis集群包含16384个插槽( hashslot),数据库中的每个键都属于这16384个插槽的其中一个

集群使用公式CRC16(key) % 16384来计算键key属于哪个槽,中CRC16(key)语句用于计算键key的CRC16校验和

集群中的每个节负责处理一部分插槽。 举个例子, 如果一个集群可以有主节点,其中:节点A负责处理0号至5460号插槽,节点B负责处理5461号至10922号插槽,节点C负责处理10923号至16383号插槽

在集群录录入值

在redis-cli每次录入、查询键值, redis 都会计算出该key应该送往的插槽,如果不是该客户端对应服务器的插槽, redis会报错,告知应前往的redis实例地址和端口。redis-cli客户端提供了-c参数实现自动重定向,如redis-cli -c -p 6379 登入后,再录入、查询键值对可以自动重定向

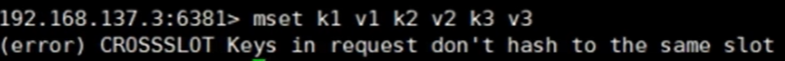

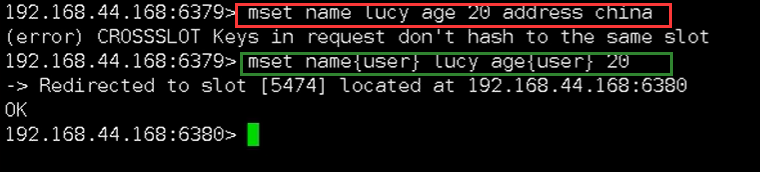

不在一个slot'下的键值,是不能使用mget,mset等多键操作

可以通过{}来定义组的概念,从而使key中{}内相同内容的键值对放到一个slot中去

查询集群中的值

CLUSTER GETKEYSINSLOT slot count返回count个slot槽中的键,只能查自己实例内的插槽的值

故障恢复

如果主节点下线?从节点能否自动升为主节点?注意: 15秒超时

主节点恢复后,主从关系会如何?主节点回来变成从机

如果所有某-段插槽的主从节点都宕掉, redis 服务否还能继续

如果某一段插槽的主从都挂掉 ,而cluster-require-full-coverage为yes那么,整个集群都挂掉~

如果某一-段插槽的主从都挂掉,而cluster-require-full-coverage为no ,那么,该插槽数据全都不能使用,也无法存储

redis.conf中的参数cluster-require-full-coverage.

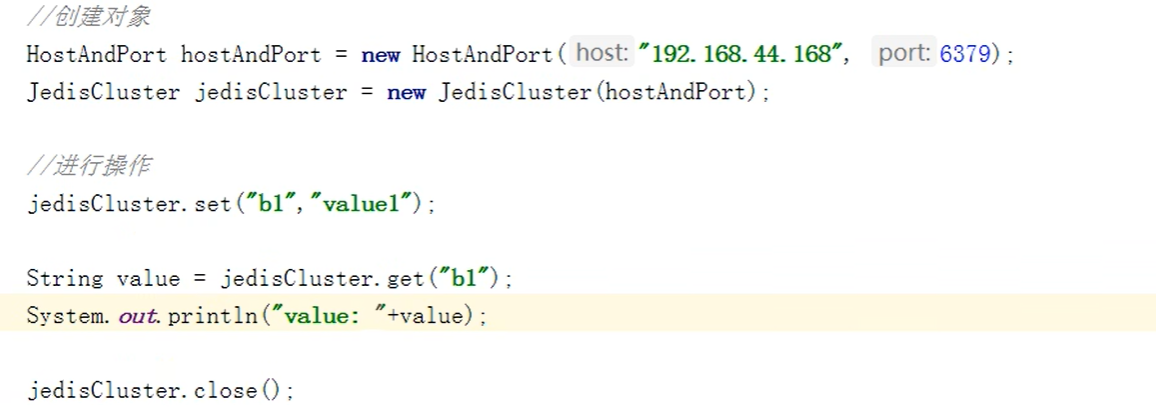

集群的Jedis开发

即使连接的不是主机,集群会自动切换主机存储。主机写,从机读

无中心化主从集群。无论从哪台主机写的数据,其他主机上都能读到数据。

优点

实现扩容

分摊压力

无中心配置相对简单

不足

多键操作是不被支持的

多键的Redis务是不被支持的。lua 脚本不被支持

于集群方案出现较晚,很多公司已经采用了其他的集群方案,而代理或者落户端分片的方案想要迁移至redis cluster ,需要整体迁移而不是逐步过渡,复杂度较大

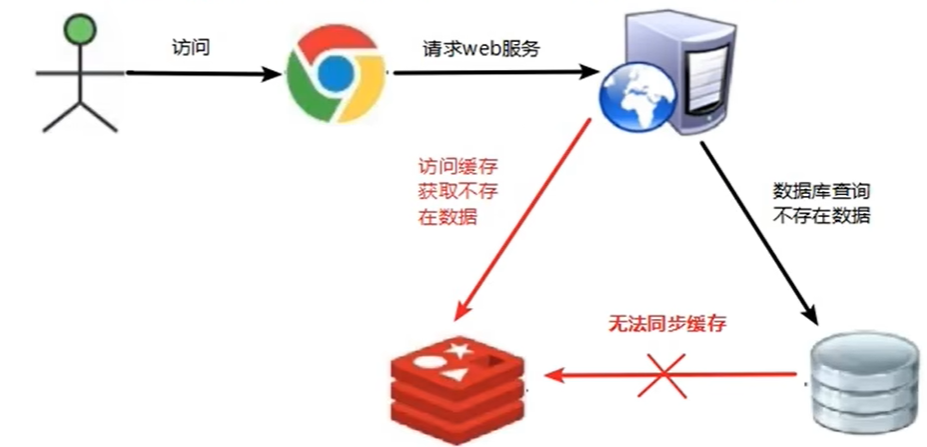

缓存穿透

key对应的数据在数据源并不存在,每次针对此key的请求从缓存获取不到,请求都会压到数据源,从而可能压垮数据源。比如用一个不存在的用户id获取用户信息,

不论缓存还是数据库都没有,若黑客利用此漏洞进行攻击可能压垮数据库

现象:应用服务器压力变大了、redis命中率降低、一直查询数据库

原因:reids查询不到数据库、出现很多非正常url访问...

一个一定不存在缓存及查询不到的数据,由于缓存是不命中时被动写的,并且出于容错考虑,如果从存储层查不到数据则不写入缓存,这将导致这个不存在的数据每

次请求都要到存储层去查询,失失了缓存的意义

解决方案(报警)

(1) 对空值缓存:如果一个查询返回的数据为空(不管是数据是否不存在) ,我们仍然把这个空结果( null )进行缓存,设置空结果的过期时间会很短,最

长不超过五分钟。

(2) 设置可访问的名单(白名单) :使用bitmaps类型定义一个可以访问的名单 ,名单id作为bitmaps的偏移量每次访问和bitmap面的id进行比较,如果访问id 不在bitmaps里面,进行拦截,不允许访问

(3) 采用布隆过滤器: (布隆过滤器( Bloom Filter )是1970 年由布隆提出的。它实际上是一个很长的二进制向量(位图)和一系列随机映射函数(哈希函数),布隆过滤器可以用于检索一个元素是否在一个集合中。它的优点是空间效率和查询时间都远远超过一般的算法,缺点是有一定的误识别率和删除困难。

将所有可能存在的数据哈希到一个足够大的bitmaps 中, 一个定不存在的数据会被这个bitmaps拦截掉,从而避免了对底层存储系统的查询压力,

(4) 进行实时监控:当发现Redis的命中率开始急速降低,需要排查访问对象和访问的数据,和运维人员配合,可以设置黑名单限制服务

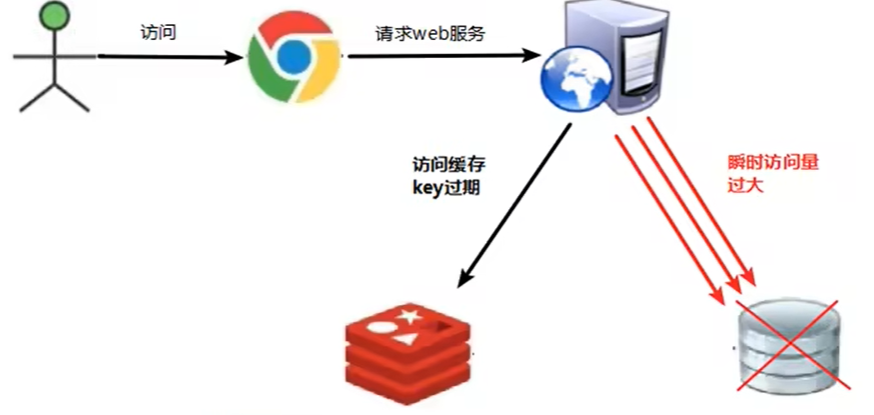

缓存击穿

key对应的数据存在,但在redis 中过期,此时若有大量并发请求过来,这些请求发现缓存过期一般都会从后端DB加载数据并回设到缓存,这个时候大并发的请求可能

会瞬间把后端DB压垮

现象:应用服务器压力瞬间增大、redis没有出现大量key过期、redis正常运行...

原因:reids某个key过期了,大量访问者使用这个key、...

key可能会在某些时间点被超高并发地访问,是一种非常”热点” 的数据。这个时候,要考虑一个问题:缓存被峙”的问题

解决方案

( 1 )预先设置热门数据:在redis高峰访问之前,把一些热门数据提前存入到redis面,加大这些热门数据key的时长

(2) 实时调整:现场监控哪些数据热门,实时调整key的过期时长

(3) 使用锁:

就是在缓存失效的时候(判断拿出来的值为空) ,不是立即去load db.

先使用缓存工具的某些带成功操作返回值的操作(比如Redis的SETNX )去set一个mutex key

当操作返回成功时,再进行load db的操作,并回设缓存,最后删除mutex key

当操作返回失败,证明有线程在load db,当前线程睡眠一-段时间再重试整个get缓存的方法

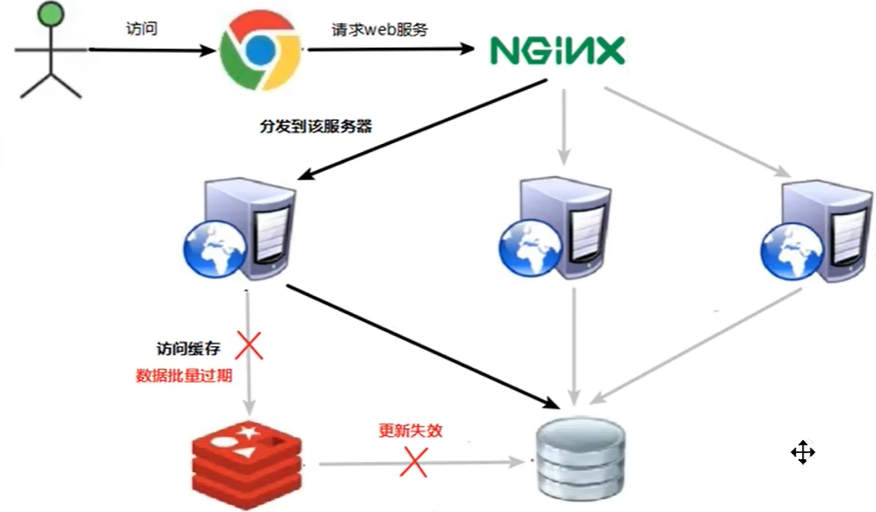

缓存雪崩

key对应的数据存在,但在redis中过期,此时若有大量并发请求过来,这些请求发现缓存过期一般都会从后端DB加载数据并回没到缓存,这个时候大并发的请求可能会瞬间把后端DB压垮,缓存雪崩与缓存耮的区别在于这鲤针对多key缓存,前者则是某一个 key正常访问

想现象:数据库压力变大,服务器崩溃

原因:在极少时间段,查询大量key的集中过期情况

解决方案

(1) 构建多级缓存架构: nginx缓存+ redis缓存+其他缓存( ehcache等)

(2) 使用锁或队列:用加锁或者队列的方式保证来保证不会有大量的线程对数据库一次性进行读写,从而避免失效时大量的并发请求落到底层存储系统上。不适用高并发情况

(3) 设置过期标志更新缓存:记录缓存数据是否过期(设置提前量) , 如果过期会触发通知另外的线程在后台去更新实际key的缓存

(4 )将缓存失效时间分散开:比如我们可以在原有的失效时间基础上增加一个随机值,比如1-5 分钟随机,这样每一个缓存的过期时间的重复率就会降低,就很难引发集体失效的事件

分布式锁

随着业务发展的需要,原单体单机部署的系统被演化成分布式集群系统后,由于分布式系统多线程、多进程并且分布在不同机器上,这将使原单机部署情况下的并发

控制锁策略失效,单纯的Java API钚能提供分布式锁的能力。为了解决这个问题就需要一种跨JVM的互斥机制来控制共享资源的访问,这就是分布式锁要解决的问题!。

分布式锁主流的实现方案

-

基于数据库实现分布式锁

2 基于缓存(Redis等)

-

基于Zookeeper

每一种分布式锁解决方案都有各自的优缺点

1.性能: redis最高

2.可靠性: zookeeper最高

这里,我们就基于redis实现分布式锁

redis:命令

set sku:1:info "OK" nx px 20 # 或者 psetnx sku:1:info 20 "OK" # 手动解锁 del sku:1:info

使用setnx 上锁,del释放锁,设置锁同时设置过期时间,自动释放锁

EX second :设置键的过期时间为second秒。SET key value EX second效果等同于SETEX key second value

PX millisecond :设置键的过期时间为millisecond毫秒。SET key value PX millisecond效果等同于PSETEX key millisecond value

NX :只在键不存在时, 才对键进行设置操作。SET key value NX效果等同于SETNX keyvalue

XX :只在键已经存在时,才对键进行设置操作

问题:可能会释放其他服务器的锁

场景:如果业务逻辑的执行时间是7s.执行流程如下

index1业务逻辑没执行完,3秒后锁被自动释放

index2获取到锁,执行业务逻辑,3秒后锁被自动释放

index3获取到锁,执行业务逻辑

index1业务逻辑执行完成,开始调用del释放,这时释放的是index3的锁,导致index3的业务只执行1s就被别人释放,最终等于没锁的情况

解决:setnx获取锁时,设置一个指定的唯一值(例如: uuid) :释放前获取这个值,判断是否自己的锁

问题:删除操作缺乏原子性

场景:

index1执行删除时,查询到的lock值确实和uuid相等

index1执行删除前, lock 刚好过期时间已到,被redis自动释放

解决:为了确保分布式锁可用,我们至少要确保锁的实现同时满足以下四个条件

-互斥性。在任意时刻,只有一个客户端能持有锁

-不会发生死锁。即使有一个客户端在持有锁的期间崩溃而没有主动解锁,也能保证后续其他客户端能加锁

-解铃还须系铃人。加锁和解锁必须是同一个客户端,客户端自己不能把别人加的锁给解了

-加锁和解锁必须具有原子性

Redis6新功能介绍

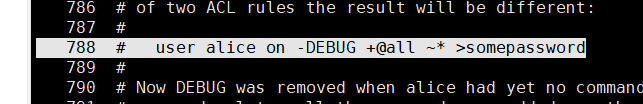

ACL

Redis ACL是Access Control List (访问控制列表)的缩写,该功能允许根据可以执行的命令和可以访问的键来限制某些连接。

在Redis 5版本之前, Redis安全规则只有密码控制还有通过rename来调整高危命令比如flushdb,KEYS* ,shutdown 等。Redis 6则提供ACL的功能对用户进行更细粒度的权限控制:

1、接入权限:用户名和密码

2、可以执行的命令

3、可以操作的KEY

命令

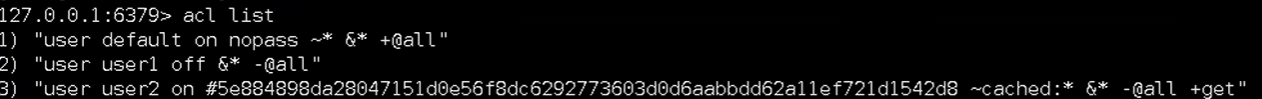

1、acl list 列出用户权限

2、acl cat 添加权限

3、acl whoami 查看当前用户

4、acl setuser 创建和编辑用户。设置有用户名、密码、ACL权限、并启用的用户acl setuser user2 on > password ~cached:* +get

如果户不存在,这将使用just created的默认属性来创建用户。如果用户已经存在,则上面的命令将不执行任何操作

ACL规则 详见官网:ACL | Redis

IO多线程

简介

Redis6终于支撑多线程了,告别单线程了吗?

I0多线程其实指客户端交互部分的网络I0 交互处理模块多线程,而非执行命令多线程。Redis6 执行命令依然是单线程

另外,多线程I0默认也是不开启的,需要再配置文件中配置

io-threads-do-reads yes

io-threads [数量]

原理架构

Redis6加入多线程,但跟Memcached这种从IO处理到数据访问多线程的实现模式有些差异。Redis的多线程部分只是用来处理网络数据的读写和协议解析,执行命令仍然是单线程。之所以这么设计是不想因为多线程而变得复杂,需要去控制key、 lua、事务,LPUSH/LPOP等等的并发问题。整体的设计大体如下

Cluster

工具支持Cluster

之前老版Redis想要搭集群需要单独安装ruby环境, Redis 5将redis-trib.rb 的功能集成到redis-cli。另外官方redis-benchmark工具开始支持cluster 模式了,通过多线程的方式对多个分片进行压测

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 周边上新:园子的第一款马克杯温暖上架

· 分享 3 个 .NET 开源的文件压缩处理库,助力快速实现文件压缩解压功能!

· Ollama——大语言模型本地部署的极速利器

· DeepSeek如何颠覆传统软件测试?测试工程师会被淘汰吗?

· 使用C#创建一个MCP客户端