Transformer相关资料

微信视频讲解(1) (推荐)

微信视频讲解(2) (推荐)

Transformer 详解 (有详细的原理以及pytorch代码实现讲解,推荐)

Vision Transformer 超详细解读 (原理分析+代码解读) (一) (推荐)

举个例子讲下transformer的输入输出细节及其他 (transformer为什么可以并行计算讲的很清晰。)

position embedding:

一文搞懂Transformer的位置编码_transformer位置编码-CSDN博客 (推荐)

This post is all you need(②位置编码与编码解码过程)

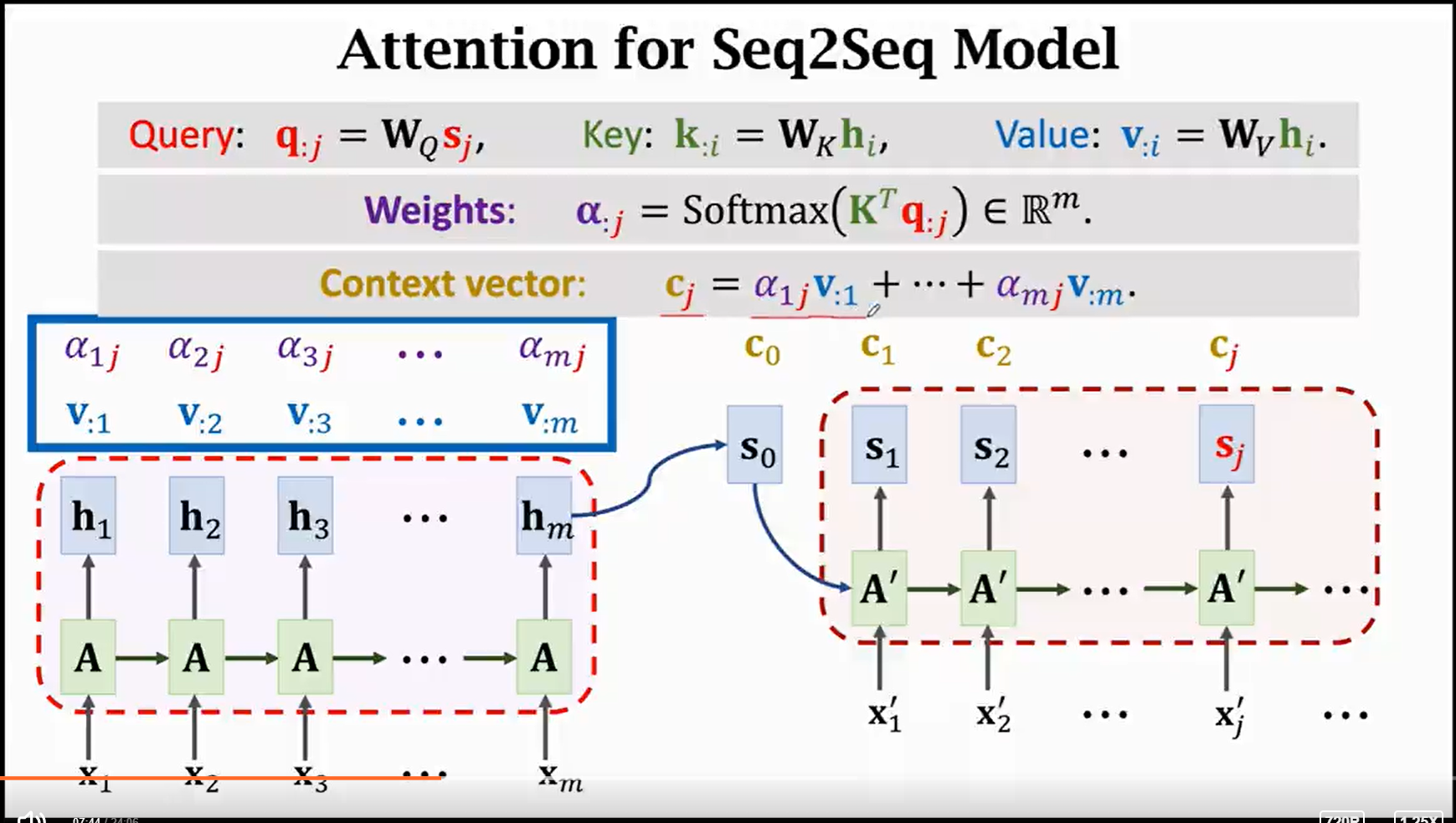

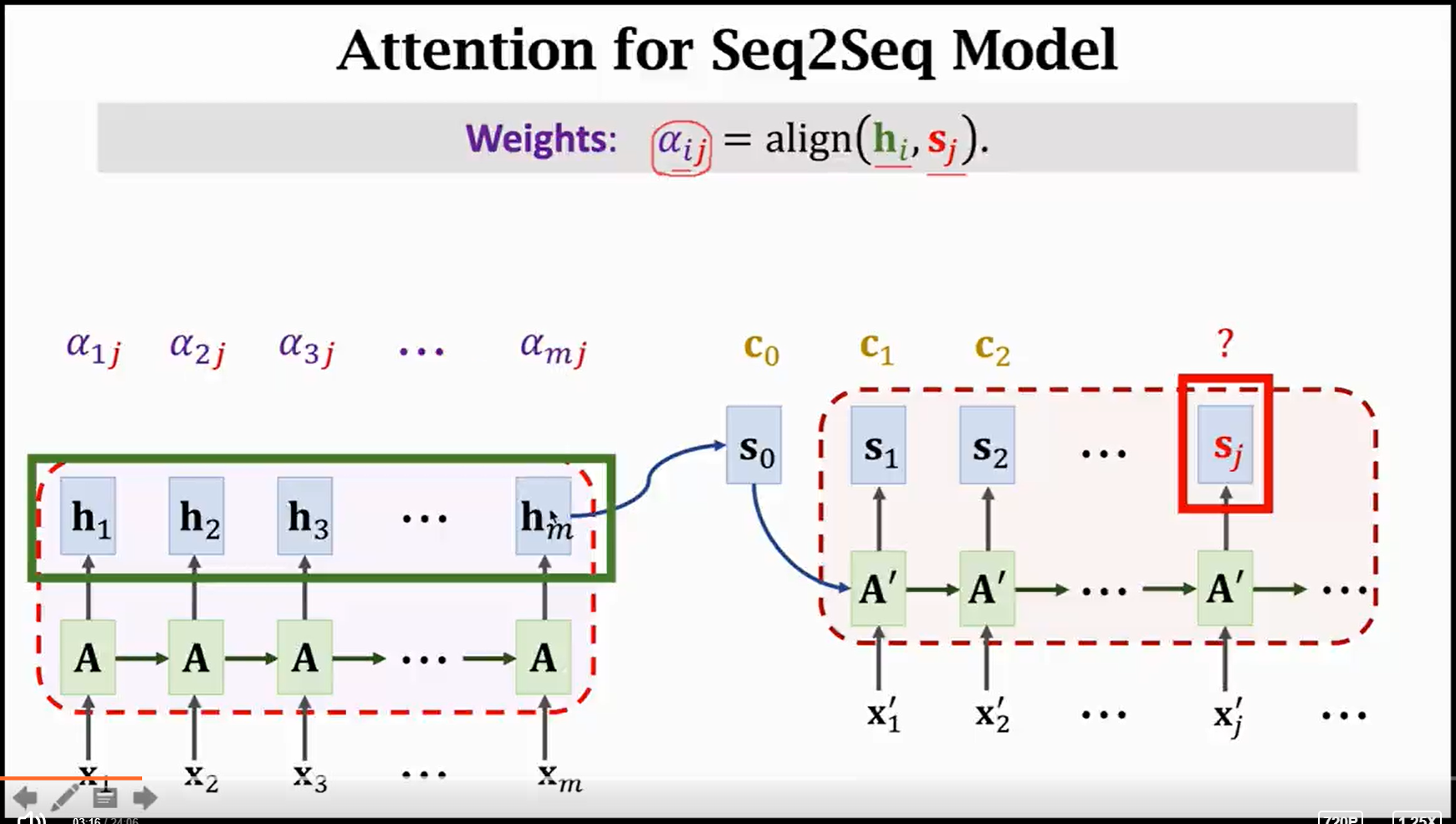

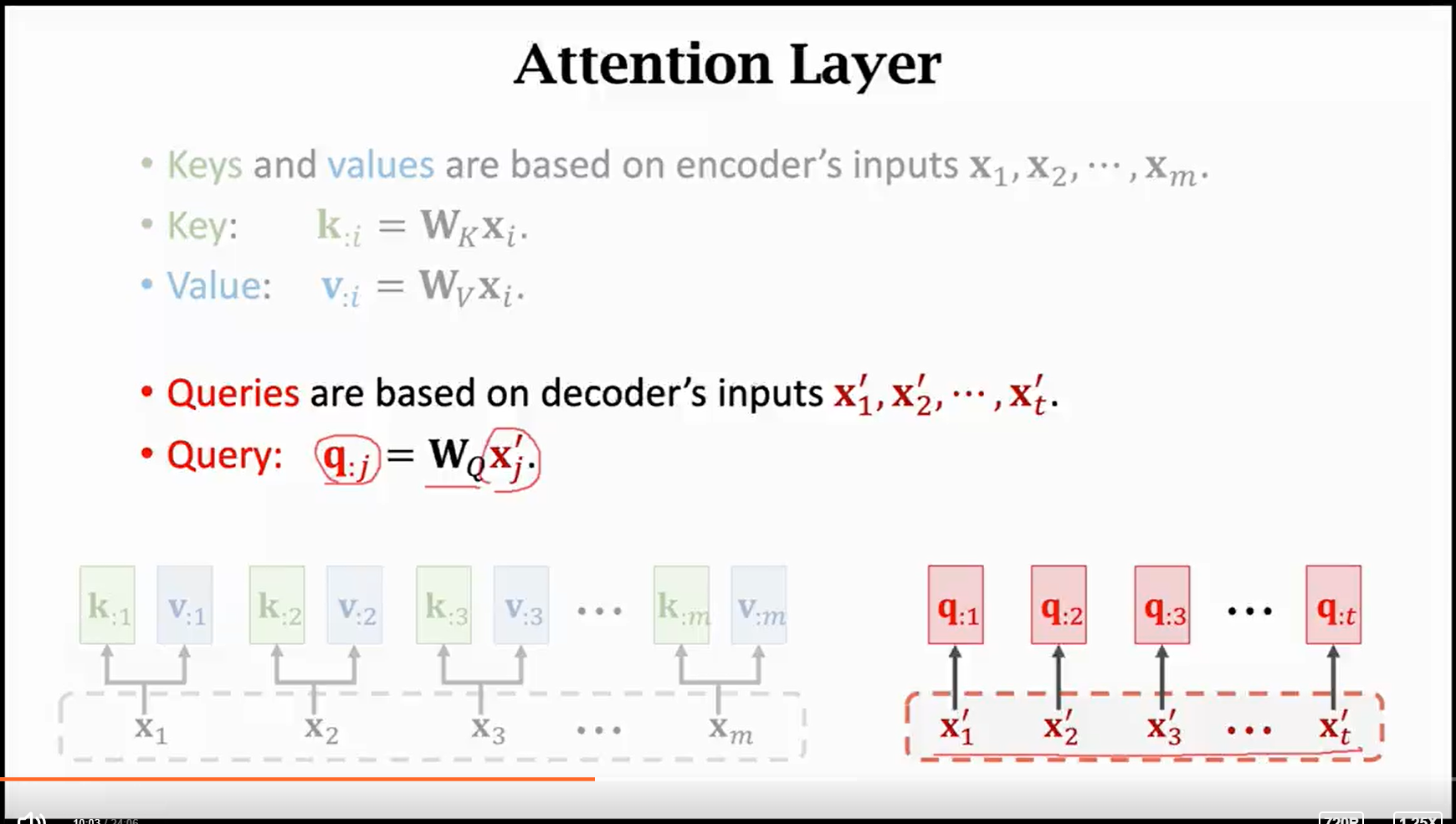

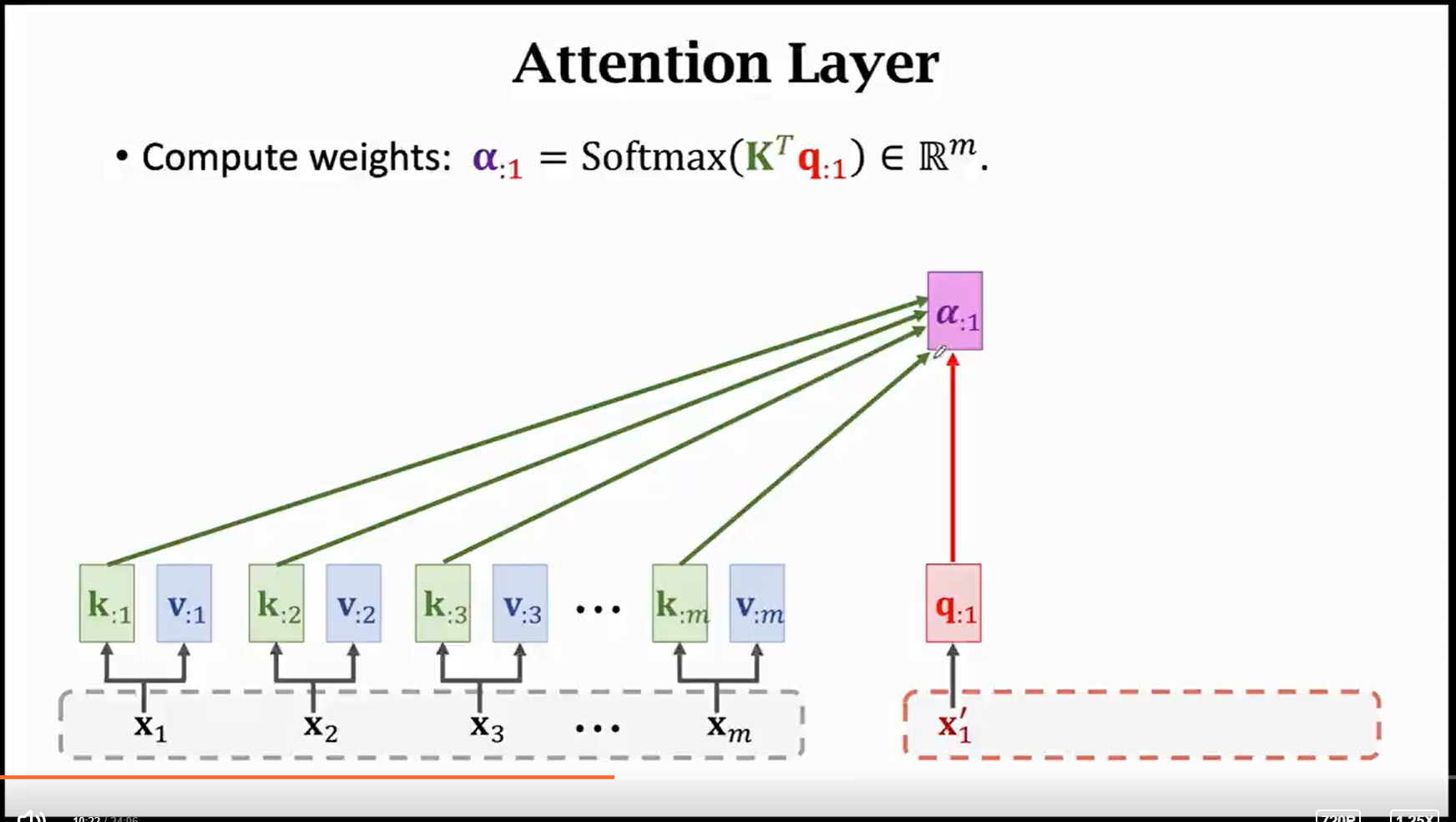

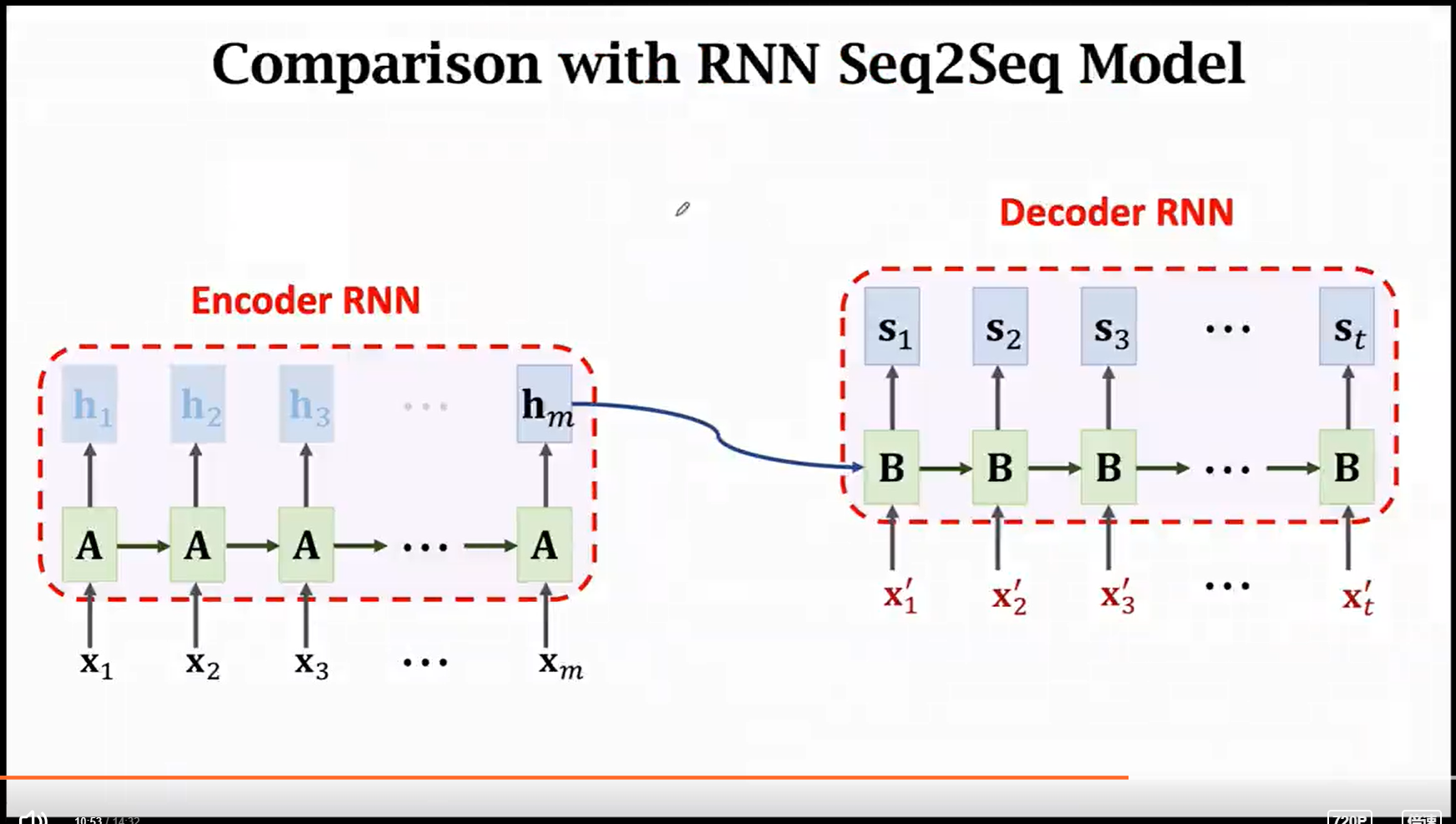

RNN LSTM、Seq2Seq、Attention、Self-attention (哔哩哔哩视频1)

Vision Transformer 超详细解读 (原理分析+代码解读) (目录)

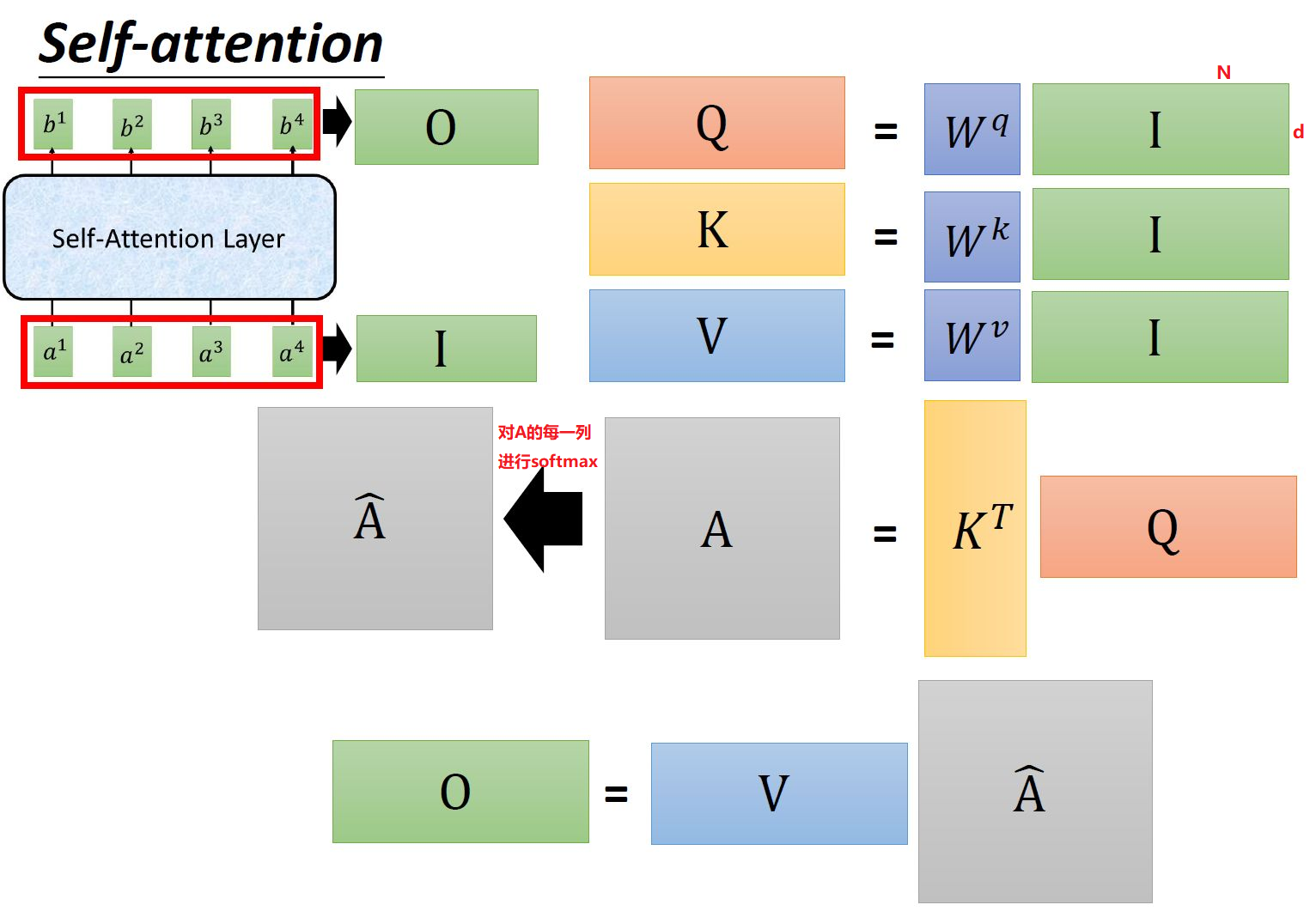

self-attention的计算量:

计算Q, K, V:

乘法:d * d * n * 3

加法:(d-1) * d * n * 3

计算相似度矩阵:

乘法:d * n * n

加法:(d-1) * n * n

计算output:

乘法:n * d * n

加法:(n-1) * d * n

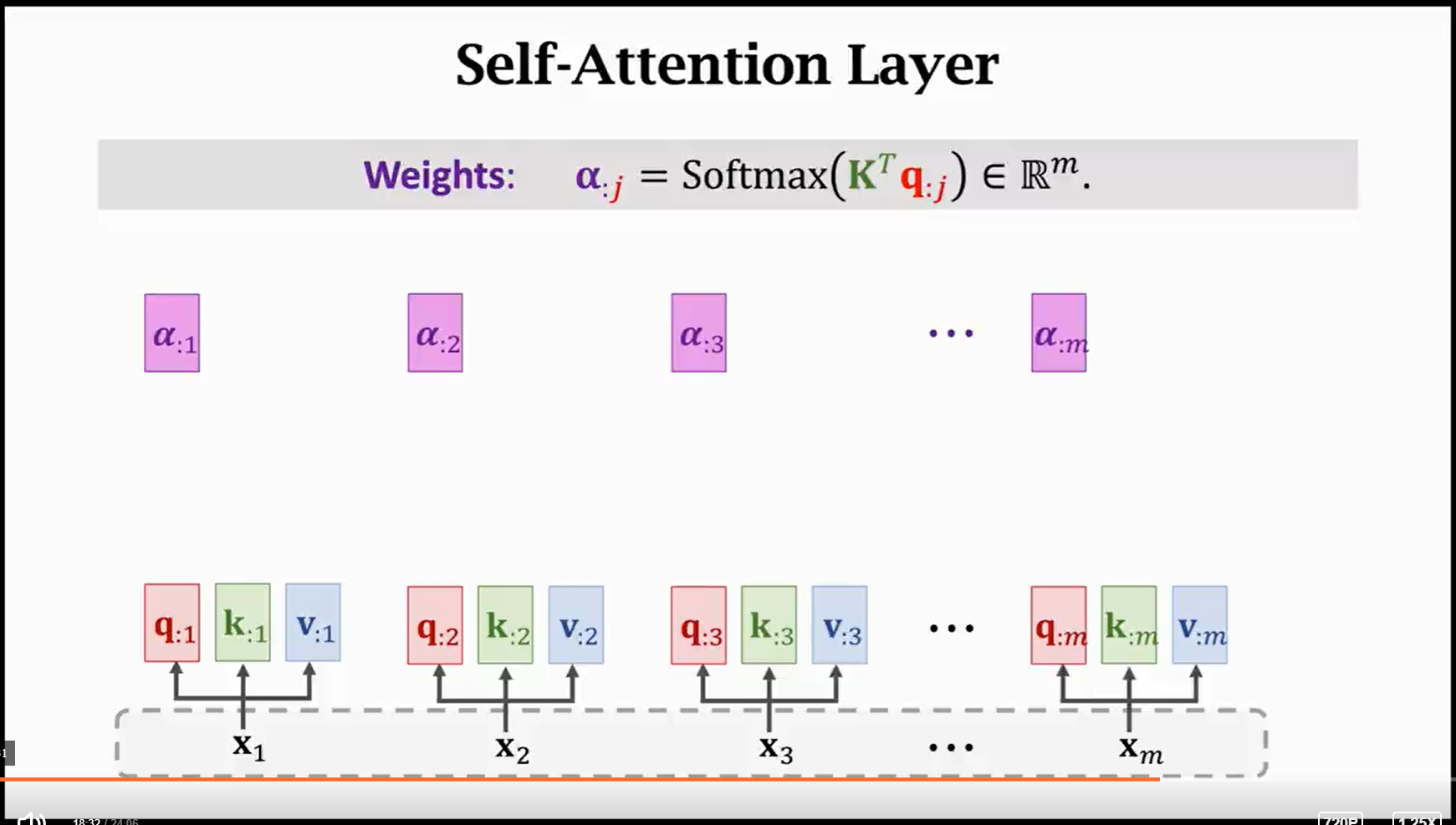

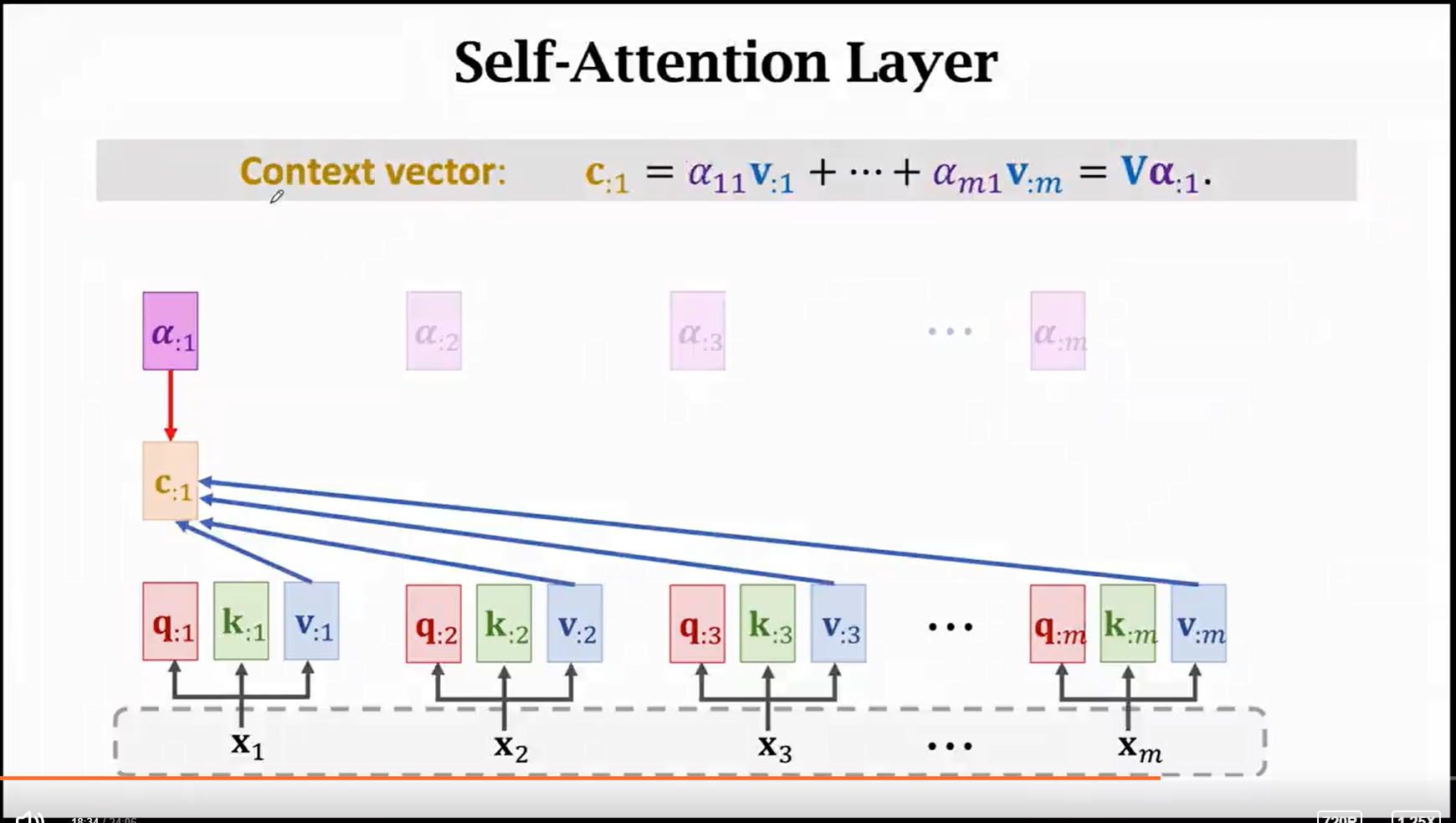

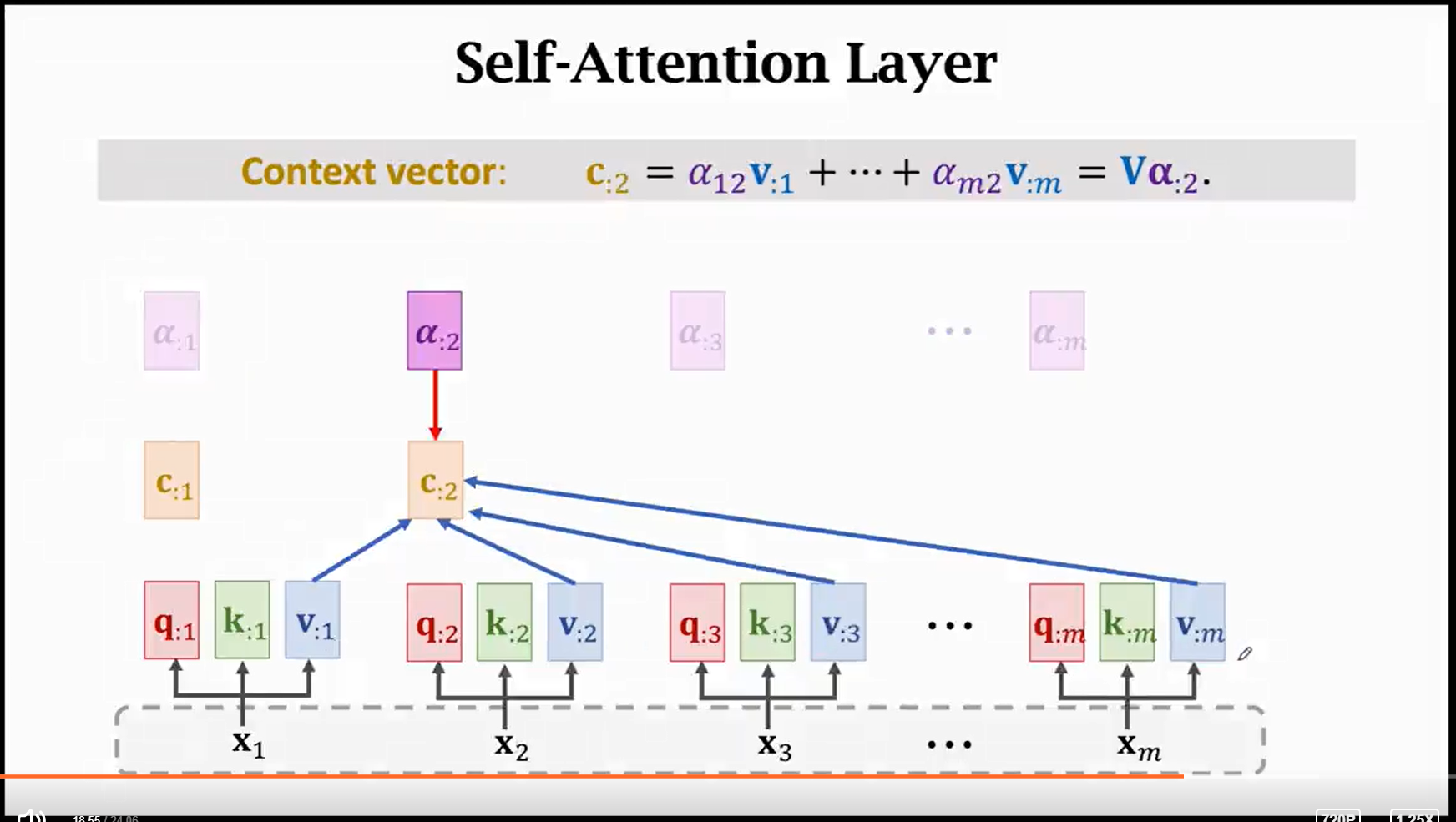

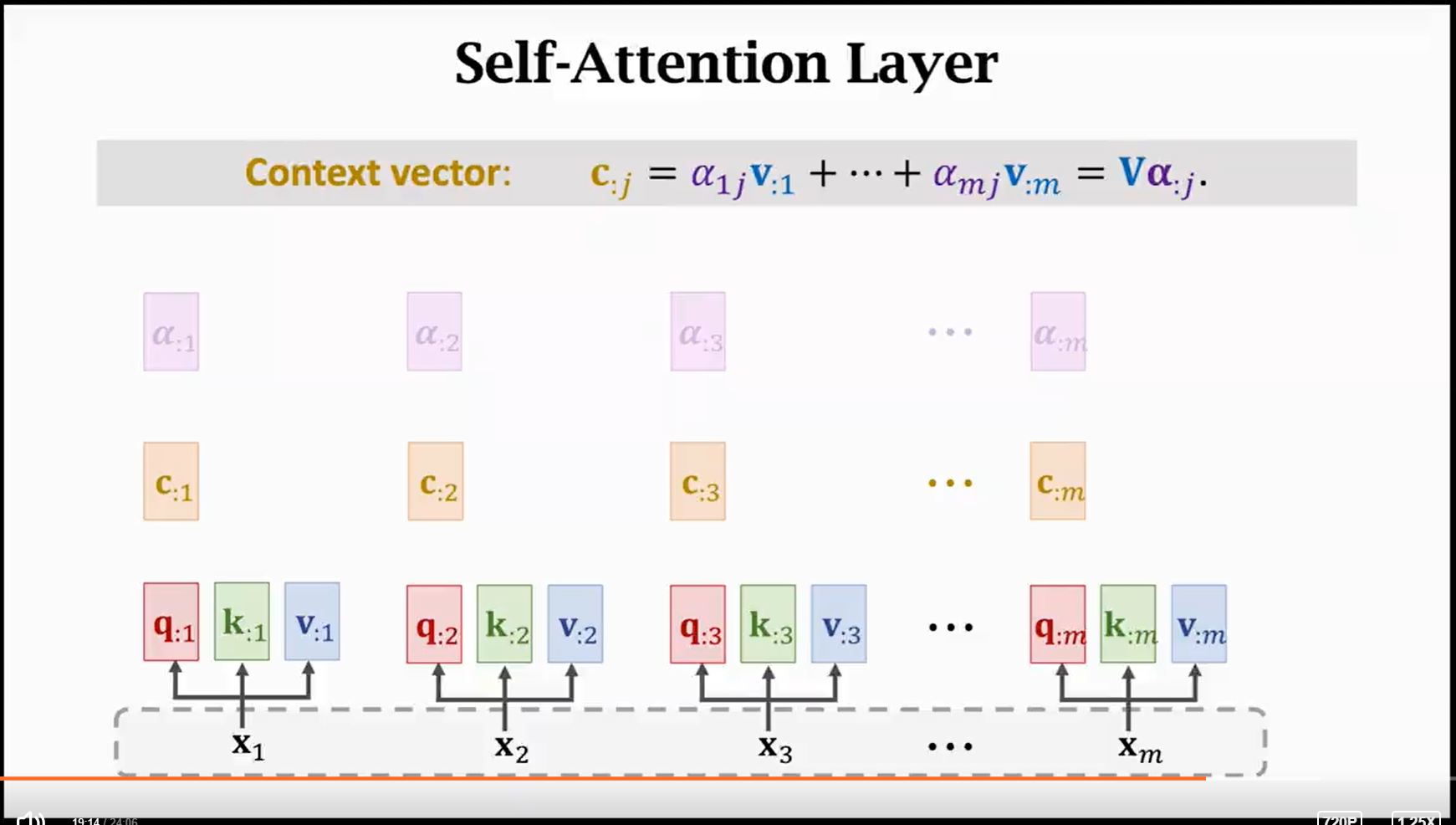

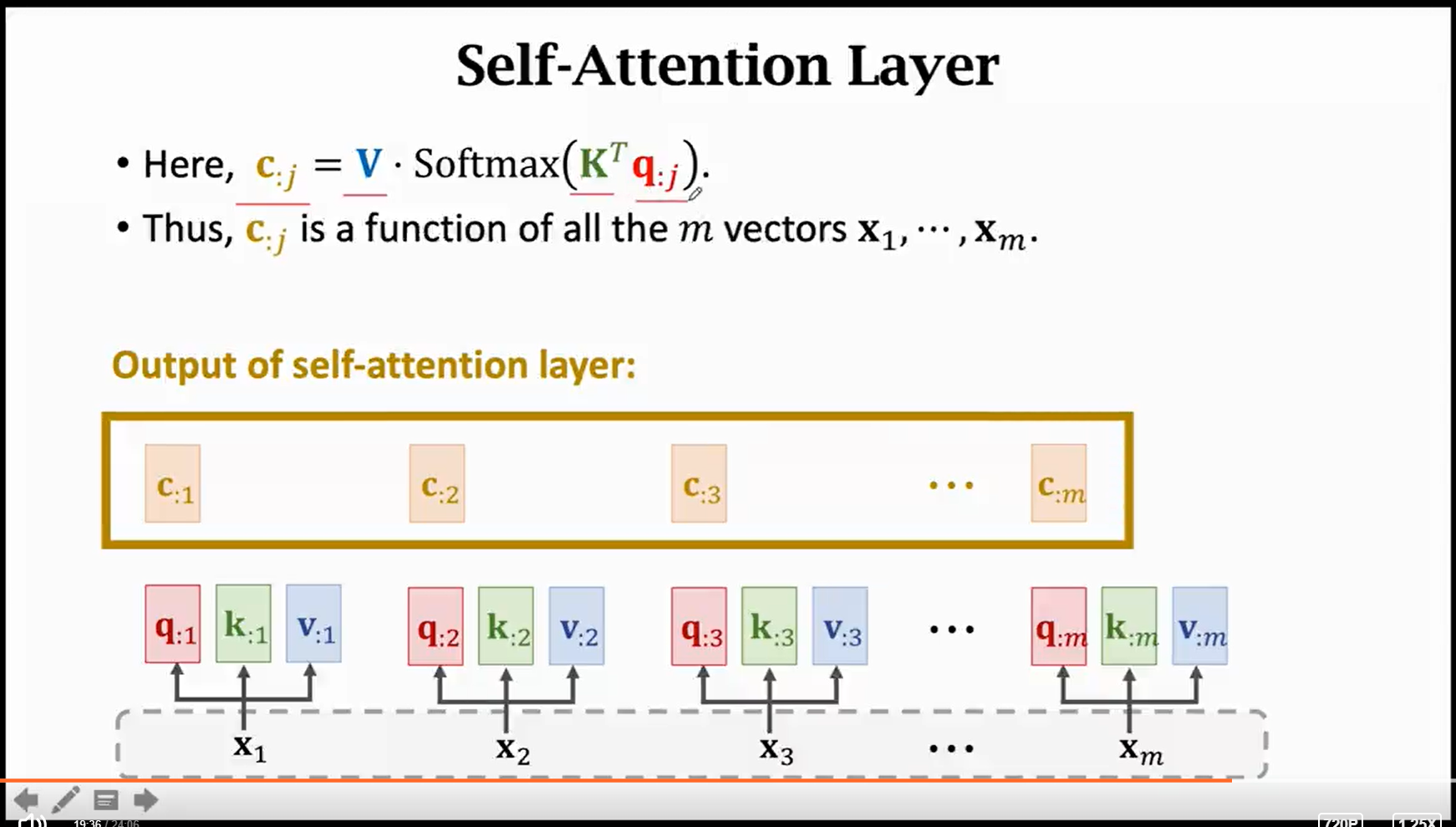

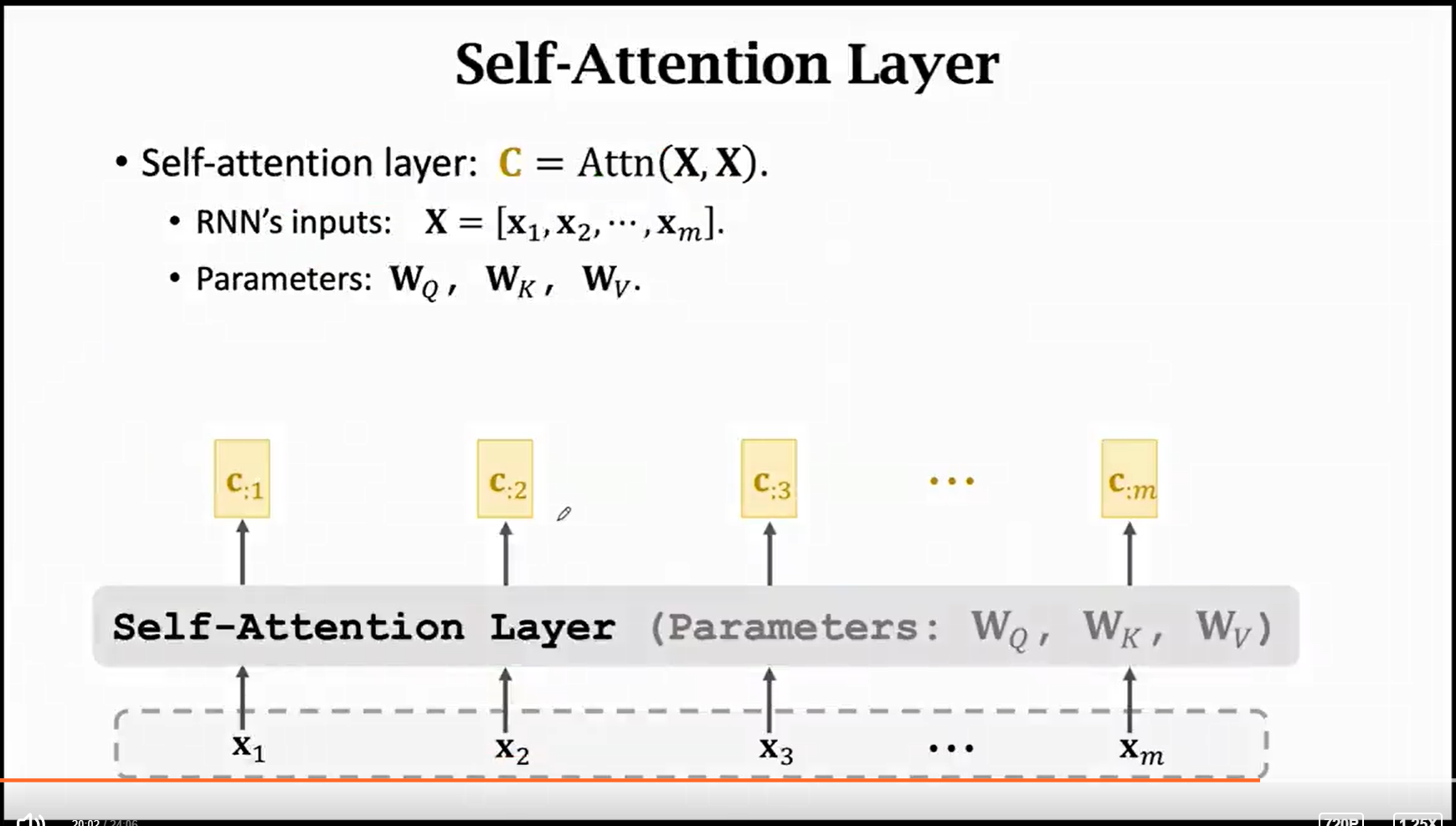

如果输入矩阵中一列表示一个样本:

如果输入矩阵中一行表示一个样本:(把上面公式的分子转置一下)

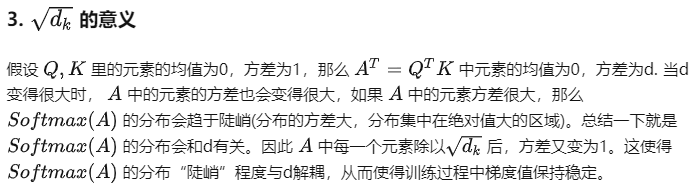

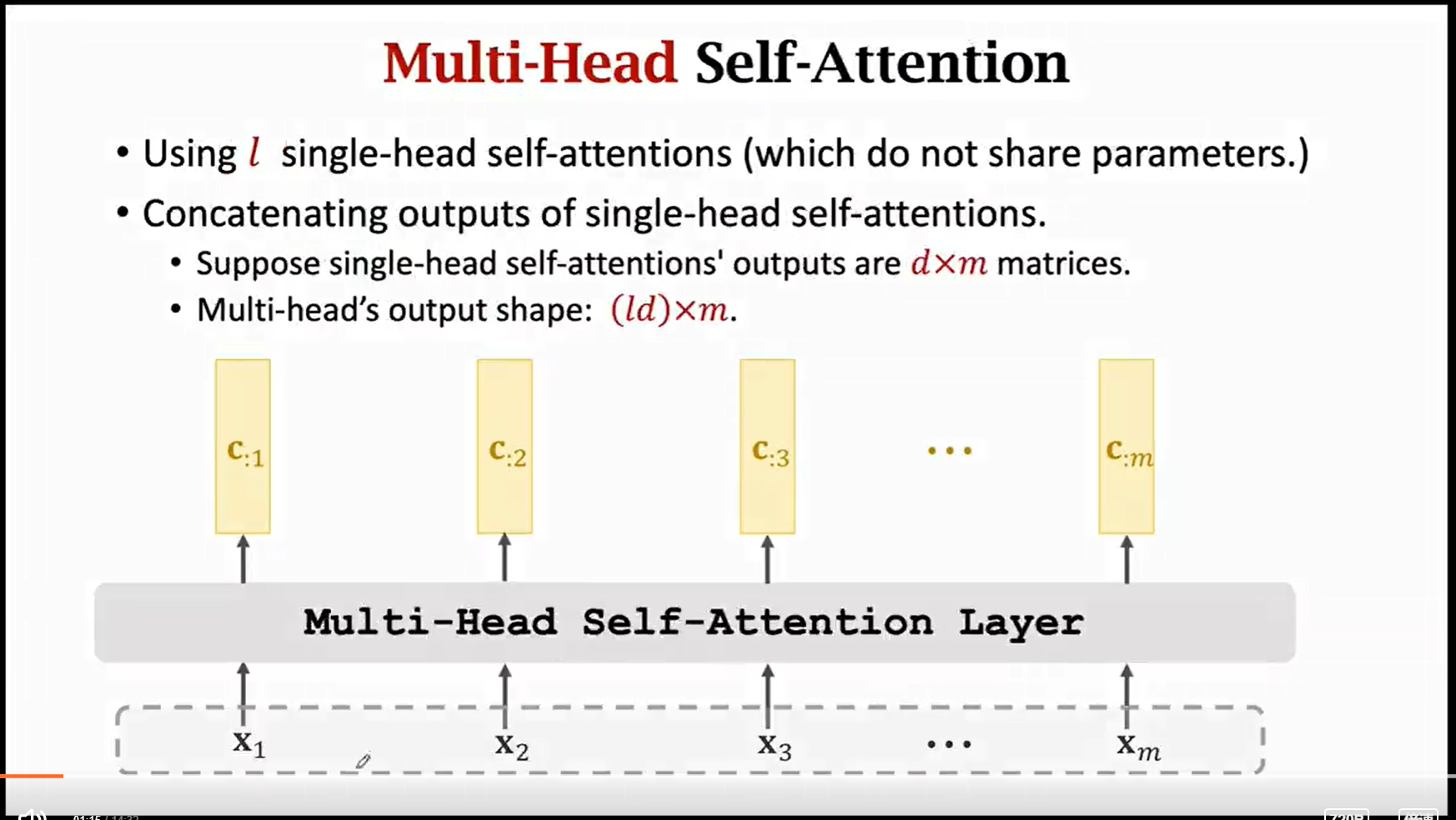

self-attention的计算复杂度分析(摘自https://zhuanlan.zhihu.com/p/361366090):

==============================================================

==============================================================

==============================================================

==============================================================

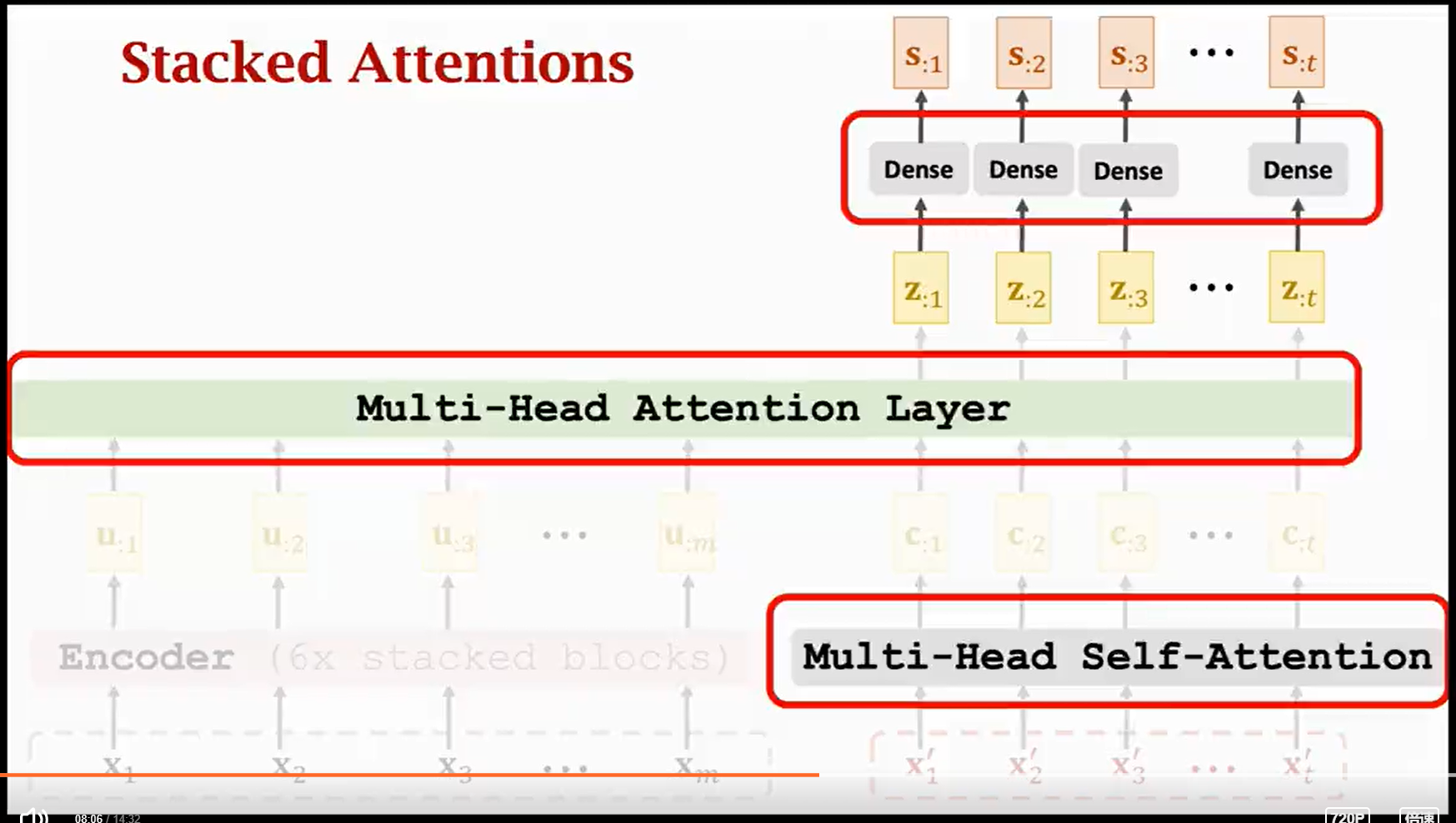

上面的的PPT摘自本文开头的两个参考资料。

浙公网安备 33010602011771号

浙公网安备 33010602011771号