模型蒸馏,蒸馏损失函数实现,蒸馏方法介绍

1. 蒸馏损失函数代码实现

摘自:知识蒸馏loss求解方法 - tangjunjun - 博客园 (cnblogs.com)

import torch

import torch.nn as nn

import numpy as np

loss_f = nn.KLDivLoss()

# 生成网络输出 以及 目标输出

model_student = torch.from_numpy(np.array([[0.1132, 0.5477, 0.3390]])).float() # 假设学生模型输出

model_teacher = torch.from_numpy(np.array([[0.8541, 0.0511, 0.0947]])).float() #假设教师模型输出

label=torch.tensor([0]) # 真实标签

loss_KD = loss_f(model_student, model_teacher)

L=nn.CrossEntropyLoss()

loss_SL=L(model_student,label)

lambda_ ,T=0.6,3 # 分别为设置权重参数,T为温度系数

loss = (1 - lambda_) * loss_SL + lambda_ * T * T * loss_KD # hint和jeff dean论文

print('\nloss: ', loss)

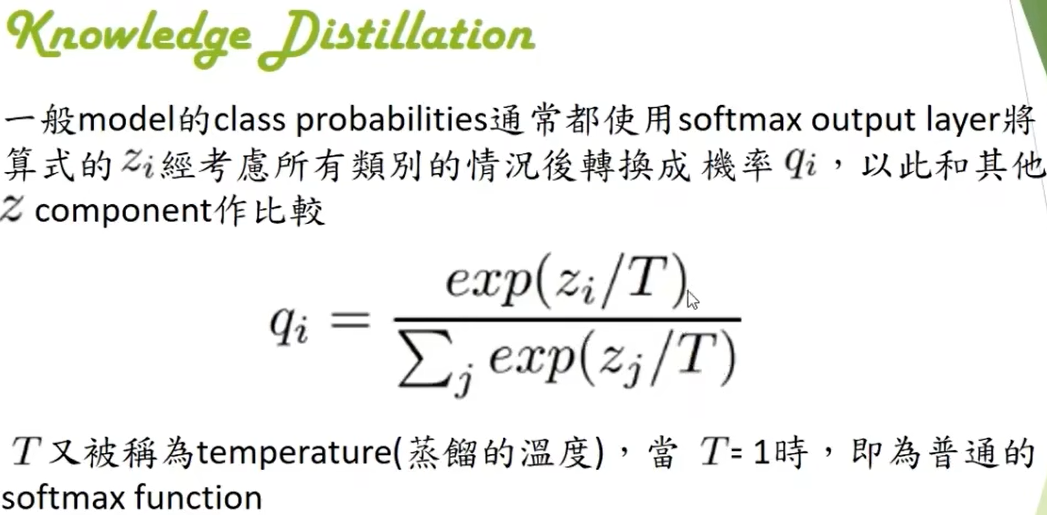

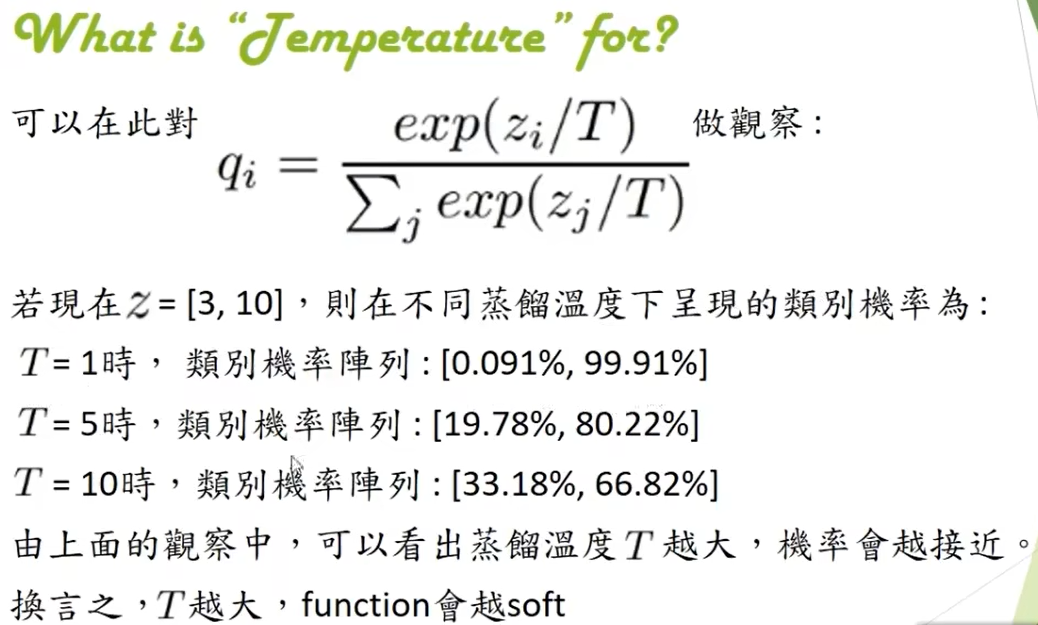

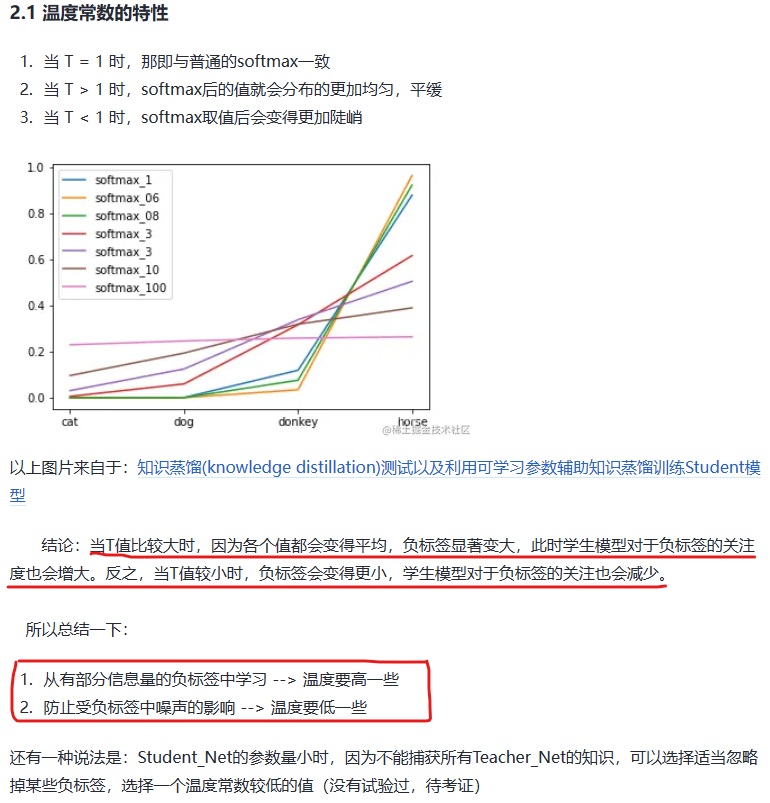

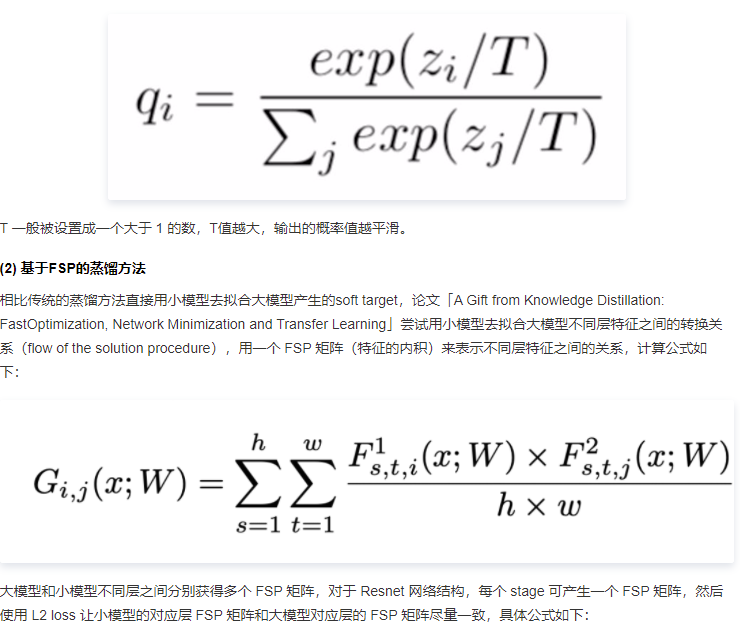

2. 蒸馏损失函数中温度的介绍和设定

摘自:李宏毅2020机器学习深度学习 和 知识蒸馏中的温度参数(2)

此外,蒸馏中温度设定的高级技巧还可以参考 bert知识蒸馏动态温度设置Annealing Knowledge Distillation (EACL 2021)& Reducing the Teacher-Student Gap - 知乎 (zhihu.com)。

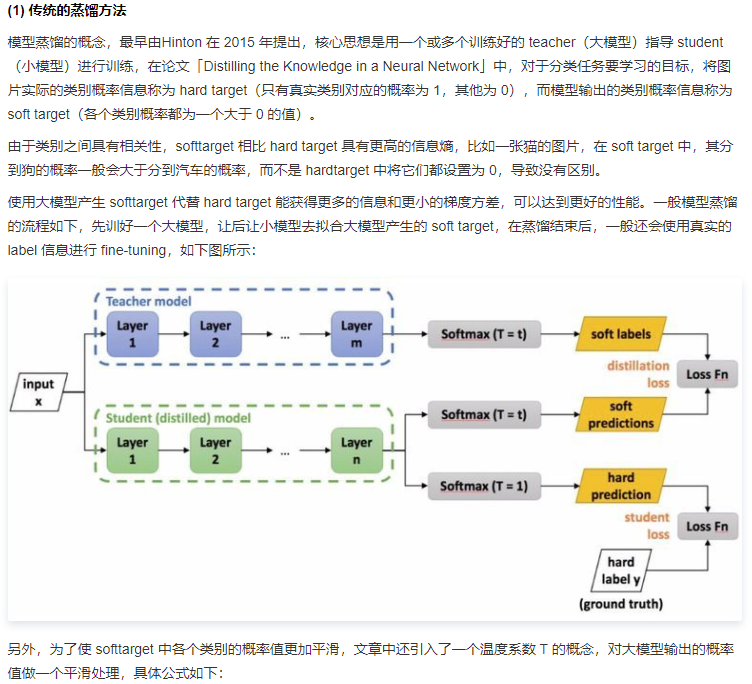

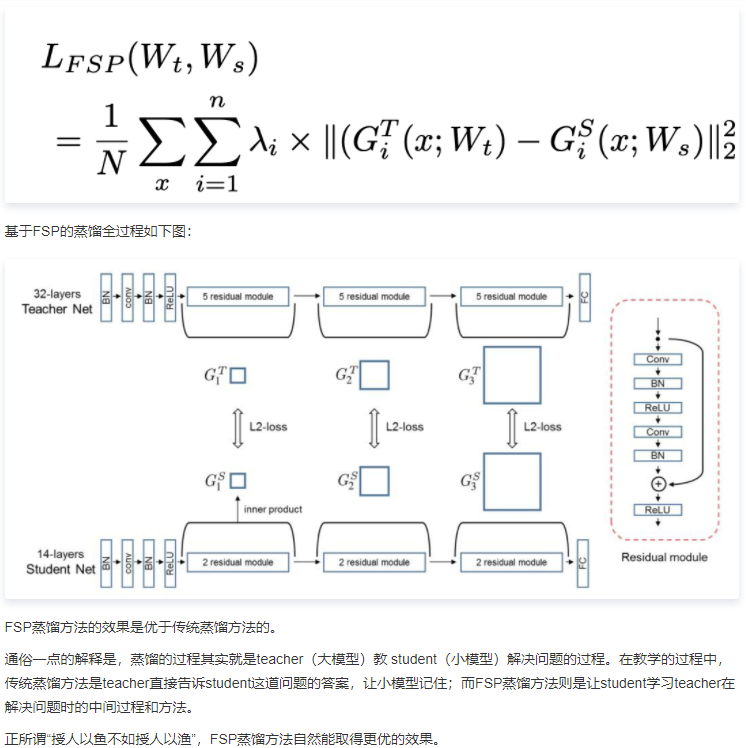

3. 蒸馏方法介绍

浙公网安备 33010602011771号

浙公网安备 33010602011771号