Lecture 1 -- Backpropagation

1. 从一个简单的例子开始

从A图中可以看到:

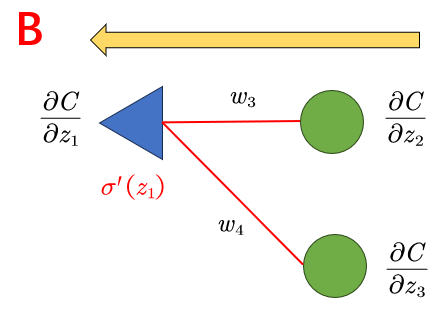

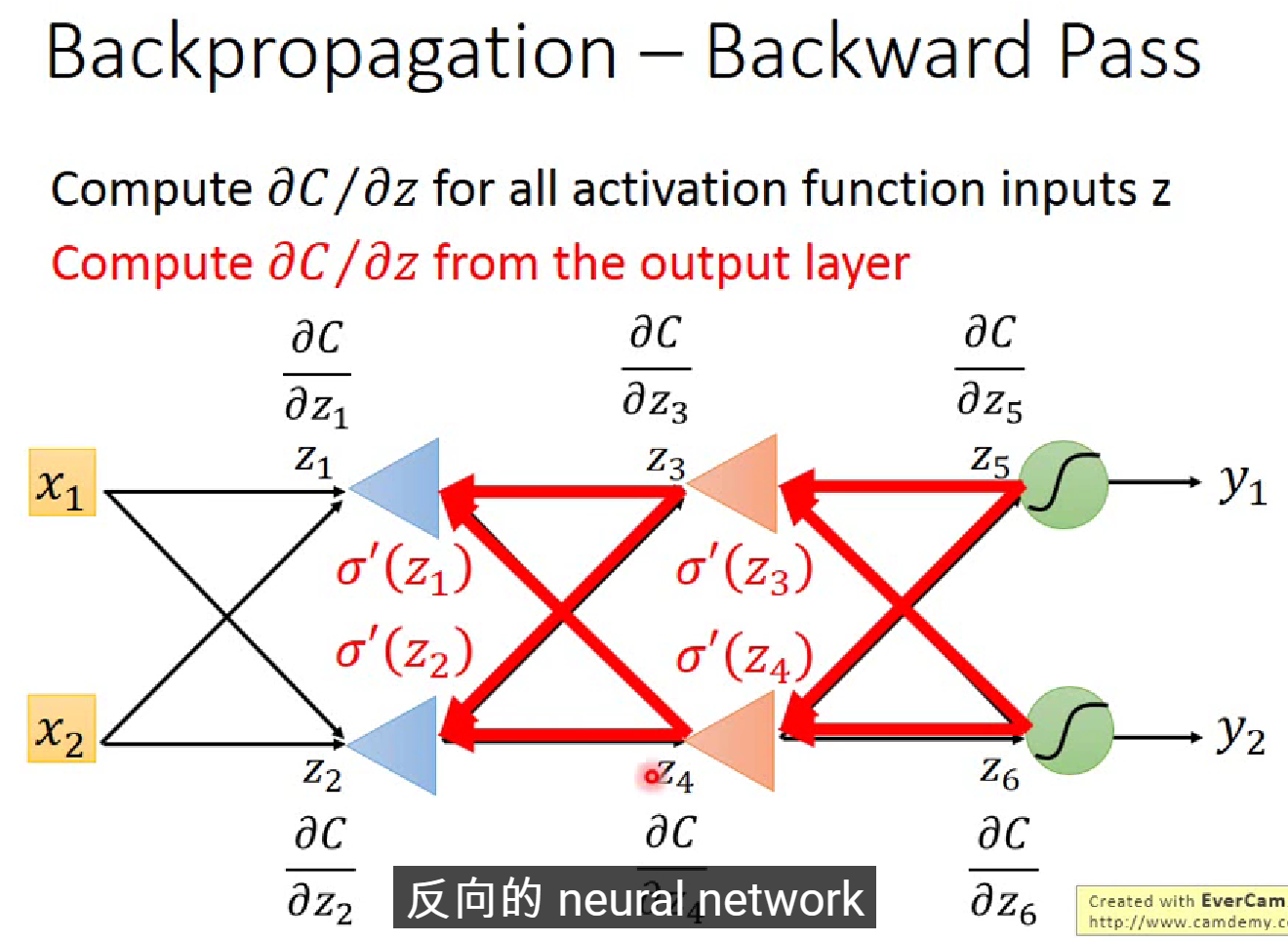

(1) $\displaystyle\frac{\partial C}{\partial z_1}=\left( \displaystyle\frac{\partial C}{\partial z_2}w_3+\displaystyle\frac{\partial C}{\partial z_3}w_4 \right) \sigma '\left( z_1 \right)$,其计算过程可以认为是一个反向的神经网络,其输入分别是$\displaystyle\frac{\partial C}{\partial z_2}$和$\displaystyle\frac{\partial C}{\partial z_3}$,激活函数是$\sigma '\left( z_1 \right)$(常数),输出为$\displaystyle\frac{\partial C}{\partial z_1}$,如图B所示。

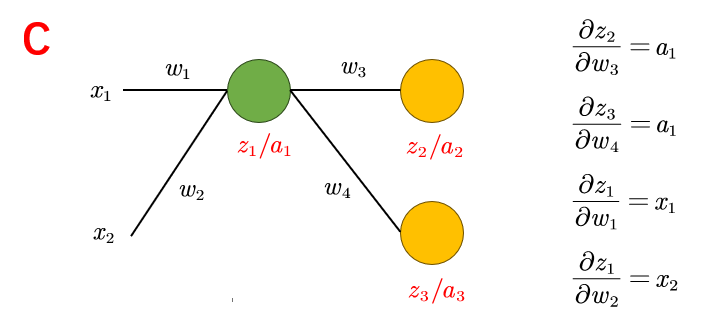

(2) $\displaystyle\frac{\partial z_1}{\partial w_1}=x_1$,其可以推广为:任意的$\displaystyle\frac{\partial z}{\partial w}$,其值为z对应的神经元前以w权重相连的神经元的激活值a,如图C所示。

2. 总结

-

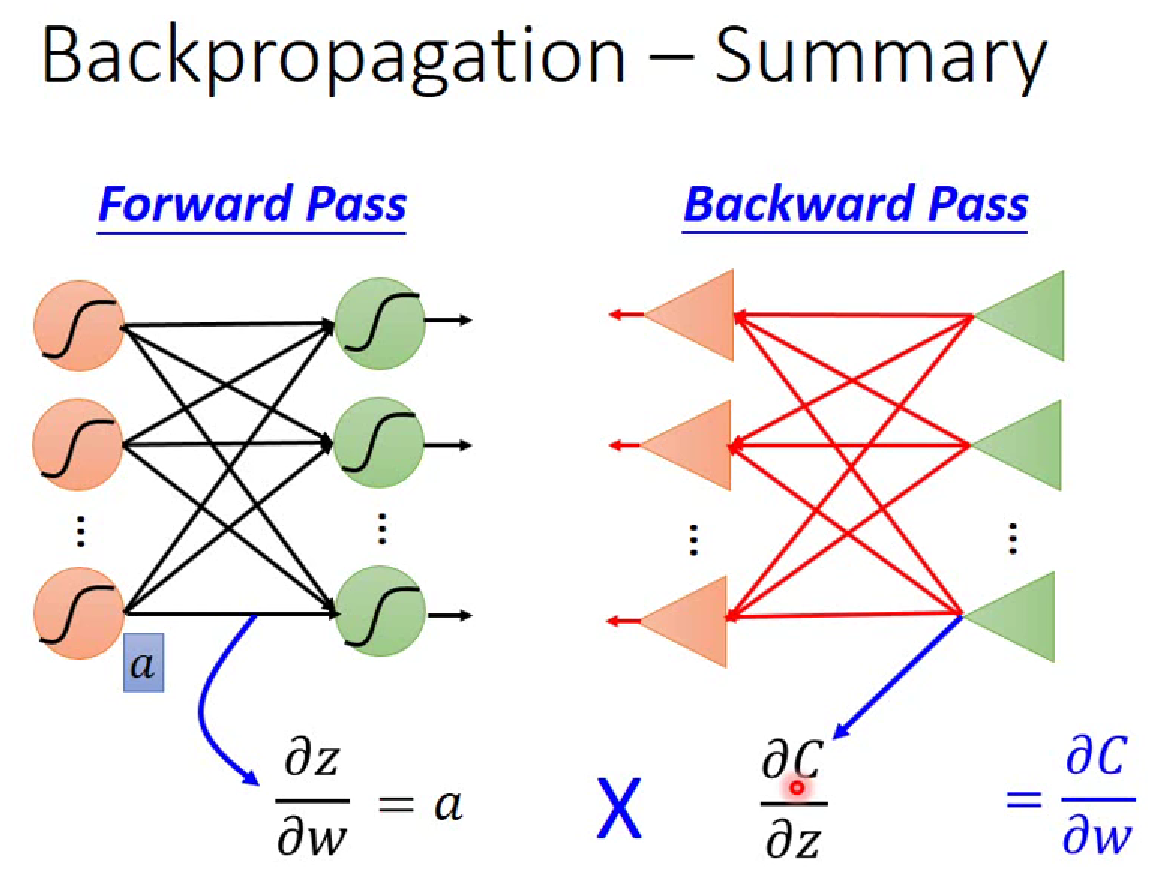

两个阶段:Forward Pass 和 Backward Pass,分别对应求两种不同的偏微分!

-

Backward Pass就是通过反向neural network的过程!注意输入,输出,激活函数分别是什么?

END

浙公网安备 33010602011771号

浙公网安备 33010602011771号