机器学习工程师 - Udacity 强化学习 Part Six

项目:强化学习走迷宫

我们将会应用 Q-learning 算法完成一个经典的 Markov 决策问题 -- 走迷宫!

请查看项目详情 https://github.com/udacity/MLND_CN_P5_Reinforcement_Learning

Section 0 问题描述与完成项目流程

1. 问题描述

在该项目中,你将使用强化学习算法,实现一个自动走迷宫机器人。

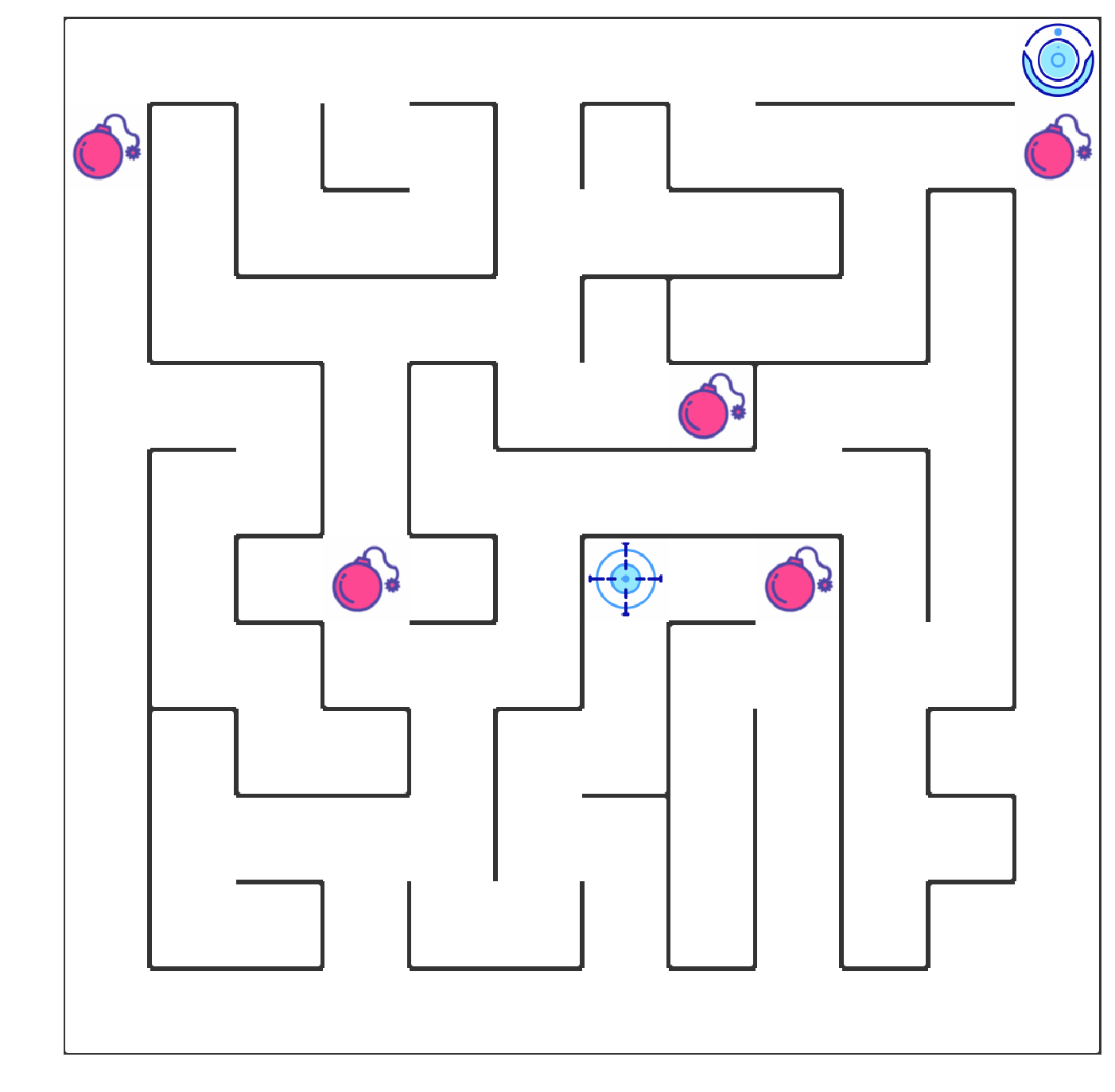

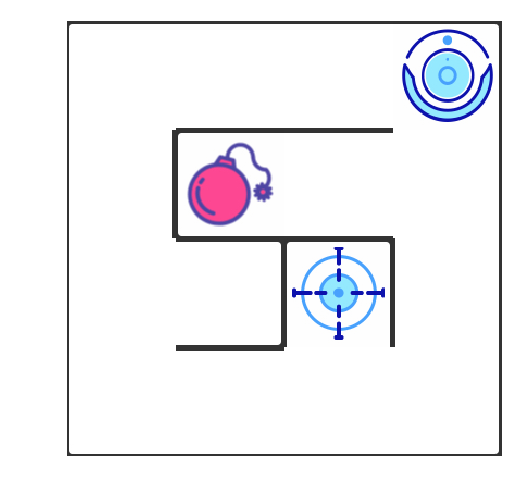

- 如上图所示,智能机器人显示在右上角。在我们的迷宫中,有陷阱(红色炸弹)及终点(蓝色的目标点)两种情景。机器人要尽量避开陷阱、尽快到达目的地。

- 小车可执行的动作包括:向上走

u、向右走r、向下走d、向左走l。 - 执行不同的动作后,根据不同的情况会获得不同的奖励,具体而言,有以下几种情况。我们需要通过修改

robot.py中的代码,来实现一个 Q Learning 机器人,实现上述的目标。- 撞到墙壁:-10

- 走到终点:50

- 走到陷阱:-30

- 其余情况:-0.1

- 我们需要通过修改 robot.py 中的代码,来实现一个 Q Learning 机器人,实现上述的目标。

2. 完成项目流程

-

配置环境,使用

envirnment.yml文件配置名为robot-env的 conda 环境,具体而言,你只需转到当前的目录,在命令行/终端中运行如下代码,稍作等待即可。conda env create -f envirnment.yml安装完毕后,在命令行/终端中运行

source activate robot-env(Mac/Linux 系统)或activate robot-env(Windows 系统)激活该环境。 -

阅读

main.ipynb中的指导完成项目,并根据指导修改对应的代码,生成、观察结果。 - 导出代码与报告,上传文件,提交审阅并优化。

Section 1 算法理解

1. 1 强化学习总览

强化学习作为机器学习算法的一种,其模式也是让智能体在“训练”中学到“经验”,以实现给定的任务。但不同于监督学习与非监督学习,在强化学习的框架中,我们更侧重通过智能体与环境的交互来学习。通常在监督学习和非监督学习任务中,智能体往往需要通过给定的训练集,辅之以既定的训练目标(如最小化损失函数),通过给定的学习算法来实现这一目标。然而在强化学习中,智能体则是通过其与环境交互得到的奖励进行学习。这个环境可以是虚拟的(如虚拟的迷宫),也可以是真实的(自动驾驶汽车在真实道路上收集数据)。

在强化学习中有五个核心组成部分,它们分别是:环境(Environment)、智能体(Agent)、状态(State)、动作(Action)和奖励(Reward)。在某一时间节点 tt:

- 智能体在从环境中感知其所处的状态 st

- 智能体根据某些准则选择动作 at

- 环境根据智能体选择的动作,向智能体反馈奖励 rt+1

通过合理的学习算法,智能体将在这样的问题设置下,成功学到一个在状态 st 选择动作 at 的策略 π(st)=at。

问题 1:请参照如上的定义,描述出 “机器人走迷宫这个问题” 中强化学习五个组成部分对应的实际对象:

- 环境 : 迷宫,包括墙壁、陷阱、终点

- 状态 : 机器人的位置

- 动作 : 向上走、向下走、向左走、向右走

- 奖励 : 撞到墙壁:-10;走到终点:50;走到陷阱:-30;其余情况:-0.1

1.2 计算 Q 值

在我们的项目中,我们要实现基于 Q-Learning 的强化学习算法。Q-Learning 是一个值迭代(Value Iteration)算法。与策略迭代(Policy Iteration)算法不同,值迭代算法会计算每个”状态“或是”状态-动作“的值(Value)或是效用(Utility),然后在执行动作的时候,会设法最大化这个值。因此,对每个状态值的准确估计,是我们值迭代算法的核心。通常我们会考虑最大化动作的长期奖励,即不仅考虑当前动作带来的奖励,还会考虑动作长远的奖励。

在 Q-Learning 算法中,我们把这个长期奖励记为 Q 值,我们会考虑每个 ”状态-动作“ 的 Q 值,具体而言,它的计算公式为:

q(st,a)=Rt+1+γ×maxaq(a,st+1)

也就是对于当前的“状态-动作” (st,a),我们考虑执行动作 a 后环境给我们的奖励 Rt+1,以及执行动作 a 到达 st+1后,执行任意动作能够获得的最大的Q值 maxaq(a,st+1),γ 为折扣因子。

不过一般地,我们使用更为保守地更新 Q 表的方法,即引入松弛变量 alpha,按如下的公式进行更新,使得 Q 表的迭代变化更为平缓。

问题 2:根据已知条件求 q(st,a),在如下模板代码中的空格填入对应的数字即可。

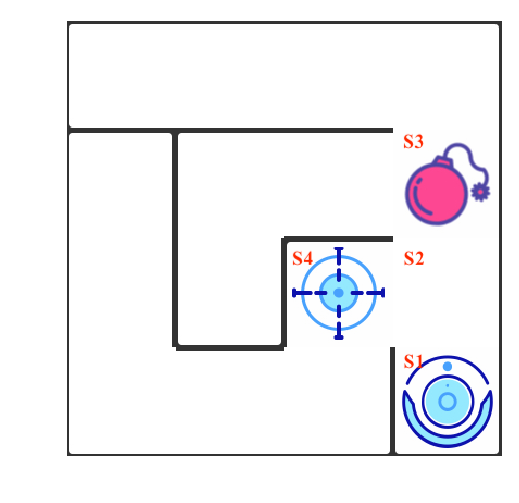

已知:如上图,机器人位于 s1,行动为 u,行动获得的奖励与题目的默认设置相同。在 s2 中执行各动作的 Q 值为:u: -24,r: -13,d: -0.29、l: +40,γ 取0.9。

1.3 如何选择动作

在强化学习中,「探索-利用」问题是非常重要的问题。具体来说,根据上面的定义,我们会尽可能地让机器人在每次选择最优的决策,来最大化长期奖励。但是这样做有如下的弊端:

- 在初步的学习中,我们的 Q 值会不准确,如果在这个时候都按照 Q 值来选择,那么会造成错误。

- 学习一段时间后,机器人的路线会相对固定,则机器人无法对环境进行有效的探索。

因此我们需要一种办法,来解决如上的问题,增加机器人的探索。由此我们考虑使用 epsilon-greedy 算法,即在小车选择动作的时候,以一部分的概率随机选择动作,以一部分的概率按照最优的 Q 值选择动作。同时,这个选择随机动作的概率应当随着训练的过程逐步减小。

问题 3:在如下的代码块中,实现 epsilon-greedy 算法的逻辑,并运行测试代码。

import random

actions = ['u','r','d','l']

qline = {'u':1.2, 'r':-2.1, 'd':-24.5, 'l':27}

epsilon = 0.3 # 以0.3的概率进行随机选择

def choose_action(epsilon):

action = None

if random.uniform(0,1) > epsilon: # 以某一概率

action = random.choice(actions) # 实现对动作的随机选择

else:

action = max(qline, key=qline.get) # 否则选择具有最大 Q 值的动作

return action

choose_action(epsilon)

Section 2 代码实现

2.1. Maze 类理解

我们首先引入了迷宫类 Maze,这是一个非常强大的函数,它能够根据你的要求随机创建一个迷宫,或者根据指定的文件,读入一个迷宫地图信息。

- 使用

Maze("file_name")根据指定文件创建迷宫,或者使用Maze(maze_size=(height,width))来随机生成一个迷宫。 - 使用

trap_number参数,在创建迷宫的时候,设定迷宫中陷阱的数量。 - 直接键入迷宫变量的名字按回车,展示迷宫图像(如

g=Maze("xx.txt"),那么直接输入g即可。 - 建议生成的迷宫尺寸,长在 6~12 之间,宽在 10~12 之间。

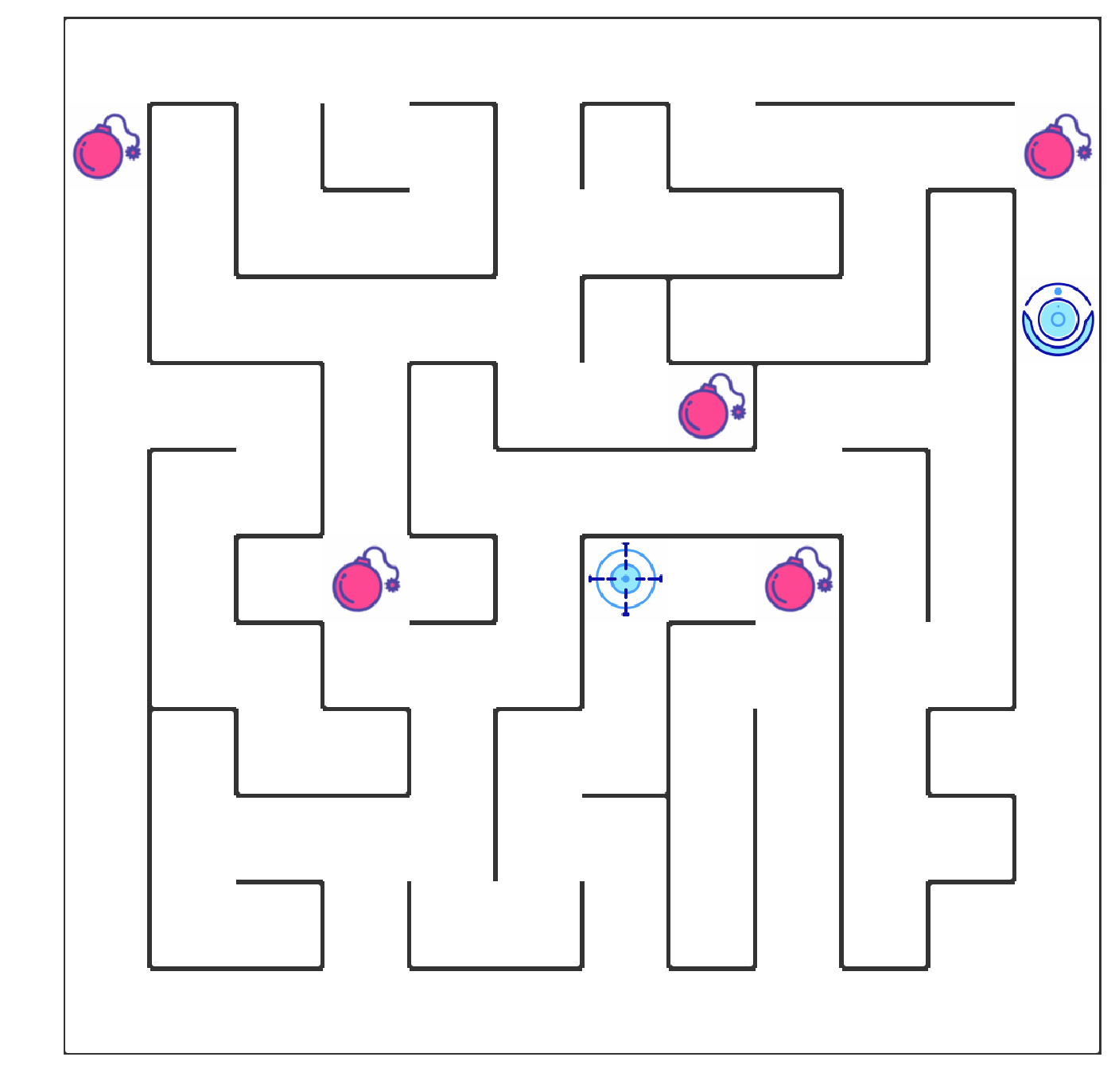

问题 4:在如下的代码块中,创建你的迷宫并展示。

from Maze import Maze

%matplotlib inline

%config InlineBackend.figure_format = 'retina'

## todo: 创建迷宫并展示

g = Maze(maze_size=(12,12), trap_number=5)

g

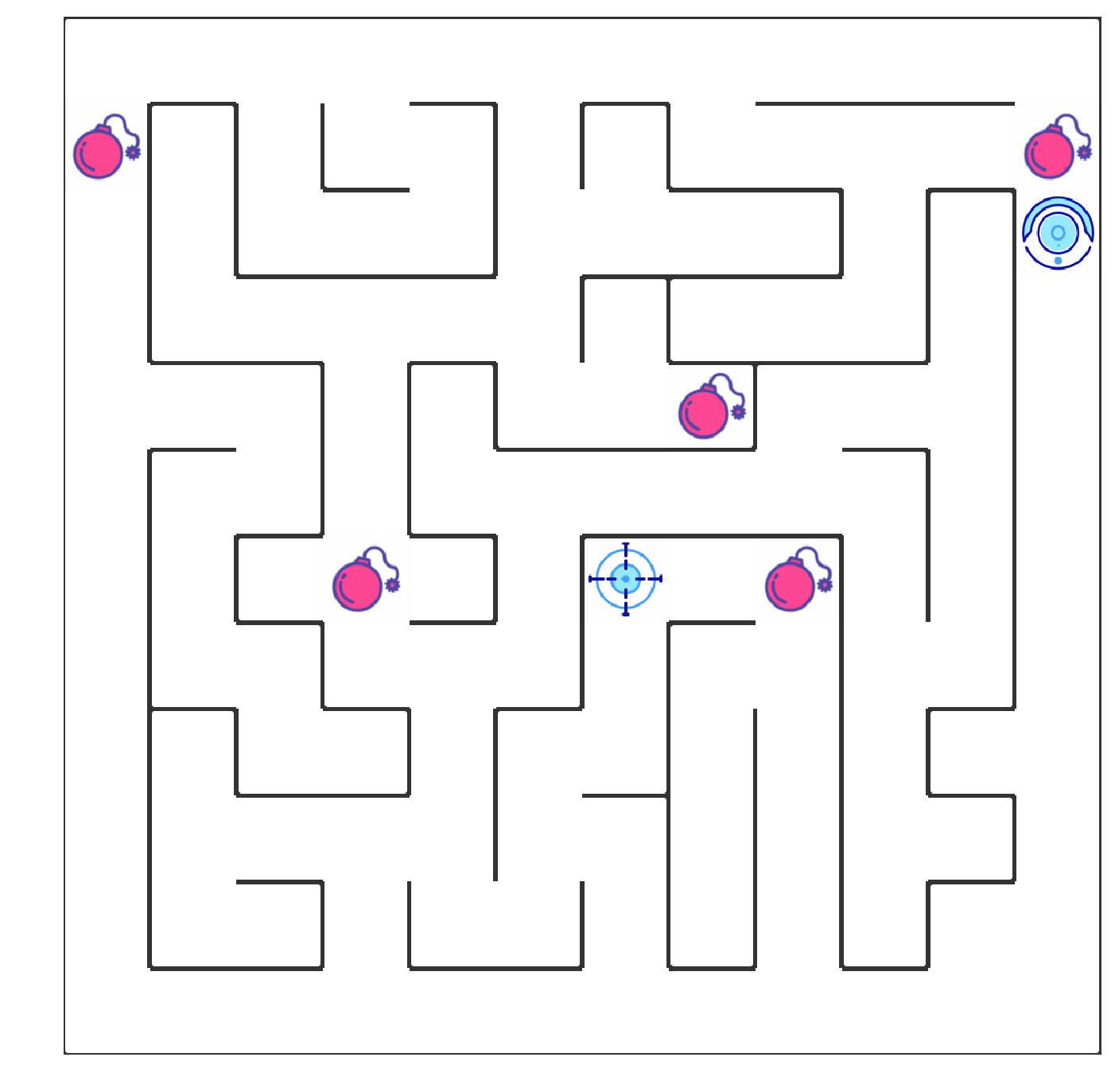

你可能已经注意到,在迷宫中我们已经默认放置了一个机器人。实际上,我们为迷宫配置了相应的 API,来帮助机器人的移动与感知。其中你随后会使用的两个 API 为 maze.sense_robot() 及 maze.move_robot()。

maze.sense_robot()为一个无参数的函数,输出机器人在迷宫中目前的位置。maze.move_robot(direction)对输入的移动方向,移动机器人,并返回对应动作的奖励值。

问题 5:随机移动机器人,并记录下获得的奖励,展示出机器人最后的位置。

rewards = []

## 循环、随机移动机器人10次,记录下奖励

for i in range(10):

rewards.append(g.move_robot(random.choice(actions)))

## 输出机器人最后的位置

print(g.sense_robot())

## 打印迷宫,观察机器人位置

g

2.2. Robot 类实现

Robot 类是我们需要重点实现的部分。在这个类中,我们需要实现诸多功能,以使得我们成功实现一个强化学习智能体。总体来说,之前我们是人为地在环境中移动了机器人,但是现在通过实现 Robot 这个类,机器人将会自己移动。通过实现学习函数,Robot 类将会学习到如何选择最优的动作,并且更新强化学习中对应的参数。

首先 Robot 有多个输入,其中 alpha=0.5, gamma=0.9, epsilon0=0.5 表征强化学习相关的各个参数的默认值,这些在之前你已经了解到,Maze 应为机器人所在迷宫对象。

随后观察 Robot.update 函数,它指明了在每次执行动作时,Robot 需要执行的程序。按照这些程序,各个函数的功能也就明了了。

最后你需要实现 Robot.py 代码中的8段代码,他们都在代码中以 #TODO 进行标注,你能轻松地找到他们。

问题 6:实现 Robot.py 中的8段代码,并运行如下代码检查效果(记得将 maze 变量修改为你创建迷宫的变量名)。

from Robot import Robot

robot = Robot(g) # 记得将 maze 变量修改为你创建迷宫的变量名

robot.set_status(learning=True,testing=False)

print(robot.update())

g

2.3 用 Runner 类训练 Robot

在实现了上述内容之后,我们就可以开始对我们 Robot 进行训练并调参了。我们为你准备了又一个非常棒的类 Runner,来实现整个训练过程及可视化。使用如下的代码,你可以成功对机器人进行训练。并且你会在当前文件夹中生成一个名为 filename 的视频,记录了整个训练的过程。通过观察该视频,你能够发现训练过程中的问题,并且优化你的代码及参数。

问题 7:尝试利用下列代码训练机器人,并进行调参。可选的参数包括:

- 训练参数

- 训练次数

epoch

- 训练次数

- 机器人参数:

epsilon0(epsilon 初值)epsilon衰减(可以是线性、指数衰减,可以调整衰减的速度),你需要在 Robot.py 中调整alphagamma

- 迷宫参数:

- 迷宫大小

- 迷宫中陷阱的数量

## 可选的参数:

epoch = 20

epsilon0 = 0.3

alpha = 0.5

gamma = 0.9

maze_size = (6,6)

trap_number = 1

from Runner import Runner

g = Maze(maze_size=maze_size,trap_number=trap_number)

r = Robot(g,alpha=alpha, epsilon0=epsilon0, gamma=gamma)

r.set_status(learning=True)

runner = Runner(r, g)

runner.run_training(epoch, display_direction=True)

# runner.generate_movie(filename = "final1.mp4") # 你可以注释该行代码,加快运行速度,不过你就无法观察到视频了。

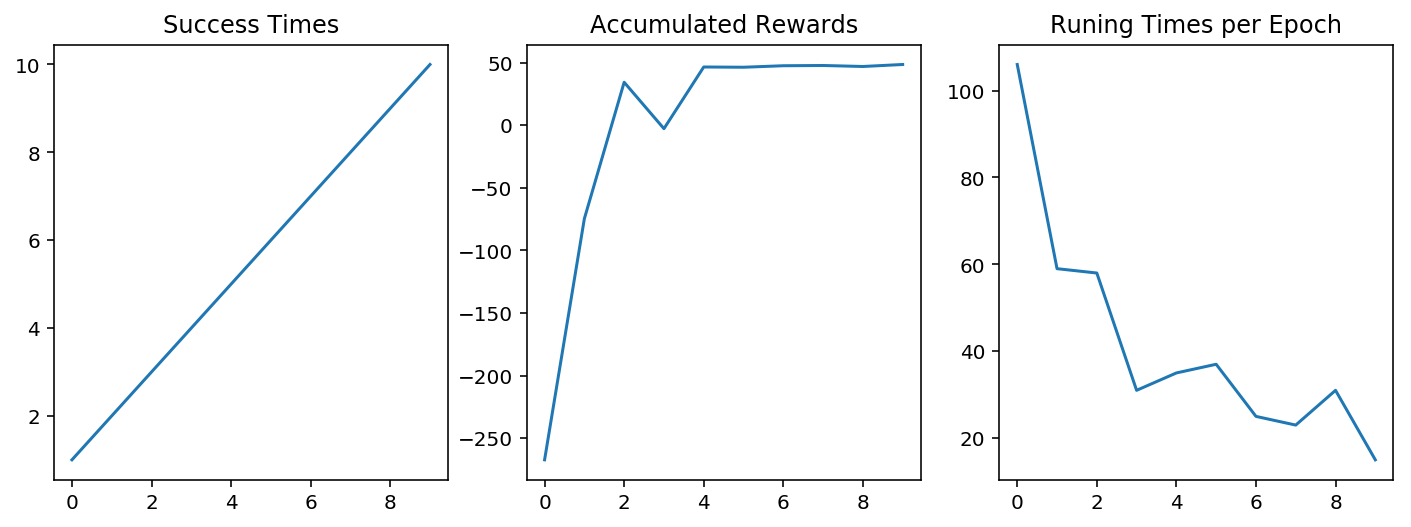

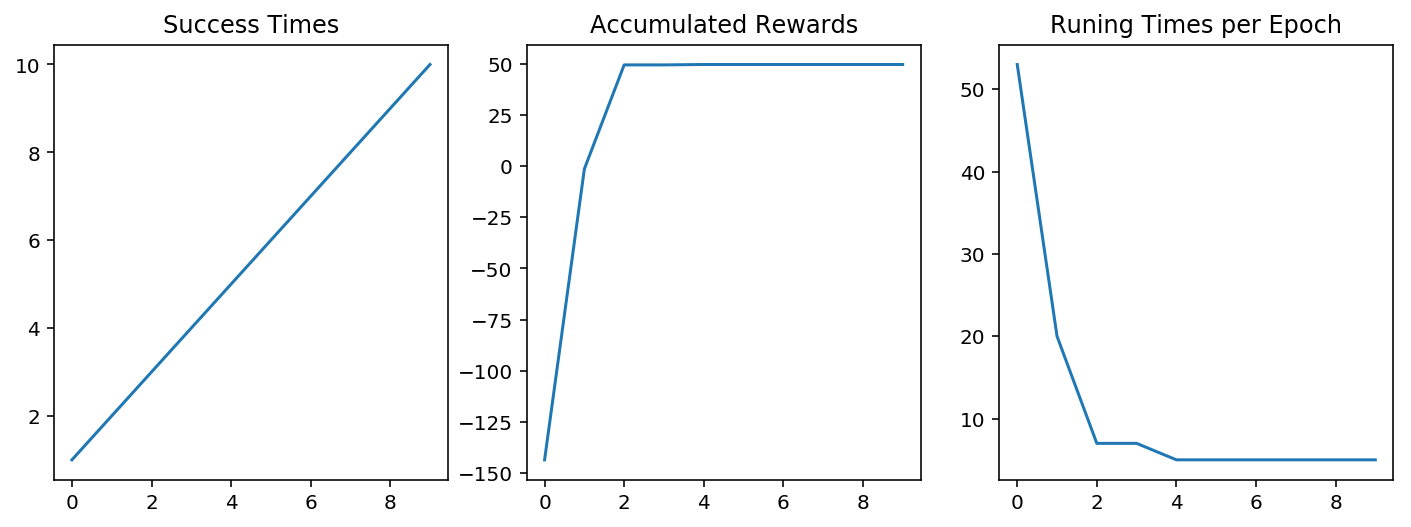

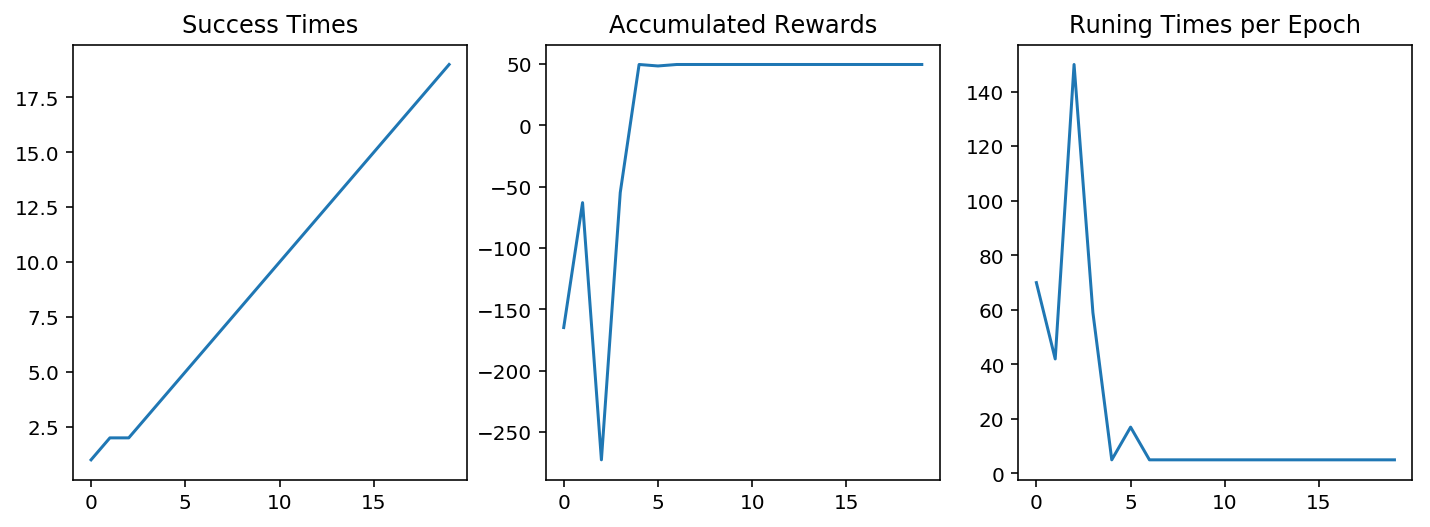

使用 runner.plot_results() 函数,能够打印机器人在训练过程中的一些参数信息。

- Success Times 代表机器人在训练过程中成功的累计次数,这应当是一个累积递增的图像。

- Accumulated Rewards 代表机器人在每次训练 epoch 中,获得的累积奖励的值,这应当是一个逐步递增的图像。

- Running Times per Epoch 代表在每次训练 epoch 中,小车训练的次数(到达终点就会停止该 epoch 转入下次训练),这应当是一个逐步递减的图像。

问题 8:使用 runner.plot_results() 输出训练结果,根据该结果对你的机器人进行分析。

- 指出你选用的参数如何,选用参数的原因。

- 建议你比较不同参数下机器人的训练的情况。

- 训练的结果是否满意,有何改进的计划。

runner.plot_results()

runner.plot_results()

runner.plot_results()

选用的参数: epoch=20,训练次数如果太少,有可能机器人永远无法成功走到终点; epsilon0=0.5,较大的初始值使得机器人在刚开始的时候尝试更多的可能性; alpha=0.5,权衡上一次学到结果和这一次学习结果,这里取它们的均值; gamma=0.9,充分地对外来奖励进行考虑,如果取值较小,机器人可能无法学习到一个到达终点的策略; maze_size=(6,6),迷宫太大,需要的训练次数需要增加,机器人每次得到的奖励将减少; trap_number=1,陷阱过多会减少机器人得到的奖励。 对训练的结果比较满意; 改进计划: 增加epoch的值; 减小epsilon0的值;

import random

class Robot(object):

def __init__(self, maze, alpha=0.5, gamma=0.9, epsilon0=0.5):

self.maze = maze

self.valid_actions = self.maze.valid_actions

self.state = None

self.action = None

# Set Parameters of the Learning Robot

self.alpha = alpha

self.gamma = gamma

self.epsilon0 = epsilon0

self.epsilon = epsilon0

self.t = 0

self.Qtable = {}

self.reset()

def reset(self):

"""

Reset the robot

"""

self.state = self.sense_state()

self.create_Qtable_line(self.state)

def set_status(self, learning=False, testing=False):

"""

Determine whether the robot is learning its q table, or

exceuting the testing procedure.

"""

self.learning = learning

self.testing = testing

def update_parameter(self):

"""

Some of the paramters of the q learning robot can be altered,

update these parameters when necessary.

"""

if self.testing:

# TODO 1. No random choice when testing

self.epsilon = 0

else:

# TODO 2. Update parameters when learning

self.epsilon *= 0.9

return self.epsilon

def sense_state(self):

"""

Get the current state of the robot. In this

"""

# TODO 3. Return robot's current state

return self.maze.sense_robot()

def create_Qtable_line(self, state):

"""

Create the qtable with the current state

"""

# TODO 4. Create qtable with current state

# Our qtable should be a two level dict,

# Qtable[state] ={'u':xx, 'd':xx, ...}

# If Qtable[state] already exits, then do

# not change it.

if state in self.Qtable:

pass

else:

self.Qtable[state] = {'u':0.0, 'r':0.0, 'd':0.0, 'l':0.0}

def choose_action(self):

"""

Return an action according to given rules

"""

def is_random_exploration():

# TODO 5. Return whether do random choice

# hint: generate a random number, and compare

# it with epsilon

return random.uniform(0, 1) < self.epsilon

if self.learning:

if is_random_exploration():

# TODO 6. Return random choose aciton

return random.choice(self.valid_actions)

else:

# TODO 7. Return action with highest q value

return max(self.Qtable[self.state], key=self.Qtable[self.state].get)

elif self.testing:

# TODO 7. choose action with highest q value

return max(self.Qtable[self.state], key=self.Qtable[self.state].get)

else:

# TODO 6. Return random choose aciton

return random.choice(self.valid_actions)

def update_Qtable(self, r, action, next_state):

"""

Update the qtable according to the given rule.

"""

if self.learning:

# TODO 8. When learning, update the q table according

# to the given rules

self.Qtable[self.state][action] += self.alpha * (r + self.gamma * float(max(self.Qtable[next_state].values()) - self.Qtable[self.state][action]))

def update(self):

"""

Describle the procedure what to do when update the robot.

Called every time in every epoch in training or testing.

Return current action and reward.

"""

self.state = self.sense_state() # Get the current state

self.create_Qtable_line(self.state) # For the state, create q table line

action = self.choose_action() # choose action for this state

reward = self.maze.move_robot(action) # move robot for given action

next_state = self.sense_state() # get next state

self.create_Qtable_line(next_state) # create q table line for next state

if self.learning and not self.testing:

self.update_Qtable(reward, action, next_state) # update q table

self.update_parameter() # update parameters

return action, reward

posted on 2019-02-27 19:36 paulonetwo 阅读(1405) 评论(0) 编辑 收藏 举报