Adaboost

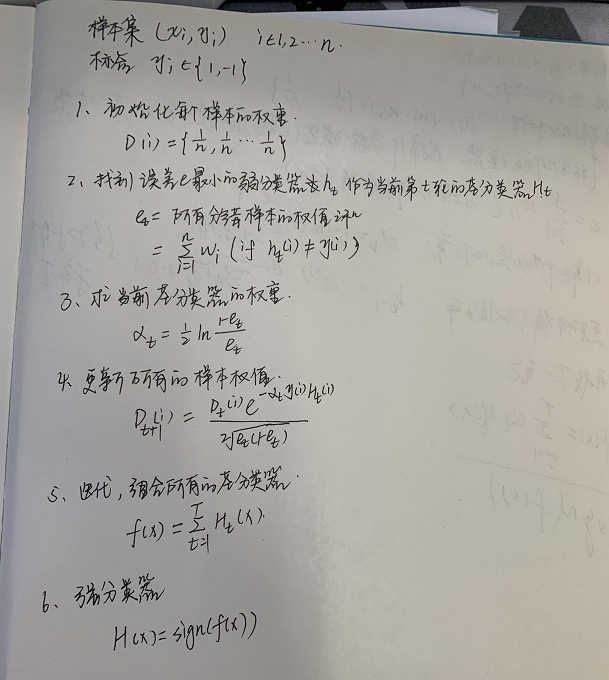

1、权值更新方法

(1)初始化权值分布;

(2)找分类误差最小的弱分类器;

(3)计算出该弱分类器的权值;

(4)更新权值分布;

(5)集合所有弱分类器得到最终的强分类器。

2、adaboost快速收敛为什么?

因为当前轮分错的样本的权重会在下一轮训练中得的提高,下一轮弱分类器为了达到较低的分类误差,会把样本权重高的样本纷分正确。

3、Adaboost 的优缺点?

能够基于泛化性能相当弱的的学习器构建出很强的集成,不容易发生过拟合。

对异常样本比较敏感,异常样本在迭代过程中会获得较高的权值,影响最终学习器的性能表现。

4、和GBDT有什么区别?

Adaboost通过不断修改权重、不断加入弱分类器进行boosting;GBDT通过不断在负梯度方向上加入新的树进行boosting。

5、推导?