【学位论文阅读】非迭代前向神经网络模型的研究

(1)神经网络相关

① 前向网络中,各个神经元接受前一级的输入,并输出到下一级,网络中没有反馈:可以用一个有向无环路图表示。这种网络实现信号从输入空间到输出空间的变换,它的信息处理能力来自于简单非线性函数的多次复合。网络结构简单,易于实现。

② 反馈网络内,神经元间有反馈,可以用一个无向的完备图表示。这种神经网络的信息处理是状态的变换,可以用动力学系统理论处理。系统的稳定性与联想记忆功能有密切关系。

在监督学习中,将训练样本的数据加到网络输入端,同时将相应的期望输出与网络输出相比较,得到误差信号,以此控制权值连接强度的调整,经多次训练后收敛到一个确定的权值。

③ “混纯”是指由确定性方程描述的动力学系统中表现出的非确定性行为,或称之为确定的随机性。“确定性”是因为它由内在的原因而不是外来的噪声或干扰所产生,而“随机性”是指其不规则的、不能预测的行为,只可能用统计的方法描述。

(2)BP网络

采用BP算法的多层神经网络模型一般称为BP网络。它由输入层、隐层、输出层组成。网络的学习过程由两部分组成:正向传播和反向传播。

当正向传播时,信息从输入层经隐层处理后传向输出层,每一层神经元的状态只影响下一层的神经元状态。如果在输出层得不到希望的输出,则转入反向传播,将误差信号沿原来的神经元连接通路返回。

返回过程中,逐一修改各层神经元连接的权值。这种过程不断迭代,最后使得误差信号达到允许的范围之内。

(3)文章工作

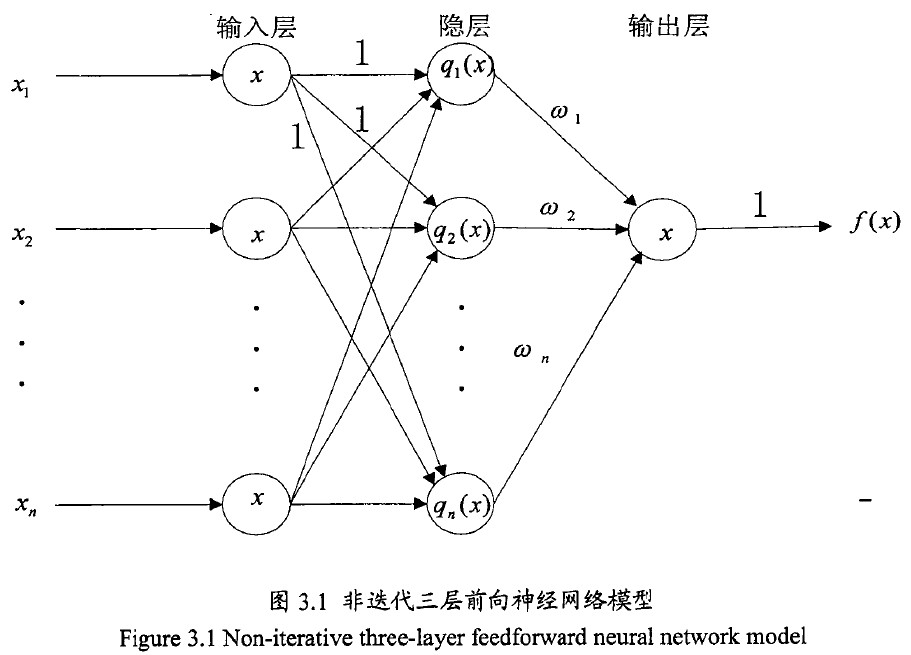

构造一个具有单隐层的多输入单输出的前向神经网络,该网络隐层神经元的激励函数是“一组已知的正交函数或者线性无关函数”,该网络的输入层与隐层神经元之间连接权值为固定值、隐层与输出层神经元之间的连接权值为“未知的非线性目标函数”的逼近多项式系数。然后,对误差函数(是非凸函数)进行凸化变换,在凸函数的前提下,依据负梯度下降最快的思想,推导出最优稳态权值的计算公式,不再需要迭代求解权值;最后,依据最优稳态的网络权值,生成一个非迭代前向神经网络,实现该网络的趋势预测功能。

研究表明,在有合理的结构和恰当权值的条件下,3层前馈网络可以逼近任意的连续函数。所以从简捷实用的角度一般选取1个隐层。

到目前为止,还没有很快确定网络参数(指隐层数和隐层神经元数)的固定方法可循,但通常设计多层前馈网络时,可按下列步骤进行:

1、对任何实际问题都只选用1个隐层;

2、使用较少的隐层神经元数;

3、增加隐层神经元个数,直到获得满意的性能为止,否则,再采用2到多个隐层。

有关研究表明,隐含层数的增加,可以形成更加复杂的决策域,使网络解决非线性问题的能力得到加强;合理的隐含层数能使网络的系统误差最小。本文只对3层神经网络进行研究。

浙公网安备 33010602011771号

浙公网安备 33010602011771号