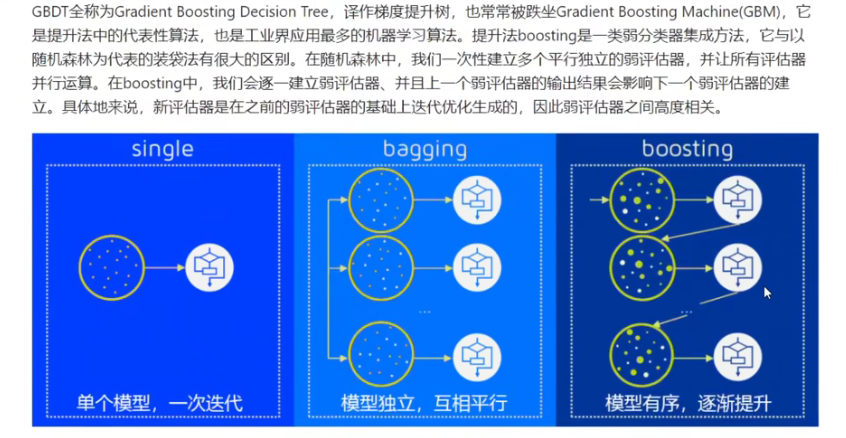

集成算法--GBDT梯度提升树

三要素:

损失函数L(x,y): 真实值和预测值之间的差异

弱评估器f(x):效果差的模型

综合集成规则:数据、特征处理方法,构建迭代过程,参数设置等

基本训练流程:以上一个弱评估器的结果,计算损失函数,并以最小化L(x,y)为目标影响下一个弱评估器的构建

Boosting 算法中所有的弱评估器都是回归树,

用于分类的话,在回归基础上加上sigmoid函数或者softmax函数构建。

树的尺寸要小,防止过拟合

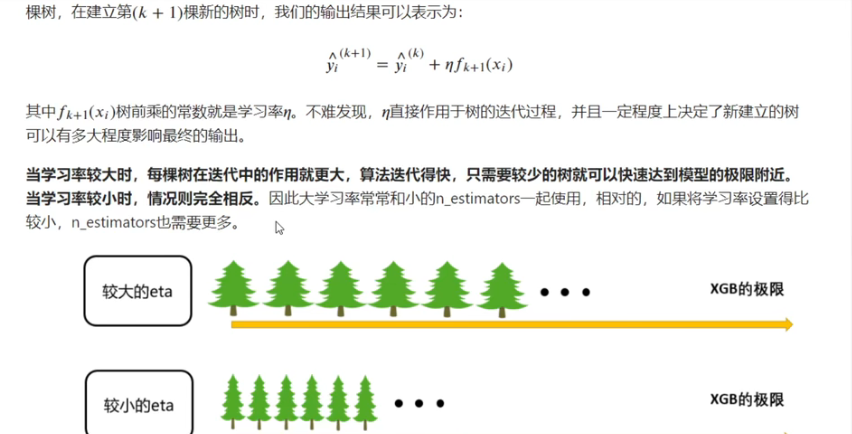

树的数量要多,得到更好的效果

调小学习率,得到更好的效果

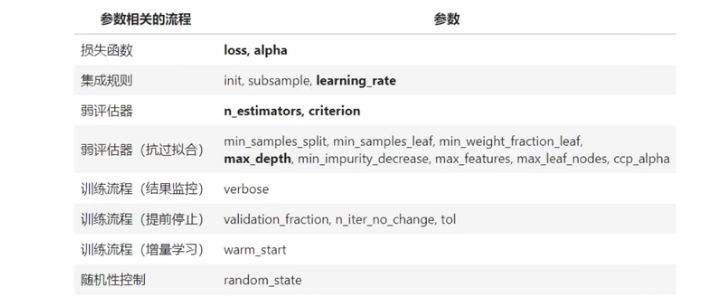

learning rate 学习率,步长 ,控制每棵树的增长速度

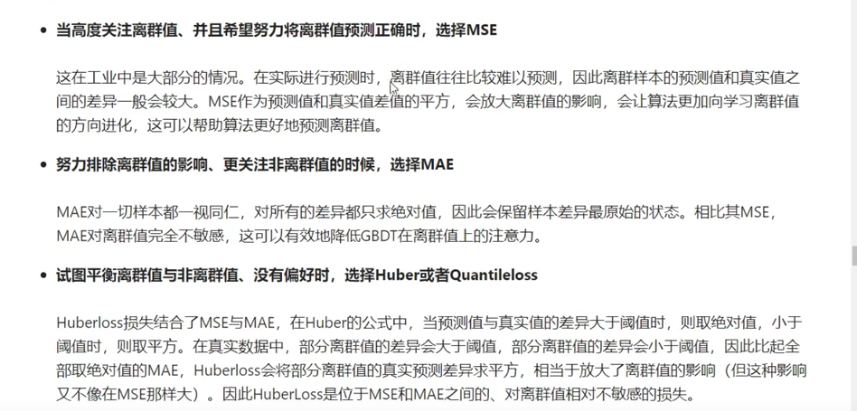

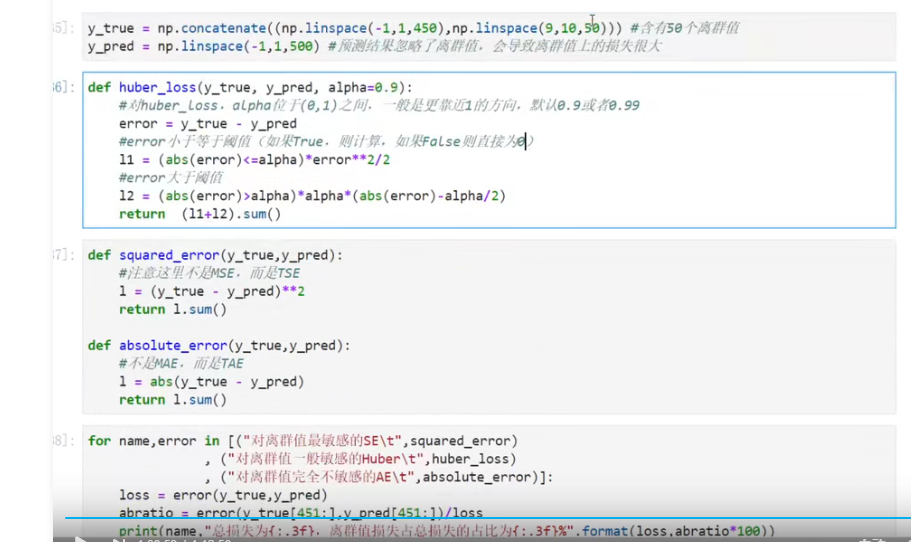

损失函数

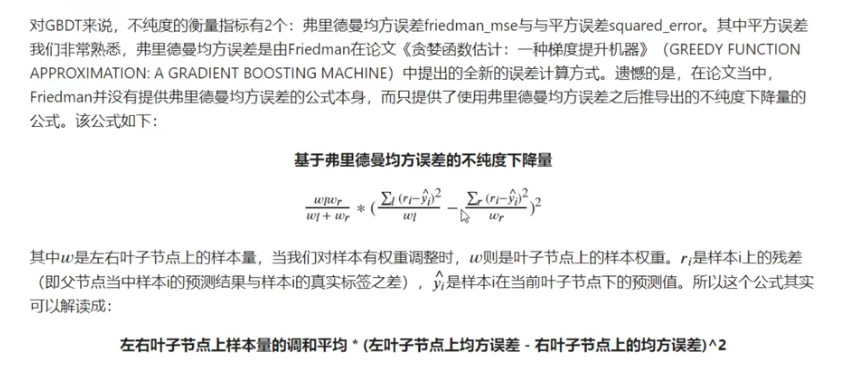

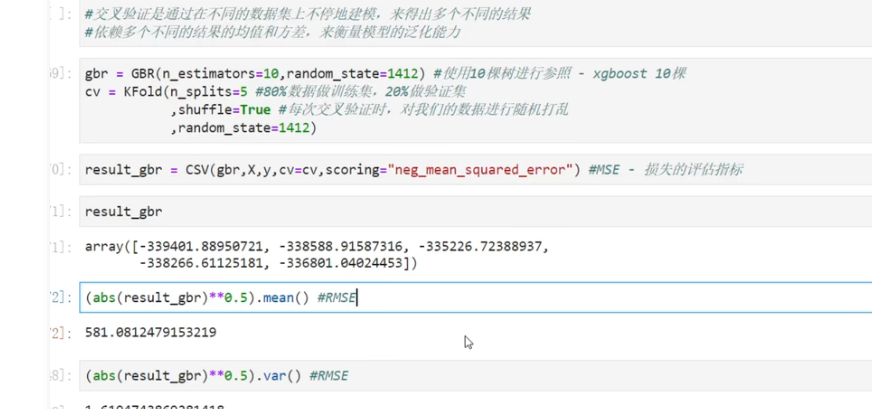

不纯度的指标 弗里德曼均方误差friedman_mse 与 平方误差

浙公网安备 33010602011771号

浙公网安备 33010602011771号