优雅的线性代数系列一

说道线性代数, 我们自然就想到矩阵, 那我们该如何理解矩阵呢?

矩阵与线性变换

若一个变换 \(L\) 满足以下两条性质

则称 \(L\) 是线性的.

由线性变换成比例性质可知,线性变换不会改变坐标系的原点, 即零向量的线性变换结果还是零向量.

我们来看看矩阵与线性变换的关系

可以看出矩阵完全满足线性变换的要求, 将矩阵看做线性变换, 这会给我们理解很多线性问题带来好处.

\(\bigstar\) 如果想知道线性变换对于一个输入向量空间有什么影响, 我们只需要知道该线性变换对该输入空间的基有什么影响.

假设 n 维输入空间 \(R^n\) 的基为 \(v1, v_2, \dots,v_n\)

其中 \(c =\begin{bmatrix} c_1\\ c_2\\ \vdots \\c_n \end{bmatrix}\) 即为 \(v\) 在该基下的坐标.

下面复合线性变换的会给出例子直观的看看.

复合线性变换

我们可以通过线性变换具有顺序性的的角度理解下面矩阵乘积的性质

\(\bigstar\) 矩阵的乘积 $ A B $ 可以看成是 复合线性变换. 复合线性变换可以看成两个线性变换有序叠加. 下面通过一个例子说明.

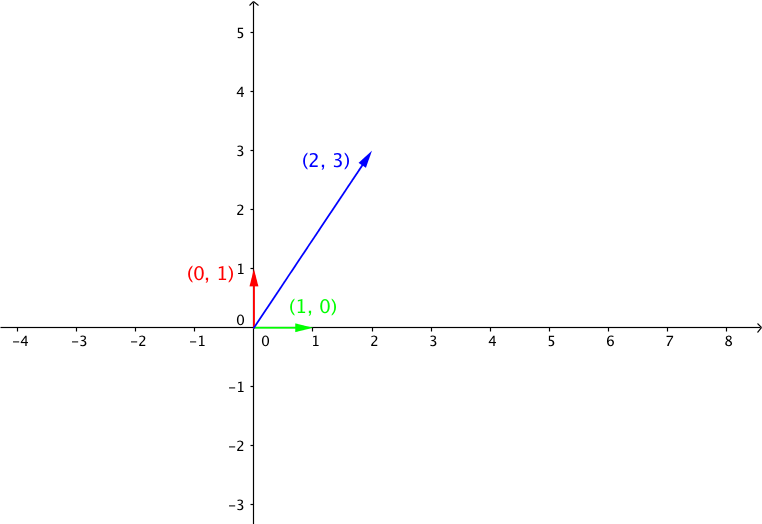

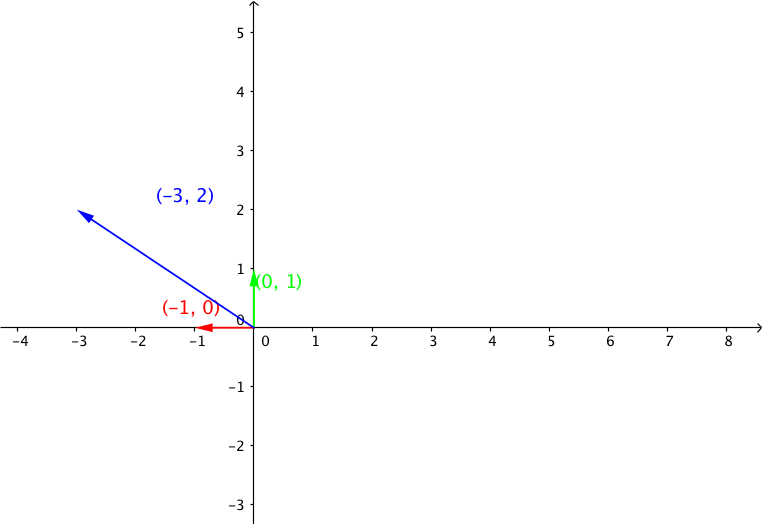

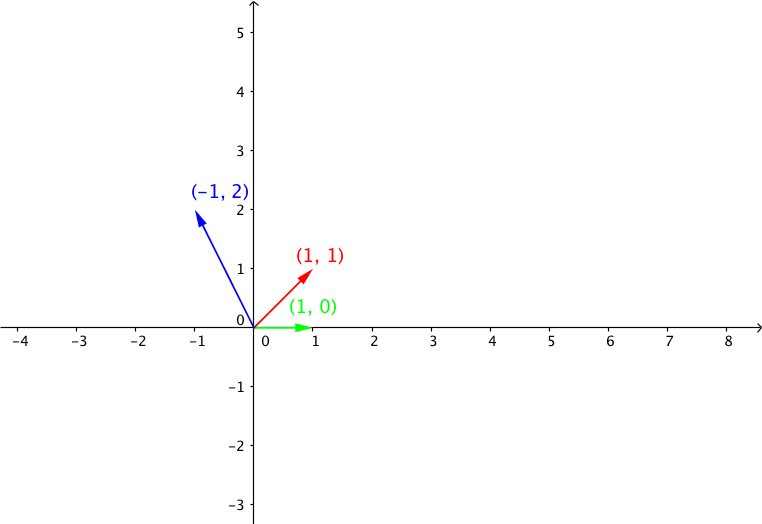

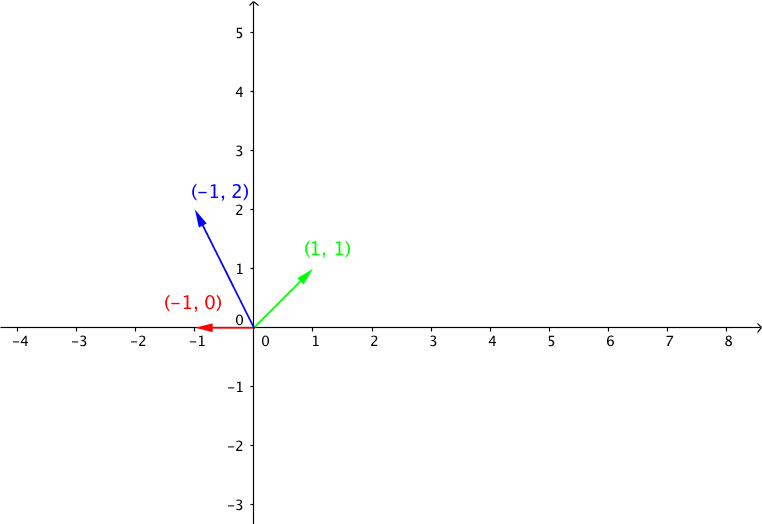

考虑 向量 $\vec v =[2, 3]^T $, 首先将该向量逆时针旋转 \(90^{\circ}\), 然后进行剪切变换.

由于在二维标准正交坐标系中, 基向量组成矩阵是单位矩 I, BI = B, 所以 矩阵 B 的列向量 就是基向量的经过线性变换 B 的变换结果.

向量 $ v =[2, 3]^T $

线性变换B: 向量 $ u = B v =[-3, 2]^T$, 其中 \(B=\begin{bmatrix} 0&-1 \\ 1&0\end{bmatrix}\)

线性变换A: 向量 $ w = Au = [-1,2]^T$, 其中 \(A = \begin{bmatrix} 1&1 \\ 0&1\end{bmatrix}\)

可以看出基向量的线性变换结果就是矩阵 A, B 的对应的列向量.

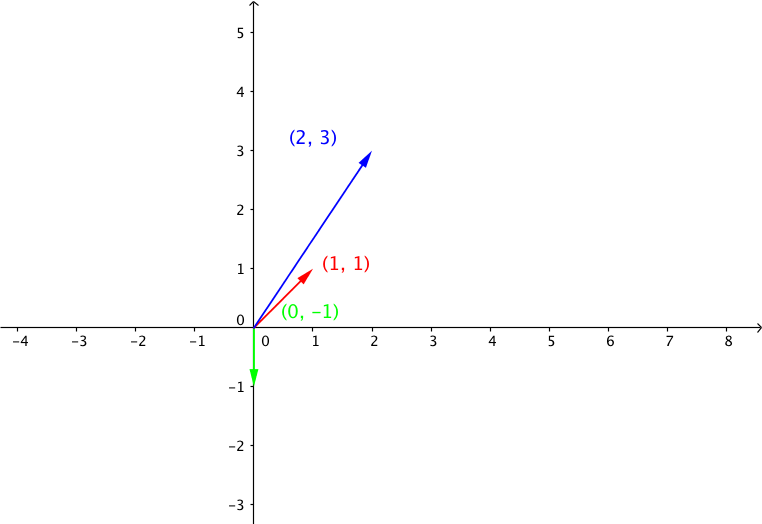

我们再来看看复合线性变换C 的线性变换

复合线性变换 C, 向量 \(p = Cv\), 其中 \(C=\begin{bmatrix} 1&-1 \\ 1&0\end{bmatrix}\)

向量\(v\) 变换结果 \(w = p\)。

逆矩阵和逆变换

\(b= Ax\) 表明矩阵 A 将向量 x 线性映射到 向量 b, 那如何将向量 b 变回到之前的向量 x 呢? 我们只需要进行逆变换就好了, 而逆变换对应的矩阵就是逆矩阵.

\(|A| \not= {0}\) 矩阵的行列式不为零表示线性变换不会将高维映射到低维, 即不会损失信息, 所以可以通过逆变换得到变换之前的向量.

还是 复合线性变换的例子 其中

可逆矩阵的定义为

求逆运算 \(Gussian{\rm -}Jordan\) 消元法

\(🎵\) 非奇异矩阵杂谈

可逆矩阵又称为非奇异矩阵, 不可逆矩阵称为奇异矩阵

Q: “奇异”一词通常指奇特的,为什么称可逆矩阵为“非奇异” ?它们有什么奇异之处?

A: 数学上, “奇异”(singular)一词用来形容破坏了某种优良性质的数学对象。

对于矩阵来说, “可逆”是一个好的性质, 不可逆的矩阵就称为“奇异”矩阵。 比如矩阵的不可逆,等价于行列式为零或非满秩,等价于某个线性变换退化. 所有的矩阵都可看作线性变换. 这个奇异性就很好理解了, 变换完丢失了东西的情况都是不好的, 也就是奇异的。

行列式的几何意义

二维坐标中, 线性变换 \(\vec A\) 的行列式 \(|A|\) 的绝对值 \(\lambda\) 表示变换后区域的面积是变换前的 \(\lambda\) 倍; 如果行列式的值 \(det \vec A\)为负数表示这样的变换改变了空间的定向. 在三维空间中, 线性变换 \(\vec A\) 的行列式 \(|A|\) 的值可以理解为体积的变化.

初等变换

初等矩阵左乘矩阵 \(\longrightarrow\) 行变换

\(row_2 - 3 row_1\)

初等矩阵右乘矩阵 \(\longrightarrow\) 列变换

向量空间

n维向量空间 \(\mathbb R^n\)

给定域F,F 上的向量空间 V 是一个集合,其上定义了两种二元运算:

- 向量加法: 把 V 中的两个元素u和v映射到V中另一个元素,记作 u + v;

- 标量乘法: 把 F 中的一个元素 a 和 V 中的一个元素 u 变为 V 中的另一个元素,记作 a ·u。

\(\bigstar\) 零向量一定在向量空间

向量子空间

线性代数中子空间的定义

设W为数域F上的n维线性空间V的子集合(即W∈V),若W中的元素满足

(1)若任意的α,β∈W,则α+β∈W;(对加法是封闭的)

(2)若任意的α∈W,λ∈F,则λα∈W。(对数乘也是封闭的)

(3)子空间中必须包含“0向量”

则容易证明:W也构成数域F上的线性空间。称W是线性空间V的一个线性子空间,简称子空间。

比如说 3维向量空间 \(R^3\) 的子空间

- \(R^3\)

- 可以是一条过原点(0,0,0)的平面;

- 可以是一条过原点(0,0,0)的直线;

- 零向量空间(只包含零向量)

如果 U, V 是向量空间 P 的子空间, 那么 \(S = U\cap V\)也是 P 的子空间

在 \(U, V\) 中, \(a, b\) 符合加法封闭性和乘法封闭性, 即 \(a, b\) 的张成的向量空间同时在 \(U 和 V\) 中, 所以 \(a, b\) 的张成的向量空间在 \(S\) 中, 即 \(S\) 空间中符合加法封闭性和乘法封闭性, 所以 \(S\) 也是 \(P\) 的子空间.

正交子空间

\(\square\) 向量子空间正交

① 若内积空间中两向量的内积为0,则它们正交。

② 若内积空间中的向量 \(v\) 与子空间A中的每个向量都正交,那么这个向量和子空间 A 正交。

③ 若内积空间的子空间 A 和 B 满足一者中的每个向量都与另一者正交,那么它们互为正交子空间。

(正交子空间只有一个交点, 即零点)

矩阵空间

矩阵是一种特殊的向量的空间, 满足加法封闭性和数乘封闭性

比如说全部 \(R^{n \times n}\) 矩阵组成的矩阵空间(matrix space), 满足加法封闭性和数乘封闭性

其子空间包括 三角矩阵, 对称矩阵, 对角矩阵

那么矩阵空间 \(M\) 的基是什么?

就 3 维矩阵空间而言, 维度 dim = 9, 基为

3维对称矩阵空间 U 的维度为 dim = 6

3维三角矩阵空间 V 的维度为 dim = 6

3维对角矩阵空间 S 的维度为 dim = 3, \(S = U \cap V\)

\(U \cup V\) 不是向量空间.所以不考虑; \(U + V\)表示向量空间 U, V 的基向量张成的空间, 这里 \(U + V\)就是3维矩阵空间(二者的基组合可以得到3维矩阵空间的基), 维度为 9.

介绍另一个向量空间,

这里 \(\sin x, \cos x\) 是二街常微分方程解空间的基向量, 虽然 \(\sin x, \cos x\) 并不那么像向量, 而是函数. 我们可以看到线性代数的知识的应用.

四个基本子空间

\(\blacksquare\) 矩阵 \(A^{m \times n}\) 的行空间和零空间正交, 行空间和零空间是将整个 n 维空间一分为二的两个相互正交的子空间; 称为 n 维空间的正交补, 即零空间包含所有正交于行空间的向量.

\(\bigstar\) 正交补并不意味着二者并集等于整个 n 维空间, 比如二维空间中垂直的两条直线, 互为正交补, 却二者并集只是二维空间的一小部分而已.

零空间是方程 \(Ax=0\) 解

所以矩阵 A 的行空间和 A 的零空间正交.

矩阵乘以列向量是矩阵列的线性组合, 结果为列向量;

行向量乘以矩阵是矩阵行的线性组合, 结果为行向量.

下面可一个简单的 矩阵乘以列向量 的例子

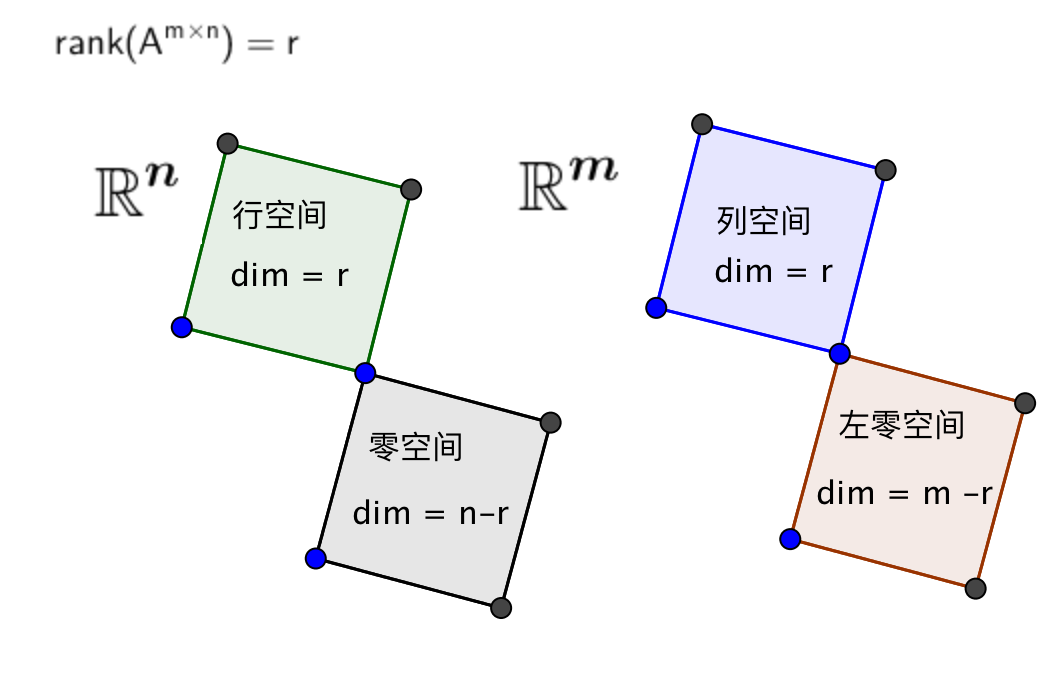

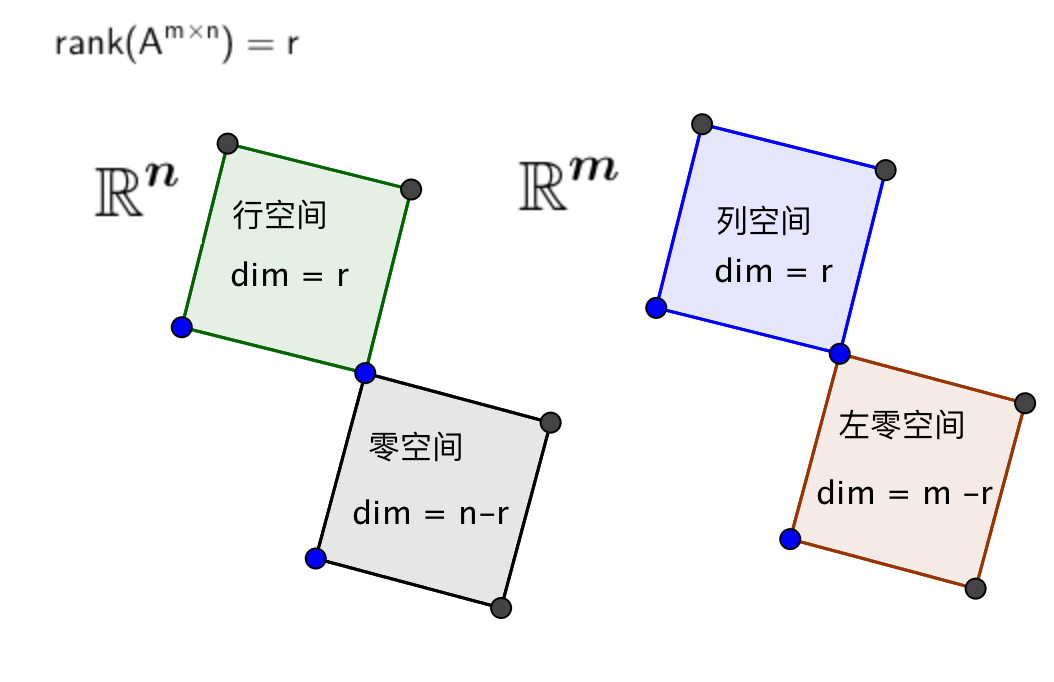

矩阵\(A^{m\times n}\)的四个基本子空间

① 列空间 column space \(C(A) \subset R^m, R^m的子空间\)

② 行空间 row space \(C(A^T) \subset R^n\)

③ 零空间 null space \(N(A) \subset R^n\)

④ 左零空间 null space of \(A^T\) \(N(A^T) \subset R^m\)

矩阵\(A^{m\times n}\)的行空间和列空间具有相同的秩 rank(A)

| 类型 | 表示 | 向量父空间 | 维度 |

|---|---|---|---|

| 列子空间 | C(A) | \(R^m\) | rank(A) |

| 行子空间 | C(\(A^T\)) | \(R^n\) | rank(A) |

| 零子空间 | N(A) | \(R^n\) | n - rank(A) |

| 左零子空间 | N(\(A^T\)) | \(R^m\) | m - rank(A) |

其中,

初等行变换(左乘)不会改变行空间, 但会改变列空间, 行变换只是对行进行了线性组合

初等列变换(右乘)不会改变列空间, 但会改变行空间, 列变换只是对列进行了线性组合

显然, 列空间 \(C(A)\not= C(R)\), 行空间 \(C(A^T) = C(R^T)\)

为什么\(N(A^T)\)叫做左零空间?

方程

方程的解 \(x\) 在 A 的零空间 \(N(A)\) 里

方程的解 \(y\) 在矩阵 \(A\) 的左边, 这就是为什么 \(N(A^T)\) 称为在矩阵 A 的左零空间.

列空间

矩阵 A 的列向量的所有线性组合构成了 \(R^3\) 的子空间, 称之为列空间.

方程

有解, 当且仅当 b 在 A 的列空间中.

零空间

方程

的解, 又称之为零空间. 能称之为向量空间的原因就是

满足加法封闭性和数乘封闭性.

比如

方程 \(A \bf x= \bf 0\)的解(零)空间为 \(\quad \bf x = c\begin{bmatrix} 1 \\ 1 \\ - 1 \end{bmatrix},\quad \forall c \in R\).

除了 \(\bf b\) 是零向量, 方程 \(Ax = b\) 的解不构成向量空间(显然零向量不在解中)

四个子空间的基

列空间, 我们将其化为最简行阶梯型矩阵, 列空间的维数等于rank(A) = 行阶梯型矩阵的主元个数 = 基向量的个数,

我们找 rank(A) 个线性无关的列作为基向量即可.

列空间的维数等于行空间的维数, 所以我们找 rank(A) 个线性无关的行向量作为基, 就能求出行空间的基.

方程 \(A\bf x=0\) 的零空间之前求过. 我们可以在求零空间的同时求出左零空间, 不过我们需要多做一点工作.

回顾求逆运算 \(Gussian\)-\(Jordan\) 消元法

虽然这里我们的 A 并不一定是方阵, 不过我们依然可以使用 \(Gussian\)-\(Jordan\) 消元法记录行变换的过程.

\(R\) 为行阶梯型矩阵, \([R: E]\) 中记录了矩阵 \(A \rightarrow R\) 的变换过程.

矩阵 \(R\) 最后一行为 0, 是变换矩阵 \(E\) 最后一行向量与矩阵 A 乘积的结果, \(y^TA = 0^T\), 所以该行向量是左零空间的基向量. R 矩阵一共有 m - rank(A) 个零行. 故左零空间的维数是 m - rank(A). 上述矩阵秩为2, 所以左零空间维数为 \(3 - 2 = 1\), 矩阵 A 的 左零空间 为:

线性相关性

\(\square\) 给定向量组 \(A: a_1, a_2,\cdots,a_m\)存在不全为零的数 \(k_1, k_2,\cdots, k_m,\) 使得

则称向量组 A 是线性相关的, 否则称它为线性无关.

\(\square\) 矢量空间的一组元素中,若没有矢量可用有限个其他矢量的线性组合所表示,则称为线性无关或线性独立(linearly independent),反之称为线性相关(linearly dependent)

\(\square\)\(m 个 n 维向量组, \space 当维数小于向量个数时, 一定线性相关\)

\(\square\) 向量组 \(A: a_1, a_2,\cdots,a_m\)线性无关, 向量组 \(A: a_1, a_2,\cdots,a_m, a_{m+1}\)线性相关, 则向量 b 必能由向量组 A 线性表示, 且表示式惟一.

\(square\) 空间 \(S\)由向量组 \(A: a_1, a_2,\cdots,a_m\) 所张成, 那么空间 \(S\) 包含向量组所有的线性组合. 这里并不要求向量组 A 是线性无关的.

\(\square\) 说向量组 \(A: a_1, a_2,\cdots,a_n\)是空间 \(S\) 的基, 则向量组 A 具有如下特征

且向量空间 \(R^n\) 基向量的个数等于 \(n\), 即空间的维数.

齐次方程组的解

\(\square\) 齐次方程组 \(Ax=0\) 的解由矩阵 A 的列向量的线性相关性决定. A 的列向量的线性相关, 方程有无穷解; A 的列向量的线性无关, 方程只有零解.

消元法求解齐次方程组

对于矩阵 \(A_{m\times n}\), 把行最简型中 r 个非零行的非零首元对应的未知数作为主元, 其余 n - r 个元素作为自由变量

\((x_3,x4 {取任意值}), 令 x2 = c1, x4 = c2, c1,c2 \in R\), 则

所以 \(A\bf x = bf 0\) 的解(零)空间为

浙公网安备 33010602011771号

浙公网安备 33010602011771号