Depth Anything环境搭建&推理测试

基于单目摄像头的深度估计,一直是CV领域的一个难点,之前也对此关注也不够多。偶然浏览技术博客,看到Depth Anything: Unleashing the Power of Large-Scale Unlabeled Data这个最新CVPR2024的工作。看到名字,大概也能猜出来这篇是致敬Segment Anything(之前也分享过一篇这个主题的,感兴趣的请移步

一、模型介绍

作者提出一种用于单目深度估计(Monocular Depth Estimation, MDE)的高度实用方案Depth Anything「致敬Segment Anything」,它旨在构建一种可以处理任务环境下任意图像的简单且强力的基础深度模型。为此,作者从三个维度进行了探索:

(1)数据集维度设计了一种数据引擎用于数据收集与自动标注,构建了~62M的大规模无标注数据,这极大程度提升了数据覆盖率、降低泛化误差;

(2)通过利用数据增广工具构建了一种更具挑战性的优化目标,促使模型主动探索额外的视觉知识,进而提升特征鲁棒性;

(3)设计了一种辅助监督信息以迫使模型从预训练Encoder中继承丰富语义先验信息。

作者在六个公开数据集与随机拍摄图片上评估了模型的zero-shot能力;通过度量深度信息微调达成新的SOTA;更优的深度模型进而引申出更优的深度引导ControlNet。

二、环境搭建

(1)模型下载

git clone

config下载

(2)代码下载

git clone

(3)安装环境

docker run -it -v /datas/work/zzq/:/workspace --gpus=all pytorch/pytorch:2.0.1-cuda11.7-cudnn8-devel bash

cd /workspace/depth-anything/Depth-Anything

pip install -r requirements.txt -i

三、推理测试

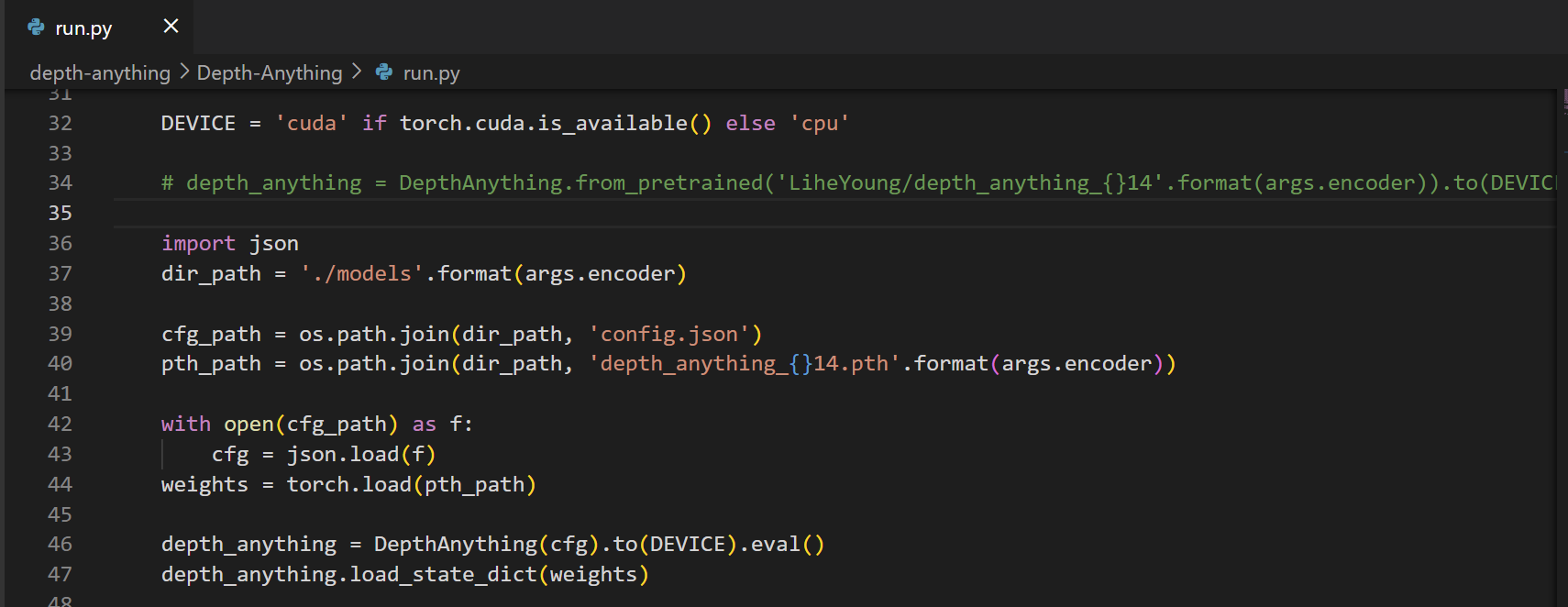

(1)修改代码

(2)执行代码

python run.py --encoder vits --img-path bus.jpg

浙公网安备 33010602011771号

浙公网安备 33010602011771号