机器学习 吴恩达 第二章 笔记

2. 单变量线性回归(Linear Regression with One Variable)

文字部分来自这位大佬的字幕合集

2.1 模型表示

我们的第一个学习算法是线性回归算法.在这段视频中,你会看到这个算法的概况,更重要的是你将会了解监督学习过程完整的流程.

让我们通过一个例子来开始:这个例子是预测住房价格的,我们要使用一个数据集,这个数据集包含俄勒冈州波特兰市的住房价格.在这里,我要根据不同房屋尺寸所售出的价格.比方说,如果你朋友的房子是1250平方尺大小,你要告诉他们这房子能卖多少钱.那么,你可以做的一件事就是构建一个模型,也许可以用直线拟合,从这个数据模型上来看,也许你可以告诉你的朋友,他能以大约220000(美元)左右的价格卖掉这个房子.这就是监督学习算法的一个例子.

上面举的例子是一个监督学习算法,因为每个输入都有一个正确的输出\(y\).也是一个回归问题,因为我们根据之前的数据预测出一个准确的输出值,对于这个例子就是价格.同时,还有另一种最常见的监督学习方式,叫做分类问题,当我们想要预测离散的输出值,例如,我们正在寻找癌症肿瘤,并想要确定肿瘤是良性的还是恶性的,这就是0/1离散输出的问题.

更进一步来说,在监督学习中我们有一个数据集,这个数据集被称训练集.在本课程中,我们使用\(m\)来作为训练集的数目.

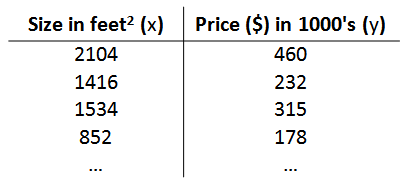

以之前的房屋交易问题为例,假使我们回归问题的训练集(Training Set)如下表所示:

我们约定用如下变量来描述数据集:

m:训练集中样本的数量x:特征/输入变量y:目标变量/输出变量(x,y):训练集中的实例- \((x^{(i)},y^{(i)})\):第i个观察实例

h:学习算法的解决方案或函数也称为假设(hypothesis)

这是一个监督学习算法的工作方式.我们可以看到这里有我们的训练集里房屋价格.我们把它喂给我们的学习算法,学习算法输出一个函数,通常表示为小写\(h\)表示.\(h\)代表\(hypothesis\)(假设),表示一个函数.输入是房屋尺寸大小,就像你朋友想出售的房屋,因此\(h\)根据输入的\(x\)值来得出\(y\)值,\(y\)值对应房子的价格,因此,\(h\)是一个从\(x\)到\(y\)的函数映射.

我将选择最初的使用规则\(h\)代表\(hypothesis\),因而,要解决房价预测问题,我们实际上是要将训练集"喂"给我们的学习算法,进而学习得到一个假设\(h\),然后将我们要预测的房屋的尺寸作为输入变量\(x\)输入给\(h\),预测出该房屋的交易价格作为输出变量\(y\)输出为结果.那么,对于我们的房价预测问题,我们该如何表达\(h\)?

一种可能的表达方式为:

,因为只含有一个特征/输入变量,因此这样的问题叫作单变量线性回归问题

2.2 代价函数

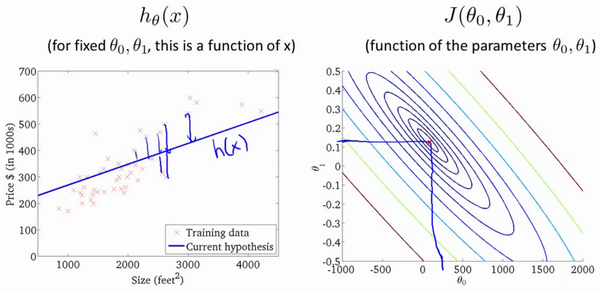

在这段视频中我们将定义代价函数的概念,这有助于我们弄清楚如何把最有可能的直线与我们的数据相拟合.如图:

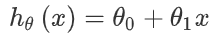

在线性回归中我们有一个像这样的训练集,\(m\)代表了训练样本的数量,比如\(m=47\).而我们的假设函数,也就是用来进行预测的函数,是这样的线性函数形式:\(h_{\theta}(x) = \theta_0 + \theta_1 x\).

接下来,我们引入如下术语:\(\theta_0\)和\(\theta_1\),我们把它们称为模型参数.在本节我们要讨论的是如何选择这两个参数.

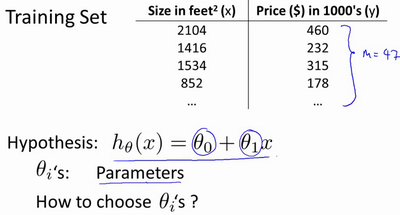

我们选择的参数决定了我们得到的直线相对于我们的训练集的准确程度,模型所预测的值与训练集中实际值之间的差距(下图中蓝线所指)就是建模误差(modeling error).

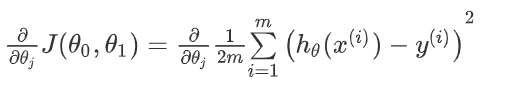

我们的目标便是选择出\(\theta_1\)和\(\theta_0\)可以使得建模误差的平方和能够最小的模型参数.即使得代价函数(或者平方误差函数)最小:

特别提醒:\(\frac{1}{2m}\)的\(\frac{1}{2}\)是为了消除求导时下来的平方2

我们之所以要求出误差的平方和,是因为误差平方代价函数,对于大多数问题,特别是回归问题,都是一个合理的选择.还有其他的代价函数也能很好地发挥作用,但是平方误差代价函数可能是解决回归问题最常用的手段了.

2.3 简单代价函数的直观理解

在上一节中,我们给了代价函数一个数学上的定义.在这个视频里,让我们通过一些例子来获取一些直观的感受,看看代价函数到底是在干什么,以及为什么我们使用它.

上一节的内容概况如下:

为了理解函数我们取一个简单的情况,当\(\theta_0 = 0\)时,假设就只是正比例函数,而此时代价函数也得到了化简,让我们来看根据\(\theta_1\)取不同值,都可以得到一个不同的假设\(h\),也有不同的代价函数\(J\),这两个函数的图像.

2.4 代价函数的直观理解

这节课中,我们将更深入地学习代价函数的作用,这段视频的内容假设你已经认识等高线图,如果你对等高线图不太熟悉的话,这段视频中的某些内容你可能会听不懂,但不要紧,如果你跳过这段视频的话,也没什么关系,不听这节课对后续课程理解影响不大.

之前是\(\theta_0 = 0\)的情况,这里可变的参数有两个\(\theta_0\)和\(\theta_1\).我们分别画出\(h\)和\(J\)在取不同参数的变化图像:

这里的\(J\)图是等高线图(所有圆圈弧上的\(J\)值都相同),以立体的形式其实是碗状,当只有一个参数时,碗的形状在平面上是这样的.但当有两个参数,图像就比较立体.

通过这些图形,我希望你能更好地理解这些代价函数\(J\)所表达的值是什么样的,它们对应的假设是什么样的,以及什么样的假设对应的点更接近于代价函数的最小值.

当然,我们真正需要的是一种有效的算法,能够自动地找出这些使代价函数\(J\)取最小值的参数\(\theta_1\)和\(\theta_0\).

我们会遇到更复杂、更高维度、更多参数的情况,而这些情况是很难画出图的,因此更无法将其可视化,因此我们真正需要的是编写程序来找出这些最小化代价函数的\(\theta_1\)和\(\theta_0\)的值,在下一节视频中,我们将介绍一种算法,能够自动地找出能使代价函数\(J\)最小化的参数\(\theta_1\)和\(\theta_0\)的值.

2.5 梯度下降

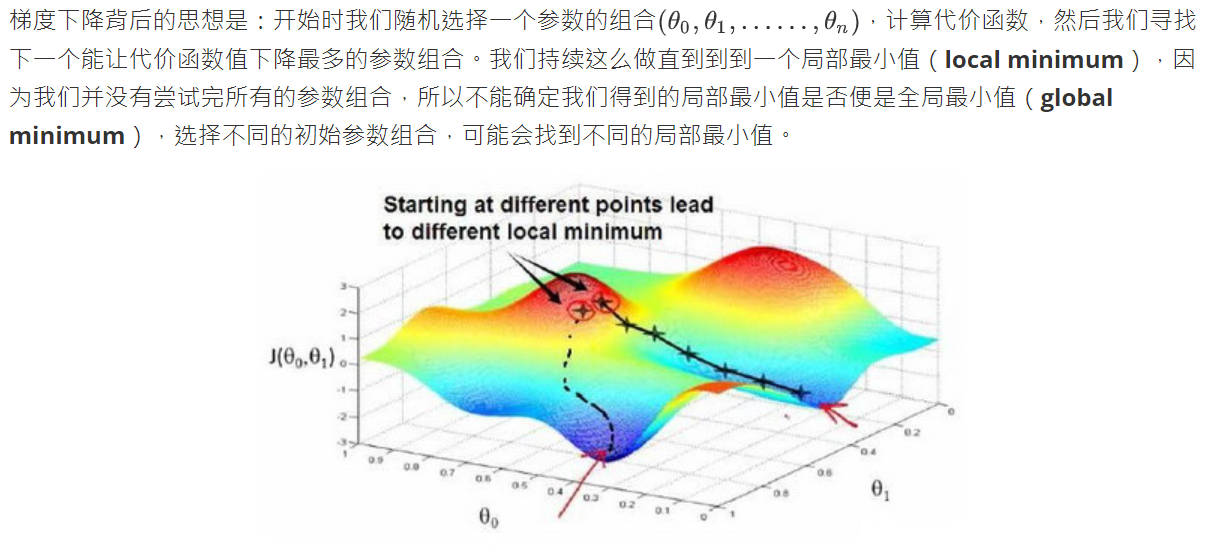

梯度下降是一个用来求函数最小值的算法,我们将使用梯度下降算法来求出代价函数\(J(\theta_1,\theta_0)\)的最小值.在后面的课程中,梯度下降还被用来最小化其他函数的值(不只是两个参数,可以泛用到\(\theta_0\)~\(\theta_n\)).

梯度最小化的思想是(为了简化,以两个参数\(\theta_1\)和\(\theta_0\)为例):

(1) 设置\(\theta_1\)和\(\theta_0\)初始值(任意,一般是0和0)

(2) 在减小\(J\)的前提下,不断改变\(\theta_1\)和\(\theta_0\)的值,直到我们找到了最小值(或者局部最小值).

看下面源字幕的笔记:

想象一下你正站立在山的这一点上,站立在你想象的公园这座红色山上,在梯度下降算法中,我们要做的就是旋转360度,看看我们的周围,并问自己要在某个方向上,用小碎步尽快下山(字幕写的是最快的路线下山(下坡最快的方向))。这些小碎步需要朝什么方向?如果我们站在山坡上的这一点,你看一下周围,你会发现最佳的下山方向,你再看看周围,然后再一次想想,我应该从什么方向迈着小碎步下山?然后你按照自己的判断又迈出一步,重复上面的步骤,从这个新的点,你环顾四周,并决定从什么方向将会最快下山,然后又迈进了一小步,并依此类推,直到你接近局部最低点的位置.

视频里讲解的是,每一步都是走下降最快的方向,直到局部最优值.

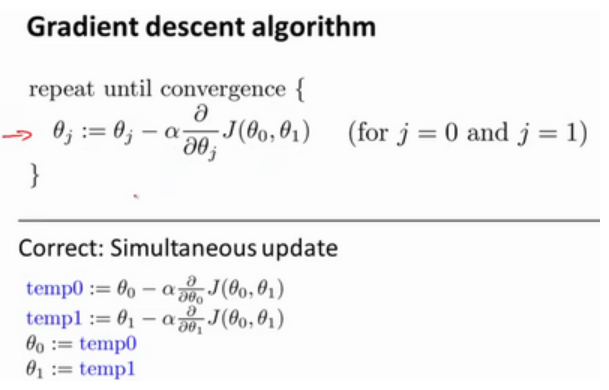

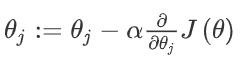

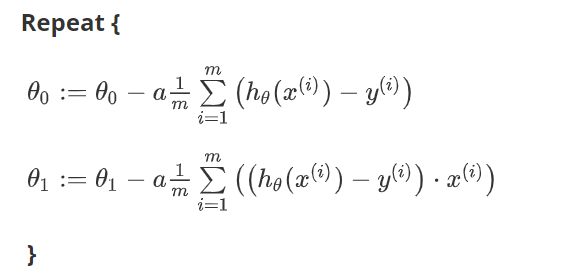

让我们来看一看(批量)梯度下降的定义:

我们需要不断更新参数\(\theta_j\)直到收敛.

其中,\(\alpha\)代表学习率.它决定了我们沿着能让代价函数下降程度最大的方向向下迈出的步子有多大.\(\alpha\)越大,我们下降的速度就会越快.在批量梯度下降中,我们每一次都同时让所有的参数减去学习速率乘以代价函数的导数.如何设置\(\alpha\)的值,会在后面讲解.

而在学习率后面的那一项,是一个导数项,我们会在后面推导这一项.

后面的for j=0 and j =1代表我们需要更新\(\theta_1\)和\(\theta_0\),

再声明一下,在本节课,:=代表计算机的赋值,而=表示判断左右相等.

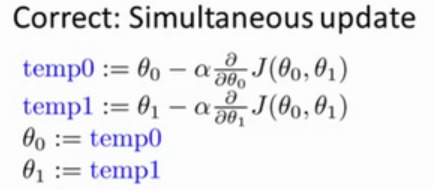

在梯度下降算法中,还有一个更微妙的问题.我们要同时更新\(\theta_1\)和\(\theta_0\).当j=0和 j=1时,会产生更新,所以你将更新\(J(\theta_0)\)和\(J(\theta_1)\)。实现梯度下降算法的微妙之处是,在这个表达式中,如果你要更新这个等式,你需要同时更新\(\theta_1\)和\(\theta_0\).原视频说的是你需要计算右边的部分,然后同时更新\(\theta_1\)和\(\theta_0\).如何正确的同步计算,也就是下面这部分:

注意:我们不能随意调换计算顺序.也就是不能更新\(\theta_0\)后,再更新\(\theta_1\).

在接下来,我们要进入这个微分项的细节之中.我已经写了出来但没有真正定义,如果你已经修过微积分课程,如果你熟悉偏导数和导数,这其实就是这个微分项:

2.6 梯度下降的直观理解

在之前的视频中,我们给出了一个数学上关于梯度下降的定义,本次视频我们更深入研究一下,更直观地感受一下这个算法是做什么的,以及梯度下降算法的更新过程有什么意义。梯度下降算法如下:

顺带一提,学习率永远是一个正数

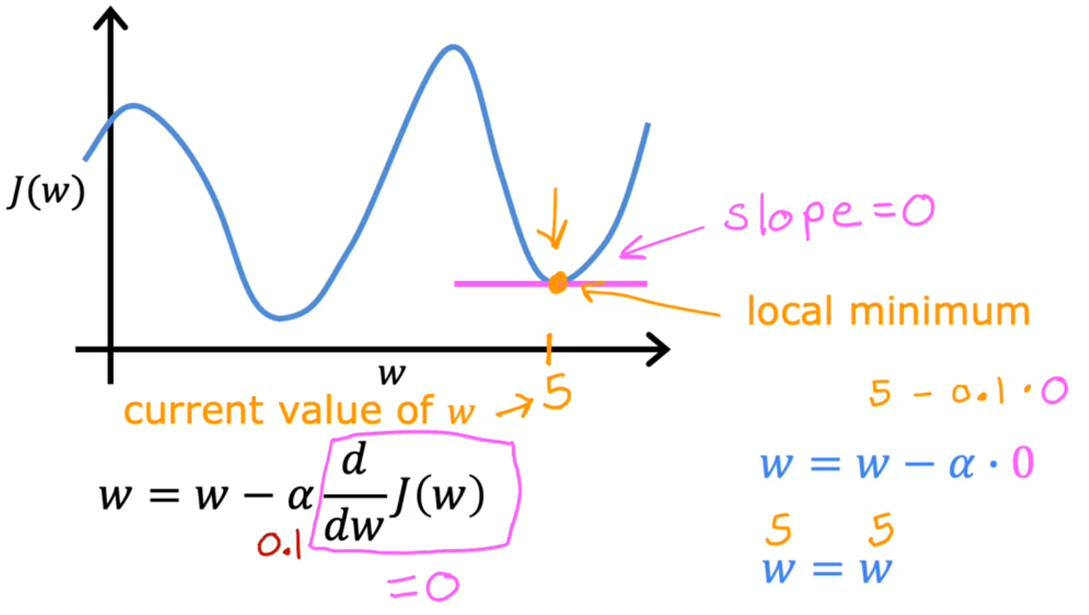

为了解释学习率和导数部分有什么作用,这里用一个比较简单的例子,也就是\(J\)只有一个参数\(\theta_1\).我们可以画出它的函数图像如下:

我们取一点在红点处,可以计算出\(J(\theta)\)对\(\theta\)的偏导数为正数,而学习率一定为正数,所以\(\theta_1\)减小了,正好切实向最小值接近.如果我们取值在最小值的左边,也同样印证了会向最小值接近的效果.这就是导数项的作用.

让我们来了解一下学习率有什么作用.看如下梯度下降法:

接下来,我们看看当学习率\(\alpha\)太小或太大会发生什么状况:

如果太小了,即学习速率太小,结果就是只能一点点地挪动,去努力接近最低点,这样就需要很多步才能到达最低点,所以如果太小的话,可能会很慢,因为它会一点点挪动,它会需要很多步才能到达全局最低点.

如果\(\alpha\)太大,那么梯度下降法可能会越过最低点,甚至可能无法收敛,下一次迭代又移动了一大步,越过一次,又越过一次,一次次越过最低点,直到你发现实际上离最低点越来越远.所以,如果太大,它会导致无法收敛,甚至发散.

接下来还有一个问题:如果我们预先把\(\theta_1\)放在一个局部的最低点,你认为下一步梯度下降法会怎样工作?

因为局部最优的导数\(=0\),所以根据如下,\(\theta_1\)会保持不变.这也解释了就算\(\alpha\)保持不变,梯度下降法也可以收敛到极小值的原因.

这就是梯度下降算法,你可以用它来最小化任何代价函数\(J\),不只是线性回归中的代价函数.

2.7 梯度下降的线性回归

在以前的视频中我们谈到关于梯度下降算法,梯度下降是很常用的算法,它不仅被用在线性回归上和线性回归模型、平方误差代价函数.在这段视频中,我们要将梯度下降和代价函数结合.我们将用到此算法,并将其应用于具体的拟合直线的线性回归算法里.

梯度下降算法和线性回归算法比较如图:

对我们之前的线性回归问题运用梯度下降法,关键在于求出代价函数的导数:

计算出偏导后,我们可以将上面代回梯度下降法.

请注意,我们需要同步更新\(\theta_1\)和\(\theta_0\),而不是一前一后更新.

我们所用的梯度下降很容易陷入局部最优解.但是线性回归函数,也就是\(J(\theta_1,\theta_0)\),都是呈碗状(也有专业术语:凸函数),它没有局部最优解,只有全局最优解.所以只要使用线性回归,它总是会收敛到全局最优.

我们刚刚使用的算法,有时也称为批量梯度下降.实际上,在机器学习中,通常不太会给算法起名字,但这个名字批量梯度下降,指的是在梯度下降的每一步中,我们都用到了所有的训练样本,在梯度下降中,在计算微分求导项时,我们需要进行求和运算.所以,在每一个单独的梯度下降中,我们最终都要计算这样一个东西,这个项需要对所有个训练样本求和.因此,批量梯度下降法这个名字说明了我们需要考虑所有这一"批"训练样本.而事实上,有时也有其他类型的梯度下降法,不是这种"批量"型的,不考虑整个的训练集,而是每次只关注训练集中的一些小的子集.在后面的课程中,我们也将介绍这些方法.

如果你之前学过线性代数m有些同学之前可能已经学过高等线性代数,你应该知道有一种计算代价函数\(J\)最小值的数值解法,不需要梯度下降这种迭代算法.在后面的课程中,我们也会谈到这个方法,它可以在不需要多步梯度下降的情况下,也能解出代价函数\(J\)的最小值,这是另一种称为正规方程(normal equations)的方法.实际上在数据量较大的情况下,梯度下降法比正规方程要更适用一些.

浙公网安备 33010602011771号

浙公网安备 33010602011771号