14. scrip框架之5大核心组件和post请求

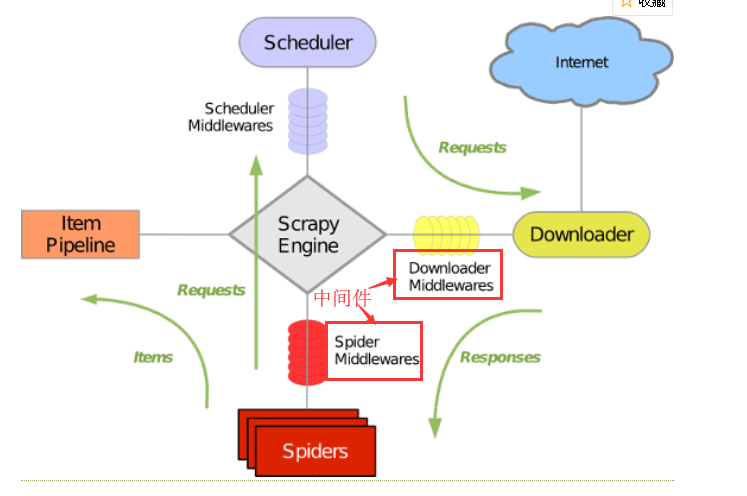

一、五大核心组件工作流程

组件的介绍:

- Spiders(爬虫文件):

爬虫是主要干活的, 用于从特定的网页中提取自己需要的信息, 即所谓的实体(Item)。

用户也可以从中提取出链接,让Scrapy继续抓取下一个页面

- Scrapy(引擎):

用来处理整个系统的数据流处理, 触发事务(框架核心)

- Scheduler(调度器):

用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个URL(抓取网页的网址或者说是链接)的优先队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址

- Downloader(下载器)

用于下载网页内容, 并将网页内容返回给引擎(Scrapy下载器是建立在twisted这个高效的异步模型上的)

- Pipeline(项目管道)

负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。

执行流程:

1.Spider发送请求对象

2. Scrapy(引擎)接收Spider传过来的请求对象

3.Scrapy(引擎)将请求对象传给Scheduler(调度器),调度器从队列中获取请求对象(队列可能有多个请求对象)

4. Scheduler(调度器) 在把请求对象返回给引擎(Scrapy)

5. 引擎(Scrapy)又将请求对象传递给Downloader(下载器)

6. Downloader(下载器)接收到请求后,会去internet(互联网上查询下载)

7. Downloader(下载器)会将下载好的数据返回给下载器(下载好到数据封装在响应对象(response)中)

8. Downloader(下载器) 将响应对象返回给引擎(Scrapy)

9. 引擎(Scrapy)接收到响应的对象,并肩=将响应的对象返回给了spider(爬虫)(此时parse方法被调用,响应的对象封装到response对象中)

10. spider接收到响应的对象,将响应对象封装到item中,item通过引擎(Scrapy)将封装的对象传递给管道

11. 引擎收到item中的数据,并将数据传递给管道

12. 管道接收数据,进行持久化存储

注意:

Scheduler(调度器)中存在一个队列和一个过滤器

队列:可能存在多个请求对象

过滤器:去除重复的请求

二、post请求发送

- 问题:在之前代码中,我们从来没有手动的对start_urls列表中存储的起始url进行过请求的发送,但是起始url的确是进行了请求的发送,那这是如何实现的呢?

- 解答:其实是因为爬虫文件中的爬虫类继承到了Spider父类中的start_requests(self)这个方法,该方法就可以对start_urls列表中的url发起请求:

def start_requests(self): for u in self.start_urls: yield scrapy.Request(url=u,callback=self.parse)

【注意】该方法默认的实现,是对起始的url发起get请求,如果想发起post请求,则需要子类重写该方法。

-方法: 重写start_requests方法,让其发起post请求:

def start_requests(self): #请求的url post_url = 'http://fanyi.baidu.com/sug' # post请求参数 formdata = { 'kw': 'wolf', } # 发送post请求 yield scrapy.FormRequest(url=post_url, formdata=formdata, callback=self.parse)

示例:

通过百度翻译,实现的post请求

# -*- coding: utf-8 -*- import scrapy class PostSpider(scrapy.Spider): name = 'post' # allowed_domains = ['www.xxx.com'] # 起始的url start_urls = ['https://fanyi.baidu.com/sug'] #start_requests默认是将起始列表中的url进行get请求的发送 # 通过如下操作进行重写父类的start_requests方法,让其进行post请求的发送 def start_requests(self): # post请求参数 data = { "kw":"mwh" } for url in self.start_urls: # 发送post请求,注意这里的Request更换成FormRequest yield scrapy.FormRequest(url=url,callback=self.parse,formdata=data) def parse(self, response): # 打印出响应对象获取到的值 print(response.text)

浙公网安备 33010602011771号

浙公网安备 33010602011771号