多模态学习

首先,什么是多模态,自然界中视觉、听觉、嗅觉、味觉、触觉、文字等都是表示物体的一种模态信息。我们大脑中也有对不同模态信息的感受区域。

那什么是多模态学习?我的理解是通过大脑中不同模态的感受器,获取多模态信息,再由大脑中的决策区域,学习实现识别、理解、甚至推理、表达、行动等操作。

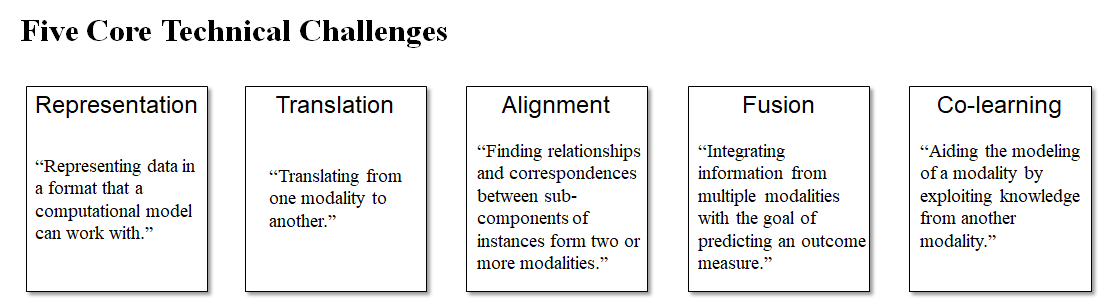

Baltrušaitis等人在2018年TPAMI的一篇文章[1]中,将常见的多模态研究分为以下五类:

1.表征。如何挖掘模态间的互补性或独立性以表征多模态数据。

2.翻译。学习一个模态到其他模态的映射。例如:图像描述任务。

3.对齐。将多模态数据的子元素进行对齐。例如将一幅图中的多个物体与一段话中的短语(或单词)进行对齐。

4.融合。融合两个模态的数据,用来进行某种预测。例如:视觉问答任务需融合图像和问题来预测答案。

5.联合学习(co-learning)。模态间的知识迁移。使用辅助模态训练的网络可以帮助当前模态的学习,尤其是当前模态数据量较小的情况下。

[1]Baltrušaitis T, Ahuja C, Morency L P. Multimodal machine learning: A survey and taxonomy[J]. IEEE transactions on pattern analysis and machine intelligence, 2018, 41(2): 423-443.

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· TypeScript + Deepseek 打造卜卦网站:技术与玄学的结合

· 阿里巴巴 QwQ-32B真的超越了 DeepSeek R-1吗?

· 【译】Visual Studio 中新的强大生产力特性

· 【设计模式】告别冗长if-else语句:使用策略模式优化代码结构

· AI与.NET技术实操系列(六):基于图像分类模型对图像进行分类