Multi-Task Learning Using Uncertainty to Weigh Losses for Scene Geometry and Semantics

很多深度学习都是多任务学习(Multi-Task Learning, MTL),需要对多个Loss同时优化,模型的性能受各Loss的权重的影响,手工选择权重成本太高,是不可能的,于是提出了基于Uncertainty的自动学习权重的方式.

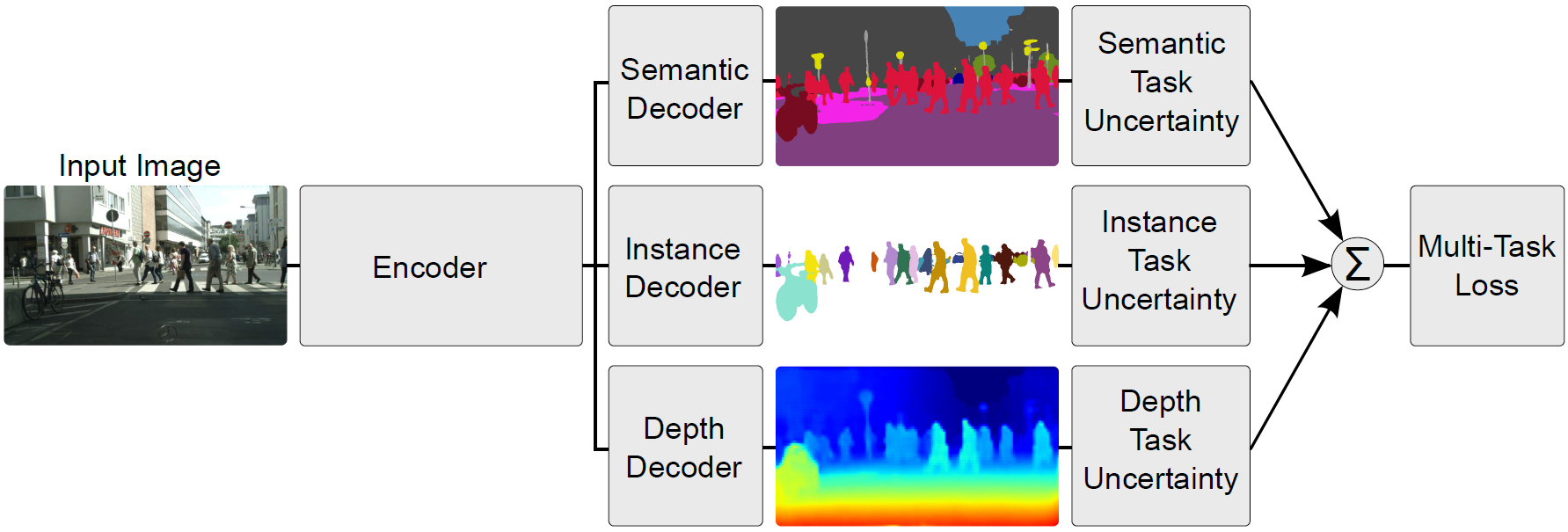

下图是一个典型的多任务学习场景,需要同时满足语义分割,实例分割,深度估计的需求.

对于多任务学习,最简单的方法就是把不同Loss的线性组合作为Loss,如下面的式子:

![]()

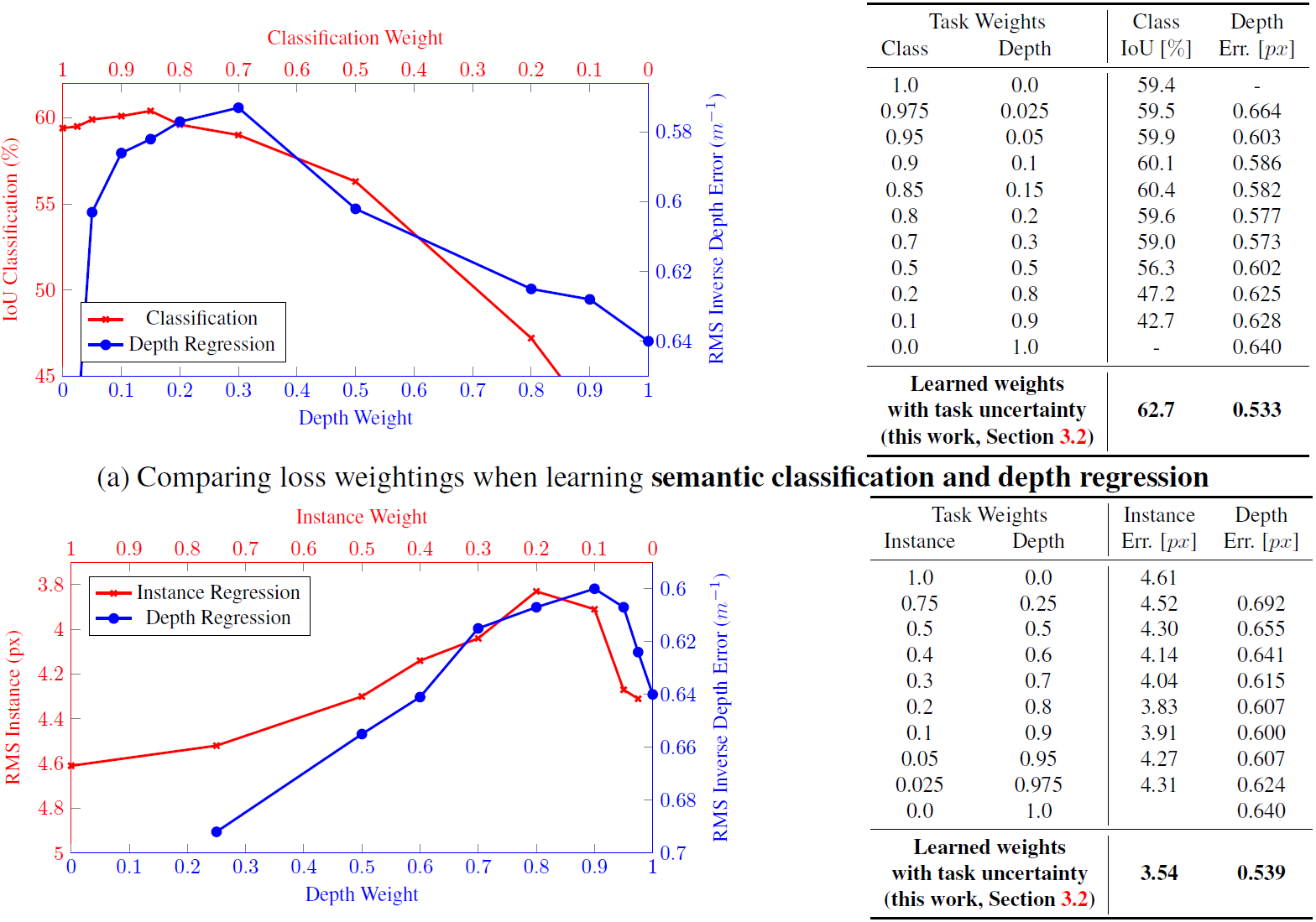

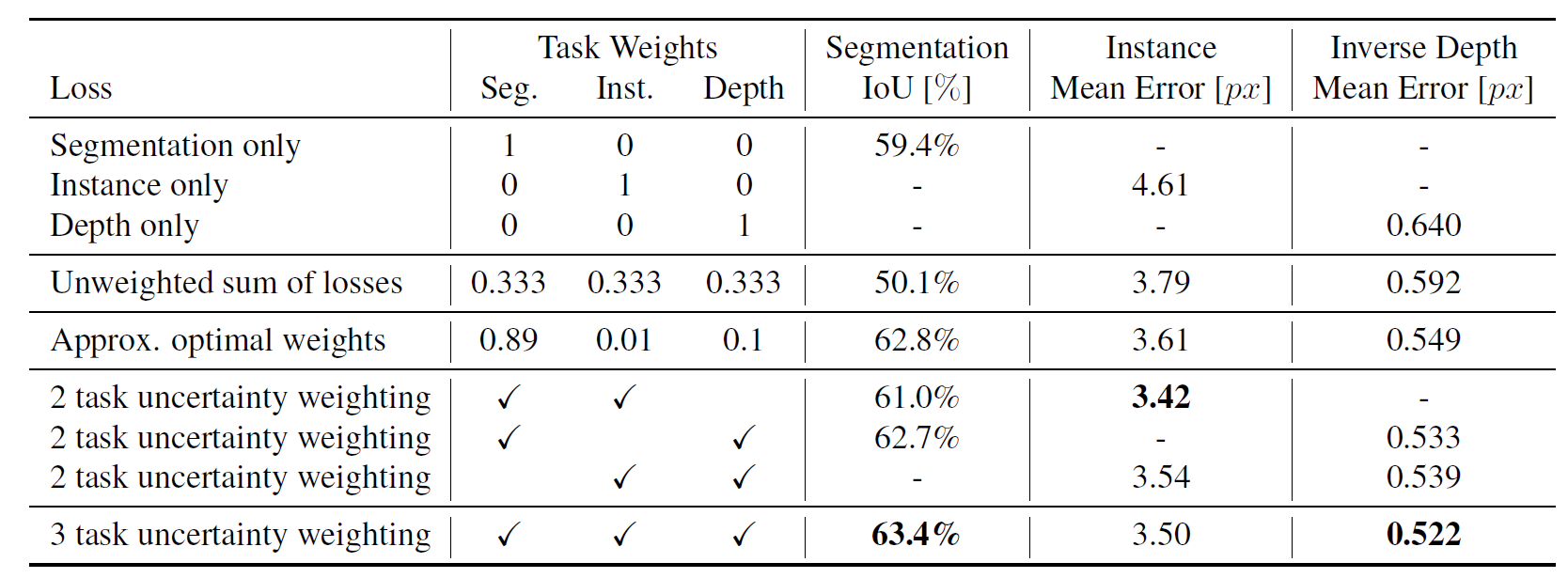

手工调节表明,权重对于模型的性能是有很大影响的:

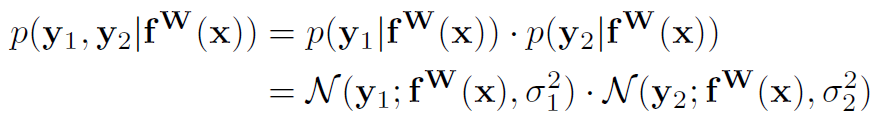

基于极大似然估计,假设fW为网络输出,W为该项输出的权重,则对于回归任务有:

![]()

对于分类任务有:

![]()

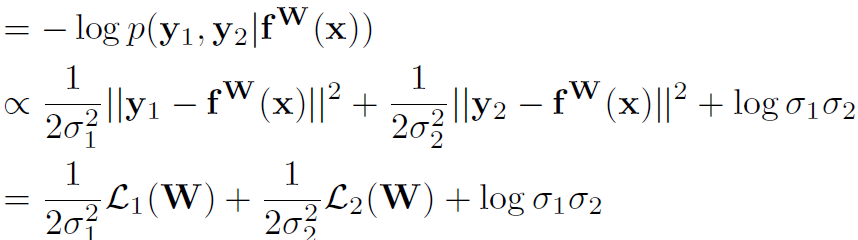

对于多任务:

![]()

如果是双任务:

最后,实验结果:

浙公网安备 33010602011771号

浙公网安备 33010602011771号