摘要:

問題描述 ValueError: Unknown loss function: bes_loss 問題場景 訓練 margin = 0.6 theta = lambda t : (K.sign(t) + 1.) / 2 def bes_loss(y_true, y_pred): return - ( 阅读全文

posted @ 2022-04-06 16:22

爱吃帮帮糖

阅读(91)

评论(0)

推荐(0)

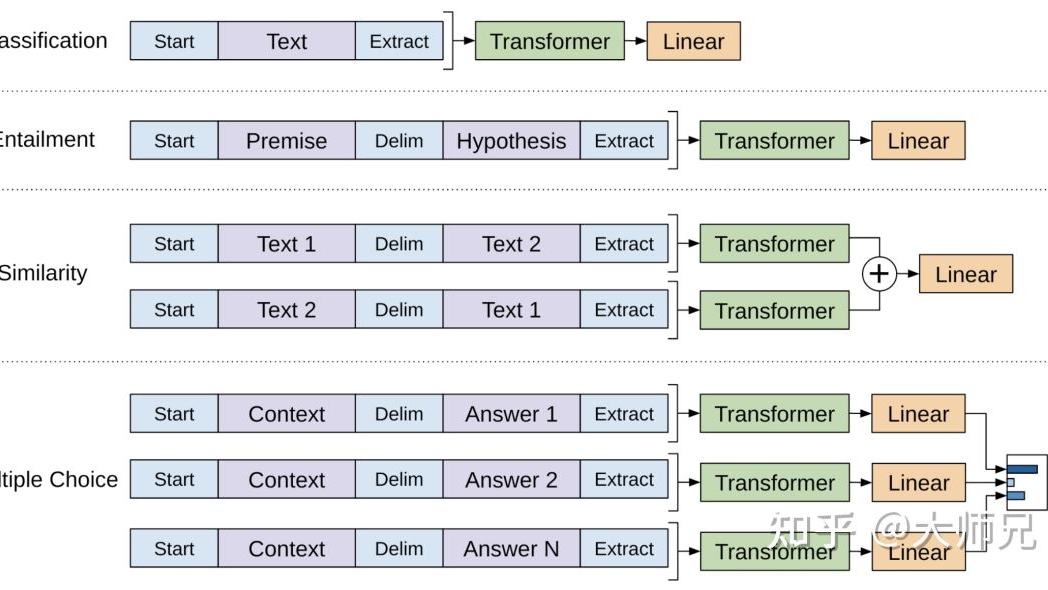

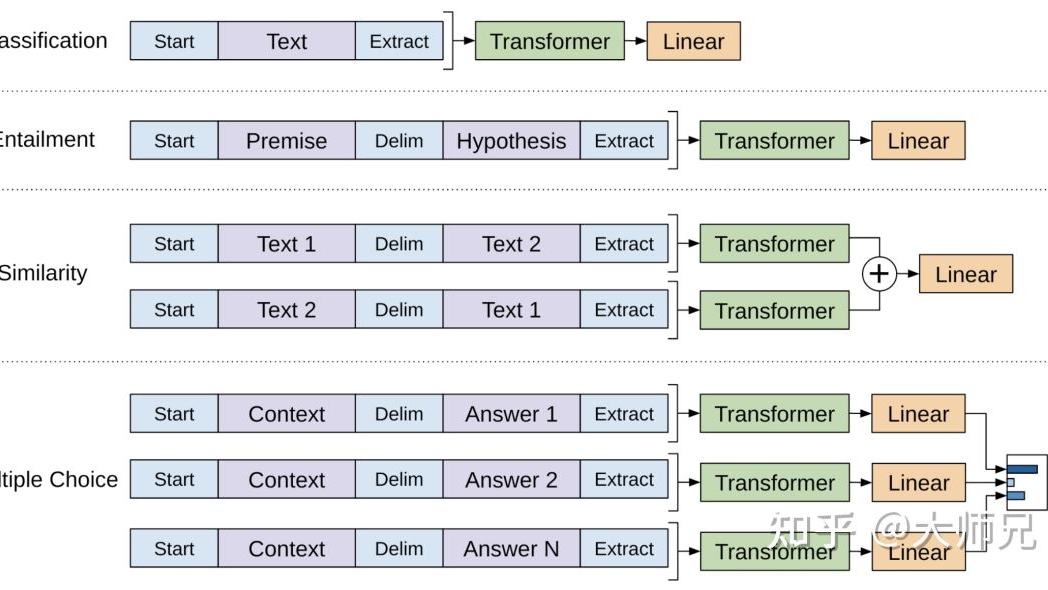

摘要:  简介 GPT(Generative Pre-trained Transformer)系列是由OpenAI提出的非常强大的预训练语言模型,这一系列的模型可以在生成式任务中取得非常好的效果,对于一个新的任务,GTP只需要很少的数据便可以理解任务的需求并达到或接近state-of-the-art的方法 阅读全文

简介 GPT(Generative Pre-trained Transformer)系列是由OpenAI提出的非常强大的预训练语言模型,这一系列的模型可以在生成式任务中取得非常好的效果,对于一个新的任务,GTP只需要很少的数据便可以理解任务的需求并达到或接近state-of-the-art的方法 阅读全文

简介 GPT(Generative Pre-trained Transformer)系列是由OpenAI提出的非常强大的预训练语言模型,这一系列的模型可以在生成式任务中取得非常好的效果,对于一个新的任务,GTP只需要很少的数据便可以理解任务的需求并达到或接近state-of-the-art的方法 阅读全文

简介 GPT(Generative Pre-trained Transformer)系列是由OpenAI提出的非常强大的预训练语言模型,这一系列的模型可以在生成式任务中取得非常好的效果,对于一个新的任务,GTP只需要很少的数据便可以理解任务的需求并达到或接近state-of-the-art的方法 阅读全文

posted @ 2022-04-06 16:10

爱吃帮帮糖

阅读(2641)

评论(0)

推荐(0)

摘要:

交叉熵损失函数 - Cross entropy loss function 标准形式 \[ \color{blue}{C=-\frac{1}{n}\sum_x{[ylna+(1-y)ln(1-a)]} (1)} \] 其中$\color{blue}{x}\(表示样本,\)\color{blue} 阅读全文

posted @ 2022-04-06 15:57

爱吃帮帮糖

阅读(233)

评论(0)

推荐(0)

浙公网安备 33010602011771号

浙公网安备 33010602011771号