Tensorflow学习Note……未完待续……

1.2初认神经网络设计过程

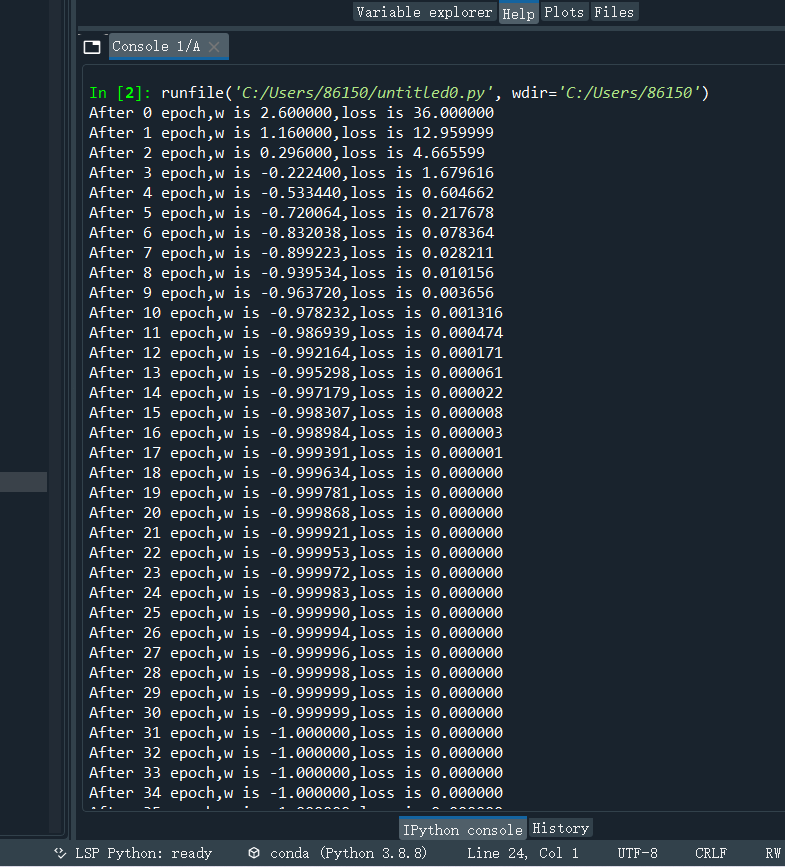

import tensorflow as tf #设置参数w的随机初始值为5,设定为可训练(即vaiable形式?) w = tf.Variable(tf.constant(5, dtype=tf.float32)) #学习率 lr=0.2 #循环次数 epoch=40 for epoch in range(epoch): with tf.GradientTape() as tape:#with结构到grad框起到了梯度计算的过程 loss=tf.square(w+1) #损失函数定义为w+1的平方 grads=tape.gradient(loss,w)#gradinet函数告知对谁求导 w.assign_sub(lr*grads) #assign_sub做自减,即w-= print("After %s epoch,w is %f,loss is %f" % (epoch, w.numpy(), loss))

数据类型:

在torch中默认的数据类型是32位浮点型(torch.FlaotTensor)

默认情况下,torch.Tensor就是torch.FlaotTensor。

设置默认的数据类型:torch.set_default_tensor_type()

查看和设置张量数据类型:torch.tensor([1.2, 3.4]).dtype

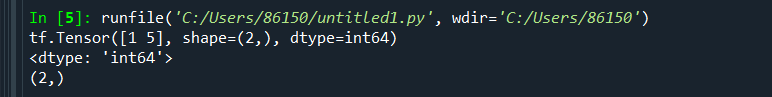

import tensorflow as tf a=tf.constant([1,5],dtype=tf.int64) #直接打印a,会输出a的所有信息 print(a) #打印a的数据类型 print(a.dtype) #打印a的形状 print(a.shape)

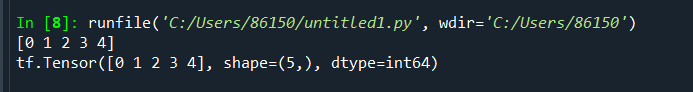

import tensorflow as tf import numpy as np a=np.arange(0,5) b=tf.convert_to_tensor(a,dtype=tf.int64) print(a) print(b)

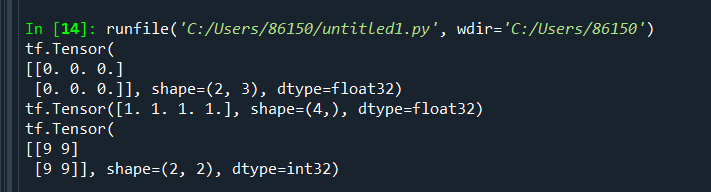

import tensorflow as tf a=tf.zeros([2,3]) b=tf.ones(4) c=tf.fill([2,2],9) print(a) print(b) print(c)

1.3 张量生成

(1)torch.tensor()生成

(2)torch.Tensor()生成

(3)张量和NumPy数据互相转换

(4)随机数生成张量

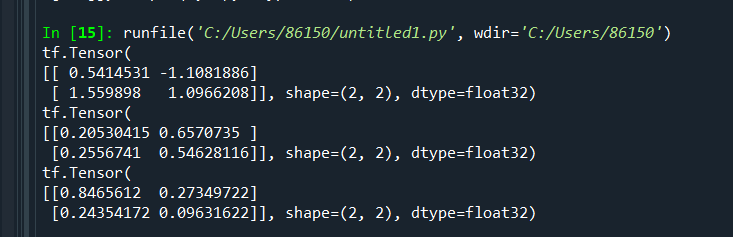

import tensorflow as tf d=tf.random.normal([2,2],mean=0.5,stddev=1) print(d) e=tf.random.truncated_normal([2,2],mean=0.5,stddev=1) print(e) f=tf.random.uniform([2,2],minval=0,maxval=1) print(f)

(5)其他函数:torch.arange()、torch.linspace()、torch.logspace()

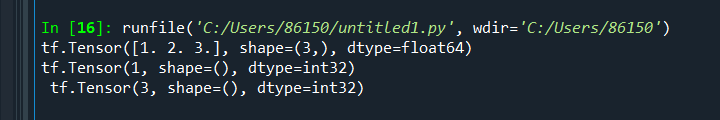

import tensorflow as tf x1=tf.constant([1.,2.,3.],dtype=tf.float64) print(x1) x2=tf.cast(x1,tf.int32) print(tf.reduce_min(x2),'\n',tf.reduce_max(x2))

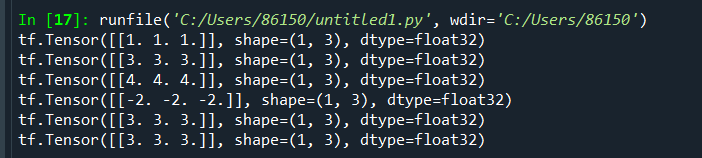

import tensorflow as tf a=tf.ones([1,3]) b=tf.fill([1,3],3.) print(a) print(b) print(tf.add(a,b)) print(tf.subtract(a,b)) print(tf.multiply(a,b)) print(tf.divide(b,a))

1.4 鸢尾花分类问题实战

1.4.1 了解鸢尾花数据;

1.4.2 神经网络实现鸢尾花数据分类

(1)准备数据

(2)搭建网络

(3)参数优化

(4)测试效果

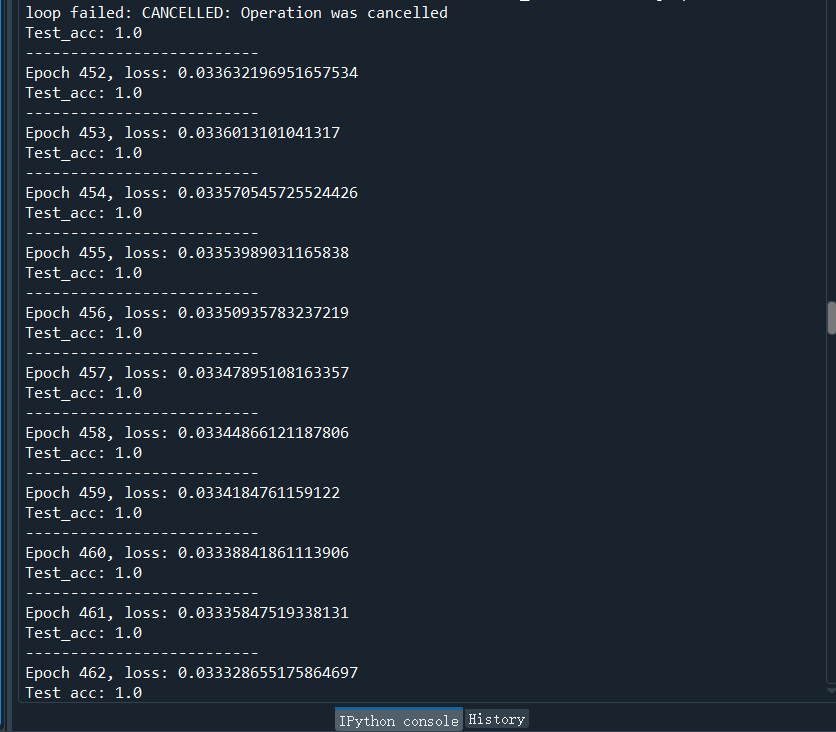

# 导入所需模块 import tensorflow as tf from sklearn import datasets from matplotlib import pyplot as plt %matplotlib inline import numpy as np # 导入数据,分别为输入特征和标签 x_data = datasets.load_iris().data y_data = datasets.load_iris().target # 随机打乱数据(因为原始数据是顺序的,顺序不打乱会影响准确率) # seed: 随机数种子,是一个整数,当设置之后,每次生成的随机数都一样(为方便教学,以保每位同学结果一致) np.random.seed(116) # 使用相同的seed,保证输入特征和标签一一对应 np.random.shuffle(x_data) np.random.seed(116) np.random.shuffle(y_data) tf.random.set_seed(116) # 将打乱后的数据集分割为训练集和测试集,训练集为前120行,测试集为后30行 x_train = x_data[:-30] y_train = y_data[:-30] x_test = x_data[-30:] y_test = y_data[-30:] # 转换x的数据类型,否则后面矩阵相乘时会因数据类型不一致报错 x_train = tf.cast(x_train, tf.float32) x_test = tf.cast(x_test, tf.float32) # from_tensor_slices函数使输入特征和标签值一一对应。(把数据集分批次,每个批次batch组数据) train_db = tf.data.Dataset.from_tensor_slices((x_train, y_train)).batch(32) test_db = tf.data.Dataset.from_tensor_slices((x_test, y_test)).batch(32) # 生成神经网络的参数,4个输入特征故,输入层为4个输入节点;因为3分类,故输出层为3个神经元 # 用tf.Variable()标记参数可训练 # 使用seed使每次生成的随机数相同(方便教学,使大家结果都一致,在现实使用时不写seed) w1 = tf.Variable(tf.random.truncated_normal([4, 3], stddev=0.1, seed=1)) b1 = tf.Variable(tf.random.truncated_normal([3], stddev=0.1, seed=1)) #定义超参数 lr = 0.1 # 学习率为0.1 train_loss_results = [] # 将每轮的loss记录在此列表中,为后续画loss曲线提供数据 test_acc = [] # 将每轮的acc记录在此列表中,为后续画acc曲线提供数据 epoch = 500 # 循环500轮 loss_all = 0 # 每轮分4个step,loss_all记录四个step生成的4个loss的和 # 训练部分 for epoch in range(epoch): #数据集级别的循环,每个epoch循环一次数据集 for step, (x_train, y_train) in enumerate(train_db): #batch级别的循环 ,每个step循环一个batch with tf.GradientTape() as tape: # with结构记录梯度信息 y = tf.matmul(x_train, w1) + b1 # 神经网络乘加运算 y = tf.nn.softmax(y) # 使输出y符合概率分布(此操作后与独热码同量级,可相减求loss) y_ = tf.one_hot(y_train, depth=3) # 将标签值转换为独热码格式,方便计算loss和accuracy loss = tf.reduce_mean(tf.square(y_ - y)) # 采用均方误差损失函数mse = mean(sum(y-out)^2) loss_all += loss.numpy() # 将每个step计算出的loss累加,为后续求loss平均值提供数据,这样计算的loss更准确 # 计算loss对各个参数的梯度 grads = tape.gradient(loss, [w1, b1]) # 实现梯度更新 w1 = w1 - lr * w1_grad b = b - lr * b_grad w1.assign_sub(lr * grads[0]) # 参数w1自更新 b1.assign_sub(lr * grads[1]) # 参数b自更新 # 每个epoch,打印loss信息 print("Epoch {}, loss: {}".format(epoch, loss_all/4)) train_loss_results.append(loss_all / 4) # 将4个step的loss求平均记录在此变量中 loss_all = 0 # loss_all归零,为记录下一个epoch的loss做准备 # 测试部分 # total_correct为预测对的样本个数, total_number为测试的总样本数,将这两个变量都初始化为0 total_correct, total_number = 0, 0 for x_test, y_test in test_db: # 使用更新后的参数进行预测 y = tf.matmul(x_test, w1) + b1#计算前向传播预测结果 y = tf.nn.softmax(y)#变为概率分布 pred = tf.argmax(y, axis=1) # 返回y中最大值的索引,即预测的分类 # 将pred转换为y_test的数据类型 pred = tf.cast(pred, dtype=y_test.dtype) # 若分类正确,则correct=1,否则为0,将bool型的结果转换为int型 correct = tf.cast(tf.equal(pred, y_test), dtype=tf.int32) # 将每个batch的correct数加起来 correct = tf.reduce_sum(correct) # 将所有batch中的correct数加起来 total_correct += int(correct) # total_number为测试的总样本数,也就是x_test的行数,shape[0]返回变量的行数 total_number += x_test.shape[0] # 总的准确率等于total_correct/total_number acc = total_correct / total_number test_acc.append(acc) print("Test_acc:", acc) print("--------------------------") # 绘制 loss 曲线 plt.title('Loss Function Curve') # 图片标题 plt.xlabel('Epoch') # x轴变量名称 plt.ylabel('Loss') # y轴变量名称 plt.plot(train_loss_results, label="$Loss$") # 逐点画出trian_loss_results值并连线,连线图标是Loss plt.legend() # 画出曲线图标 plt.show() # 画出图像 # 绘制 Accuracy 曲线 plt.title('Acc Curve') # 图片标题 plt.xlabel('Epoch') # x轴变量名称 plt.ylabel('Acc') # y轴变量名称 plt.plot(test_acc, label="$Accuracy$") # 逐点画出test_acc值并连线,连线图标是Accuracy plt.legend() plt.show()

第二章TensorFlow入门

1. TensorFlow介绍

Tensorflow是广泛使用的实现机器学习以及其它涉及大量数学运算的算法库之一。Tensorflow由Google开发,是GitHub上最受欢迎的机器学习库之一。Google几乎在所有应用程序中都使用Tensorflow来实现机器学习。

2. 计算图session Tensor

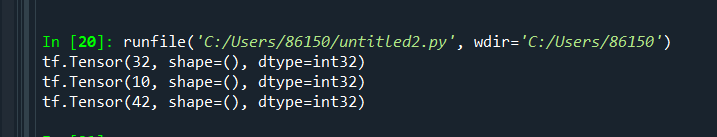

import tensorflow as tf a=tf.constant(32) #创建常量 b=tf.constant(10) #创建常量 c=tf.add(a,b) print(a) print(b) print(c)

3. OP 矩阵 随机化 Variable

3.1 OP

3.2 tensorflow矩阵及运算

3.3 随机化

#标准正态分布随机 #注意tensorflow版本区别,在1.0中是random_normal rand_normal=tf.random_normal((1,10),mean=0.0,stddev=1.0,dtype=tf.float32,seed=None) #truncated正态随机 truncated_normal=tf.truncated_normal((1,10),mean=0.0,stddev=1.0,dtype=tf.float32,seed=None) #均匀分布随机 rand_uniform=tf.random_uniform((1,10),minval=0.0,maxval=1.0,dtype=tf.float32,seed=None) print(sess.run(rand_normal)) print(sess.run(truncated_normal)) print(sess.run(rand_uniform))

3.4 Variable

var_a=tf.Variable(0,dtype=tf.int32) var_b=tf.Variable([1,2],dtype=tf.float32) var_w=tf.Variable(tf.zeros(1024,10)) #开启交互式session sess= tf.InteractiveSession() #一次性初始化所有变量 init=tf.global_variables_initializer() sess.run(init) #初始化某些变量 init_ab=tf.variables_initializer([var_a,var_b]) init_ab.run() #初始化某个变量,通过调用变量的初始化函数来实现 var_w.initializer.run() W=tf.Variable(10) sess.run(W.initializer) print(W) print(sess.run(W)) print(W.eval())

浙公网安备 33010602011771号

浙公网安备 33010602011771号