【原】Coursera—Andrew Ng机器学习—Week 10 习题—大规模机器学习

【1】大规模数据

【2】随机梯度下降

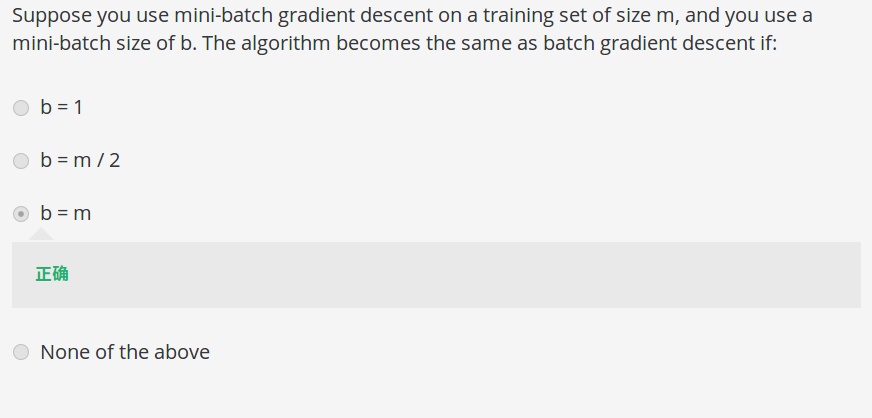

【3】小批量梯度下降

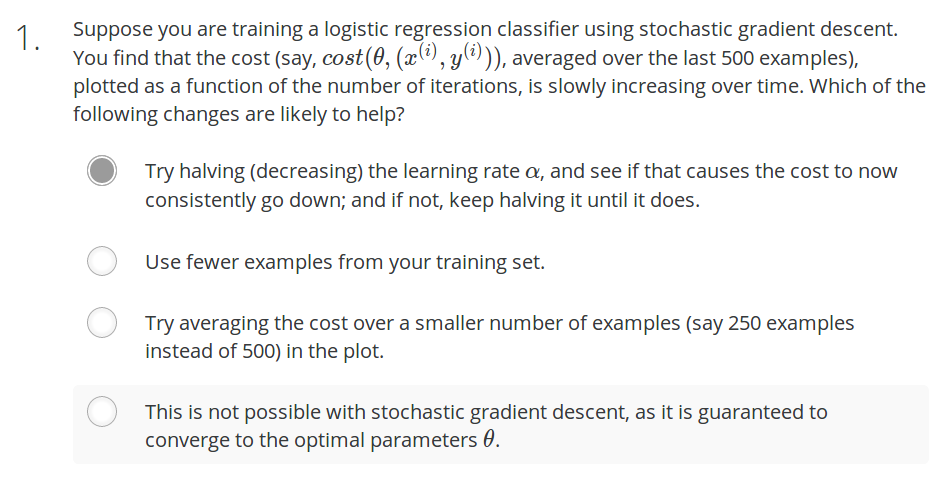

【4】随机梯度下降的收敛

Answer:BD

A 错误。学习率太小,算法容易很慢

B 正确。学习率小,效果更好

C 错误。应该是确定阈值吧

D 正确。曲线不下降,说明学习率选的太大

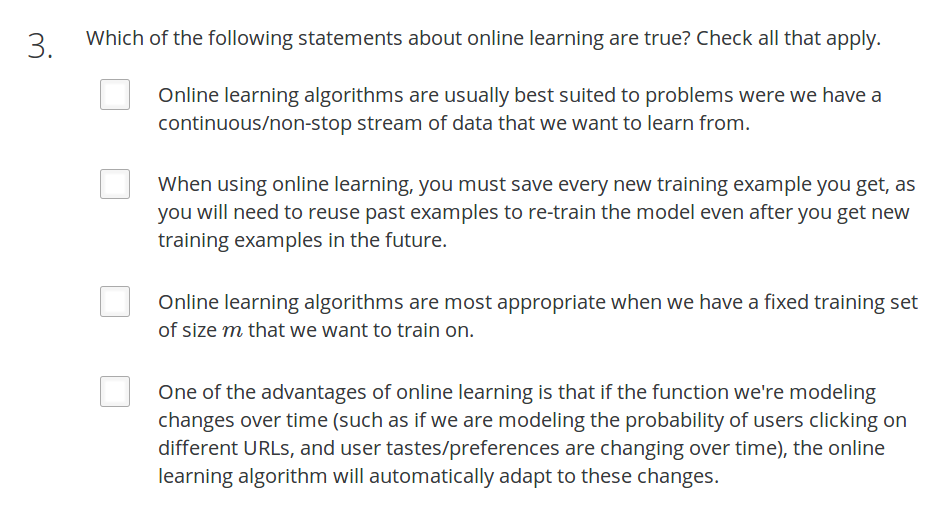

【5】在线学习

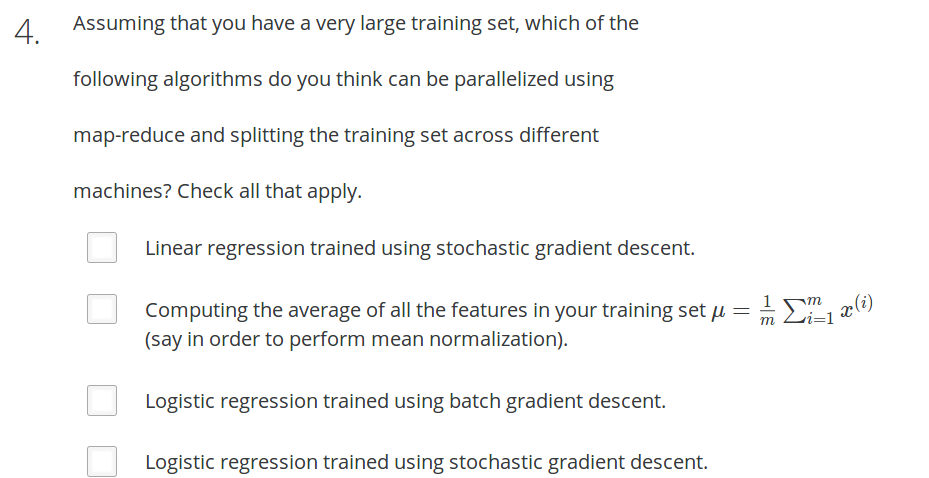

【6】

Answer:BC

A 错误。随机梯度下降,J(θ)不一定每次都减小

D 错误。随机梯度下降适合大数据量任务

Answer:CD

A 错误。

B 错误。不是因为使用parallelizaion

Answer:AD

B 错误。不需要保存每次的结果

C 错误。online learning不适合固定的m

Answer:BC

AD 错误。随机梯度下降的不适合

Answer:AB

Answer:ACD

B 错误。不一定获得N倍的速度

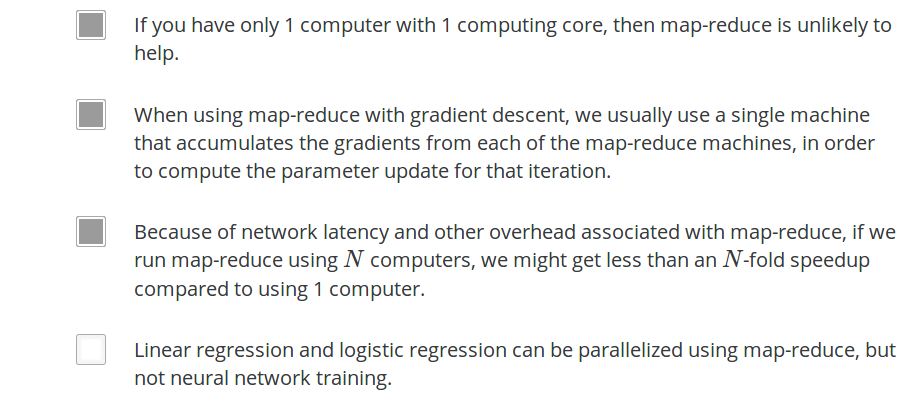

Answer:ABC

D 错误。神经网络也可以使用map-reduce

浙公网安备 33010602011771号

浙公网安备 33010602011771号