基于WOA优化的CNN-GRU的时间序列回归预测matlab仿真

1.算法运行效果图预览

(完整程序运行后无水印)

2.算法运行软件版本

matlab2022a

3.部分核心程序

(完整版代码包含详细中文注释和操作步骤视频)

%调整参数

c1 = 2-t*((1)/300);

c2 =-1+t*((-1)/300);

%位置更新

for i=1:Num

r1 = rand();

r2 = rand();

K1 = 2*c1*r1-c1;

K2 = 2*r2;

l =(c2-1)*rand + 1;

rand_flag = rand();

for j=1:D

if rand_flag<0.5

if abs(K1)>=1

RLidx = floor(Num*rand()+1);

X_rand = xwoa(RLidx, :);

D_X_rand = abs(K2*X_rand(j)-xwoa(i,j));

xwoa(i,j)= X_rand(j)-K1*D_X_rand;

else

D_Leader = abs(K2*woa_idx(j)-xwoa(i,j));

xwoa(i,j)= woa_idx(j)-K1*D_Leader;

end

else

distLeader = abs(woa_idx(j)-xwoa(i,j));

xwoa(i,j) = distLeader*exp(2*l).*cos(l.*2*pi)+woa_idx(j);

end

%目标函数更新

if xwoa(i,j)>=tmps(j,2)

xwoa(i,j)=tmps(j,2);

end

if xwoa(i,j)<=tmps(j,1)

xwoa(i,j)=tmps(j,1);

end

end

gb12(i)= func_obj(xwoa(i,:));

end

end

LR = woa_idx(1);

%训练

[Net,INFO] =trainNetwork(Nsp_train2, NTsp_train, layers, options);

IT =[1:length(INFO.TrainingLoss)];

Accuracy=INFO.TrainingRMSE;

figure;

plot(IT(1:1:end),Accuracy(1:1:end));

xlabel('epoch');

ylabel('RMSE');

%数据预测

Dpre1 = predict(Net, Nsp_train2);

Dpre2 = predict(Net, Nsp_test2);

%归一化还原

T_sim1=Dpre1*Vmax2;

T_sim2=Dpre2*Vmax2;

%网络结构

analyzeNetwork(Net)

figure

subplot(211);

plot(1: Num1, Tat_train,'-bs',...

'LineWidth',1,...

'MarkerSize',6,...

'MarkerEdgeColor','k',...

'MarkerFaceColor',[0.9,0.0,0.0]);

hold on

plot(1: Num1, T_sim1,'g',...

'LineWidth',2,...

'MarkerSize',6,...

'MarkerEdgeColor','k',...

'MarkerFaceColor',[0.9,0.9,0.0]);

legend('真实值', '预测值')

xlabel('预测样本')

ylabel('预测结果')

grid on

subplot(212);

plot(1: Num1, Tat_train-T_sim1','-bs',...

'LineWidth',1,...

'MarkerSize',6,...

'MarkerEdgeColor','k',...

'MarkerFaceColor',[0.9,0.0,0.0]);

xlabel('预测样本')

ylabel('预测误差')

grid on

ylim([-50,50]);

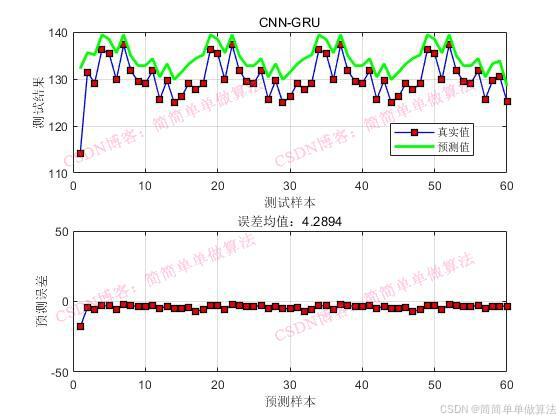

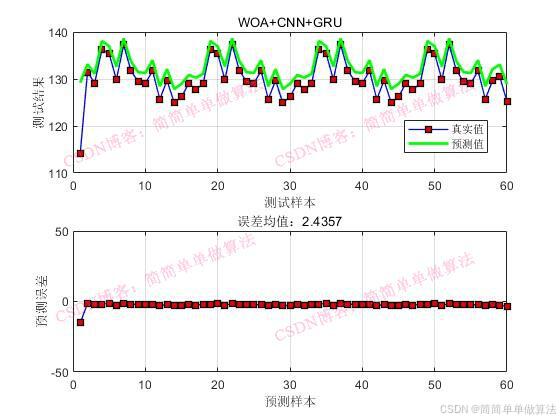

figure

subplot(211);

plot(1: Num2, Tat_test,'-bs',...

'LineWidth',1,...

'MarkerSize',6,...

'MarkerEdgeColor','k',...

'MarkerFaceColor',[0.9,0.0,0.0]);

hold on

plot(1: Num2, T_sim2,'g',...

'LineWidth',2,...

'MarkerSize',6,...

'MarkerEdgeColor','k',...

'MarkerFaceColor',[0.9,0.9,0.0]);

legend('真实值', '预测值')

xlabel('测试样本')

ylabel('测试结果')

grid on

subplot(212);

plot(1: Num2, Tat_test-T_sim2','-bs',...

'LineWidth',1,...

'MarkerSize',6,...

'MarkerEdgeColor','k',...

'MarkerFaceColor',[0.9,0.0,0.0]);

xlabel('预测样本')

ylabel('预测误差')

grid on

ylim([-50,50]);

save R2.mat Num2 Tat_test IT T_sim2 Accuracy

158

4.算法理论概述

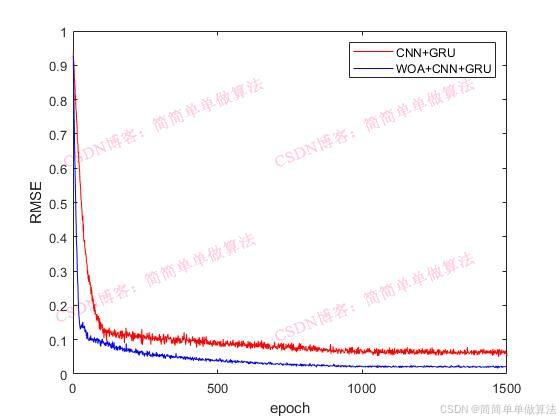

时间序列回归预测是数据分析的重要领域,旨在根据历史数据预测未来时刻的数值。近年来,深度学习模型如卷积神经网络(Convolutional Neural Network, CNN)、GRU在时间序列预测中展现出显著优势。然而,模型参数的有效设置对预测性能至关重要。鲸鱼优化(WOA)作为一种高效的全局优化算法,被引入用于优化深度学习模型的超参数。

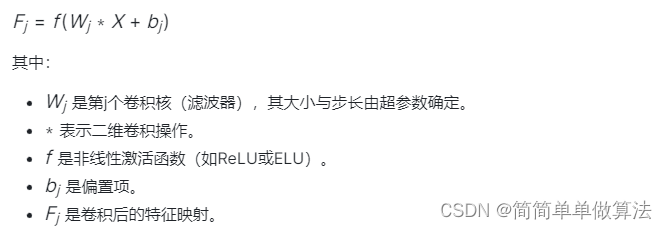

4.1卷积神经网络(CNN)在时间序列中的应用

在时间序列数据中,CNN用于提取局部特征和模式。对于一个长度为T的时间序列数据X = [x_1, x_2, ..., x_T],通过卷积层可以生成一组特征映射:

CNN通过多个卷积层和池化层的堆叠来提取输入数据的特征。每个卷积层都包含多个卷积核,用于捕捉不同的特征。池化层则用于降低数据的维度,减少计算量并增强模型的鲁棒性。

4.2 GRU网络

GRU(Gated Recurrent Unit)是一种先进的循环神经网络(RNN)变体,专门设计用于处理序列数据,如文本、语音、时间序列等。GRU旨在解决传统RNN在处理长序列时可能出现的梯度消失或梯度爆炸问题,并简化LSTM(Long Short-Term Memory)网络的结构,同时保持其捕获长期依赖关系的能力。

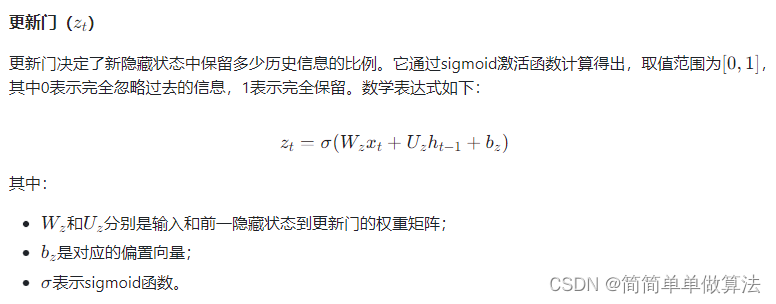

GRU包含一个核心循环单元,该单元在每个时间步t处理输入数据xt并更新隐藏状态ht。其核心创新在于引入了两个门控机制:更新门(Update Gate)和重置门(Reset Gate)。

4.3 WOA优化算法

WOA即Whale Optimization Algorithm(鲸鱼优化算法),是一种受自然界鲸鱼捕食行为启发的生物启发式优化算法,由Eslam Mohamed于2016年提出,常用于解决各种连续优化问题,包括函数优化、机器学习参数调整、工程设计等领域中的复杂优化任务。鲸鱼优化算法模拟了虎鲸的两种主要觅食策略: Bubble-net attacking 和 Spiral updating 过程。

浙公网安备 33010602011771号

浙公网安备 33010602011771号