基于affine+sift+GTM算法的图像配准和三维重建算法matlab仿真

1.算法理论概述

在计算机视觉和图像处理领域,图像配准和三维重建是两个重要的研究方向。图像配准是指将多幅图像中的同一场景进行对齐,使得它们在同一坐标系下,以便进行后续的图像处理和分析。三维重建则是指将多幅图像中的二维信息重建成三维信息,以便进行三维可视化和分析。本文将介绍基于affine+sift+GTM算法的图像配准和三维重建方法。

affine+sift+GTM算法是一种基于特征点匹配的图像配准和三维重建方法。该方法通过提取图像的SIFT特征点,将它们进行配准,然后利用GTM模型进行三维重建。具体实现步骤如下:

数据准备

准备多幅拍摄同一场景的图像,以及相应的摄像机参数,包括内参和外参等。

特征提取

从每幅图像中,提取出一组SIFT特征点。SIFT是一种局部特征描述符,它可以在不同尺度和旋转角度下提取出图像中的关键点,并计算出每个关键点的特征向量,用于表示该点的局部特征。SIFT特征点的提取可以使用OpenCV等开源库进行实现。

特征匹配

将每幅图像中的SIFT特征点进行匹配,以确定它们之间的对应关系。常用的特征匹配方法包括基于描述符距离的匹配、基于相似性度量的匹配等。匹配过程可以使用RANSAC等算法进行优化,以提高匹配的准确性。

相似变换

根据特征点的对应关系,计算出多幅图像之间的相似变换,以实现图像的配准。常用的相似变换包括仿射变换、透视变换等。在本方法中,采用仿射变换进行图像配准。

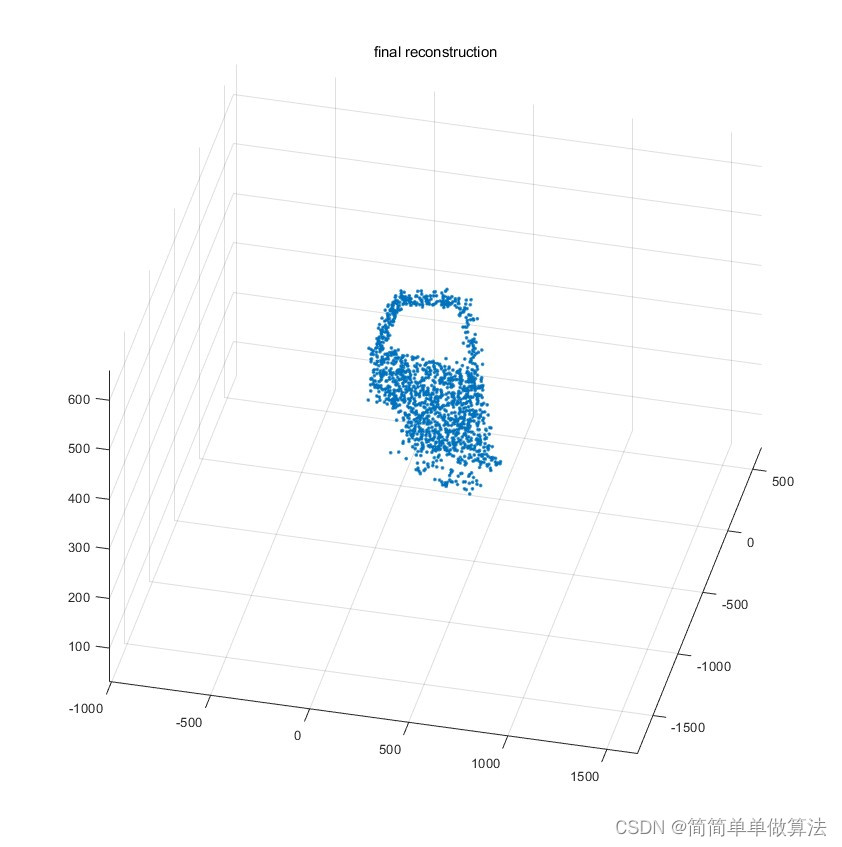

三维重建

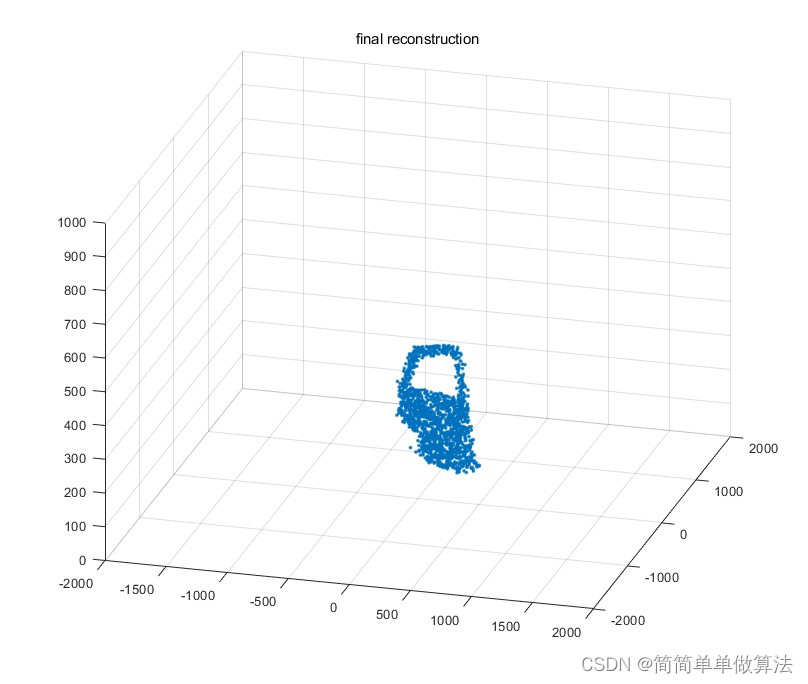

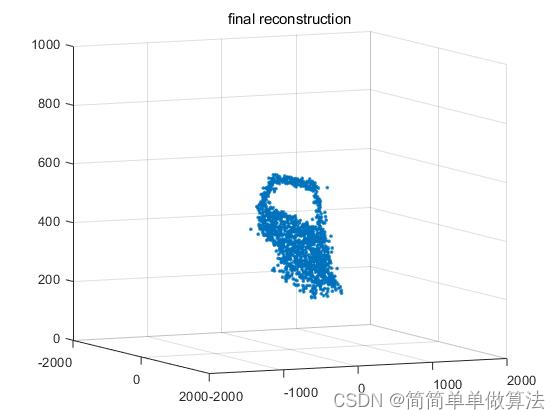

根据配准后的图像,利用GTM模型进行三维重建。GTM模型是一种基于概率的统计模型,它可以将多幅图像中的二维信息重建成三维信息。具体实现步骤如下:

(1)定义GTM模型的参数,包括高斯混合数、隐变量维度等。

(2)根据配准后的图像,计算出每个像素点的深度值,并构造出一个深度图像。

(3)将深度图像作为输入,利用GTM模型进行三维重建,得到一个三维点云模型。

三维可视化

将三维点云模型进行可视化,以便进行三维分析和处理。常用的三维可视化软件包括MeshLab、CloudCompare等。

下面给出affine+sift+GTM算法中常用的数学公式:

SIFT特征点描述符

SIFT特征点描述符是一种128维的向量,用于表示该点的局部特征。设该点的梯度方向直方图为h,共有16个方向,每个方向有8个bin,则SIFT特征点描述符为:

d = [h1,h2,...,h128]

其中,hi表示第i个bin的值。

仿射变换

仿射变换是一种线性变换,可以将一个二维图像变换到另一个二维图像。假设有一个二维点(x,y),经过仿射变换后得到的点(x',y')可以表示为:

[x' y' 1] = [x y 1] * A

其中,A是一个3*3的仿射变换矩阵,可以表示为:

A = [a11 a12 tx

a21 a22 ty

0 0 1]

其中,a11、a12、a21、a22表示缩放和旋转的参数,tx、ty表示平移的参数。

GTM模型

GTM模型是一种基于概率的统计模型,它可以将多幅图像中的二维信息重建成三维信息。假设有N个像素点,GTM模型可以表示为:

p(x) = 1/Z * sum(wj * N(x | μj,Σj))

其中,Z是归一化因子,w是权重,N(x | μj,Σj)表示多元高斯分布,μj和Σj分别表示第j个高斯分布的均值和协方差矩阵。

三维点云模型是由一组三维点构成的,在本方法中,可以表示为:

P = {(x1,y1,z1),(x2,y2,z2),...,(xn,yn,zn)}

其中,(xi,yi,zi)表示第i个三维点的坐标。

2.算法运行软件版本

MATLAB2017b

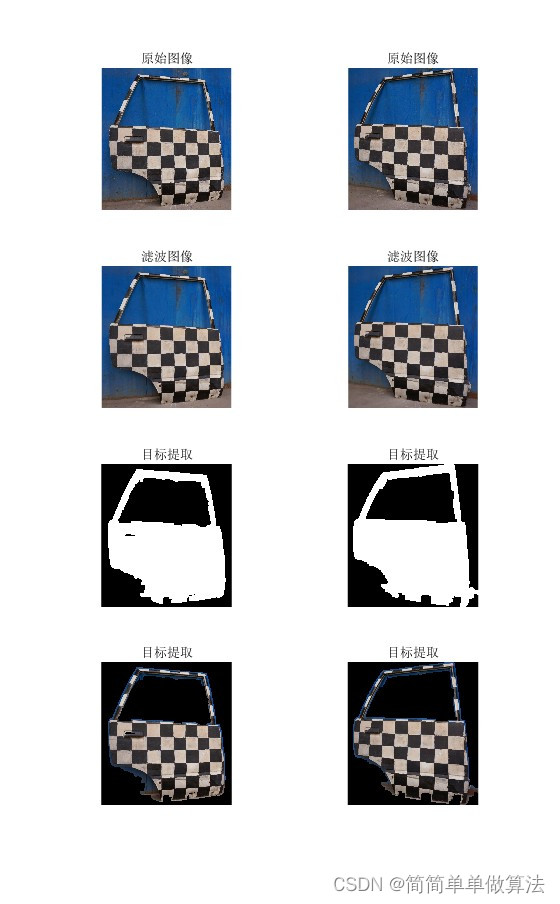

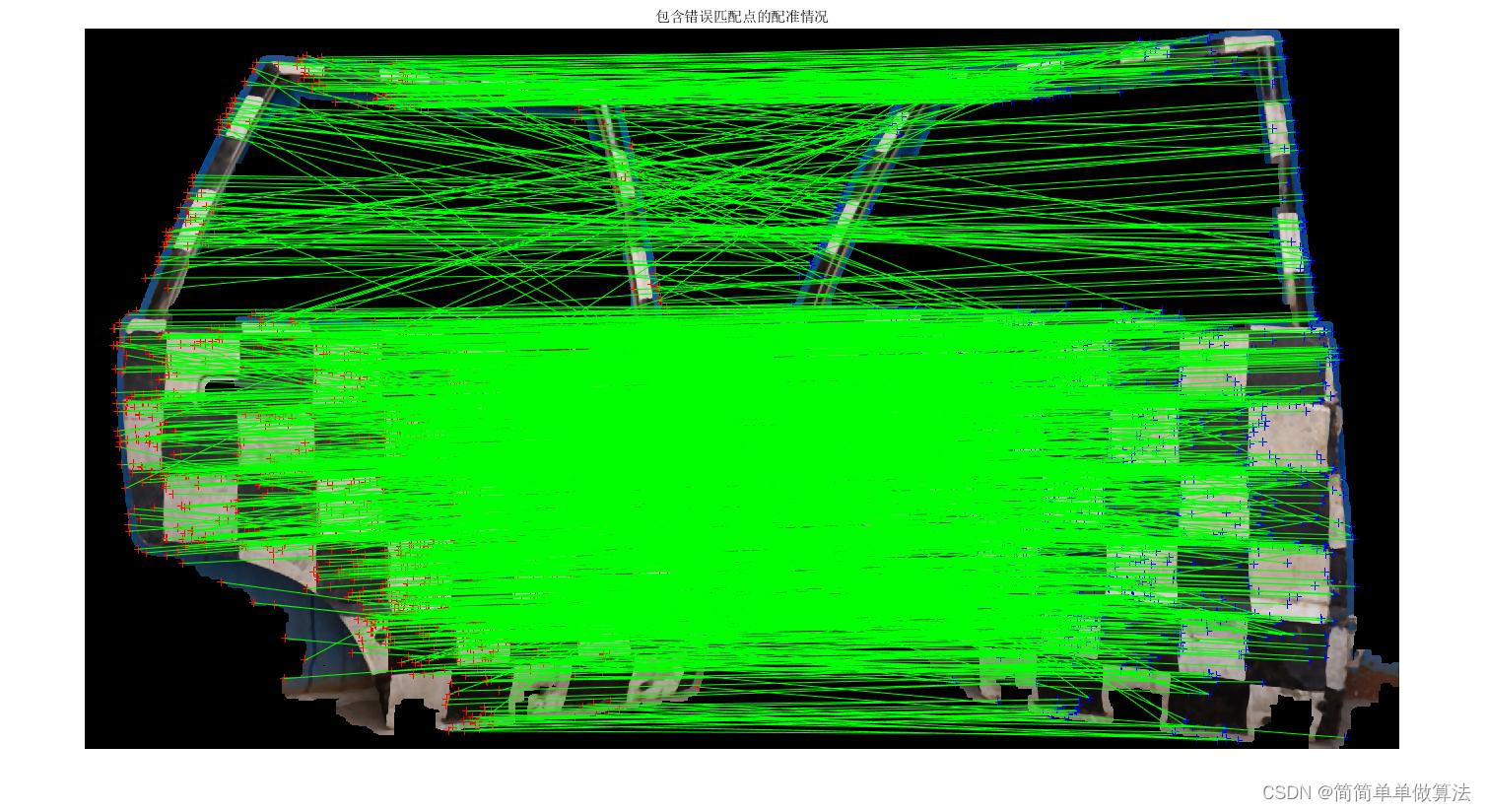

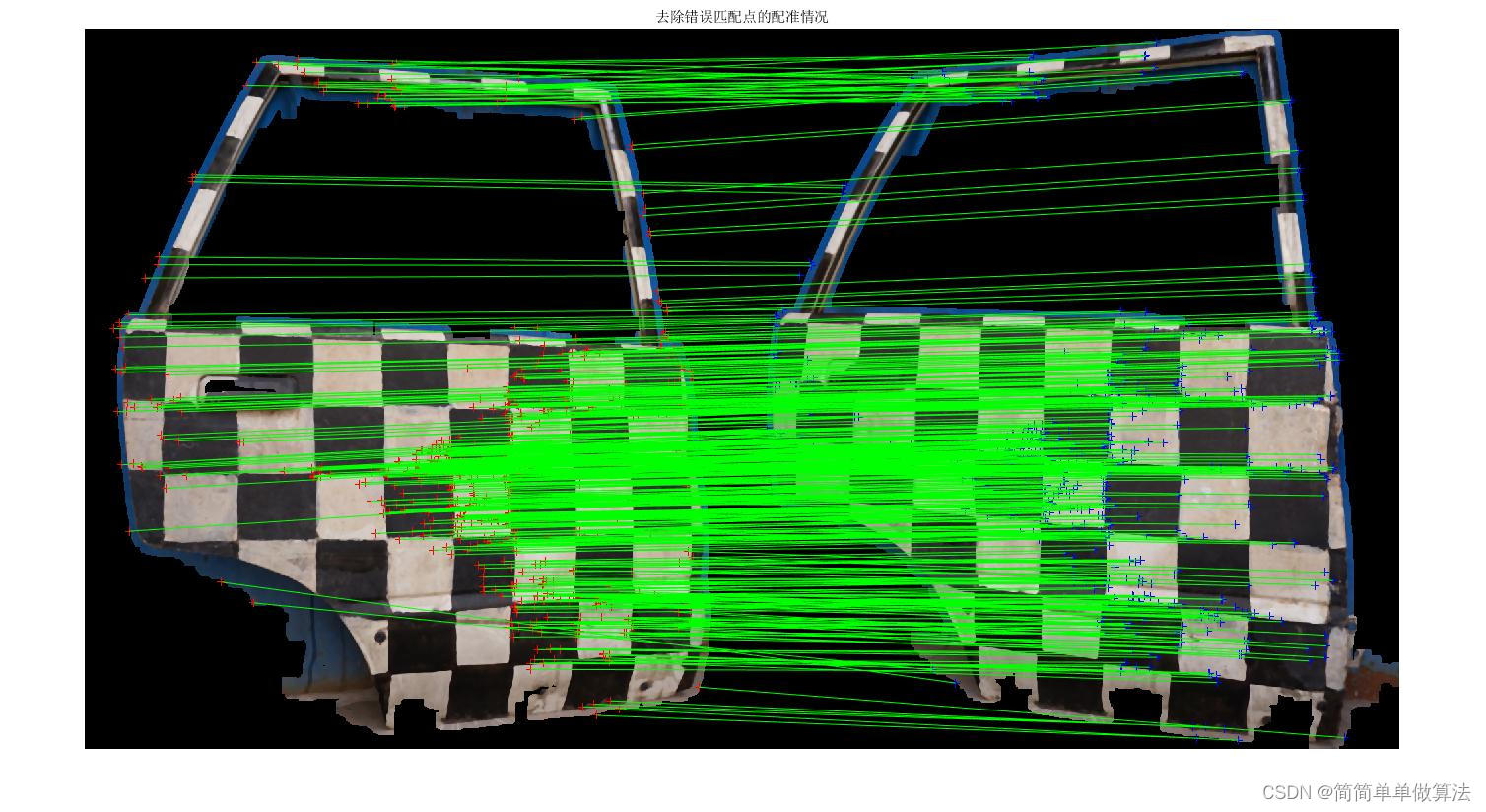

3.算法运行效果图预览

4.部分核心程序

% 定义图像缩放比例和阈值

SCALE = 5;

Threshold = 0.0000002;

%1输入2个图片

I1 = imread('pic\a1.jpg');

I2 = imread('pic\a2.jpg');

% 显示原始图像

figure;

subplot(421);

imshow(I1);title('原始图像');

subplot(422);

imshow(I2);title('原始图像');

%2图像的预处理,比如增强,滤波,去背景等等,提取目标

I1f(:,:,1) = medfilt2(I1(:,:,1),[5,5]);

I1f(:,:,2) = medfilt2(I1(:,:,2),[5,5]);

I1f(:,:,3) = medfilt2(I1(:,:,3),[5,5]);

I2f(:,:,1) = medfilt2(I2(:,:,1),[5,5]);

I2f(:,:,2) = medfilt2(I2(:,:,2),[5,5]);

I2f(:,:,3) = medfilt2(I2(:,:,3),[5,5]);

subplot(423);

imshow(I1f);title('滤波图像');

subplot(424);

imshow(I2f);title('滤波图像');

[R,C,K] = size(I1f);

I1bg = zeros(R,C);

I2bg = zeros(R,C);

Thresh1 = 130;

Thresh2 = 70;

for i = 1:R

for j = 1:C

if I1f(i,j,1) >= Thresh1 & I1f(i,j,2) >= Thresh1 & I1f(i,j,3) >= Thresh1

I1bg(i,j) = 1;

end

if I1f(i,j,1) <= Thresh2 & I1f(i,j,2) <= Thresh2 & I1f(i,j,3) <= Thresh2

I1bg(i,j) = 1;

end

if I2f(i,j,1) >= Thresh1 & I2f(i,j,2) >= Thresh1 & I2f(i,j,3) >= Thresh1

I2bg(i,j) = 1;

end

if I2f(i,j,1) <= Thresh2 & I2f(i,j,2) <= Thresh2 & I2f(i,j,3) <= Thresh2

I2bg(i,j) = 1;

end

end

end

%去掉连通域小面积区域

I1bg = double(bwareaopen(I1bg,20000));

I2bg = double(bwareaopen(I2bg,20000));

SE=strel('square',20);

I1bgs = imdilate(I1bg,SE);%图像

I2bgs = imdilate(I2bg,SE);%图像

subplot(425);

imshow(I1bgs);title('目标提取');

subplot(426);

imshow(I2bgs);title('目标提取');

[R,C] = size(I1bg);

imgs1 = I1f;

imgs2 = I2f;

%根据提取出的目标,将图像中非目标区域置为0。

for i = 1:R

for j = 1:C

if I1bgs(i,j,1) == 0

imgs1(i,j,:) = 0;

end

if I2bgs(i,j,1) == 0

imgs2(i,j,:) = 0;

end

end

end

subplot(427);

imshow(imgs1);title('目标提取');

subplot(428);

imshow(imgs2);title('目标提取');

%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%%

%3目标的特征点检测和提取,

[F_1,Vp_1] = extractFeatures(rgb2gray(imgs1),detectKAZEFeatures(rgb2gray(imgs1),'Threshold',Threshold, 'NumOctaves',3,'NumScaleLevels',SCALE));

[F_2,Vp_2] = extractFeatures(rgb2gray(imgs2),detectKAZEFeatures(rgb2gray(imgs2),'Threshold',Threshold, 'NumOctaves',3,'NumScaleLevels',SCALE));

indexPairs = matchFeatures(F_1,F_2); %匹配提取出的特征点。

Mf_1 = Vp_1(indexPairs(:, 1));

Mp_1 = Mf_1.Location;

Mf_2 = Vp_2(indexPairs(:, 2));

Mp_2 = Mf_2.Location;

Images1all = Vp_1.Location;

Images2all = Vp_2.Location;

X1 = Mp_1;

X2 = Mp_2;

img1s = imgs1;

img2s = imgs2;

[r1,c1,k] = size(img1s);

[r2,c2,k] = size(img2s);

L1 = min(r1,r2);

L2 = min(c1,c2);

Step = 1;

Xs = X1(1:Step:end,1);

Ys = X1(1:Step:end,2);

Xe = X2(1:Step:end,1)+c1;

Ye = X2(1:Step:end,2);

%去除错误配准点后的匹配效果显示匹配结果。

figure(2);

hIm = montage([(img1s(1:L1,1:L2,:)),(img2s(1:L1,1:L2,:))]);

img2s2 = img2s(1:L1,1:L2,:);

hold on;

plot(Xs,Ys,'r+');

hold on;

plot(Xe,Ye,'b+');

hold on

for i = 1:length(Xs)

line([Xs(i),Xe(i)],[Ys(i),Ye(i)],'color','g');

hold on

end

title('包含错误匹配点的配准情况');

save step1.mat imgs1 imgs2 Xs Ys Xe Ye c1 X1 X2 Images1all Images2all

浙公网安备 33010602011771号

浙公网安备 33010602011771号