bond网卡

目录

一、bond概述

1.1、bond的优点

二、bond模式

2.1、mode=0

2.2、mode=1

2.3、mode=2

2.4、mode=3

2.5、mode=4

2.6、mode=5

2.7、mode=6

三、实验案例

实验bond1 压力测试 查看网卡流向 以及主备测试

结论

引言:当linux系统上有多个单独网卡,又想充分利用这些网卡,同时对外提供一个统一的网络地址,以使得增大网络的吞吐量,同时也提高网络的可用性,这时就需要bond来帮助我们解决这个问题。

一、bond概述

bond是将多块物理网卡虚拟为一块逻辑网卡,使多块网卡看起来像一块网卡,通过主从的配置来讲进行网络的运行维护。

1.1、bond的优点

linux系统下配置bond,通过网卡绑定可增加服务器可靠性,同时可增加网络带宽,提供稳定的网络服务。

二、bond模式

Linux网卡绑定mode共有七种(0~6) bond0、bond1、bond2、bond3、bond4、bond5、bond6,接下来我们一起简单看下这7中模式的工作原理概述。

2.1、mode=0

轮询策略,数据包在每个slave网卡上都进行数据传输,以逐包形式在两个物理网卡上转发数据。这种模式提供了数据的负载均衡和容错能力。

bond0工作原理

传输数据包顺序是依次传输(即:第1个包走eth0,下一个包就走eth1….一直循环下去,直到最后一个传输完毕),此模式提供负载平衡和容错能力;但是我们知道如果一个连接或者会话的数据包从不同的接口发出的话,中途再经过不同的链路,在客户端很有可能会出现数据包无序到达的问题,而无序到达的数据包需要重新要求被发送,这样网络的吞吐量就会下降.

2.2、mode=1

在主备模式下,只有主网卡工作,备份网卡不工作,只有当一个网络接口失效时(例如交换机掉电等),为了不会出现网络中断,系统会按照配置指定的网卡顺序启动工作,保证机器仍能对外服务,起到了失效保护功能。

bond1工作原理

只有一个设备处于活动状态,当一个宕掉另一个马上由备份转换为主设备。mac地址是外部可见得,从外面看来,bond的MAC地址是唯一的,以避免switch(交换机)发生混乱。此模式只提供了容错能力;由此可见此算法的优点是可以提供高网络连接的可用性,但是它的资源利用率较低,只有一个接口处于工作状态,在有N个网络接口的情况下,资源利用率为1/N

2.3、mode=2

基于所选择的hash策略,本模式也提供负载均衡和容错能力

bond2工作原理

基于指定的传输HASH策略传输数据包。缺省的策略是:(源MAC地址 XOR 目标MAC地址) % slave数量。其他的传输策略可以通过xmit_hash_policy选项指定,此模式提供负载平衡和容错能力

2.4、mode=3

广播策略,向所有的slave接口发送数据包,本模式提供容错能力

bond3工作原理

在每个slave接口上传输每个数据包,此模式提供了容错能力。

2.5、mode=4

动态链路聚合,根据802.3ad标准利用所有的slave建立聚合链路。slave接口的出口取决于传输的hash策略,默认策略是简单的XOR策略,而hash策略则可以通xmit_hash_policy选项配置。

前提:每个slave网卡支持ethtool获取速率和双工状态

bond4工作原理

创建一个聚合组,它们共享同样的速率和双工设定。根据802.3ad规范将多个slave工作在同一个激活的聚合体下。外出流量的slave选举是基于传输hash策略,该策略可以通过xmit_hash_policy选项从缺省的XOR策略改变到其他策略。需要注意的是,并不是所有的传输策略都是802.3ad适应的,尤其考虑到在802.3ad标准43.2.4章节提及的包乱序问题。不同的实现可能会有不同的适应性。

2.6、mode=5

自适应传输负载均衡:根据每个slave的负载(相对速度)决定从哪个接口发送数据包,从当前接口接收数据包。如果接收的slave接口故障,其它slave接口将接管它的mac地址继续接收。

前提:每个slave网卡支持ethtool获取速率。

bond5工作原理

不需要任何特别的switch(交换机)支持的通道bonding。在每个slave上根据当前的负载(根据速度计算)分配外出流量。如果正在接受数据的slave出故障了,另一个slave接管失败的slave的MAC地址。

2.7、mode=6

自适应负载均衡:

前提:每个slave网卡支持ethtool获取速率,每个slave网卡支持启用时重新设置硬件地址

bond6工作原理

该模式包含了balance-tlb模式,同时加上针对IPV4流量的接收负载均衡(receive load balance, rlb),而且不需要任何switch(交换机)的支持。接收负载均衡是通过ARP协商实现的。bonding驱动截获本机发送的ARP应答,并把源硬件地址改写为bond中某个slave的唯一硬件地址,从而使得不同的对端使用不同的硬件地址进行通信。

其它地方的相关概念

将两张网卡绑定,共用一个IP,实现冗余效果。实际上Linux双网卡的绑定模式有7种,而在这里常用的是active-backup,

一个设备如果只有一个网卡,那么当这个网卡损坏时设备的网络就会瘫痪。绑定接口的作用就是让多个物理网卡服务于一个IP地址,使得这个网络的抵抗性强。一个设备只能有一个bound接口,配置好以后每个网卡需要一根网线,需要插两个网线,交换机也需要做链路聚合。

1、mode=0(balance-rr)(平衡抡循环策略)

链路负载均衡,增加带宽,支持容错,一条链路故障会自动切换正常链路。交换机需要配置聚合口,思科叫port channel。

特点:传输数据包顺序是依次传输(即:第1个包走eth0,下一个包就走eth1….一直循环下去,直到最后一个传输完毕),此模式提供负载平衡和容错能力;但是我们知道如果一个连接

或者会话的数据包从不同的接口发出的话,中途再经过不同的链路,在客户端很有可能会出现数据包无序到达的问题,而无序到达的数据包需要重新要求被发送,这样网络的吞吐量就会下降

2、mode=1(active-backup)(主-备份策略)

这个是主备模式,只有一块网卡是active,另一块是备用的standby,所有流量都在active链路上处理,交换机配置的是捆绑的话将不能工作,因为交换机往两块网卡发包,有一半包是丢弃的。

特点:只有一个设备处于活动状态,当一个宕掉另一个马上由备份转换为主设备。mac地址是外部可见得,从外面看来,bond的MAC地址是唯一的,以避免switch(交换机)发生混乱。

此模式只提供了容错能力;由此可见此算法的优点是可以提供高网络连接的可用性,但是它的资源利用率较低,只有一个接口处于工作状态,在有 N 个网络接口的情况下,资源利用率为1/N

3、mode=2(balance-xor)(平衡策略)

表示XOR Hash负载分担,和交换机的聚合强制不协商方式配合。(需要xmit_hash_policy,需要交换机配置port channel)

特点:基于指定的传输HASH策略传输数据包。缺省的策略是:(源MAC地址 XOR 目标MAC地址) % slave数量。其他的传输策略可以通过xmit_hash_policy选项指定,此模式提供负载平衡和容错能力

4、mode=3(broadcast)(广播策略)

表示所有包从所有网络接口发出,这个不均衡,只有冗余机制,但过于浪费资源。此模式适用于金融行业,因为他们需要高可靠性的网络,不允许出现任何问题。需要和交换机的聚合强制不协商方式配合。

特点:在每个slave接口上传输每个数据包,此模式提供了容错能力

5、mode=4(802.3ad)(IEEE 802.3ad 动态链接聚合)

表示支持802.3ad协议,和交换机的聚合LACP方式配合(需要xmit_hash_policy).标准要求所有设备在聚合操作时,要在同样的速率和双工模式,而且,和除了balance-rr模式外的其它bonding负载均衡模式一样,任何连接都不能使用多于一个接口的带宽。

特点:创建一个聚合组,它们共享同样的速率和双工设定。根据802.3ad规范将多个slave工作在同一个激活的聚合体下。

外出流量的slave选举是基于传输hash策略,该策略可以通过xmit_hash_policy选项从缺省的XOR策略改变到其他策略。需要注意的 是,并不是所有的传输策略都是802.3ad适应的,

尤其考虑到在802.3ad标准43.2.4章节提及的包乱序问题。不同的实现可能会有不同的适应 性。

必要条件:

条件1:ethtool支持获取每个slave的速率和双工设定

条件2:switch(交换机)支持IEEE 802.3ad Dynamic link aggregation

条件3:大多数switch(交换机)需要经过特定配置才能支持802.3ad模式

6、mode=5(balance-tlb)(适配器传输负载均衡)

是根据每个slave的负载情况选择slave进行发送,接收时使用当前轮到的slave。该模式要求slave接口的网络设备驱动有某种ethtool支持;而且ARP监控不可用。

特点:不需要任何特别的switch(交换机)支持的通道bonding。在每个slave上根据当前的负载(根据速度计算)分配外出流量。如果正在接受数据的slave出故障了,另一个slave接管失败的slave的MAC地址。

必要条件:

ethtool支持获取每个slave的速率

7、mode=6(balance-alb)(适配器适应性负载均衡)

在5的tlb基础上增加了rlb(接收负载均衡receive load balance).不需要任何switch(交换机)的支持。接收负载均衡是通过ARP协商实现的.

特点:该模式包含了balance-tlb模式,同时加上针对IPV4流量的接收负载均衡(receive load balance, rlb),而且不需要任何switch(交换机)的支持。接收负载均衡是通过ARP协商实现的。bonding驱动截获本机发送的ARP应答,并把源硬件地址改写为bond中某个slave的唯一硬件地址,从而使得不同的对端使用不同的硬件地址进行通信。

来自服务器端的接收流量也会被均衡。当本机发送ARP请求时,bonding驱动把对端的IP信息从ARP包中复制并保存下来。当ARP应答从对端到达 时,bonding驱动把它的硬件地址提取出来,并发起一个ARP应答给bond中的某个slave。

使用ARP协商进行负载均衡的一个问题是:每次广播 ARP请求时都会使用bond的硬件地址,因此对端学习到这个硬件地址后,接收流量将会全部流向当前的slave。这个问题可以通过给所有的对端发送更新 (ARP应答)来解决,应答中包含他们独一无二的硬件地址,从而导致流量重新分布。

当新的slave加入到bond中时,或者某个未激活的slave重新 激活时,接收流量也要重新分布。接收的负载被顺序地分布(round robin)在bond中最高速的slave上

当某个链路被重新接上,或者一个新的slave加入到bond中,接收流量在所有当前激活的slave中全部重新分配,通过使用指定的MAC地址给每个

三、实验案例

需求:将两张网卡绑定配置成一张虚拟网卡 bond1来测试主备

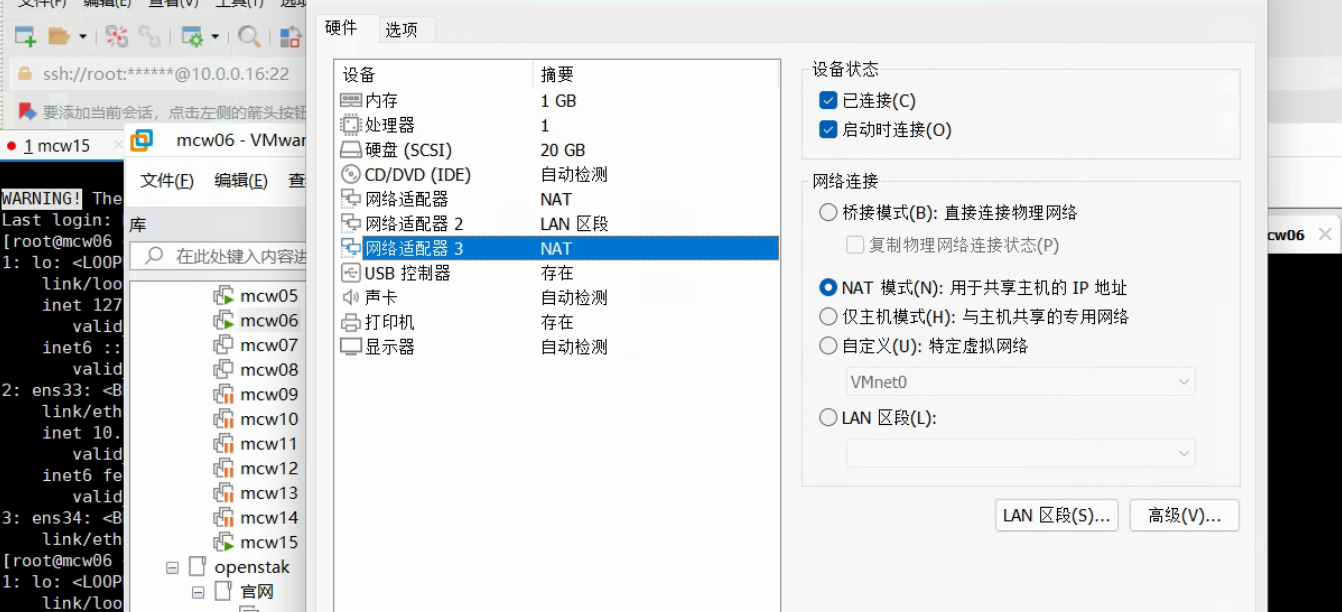

1、添加网卡

@@

新增nat网卡

查看立马多了个网卡,但是还没有这个网卡配置

可以手动添加它的配置

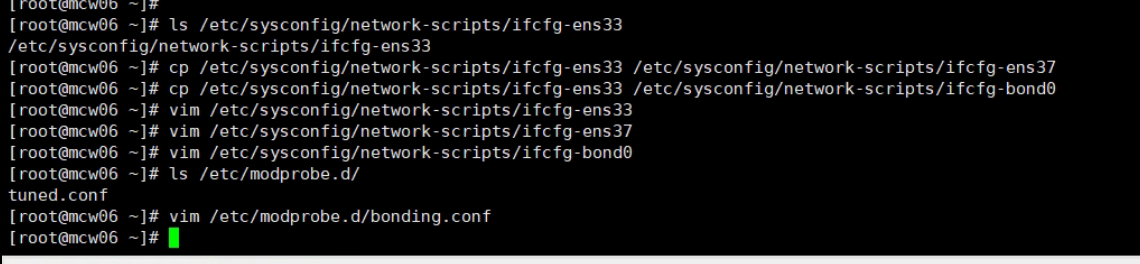

2、修改网卡的信息

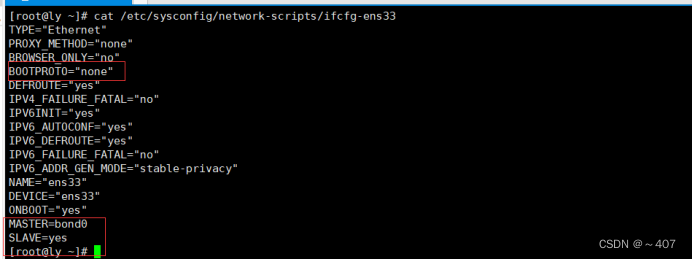

ens33

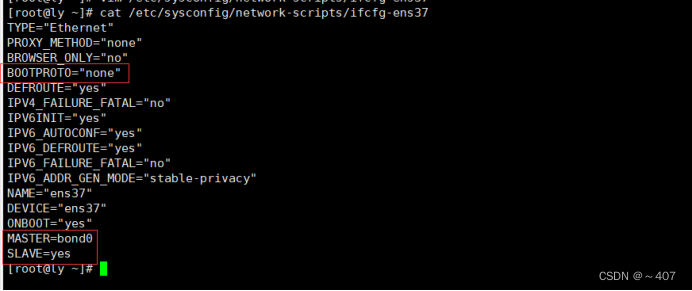

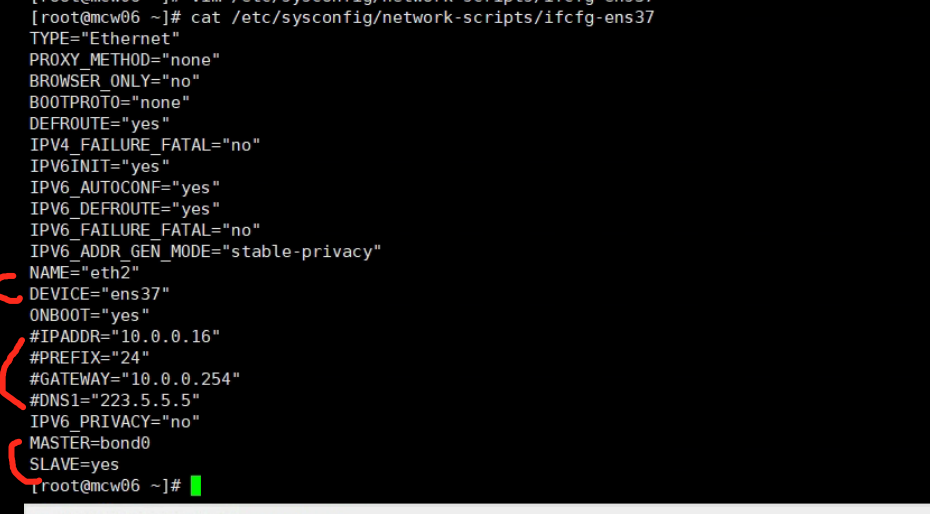

ens37

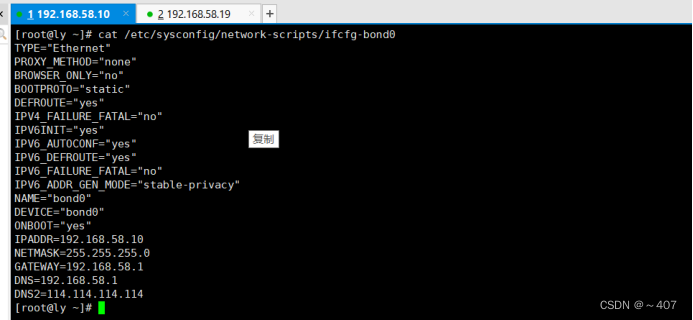

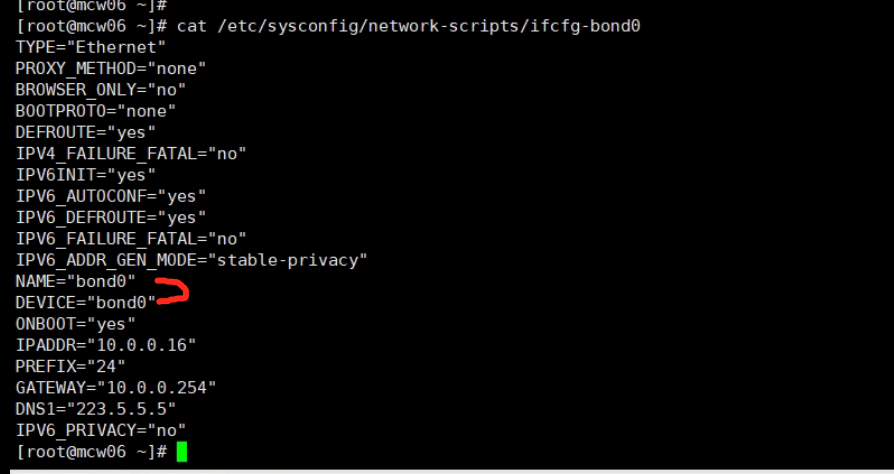

bond0

@@@

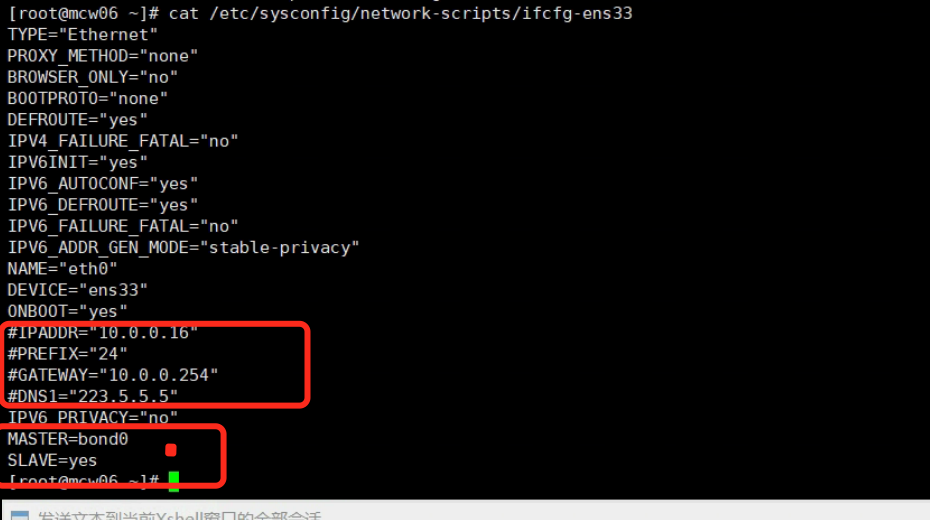

目前ens33的配置

[root@mcw06 ~]# cat /etc/sysconfig/network-scripts/ifcfg-ens33 TYPE="Ethernet" PROXY_METHOD="none" BROWSER_ONLY="no" BOOTPROTO="none" DEFROUTE="yes" IPV4_FAILURE_FATAL="no" IPV6INIT="yes" IPV6_AUTOCONF="yes" IPV6_DEFROUTE="yes" IPV6_FAILURE_FATAL="no" IPV6_ADDR_GEN_MODE="stable-privacy" NAME="eth0" DEVICE="ens33" ONBOOT="yes" IPADDR="10.0.0.16" PREFIX="24" GATEWAY="10.0.0.254" DNS1="223.5.5.5" IPV6_PRIVACY="no" [root@mcw06 ~]#

复制ens33为ens37和bond0配置,并且修改配置

注释一些,添加一些

3、修改并添加配置文件

增删改

bond0还是原来的ens33的配置,就改了个网卡名字,其它没有变

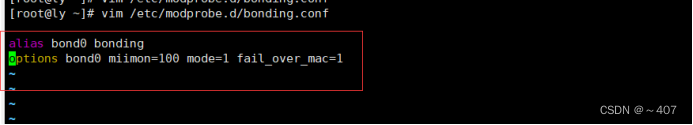

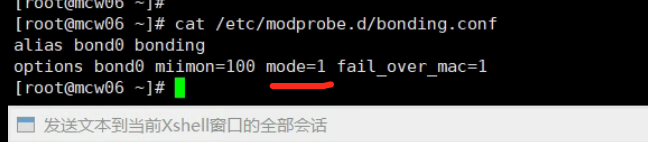

[root@mcw06 ~]# cat /etc/modprobe.d/bonding.conf

alias bond0 bonding

options bond0 miimon=100 mode=1 fail_over_mac=1

[root@mcw06 ~]#

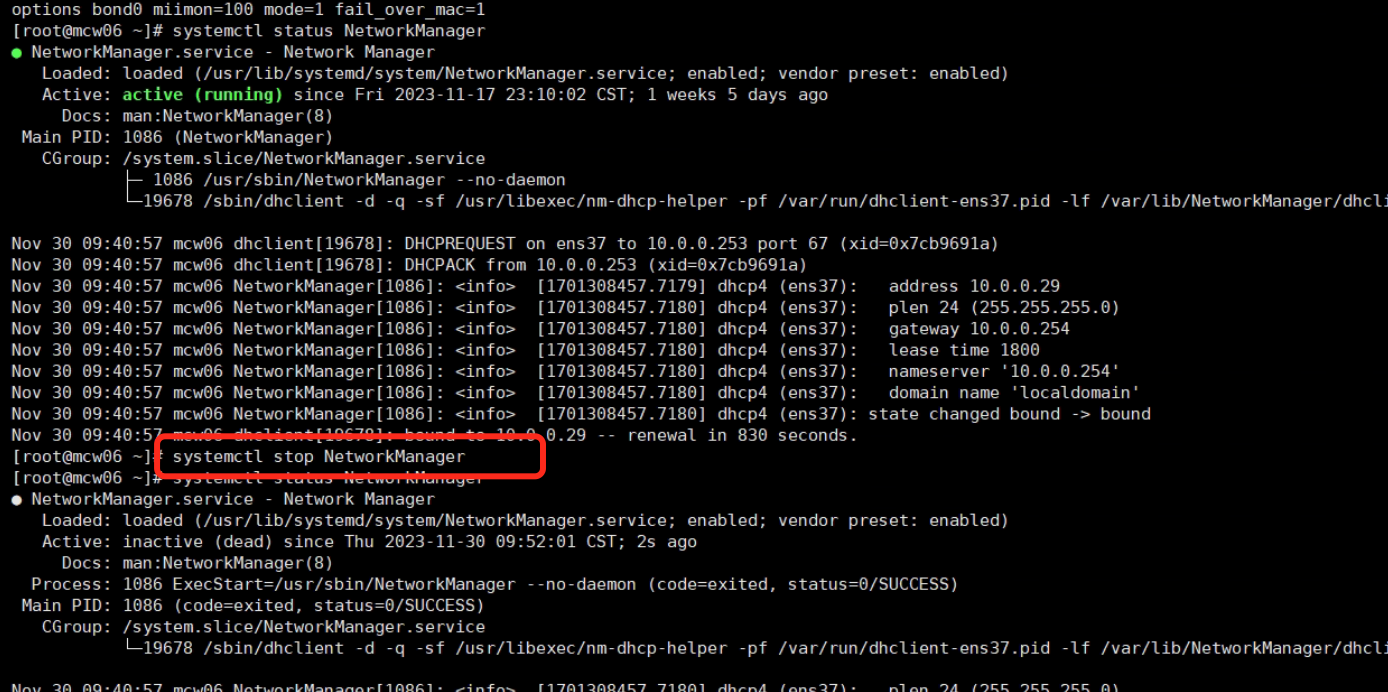

4、关闭NetworkManager服务

并设置开机自关闭

@@@

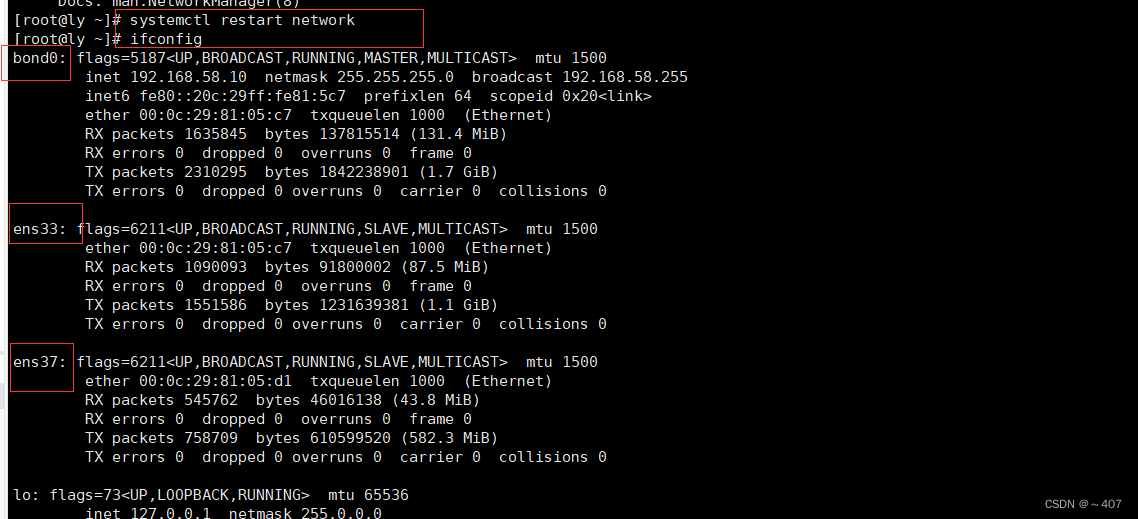

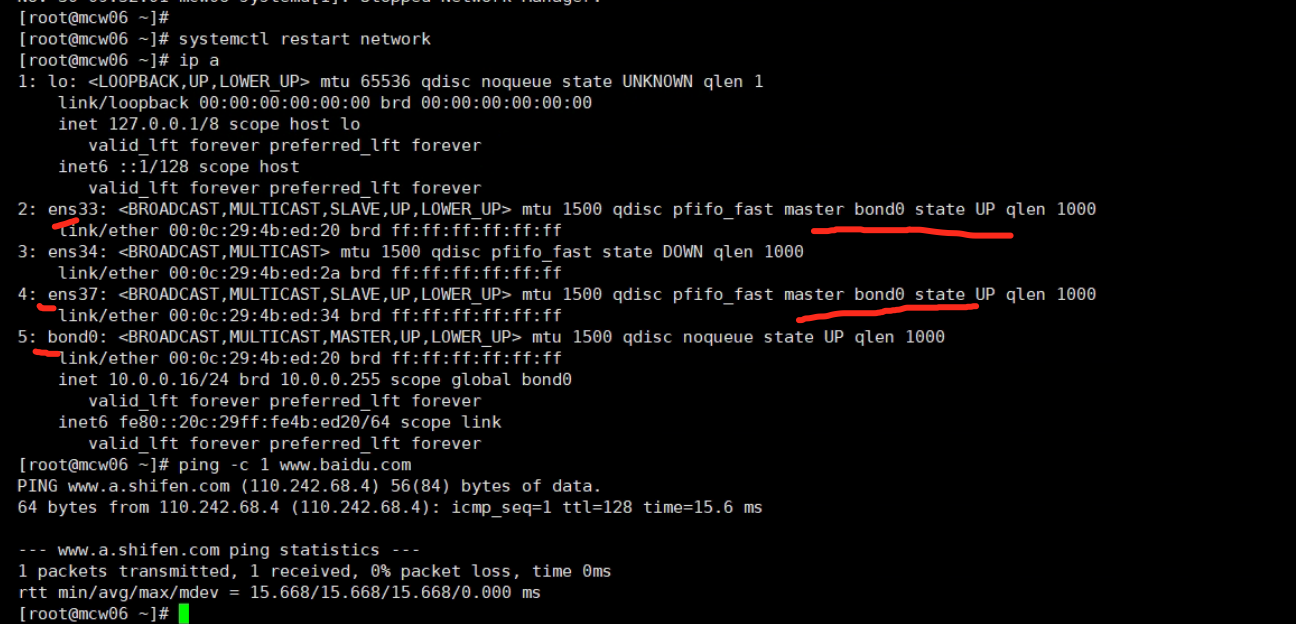

5、重启网卡,以及重启虚拟机,查看网卡信息

@@@

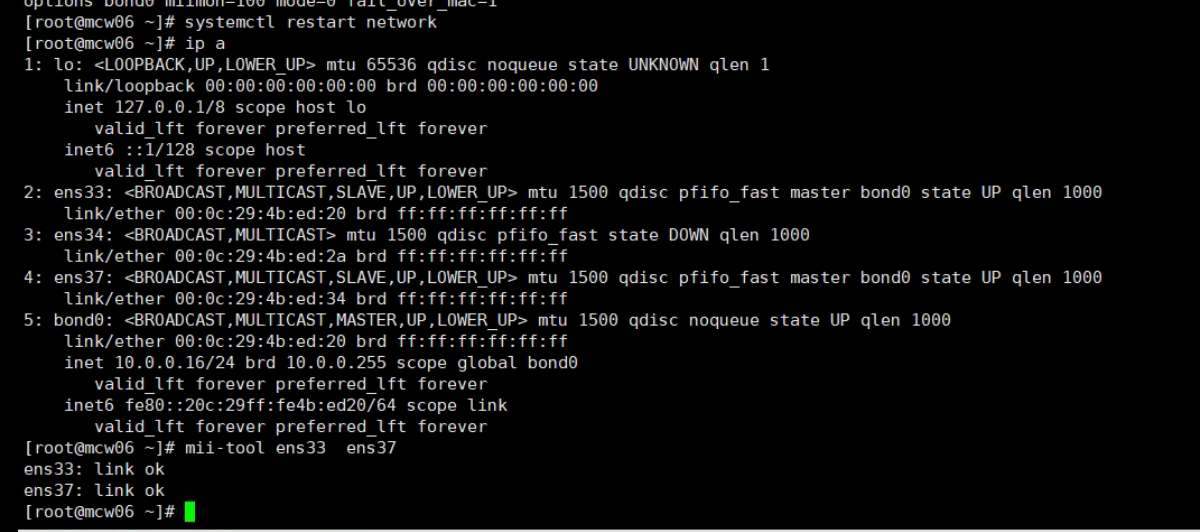

ens33 37都没显示IP。两个网卡都显示master是bond0网卡,并且是up,并且此刻通外网,和用ens33做外网网卡的时候一样,重启网络后,xshell会话也没有断开

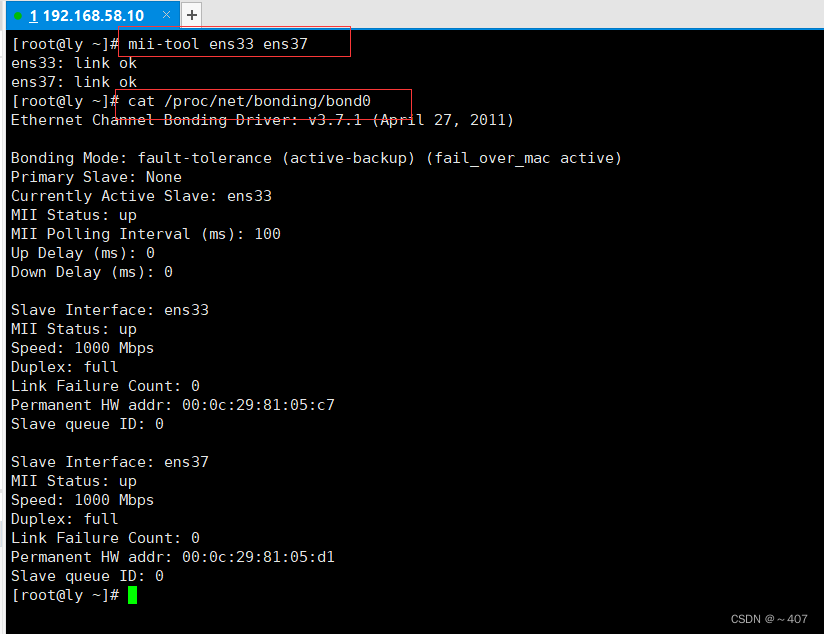

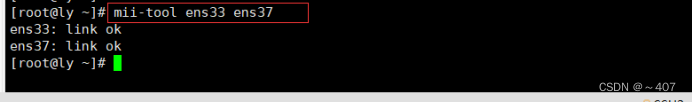

6、获取网卡状态

@@@

查看网络状态

[root@mcw06 ~]# mii-tool ens33 ens37 ens33: link ok ens37: link ok [root@mcw06 ~]# mii-tool ens33 ens33: link ok [root@mcw06 ~]# cat /proc/net/bonding/bond0 Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011) Bonding Mode: fault-tolerance (active-backup) (fail_over_mac active) Primary Slave: None Currently Active Slave: ens33 #当前活跃的从,是ens33,那么ens37会工作吗。bond0应该两个网卡都工作才对吧 MII Status: up MII Polling Interval (ms): 100 Up Delay (ms): 0 Down Delay (ms): 0 Slave Interface: ens33 #从接口网卡,ens33 和37两个。 MII Status: up #状态是up的 Speed: 1000 Mbps #速率 Duplex: full #这个是否是全双工的意思吗,不太清楚 Link Failure Count: 0 #目前没有错误信息 Permanent HW addr: 00:0c:29:4b:ed:20 #这里这个,跟ens34的地址一样 Slave queue ID: 0 #从id一样,应该就是同一个主吧。 Slave Interface: ens37 MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 00:0c:29:4b:ed:34 Slave queue ID: 0 [root@mcw06 ~]#

查看ens34这个没有开启的网卡

[root@mcw06 ~]# mii-tool ens34 ens34: no link [root@mcw06 ~]# ip a 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST,SLAVE,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast master bond0 state UP qlen 1000 link/ether 00:0c:29:4b:ed:20 brd ff:ff:ff:ff:ff:ff 3: ens34: <BROADCAST,MULTICAST> mtu 1500 qdisc pfifo_fast state DOWN qlen 1000 link/ether 00:0c:29:4b:ed:2a brd ff:ff:ff:ff:ff:ff 4: ens37: <BROADCAST,MULTICAST,SLAVE,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast master bond0 state UP qlen 1000 link/ether 00:0c:29:4b:ed:34 brd ff:ff:ff:ff:ff:ff 5: bond0: <BROADCAST,MULTICAST,MASTER,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP qlen 1000 link/ether 00:0c:29:4b:ed:20 brd ff:ff:ff:ff:ff:ff inet 10.0.0.16/24 brd 10.0.0.255 scope global bond0 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:fe4b:ed20/64 scope link valid_lft forever preferred_lft forever [root@mcw06 ~]#

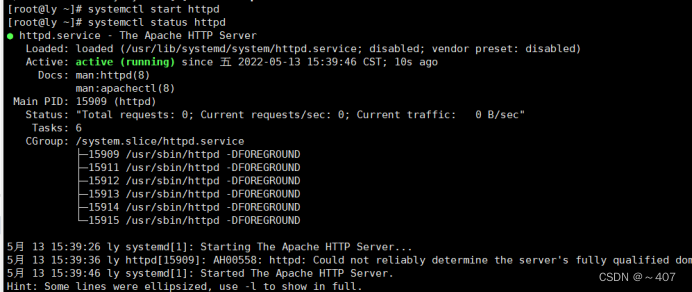

7、开启httpd服务,并查看状态

实验bond1 压力测试 查看网卡流向 以及主备测试

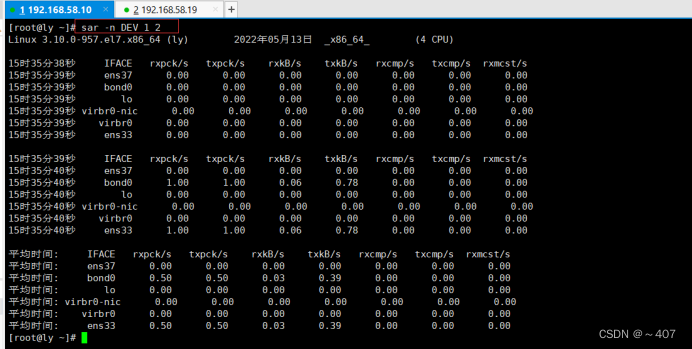

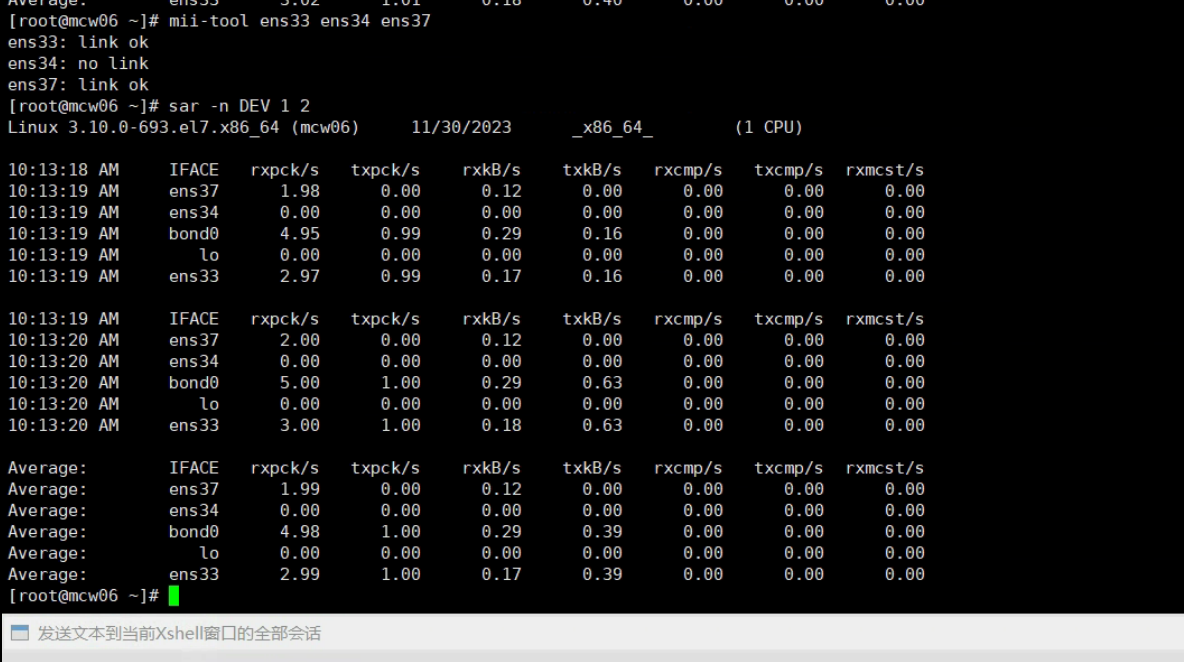

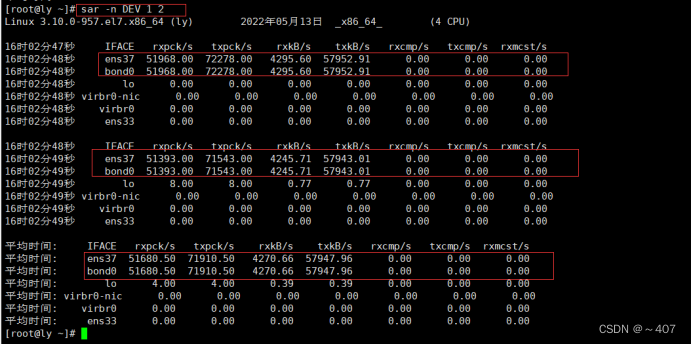

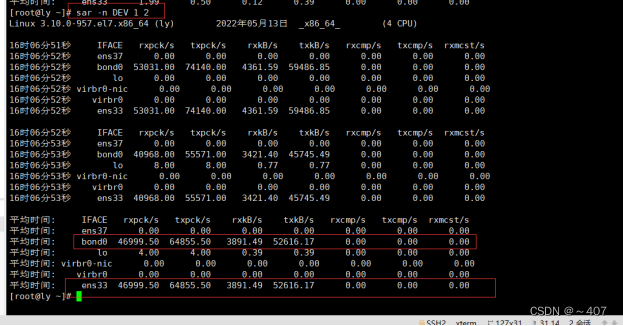

Sar -n DEV 1 2 检测数据流向

命令后面1 2 意思是:每一秒钟取1次值,取2次。

DEV显示网络接口信息

同时开启2块网卡

《@@@

@@@》

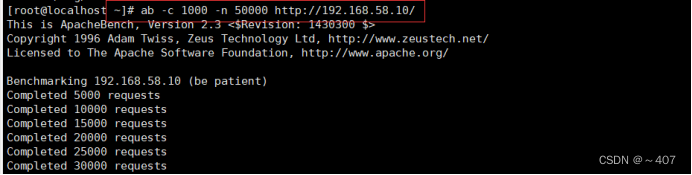

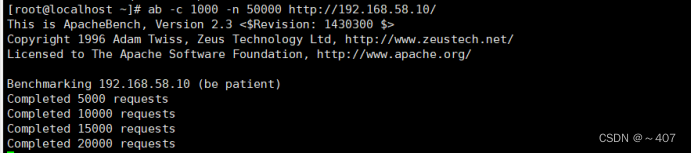

使用ab -c 1000 -n 50000 http://192.168.58.10压力测试

-c表示并发用户数

-n表示请求总数

Bond虚拟网卡与ens33分担流量压力 增加带宽

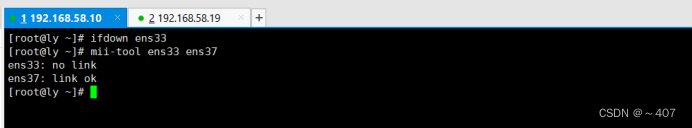

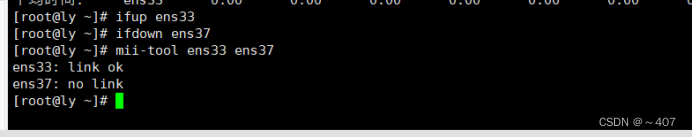

关闭ens33网卡

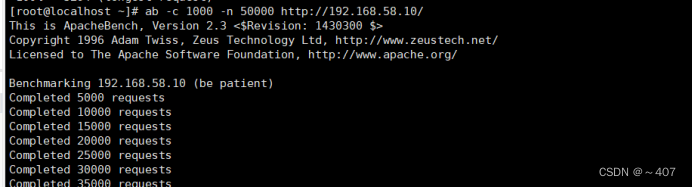

压力测试

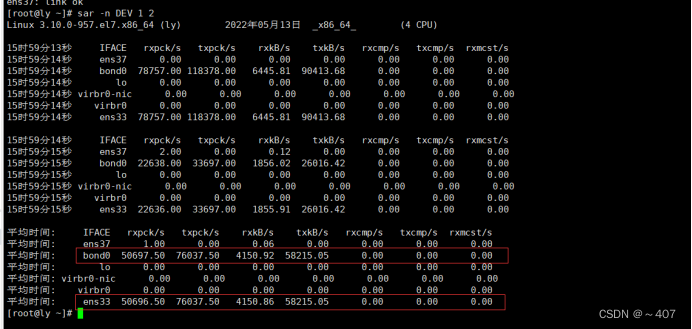

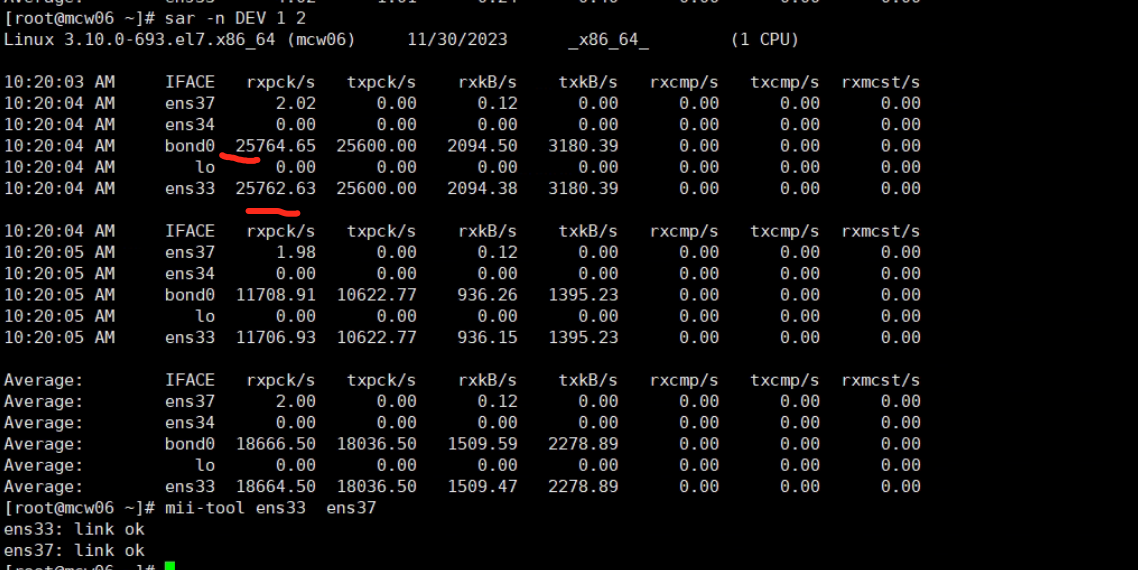

Sar命令查看数据流向 关闭ens33网卡 ens37代替工作和bond虚拟网卡 分担流量压力

在关闭ens37网卡

压力测试

关闭ens37网卡 ,ens33代替工作与bond虚拟网卡工作分担流量压力

结论

由上述实验案例可以验证bond是将多块物理网卡虚拟为一块逻辑网卡,可以通过主从的配置来讲进行网络的运行维护。bond1主备实验案例完成。

《@@@

我的双网卡都在的时候,结果只是走的ens33呀,不知道为啥

宕33之前

[root@mcw06 ~]# mii-tool ens33 ens37 ens33: link ok ens37: link ok [root@mcw06 ~]# ip a 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST,SLAVE,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast master bond0 state UP qlen 1000 link/ether 00:0c:29:4b:ed:20 brd ff:ff:ff:ff:ff:ff 3: ens34: <BROADCAST,MULTICAST> mtu 1500 qdisc pfifo_fast state DOWN qlen 1000 link/ether 00:0c:29:4b:ed:2a brd ff:ff:ff:ff:ff:ff 4: ens37: <BROADCAST,MULTICAST,SLAVE,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast master bond0 state UP qlen 1000 link/ether 00:0c:29:4b:ed:34 brd ff:ff:ff:ff:ff:ff 5: bond0: <BROADCAST,MULTICAST,MASTER,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP qlen 1000 link/ether 00:0c:29:4b:ed:20 brd ff:ff:ff:ff:ff:ff #此时这个地址是33的 inet 10.0.0.16/24 brd 10.0.0.255 scope global bond0 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:fe4b:ed20/64 scope link valid_lft forever preferred_lft forever [root@mcw06 ~]# cat /proc/net/bonding/bond0 #查看文件,有33的信息 Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011) Bonding Mode: fault-tolerance (active-backup) (fail_over_mac active) Primary Slave: None Currently Active Slave: ens33 #宕33之前,活跃的是33 MII Status: up MII Polling Interval (ms): 100 Up Delay (ms): 0 Down Delay (ms): 0 Slave Interface: ens33 # MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 00:0c:29:4b:ed:20 Slave queue ID: 0 Slave Interface: ens37 MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 00:0c:29:4b:ed:34 Slave queue ID: 0 [root@mcw06 ~]#

宕33之后

[root@mcw06 ~]# ifdown ens33 [root@mcw06 ~]# ip a 1: lo: <LOOPBACK,UP,LOWER_UP> mtu 65536 qdisc noqueue state UNKNOWN qlen 1 link/loopback 00:00:00:00:00:00 brd 00:00:00:00:00:00 inet 127.0.0.1/8 scope host lo valid_lft forever preferred_lft forever inet6 ::1/128 scope host valid_lft forever preferred_lft forever 2: ens33: <BROADCAST,MULTICAST> mtu 1500 qdisc pfifo_fast state DOWN qlen 1000 link/ether 00:0c:29:4b:ed:20 brd ff:ff:ff:ff:ff:ff 3: ens34: <BROADCAST,MULTICAST> mtu 1500 qdisc pfifo_fast state DOWN qlen 1000 link/ether 00:0c:29:4b:ed:2a brd ff:ff:ff:ff:ff:ff 4: ens37: <BROADCAST,MULTICAST,SLAVE,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast master bond0 state UP qlen 1000 link/ether 00:0c:29:4b:ed:34 brd ff:ff:ff:ff:ff:ff 5: bond0: <BROADCAST,MULTICAST,MASTER,UP,LOWER_UP> mtu 1500 qdisc noqueue state UP qlen 1000 link/ether 00:0c:29:4b:ed:34 brd ff:ff:ff:ff:ff:ff #mac地址是37的 了 inet 10.0.0.16/24 brd 10.0.0.255 scope global bond0 valid_lft forever preferred_lft forever inet6 fe80::20c:29ff:fe4b:ed20/64 scope link valid_lft forever preferred_lft forever [root@mcw06 ~]# cat /proc/net/bonding/bond0 Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011) Bonding Mode: fault-tolerance (active-backup) (fail_over_mac active) Primary Slave: None Currently Active Slave: ens37 #当前活跃的从是37 MII Status: up MII Polling Interval (ms): 100 Up Delay (ms): 0 Down Delay (ms): 0 Slave Interface: ens37 #看不到33的信息了 MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 00:0c:29:4b:ed:34 Slave queue ID: 0 [root@mcw06 ~]#

此时再从别处压力测试,看流量走的是37网卡了。宕一个网卡,bond0还是能使用的。

[root@mcw06 ~]# mii-tool ens33 ens37 ens33: no link ens37: link ok [root@mcw06 ~]# sar -n DEV 1 2 Linux 3.10.0-693.el7.x86_64 (mcw06) 11/30/2023 _x86_64_ (1 CPU) 10:28:48 AM IFACE rxpck/s txpck/s rxkB/s txkB/s rxcmp/s txcmp/s rxmcst/s 10:28:49 AM ens37 8872.00 7741.00 689.01 1105.84 0.00 0.00 0.00 10:28:49 AM ens34 0.00 0.00 0.00 0.00 0.00 0.00 0.00 10:28:49 AM bond0 8872.00 7741.00 689.01 1105.84 0.00 0.00 0.00 10:28:49 AM lo 8.00 8.00 0.81 0.81 0.00 0.00 0.00 10:28:49 AM ens33 0.00 0.00 0.00 0.00 0.00 0.00 0.00 10:28:49 AM IFACE rxpck/s txpck/s rxkB/s txkB/s rxcmp/s txcmp/s rxmcst/s 10:28:50 AM ens37 23.23 17.17 1.93 3.74 0.00 0.00 0.00 10:28:50 AM ens34 0.00 0.00 0.00 0.00 0.00 0.00 0.00 10:28:50 AM bond0 23.23 17.17 1.93 3.74 0.00 0.00 0.00 10:28:50 AM lo 8.08 8.08 0.82 0.82 0.00 0.00 0.00 10:28:50 AM ens33 0.00 0.00 0.00 0.00 0.00 0.00 0.00 Average: IFACE rxpck/s txpck/s rxkB/s txkB/s rxcmp/s txcmp/s rxmcst/s Average: ens37 4469.85 3898.49 347.20 557.56 0.00 0.00 0.00 Average: ens34 0.00 0.00 0.00 0.00 0.00 0.00 0.00 Average: bond0 4469.85 3898.49 347.20 557.56 0.00 0.00 0.00 Average: lo 8.04 8.04 0.81 0.81 0.00 0.00 0.00 Average: ens33 0.00 0.00 0.00 0.00 0.00 0.00 0.00 [root@mcw06 ~]#

上面是正常的,因为我的模式是1,虽然命名是bond0,但是它并不是0的模式。

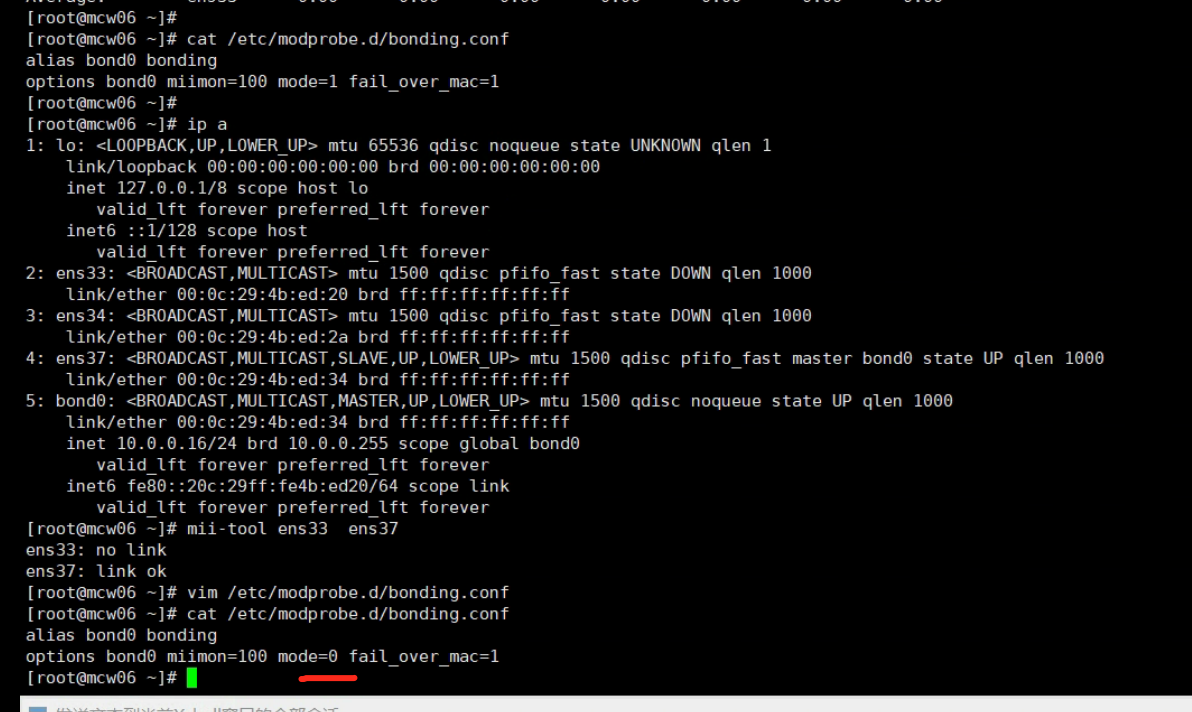

我把模式改成0再试试。

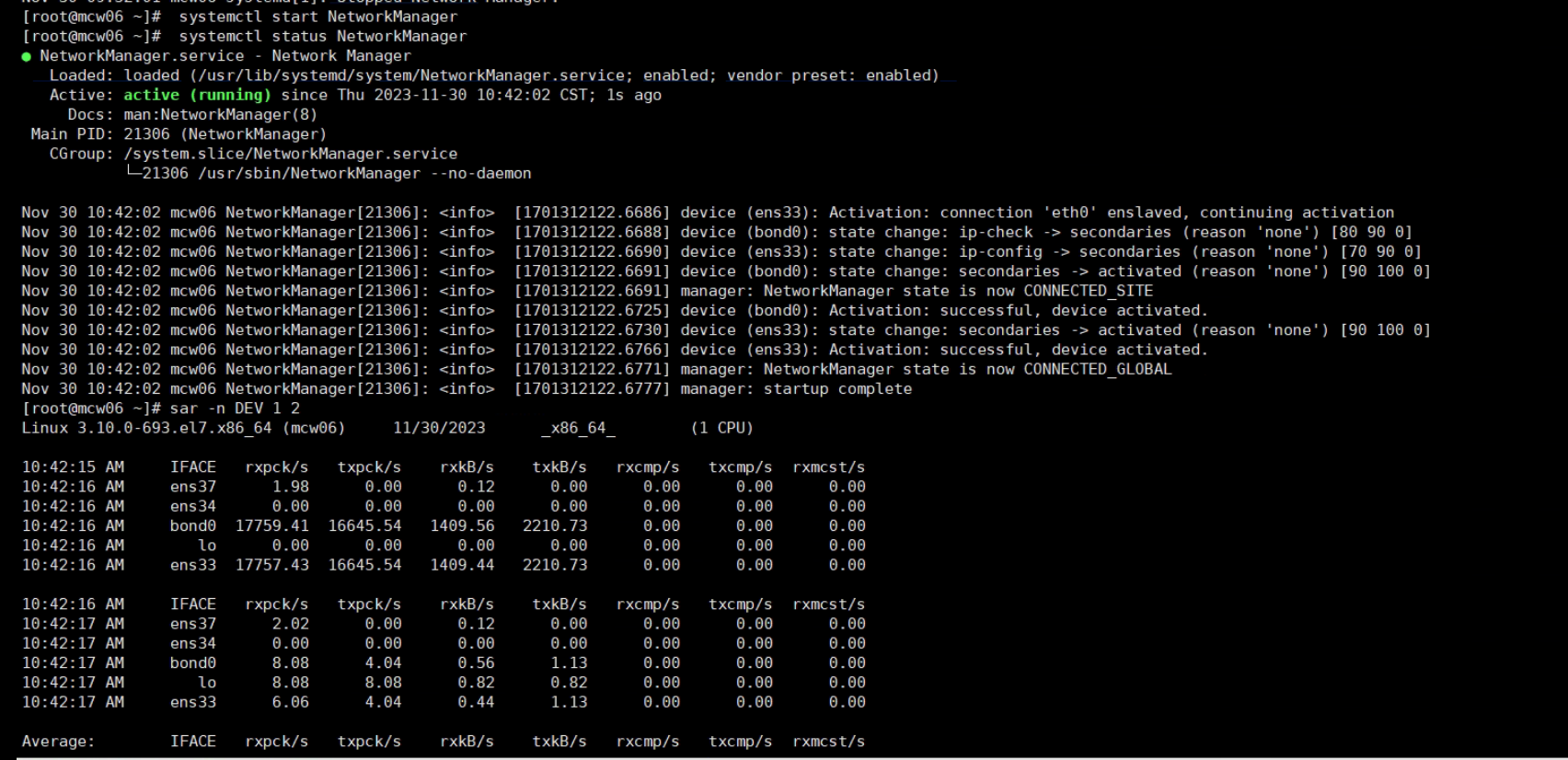

重启网络

查看,网络还是走的ens33.没有两个网卡都有,没搞明白啥情况

网络管理服务开启,好像bond网卡照样生效呢,但是好像还是有影响的。因为一次配置之后,重启network,bond0网卡没有IP,只有把网络管理服务stop之后,然后重启network,bond0的IP,才显示出来。

测试,修改模式为0,配置生效但是效果没达到预期

修改配置,修改为下面标题2的一个配置案例的 bond0网卡配置,就可以了。只保留IP,网关,dns地址是自己需要配置的,其它的直接复制那个案例的就可以了

修改前先备份

[root@mcw06 ~]# cp /etc/sysconfig/network-scripts/ifcfg-bond0 .

修改前配置

[root@mcw06 ~]# cat ifcfg-bond0 TYPE="Ethernet" PROXY_METHOD="none" BROWSER_ONLY="no" BOOTPROTO="none" DEFROUTE="yes" IPV4_FAILURE_FATAL="no" IPV6INIT="yes" IPV6_AUTOCONF="yes" IPV6_DEFROUTE="yes" IPV6_FAILURE_FATAL="no" IPV6_ADDR_GEN_MODE="stable-privacy" NAME="bond0" DEVICE="bond0" ONBOOT="yes" IPADDR="10.0.0.16" PREFIX="24" GATEWAY="10.0.0.254" DNS1="223.5.5.5" IPV6_PRIVACY="no" BONDING_MASTER=yes BONDING_OPTS="miimon=1000 mode=4" [root@mcw06 ~]#

参考下面配置

[root@mcw xiaoma]# cat /etc/sysconfig/network-scripts/ifcfg-bond0 DEVICE=bond0 ONBOOT=yes TYPE=Bond BONDING_MASTER=yes BONDING_OPTS="miimon=1000 mode=4" TYPE=Ethernet BOOTPROTO=none IPADDR=172.168.16.12 NETMASK=255.255.255.0 DNS1=172.168.16.11 DNS2=172.168.16.9 [root@mcw xiaoma]#

修改后配置

[root@mcw06 ~]# cat /etc/sysconfig/network-scripts/ifcfg-bond0 DEVICE=bond0 ONBOOT=yes TYPE=Bond BONDING_MASTER=yes BONDING_OPTS="miimon=1000 mode=4" TYPE=Ethernet BOOTPROTO=none IPADDR="10.0.0.16" PREFIX="24" GATEWAY="10.0.0.254" DNS1="223.5.5.5" [root@mcw06 ~]#

重启网络后再次查看bond0状态,跟之前看到的内容不同了,这里是动态链接,还有调度算法。

[root@mcw06 ~]# cat /proc/net/bonding/bond0 Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011) Bonding Mode: IEEE 802.3ad Dynamic link aggregation Transmit Hash Policy: layer2 (0) MII Status: up MII Polling Interval (ms): 1000 Up Delay (ms): 0 Down Delay (ms): 0 802.3ad info LACP rate: slow Min links: 0 Aggregator selection policy (ad_select): stable System priority: 65535 System MAC address: 00:0c:29:4b:ed:20 Active Aggregator Info: Aggregator ID: 5 Number of ports: 1 Actor Key: 9 Partner Key: 1 Partner Mac Address: 00:00:00:00:00:00 Slave Interface: ens33 MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 00:0c:29:4b:ed:20 Slave queue ID: 0 Aggregator ID: 5 Actor Churn State: monitoring Partner Churn State: monitoring Actor Churned Count: 0 Partner Churned Count: 0 details actor lacp pdu: system priority: 65535 system mac address: 00:0c:29:4b:ed:20 port key: 9 port priority: 255 port number: 1 port state: 205 details partner lacp pdu: system priority: 65535 system mac address: 00:00:00:00:00:00 oper key: 1 port priority: 255 port number: 1 port state: 3 Slave Interface: ens37 MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 00:0c:29:4b:ed:34 Slave queue ID: 0 Aggregator ID: 6 Actor Churn State: monitoring Partner Churn State: monitoring Actor Churned Count: 0 Partner Churned Count: 0 details actor lacp pdu: system priority: 65535 system mac address: 00:0c:29:4b:ed:20 port key: 9 port priority: 255 port number: 2 port state: 197 details partner lacp pdu: system priority: 65535 system mac address: 00:00:00:00:00:00 oper key: 1 port priority: 255 port number: 1 port state: 3 [root@mcw06 ~]#

虽然这里状态变化了,但是发现,依然没有同时使用两个网卡

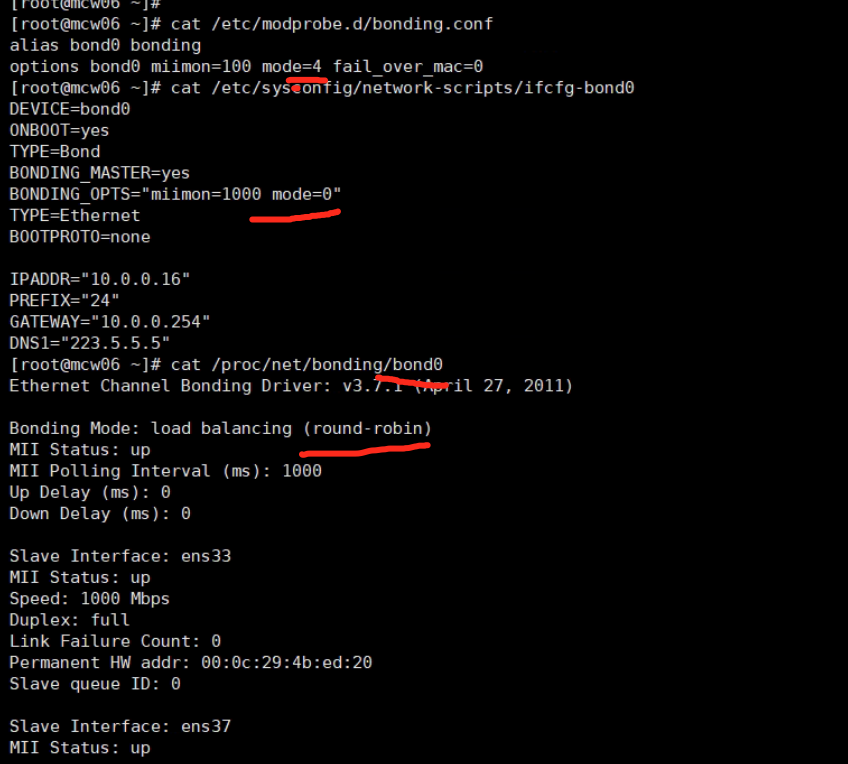

我们再改下, /etc/modprobe.d/bonding.conf里面模式是4, /etc/sysconfig/network-scripts/ifcfg-bond0这里面设置模式是0,后面这个生效了,可以看到bond0的状态已经变成了模式是0的了配置了 --》Bonding Mode: load balancing (round-robin)

压力测试

[root@mcw15 ~]# ab -c 1000 -n 50000 http://10.0.0.16/ This is ApacheBench, Version 2.3 <$Revision: 1430300 $> Copyright 1996 Adam Twiss, Zeus Technology Ltd, http://www.zeustech.net/ Licensed to The Apache Software Foundation, http://www.apache.org/ Benchmarking 10.0.0.16 (be patient) Completed 5000 requests Completed 10000 requests Completed 15000 requests apr_socket_recv: Connection timed out (110) Total of 17797 requests completed [root@mcw15 ~]#

结果还是不行,ens37没用到,单网卡在使用

[root@mcw06 ~]# sar -n DEV 1 2 Linux 3.10.0-693.el7.x86_64 (mcw06) 11/30/2023 _x86_64_ (1 CPU) 12:54:06 PM IFACE rxpck/s txpck/s rxkB/s txkB/s rxcmp/s txcmp/s rxmcst/s 12:54:07 PM ens37 1.98 12243.56 0.12 1611.05 0.00 0.00 0.00 12:54:07 PM ens34 0.00 0.00 0.00 0.00 0.00 0.00 0.00 12:54:07 PM bond0 26016.83 24485.15 2131.23 3042.11 0.00 0.00 0.00 12:54:07 PM lo 0.00 0.00 0.00 0.00 0.00 0.00 0.00 12:54:07 PM ens33 26014.85 12241.58 2131.11 1431.06 0.00 0.00 0.00 12:54:07 PM IFACE rxpck/s txpck/s rxkB/s txkB/s rxcmp/s txcmp/s rxmcst/s 12:54:08 PM ens37 2.04 3031.63 0.12 396.38 0.00 0.00 0.00 12:54:08 PM ens34 0.00 0.00 0.00 0.00 0.00 0.00 0.00 12:54:08 PM bond0 7009.18 6065.31 529.00 832.10 0.00 0.00 0.00 12:54:08 PM lo 0.00 0.00 0.00 0.00 0.00 0.00 0.00 12:54:08 PM ens33 7007.14 3033.67 528.88 435.72 0.00 0.00 0.00 Average: IFACE rxpck/s txpck/s rxkB/s txkB/s rxcmp/s txcmp/s rxmcst/s Average: ens37 2.01 7707.04 0.12 1012.87 0.00 0.00 0.00 Average: ens34 0.00 0.00 0.00 0.00 0.00 0.00 0.00 Average: bond0 16656.28 15414.07 1342.19 1953.76 0.00 0.00 0.00 Average: lo 0.00 0.00 0.00 0.00 0.00 0.00 0.00 Average: ens33 16654.27 7707.04 1342.07 940.89 0.00 0.00 0.00 [root@mcw06 ~]#

如果没有加载模块,需要加载一下

加载bond module

modprobe bonding

一个bond的参考案例

下面实现了两个网卡一起使用

[root@mcw xiaoma]# cat /etc/sysconfig/network-scripts/ifcfg-bond0 DEVICE=bond0 ONBOOT=yes TYPE=Bond BONDING_MASTER=yes BONDING_OPTS="miimon=1000 mode=4" TYPE=Ethernet BOOTPROTO=none IPADDR=172.168.16.12 NETMASK=255.255.255.0 DNS1=172.168.16.11 DNS2=172.168.16.9 [root@mcw xiaoma]# cat /etc/sysconfig/network-scripts/ifcfg-eth1 DEVICE=eth1 ONBOOT=yes SLAVE=yes MASTER=bond0 HOTPLUG=no TYPE=Ethernet BOOTPROTO=none [root@mcw xiaoma]# cat /etc/sysconfig/network-scripts/ifcfg-eth0 DEVICE=eth0 ONBOOT=yes SLAVE=yes MASTER=bond0 HOTPLUG=no TYPE=Ethernet BOOTPROTO=none [root@mcw xiaoma]# [root@mcw xiaoma]# cat /proc/net/bonding/bond0 Ethernet Channel Bonding Driver: v3.7.1 (April 27, 2011) Bonding Mode: IEEE 802.3ad Dynamic link aggregation Transmit Hash Policy: layer2 (0) MII Status: up MII Polling Interval (ms): 1000 Up Delay (ms): 0 Down Delay (ms): 0 802.3ad info LACP rate: slow Min links: 0 Aggregator selection policy (ad_select): stable System priority: 65535 System MAC address: 14:18:77:27:8b:eb Active Aggregator Info: Aggregator ID: 1 Number of ports: 2 Actor Key: 9 Partner Key: 2 Partner Mac Address: 78:2c:29:ac:59:ba Slave Interface: eth0 MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 14:18:77:27:8b:eb Slave queue ID: 0 Aggregator ID: 1 Actor Churn State: none Partner Churn State: none Actor Churned Count: 0 Partner Churned Count: 0 details actor lacp pdu: system priority: 65535 system mac address: 14:18:77:27:8b:eb port key: 9 port priority: 255 port number: 1 port state: 61 details partner lacp pdu: system priority: 32768 system mac address: 78:2c:29:ac:59:ba oper key: 2 port priority: 32768 port number: 1 port state: 61 Slave Interface: eth1 MII Status: up Speed: 1000 Mbps Duplex: full Link Failure Count: 0 Permanent HW addr: 14:18:77:27:8b:ec Slave queue ID: 0 Aggregator ID: 1 Actor Churn State: none Partner Churn State: none Actor Churned Count: 0 Partner Churned Count: 0 details actor lacp pdu: system priority: 65535 system mac address: 14:18:77:27:8b:eb port key: 9 port priority: 255 port number: 2 port state: 61 details partner lacp pdu: system priority: 32768 system mac address: 78:2c:29:ac:59:ba oper key: 2 port priority: 32768 port number: 64 port state: 61 [root@mcw xiaoma]# cat /etc/modprobe.d/bonding.conf alias bond0 bonding [root@mcw xiaoma]#

————————————————

版权声明:本文为CSDN博主「~407」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/weixin_56270746/article/details/124790749

原文链接:https://blog.csdn.net/qq_57377057/article/details/125833206

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 阿里最新开源QwQ-32B,效果媲美deepseek-r1满血版,部署成本又又又降低了!

· 开源Multi-agent AI智能体框架aevatar.ai,欢迎大家贡献代码

· Manus重磅发布:全球首款通用AI代理技术深度解析与实战指南

· 被坑几百块钱后,我竟然真的恢复了删除的微信聊天记录!

· AI技术革命,工作效率10个最佳AI工具

2021-11-29 python运维脚本