通过spark-submit提交hadoop配置的方法

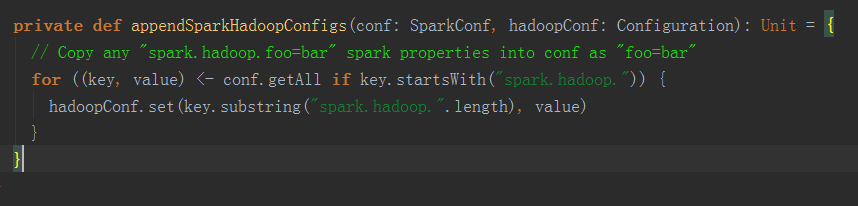

通过spark提交的spark开头的配置在程序启动后会添加到SparkConf中,但是hadoop相关的配置非spark开头会被过滤掉,但是只要在这些配置的key前面添加spark.hadoop.前缀,则该key就不会被过滤,会被放置到SparkConf中;最终会存储在Configuration 对象中,存入之前会将 spark.hadoop.前缀截掉(如:hbase的hbase.zookeeper.quorum,则这样传递:spark-submit --conf spark.hadoop.hbase.zookeeper.quorum),见下方截图代码逻辑

在spark应用中如果要是用这些key,只需要添加如下代码即可:

Configuration conf = ss.sparkContext().hadoopConfiguration();

String quorum = conf.get("hbase.zookeeper.quorum");