简历项目的梳理和面试准备

简历的目的是拿到面试机会,所以要

1、简历项目

一、投资人用户画像,给新的项目推荐投资机构,文本的处理,文本相似问题,用tfidf和浅语义模型解决,文本检索技术,可以归类为文本检索的问题

文本预处理:中文分词,然后去除停用词、删除低频词、进行word ->id转换

可选的优化:比如用TF-IDF为词汇加上局部权重,构建TF_IDF向量

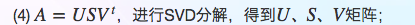

将训练文本用Dictionary转换成id表现的形式,这就得到了Term-Document矩阵A

降维,将奇异值S减少为k个(topic值),当然k是个经验数字,比如200-500,然后U选前k列,V选前k列;S选左上角k行k列对角方阵,其实V的

新的查询文本q,其查询向量为q上公式;两个向量的相似度计算常常使用consine余弦相似度

gensim库的实现:

LSI模块

Similarities模块

二、发现创投新概念,文本分类,打标签问题,文本分类有传统的 tfidf + lr 或者svm;深度学习中词嵌入+lstm,词嵌入的是通过公司内部收集关于证券的数据,

三、搜狗大数据用户画像:特征:搜索文本,label:年龄、性别、学历

三个子任务、任务查询词、

用户画像:

研究准备与数据收集 -> 亲和图 -> 人物原型框架 -> 优先级排序 -> 完善人物原型 ->

用户画像构建流程:

基础数据收集 -> 行为建模 -> 构建画像

网络行为数据 文本挖掘 基本属性

服务内行为数据 自然语言处理 购买能力

用户内容偏好数据 机器学习 行为特征

用户交易数据 预测算法 兴趣爱好

聚类算法 心理特征

社交网络

1、数据预处理

停用词:教育高:空格留下,教育低,用之的概率大,

分词处理:jieba分词

2、特征表示:

(1)Bag of words 词袋:至少5篇文档中的词汇来组成词表,统计one-gram及bi-gram特征,该特征可以有效体现出不同类别用户的用词习惯,

(2)词嵌入:使用google的word2vec工具在搜狗新闻语聊上训练得到了常用词的词向量,应用到用户的历史查询词中,该方法得到的词向量可以有效计算出两个词之间的相似度,从而表示出不同用户查询历史的差异

word2vec词向量可以较好地表达不同词之间的相似和类比关系

(3)主题词嵌入:

该任务中,每个用户具有多组查询词,其中有些查询相关性较强,有些则完全不相关,使用主题模型来抽取用户的多个查询主题,更有利于刻画用户的查询习惯,基于LDA的结果,使用topical word

embedding模型训练得到每个查询词的词向量。TWE模型与常见的word2vec不同在于,其计算出的词向量同时考虑词的上下文及该词的所在主题的信息。使用tfidf特征值对用户查询历史中的词向量进行加权平均,可以得到表示整体查询的向量值,可以将其直接作为多个分类模型的输入,完成用户层级的分类任务

(4) doc2vec特征表示:

为了将文档直接表示成一个固定长度的向量,采用Doc2vec方法,它通过直接构造文档向量,并将该向量加入到该文档中词向量的训练过程,进行共同训练,从而得到能直接体现该文档语义特征的向量

根据训练文档向量的网络结构不同,可分为DM分布式内存模型和dbow 分布式词袋 DM是更具上下文和文档id预测中心词,dbow是以文档id去预测文档中的词

(5) 人工构建的特征:

查询词的个数、查询词的平均长度、查询词的最大长度、有空格的query占总查询的比例、

3、模型结构

基于TFIDF的传统机器学习模型

第一层模型:尝试了sklearn中的LR、KNN、SVC、RF和xgboost中的gliear和gbtree。其中,由于tfidf特征过于稀疏、维度过高、树形模型表现结果很差,由于数据量太大,KNN和SVC算法都不能训练出结果

gliear线下测试要高于逻辑回归,但是线下成绩不如逻辑回归

基于分布式向量的神经网络模型

第二层融合模型(stacking):

融合的优点:

三个子任务上训练,模型输出的概率值作为下一层模型的输入,由于三个子任务分别是6分类、6分类、2分类,所以第一层特征维度是6+6+2=

4、数据后处理---错误分析

补充缺失值,含有缺失值的样本剔除

5、总结和展望

深度学习方法

四、深度学习:

LSTM在

五、反欺诈建模中的数据科学

数据获取与清洗 -> 特征获取 -> 高级特征获取 -> 建模 -> 风控决策

企业的金融数据 统计学习 GBDT 梯度提升树 消费能力评级

消费数据 数据分析 SVM 支撑向量机 用户风险评级

信用数据 社交网络分析 RF 随机森林 社交关联评级

行为数据 用户属性评级

社交数据

其他