Nginx七层负载均衡

第五章·Nginx七层负载均衡

Nginx负载均衡基本概述

为什么要使用负载均衡:

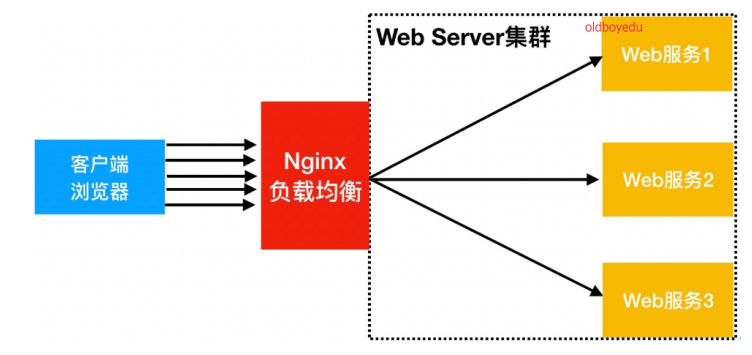

当我们的Web服务器直接面向用户,往往要承载大量并发请求,单台服务器难以负荷,我使用多台Web服务器组成集群,前端使用Nginx负载均衡,将请求分散的打到我们的后端服务器集群中,实现负载的分发。那么会大大提升系统的吞吐率、请求性能、高容灾

往往我们接触的最多的是SLB(Server Load Balance)负载均衡,实现最多的也是SLB、那么SLB它的调度节点和服务节点通常是在一个地域里面。那么它在这个小的逻辑地域里面决定了他对部分服务的实时性、响应性是非常好的。

所以说当海量用户请求过来以后,它同样是请求调度节点,调度节点将用户的请求转发给后端对应的服务节点,服务节点处理完请求后在转发给调度节点,调度节点最后响应给用户节点。这样也能实现一个均衡的作用,那么Nginx则是一个典型的SLB

负载均衡的叫法:

- 负载

- Load Balance

- LB

公有云中的叫法

- 阿里云:SLB

- 腾讯云:CLB

- 青云:QLB

- Ucloud:ULB

负载均衡产品

- 软件

- nginx

- HAproxy

- LVS

- 硬件

- F5

四层负载均衡和七层负载均衡的区别

四层负载:

所谓四层负载均衡指的是OSI七层模型中的传输层,那么传输层Nginx已经能支持TCP/IP的控制,所以只需要对客户端的请求进行TCP/IP协议的包转发就可以实现负载均衡,那么它的好处是性能非常快、只需要底层进行应用处理,而不需要进行一些复杂的逻辑

七层负载:

七层负载均衡它是在应用层,那么它可以完成很多应用方面的协议请求,比如我们说的http应用的负载均衡,它可以实现http信息的改写、头信息的改写、安全应用规则控制、URL匹配规则控制、以及转发、rewrite等等的规则,所以在应用层的服务里面,我们可以做的内容就更多,那么Nginx则是一个典型的七层负载均衡SLB

区别:

四层负载均衡数据包在底层就进行了分发,而七层负载均衡数据包则是在最顶层进行分发、由此可以看出,七层负载均衡效率没有四负载均衡高。

但七层负载均衡更贴近于服务,如:http协议就是七层协议,我们可以用Nginx可以作会话保持,URL路径规则匹配、head头改写等等,这些是四层负载均衡无法实现的。

注意:四层负载均衡不识别域名,七层负载均衡识别域名

Nginx负载均衡配置场景

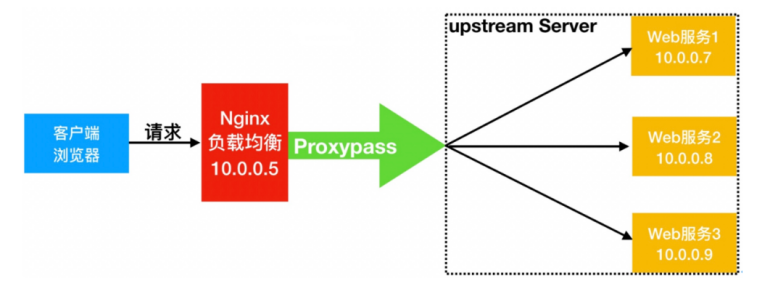

Nginx要实现负载均衡需要用到 proxy_pass 代理模块配置.

Nginx负载均衡与Nginx代理不同地方在于,Nginx的一个 location 仅能代理一台服务器,而Nginx负载均衡则是 将客户端请求代理转发至一组upstream虚拟服务池.

负载均衡配置语法

Syntax: upstream name { ... }

Default: —

Context: http

upstream name {

server xxx;

server xxx;

}

官方案例配置

Syntax: upstream name { ... }

Default: -

Context: http

#upstream模块配置

模块名 后端主机池:名字(根据网站域名来起名)

upstream backend {

server backend1.example.com weight=5;

server backend2.example.com:8080;

server unix:/tmp/backend3;

server backup1.example.com:8080 backup;

}

server {

location / {

proxy_pass http://backend;

}

}

1.环境准备

| 角色 | 外网****IP(NAT) | 内网****IP(LAN) | 主机名 | 应用 |

|---|---|---|---|---|

| 负载均衡 | eth0:10.0.0.5 | eth1:172.16.1.5 | lb01 | nginx |

| web网站 | eth0:10.0.0.7 | eth1:172.16.1.7 | web01 | nginx、php |

| web网站 | eth0:10.0.0.8 | eth1:172.16.1.8 | web02 | nginx、php |

2.web01服务器上配置nginx

[root@web01 ~]# vim /etc/nginx/conf.d/lb.lw.com.conf

server {

listen 9999;

server_name lb.lw.com;

root /code/lb;

index index.html;

}

[root@web01 conf.d]# mkdir /code/lb

[root@web01 conf.d]# echo "web01" > /code/lb/index.html

root@web01 conf.d]# nginx -t

nginx: the configuration file /etc/nginx/nginx.conf syntax is ok

nginx: configuration file /etc/nginx/nginx.conf test is successful

[root@web01 conf.d]# systemctl reload nginx

3.web02服务器上配置nginx

[root@web02 ~]# vim /etc/nginx/conf.d/lb.lw.com.conf

server {

listen 9999;

server_name lb.lw.com;

root /code/lb;

index index.html;

}

[root@web02 conf.d]# mkdir /code/lb

[root@web02 conf.d]# echo "web01" > /code/lb/index.html

root@web02 conf.d]# nginx -t

nginx: the configuration file /etc/nginx/nginx.conf syntax is ok

nginx: configuration file /etc/nginx/nginx.conf test is successful

[root@web02 conf.d]# systemctl reload nginx

4.域名解析

## 域名解析

10.0.0.7 lb.lw.com

#10.0.0.8 lb.lw.com

5.准备Nginx负载均衡调度使用的proxy_params

[root@Nginx ~]# vim /etc/nginx/proxy_params

proxy_set_header Host $http_host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_connect_timeout 30;

proxy_send_timeout 60;

proxy_read_timeout 60;

proxy_buffering on;

proxy_buffer_size 32k;

proxy_buffers 4 128k;

6.配置Nginx负载均衡

[root@lb01 ~]# vim /etc/nginx/conf.d/lb.lw.com.conf

upstream lb.lw.com {

server 172.16.1.7:9999;

server 172.16.1.8:9999;

}

server {

listen 80;

server_name lb.lw.com;

location / {

proxy_pass http://lb.lw.com;

include proxy_params;

}

}

[root@lb01 conf.d]# systemctl restart nginx

负载均衡常见典型故障

如果后台服务连接超时,Nginx是本身是有机制的,如果出现一个节点down掉的时候,Nginx会更据你具体负载均衡的设置,将请求转移到其他的节点上,但是,如果后台服务连接没有down掉,但是返回错误异常码了如:504、502、500,这个时候你需要加一个负载均衡的设置,如下:proxy_next_upstream http_500 | http_502 | http_503 | http_504 |http_404;意思是,当其中一台返回错误码404,500...等错误时,可以分配到下一台服务器程序继续处理,提高平台访问成功率

## 解决方案

### 遇到如下状态码的机器,跳过请求的下发,直接下发到其他正常的服务器

proxy_next_upstream error timeout http_500 http_502 http_503 http_504;

upstream lb.lw.com {

server 172.16.1.7:9999;

server 172.16.1.8:9999;

server 172.16.1.9:9999;

}

server {

listen 80;

server_name lb.lw.com;

location /{

proxy_pass http://lb.lw.com;

proxy_next_upstream error timeout http_500 http_502 http_503 http_504;

include proxy_params;

}

}

负载均衡调度算法

| 调度算法 | 概述 |

|---|---|

| 轮询 | 按时间顺序逐一分配到不同的后端服务器(默认) |

| weight | 加权轮询,weight值越大,分配到的访问几率越高 |

| ip_hash | 每个请求按访问IP的hash结果分配,这样来自同一IP的固定访问一个后端服务器 |

| url_hash | 按照访问URL的hash结果来分配请求,是每个URL定向到同一个后端服务器 |

| least_conn | 最少链接数,那个机器链接数少就分发 |

Nginx负载均衡[rr]轮询具体配置

upstream load_pass {

server 10.0.0.7:80;

server 10.0.0.8:80;

}

Nginx负载均衡[wrr]权重轮询具体配置

upstream load_pass {

server 10.0.0.7:80 weight=5;

server 10.0.0.8:80;

}

Nginx负载均衡ip_hash

具体配置不能和weight一起使用。

#如果客户端都走相同代理, 会导致某一台服务器连接过多

upstream load_pass {

ip_hash;

server 10.0.0.7:80 weight=5;

server 10.0.0.8:80;

}

Nginx负载均衡后端状态

| 状态 | 概述 |

|---|---|

| down | 当前的server暂时不参与负载均衡 |

| backup | 预留的备份服务器 |

| max_fails | 允许请求失败的次数 |

| fail_timeout | 经过max_fails失败后, 服务暂停时间 |

| max_conns | 限制最大的接收连接数 |

1.down 状态:只是负载均衡不对该标识的服务器下发请求,后端的服务器并没有真正宕机

upstream lb.lw.com {

server 172.16.1.7:9999;

server 172.16.1.8:9999 down;

server 172.16.1.9:9999;

}

server {

listen 80;

server_name lb.lw.com;

location /{

proxy_pass http://lb.lw.com;

include proxy_params;

}

}

2.backup 状态:备份,当前其它没有backup标识机器都宕机时,才会给该服务器发请求

upstream lb.lw.com {

server 172.16.1.7:9999;

server 172.16.1.8:9999 backup;

server 172.16.1.9:9999;

}

server {

listen 80;

server_name lb.lw.com;

location /{

proxy_pass http://lb.lw.com;

include proxy_params;

}

}

max_fails:负载均衡访问后端,最大错误次数,到该指定次数后,不给该服务器发送请求

fail_timeout:配合max_fails使用,规定不发请求的时间段

upstream lb.lw.com {

server 172.16.1.7:9999 max_fails=3 fail_timeout=10s;

server 172.16.1.8:9999 max_fails=3 fail_timeout=10s;

server 172.16.1.9:9999 max_fails=3 fail_timeout=10s;

}

server {

listen 80;

server_name lb.lw.com;

location /{

proxy_pass http://lb.lw.com;

include proxy_params;

}

}

4.max_conn:限制该后端web服务器最大连接数为1024个

upstream lb.lw.com {

server 172.16.1.7:9999 max_fails=3 fail_timeout=10s;

server 172.16.1.8:9999 max_fails=3 fail_timeout=10s;

server 172.16.1.9:9999 max_fails=3 fail_timeout=10s max_conn=1024;

}

server {

listen 80;

server_name lb.lw.com;

location /{

proxy_pass http://lb.lw.com;

include proxy_params;

}

}

Nginx负载均衡健康检查

在Nginx官方模块提供的模块中,没有对负载均衡后端节点的健康检查模块,但可以使用第三方模块。

nginx_upstream_check_module来检测后端服务的健康状态。

第三方模块项目地址:TP

1.安装依赖包

[root@lb01 ~]# yum install -y gcc glibc gcc-c++ pcre-devel openssl-devel patch

2.停掉yum安装的nginx

[root@lb01 ~]# systemctl stop nginx

3.下载nginx源码包以及nginx健康第三方模块

[root@lb01 ~]# wget https://nginx.org/download/nginx-1.22.0.tar.gz

[root@lb01 ~]# wget

https://github.com/yaoweibin/nginx_upstream_check_module/archive/master.zip

4.解压nginx源码包和第三方模块包

[root@lb01 ~]# tar xf nginx-1.22.0.tar.gz

[root@lb01 ~]# unzip master.zip

#创建应用目录

[root@lb01 ~]# mkdir /app

5.进入nginx目录,打补丁(nginx的版本是1.20.1补丁就选择1.20.1的,p1代表在nginx目录,p0是不在nginx目录)

[root@lb01 ~]# cd nginx-1.22.0/

[root@lb01 nginx-1.22.0]# patch -p1 </root/nginx_upstream_check_module-master/check_1.20.1+.patch

6.生成、编译与安装

# 生成

./configure --prefix=/app/nginx-1.22.0 --with-compat --

with-file-aio --with-threads --with-http_addition_module --with-http_auth_request_module --with-http_dav_module --with-http_flv_module --with-http_gunzip_module --with-http_gzip_static_module --with-http_mp4_module --with-http_random_index_module --with-http_realip_module --with-http_secure_link_module --

with-http_slice_module --with-http_ssl_module --with-http_stub_status_module --with-http_sub_module --with-http_v2_module --with-mail --with-mail_ssl_module --with-stream --with-stream_realip_module --with-stream_ssl_module --with-stream_ssl_preread_module --with-cc-opt='-O2 -g -pipe -Wall -Wp,-D_FORTIFY_SOURCE=2 -

fexceptions -fstack-protector-strong --param=ssp-buffer-size=4 -grecord-gcc-switches

-m64 -mtune=generic -fPIC' --with-ld-opt='-Wl,-z,relro -Wl,-z,now -pie' --add-module=/root/nginx_upstream_check_module-master

## 编译 && 安装

[root@lb01 nginx-1.22.0]# make && make install

7.nginx主配置文件,添加conf.d

[root@lb01 conf]# cat nginx.conf

#user nobody;

worker_processes 1;

#error_log logs/error.log;

#error_log logs/error.log notice;

#error_log logs/error.log info;

#pid logs/nginx.pid;

events {

worker_connections 1024;

}

http {

include mime.types;

default_type application/octet-stream;

#log_format main '$remote_addr - $remote_user [$time_local] "$request" '

# '$status $body_bytes_sent "$http_referer" '

# '"$http_user_agent" "$http_x_forwarded_for"';

#access_log logs/access.log main;

sendfile on;

#tcp_nopush on;

#keepalive_timeout 0;

keepalive_timeout 65;

#gzip on;

include /app/nginx-1.22.0/conf/conf.d/*.conf;

}

8.创建虚拟主机配置文件存放目录

[root@lb01 conf]# mkdir /app/nginx-1.22.0/conf/conf.d

9.编写负载均衡配置文件,添加location

[root@lb01 conf.d]# /app/nginx-1.22.0/conf/conf.d/lb.lw.com.conf

upstream lb.lw.com {

server 172.16.1.7:9999 max_fails=2 fail_timeout=10s;

server 172.16.1.8:9999 max_fails=2 fail_timeout=10s;

server 172.16.1.9:9999 max_fails=2 fail_timeout=10s max_conns=1024;

check interval=3000 rise=2 fall=3 timeout=1000 type=tcp;

#interval 检测间隔时间,单位为毫秒

#rise 表示请求2次正常,标记此后端的状态为up

#fall 表示请求3次失败,标记此后端的状态为down

#type 类型为tcp

#timeout 超时时间,单位为毫秒

}

server {

listen 80;

server_name lb.lw.com;

location / {

proxy_pass http://lb.lw.com;

include proxy_params;

}

location /upstream_check {

check_status;

}

}

10.语法检测、启动nginx

# 10.语法检测

[root@lb01 conf]# /app/nginx-1.22.0/sbin/nginx -t

# 11.启动nginx

[root@lb01 conf]# /app/nginx-1.22.0/sbin/nginx

Nginx负载均衡会话保持

在使用负载均衡的时候会遇到会话保持的问题,可通过如下方式进行解决。

- 使用nginx的ip_hash,根据客户端的IP,将请求分配到对应的IP上

- 基于服务端的session会话共享(NFS,MySQL,memcache,redis,file)

在解决负载均衡会话问题,我们需要了解session和cookie的区别。

- 前端开发人员将用户登录的信息,保存到浏览器中(开发者工具->Application->Cookies) 如果仅将用户的登录信息记录在Cookie中,随时可以在浏览器中篡改

- 后端开发人员,将用户登录信息记录在 服务器上(共享存储,某一个文件夹下的某个文件、数据库中、缓 存数据库中....)session是对cookie做的加密,保存在服务器上

服务端会查询用户的cookie作为key去存储里找对应的value(session),也就是说cookie对应的session也是唯一的.

环境准备

| 主机名 | WanIP | LanIP | 角色 | 应用 |

|---|---|---|---|---|

| lb01 | 10.0.0.5 | 172.16.1.5 | 负载均衡 | nginx |

| web01 | 10.0.0. | 172.16.1. | phpmyadmin网站 | nginx、php |

| web02 | 10.0.0. | 172.16.1. | phpmyadmin网站 | nginx、php |

| db01 | 10.0.0. | 172.16.1. | 数据库 | MariaDB |

1.配置Nginx

[root@web01 conf.d]# cat php.conf

server {

listen 80;

server_name php.lw.com;

root /code/phpMyAdmin-4.8.4-all-languages;

location / {

index index.php index.html;

}

location ~ \.php$ {

fastcgi_pass 127.0.0.1:9000;

fastcgi_param SCRIPT_FILENAME $document_root$fastcgi_script_name;

include fastcgi_params;

}

}

[root@web01 conf.d]# systemctl restart nginx

2.安装phpmyadmin (web01和web02上都装)

[root@web01 conf.d]# cd /code

[root@web01 code]# wget https://files.phpmyadmin.net/phpMyAdmin/4.8.4/phpMyAdmin-4.8.4-all-languages.zip

[root@web01 code]# unzip phpMyAdmin-4.8.4-all-languages.zip

3.修改代码连接数据库的配置文件

将站点目录的案例配置文件改名

[root@web01 phpmyadmin]# cp config.sample.inc.php config.inc.php

[root@web01 phpmyadmin]# vim config.inc.php

将第31行的localhost改成自己数据库的ip地址

$cfg['Servers'][$i]['host'] = '172.16.1.51';

4.配置授权

[root@web01 conf.d]# chown -R www.www /var/lib/php/

5.将web01上配置好的phpmyadmin以及nginx的配置文件推送到web02主机上

[root@web01 code]# scp -rp phpMyAdmin-4.8.4-all-languages root@172.16.1.8:/code/

[root@web01 code]# scp /etc/nginx/conf.d/php.conf root@172.16.1.8:/etc/nginx/conf.d/

6.在web02上重载Nginx服务

[root@web02 code]# systemctl restart nginx

7.授权

[root@web02 code]# systemctl restart nginx

8.接入负载均衡

[root@lb01 conf.d]# vim proxy_php.com.conf

upstream php.lw.com {

server 172.16.1.7:80;

server 172.16.1.8:80;

}

server {

listen 80;

server_name php.lw.com;

location / {

proxy_pass http://php.lw.com;

include proxy_params;

}

}

[root@lb01 conf.d]# nginx -t

nginx: the configuration file /etc/nginx/nginx.conf syntax is ok

nginx: configuration file /etc/nginx/nginx.conf test is successful

[root@lb01 conf.d]# systemctl restart nginx

#将域名解析到负载均衡上

10.0.0.5 php.lw.com

使用负载均衡的轮询功能之后,会发现,如果将session保存在本地文件的话,永远都登录不上去。

部署redis解决

1.安装redis内存数据库

# 注意:redis端口:6379

[root@db01 ~]# yum install redis -y

2.配置redis监听在172.16.1.0网段上

# 2.修改redis配置文件

[root@db01 ~]# vim /etc/redis.conf

将第61行的bind后面IP地址改为 0.0.0.0

bind 0.0.0.0

3.启动redis

[root@db01 ~]# systemctl start redis

[root@db01 ~]# systemctl enable redis

4.php配置session连接redis

[root@web01 phpmyadmin]# vim /etc/php.ini

1231 session.save_handler = files

将以上内容改为以下内容

session.save_handler = redis

在第1265行添加如下内容

session.save_path = "tcp://172.16.1.51:6379"

1295 session.auto_start = 0

将以上内容改为以下内容

session.auto_start = 1

5.修改php启动程序配置文件

[root@web01 phpmyadmin]# vim /etc/php-fpm.d/www.conf

源配置

398 php_value[session.save_handler] = files

399 php_value[session.save_path] = /var/lib/php/session

#注释php-fpm.d/www.conf里面的两条内容,否则session内容会一直写入/var/lib/php/session目录中

;php_value[session.save_handler] = files

;php_value[session.save_path] = /var/lib/php/session

6.重启php-fpm

[root@web01 code]# systemctl restart php-fpm

7.将web01上配置好的文件推送到web02

[root@web01 code]# scp /etc/php.ini root@172.16.1.8:/etc/php.ini

[root@web01 code]# scp /etc/php-fpm.d/www.conf root@172.16.1.8:/etc/php-fpm.d/www.conf

8.web02上重启php-fpm

[root@web02 code]# systemctl restart php-fpm

浙公网安备 33010602011771号

浙公网安备 33010602011771号