深度学习: 学习率 (learning rate)

Introduction

学习率 (learning rate),控制 模型的 学习进度 :

lr 即 stride (步长) ,即反向传播算法中的 ηη :

ωn←ωn−η∂L∂ωnωn←ωn−η∂L∂ωn

学习率大小

| 学习率 大 | 学习率 小 | |

|---|---|---|

| 学习速度 | 快 | 慢 |

| 使用时间点 | 刚开始训练时 | 一定轮数过后 |

| 副作用 | 1.易损失值爆炸;2.易振荡。 | 1.易过拟合;2.收敛速度慢。 |

学习率设置

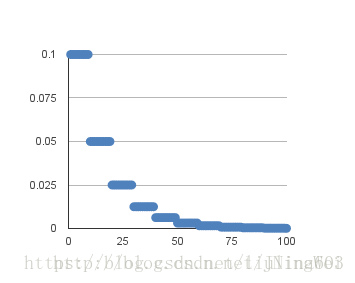

在训练过程中,一般根据训练轮数设置动态变化的学习率。

- 刚开始训练时:学习率以 0.01 ~ 0.001 为宜。

- 一定轮数过后:逐渐减缓。

- 接近训练结束:学习速率的衰减应该在100倍以上。

Note:

如果是 迁移学习 ,由于模型已在原始数据上收敛,此时应设置较小学习率 (≤10−4≤10−4) 在新数据上进行 微调 。

把脉 目标函数损失值 曲线

理想情况下 曲线 应该是 滑梯式下降 [绿线]:

1. 曲线 初始时 上扬 [红线]: Solution:初始 学习率过大 导致 振荡,应减小学习率,并 从头 开始训练 。

2. 曲线 初始时 强势下降 没多久 归于水平 [紫线]: Solution:后期 学习率过大 导致 无法拟合,应减小学习率,并 重新训练 后几轮 。

3. 曲线 全程缓慢 [黄线]: Solution:初始 学习率过小 导致 收敛慢,应增大学习率,并从头 开始训练。

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· AI与.NET技术实操系列:向量存储与相似性搜索在 .NET 中的实现

· 基于Microsoft.Extensions.AI核心库实现RAG应用

· Linux系列:如何用heaptrack跟踪.NET程序的非托管内存泄露

· 开发者必知的日志记录最佳实践

· SQL Server 2025 AI相关能力初探

· winform 绘制太阳,地球,月球 运作规律

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· AI与.NET技术实操系列(五):向量存储与相似性搜索在 .NET 中的实现

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理

· 超详细:普通电脑也行Windows部署deepseek R1训练数据并当服务器共享给他人

2017-07-30 ODB Examples

2017-07-30 linux 下 一步一步安装odb

2017-07-30 fedora18 You might need to install dependency packages for libxcb.