本文转自知乎

作者:苏格兰折耳喵

—————————————————————————————————————————————————————

本文作者将结合自身经验,并以实际案例的形式进行呈现,涉及从数据采集、数据清洗、数据分析再到数据可视化的一整套流程分析,力求条理清晰的展现外部数据分析的强大威力。enjoy~

在八月份,笔者曾经写过一篇针对外部数据分析的文章,一部分读者看过此文后,向笔者反映,说对外部数据的分析跳出了原有的只针对企业内部数据分析(用户数据、销售数据、流量数据等)的窠臼,在企业自身数据资源不足或质量不佳的情况下,往往能给产品、运营、营销带来意想不到的启迪,为数据化驱动业务增长打开了一扇窗……

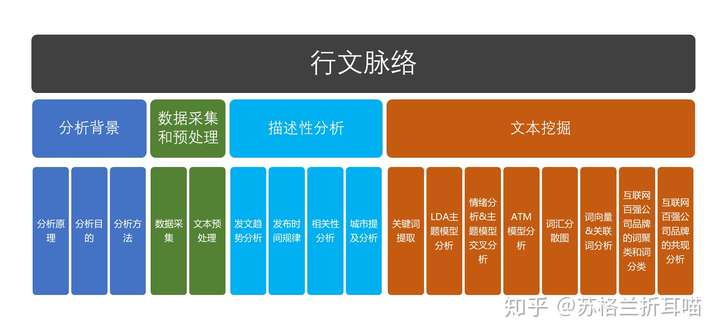

由于笔者所在的新浪微舆情是一家社会化大数据领域的语义分析公司,近期从数据分析岗转到数据产品岗后,不可避免的涉及到许多大数据语义分析的实际应用场景。由此,笔者将工作中的若干心得,以实际案例的形式进行呈现,涉及从数据采集、数据清洗、数据分析再到数据可视化的一整套流程分析,力求条理清晰的展现外部数据分析的强大威力。以下是本文的写作框架:

1. 分析背景

1.1 分析原理:为什么选择分析虎嗅网

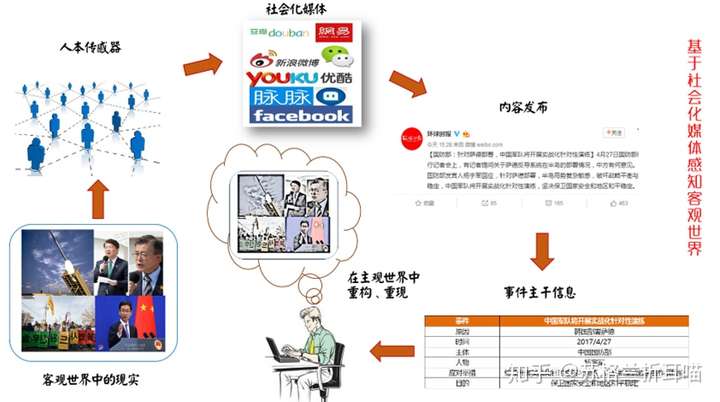

在现今数据爆炸、信息质量良莠不齐的互联网时代,我们无时无刻不身处在互联网社会化媒体的“信息洪流”之中,因而无可避免的被它上面泛滥的信息所“裹挟”,也就是说,社会化媒体上的信息对现实世界中的每个人都有重大影响,社会化媒体是我们间接了解现实客观世界和主观世界的一面窗户,我们每时每刻都在受到它的影响。关于“社会化媒体”方面的内容,请参看《干货|如何利用Social Listening从社会化媒体中“提炼”有价值的信息?》,以下内容也摘自该文:

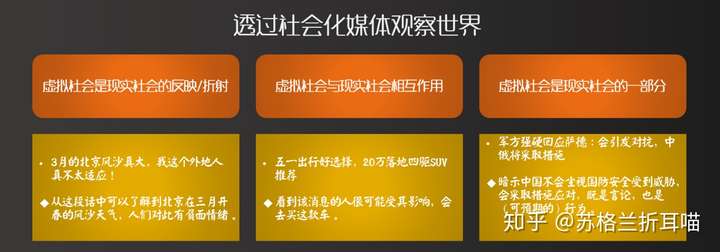

综合上述两类情形,可以得出这样的结论,透过社会化媒体,我们可以观察现实世界:

由此,社会化媒体是现实主客观世界的一面镜子,而它也会进一步影响人们的行为,如果我们对该领域中的优质媒体所发布的信息进行分析,除了可以了解该领域的发展进程和现状,还可以对该领域的人群行为进行一定程度的预判。

鉴于此种情况,作为互联网从业者的笔者想分析一下互联网行业的一些现状,第一步是找到在互联网界有着重要影响力媒体,上次分析的是“人人的是产品经理”(请参看《 干货|作为一个合格的“增长黑客”,你还得重视外部数据的分析!》),这次笔者想到的是虎嗅网。

虎嗅网创办于2012年5月,是一个聚合优质创新信息与人群的新媒体平台。该平台专注于贡献原创、深度、犀利优质的商业资讯,围绕创新创业的观点进行剖析与交流。虎嗅网的核心,是关注互联网及传统产业的融合、一系列明星公司(包括公众公司与创业型企业)的起落轨迹、产业潮汐的动力与趋势。

因此,对该平台上的发布内容进行分析,对于研究互联网的发展进程和现状有一定的实际价值。

1.2 本文的分析目的

笔者在本项目中的分析目的主要有4个:

(1)对虎嗅网内容运营方面的若干分析,主要是对发文量、收藏量、评论量等方面的描述性分析;

(2)通过文本分析,对互联网行业的一些人、企业和细分领域进行趣味性的分析;

(3)展现文本挖掘在数据分析领域的实用价值;

(4)将杂芜无序的结构化数据和非结构化数据进行可视化,展现数据之美。

1.3 分析方法:分析工具和分析类型

本文中,笔者使用的数据分析工具如下:

- Python3.5.2(编程语言)

- Gensim(词向量、主题模型)

- Scikit-Learn(聚类和分类)

- Keras(深度学习框架)

- Tensorflow(深度学习框架)

- Jieba(分词和关键词提取)

- Excel(可视化)

- Seaborn(可视化)

- Bokeh(可视化)

- Gephi(网络可视化)

- Plotly(可视化)

使用上述数据分析工具,笔者将进行2类数据分析:第一类是较为传统的、针对数值型数据的描述下统计分析,如阅读量、收藏量等在时间维度上的分布;另一类是本文的重头戏---深层次的文本挖掘,包括关键词提取、文章内容LDA主题模型分析、词向量/关联词分析、ATM模型、词汇分散图和词聚类分析。

2. 数据采集和文本预处理

2.1 数据采集

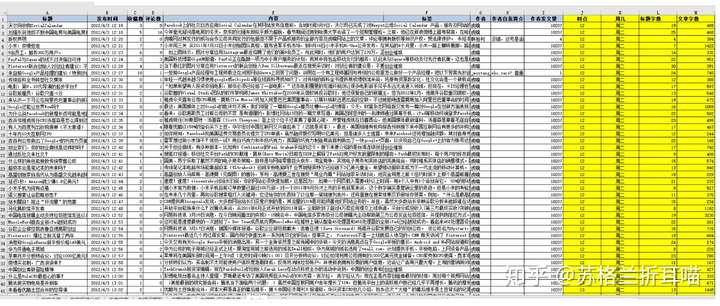

笔者使用爬虫采集了来自虎嗅网主页的文章(并不是全部的文章,但展示在主页的信息是主编精挑细选的,很具代表性),数据采集的时间区间为2012.05~2017.11,共计41,121篇。采集的字段为文章标题、发布时间、收藏量、评论量、正文内容、作者名称、作者自我简介、作者发文量,然后笔者人工提取4个特征,主要是时间特征(时点和周几)和内容长度特征(标题字数和文章字数),最终得到的数据如下图所示:

2.2 数据预处理

数据分析/挖掘领域有一条金科玉律:“Garbage in, Garbage out”,做好数据预处理,对于取得理想的分析结果来说是至关重要的。本文的数据规整主要是对文本数据进行清洗,处理的条目如下:

(1)文本分词

要进行文本挖掘,分词是最为关键的一步,它直接影响后续的分析结果。笔者使用jieba来对文本进行分词处理,它有3类分词模式,即全模式、精确模式、搜索引擎模式:

- 精确模式:试图将句子最精确地切开,适合文本分析;

- 全模式:把句子中所有的可以成词的词语都扫描出来, 速度非常快,但是不能解决歧义;

- 搜索引擎模式:在精确模式的基础上,对长词再次切分,提高召回率,适合用于搜索引擎分词。

现以“定位理论认为营销的终极战场在于消费者心智”为例,3种分词模式的结果如下:

- 【全模式】: 定位/理论/定位理论/认为/营销/的/终极/战场/终极战场/在/于/在于/消费者/心智/消费者心智

- 【精确模式】: 定位理论/认为/营销/的/终极战场/在于/消费者心智

- 【搜索引擎模式】:定位,理论,定位理论,认为,营销,的,终极,战场,终极战场,在于,消费者心智,消费者,心智

为了避免歧义和切出符合预期效果的词汇,笔者采取的是精确(分词)模式。

(2) 去停用词

这里的去停用词包括以下三类:

- 标点符号:, 。! /、*+-

- 特殊符号:❤❥웃유♋☮✌☏☢☠✔☑♚▲♪等

- 无意义的虚词:“the”、“a”、“an”、“that”、“你”、“我”、“他们”、“想要”、“打开”、“可以”等

(3) 去掉高频词、稀有词和计算Bigrams

去掉高频词、稀有词是针对后续的主题模型(LDA、ATM)时使用的,主要是为了排除对区隔主题意义不大的词汇,最终得到类似于停用词的效果。

Bigrams是为了自动探测出文本中的新词,基于词汇之间的共现关系---如果两个词经常一起毗邻出现,那么这两个词可以结合成一个新词,比如“数据”、“产品经理”经常一起出现在不同的段落里,那么,“数据_产品经理”则是二者合成出来的新词,只不过二者之间包含着下划线。

3. 描述性分析

该部分中,笔者主要对数值型数据进行描述性的统计分析,它属于较为常规的数据分析,能揭示出一些问题,做到知其然,关于数据分析的4种类型,详情请参看《干货|作为一个合格的“增长黑客”,你还得重视外部数据的分析!》的第一部分。

3.1 发文数量、评论量和收藏量的变化走势

从下图可以看出,在2012.05~2017.11期间,以季度为单位,主页的发文数量起伏波动不大,在均值1800上下波动,进入2016年后,发文数量有明显提升。

此外,一头(2012年第二季)一尾(2017年第四季)因为没有统计完全,所以发文数量较小。

下图则是该时间段内收藏量和评论量的变化情况,评论量的变化不愠不火,起伏不大,但收藏量一直在攀升中,尤其是在2017年的第二季达到峰值。收藏量在一定程度上反映了文章的干货程度和价值性,读者认为有价值的文章才会去保留和收藏,反复阅读,含英咀华,这说明虎嗅的文章质量在不断提高,或读者的数量在增长。

3.2 发文时间规律分析

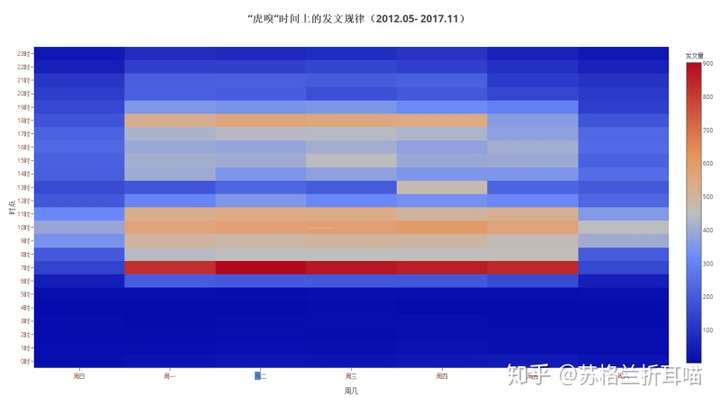

笔者从时间维度里提取出“周”和“时段”的信息,也就是开题提到的“人工特征”的提取,现在做文章分布数量的在“周”和“时”上的交叉分析,得到下图:

上图是一个热力图,色块颜色上的由暖到冷表征数值的由大变小。很明显的可以看到,中间有一个颜色很明显的区域,即由“6时~19时”和“周一~周五”围成的矩形,也就是说,发文时间主要集中在工作日的白天。另外,周一到周五期间,6时~7时这个时间段是发文的高峰,说明虎嗅的内容运营人员倾向于在工作日的清晨发布文章,这也符合它的人群定位---TMT领域从业、创业者、投资人,他们中的许多人有晨读的习惯,喜欢在赶地铁、坐公交的过程中阅读虎嗅讯息。发文高峰还有9时-11时这个高峰,是为了提前应对读者午休时间的阅读,还有17时~18时,提前应对读者下班时间的阅读。

3.3 相关性分析

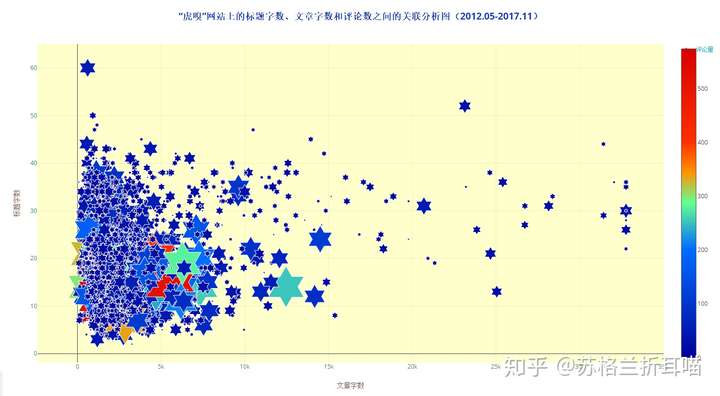

笔者一直很好奇,文章的评论量、收藏量和标题字数、文章字数是否存在统计学意义上的相关性关系。基于此,笔者绘制出能反映上述变量关系的两张图。

首先,笔者做出了标题字数、文章字数和评论量之间的气泡图(圆形的气泡被六角星替代,但本质上还是气泡图)。

上图中,横轴是文章字数,纵轴是标题字数,评论数大小由六角星的大小和颜色所反映,颜色越暖,数值越大,五角星越大,数值越大。从这张图可以看出,文章评论量较大的文章,绝大部分分布于由文章字数6000字、标题字数20字所构成的区域内。虎嗅网上的商业资讯文章大都具有原创、深度的特点,文章篇幅中长,意味着能把事情背后的来龙去脉论述清楚,而且标题要能够吸引人,引发读者的大量阅读,合适长度标题和正文篇幅才能做到这一点。

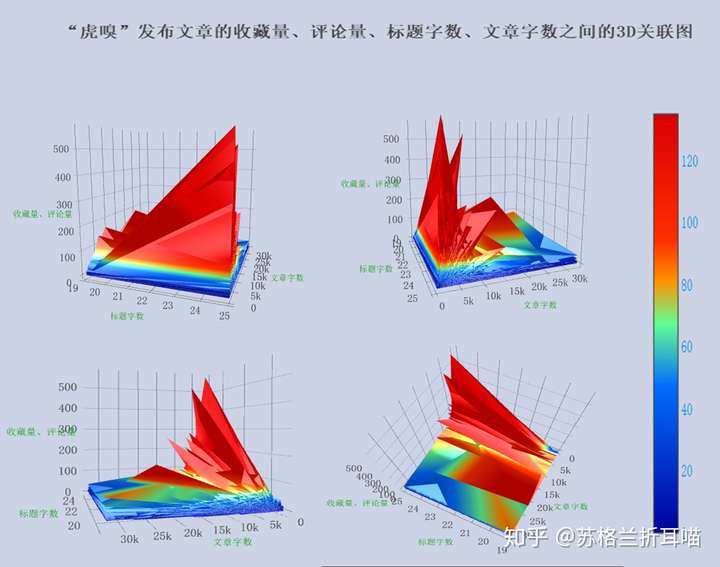

接下来,笔者将收藏量、评论量和标题字数、文章字数绘制成一张3D立体图,X轴和Y轴分别为标题字数和正文字数,Z轴为收藏量和评论量所构成的平面,通过旋转这个3维的Surface图,我们可以发现收藏量、评论量和标题字数、文章字数之间的相关关系。

注意,上图的数值表示和前面几张图一样,颜色上的由暖到冷表示数值的由大到小,通过旋转各维度的截面,可以看到在正文字数5000字以内、标题字数15字左右的收藏量和评论量形成的截面出现“华山式”陡峰,因而这里的收藏量和评论量最大。

3.4 城市提及分析

在这里,笔者通过构建一个包含全国1~5线城市的词表,提取出经过预处理后的文本中的城市名称,根据提及频次的大小,绘制出一张反映城市提及频次的地理分布地图,进而间接地了解各个城市互联网的发展状况(一般城市的提及跟互联网产业、产品和职位信息挂钩,能在一定程度上反映该城市互联网行业的发展态势)。

上图反映的结果比较符合常识,北上深广杭这些一线城市的提及次数最多,它们是互联网行业发展的重镇。值得注意的是,长三角地区的大块区域(长江三角洲城市群,它包含上海,江苏省的南京、无锡、常州、苏州、南通、盐城、扬州、镇江、泰州,浙江省的杭州、宁波、嘉兴、湖州、绍兴、金华、舟山、台州,安徽省的合肥、芜湖、马鞍山、铜陵、安庆、滁州、池州、宣城)呈现出较高的热度值,直接说明这些城市在虎嗅网各类资讯文章中的提及次数较多,结合国家政策和地区因素,可以这样理解地图中反映的这个事实:

长三角城市群是“一带一路”与长江经济带的重要交汇地带,在中国国家现代化建设大局和全方位开放格局中具有举足轻重的战略地位。中国参与国际竞争的重要平台、经济社会发展的重要引擎,是长江经济带的引领发展区,是中国城镇化基础最好的地区之一。

接下来,笔者将抽取文本中城市之间的共现关系,也就是城市之间两两同时出现的频率,在一定程度上反映出城市间经济、文化、政策等方面的相关关系,共现频次越高,说明二者之间的联系紧密程度越高,抽取出的结果如下表所示:

将上述结果绘制成如下动态的流向图:

由于虎嗅网上的文章大多涉及创业、政策、商业方面的内容,因而这种城市之间的共现关系反映出城际间在资源、人员或者行业方面的关联关系,本动态图中,主要反映的是北上广深杭(网络中的枢纽节点)之间的相互流动关系和这几个一线城市向中西部城市的单向流动情形。流动量大、交错密集的区域无疑是中国最发达的3个城市群和其他几个新兴的城市群:

- 京津冀城市群

- 长江三角洲城市群

- 珠江三角洲城市群

- 中原城市群

- 成渝城市群

- 长江中游城市群

上面的数据分析是基于数值型数据的描述性分析,接下来,笔者将进行更为深入的文本挖掘。

4. 文本挖掘

数据挖掘是从有结构的数据库中鉴别出有效的、新颖的、可能有用的并最终可理解的模式;而文本挖掘(在文本数据库也称为文本数据挖掘或者知识发现)是从大量非结构的数据中提炼出模式,也就是有用的信息或知识的半自动化过程。关于文本挖掘方面的相关知识,请参看《数据运营|数据分析中,文本分析远比数值型分析重要!(上)》、《在运营中,为什么文本分析远比数值型分析重要?一个实际案例,五点分析(下)》。

本文的文本挖掘部分主要涉及高频词统计/关键词提取/关键词云、文章标题聚类、文章内容聚类、文章内容LDA主题模型分析、词向量/关联词分析、ATM模型、词汇分散图和词聚类分析。

4.1 关键词提取

对于关键词提取,笔者没有采取词频统计的方法,因为词频统计的逻辑是:一个词在文章中出现的次数越多,则它就越重要。因而,笔者采用的是TF-IDF(termfrequency–inverse document frequency)的关键词提取方法:

它用以评估一字/词对于一个文件集或一个语料库中的其中一份文件的重要程度,字/词的重要性会随着它在文件中出现的次数成正比增加,但同时会随着它在语料库中出现的频率成反比下降。

由此可见,在提取某段文本的关键信息时,关键词提取较词频统计更为可取,能提取出对某段文本具有重要意义的关键词。

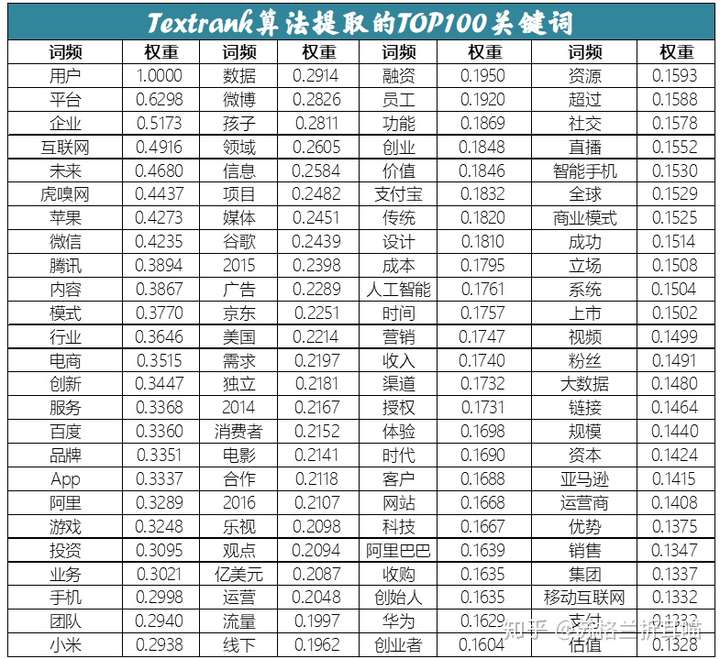

下面是笔者利用jieba在经预处理后的、近400MB的语料中抽取出的TOP100关键词。

从宏观角度来看,从上面可以明显的识别出3类关键词:

- 公司品牌类:虎嗅网、苹果、腾讯、苹果、小米等;

- 行业领域类:行业、电商、游戏、投资、广告、人工智能、智能手机等;

- 创业、商业模式类:模式、创新、业务、运营、流量、员工等。

从微观角度来看,居于首要位置的是“用户”,互联网从业者放在嘴边的是“用户为王”、“用户至上”和“以用户为中心”,然后是“平台”和“企业”。

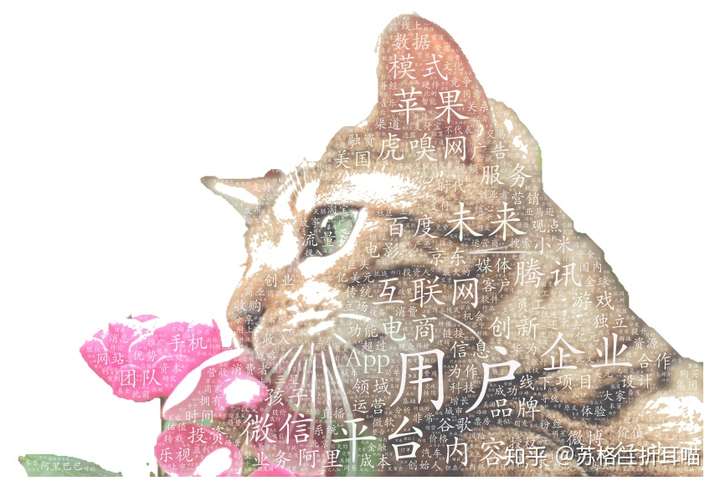

笔者选取TOP500关键词来绘制关键词云。因为虎嗅的名字来源于英国当代诗人Siegfried Sassoon的著名诗句“In me the tigersniffs the rose(心有猛虎,细嗅蔷薇),所以词云以“虎嗅蔷薇”为背景,找不到合适的虎嗅蔷薇的画面,于是用它的近亲猫作为替代,词云如下:

4.2 LDA主题模型分析

刚才针对关键词的分类较为粗略,且人为划分,难免有失偏颇,达不到全面的效果。因此,笔者采用LDA主题模型来发现该语料中的潜在主题。关于LDA主题模型的相关原理,请参看《【干货】用大数据文本挖掘,来洞察“共享单车”的行业现状及走势》的第4部分。

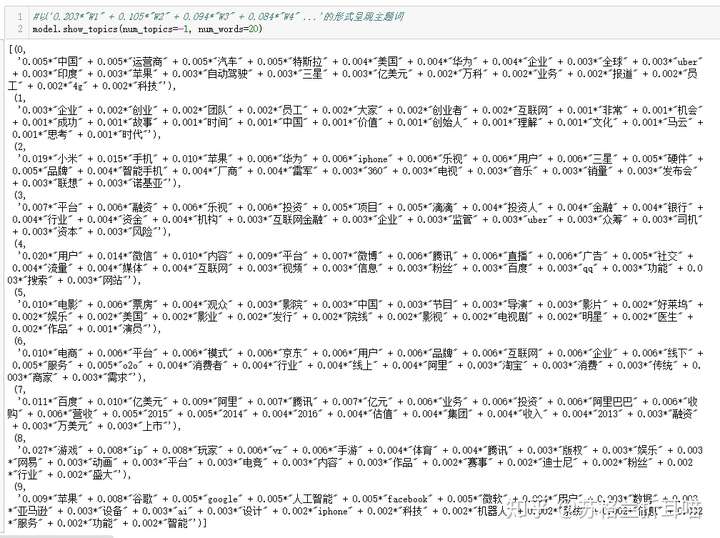

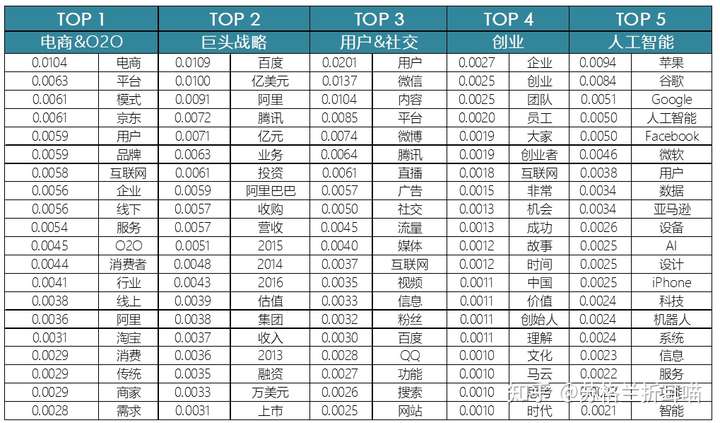

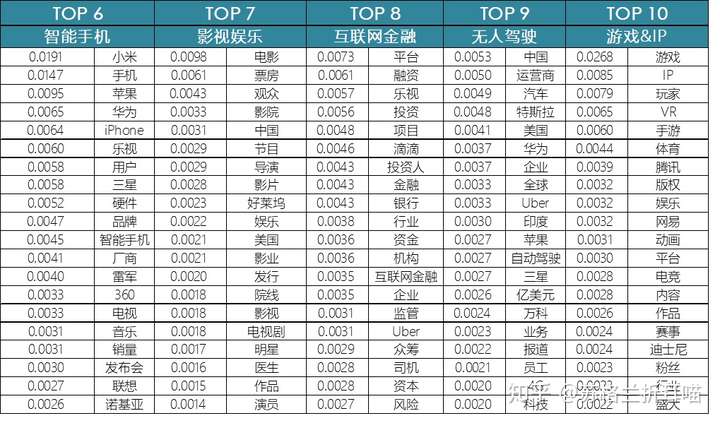

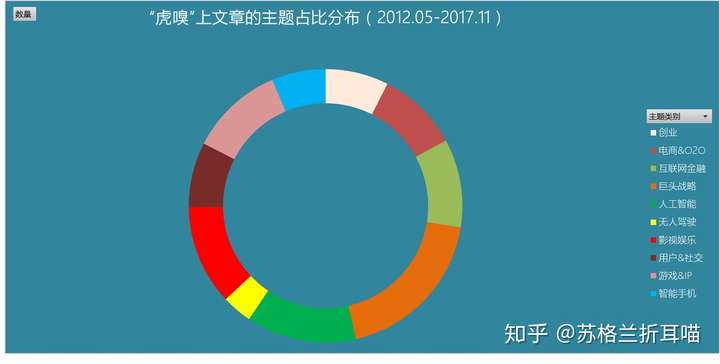

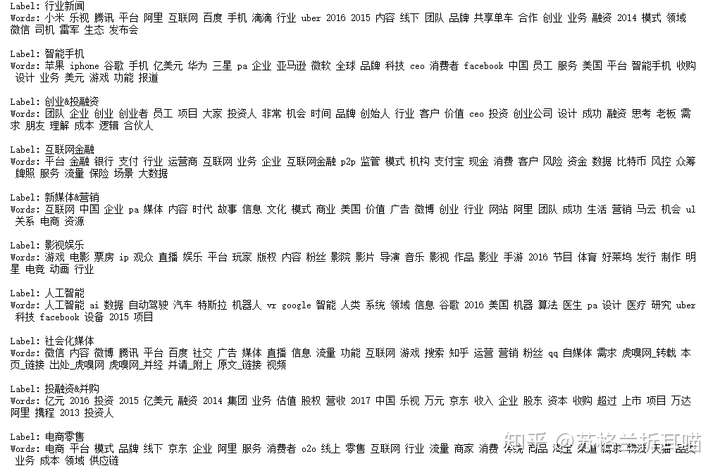

一般情况下,笔者将主题的数量设定为10个,经过数小时的运行,得到如下结果:

可以看出,经过文本预处理后的语料比较纯净,通过每个主题下的“主题词”,可以很容易的从这10个簇群中辨析出若干主题,不过,其中3个主题存在杂糅的情况(每个topic下包含2个主题),但这不影响笔者的后续分析,主题分类如下表所示:

电商&O2O: 该主题包含2个部分,即各大电商平台(淘宝、京东等)上的零售;O2O(Online线上网店Offline线下消费),商家通过免费开网店将商家信息、商品信息等展现给消费者,消费者在线上进行筛选服务,并支付,线下进行消费验证和消费体验。

巨头战略:主要是国内BAT三家的营收、融资、并购,以及涉足互联网新领域方面的资讯。

用户&社交:主要涉及用户和社会化媒体(微博、QQ、微信、直播平台等)方面的资讯。

创业:涉及创业人、创新模式、创业公司等一切关于创业的话题,令笔者印象最为深刻的是创业维艰。

人工智能:进入移动互联网时代,各类线上数据的不断积累和硬件技术的突飞猛进,大数据时代已然来临,随之而来的还有人工智能,该领域是时下国内外IT巨头角逐的焦点。

智能手机:智能手机的普及是移动互联网时代兴起的催化剂之一,2012年以来,“东风(国内智能手机企业)”逐渐压倒“西风(国外智能手机企业)”,国产智能手机品牌整体崛起,苹果、小米和锤子的每一次手机发布会总能在互联网界引起一片热议。

影视娱乐:影视文化产业作为政策力挺、利润巨大的行业,吸引着无数资本的目光。在金融资本与电影产业碰撞出“火花”的背后,是中国影视消费市场的快速崛起。国外好莱坞大片的不断引进和票房屡创新高,直接刺激着国内影视从业者提升自身的编剧和制片水平,由此诞生了一大批影视佳作,如近三年来的《夏洛特烦恼》、《湄公河行动》、《战狼2》。

互联网金融:互联网金融(ITFIN)是指传统金融机构与互联网企业利用互联网技术和信息通信技术实现资金融通、支付、投资和信息中介服务的新型金融业务模式。2011年以来至今,互联网金融所经历的是突飞猛进的实质性的金融业务发展阶段,在这个过程中,国内互联网金融呈现出多种多样的业务模式和运行机制。该主题下,第三个主题词“乐视”赫然在目,从2014年年底贾跃亭宣布乐视“SEE计划“到2017年10月中旬,乐视网巨亏16亿,贾跃亭财富缩水400亿也不到3年,“眼看他起朱楼,眼看他宴宾客…“

无人驾驶:无人驾驶是通过人工智能系统实现无人驾驶的智能汽车,它在本世纪尤其是近5年呈现出接近实用化的趋势,比如,谷歌自动驾驶汽车于2012年5月获得了美国首个自动驾驶车辆许可证,现在特斯拉的无人驾驶汽车已经在市场上在销售。随着技术上和硬件上的不断进步,它日趋成熟,成为国内互联网巨头的都想要摘得的桂冠。

游戏&IP:网络游戏被指是除了互联网金融之外捞金指数最强劲的互联网行业,从最近"王者荣耀"成都主创团队年终奖事件的引爆就能看出端倪,更不用说时下的流行语“吃鸡”了;同时,随着互联网IP产业的不断深化发展,体育、娱乐、文学等领域对版权和IP的重视程度越来越高,当下的互联网+时代,IP更是呈现了多元化的发展形势。

以下是上述各个话题在这4W多篇文章中的占比情况,可以明显的看出,虎嗅首页上的文章对互联网行业各大巨头的行业动向报道较多,其次是不断崛起的影视娱乐,除了无人驾驶方面的报道偏少以外,其他主题方面的文章的报道量差异不大,比较均衡。

再次是各主题的文章数量在时间上的变化情况:

上图中,我们可以明显的看出“巨头战略”这一话题的首页发文量始终维持在一个较高的水平,其次是“人工智能”的话题,它在虎嗅网主页2013年第一季度出现一个报道小高潮。值得注意的是,“互联网金融”在2014年第3个季度的报道量较大,从中可以获悉这个阶段的互联网金融正处于一个爆发的阶段,这个时段互金行业的重大事件有:小米投资积木盒子进军互联网金融(9.10)、京东发布消费金融战略(9.24)、蚂蚁金服集团成立(10.16),以及整个2014年是“众筹元年”,P2P步入洗牌季、以及央行密集令直指监管互联网金融,这些事件或政策都足以引发互联网界人士的热议,造成这一时段声量的骤然升起。

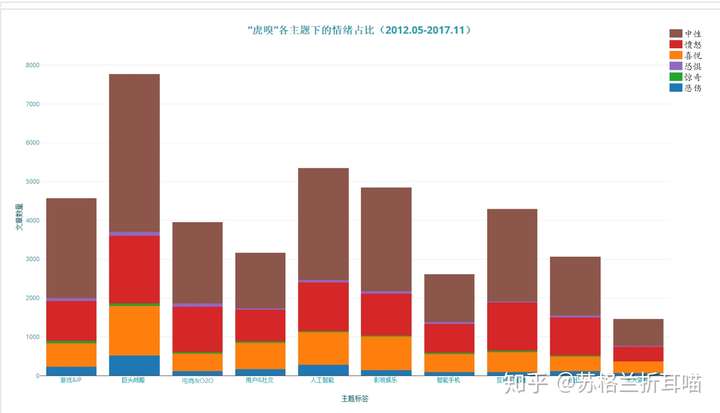

4.3 情绪分析&LDA主题模型交叉分析

结合上述LDA主题模型分析的结果,笔者使用基于深度学习的情绪语义分析模型(该模型有6类情绪,即喜悦、愤怒、悲伤、惊奇、恐惧和中性),对这些文章的标题进行情绪分析,得出各个文章的情绪标签,处理结果如下表所示:

将主题和情绪维度进行交叉分析,得出下图:

从上图中可以看出,各个主题下的标题的情绪以中性为主,凸显作者和官方的客观和中立态度,但是在现今标题党横行和全民重口味的时代,拟标题上的过分中立也意味着平淡无奇,难以触发读者的阅读行为,正所谓“有性格的品牌,有情绪的营销”,能成功挑起读者情绪的作者绝对是高手,所以,在上图中除了中性情绪外,居于第二位的是愤怒,狂撕狂怼,点燃读者的情绪;再次是悲伤,在现实生活中,伤感总能引起同情与共鸣。

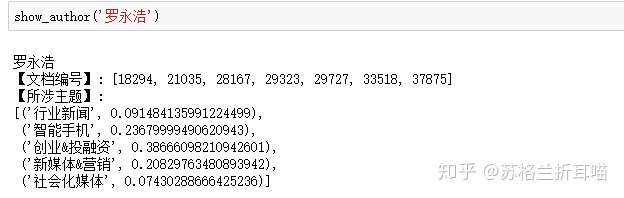

4.4 ATM模型

在这个部分,笔者想了解“虎嗅网上各个作家的写作主题,分析某些牛X作家喜欢写哪方面的文章(比如“行业洞察”、“爆品营销”、“新媒体运营”等),以及写作主题类似的作者有哪些。

为此,笔者采用了ATM模型进行分析,注意,这不是自动取款机的缩写,而是author-topicmodel:

ATM模型(author-topic model)也是“概率主题模型”家族的一员,是LDA主题模型(Latent Dirichlet Allocation )的拓展,它能对某个语料库中作者的写作主题进行分析,找出某个作家的写作主题倾向,以及找到具有同样写作倾向的作家,它是一种新颖的主题探索方式。

首先,笔者去除若干发布文章数为1的作者,再从文本中“析出”若干主题,因为文本数量有删减,所以跟之前的主题划分不太一致。根据各个主题下的主题词特征,笔者将这10个主题归纳为 :“行业新闻”、“智能手机”、“创业&投融资”、“互联网金融”、“新媒体&营销”、“影视娱乐”、“人工智能”、“社会化媒体”、“投融资&并购”和“电商零售”。

接下来,笔者将会对一些自己感兴趣的作者的写作主题及其相关作者进行一定的分析。

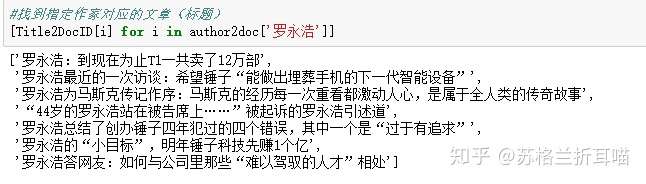

首先是锤子科技的创始人罗永浩,笔者一直认为他是一个奇人,之前看到他在虎嗅网上有署名文章,所以想看他在虎嗅网上写了啥:

从老罗的写作主题及其概率分布来看,他比较倾向于写创业、融资、智能手机和新媒体营销方面的文章,这个比较符合大众认知,因为善打情怀牌的老罗喜欢谈创业、谈自己对于手机的理解,而且由于自己鲜明的个性和犀利的语言,他常常在为自己的锤子品牌代言。

根据文档ID,笔者找到了他发布的这几篇文章:

单看标题,ATM模型还是蛮聪明的,能从老罗的文章中学习到了他的写作主题。

接下来是写作主题与老罗相近的虎嗅网作家,他们的发布文章数大于3篇:

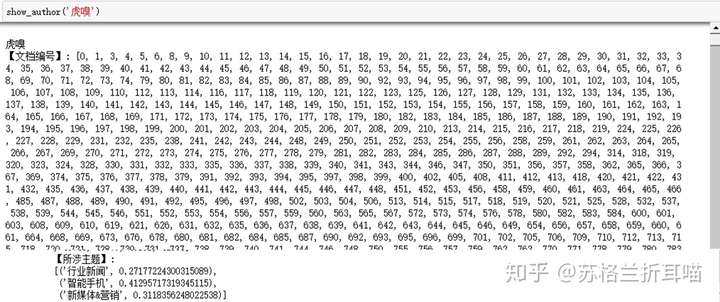

接下来是虎嗅自己的媒体,主页上发文量破万,所涉及的写作主题集中在“行业新闻”、“智能手机”和“新媒体&营销”:

与其写作主题类似的作者除了一些个人自媒体人,还包括一些媒体,如环球网、财富中文网、彭博商业周刊等。从前面的分析中可以推测出,他们在上述3个话题上的发文量也比较大。

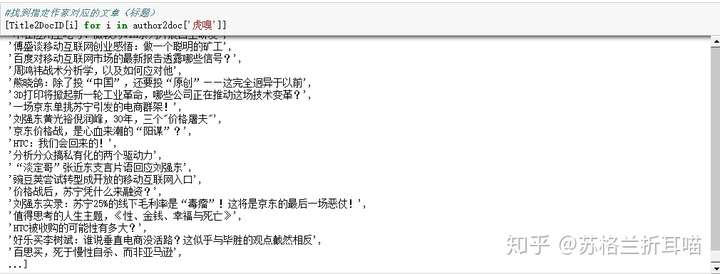

在这10,189篇文章里,笔者按文档ID随机抽取出其中的若干篇文章的标题,粗略验证下。然后,把这些标题绘制成独角兽形状的词云。

由上面的标题及其关键词云,预测的主题还是比较合理的。

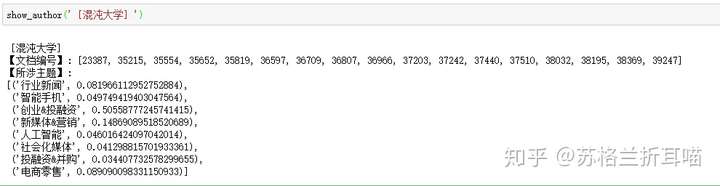

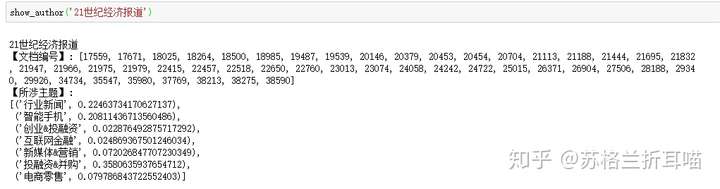

再看看另外两个笔者比较感兴趣的自媒体---混沌大学和21世纪经济报道。

从上面2个图可以看出,混沌大学关注的领域主要是“创业&投融资”、“新媒体&营销”方面的话题,偏向于为创业者提供创业相关的技能;而21世纪经济报道则更青睐“投融资&并购”、“行业新闻”和“智能手机”方面的话题,这比较符合该媒体的报道风格---分析国际形式、透视中国经济、观察行业动态和引导良性发展,有效地反映世界经济格局及变化,跟踪报道中国企业界的动态与发展。

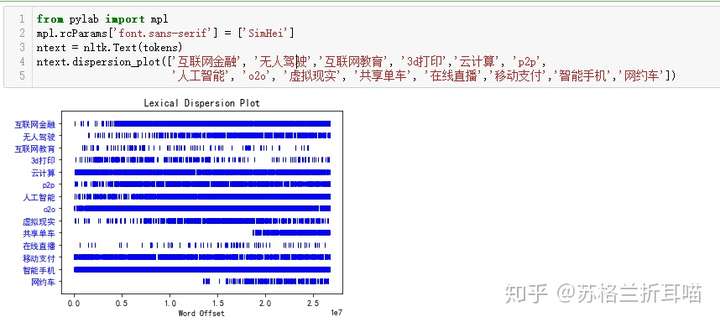

4.5 词汇分散图

接下来,笔者想了解虎嗅网主页这4W+文章中的某些词汇在2012.05~2017.11之间的数量分布和他们的位置信息(the locationof a word in the text),这时可以利用Lexical dispersion plot(词汇分散图)进行分析,它可以揭示某个词汇在一段文本中的分布情况(Producea plot showing the distribution of the words through the text)。

笔者先将待分析的文本按时间顺序进行排列,分词后再进行Lexical DispersionPlot分析。因此,文本字数的累积增长方向与时间正向推移的方向一致。图中纵轴表示词汇,横轴是文本字数,是累加的;蓝色竖线表示该词汇在文本中被提及一次,对应横轴能看到它所处的位置信息,空白则表示无提及。蓝色竖线的密集程度及起位置代表了该词汇在某一阶段的提及频次和所在年月。

从上面的关键词和主题词中,笔者挑拣出14个词汇进行分析,结果如下:

从上图中可以看出,“智能手机”、“移动支付”、“O2O”和“云计算”这4个词在近6年的热度居高不下,提及频次很高,在条柱上几近饱和。相较之下,“互联网教育”、“3D打印”、“在线直播”这些在虎嗅网上的报道量不大,从始至终只是零零星星的有些提及。

值得注意的是,“共享单车”在后期提及次数显著增加,而且是爆发式的出现,这与共享单车出现比较吻合,关于共享单车方面的数据分析,请参看《【干货】用大数据文本挖掘,来洞察“共享单车”的行业现状及走势》。

4.6 词向量/关联词分析---当我们谈论XX时 我们在谈论什么

基于深度神经网络的词向量能从大量未标注的普通文本数据中无监督地学习出词向量,这些词向量包含了词汇与词汇之间的语义关系,正如现实世界中的“物以类聚,类以群分”一样,词汇可以由它们身边的词汇来定义(Words can be defined by the company they keep)。

从原理上讲,基于词嵌入的Word2vec是指把一个维数为所有词的数量的高维空间嵌入到一个维数低得多的连续向量空间中,每个单词或词组被映射为实数域上的向量。把每个单词变成一个向量,目的还是为了方便计算,比如“求单词A的同义词”,就可以通过“求与单词A在cos距离下最相似的向量”来做到。

接下来,通过Word2vec,笔者查找出自己感兴趣的若干词汇的关联词,从而在虎嗅网的这个独特语境下去解读它们。

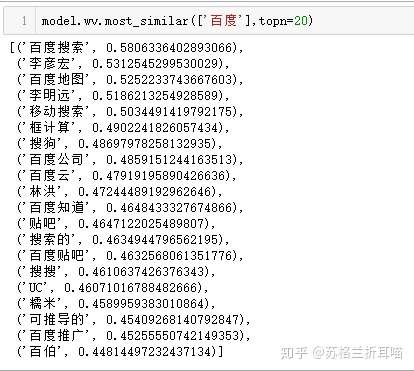

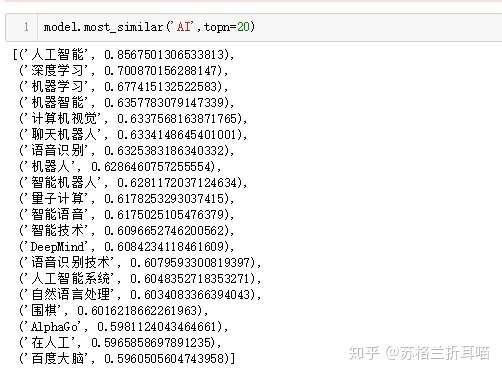

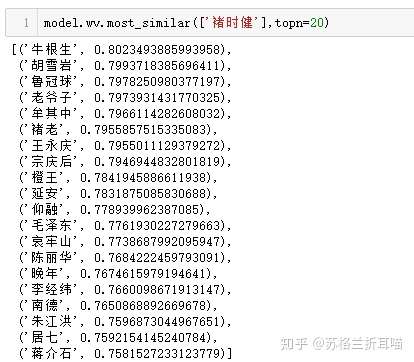

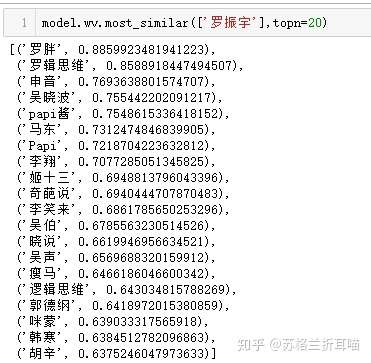

由此,笔者依次对“百度”、“人工智能”、“褚时健”和“罗振宇”这几个关键词进行关联词分析。

出来的都是与百度相关的词汇,不是百度的产品、公司,就是百度的CEO和管理者,“搜索”二字变相的出现了很多次,它是百度起家的一大法宝。

与“AI”相关的词汇也是很好的解释了人工智能的细分领域和目前比较火的几个应用场景。

与褚时健一样,相关词中前几位名人(牛根生、胡雪岩、鲁冠球、王永庆和宗庆后)也是名噪一时的商业精英,“老爷子”、“褚老”、“橙王”是外界对其的尊称。有意思的是,褚老也有一些政治人物(毛主席和蒋委员长)那样的英雄气概,其人其事大有“东隅已逝,桑榆非晚”、“待从头,收拾旧山河”的豁达精神和乐观主义!

再就是资深媒体人和传播专家罗振宇了,“知识变现”的践行者,他的许多见解都能颠覆群众原有的观念。与罗胖相类似的人还有申音(互联网真人秀《怪杰》的创始人和策划人,罗振宇的创业伙伴)、吴晓波(吴晓波频道和社群的创始人)、Papi酱(知名搞笑网红)、马东(现“奇葩说”主持人)、李翔(得到APP上《李翔商业内参》的推出者)、姬十三(果壳网创始人)、李笑来(财务自由知名布道者)、吴伯凡(词没切全,《21世纪商业评论》发行人,作品有《冬吴相对论》和《伯凡日知录》)…

4.7 对互联网百强公司旗下品牌的词聚类与词分类

2016年互联网百强企业的互联网业务收入总规模达到1.07万亿元,首次突破万亿大关,同比增长46.8%,带动信息消费增长8.73%。数据显示,互联网领域龙头企业效应越来越明显,对他们的研究分析能帮助我们更好的了解中国互联网行业的发展概况和未来方向。

笔者在这里选取2016年入选的互联网百强企业,名单如下:

对于上述百强互联网公司的旗下品牌名录,笔者利用上面训练出来的词向量模型,用来进行下面的词聚类和词分类。

4.7.1 词聚类

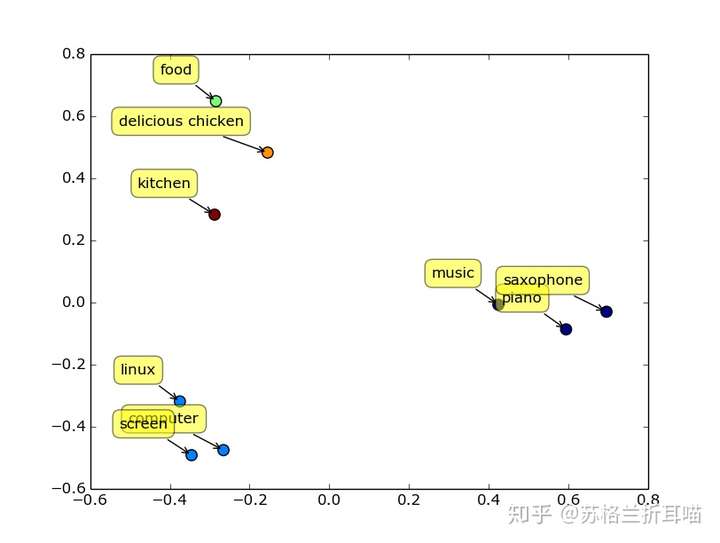

运用基于Word2Vec(词向量)的K-Means聚类,充分考虑了词汇之间的语义关系,将余弦夹角值较小的词汇聚集在一起,形成簇群。下图是高维词向量压缩到2维空间的可视化呈现:

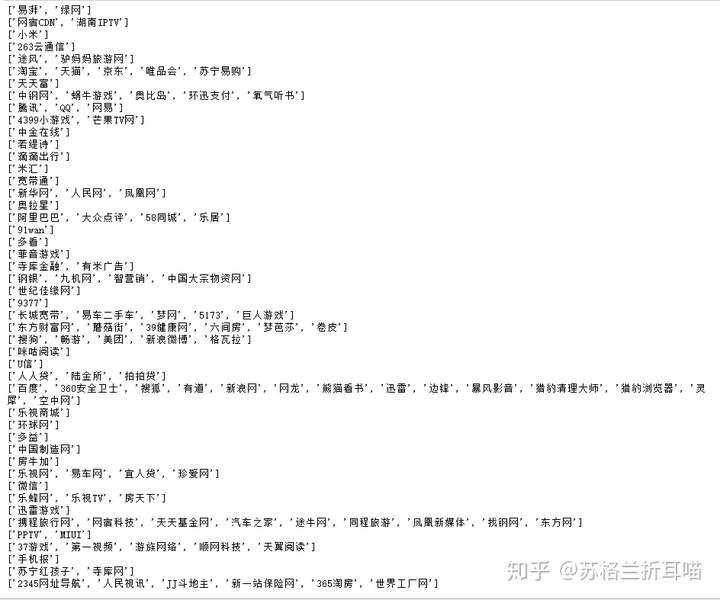

笔者将词向量模型中所包含的所有词汇划定为300个类别,看看这种设定下的品牌聚类效果如何。分析结果和规整如下所示:

从上述结果来看,有些分类是比较好理解的,如途风(网)和驴妈妈旅游网,都是做旅游的,人人贷、陆金所和拍拍贷是搞互金的,这些词汇是在“行业的语境”里出现的次数较多,基于同义关系聚类在一起,同属一个行业。但其中大多数的聚类不是按行业来的,而是其他的语境中出现,且看下面这两段话:

第一波人口红利是从2011年开始的,这波人口是原来核心的三亿重度互联网网民,或者简单地说,是那个年代去买小米手机和iPhone的这波用户,当然也包括三星。他们是一二线城市里边比较偏年轻的这些人口。所以你看包括我们自己投资的美图、知乎、今日头条、小米都是跟着这波人口起来的。

第二波人口是从2013年、2014年开始发生的,这波人口是什么?这波人口实际上是移动互联网往三四线城市下沉造成的人口红利,是二三四线城市里面比较年轻的人口。大家简单想一下买OPPO、ViVO手机的人。这波红利带来了包括快手、映客等一系列的兴起,包括微博的二次崛起。

上面加粗加黑的品牌虽然不同属一个行业,但都出现在“移动互联网的人口红利”的语境中,所以单从这个语境来说,它们可以聚为一类。

所以,上述的聚类可能是由于各类词汇出现在不同的语境中,深挖的话,或许能发现到若干有趣的线索。篇幅所限,这个就留给有好奇心的读者来完成吧。

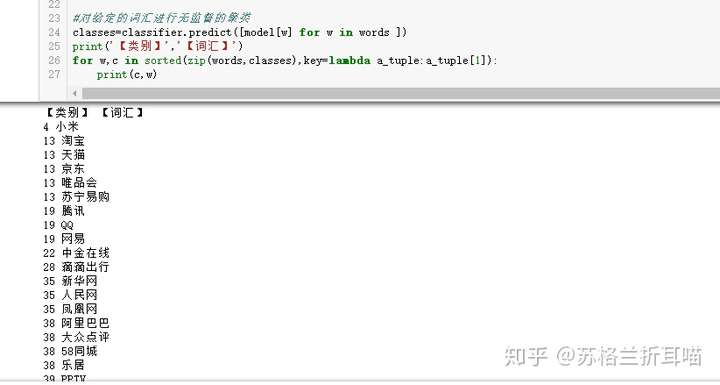

4.7.2 词分类

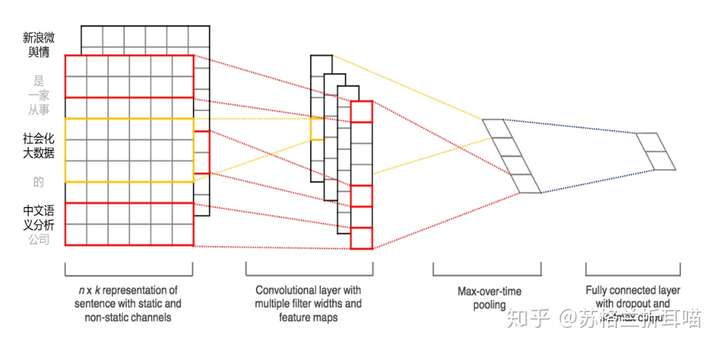

在这里,笔者还是利用之前训练得出的词向量,通过基于CNN( ConvolutionalNeural Networks,卷积神经网络)做文本分类,用来预测。CNN的具体原理太过复杂,笔者在这里不做赘述,感兴趣的小伙伴可以查阅后面的参考资料。

由于文本分类(Text Classification)跟上面的文本聚类(Text Cluster)在机器学习中分属不同的任务,前者是有监督的学习(所有训练数据都有标签),后者是无监督的学习(数据没有标签),因而,笔者在正式的文本分类任务开始前,先用有标注的语料训练模型,再来预测后续的未知的文本。

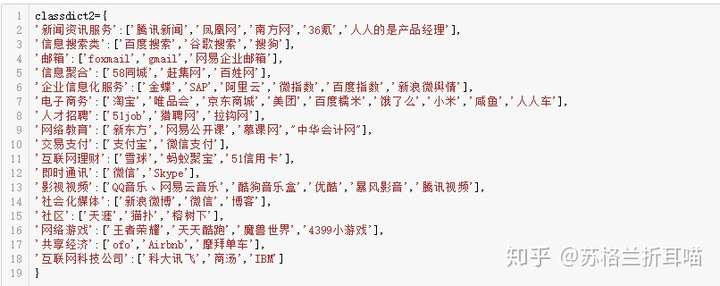

在这里,笔者根据互联网企业所属细分领域的不同,划分为17个类别,每个类别只有很少的标注语料参与训练,也就是几个词罢了。对,你没看错,借助外部语义信息(之前训练好的词向量模型,已经包含有大量的语义信息),你只需要少许的标注语料就可以完成分类模型的训练。

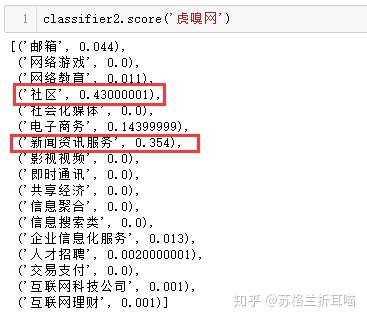

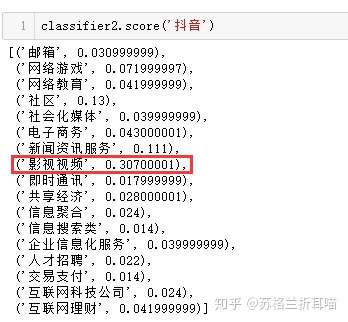

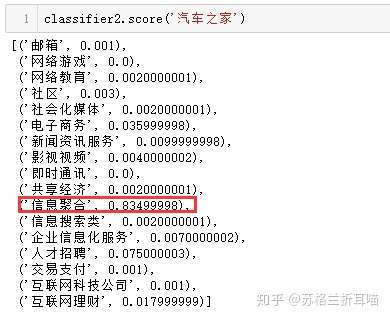

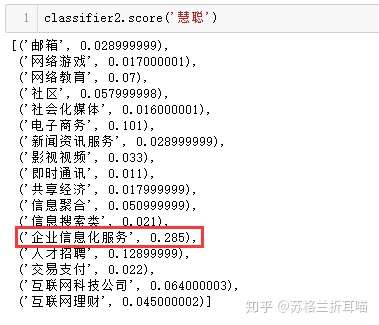

接着,笔者用之前未出现在训练语料中的词来检验效果,出来的结果是类别标签及其对应的概率,概率值大的类别是品牌最有可能从属的细分领域。结果如下图所示:

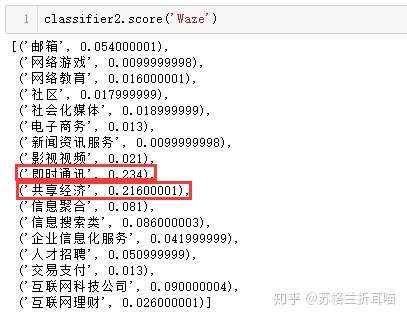

上述的结果都符合大家的基本认知,小规模测试下,准确率尚可,最后来一个难度大一点的,国外一家笔者从未知晓的互联网公司:

通过Google,笔者了解到Waze是以色列一家做众包导航地图的科技公司。前一段时间火了一把,被Google 10亿美元收购了。其产品虽然没有Google地图那样强大的卫星图片作支撑,但是可以向用户社区提供有关交通状况、交通事故以及测速区等实时信息(地图弹幕即视感)。“众包”和“实时信息”分别对应“共享经济”和“即时通讯”,比较符合预测标签所表征的内涵,能在一定程度上预测出该企业的业务属性。

4.8 互联网百强公司的共现分析

上面所做的关于互联网百强公司的聚类分析和分类分析,看起来是“黑匣子”,其内在的机理,我们不太容易理解。接下来,笔者将基于“图论”来做品牌共现分析,从网络的角度来分析百强企业品牌之间的关联关系。

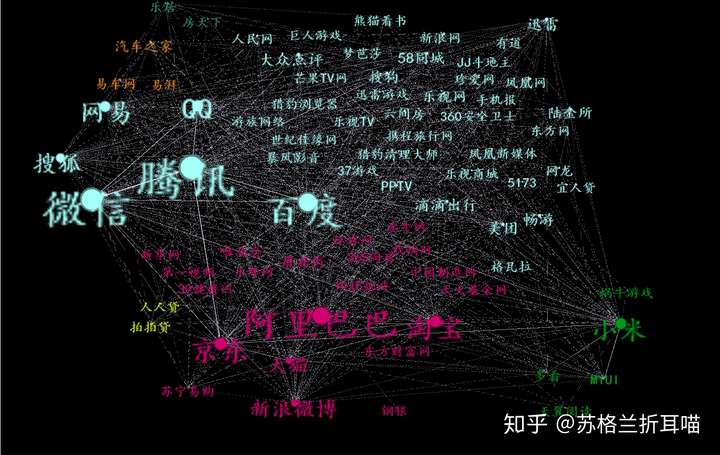

提取出上述百强企业品牌的相互共现关系,形成如下的社交网络图:

上图中,每个节点代表一个人物,线条粗细代表品牌与品牌之间的强弱链接关系,相同颜色的节点表示它们(在某种条件下)同属于一类。节点及字体的大小表示品牌在网络中的影响力大小,也就是“Betweenness Centrality(中介核心性),”学术的说法是“两个非邻接的成员间的相互作用依赖于网络中的其他成员,特别是位于两成员之间路径上的那些成员,他们对这两个非邻接成员的相互作用具有某种控制和制约作用”。说人话就是,更大的影响力就意味着该品牌链接了更多的合作机会和资源,以及涉足更多的互联网领域。

先看里面影响力TOP10,依次是腾讯、微信、百度、QQ、阿里巴巴、淘宝、京东、小米、网易和新浪微博,“腾讯系”在10强里占据了3个席位,实力强大,可见一斑。

再看由颜色区分出的6个簇群:

- 淡蓝系:腾讯、微信、百度、QQ、网易、搜狐…

- 洋红系:阿里巴巴、淘宝、京东、新浪微博、天猫…

- 深绿系:小米、多看、MIUI、天翼阅读…

- 浅绿系:乐居、房天下

- 明黄系:人人贷、拍拍贷

- 黄橙系:汽车之家、易车网、易湃

上述的分类,大部分是好理解的, 浅绿系(乐居、房天下)是做房产的,明黄系(人人贷、拍拍贷)是搞互联网P2P金融的,而黄橙系(汽车之家、易车网、易湃)是互联网汽车领域的品牌。

值得注意的是,深绿系的小米、多看、MIUI、天翼阅读,以小米为中心MIUI是小米的产品,多看(阅读)已经被小米收购,天翼阅读一度是小米捆绑的阅读软件,然而,蜗牛游戏就跟前几个不同,有一篇文章的标题是这样的:“蜗牛发布移动战略,石海:不做小米第二”,它是小米在移动游戏领域的对手…

此外,淡蓝系(腾讯、微信、百度、QQ、网易、搜狐等)和洋红系(阿里巴巴、淘宝、京东、新浪微博、天猫等)这两个簇群中,品牌与品牌之间的关系就比较复杂了,子母公司、兄弟品牌、跨界合作、竞对关系、跨界竞争、融资及兼并,上述情况,在这两类簇群中或可兼而有之。

结语

在本文的文本挖掘部分,其实已经涉及到人工智能/AI这块的实际应用---关键词提取、LDA主题模型、ATM模型属于机器学习,情绪分析、词向量、词聚类和词分类涉及到深度学习方面的知识,这些都是AI 在数据分析中的真实应用场景。

此外,本文是探索性质的数据分析干货文,不是数据分析报告,重在启迪思路,授人以渔,得出具体的结论不是本文的目的,对结果的分析分散在各个部分,“文末结论控”不喜勿喷。

参考资料:

1.数据来源:虎嗅网主页,2012.05-2017.11

2.苏格兰折耳喵,《数据运营|数据分析中,文本分析远比数值型分析重要!(上)》

3.苏格兰折耳喵,《在运营中,为什么文本分析远比数值型分析重要?一个实际案例,五点分析(下)》

4.苏格兰折耳喵,《干货|如何利用Social Listening从社会化媒体中“提炼”有价值的信息?》

5.苏格兰折耳喵,《干货|作为一个合格的“增长黑客”,你还得重视外部数据的分析!》

6.苏格兰折耳喵,《以《大秦帝国之崛起》为例,来谈大数据舆情分析和文本挖掘》

7.苏格兰折耳喵,《【干货】用大数据文本挖掘,来洞察“共享单车”的行业现状及走势》

8.Word2vec维基百科词条,https://en.wikipedia.org/wiki/Word2vec

10.宗成庆,《自然语言理解:(06)词法分析与词性标注》,中科院

11.UnderstandingConvolutional Neural Networks for NLP

12.Yoon Kim,Convolutional Neural Networks for Sentence Classification

13. Hoffman, Blei, Bach. 2010. Online learning for LatentDirichlet Allocation

14.TomasMikolov, Kai Chen, Greg Corrado, and Jeffrey Dean. Efficient Estimation of WordRepresentations in Vector Space. In Proceedings of Workshop at ICLR, 2013.

15.TomasMikolov, Ilya Sutskever, Kai Chen, Greg Corrado, and Jeffrey Dean. DistributedRepresentations of Words and Phrases and their Compositionality. In Proceedingsof NIPS, 2013.