训练集外误差

@

- 前言

- 一、基本术语

- 1.数据集(dataset)

- 2.样本(sample)

- 3.属性(attribute)

- 4.属性值(attribute value)

- 5.属性空间(attribute space)

- 6.学习(learning)/训练(training)

- 7.训练数据(training data)

- 8.训练样本(training sample)

- 9.训练集(training set)

- 10.假设(hypothesis)

- 11.学习器(learner)

- 12.标记(label)

- 13.样例(example)

- 14.分类(classification)

- 15.回归(regression)

- 16.测试(testing)

- 17.簇(cluster)

- 18.聚类(clustering)

- 19.监督学习(supervised learning)

- 20.无监督学习(unsupervised learning)

- 21.泛化能力(generalization)

- 22.独立同分布(independent and identically distributed 简称i.i.d.)

- 23.归纳偏好(Inductive Bias)

- 24.没有免费的午餐定理(No Free Lunch Theorem)

- 二、训练集之外误差

- 总结

前言

本人为机器机器学习初学,正在一点一点阅读周志华老师的西瓜书,顺便写点笔记与自己的理解。

本次笔记主要是在阅读到绪论部分时对训练集外误差公式的理解,如有不正之处,欢迎指出。

提示:以下是本篇文章正文内容,下面理解可供参考

一、基本术语

1.数据集(dataset)

一组记录的集合。例如:(色泽=青绿;根蒂=稍蜷;敲声=沉闷)。

2.样本(sample)

数据集中的每条记录,它是关于一个事件或对象的描述。又称示例(instance)。例如:色泽=青绿。

3.属性(attribute)

反映事件或对象在某方面的表现或性质的事项。又称特征(feature)。例如色泽。

4.属性值(attribute value)

属性上的取值。例如:青绿。

5.属性空间(attribute space)

属性张成的空间。又称样本空间(sample space)。例如:把色泽、根蒂、敲声作为三个坐标轴,它们张成的一个描述西瓜的三维空间,每个西瓜都可以在这个空间中找到一个对应的坐标位置,这个点对应一个坐标向量,这个示例又称为一个“特征向量”(feature vector)。

6.学习(learning)/训练(training)

从数据中学得模型的过程,这个过程是通过执行某个学习算法来完成。

7.训练数据(training data)

训练过程中使用的数据。

8.训练样本(training sample)

训练数据中的每个样本。

9.训练集(training set)

训练样本组成的集合。

10.假设(hypothesis)

学得模型对应了关于数据的某种潜在的规律。

11.学习器(learner)

模型又称学习器。

12.标记(label)

学得一个模型,仅有已有的示例数据是不够的。要建立一个关于“预测”(prediction)的模型,需要获得训练样本的“结果”信息。例如“((色泽=青绿;根蒂=稍蜷;敲声=浊响),好瓜)”。这里关于示例结果的信息“好瓜”,称为标记。

13.样例(example)

拥有了标记信息的示例。

14.分类(classification)

欲预测的是离散值。

15.回归(regression)

欲预测的是连续值。

16.测试(testing)

学得模型后,使用其进行预测的过程。

17.簇(cluster)

将训练集中的记录分组,每个组就是一个簇。

18.聚类(clustering)

将训练集分组的过程。

19.监督学习(supervised learning)

训练数据既有特征(feature)又有标签(label),通过训练,让机器可以自己找到特征和标记之间的联系,在面对只有特征没有标签的数据时,可以判断出标签。代表:分类和回归。

20.无监督学习(unsupervised learning)

在只有特征没有标记的训练数据集中,通过数据之间的内在联系和相似性将他们分成若干类。代表:聚类。

21.泛化能力(generalization)

学得模型适用于新样本的能力。

22.独立同分布(independent and identically distributed 简称i.i.d.)

假设样本空间中全体样本服从一个未知的“分布”D,我们获得的每个样本都是独地从这个分布上采样获得的,即“独立同分布”。

23.归纳偏好(Inductive Bias)

机器学习算法在学习过程中对某种类型假设的偏好,称为“归纳偏好”。与特征选择(feature selection)有关。

24.没有免费的午餐定理(No Free Lunch Theorem)

若学习算法La在某些问题上比学习算法Lb要好,那么必然存在另一些问题,在这些问题中Lb比La泛化能力强。

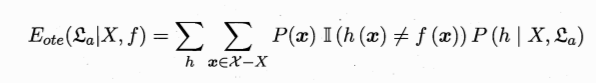

二、训练集之外误差

1.等式解释

La在训练集之外的所有样本上的误差为:

χ:样本空间。 H:假设空间。

La、Lb:学习算法。学习算法有其偏好性,对于相同的训练数据,不同的学习算法可以产生不同的假设,学得不同的模型,因此才会有哪个学习算法对于具体问题更好。这里这个没有免费的午餐定理要证明的就是:若对于某些问题算法La学得的模型更好,那么必然又有在另一些问题中,算法Lb学得的模型更好。这里的好坏在下文中使用算法对于所有样本的总误差来表示。

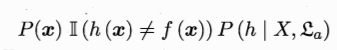

P(h|X,La): 算法La基于训练数据X产生假设h的概率。既然前面有假设空间这个概念,那么假设h自然不止一个,并且对于整个空间的每一个h,P(h|X,La)的总和等于1。这里的假设是一个映射,是y=h(x),是基于数据X产生的对于学习目标(判断好瓜)的预测。因数据X不一样,所以可能产生不一样的假设h。

f:希望学得的真实目标函数。这个函数不是唯一的,而是存在一个函数空间,在这个空间中按某个概率分布,下文证明中采用的是均匀分布。

E是期望expectation,这个下标ote,是off-training error,即训练集外误差。

Eote(La|X,f): 算法La学得的假设在训练集外的所有样本上的误差的期望。

P(x): 样本空间中的每个样本的取得概率不同。比如:(色泽=浅白,根蒂=硬挺,敲声=清脆)的西瓜可能比(色泽=浅白,根蒂=稍蜷,敲声=沉闷)的西瓜更多,取到的概率更大。所以有P(x)这个概率。

Ⅱ(h(x)≠f(x)):指示函数,括号里为真就=1,为假就=0。.

求和符号理解:

∑h: 对假设的求和。同一算法对于训练集外(测试集)的不同数据产生的不同的假设,每个假设有不同的概率。

∑x∈χ−X:对于样本空间中每一个训练集外的数据都进行右边的 运算。

运算。

2.二分类问题

先要说明,对于我们想要求得的真实目标函数f可能也不止一个,这个好理解,因为满足版本空间中的假设的函数都可以是真实目标函数,然后这些不同的f有着相同的概率(均匀分布),函数空间为{0,1},那么有多少个这种函数呢?

我们来看对于同一个样本的这个预测值,对于样本空间χ中的某个样本x,如果f1(x)=0,f2(x)=1, 那么这就是两个不同的真实目标函数,所以对于某个样本可以区分出两个真实目标函数,一共有|χ|个样本,所以一共有2|χ|个真实目标函数,这些真实目标函数是等可能分布的(均匀分布),所以对于某个假设h(x)如果h(x)=0那么就有1/2的可能与真实目标函数相等。

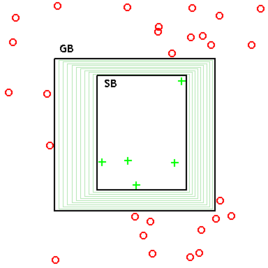

3.版本空间与假设空间

假设空间:属性所有可能取值组成的可能的样本

版本空间:与已知数据集一致的所有假设的子集集合。

(绿色加号代表正类样本,红色小圈代表负类样本)

GB 是最大泛化正假设边界(maximally General positive hypothesis Boundary),;

SB 是最大精确正假设边界(maximally Specific positive hypothesis Boundary)

GB与SB之间所围成的区域就是版本空间。

例如:

假设空间

1 色泽=*,根蒂=*,敲声=*

2 色泽=青绿,根蒂=*,敲声=*

3 色泽=乌黑,根蒂=*,敲声=*

4 色泽=*,根蒂=蜷缩,敲声=*

5 色泽=*,根蒂=硬挺,敲声=*

6 色泽=*,根蒂=稍蜷,敲声=*

7 色泽=*,根蒂=*,敲声=浊响

8 色泽=*,根蒂=*,敲声=清脆

9 色泽=*,根蒂=*,敲声=沉闷

10 色泽=青绿,根蒂=蜷缩,敲声=*

11 色泽=青绿,根蒂=硬挺,敲声=*

12 色泽=青绿,根蒂=稍蜷,敲声=*

13 色泽=乌黑,根蒂=蜷缩,敲声=*

14 色泽=乌黑,根蒂=硬挺,敲声=*

15 色泽=乌黑,根蒂=稍蜷,敲声=*

16 色泽=青绿,根蒂=*,敲声=浊响

17 色泽=青绿,根蒂=*,敲声=清脆

18 色泽=青绿,根蒂=*,敲声=沉闷

19 色泽=乌黑,根蒂=*,敲声=浊响

20 色泽=乌黑,根蒂=*,敲声=清脆

21 色泽=乌黑,根蒂=*,敲声=沉闷

22 色泽=*,根蒂=蜷缩,敲声=浊响

23 色泽=*,根蒂=蜷缩,敲声=清脆

24 色泽=*,根蒂=蜷缩,敲声=沉闷

25 色泽=*,根蒂=硬挺,敲声=浊响

26 色泽=*,根蒂=硬挺,敲声=清脆

27 色泽=*,根蒂=硬挺,敲声=沉闷

28 色泽=*,根蒂=稍蜷,敲声=浊响

29 色泽=*,根蒂=稍蜷,敲声=清脆

30 色泽=*,根蒂=稍蜷,敲声=沉闷

31 色泽=青绿,根蒂=蜷缩,敲声=浊响

32 色泽=青绿,根蒂=蜷缩,敲声=清脆

33 色泽=青绿,根蒂=蜷缩,敲声=沉闷

34 色泽=青绿,根蒂=硬挺,敲声=浊响

35 色泽=青绿,根蒂=硬挺,敲声=清脆

36 色泽=青绿,根蒂=硬挺,敲声=沉闷

37 色泽=青绿,根蒂=稍蜷,敲声=浊响

38 色泽=青绿,根蒂=稍蜷,敲声=清脆

39 色泽=青绿,根蒂=稍蜷,敲声=沉闷

40 色泽=乌黑,根蒂=蜷缩,敲声=浊响

41 色泽=乌黑,根蒂=蜷缩,敲声=清脆

42 色泽=乌黑,根蒂=蜷缩,敲声=沉闷

43 色泽=乌黑,根蒂=硬挺,敲声=浊响

44 色泽=乌黑,根蒂=硬挺,敲声=清脆

45 色泽=乌黑,根蒂=硬挺,敲声=沉闷

46 色泽=乌黑,根蒂=稍蜷,敲声=浊响

47 色泽=乌黑,根蒂=稍蜷,敲声=清脆

48 色泽=乌黑,根蒂=稍蜷,敲声=沉闷

49 Ø

根据总结,按照上述过程进行学习:

(1,(色泽=青绿、根蒂=蜷缩、敲声=浊响),好瓜)

可以删除假设空间中的3、5、6、8、9、11-15、17-21、23-30、32-49

(2,(色泽=乌黑、根蒂=蜷缩、敲声=浊响),好瓜)

可以删除剩余假设空间中的2、10、16、31

(3,(色泽=青绿、根蒂=硬挺、敲声=清脆),坏瓜)

可以删除剩余假设空间中的1

(4,(色泽=乌黑、根蒂=稍蜷、敲声=沉闷),坏瓜)

剩余假设空间中无可删除的假设

学习过后剩余的假设为:

4 色泽=*,根蒂=蜷缩,敲声=*

7 色泽=*,根蒂=*,敲声=浊响

22 色泽=*,根蒂=蜷缩,敲声=浊响

这就是最后的“假设集合”,也就是“版本空间”。

总结

本文介绍了相关专业术语,以及周志华机器学习中训练集外误差的理解。