python 中文分词库 jieba库

jieba库概述:

jieba是优秀的中文分词第三方库

中文文本需要通过分词获得单个的词语

jieba是优秀的中文分词第三方库,需要额外安装

jieba库分为精确模式、全模式、搜索引擎模式

原理

1.利用一个中文词库,确定汉子之间的关系概率

2.汉字间概率大的组成词组,形成分词结果

3.除了分词,用户还可以添加自定义的词组

安装

pip install jieba 如果下载失败需要使用 -i 转镜像源可以参考这个博客https://www.cnblogs.com/love2000/p/11639572.html

提示下载成功

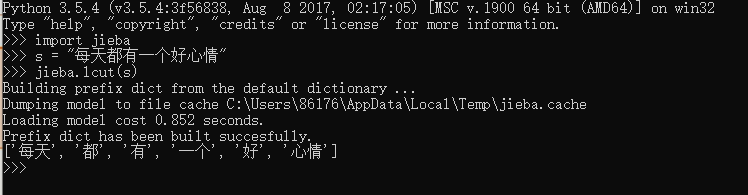

精准模式

jieba.lcut(s)

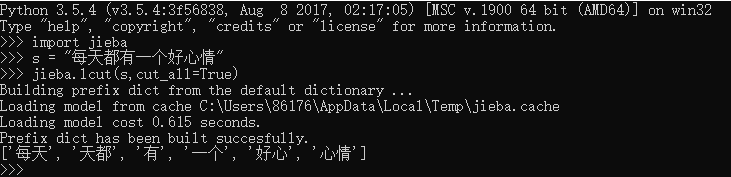

全模式

jieba.lcut(s,cut_all=True)

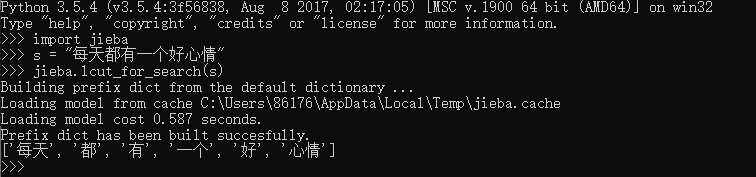

搜索引擎模式

jieba.lcut_for_search(s)

模式说明:

精确模式、全模式、搜索引擎模式

精确模式:把文本精确的切分开,不存在冗余单词

全模式:把文本中所有可能的词语都扫描出来,有冗余

搜索引擎模式:在精确模式基础上,对长词再次切分

浙公网安备 33010602011771号

浙公网安备 33010602011771号