softmax回归

softmax回归模型是logistic回归模型在多分类问题上的推广,在多分类问题中,类标签$y$可以取两个以上的值,softmax回归是有监督的。

在logistic回归中,预测函数为:

$h_{\Theta}(x) = \frac{1}{1 + exp(-\Theta^Tx)}$

损失函数为

$J(\Theta) = - \frac{1}{m}[\sum^m_{i=1}y^{(i)}logh_{\Theta}(x^{(i)}) + (1 - y^{(i)})log(1 - h_{\Theta}(x^{i}))]$

在softmax回归中,我们解决的是多分类问题(相对于logistic回归解决的二分类问题),y可以取k个不同的值,我们想估计x的每一种分类结果出现的概率。对于给定的输入x,预测函数输出一个k维的向量来表示这k个估计的概率值。

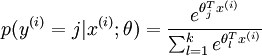

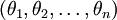

预测函数为:

其中$\Theta_1,\Theta_2,...,\Theta_k$是模型的参数,$\frac{1}{\sum^k_{j=1}e^{\Theta^T_jx^{(i)}}}$对概率分布进行归一化,使得所有概率之和为1.

记 1{ 值为真的表达式 } = 1,1{ 值为假的表达式 } = 0.则softmax回归的损失函数为

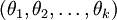

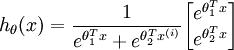

上述公式是logistic回归损失函数的推广,logistic回归损失函数可以改为

![\begin{align}

J(\theta) &= -\frac{1}{m} \left[ \sum_{i=1}^m (1-y^{(i)}) \log (1-h_\theta(x^{(i)})) + y^{(i)} \log h_\theta(x^{(i)}) \right] \\

&= - \frac{1}{m} \left[ \sum_{i=1}^{m} \sum_{j=0}^{1} 1\left\{y^{(i)} = j\right\} \log p(y^{(i)} = j | x^{(i)} ; \theta) \right]

\end{align}](http://ufldl.stanford.edu/wiki/images/math/5/4/9/5491271f19161f8ea6a6b2a82c83fc3a.png)

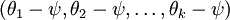

在softmax回归中将x分类为类别j的概率为:

对于$J(\Theta)$的最小化问题,目前还没有闭式解法。使用迭代的优化算法(梯度下降或L-BFGS等),经过求导,可得到损失函数关于参数的梯度。

softmax回归模型参数化的特点:

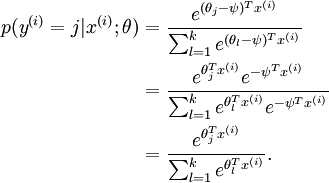

假设我们从参数向量$\Theta_j$中减去了向量$\Psi$,则预测函数变为:

显然,从$\Theta_j$中减去$\Psi$完全不影响预测函数的预测结果,这表明前面的softmax回归模型中存在冗余的参数,即softmax模型被过度参数化了。

进一步而言,如果参数  是代价函数

是代价函数  的极小值点,那么

的极小值点,那么  同样也是它的极小值点,其中

同样也是它的极小值点,其中  可以为任意向量。因此使

可以为任意向量。因此使  最小化的解不是唯一的。(有趣的是,由于$J(\Theta)$仍然是一个凸函数,因此梯度下降时不会遇到局部最优解的问题。但是 Hessian 矩阵是奇异的/不可逆的,这会直接导致采用牛顿法优化就遇到数值计算的问题)

最小化的解不是唯一的。(有趣的是,由于$J(\Theta)$仍然是一个凸函数,因此梯度下降时不会遇到局部最优解的问题。但是 Hessian 矩阵是奇异的/不可逆的,这会直接导致采用牛顿法优化就遇到数值计算的问题)

注意,当  时,我们总是可以将$\Theta_1$替换为$\Theta_1 - \Psi = 0_{->}$(即替换为全零向量),并且这种变换不会影响假设函数。因此我们可以去掉参数向量 $\Theta_1$(或者其他 $\Theta_j$中的任意一个)而不影响假设函数的表达能力。实际上,与其优化全部的 $k * (n + 1)$个参数 ,我们可以令

时,我们总是可以将$\Theta_1$替换为$\Theta_1 - \Psi = 0_{->}$(即替换为全零向量),并且这种变换不会影响假设函数。因此我们可以去掉参数向量 $\Theta_1$(或者其他 $\Theta_j$中的任意一个)而不影响假设函数的表达能力。实际上,与其优化全部的 $k * (n + 1)$个参数 ,我们可以令 ,只优化剩余的 $(k - 1) * (n + 1)$个参数,这样算法依然能够正常工作。(其中n +1是$\Theta_j$的维度)

,只优化剩余的 $(k - 1) * (n + 1)$个参数,这样算法依然能够正常工作。(其中n +1是$\Theta_j$的维度)

在实际应用中,为了使算法实现更简单清楚,往往保留所有参数  ,而不任意地将某一参数设置为 0。但此时我们需要对代价函数做一个改动:加入权重衰减。权重衰减可以解决 softmax 回归的参数冗余所带来的数值问题。

,而不任意地将某一参数设置为 0。但此时我们需要对代价函数做一个改动:加入权重衰减。权重衰减可以解决 softmax 回归的参数冗余所带来的数值问题。

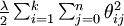

我们通过添加一个权重衰减项  来修改代价函数,这个衰减项会惩罚过大的参数值,现在我们的代价函数变为:

来修改代价函数,这个衰减项会惩罚过大的参数值,现在我们的代价函数变为:

![\begin{align}

J(\theta) = - \frac{1}{m} \left[ \sum_{i=1}^{m} \sum_{j=1}^{k} 1\left\{y^{(i)} = j\right\} \log \frac{e^{\theta_j^T x^{(i)}}}{\sum_{l=1}^k e^{ \theta_l^T x^{(i)} }} \right]

+ \frac{\lambda}{2} \sum_{i=1}^k \sum_{j=0}^n \theta_{ij}^2

\end{align}](http://ufldl.stanford.edu/wiki/images/math/4/7/1/471592d82c7f51526bb3876c6b0f868d.png)

有了这个权重衰减项以后 ( ),代价函数就变成了严格的凸函数,这样就可以保证得到唯一的解了。 此时的 Hessian矩阵变为可逆矩阵,并且因为

),代价函数就变成了严格的凸函数,这样就可以保证得到唯一的解了。 此时的 Hessian矩阵变为可逆矩阵,并且因为 是凸函数,梯度下降法和 L-BFGS 等算法可以保证收敛到全局最优解。

是凸函数,梯度下降法和 L-BFGS 等算法可以保证收敛到全局最优解。

softmax回归与logistic回归的关系:

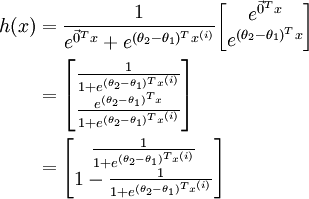

当类别数  时,softmax 回归退化为 logistic 回归。这表明 softmax 回归是 logistic 回归的一般形式。具体地说,当

时,softmax 回归退化为 logistic 回归。这表明 softmax 回归是 logistic 回归的一般形式。具体地说,当  时,softmax 回归的预测函数为:

时,softmax 回归的预测函数为:

利用softmax回归参数冗余的特点,我们令  ,并且从两个参数向量中都减去向量

,并且从两个参数向量中都减去向量  ,得到:

,得到:

因此,用  来表示

来表示 ,我们就会发现 softmax 回归器预测其中一个类别的概率为

,我们就会发现 softmax 回归器预测其中一个类别的概率为  ,另一个类别概率的为

,另一个类别概率的为  ,这与 logistic回归是一致的。

,这与 logistic回归是一致的。

softmax回归 vs k个二元分类器

如果你在开发一个音乐分类的应用,需要对k种类型的音乐进行识别,那么是选择使用 softmax 分类器呢,还是使用 logistic 回归算法建立 k 个独立的二元分类器呢?

这一选择取决于你的类别之间是否互斥,例如,如果你有四个类别的音乐,分别为:古典音乐、乡村音乐、摇滚乐和爵士乐,那么你可以假设每个训练样本只会被打上一个标签(即:一首歌只能属于这四种音乐类型的其中一种),此时你应该使用类别数 k = 4 的softmax回归。(如果在你的数据集中,有的歌曲不属于以上四类的其中任何一类,那么你可以添加一个“其他类”,并将类别数 k 设为5。)

如果你的四个类别如下:人声音乐、舞曲、影视原声、流行歌曲,那么这些类别之间并不是互斥的。例如:一首歌曲可以来源于影视原声,同时也包含人声 。这种情况下,使用4个二分类的 logistic 回归分类器更为合适。这样,对于每个新的音乐作品 ,我们的算法可以分别判断它是否属于各个类别。

现在我们来看一个计算视觉领域的例子,你的任务是将图像分到三个不同类别中。(i) 假设这三个类别分别是:室内场景、户外城区场景、户外荒野场景。你会使用sofmax回归还是 3个logistic 回归分类器呢? (ii) 现在假设这三个类别分别是室内场景、黑白图片、包含人物的图片,你又会选择 softmax 回归还是多个 logistic 回归分类器呢?

在第一个例子中,三个类别是互斥的,因此更适于选择softmax回归分类器 。而在第二个例子中,建立三个独立的 logistic回归分类器更加合适。

参考:

http://ufldl.stanford.edu/wiki/index.php/Softmax%E5%9B%9E%E5%BD%92

https://en.wikipedia.org/wiki/Cross_entropy#Motivation logistic回归的损失函数既可以由最大似然估计推出,也可由交叉熵推出