spark与Scala版本对应问题

在阅读一些博客和资料中,发现安装spark与Scala是要严格遵守两者的版本对应关系,如果版本不对应会在之后的使用中出现许多问题。

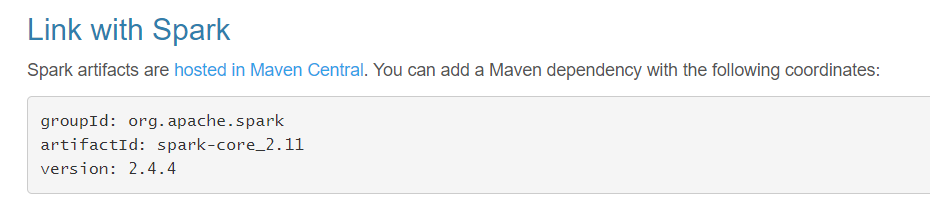

在安装时,我们可以在spark的官网中查到对应的Scala版本号,如spark2.4.4中对应的版本号为Scala2.11

spark官网:http://spark.apache.org/downloads.html,其中可以得到所需的版本信息

图中对应spark2.4.4需要使用Scala2.11版本,所以在下载安装时需要注意

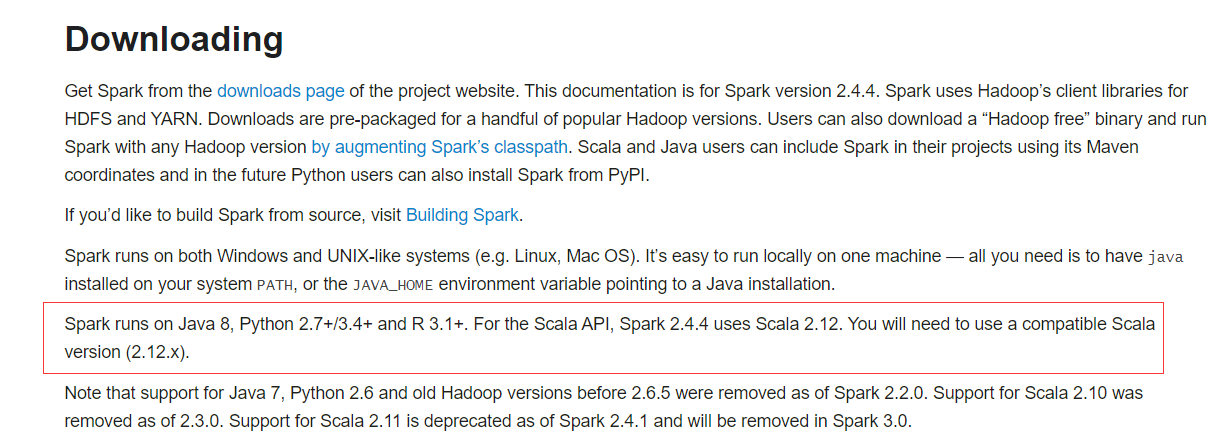

Spark官网相关说明中也有涉及https://spark.apache.org/docs/latest/index.html

另附一些看到的文章地址

迷之问题:Spark和Scala库的版本一致性:http://www.bigdatastudy.net/show.aspx?id=644&cid=9

关于spark与scala版本问题记录:https://www.cnblogs.com/little-horse/p/9665329.html

浙公网安备 33010602011771号

浙公网安备 33010602011771号