kubernetes使用kubeadm搭建集群详解

1.平台规划

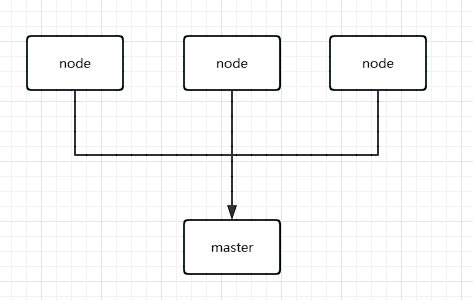

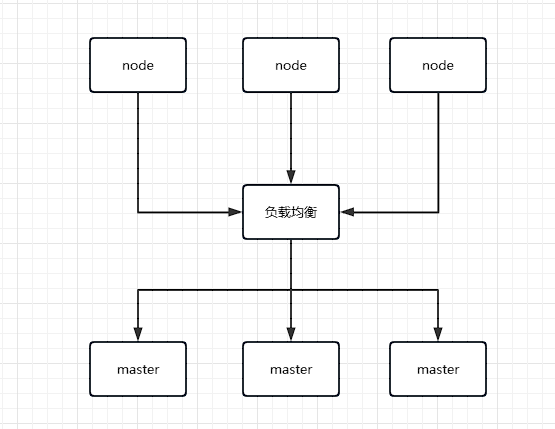

1.1 单master集群规划

1.2多master集群规划

2.生产环境的部署方式

2.1 kubeadm部署方式

kubeadm介绍:kubeadm是官方社区推出的一个用于快速部署kubernetes集群的工具,这个工具能通过两条指令完成一个kubernetes集群的部署

2.1.1 环境准备

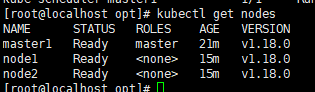

本次部署采用单master节点环境部署

| 系统版本 | 节点名称 | ip地址 |

|---|---|---|

| centos7.9 | master1 | 192.168.30.11 |

| centos7.9 | node1 | 192.168.30.15 |

| centos7.9 | node2 | 192.168.30.16 |

2.1.2 系统环境初始化

关闭防火墙

systemctl stop firewalld

systemctl disable firewalld

关闭selinux

sed -i 's/enforcing/disabled/' /etc/selinux/config #永久关闭

setenforce 0 # 临时

关闭swap分区

#这里的 sed 命令使用了替换模式 s/old/new/,其中 old 是一个正则表达式,匹配需要替换的文本,而 new 则是替换后的文本。

#在这个命令中,old 的正则表达式是 .*swap.*,它会匹配包含 swap 字符串的任何行。. 匹配除了换行符之外的任意字符,* 表示重复匹配前面的字符或表达式零次或多次。

#而 new 的值是 #&,其中 # 表示注释符号,& 表示与 old 匹配的文本,因此 #& 表示在匹配到的文本前面添加注释符号。

#因此,这个 sed 命令将会把 /etc/fstab 中包含 swap 的行全部注释掉,从而禁用 swap 分区

swapoff -a # 临时

sed -ri 's/.*swap.*/#&/' /etc/fstab

根据规划设置主机名

hostnamectl set-hostname master1

hostnamectl set-hostname node1

hostnamectl set-hostname node2

在master节点上添加host

cat > /etc/hosts << EOF

192.168.30.11 master1

192.168.30.15 node1

192.168.30.16 node2

EOF

将桥接的IPV4流量传递到iptables的链

cat > /etc/sysctl.d/k8s.conf << EOF

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

EOF

sysctl --system #生效

时间同步

yum install ntpdate -y

ntpdate time.windows.com

2.1.3 所有节点安装docker/kubeadm/kubelet

2.1.3.1 安装docker

wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo

yum -y install docker-ce-18.06.1.ce-3.el7

systemctl enable docker && systemctl start docker

docker --version

#Docker version 18.06.1-ce, build e68fc7a

cat > /etc/docker/daemon.json << EOF

{

"registry-mirrors": ["https://b9pmyelo.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"]

}

EOF

systemctl restart docker

docker info

2.1.3.2 添加阿里云yum软件源

cat > /etc/yum.repos.d/kubernetes.repo << EOF

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

2.1.3.3 安装kubeadm,kubelet和kubectl

yum install -y kubelet-1.18.0 kubeadm-1.18.0 kubectl-1.18.0

systemctl enable kubelet

2.1.4 部署kubernetes Master

在192.168.30.11j节点上执行

kubeadm init \

--apiserver-advertise-address=192.168.30.11 \

--image-repository registry.aliyuncs.com/google_containers \

--kubernetes-version v1.18.0 \

--service-cidr=10.96.0.0/12 \

--pod-network-cidr=10.244.0.0/16 \

--ignore-preflight-errors=all

- –apiserver-advertise-address 集群通告地址

- –image-repository 由于默认拉取镜像地址k8s.gcr.io国内无法访问,这里指定阿里云镜像仓库地址

- –kubernetes-version K8s版本,与上面安装的一致

- –service-cidr 集群内部虚拟网络,Pod统一访问入口

- –pod-network-cidr Pod网络,与下面部署的CNI网络组件yaml中保持一致

#有下面的提示继续

Your Kubernetes control-plane has initialized successfully!

To start using your cluster, you need to run the following as a regular user:

#执行下面的三个命令

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

You should now deploy a pod network to the cluster.

Run "kubectl apply -f [podnetwork].yaml" with one of the options listed at:

https://kubernetes.io/docs/concepts/cluster-administration/addons/

Then you can join any number of worker nodes by running the following on each as root:

#在node节点执行

kubeadm join 192.168.30.11:6443 --token yleibi.al0eadme7yh222iu \

--discovery-token-ca-cert-hash sha256:24e7168b3f12b422dce44ef74f25b0db115f51166a6224fecc1a2bbf5f8abfce

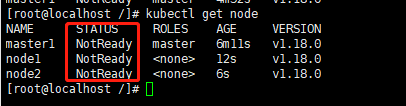

由于没有配置网络组建所以状态显示notready

默认token有效期为24小时,当过期之后,该token就不可用了。这时就需要重新创建token,可以直接使用命令快捷生成:

kubeadm token create --print-join-command

2.1.5部署CNI网络插件

master节点运行

kubectl apply -f https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

namespace/kube-flannel created

clusterrole.rbac.authorization.k8s.io/flannel created

clusterrolebinding.rbac.authorization.k8s.io/flannel created

serviceaccount/flannel created

configmap/kube-flannel-cfg created

daemonset.apps/kube-flannel-ds created

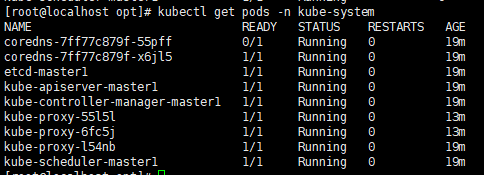

kubectl get pods -n kube-system #查看组件状态

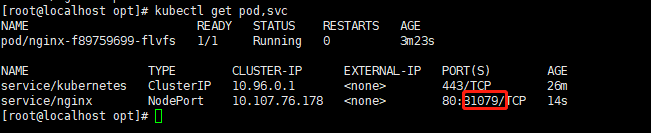

2.1.6测试kubernetes集群

在集群中创建一个pod,验证是否正常运行

kubectl create deployment nginx --image=nginx

kubectl expose deployment nginx --port=80 --type=NodePort

kubectl get pod,svc

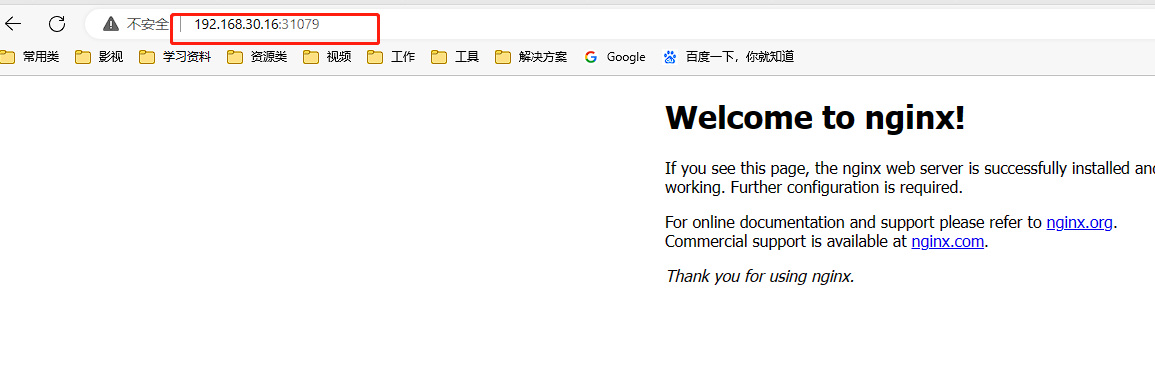

浏览器访问,任意node节点的ip地址加31079端口,验证。

2.2 二进制部署方式

2.2.1 环境准备

| 系统版本 | 节点名称 | ip地址 |

|---|---|---|

| centos7.9 | master | 192.168.30.21 |

| centos7.9 | node | 192.168.30.22 |

2.2.2 操作系统初始化

参考2.1.2

2.2.3 搭建etcd集群

2.2.3.1 配置工作目录

#创建配置文件和证书文件存放目录,多节点同时操作

mkdir -p /etc/etcd/ssl

2.2.3.2 安装签发证书工具 cfssl

mkdir /data/work -p

cd /data/work/

#cfssl-certinfo_linux-amd64 cfssljson_linux-amd64 cfssl_linux-amd64 上传到/data/work/目录下

#把文件变成可执行权限

chmod +x *

mv cfssl_linux-amd64 /usr/local/bin/cfssl

mv cfssljson_linux-amd64 /usr/local/bin/cfssljson

mv cfssl-certinfo_linux-amd64 /usr/local/bin/cfssl-certinfo

2.2.3.3 配置安装ca证书

生成ca证书请求文件

vim ca-csr.json

{

"CN":"kubernetes",

"key": {

"algo":"rsa",

"size": 2048

},

"names": [

{

"C":"CN",

"L":"Beijing",

"ST":"Beijing",

"O":"k8s",

"OU":"System"

}

]

}

生成证书文件

vim ca-config.json

{

"signing": {

"default": {

"expiry": "87600h"

},

"profiles": {

"kubernetes": {

"usages": [

"signing",

"key encipherment",

"server auth",

"client auth"

],

"expiry": "87600h"

}

}

}

}

cfssl gencert -initca ca-csr.json | cfssljson -bare ca

2.2.3.4 生成etcd证书

配置 etcd 证书请求,hosts 的 ip 变成自己 etcd 所在节点的 ip

vim etcd-csr.json

{

"CN": "etcd",

"hosts": [

"192.168.30.21",

"192.168.30.22"

],

"key": {

"algo": "rsa",

"size": 2048

},

"names": [

{

"C": "CN",

"ST": "BeiJing",

"L": "BeiJing"

}

]

}

#执行

cfssl gencert -ca=ca.pem -ca-key=ca-key.pem -config=ca-config.json -profile=kubernetes etcd-csr.json | cfssljson -bare etcd

ls etcd*.pem

# etcd-key.pem etcd.pem

2.2.3.5 部署etcd集群

下载etcd-v3.4.13-linux-amd64.tar.gz,并将文件放入/data/work目录下

tar -xf etcd-v3.4.13-linux-amd64.tar.gz

cp -ar etcd-v3.4.13-linux-amd64/etcd* /usr/local/bin/

chmod +x /usr/local/bin/etcd*

# 同样拷贝到其他节点下,ip根据自己的环境修改

scp -r etcd-v3.4.13-linux-amd64/etcd* root@192.168.30.22:/usr/local/bin/

#其他节点执行

chmod +x /usr/local/bin/etcd*

创建配置文件,并赋予可执行权限!!!!

vim /etc/etcd/etcd.conf

#[Member]

ETCD_NAME="etcd1"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.30.21:2380"

ETCD_LISTEN_CLIENT_URLS="https://192.168.30.21:2379"

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.30.21:2380"

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.30.21:2379"

ETCD_INITIAL_CLUSTER="etcd1=https://192.168.30.21:2380,etcd2=https://192.168.30.22:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

ETCD_NAME:节点名称,集群中唯一

ETCD_DATA_DIR:数据目录

ETCD_LISTEN_PEER_URLS:集群通信监听地址

ETCD_LISTEN_CLIENT_URLS:客户端访问监听地址

ETCD_INITIAL_ADVERTISE_PEER_URLS:集群通告地址

ETCD_ADVERTISE_CLIENT_URLS:客户端通告地址

ETCD_INITIAL_CLUSTER:集群节点地址

ETCD_INITIAL_CLUSTER_TOKEN:集群 Token

ETCD_INITIAL_CLUSTER_STATE:加入集群的当前状态,new 是新集群,existing 表示加入已有集群

创建启动服务文件

vim /usr/lib/systemd/system/etcd.service

[Unit]

Description=Etcd Server

After=network.target

After=network-online.target

Wants=network-online.target

[Service]

Type=notify

EnvironmentFile=-/etc/etcd/etcd.conf

WorkingDirectory=/var/lib/etcd/

ExecStart=/usr/local/bin/etcd \

--cert-file=/etc/etcd/ssl/etcd.pem \

--key-file=/etc/etcd/ssl/etcd-key.pem \

--trusted-ca-file=/etc/etcd/ssl/ca.pem \

--peer-cert-file=/etc/etcd/ssl/etcd.pem \

--peer-key-file=/etc/etcd/ssl/etcd-key.pem \

--peer-trusted-ca-file=/etc/etcd/ssl/ca.pem \

--peer-client-cert-auth \

--client-cert-auth

Restart=on-failure

RestartSec=5

LimitNOFILE=65536

[Install]

WantedBy=multi-user.target

#一定要可执行权限!!!!

chmod +x /usr/lib/systemd/system/etcd.service

把etcd的证书都拷贝到一开始创建证书目录下,并拷贝到其他节点(节点多的可以用for循环拷贝)

#配置文件也要拷贝过去 etcd.service etcd.conf

cp ca*.pem /etc/etcd/ssl/

cp etcd*.pem /etc/etcd/ssl/

启动 etcd 集群

#所有节点执行

mkdir -p /var/lib/etcd/default.etcd

修改其他节点配置文件

vim /etc/etcd/etcd.conf

#[Member]

ETCD_NAME="etcd2"

ETCD_DATA_DIR="/var/lib/etcd/default.etcd"

ETCD_LISTEN_PEER_URLS="https://192.168.30.22:2380" #这里

ETCD_LISTEN_CLIENT_URLS="https://192.168.30.22:2379" #这里

#[Clustering]

ETCD_INITIAL_ADVERTISE_PEER_URLS="https://192.168.30.22:2380"#这里

ETCD_ADVERTISE_CLIENT_URLS="https://192.168.30.22:2379"#这里

ETCD_INITIAL_CLUSTER="etcd1=https://192.168.30.21:2380,etcd2=https://192.168.30.22:2380"

ETCD_INITIAL_CLUSTER_TOKEN="etcd-cluster"

ETCD_INITIAL_CLUSTER_STATE="new"

#我只有两个节点,所以只需要将配置文件里的ip改为本机ip即可

启动etcd服务

#所有节点都需要执行

systemctl daemon-reload

systemctl enable etcd.service

systemctl start etcd.service #多节点同时执行

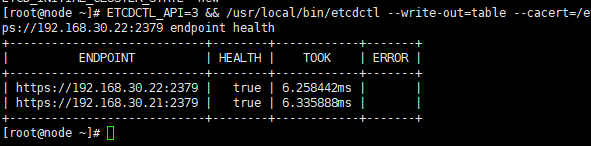

查看 etcd 集群

ETCDCTL_API=3 && /usr/local/bin/etcdctl --write-out=table --cacert=/etc/etcd/ssl/ca.pem --cert=/etc/etcd/ssl/etcd.pem --key=/etc/etcd/ssl/etcd-key.pem --endpoints=https://192.168.30.21:2379,https://192.168.30.22:2379 endpoint health

37edb4e0-0b9f-4cf0-ab79-817ca9138612

2.2.4 后续步骤参考这位大佬的二进制部署步骤,我就不重复造轮子了

kubernetes使用二进制安装部署k8s的v1.23版本安装方法及详细步骤 - 记忆流年 - 博客园 (cnblogs.com)

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 别再用vector<bool>了!Google高级工程师:这可能是STL最大的设计失误

· 单元测试从入门到精通

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理

· 上周热点回顾(3.3-3.9)