8 字符编码

学习字符编码的计算机基础储备

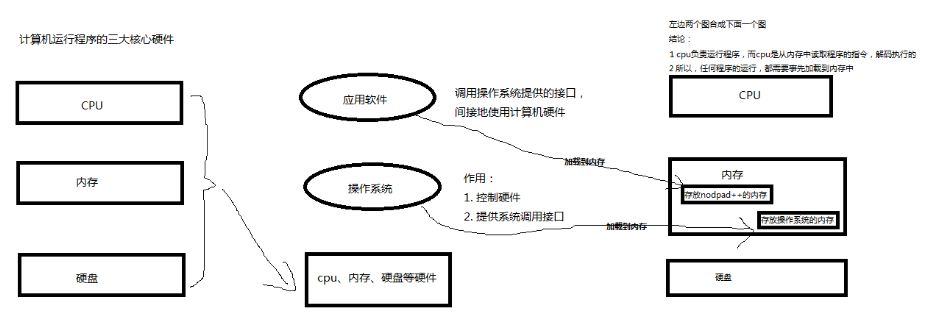

1、计算机软件运行基础图解

2、文本编辑器存取文件原理。(nodepad++,pycharm,word)

打开编辑器就打开了一个进程,是在内存中的,所以在编辑器编写的内容也都是存放与内存中的,断电后数据丢失。因而需要保存到硬盘上,点击保存按钮,就从内存中把数据刷到了硬盘上。

在这一点上,我们编写一个py文件(没有执行),跟编写其他文件没有任何区别,都只是在编写一堆字符而已。

3. python解释器执行py文件的原理 ,例如python test.py

第一阶段:python解释器启动,此时就相当于启动了一个文本编辑器,进入内存

第二阶段:python解释器相当于文本编辑器,去打开test.py文件,从硬盘上将test.py的文件内容读入到内存中(小复习:pyhon的解释性,决定了解释器只关心文件内容,不关心文件后缀名)

第三阶段:python解释器解释执行刚刚加载到内存中test.py的代码( ps:在该阶段,即执行时,才会识别python的语法,执行文件内代码,执行到name="egon",会开辟内存空间存放字符串"egon")

在前两个阶段中python解释器和文本编辑器是相同的唯一的不同是到了第三个阶段文本编辑器将内容读入内存是为了显示/编辑,而python解释器是为了执行。

什么是字符编码

计算机只认识又0,1组成的数字。而我们平时在使用计算机时,用的都是人类能读懂的字符(用高级语言编程的结果也无非是在文件内写了一堆字符)。想让计算机看得懂我们所写的内容必须经过一个过程:

字符---------->翻译过程---------->数字

这个过程实际就是一个字符如何对应一个特定数字的标准,这个标准称之为字符编码

以下两个场景下涉及到字符编码的问题:

1. 一个python文件中的内容是由一堆字符组成的(python文件未执行时)

2. python中的数据类型字符串是由一串字符组成的(python文件执行时)

字符编码的发展

1、ASCII

现代计算机起源于美国,最早诞生也是基于英文考虑的ASCII

ASCII:一个Bytes代表一个字符(英文字符/键盘上的所有其他字符),1Bytes=8bit,8bit可以表示0-2**8-1种变化,即可以表示256个字符

ASCII最初只用了后七位,127个数字,已经完全能够代表键盘上所有的字符了(英文字符/键盘的所有其他字符)后来为了将拉丁文也编码进了ASCII表,将最高位也占用了

2、百花齐放

为了满足中文,中国人定制了GBK

GBK:2Bytes代表一个字符

为了满足其他国家,各个国家纷纷定制了自己的编码

日本把日文编到Shift_JIS里,韩国把韩文编到Euc-kr里 ... ...

3、分久必合终归一统

各国有各国的标准,就会不可避免地出现冲突,结果就是,在多语言混合的文本中,显示出来会有乱码。于是产生了unicode,统一用2Bytes代表一个字符,2**16-1=65535,可代表6万多个字符,因而兼容万国语言

但对于通篇都是英文的文本来说,这种编码方式无疑是多了一倍的存储空间。于是产生了UTF-8,对英文字符只用1Bytes表示,对中文字符用3Bytes

4、注意:

unicode:简单粗暴,所有字符都是2Bytes,优点是字符->数字的转换速度快,缺点是占用空间大

utf-8:精准,对不同的字符用不同的长度表示,优点是节省空间,缺点是:字符->数字的转换速度慢,因为每次都需要计算出字符需要多长的Bytes才能够准确表示

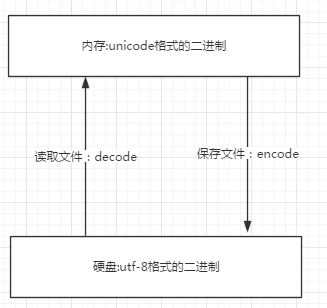

1)内存中使用的编码是unicode,用空间换时间(程序都需要加载到内存才能运行,因而内存应该是尽可能的保证快)

2)硬盘中或者网络传输用utf-8,网络I/O延迟或磁盘I/O延迟要远大与utf-8的转换延迟,而且I/O应该是尽可能地节省带宽,保证数据传输的稳定性。

字符编码的实际应用

unicode----->encode-------->utf-8

utf-8-------->decode---------->unicode

1、乱码

文件从内存刷到硬盘的操作简称存文件

文件从硬盘读到内存的操作简称读文件

1)乱码一:存文件时已乱码

例如存文件时,由于文件内有各个国家的文字,我们单以日本的编码shiftjis去存,

本质上其他国家的文字由于在shiftjis中没有找到对应关系而导致存储失败,'你瞅啥'在shiftjis中找不到对应关系'何を見て\n'可以找到对应关系。但当我们用文件编辑器去存的时候,编辑器会帮我们做转换,保证中文也能用shiftjis存储(硬存,必然乱码),这就导致了,存文件阶段就已经发生乱码此时当我们用shiftjis打开文件时,日文可以正常显示,而中文则乱码了。或者:

f=open('a.txt','wb') f.write('何を見て\n'.encode('shift_jis')) f.write('你愁啥\n'.encode('gbk')) f.write('你愁啥\n'.encode('utf-8')) f.close()

以任何编码打开文件a.txt都会出现其余两个无法正常显示的问题(open,write是下一个文件处理的知识点不是大家的关注点,只需要看编码部分即可)

2)乱码二:存文件是没乱码读文件时乱码

存文件时用utf-8编码,保证兼容万国,不会乱码,而读文件时选择了错误的解码方式,比如gbk,则在读阶段发生乱码,读阶段发生乱码是可以解决的,选对正确的解码方式就ok了,而存文件时乱码,则是一种数据的损坏。

总结:

无论是何种编辑器,要防止文件出现乱码核心法则就是,文件以什么编码保存的,就以什么编码方式打开

2、注意:

文件test.py以gbk格式保存,内容为:x='林'

无论是python2 test.py

还是python3 test.py

都会报错(因为python2默认ascii,python3默认utf-8)

除非在文件开头指定#coding:gbk

重点总结

1、以什么编码存的就要以什么编码取出

ps:内存固定使用unicode编码,

我们可以控制的编码是往硬盘存放或者基于网络传输选择编码

2、数据是最先产生于内存中,是unicode格式,要想传输需要转成bytes格式

#unicode----->encode(utf-8)------>bytes

拿到bytes,就可以往文件内存放或者基于网络传输

#bytes------>decode(gbk)------->unicode

3、python3中字符串被识别成unicode

python3中的字符串encode得到bytes

4、了解

python2中的字符串就bytes

python2中在字符串前加u,就是unicode