【大数据面试】【框架】Flume:Source的断点续传、重复数据、Channel选择

〇、用途

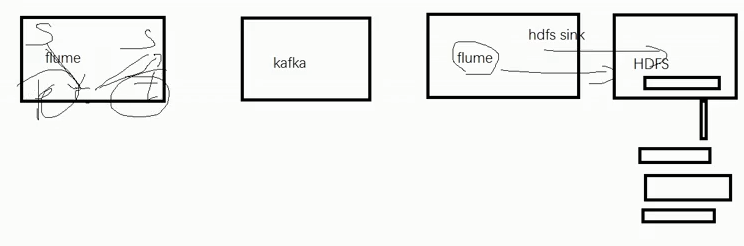

流式结构

获取磁盘日志,拦截器过滤后,传递指定数据,写入HDFS或kafka

一、组成-Source、Channel、Sink

事务(put/take)

1、Source---taildir source:

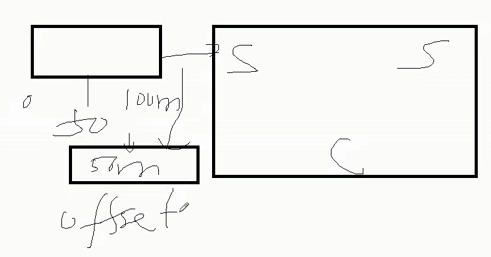

(1)特点:断点续传+多目录(维护offset)

产生自哪个版本-Apache Flume1.7,CDH 1.6

(2)没有断点续传功能时如何使用?自定义方式实现

(3)taildir挂掉怎么办,是否有影响

首先不会丢数(断点续传),但是会产生重复数据(一条或一批次)

读取成功,写入失败

(4)怎么处理重复数据?

生产环境下通常不处理,处理方案

自身:可以在taildir source内部增加自定义事务

找兄弟:下一级处理(sparkStreaming、hive、dwd、flink过滤器),手段(group by去重、开窗取窗口最小,只取第一条、Redis集群帮助去重)

(5)taildir source是否支持递归遍历文件夹读取文件?

不支持,需要自定义

递归遍历文件夹+读取文件

2、Channel

(1)常见的Channel包括哪些及对应的特点

File Channel:数据存储在磁盘上(数据可靠性高、传输速度低),默认存储容量:100w个event

Memory Channel:数据存储于内存(传输速度快、可靠性差),默认容量是100个event

Kafka Channel:数据存储于kafka/基于磁盘(数据可靠性高、传输速度也快【kafka Channel》kafka sink+Memory Channel,原因:省去了sink阶段】),在flume 1.6版本产生(原因:有bug,可以设置前缀是否带topic,但不起作用)

kafka-topic_start/topic_event,增加了额外清洗的工作量,Flume 1.7解决了该问题

(2)生产环境下如何选择

如果下一级是kafka,通常会优先选择kafka channel

如果下一级不是kafka,金融、对钱要求准确的公司,选择File Channel

如果是普通日志,通常会选择memory Channel(JD每天丢失几百万数据,每天都是PB级数据)

3、HDFS sink

不做控制,会直接落盘,产生大量小文件

可以通过参数控制:时间、大小、event的个数【或】

时间:3600-7200s(1小时-2小时)

大小:128M

event的个数(0禁止)

二、三个器(拦截器、选择器、监控器)

1、拦截器

ETL拦截器、分类型拦截器

(1)ETL拦截器

实现:数据轻度清洗(判断是否是大括号开头结尾,为了保证传输效率/实时性)

判断了数据时间:13位,必须全部是数字

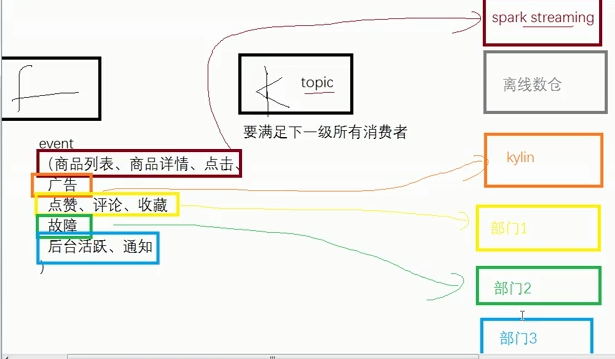

(2)分类型拦截器(11张表)

start

event(商品列表、商品详情、商品点击、

广告、

点赞、评论、收藏、故障、

后台活跃、通知)

哪张表与kafka有关系,要满足所有下一级消费者

创建成特定类,不产生重复数据,针对每个表创建一个topic

一张表一个topic,一定能满足下一级消费者

为了效率,可以做适当的聚合

(3)自定义拦截器的步骤

定义一个类,实现interceptor接口,重写内部的4个方法:

初始化、关闭、单event、多event、同时创建一个静态内部类Builder

打包==》上传至flume的lib包下==》在配置文件中关联拦截器

(4)可以不使用拦截器吗

可以不用,但需要在下一级hive的DWD层或sparkstreaming里面进行处理

(5)优势和劣势

优势:只处理一次,轻度处理,不会影响太多性能

劣势:影响性能,不适合像推荐这种对实时性要求比较高的场景

三、优化

1、File Channel可以配置多目录-多个磁盘

可以提高吞吐量

2、HDFS Sink

解决小文件:时间、大小、event的个数【或】

3、监控器

调整内存

找自己:提高自己内存

找朋友:增加flume台数

4、Flume挂掉后的操作

source挂掉,可能会产生重复数据(offset),使用事务解决

channel挂掉(File、Memory×、Kafka),会丢失100个event

本文来自博客园,作者:哥们要飞,转载请注明原文链接:https://www.cnblogs.com/liujinhui/p/15675023.html