关于spark与scala版本问题记录

记录一下版本问题:

spark与scala版本对应问题:

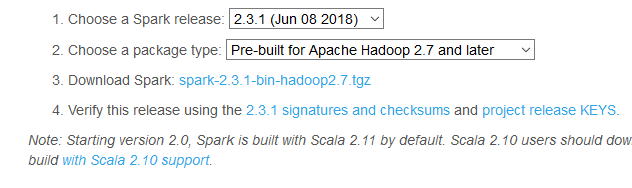

1.官网会给出,如下,spark2.3.1默认需要scala2.11版本

2.在maven依赖网中也可以看到,如下

3.关于idea开发版本中也可以看到所需要依赖的scala版本

通常在file->project structure->global libraries 右侧,点击加号将scala sdk加入后,最右侧有个下拉框,可以看到此idea支持的一些scala版本号

如果通过加入的scala sdk版本超出idea所需要的scala版本会无法使用

4.可以不通过上面的方式加入scala sdk,可以通过pom形式加入所需scala依赖项,也可以开发spark和scala程序

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· AI与.NET技术实操系列:向量存储与相似性搜索在 .NET 中的实现

· 基于Microsoft.Extensions.AI核心库实现RAG应用

· Linux系列:如何用heaptrack跟踪.NET程序的非托管内存泄露

· 开发者必知的日志记录最佳实践

· SQL Server 2025 AI相关能力初探

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 单元测试从入门到精通

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理

· 上周热点回顾(3.3-3.9)

· winform 绘制太阳,地球,月球 运作规律