llm_security(大模型内容安全)

项目地址:https://github.com/jiangnanboy/llm_security

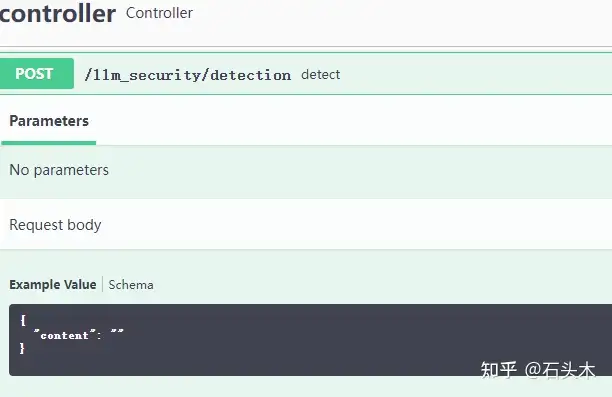

利用分类法和敏感词检测法对生成式大模型的输入和输出内容进行安全检测,尽早识别风险内容。

使用【ServiceApplication.java】

相关模型下载:https://github.com/jiangnanboy/text_security_audit

使用者可自行训练bert类相关模型,用本项目加载即可。

本项目采用java, springboot实现。

- 敏感词(sensitive word detection)

- 政治类(politics detection)

- 暴恐类(violence detection)

- 色情类(porn detection)

- 辱骂歧视类(insult detection)